Oprava dezinformací v AI

Zjistěte, jak identifikovat a opravit nesprávné informace o značce v AI systémech jako ChatGPT, Gemini a Perplexity. Objevte monitorovací nástroje, strategie op...

Zjistěte, jak požádat o opravy na AI platformách jako ChatGPT, Perplexity a Claude. Pochopte mechanismy oprav, procesy zpětné vazby a strategie, jak ovlivnit AI odpovědi týkající se vaší značky.

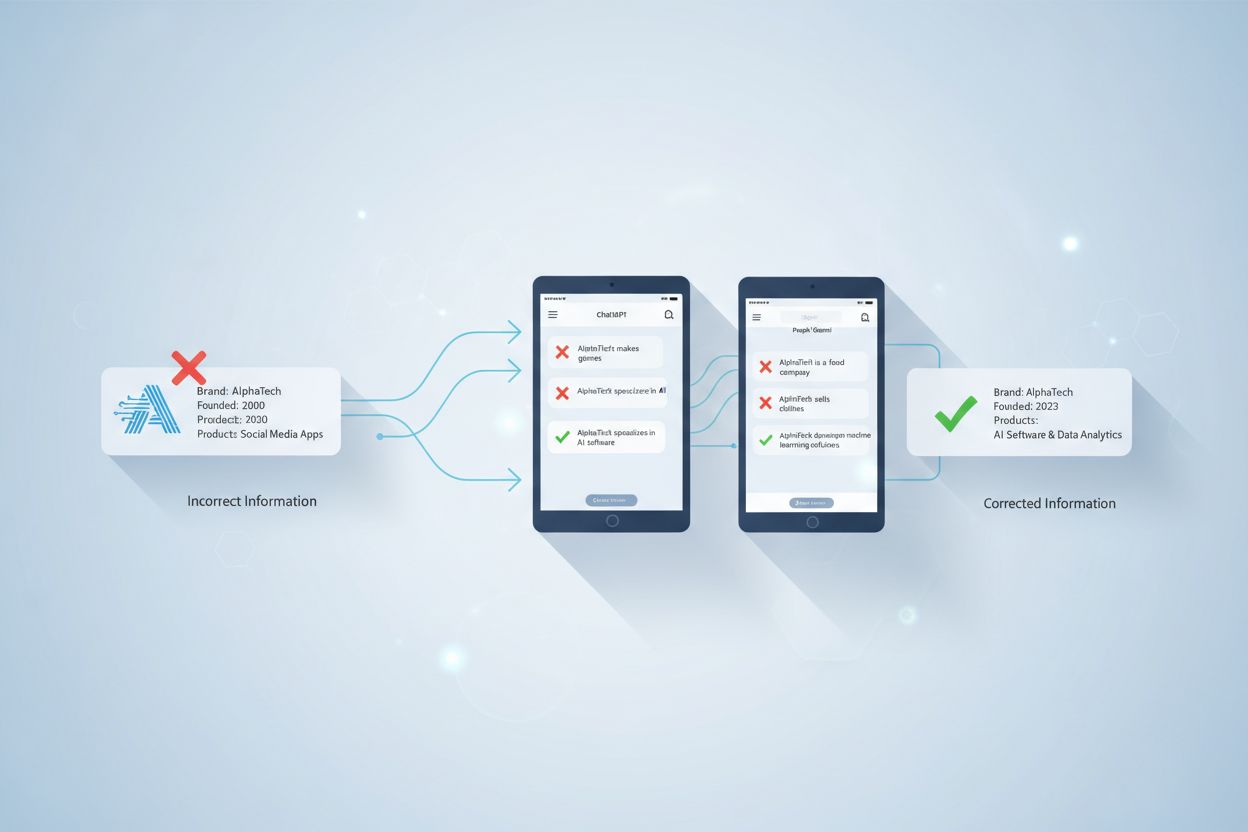

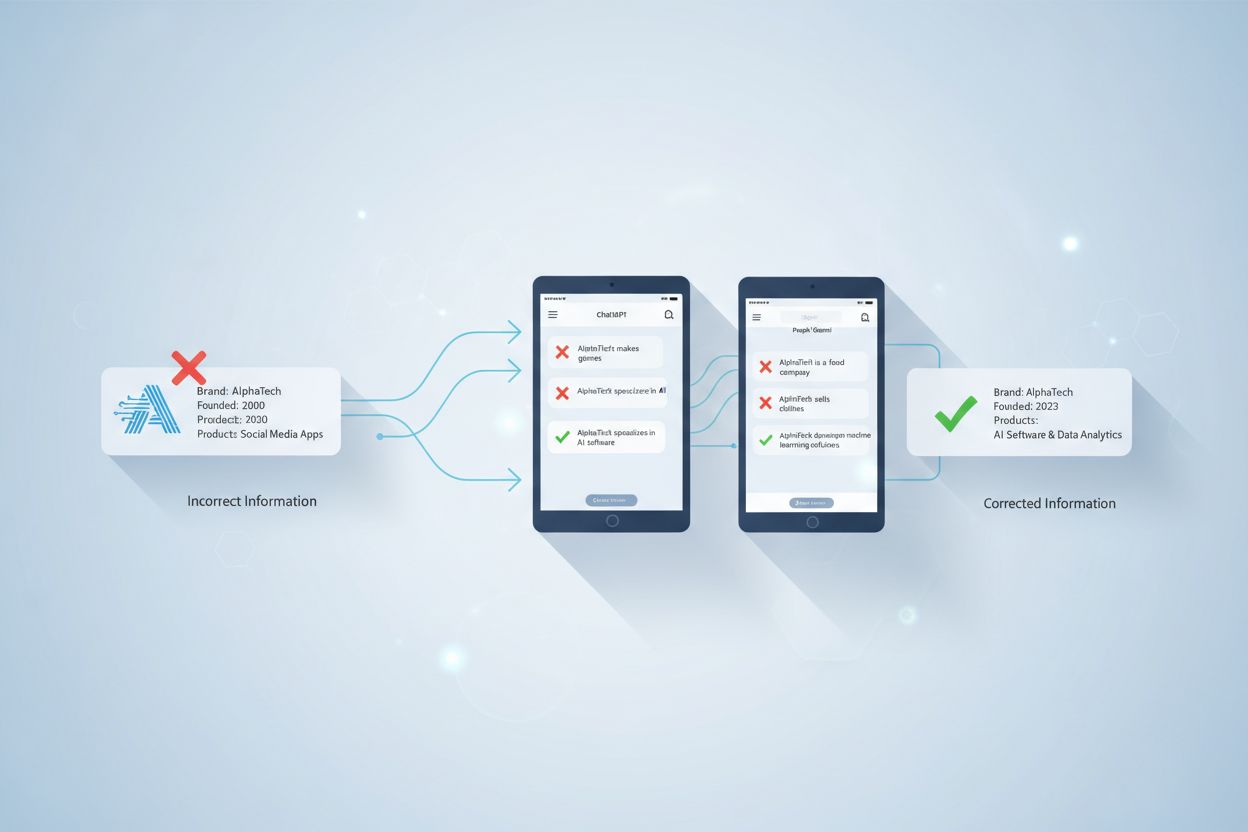

Přímé odstranění informací z trénovacích dat AI není možné, ale můžete žádat o opravy prostřednictvím mechanismů zpětné vazby, řešit nepřesnosti u jejich zdrojů a ovlivnit budoucí odpovědi AI tvorbou autoritativního pozitivního obsahu a spoluprací s podpůrnými týmy platforem.

Žádání o opravy na AI platformách vyžaduje pochopení základního fungování těchto systémů. Na rozdíl od tradičních vyhledávačů, kde můžete kontaktovat vlastníka webu a požádat o odstranění či aktualizaci obsahu, AI jazykové modely se učí z trénovacích dat během konkrétních trénovacích fází, kde zpracovávají miliardy webových stránek, zpravodajských článků a dalších textových zdrojů. Jakmile se negativní či nepřesné informace stanou součástí trénovacích dat, nelze je přímo smazat ani upravit tak, jak byste to mohli požadovat u vlastníka webu. AI si během tréninkového cyklu vytvoří vzorce a asociace z mnoha zdrojů.

Proces oprav se výrazně liší u statických a real-time AI systémů. Statické modely jako GPT-4 jsou natrénované na datech do určitého data (například prosinec 2023 pro GPT-4-turbo) a po natrénování si své znalosti uchovávají až do dalšího cyklu. Real-time AI systémy jako Perplexity a Claude.ai čerpají aktuální webový obsah, takže opravy přímo ve zdrojích mohou mít okamžitý efekt v jejich odpovědích. Je zásadní vědět, s jakým typem AI platformy pracujete, abyste mohli zvolit nejúčinnější strategii opravy.

Většina hlavních AI platforem nabízí vestavěné mechanismy zpětné vazby, které uživatelům umožňují nahlásit nepřesnosti. Například ChatGPT obsahuje tlačítka palec nahoru a dolů u odpovědí, díky kterým mohou uživatelé označit problematické odpovědi. Pokud dáte negativní zpětnou vazbu na nepřesnou odpověď, platforma tuto informaci sbírá a analyzuje její tým. Tyto zpětnovazební smyčky pomáhají AI systémům zlepšovat se na základě úspěšných i chybných výsledků. Zpětná vazba, kterou zadáte, se stává součástí dat, která vývojáři využívají k identifikaci vzorců chyb a zvýšení přesnosti modelu.

Perplexity a Claude nabízejí podobné možnosti zpětné vazby přímo ve svém rozhraní. Obvykle můžete nahlásit, když je odpověď nepřesná, zavádějící nebo obsahuje zastaralé informace. Některé platformy umožňují uvést konkrétní opravy nebo upřesnění. Efektivita této zpětné vazby závisí na tom, kolik uživatelů stejný problém nahlásí a jak závažná nepřesnost je. Platformy upřednostňují opravy u rozšířených problémů, které ovlivňují mnoho uživatelů, takže pokud více lidí nahlásí stejnou nepřesnost týkající se vaší značky, platforma má větší motivaci ji prověřit a řešit.

Nejúčinnější dlouhodobou strategií pro nápravu AI-generovaných dezinformací je řešení původního zdroje nepřesných informací. Protože se AI systémy učí z webového obsahu, zpravodajských článků, záznamů na Wikipedii a dalších publikovaných materiálů, oprava přímo v těchto zdrojích ovlivní, jak budou AI platformy informace prezentovat v příštích trénovacích cyklech. Požádejte původní vydavatele, kde se nepřesná informace objevuje, o opravu nebo aktualizaci. Pokud mediální dům zveřejnil nepravdivou informaci o vaší značce, kontaktujte redakci s důkazy a požádejte o opravu či upřesnění.

Wikipedie představuje obzvlášť důležitý zdroj trénovacích dat AI. Pokud se na Wikipedii objeví nepřesné údaje o vaší značce nebo doméně, řešte to přes odpovídající editační kanály platformy. Wikipedie má specifické procesy pro zpochybňování informací a žádosti o opravu, přičemž je nutné dodržovat pravidla neutrality a ověřitelnosti. Vysoce autoritativní zdroje jako Wikipedie, hlavní zpravodajské organizace, vzdělávací instituce a vládní weby mají v trénovacích datech AI značnou váhu. Opravy v těchto zdrojích mají větší šanci být zahrnuty do budoucích aktualizací AI modelů.

U neaktuálních nebo nepřesných informací na vlastním webu nebo kontrolovaných webech je důležité je co nejdříve aktualizovat nebo odstranit. Veďte si záznamy o všech změnách, protože tyto aktualizace mohou být zahrnuty v příštích trénovacích cyklech. Když opravíte informace na vlastní doméně, poskytujete AI systémům přesnější zdrojový materiál pro budoucí učení.

Namísto zaměření pouze na odstranění negativních nebo nepřesných informací vytvářejte silné proti-narativy s autoritativním pozitivním obsahem. AI modely hodnotí informace částečně na základě četnosti a autority zdrojů v trénovacích datech. Pokud vytvoříte podstatně více pozitivního, přesného a autoritativního obsahu, než existuje nepřesných informací, AI systémy budou při vytváření odpovědí o vaší značce čerpat především z pozitivních zdrojů.

| Typ obsahu | Úroveň autority | Dopad na AI | Časový horizont |

|---|---|---|---|

| Profesionální biografie | Vysoká | Okamžitý vliv na odpovědi | Týdny až měsíce |

| Odborné publikace a thought leadership | Velmi vysoká | Silná váha v AI odpovědích | Měsíce |

| Tiskové zprávy přes hlavní zpravodajské služby | Vysoká | Významný vliv na narativy | Týdny až měsíce |

| Případové studie a úspěšné příběhy | Středně vysoká | Kontextová podpora pozitivních tvrzení | Měsíce |

| Akademické či výzkumné publikace | Velmi vysoká | Dlouhodobý vliv v trénovacích datech | Měsíce až roky |

| Záznamy na Wikipedii | Velmi vysoká | Klíčové pro budoucí AI trénink | Měsíce až roky |

Vytvářejte ucelený obsah napříč několika důvěryhodnými platformami, aby AI systémy narazily na autoritativní pozitivní informace. Tato strategie nasycení obsahu je obzvlášť účinná, protože řeší příčinu AI dezinformací – nedostatek pozitivních informací, které by vyvážily nepřesná tvrzení. Když mají AI systémy přístup k více pozitivním, podloženým informacím z autoritativních zdrojů, přirozeně generují příznivější odpovědi o vaší značce.

Různé AI platformy mají odlišnou architekturu a aktualizační cykly, což vyžaduje přizpůsobené přístupy k opravám. ChatGPT a další systémy založené na GPT se opírají o platformy zahrnuté před tréninkovým cut-offem: hlavní zpravodajské weby, Wikipedii, profesní adresáře a hojně citovaný webový obsah. Protože tyto modely nejsou aktualizovány v reálném čase, opravy provedené dnes ovlivní budoucí tréninkové cykly, obvykle za 12–18 měsíců. Perplexity a real-time AI vyhledávače integrují aktuální webový obsah, proto má silná SEO a stálá mediální viditelnost okamžitý efekt. Když odstraníte nebo opravíte obsah na webu, Perplexity na něj obvykle přestane odkazovat během dnů nebo týdnů.

Claude a systémy Anthropic upřednostňují faktické a dobře doložené informace. Anthropic klade důraz na faktickou spolehlivost, proto zajistěte, aby pozitivní obsah o vaší značce byl ověřitelný a odkazoval na důvěryhodné zdroje. Při žádosti o opravu u Claude se zaměřte na doložená upřesnění a odkažte na autoritativní zdroje, které podporují správné informace. Klíčem je pochopit, že každá platforma má jiné datové zdroje, frekvenci aktualizací a standardy kvality. Přizpůsobte tomu svou strategii oprav.

Pravidelné testování, jak AI systémy popisují vaše jméno nebo značku, je zásadní pro sledování efektivity oprav. Zkoušejte dotazy v ChatGPT, Claude, Perplexity a dalších platformách s pozitivní i negativní formulací (například „Je [značka] důvěryhodná?“ versus „[značka] úspěchy“). Zaznamenávejte výsledky v čase a sledujte pokrok, abyste identifikovali nepřesnosti a měřili, zda se díky vašim opravám mění narativ. Toto monitorování vám umožní rychle reagovat při výskytu nových nepřesností. Pokud zjistíte, že AI platforma stále odkazuje na zastaralé nebo nesprávné informace týdny po opravě zdroje, můžete problém eskalovat přes podporu platformy.

Veďte si záznamy o všech požadovaných opravách a odpovědích, které obdržíte. Tato dokumentace má několik funkcí: slouží jako důkaz při případné eskalaci, pomáhá identifikovat vzorce v přístupu různých platforem k opravám a dokládá vaši snahu udržovat přesné informace. Zaznamenávejte, kdy jste zpětnou vazbu zadali, jakou nepřesnost jste nahlásili a případné reakce platformy.

Úplné odstranění nepřesných informací z AI vyhledávání je jen zřídka možné, ale rozředění a budování kontextu jsou dosažitelné cíle. Většina AI společností aktualizuje trénovací data periodicky, u hlavních jazykových modelů obvykle každých 12–18 měsíců. To, co uděláte dnes, ovlivní budoucí iterace, ale mezi žádostí o opravu a jejím promítnutím do AI odpovědí je třeba počítat s časovým odstupem. Úspěch vyžaduje trpělivost a konzistenci. Zaměřením na tvorbu autoritativního obsahu, řešení nepřesností u zdrojů a budování důvěryhodnosti můžete postupně ovlivnit, jak AI platformy vaši značku prezentují.

AI vyhledávače v reálném čase jako Perplexity mohou ukázat výsledky během týdnů či měsíců, zatímco statické modely jako ChatGPT mohou potřebovat 12–18 měsíců k promítnutí oprav do základního modelu. Přesto se mohou dílčí zlepšení projevit dříve, pokud platforma vydá aktualizovanou verzi nebo jemně doladí určité aspekty modelu. Časová osa závisí také na rozšířenosti nepřesnosti a počtu uživatelů, kteří ji nahlásí. Rozšířené nepřesnosti ovlivňující mnoho uživatelů bývají řešeny rychleji než problémy mající dopad jen na několik osob.

V některých jurisdikcích máte právní možnosti pro řešení nepřesných nebo pomlouvačných informací. Pokud AI platforma generuje nepravdivé, pomlouvačné či škodlivé informace o vaší značce, můžete mít důvod k právnímu postupu. Právo na zapomenutí v příslušných jurisdikcích, zejména pod GDPR v Evropě, poskytuje další možnosti. Tyto zákony umožňují požádat o odstranění některých osobních údajů z výsledků vyhledávání a v některých případech také z trénovacích dat AI.

Kontaktujte právní tým AI platformy, pokud se domníváte, že informace porušují jejich podmínky nebo platné zákony. Většina platforem má procesy pro řešení právních stížností a žádostí o stažení obsahu. Uveďte jasné důkazy o nepřesnosti a vysvětlete, proč jde o porušení zákonů nebo pravidel platformy. Veďte si záznamy o veškeré komunikaci s platformou, abyste měli důkaz své snahy problém řešit.

Nejudržitelnějším způsobem, jak spravovat pověst v AI vyhledávání, je převýšit negativní informace konzistentní, autoritativní pozitivní prezentací. Pravidelně publikujte odborný obsah, udržujte aktuální profesní profily, usilujte o stabilní mediální pokrytí, budujte sítě, které posilují vaše úspěchy, a zdůrazňujte zapojení do komunity. Tento dlouhodobý přístup zajistí, že případné negativní nebo nepřesné pokrytí bude jen okrajovou poznámkou v celkovém narativu o vaší značce.

Implementujte strategické SEO pro budoucí AI trénink tím, že zajistíte vysoké pozice autoritativního obsahu ve vyhledávačích. Používejte strukturovaná data a schéma pro upřesnění kontextu, udržujte konzistentní NAP (název, adresa, telefon) a budujte kvalitní zpětné odkazy na důvěryhodný pozitivní obsah. Tyto kroky zvýší šanci, že pozitivní informace se stanou dominantním narativem v příštích cyklech AI tréninku. S tím, jak se AI systémy stávají sofistikovanějšími a více integrovanými do každodenního života, roste význam udržování přesných a autoritativních informací na webu. Investujte do své digitální prezentace nyní, abyste zajistili, že AI platformy budou mít o vaší značce přesné informace i v budoucnu.

Sledujte, jak se vaše značka, doména a URL adresy zobrazují v ChatGPT, Perplexity a dalších AI vyhledávačích. Získejte upozornění, když je potřeba opravit informace, a měřte dopad svých aktivit.

Zjistěte, jak identifikovat a opravit nesprávné informace o značce v AI systémech jako ChatGPT, Gemini a Perplexity. Objevte monitorovací nástroje, strategie op...

Zjistěte, jak aktualizace algoritmů ovlivňují viditelnost v AI vyhledávání napříč ChatGPT, Perplexity, Google AI Overviews a Claude. Poznejte faktory hodnocení ...

Zjistěte, jak přepracovat a optimalizovat obsah pro AI platformy jako ChatGPT, Perplexity a Claude. Objevte strategie pro AI viditelnost, strukturu obsahu a zís...