Které AI crawlery povolit? Kompletní průvodce pro rok 2025

Zjistěte, které AI crawlery povolit nebo blokovat ve vašem robots.txt. Komplexní průvodce zahrnující GPTBot, ClaudeBot, PerplexityBot a 25+ AI crawlerů s ukázka...

Naučte se, jak identifikovat a monitorovat AI crawlery jako GPTBot, PerplexityBot a ClaudeBot ve vašich serverových logách. Objevte user-agent řetězce, metody ověření IP a osvědčené postupy pro sledování AI provozu.

Identifikujte AI crawlery v serverových logách vyhledáváním specifických user-agent řetězců jako GPTBot, PerplexityBot a ClaudeBot pomocí příkazů grep. Ověřte pravost pomocí kontroly IP adres, sledujte vzorce požadavků a využívejte serverové analytické nástroje ke sledování AI bot provozu, který tradiční analytika přehlíží.

AI crawlery jsou automatizovaní roboti, kteří skenují webové stránky za účelem sběru dat pro trénink velkých jazykových modelů a pohánění AI odpovídacích enginů jako ChatGPT, Perplexity a Claude. Na rozdíl od tradičních vyhledávacích crawlerů, které primárně indexují obsah pro účely hodnocení, AI boti konzumují váš obsah pro trénink generativních AI systémů a poskytování odpovědí na uživatelské dotazy. Pochopení toho, jak tito crawlery interagují s vaším webem, je zásadní pro udržení kontroly nad vaším digitálním otiskem a zajištění správné prezentace vaší značky v AI generovaných odpovědích. Nárůst AI poháněného vyhledávání zásadně změnil způsob, jakým je obsah objevován a používán, což činí server-side monitoring nezbytným pro každou organizaci, které záleží na online přítomnosti.

Nejúčinnějším způsobem identifikace AI crawlerů je rozpoznání jejich user-agent řetězců ve vašich serverových logách. Tyto řetězce jsou unikátní identifikátory, které boti posílají s každým požadavkem, což vám umožňuje rozlišit různé typy automatizovaného provozu. Zde je přehledná tabulka hlavních AI crawlerů, které byste měli sledovat:

| Název crawleru | Dodavatel | User-Agent řetězec | Účel |

|---|---|---|---|

| GPTBot | OpenAI | Mozilla/5.0 (compatible; GPTBot/1.0; +https://openai.com/gptbot) | Sběr dat pro trénink GPT modelů |

| OAI-SearchBot | OpenAI | Mozilla/5.0 (compatible; OAI-SearchBot/1.0; +https://openai.com/searchbot) | Indexuje stránky pro ChatGPT hledání a citace |

| ChatGPT-User | OpenAI | Mozilla/5.0 (compatible; ChatGPT-User/1.0; +https://openai.com/chatgpt-user) | Načítá URL, když uživatelé žádají o konkrétní stránky |

| ClaudeBot | Anthropic | ClaudeBot/1.0 (+https://www.anthropic.com/claudebot) | Získává obsah pro citace v Claude |

| anthropic-ai | Anthropic | anthropic-ai | Sběr dat pro trénink modelů Claude |

| PerplexityBot | Perplexity | Mozilla/5.0 (compatible; PerplexityBot/1.0; +https://www.perplexity.ai/bot) | Indexuje weby pro vyhledávání Perplexity |

| Perplexity-User | Perplexity | Mozilla/5.0 (compatible; Perplexity-User/1.0; +https://www.perplexity.ai/bot) | Načítá stránky, když uživatelé kliknou na citace |

| Google-Extended | Mozilla/5.0 (compatible; Googlebot/2.1; +http://www.google.com/bot.html) | Řídí přístup pro trénink Gemini AI | |

| Bingbot | Microsoft | Mozilla/5.0 (compatible; bingbot/2.0; +http://www.bing.com/bingbot.htm) | Crawler pro Bing Search a Copilot |

| CCBot | Common Crawl | CCBot/2.0 (+https://commoncrawl.org/faq/) | Tvorba otevřených datasetů pro AI výzkum |

Apache serverové logy obsahují detailní informace o každém požadavku na váš web, včetně user-agent řetězce, který identifikuje požadujícího bota. Pro nalezení AI crawlerů ve vašich Apache access logách použijte příkaz grep se vzorem odpovídajícím známým AI bot identifikátorům. Tento postup vám umožní rychle filtrovat potenciálně miliony log záznamů a izolovat AI provoz.

Spusťte tento příkaz pro hledání více AI crawlerů:

grep -Ei "GPTBot|PerplexityBot|ClaudeBot|bingbot|Google-Extended|OAI-SearchBot|anthropic-ai" /var/log/apache2/access.log

Tento příkaz vrátí řádky jako:

66.249.66.1 - - [07/Oct/2025:15:21:10 +0000] "GET /blog/article HTTP/1.1" 200 532 "-" "Mozilla/5.0 (compatible; GPTBot/1.0; +https://openai.com/gptbot)"

Pro spočítání, kolikrát každý bot přistoupil na váš web, použijte tento rozšířený příkaz:

grep -Eo "GPTBot|PerplexityBot|ClaudeBot|bingbot" /var/log/apache2/access.log | sort | uniq -c | sort -rn

Tím získáte výstup zobrazující četnost jednotlivých crawlerů, což vám pomůže pochopit, které AI systémy váš obsah indexují nejaktivněji.

Nginx logy mají podobný formát jako Apache logy, ale mohou být uloženy na různých místech podle konfigurace vašeho serveru. Postup identifikace je stejný – hledáte konkrétní user-agent řetězce, které identifikují AI boty. Nginx logy obvykle obsahují stejné informace jako Apache logy, včetně IP adres, časových údajů, požadovaných URL a user-agent řetězců.

Pro hledání AI crawlerů v Nginx logách použijte:

grep -Ei "GPTBot|PerplexityBot|ClaudeBot|bingbot|Google-Extended|OAI-SearchBot" /var/log/nginx/access.log

Pro detailnější analýzu zobrazující IP adresy a user agenty společně:

grep -Ei "GPTBot|PerplexityBot|ClaudeBot|bingbot" /var/log/nginx/access.log | awk '{print $1, $4, $7, $12}' | head -20

Tento příkaz vytáhne IP adresu, časové razítko, požadovanou URL a user-agent řetězec, což vám poskytne komplexní pohled na to, jak jednotliví boti interagují s vaším webem. Číslo head -20 můžete zvýšit pro více záznamů nebo jej zcela odstranit pro zobrazení všech odpovídajících požadavků.

I když jsou user-agent řetězce hlavní metodou identifikace, podvrh botů je v AI crawler oblasti reálný problém. Někteří škodliví aktéři nebo dokonce legitimní AI společnosti byli přistiženi při používání falešných user-agent řetězců nebo nezveřejněných crawlerů, aby obešli omezení webových stránek. Pro ověření, že crawler je autentický, byste měli porovnat IP adresu s oficiálními rozsahy IP adres zveřejněnými provozovatelem bota.

OpenAI zveřejňuje oficiální rozsahy IP adres pro své crawlery na:

https://openai.com/gptbot.jsonhttps://openai.com/searchbot.jsonhttps://openai.com/chatgpt-user.jsonPro ověření, že IP adresa patří OpenAI, použijte reverse DNS lookup:

host 52.233.106.11

Pokud výsledek končí důvěryhodnou doménou jako openai.com, bot je autentický. Pro Microsoft Bingbot použijte jejich oficiální ověřovací nástroj na https://www.bing.com/toolbox/verify-bingbot. Pro Google crawlery proveďte reverse DNS lookup, který by měl končit na .googlebot.com.

Zásadní zjištění z nedávné serverové analýzy je, že většina AI crawlerů nevykonává JavaScript. To je zásadně odlišné od toho, jak se chovají lidské návštěvy webu. Tradiční analytické nástroje spoléhají na vykonávání JavaScriptu pro sledování návštěvníků, což znamená, že zcela přehlížejí provoz AI crawlerů. Když AI boti požadují vaše stránky, obdrží pouze počáteční HTML odpověď bez jakéhokoli klientského renderování obsahu.

To vytváří zásadní mezeru: pokud je váš klíčový obsah renderován pomocí JavaScriptu, AI crawlery jej vůbec nemusí vidět. To znamená, že váš obsah může být pro AI systémy neviditelný, i když je pro lidské návštěvníky dokonale viditelný. Server-side rendering (SSR) nebo zajištění, že klíčový obsah je dostupný v počáteční HTML odpovědi, se stává zásadním pro AI viditelnost. Důsledky jsou zásadní – weby silně závislé na JavaScriptových frameworkech mohou potřebovat restrukturalizovat svůj způsob doručování obsahu, aby zajistily, že AI systémy budou mít přístup k nejdůležitějším informacím.

Nedávné výzkumy odhalily znepokojivé chování některých AI crawlerů, kteří používají stealth taktiky k obcházení omezení webových stránek. Někteří crawlery rotují více IP adres, mění své user-agent řetězce a ignorují direktivy robots.txt, aby obešli preference vlastníků webů. Tito nezveřejnění crawlery často imitují standardní uživatelské agenty prohlížečů jako Chrome na macOS, což je činí nerozlišitelnými od legitimního lidského provozu při základní analýze logů.

Pro detekci stealth crawlerů hledejte vzorce jako:

Pokročilá detekce botů vyžaduje analýzu nejen user-agent řetězců, ale také vzorců požadavků, časování a behaviorálních signálů. Analytické nástroje s podporou strojového učení dokáží tyto vzorce identifikovat efektivněji než pouhé porovnávání řetězců.

Tradiční analytické platformy jako Google Analytics přehlížejí provoz AI crawlerů, protože tito boti nevykonávají JavaScript ani neudržují stav relace. Pro správné monitorování AI crawlerů potřebujete server-side analytiku, která zpracovává surové serverové logy. Několik specializovaných nástrojů v tomto úkolu vyniká:

Screaming Frog Log File Analyser zpracovává velké log soubory a automaticky identifikuje vzorce crawlerů, kategorizuje různé typy botů a zvýrazňuje neobvyklé chování. Botify nabízí enterprise platformu, která kombinuje analýzu logů s SEO poznatky, což vám umožňuje korelovat chování crawlerů s výkonností obsahu. OnCrawl nabízí cloudovou analýzu, která propojuje log data s výkonnostními metrikami, zatímco Splunk a Elastic Stack poskytují pokročilé možnosti strojového učení pro detekci anomálií a rozpoznávání vzorců.

Tyto nástroje automaticky kategorizují známé boty, identifikují nové typy crawlerů a označují podezřelou aktivitu. Dokáží zpracovávat miliony log záznamů v reálném čase a poskytují okamžitý přehled o tom, jak AI systémy interagují s vaším obsahem. Pro organizace, které to s AI viditelností myslí vážně, je implementace serverové analýzy logů nezbytná.

Pro průběžné sledování bez drahých nástrojů můžete vytvořit jednoduché automatizované skripty, které běží pravidelně. Tento bash skript identifikuje AI crawlery a počítá jejich požadavky:

#!/bin/bash

LOG="/var/log/nginx/access.log"

echo "AI Crawler Activity Report - $(date)"

echo "=================================="

grep -Ei "GPTBot|PerplexityBot|ClaudeBot|bingbot|Google-Extended|OAI-SearchBot" $LOG | awk '{print $1, $12}' | sort | uniq -c | sort -rn

Naplánujte tento skript jako cron úlohu, která poběží denně:

0 2 * * * /path/to/script.sh >> /var/log/ai-crawler-report.log

Tím vygenerujete denní reporty ukazující, které AI crawlery navštívily váš web a kolik požadavků každý z nich provedl. Pro pokročilejší analýzu posílejte svá log data do BigQuery nebo Elasticsearch pro vizualizaci a sledování trendů v čase. Tento přístup vám umožní identifikovat vzorce chování crawlerů, zjistit, kdy začnou nové AI systémy indexovat váš obsah, a měřit dopad jakýchkoliv změn ve struktuře webu nebo konfiguraci robots.txt.

Stanovte výchozí vzorce procházení shromažďováním 30–90 dní log dat, abyste pochopili běžné chování AI crawlerů. Sledujte metriky jako frekvence návštěv jednotlivých botů, nejčastěji přistupované sekce, hloubku prozkoumávání struktury webu, špičky v čase procházení a preference typů obsahu. Tento základ vám pomůže později odhalit neobvyklou aktivitu a pochopit, který obsah AI systémy upřednostňují.

Implementujte strukturovaná data pomocí formátu JSON-LD, abyste AI systémům usnadnili pochopení vašeho obsahu. Přidejte schema markup pro typ obsahu, autory, data, specifikace a vztahy mezi částmi obsahu. To pomáhá AI crawlerům přesně interpretovat a citovat váš obsah při generování odpovědí.

Optimalizujte architekturu webu pro AI crawlery tím, že zajistíte přehlednou navigaci, silné interní prolinkování, logickou organizaci obsahu, rychlé načítání stránek a responzivní design. Tato vylepšení prospívají jak lidským návštěvníkům, tak AI systémům.

Sledujte časy odezvy speciálně pro požadavky AI crawlerů. Pomalé reakce nebo chyby timeout naznačují, že boti váš obsah opouštějí dříve, než jej kompletně zpracují. AI crawlery často mají přísnější časové limity než tradiční vyhledávače, proto je optimalizace výkonu klíčová pro AI viditelnost.

Pravidelně kontrolujte logy, abyste identifikovali trendy a změny v chování crawlerů. Týdenní kontroly jsou nejlepší pro weby s vysokou návštěvností, zatímco pro menší weby postačí měsíční. Sledujte nové typy botů, změny ve frekvenci procházení, chyby či překážky a posuny v tom, který obsah je nejčastěji přistupován.

Sledujte, jak se váš obsah zobrazuje v ChatGPT, Perplexity a dalších AI odpovídacích enginech. Získejte aktuální přehled o aktivitě AI crawlerů a viditelnosti vaší značky v AI generovaných odpovědích.

Zjistěte, které AI crawlery povolit nebo blokovat ve vašem robots.txt. Komplexní průvodce zahrnující GPTBot, ClaudeBot, PerplexityBot a 25+ AI crawlerů s ukázka...

Naučte se identifikovat a monitorovat AI crawlery jako GPTBot, ClaudeBot a PerplexityBot ve vašich serverových logách. Kompletní průvodce s user-agent řetězci, ...

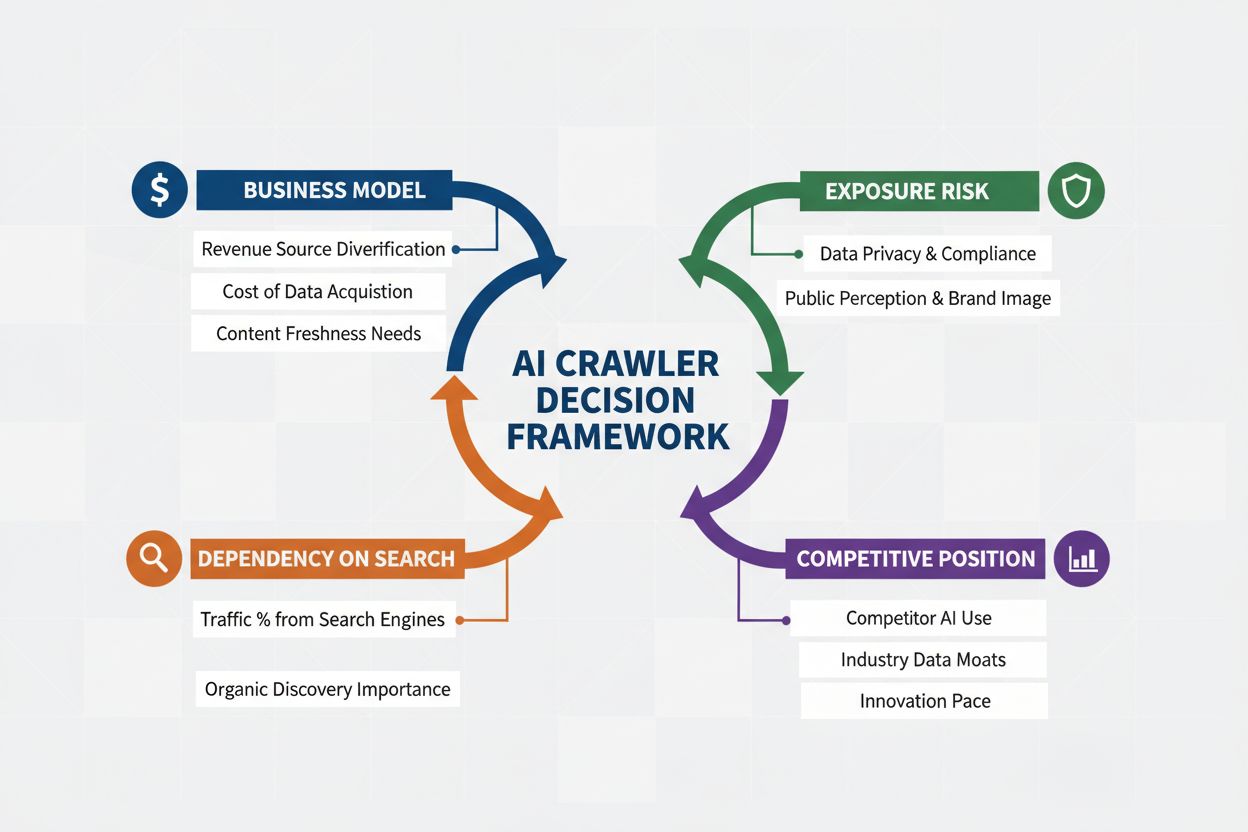

Naučte se, jak strategicky rozhodovat o blokování AI crawlerů. Vyhodnoťte typ obsahu, zdroje návštěvnosti, modely příjmů a konkurenční pozici pomocí našeho komp...