Visuel søgning og AI: Billedoptimering til AI-opdagelse

Lær hvordan visuel søgning og AI forvandler billedopdagelse. Optimer dine billeder til Google Lens, AI Overviews og multimodale LLM'er for at øge synligheden i ...

Lær hvordan Google Lens transformerer visuel søgning med over 100 milliarder søgninger årligt. Opdag optimeringsstrategier, så dit brand vises i resultater for visuel opdagelse og fanger shopping-intenderet trafik.

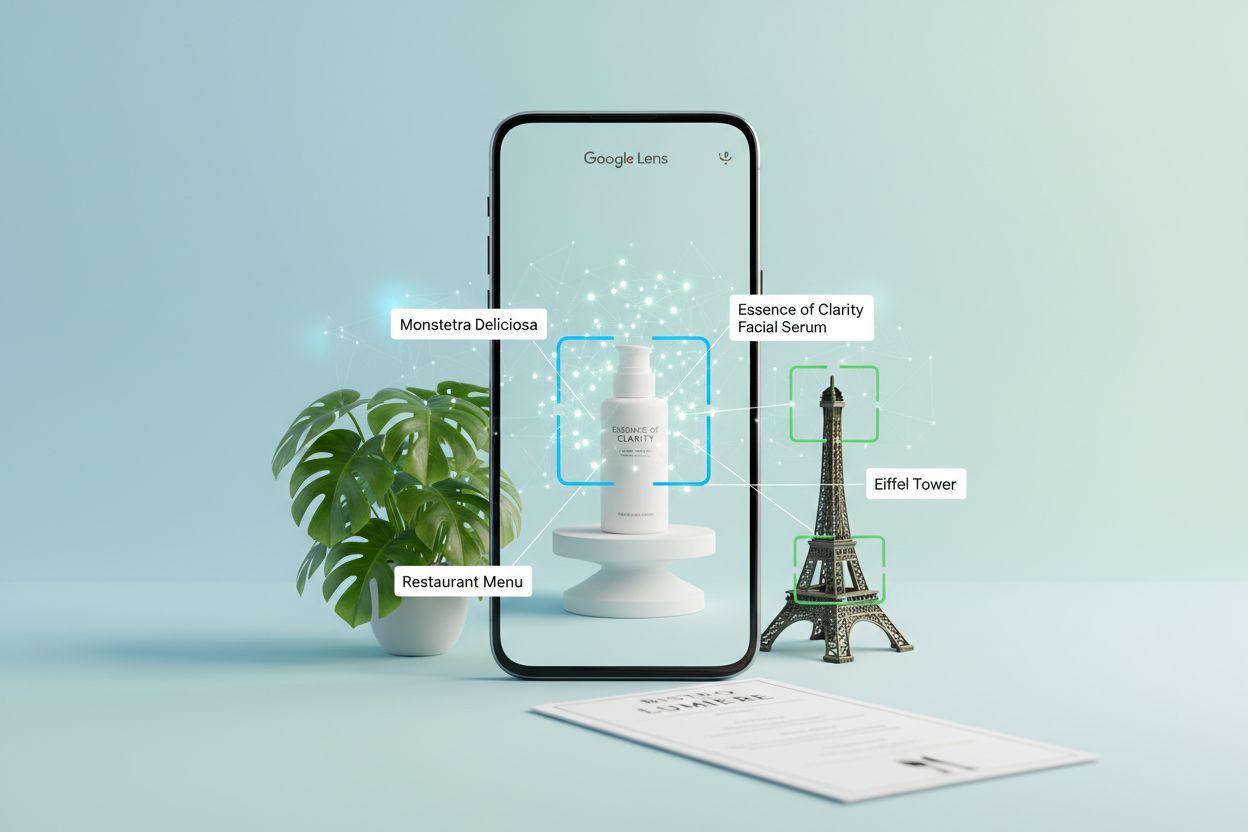

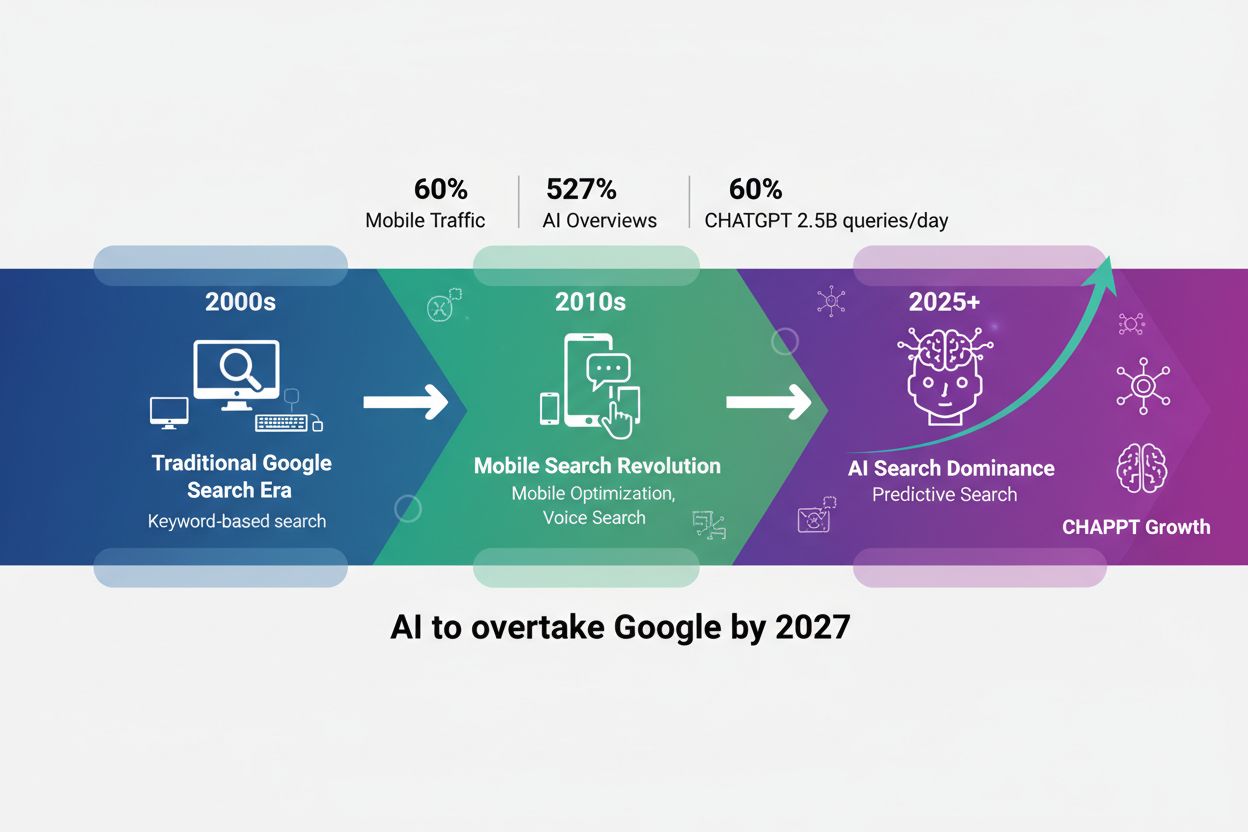

Visuel søgning har fundamentalt ændret måden, folk opdager information online på, og flyttet fokus fra tekstbaserede forespørgsler til kamera-først interaktioner. Google Lens, virksomhedens flagskib inden for visuel søgeteknologi, driver nu næsten 20 milliarder visuelle søgninger hver måned, med over 100 milliarder visuelle søgninger gennem Lens og Circle to Search alene i 2024. Denne eksplosive vækst afspejler et bredere skift i forbrugeradfærd: Folk foretrækker i stigende grad at pege deres kamera mod noget, de vil lære om, fremfor at skrive en beskrivelse.

Platformens rækkevidde er svimlende: 1,5 milliarder mennesker bruger nu Google Lens månedligt, hvor yngre brugere i alderen 18-24 har de højeste engagementrater. Det særligt betydningsfulde for brands er, at én ud af fem af disse visuelle søgninger—omtrent 20 milliarder søgninger—har direkte shopping-intention. Det er ikke tilfældige nysgerrighedssøgninger; det er potentielle kunder, der aktivt leder efter at købe noget, de har set i den virkelige verden.

Kernen i Google Lens er tre sammenkoblede AI-teknologier, der forstår og besvarer visuelle forespørgsler. Convolutional Neural Networks (CNNs) danner fundamentet og analyserer pixelmønstre for at identificere objekter, scener og visuelle relationer med bemærkelsesværdig nøjagtighed. Disse dybe læringsmodeller er trænet på milliarder af mærkede billeder og kan genkende alt fra almindelige husholdningsgenstande til sjældne plantearter.

Optisk tegngenkendelse (OCR) håndterer tekstgenkendelse og -udtrækning, så Lens kan læse menukort, skilte, dokumenter og håndskrevne noter. Når du peger dit kamera på et menukort på et fremmed sprog eller et vejskilt, konverterer OCR den visuelle tekst til digitale data, der kan behandles og oversættes. Naturlig sprogbehandling (NLP) fortolker derefter denne tekst kontekstuelt og forstår ikke kun, hvilke ord der står, men hvad de betyder i forhold til din forespørgsel.

Den virkelige styrke opstår ved multimodal AI—evnen til at behandle flere typer input samtidigt. Du kan nu pege dit kamera på et produkt, stille et spørgsmål med stemmen og få et AI-drevet svar, der kombinerer visuel forståelse med samtalemæssig kontekst. Denne integration skaber en søgeoplevelse, der føles naturlig og intuitiv.

| Funktion | Traditionel tekstsøgning | Google Lens |

|---|---|---|

| Inputmetode | Indtastede nøgleord | Billede, video eller stemme |

| Genkendelsesevne | Kun nøgleord | Objekter, tekst, kontekst, relationer |

| Svartid | Sekunder | Øjeblikkelig |

| Kontekstforståelse | Begrænset til forespørgselstekst | Omfattende visuel kontekst |

| Realtidsmulighed | Nej | Ja, med live-kamera |

| Nøjagtighed for visuelle elementer | Lav (svær at beskrive) | Høj (direkte visuel match) |

De praktiske anvendelser af Google Lens rækker langt ud over tilfældig nysgerrighed. Inden for shopping fotograferer brugere produkter, de ser i butikker, på sociale medier eller i videoer, og finder straks ud af, hvor de kan købe dem, og sammenligner priser på tværs af forhandlere. En kunde ser et møbel hos en ven, tager et billede og finder præcis det samme produkt til salg—alt sammen uden at skulle forlade øjeblikket.

Uddannelse er et andet stærkt anvendelsesområde, især i udviklingslande. Studerende fotograferer opgaver eller undervisningsmateriale på engelsk og bruger Lens til at oversætte til deres modersmål, hvorefter de får lektiehjælp og forklaringer. Dette demokratiserer adgangen til undervisningsressourcer på tværs af sprogbarrierer.

Rejser og udforskning gør brug af Lens til identifikation af vartegn, restaurantopdagelse og kulturel læring. Turister fotograferer ukendt arkitektur eller skilte og får straks historisk kontekst og information. Naturinteresserede identificerer planter, dyr og insekter på udflugter og gør tilfældige observationer til læringsmuligheder.

Produktresearch og sammenligning er blevet gnidningsfrit. En person ser en taske, de kan lide, fotograferer den, og Lens returnerer ikke kun det præcise produkt, men også lignende varer i forskellige prisklasser fra nærliggende forhandlere. Denne funktion har fundamentalt ændret måden, forbrugere shopper på, og fjerner friktion fra opdagelse til køb.

Muligheden er enorm: 20 milliarder shopping-intenderede visuelle søgninger årligt udgør en massiv kanal, som de fleste brands fuldstændig ignorerer. Mens konkurrenter kæmper om placeringer i AI Overview—et overfyldt felt domineret af store udgivere og etablerede detailhandlere—forbliver visuel søgning et relativt uudnyttet område med first-mover-fordele tilgængelige lige nu.

Brands, der optimerer til visuel opdagelse, opnår en konkurrencefordel, der overskrider traditionel SEO. Når dit produkt optræder i Google Lens-resultater, konkurrerer du ikke på nøgleord eller indholdskvalitet; du konkurrerer på visuel relevans og kontekst. En møbelbutik, hvis produkter vises i Lens-søgninger for “natbord queen soveværelse”, fanger kunder præcis, når de er klar til at købe, før de overhovedet har besøgt en søgemaskine.

Konverteringskonsekvenserne er markante. Brugere af visuel søgning har allerede identificeret, hvad de vil have—de browser eller researcher ikke, de køber. Denne stærke intention i trafikken konverterer markant bedre end traditionel søgetrafik. Derudover reducerer visuel søgning friktionen før køb: Kunder kan se præcis, hvordan et produkt ser ud i kontekst, forstå dets størrelse i forhold til kendte objekter og træffe trygge købsbeslutninger.

Den konkurrencemæssige timingfordel er reel. De fleste bureauer og brands forstår stadig ikke, at visuel søgning eksisterer som en selvstændig kanal. De virksomheder, der implementerer optimering til visuel søgning nu, opbygger forspring og markedsandele, mens konkurrenter forbliver fokuseret på gårsdagens søgeparadigmer.

Optimering til visuel opdagelse kræver en fundamentalt anderledes tilgang end traditionel billed-SEO. Her er de essentielle strategier:

Hvert af disse elementer bidrager til, hvordan Google Lens forstår og rangerer dit visuelle indhold. Jo mere kontekst du giver, jo større er sandsynligheden for, at dine produkter vises i relevante visuelle søgninger.

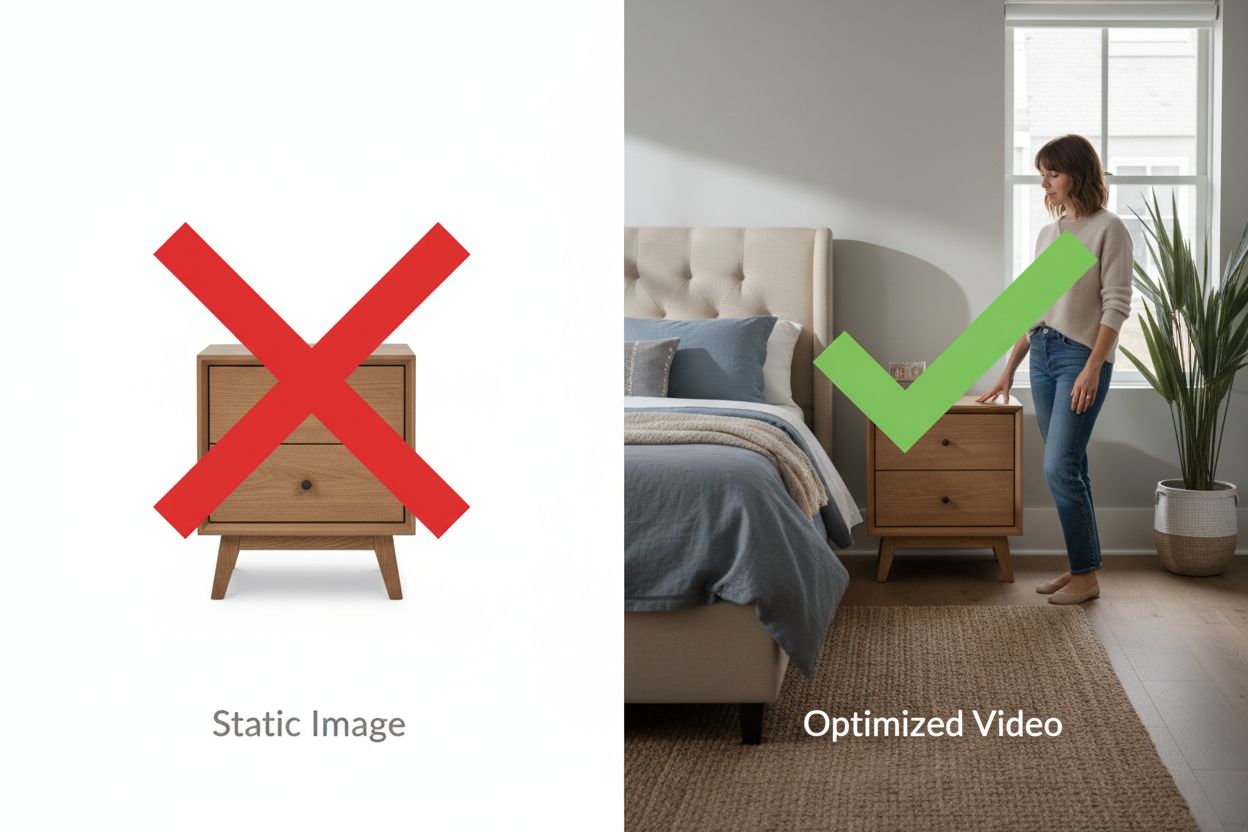

Stillbilleder er standard i optimering til visuel søgning; video er din konkurrencefordel. Google Lens udtrækker information fra videoframes, hvilket betyder, at en 30 sekunders produktdemonstrationsvideo kan generere dusinvis af opdagelige øjeblikke, som stillbilleder ikke kan.

Video viser skala på måder, billeder ikke kan. Når du viser et natbord placeret ved siden af en queen-size seng med en person stående ved siden af, kan Lens udlede præcise mål via rumlige relationer. Når du demonstrerer et produkt i brug—en vandtæt taske, der overlever et regnskyl, et hæve-sænkebord, der bærer to skærme, et telt, der modstår kraftig regn—giver du bevis, der overgår påstande.

Konverteringseffekten er målbar. Webshops, der tilføjer produktvideoer, ser stigninger i konverteringsraten på 20-40 %, fordi kunder kan visualisere produkterne i deres egne omgivelser, før de køber. Disse samme videoer bliver opdagelige i Google Lens-søgninger og driver trafik fra en helt ny kanal.

De tekniske krav er enkle: 15-45 sekunders videoer, der viser produkter fra flere vinkler med tydelig skala, uploadet direkte til din hjemmeside (ikke YouTube-embeds på produktsider), med beskrivende filnavne og schema markup. Du behøver ikke Hollywood-produktionskvalitet; autentiske smartphone-optagelser med ægte kontekst overgår ofte sterile studieoptagelser, fordi konteksten er mere værdifuld end produktionsværdien.

Implementering af optimering til visuel søgning kræver en strategisk tilgang. Start med at gennemgå dine nuværende visuelle aktiver i Google Search Console under Billeder—de fleste brands opdager, at de får tusindvis af visninger, men kun få klik, hvilket indikerer et stort optimeringspotentiale.

Identificér dine 50 mest populære produkter målt på trafik og omsætning, og vurder derefter deres nuværende visuelle indhold. Hvilke produkter har flere vinkler? Hvilke har videoer? Hvilke mangler livsstilsfotografi? Denne gennemgang afslører, hvor dine optimeringsindsatser vil give det højeste afkast. Skab en indholdsplan, der prioriterer produkter med størst søgevolumen og kommerciel intention.

Implementeringsplanen strækker sig over 60-90 dage. Uge 1-2 fokuserer på planlægning og prioritering. Uge 3-4 handler om indholdsproduktion—optagelse af produktvideoer, livsstilsfotografi og demonstrationsindhold. Uge 5-6 står på teknisk optimering: omdøbning af filer, skrivning af alt-tekster, implementering af schema markup og upload af indhold. Uge 7-8 fokuserer på overvågning og iteration, hvor du sporer, hvilke produkter og indholdstyper der genererer mest visuel søgetrafik.

Overvåg Google Search Consoles Performance-rapport filtreret på “Billede”-søgetype for at følge fremgangen. Forvent 30-60 dage, før der ses væsentlige trafikstigninger, da Google skal have tid til at gen-crawle og indeksere dit nye visuelle indhold. Spor konverteringer fra billedsøgetrafik specifikt ved hjælp af UTM-parametre eller kanalgruppering i Google Analytics for at måle afkastet.

Googles køreplan for visuel søgning udvider sig fortsat i spændende retninger. Search Live, der udrulles i 2025, muliggør samtale i realtid med Search—du kan pege dit kamera på et maleri og spørge “Hvilken stil er dette?” og derefter følge op med “Hvem er berømte kunstnere inden for den stil?” og skabe en sømløs, samtalebaseret visuel søgeoplevelse.

Multimodale AI-evner udvikler sig løbende og gør Lens i stand til at forstå stadig mere komplekse visuelle forespørgsler. Lens kan nu ikke bare identificere objekter, men også forstå relationer, kontekster og nuancerede spørgsmål om det, du ser. Udvidelsen af Circle to Search bringer gestusbaseret visuel søgning til flere enheder og platforme, hvilket gør visuel opdagelse endnu mere tilgængelig.

Integration på tværs af Googles økosystem forstærker mulighederne. Google Lens er nu indbygget i Chrome til desktop, så visuel søgning er tilgængelig, når inspirationen opstår. Efterhånden som disse funktioner udvides globalt og til flere platforme, bliver konkurrencefordelen ved tidlig optimering endnu tydeligere.

De brands, der forbereder sig nu—optimerer deres visuelle indhold, skaber demonstrationsvideoer og implementerer korrekt schema markup—vil dominere resultaterne for visuel søgning, efterhånden som kanalen fortsætter sin eksplosive vækst. Spørgsmålet er ikke, om visuel søgning vil få betydning for din forretning; det er, om du er synlig, når kunder søger visuelt efter det, du sælger.

Google Lens er Googles visuelle søgeteknologi, der bruger AI til at identificere objekter, tekst og scener fra billeder eller video. Den anvender convolutional neural networks (CNNs) til genkendelse af objekter, optisk tegngenkendelse (OCR) til tekstgenkendelse samt naturlig sprogbehandling (NLP) til at forstå kontekst. Brugere kan pege deres kamera på noget og stille spørgsmål om det og få øjeblikkelige AI-drevne svar og relateret information.

Traditionel billedsøgning er afhængig af nøgleord og metadata for at finde visuelt lignende billeder. Google Lens forstår det egentlige indhold i billeder—objekter, relationer, kontekst og betydning—så den kan matche produkter og information baseret på visuel lighed fremfor tekstbeskrivelser. Dette gør den langt mere effektiv til at finde ting, der er svære at beskrive med ord, som møbler, mode eller vartegn.

Google Lens behandler over 100 milliarder visuelle søgninger årligt, hvoraf 20 milliarder har direkte shopping-intention. Brugere, der foretager visuelle søgninger, leder aktivt efter at købe noget, de har set, hvilket gør denne trafik særdeles værdifuld. Optimering til visuel opdagelse fanger kunder i det øjeblik, de har intentionen, før de overhovedet har skrevet en søgeforespørgsel, hvilket resulterer i højere konverteringsrater end traditionel søgetrafik.

Google Lens kræver, at du åbner appen og tager et billede eller uploader et billede. Circle to Search er en gestusbaseret funktion tilgængelig på Android-enheder, hvor du kan cirkle, trykke eller fremhæve objekter direkte på din skærm uden at skifte app. Begge bruger samme underliggende visuelle søgeteknologi, men Circle to Search giver en hurtigere og mere sømløs oplevelse for brugere, der allerede ser indhold på deres telefon.

Optimer til Google Lens ved at vise produkter fra flere vinkler, inkludere kendte størrelsesreferencer (senge, døre, personer) for skala, skrive beskrivende alt-tekster, implementere Product- og Video-schema markup, skabe livsstilsfotografi, der viser brug i virkeligheden, lade sæsonvarer blive online med udsolgt-indikatorer og bruge beskrivende filnavne. Hvert element gør det lettere for Google Lens at forstå dit visuelle indhold.

Video er en gamechanger for visuel søgning, fordi Google Lens udtrækker information fra videoframes og skaber mange opdagelige øjeblikke fra en enkelt video. Videoer demonstrerer skala, funktionalitet og brug i virkeligheden på måder, stillbilleder ikke kan. Produkter med demonstrationsvideoer oplever 20-40% højere konverteringsrater og vises oftere i visuelle søgeresultater, hvilket gør video afgørende for konkurrencefordel.

Forvent 30-60 dage, før væsentlige trafikstigninger kan ses i Google Search Console under Billeder. Google skal have tid til at gen-crawle og indeksere dit nye visuelle indhold. Du bør dog overvåge stigninger i visninger indenfor 30 dage, hvilket indikerer, at Google opdager og indekserer dit optimerede indhold. Konverteringsforbedringer følger typisk indenfor 60-90 dage, efterhånden som trafikvolumen stiger.

Ja, du kan spore visuel søgetrafik i Google Analytics ved at filtrere efter 'Billede'-søgetype i Google Search Console's Performance-rapport. For mere detaljeret konverteringssporing kan du bruge UTM-parametre på produktsider eller oprette en brugerdefineret kanalgruppering for billedsøgetrafik. Overvåg metrics som klikrate, konverteringsrate og gennemsnitlig ordreværdi specifikt for billedsøgetrafik for at måle ROI på dine optimeringsindsatser.

AmICited sporer, hvordan Google Lens, Circle to Search og andre AI-værktøjer refererer til dit brand i resultater for visuel opdagelse. Få indsigt i din AI-synlighed og optimer din strategi for visuelt indhold.

Lær hvordan visuel søgning og AI forvandler billedopdagelse. Optimer dine billeder til Google Lens, AI Overviews og multimodale LLM'er for at øge synligheden i ...

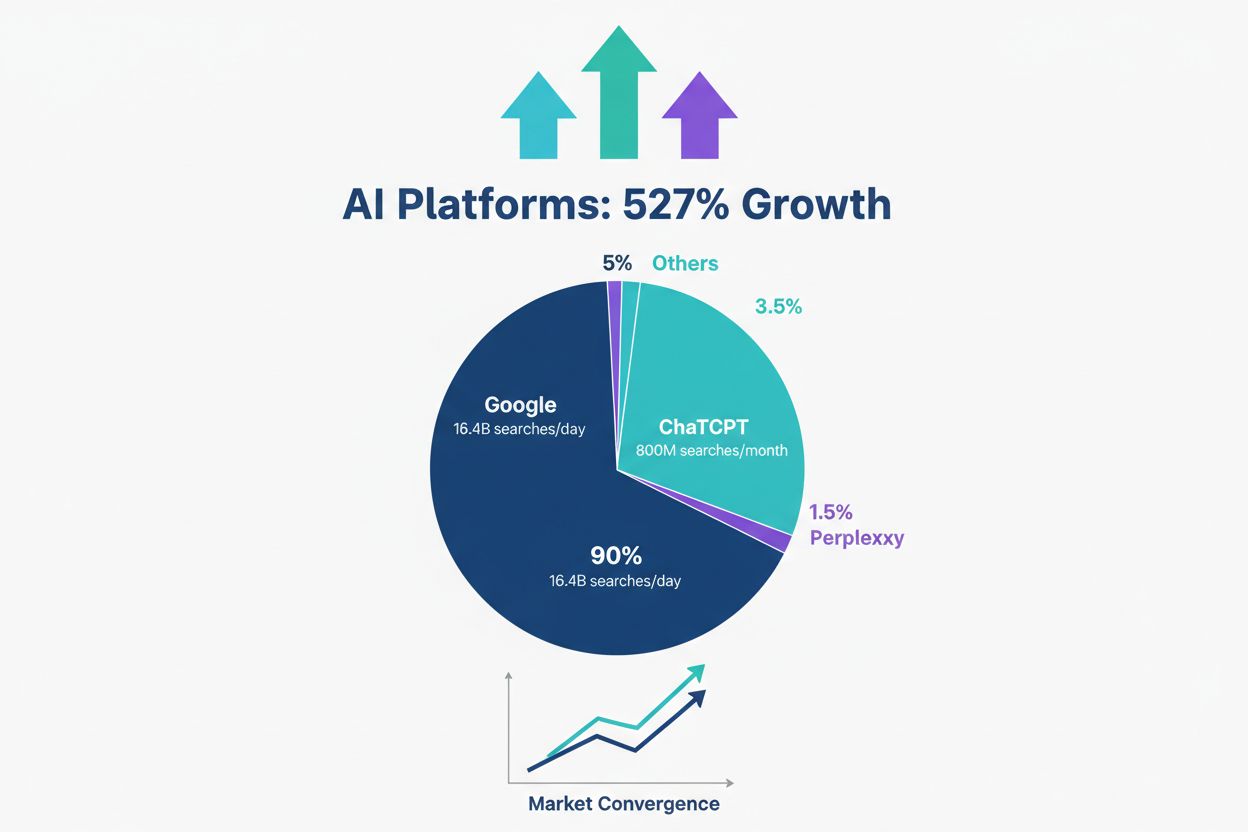

Udforsk hvordan AI-søgeplatforme som ChatGPT og Perplexity omformer søgelandskabet. Opdag hvornår AI kan matche Googles konverteringsvolumen, og hvad det betyde...

Opdag hvordan AI-søgning omformer SEO. Lær de vigtigste forskelle mellem AI-platforme som ChatGPT og traditionel Google-søgning, og hvordan du optimerer dit ind...