Enterprise AI-synlighedsløsninger: Vælg den rigtige platform

Komplet guide til enterprise AI-synlighedsløsninger. Sammenlign topplatforme som Conductor, Profound og Athena. Lær evalueringskriterier og udvælgelsesstrategie...

Strategi for Enterprise AI-synlighed henviser til den omfattende tilgang, organisationer implementerer for at overvåge, spore og forstå alle kunstige intelligenssystemer, modeller og applikationer, der opererer inden for deres infrastruktur. Denne strategi omfatter evnen til at se, hvilke AI-systemer der anvendes, hvordan de præsterer, hvem der bruger dem, og hvilke risici de udgør på tværs af hele organisationen. For store virksomheder, der håndterer hundreder eller tusinder af AI-implementeringer, bliver synlighed særligt kritisk, fordi shadow AI—uautoriserede eller udokumenterede AI-værktøjer—kan sprede sig hurtigt uden korrekt opsyn. Uden omfattende synlighed kan organisationer ikke sikre compliance, håndtere risici, optimere performance eller opnå maksimal værdi af deres AI-investeringer.

Strategi for Enterprise AI-synlighed henviser til den omfattende tilgang, organisationer implementerer for at overvåge, spore og forstå alle kunstige intelligenssystemer, modeller og applikationer, der opererer inden for deres infrastruktur. Denne strategi omfatter evnen til at se, hvilke AI-systemer der anvendes, hvordan de præsterer, hvem der bruger dem, og hvilke risici de udgør på tværs af hele organisationen. For store virksomheder, der håndterer hundreder eller tusinder af AI-implementeringer, bliver synlighed særligt kritisk, fordi shadow AI—uautoriserede eller udokumenterede AI-værktøjer—kan sprede sig hurtigt uden korrekt opsyn. Uden omfattende synlighed kan organisationer ikke sikre compliance, håndtere risici, optimere performance eller opnå maksimal værdi af deres AI-investeringer.

Strategi for Enterprise AI-synlighed henviser til den omfattende tilgang, organisationer implementerer for at overvåge, spore og forstå alle kunstige intelligenssystemer, modeller og applikationer, der opererer inden for deres infrastruktur. Denne strategi omfatter evnen til at se, hvilke AI-systemer der anvendes, hvordan de præsterer, hvem der bruger dem, og hvilke risici de udgør på tværs af hele organisationen. For store virksomheder, der håndterer hundreder eller tusinder af AI-implementeringer, bliver synlighed særligt kritisk, fordi shadow AI—uautoriserede eller udokumenterede AI-værktøjer—kan sprede sig hurtigt uden korrekt opsyn. Udfordringen intensiveres i stor skala, hvor 85% af virksomheder nu anvender AI i en eller anden form, men kun 11% rapporterer klar forretningsværdi, hvilket indikerer et væsentligt gab mellem implementering og effektiv styring. Uden omfattende synlighed kan organisationer ikke sikre compliance, håndtere risici, optimere performance eller opnå maksimal værdi af deres AI-investeringer.

Enterprise AI-synlighed fungerer på tværs af tre indbyrdes forbundne dimensioner, der tilsammen giver fuld organisatorisk forståelse af AI-systemer og deres indvirkning. Den første dimension, brugsmonitorering, sporer hvilke AI-systemer der er implementeret, hvem der får adgang til dem, hvor ofte de anvendes, og til hvilke forretningsformål. Den anden dimension, kvalitetsmonitorering, sikrer, at AI-modeller præsterer som forventet, opretholder nøjagtighedsstandarder og ikke forringes over tid på grund af datadrift eller modelnedbrydning. Den tredje dimension, sikkerhedsmonitorering, beskytter mod uautoriseret adgang, databrud, prompt injection-angreb og sikrer compliance med regulatoriske krav. Disse tre dimensioner skal arbejde sammen, understøttet af centraliseret logging, realtids-dashboards og automatiserede varslingssystemer. Organisationer, der implementerer omfattende synlighed på alle tre dimensioner, rapporterer markant bedre governance-resultater og hurtigere respons på hændelser.

| Dimension | Formål | Nøglemålepunkter |

|---|---|---|

| Brugsmonitorering | Spor AI-systemimplementering og anvendelsesmønstre | Aktive brugere, API-kald, modelversioner, forretningsenheders adoption |

| Kvalitetsmonitorering | Sikre modelperformance og pålidelighed | Nøjagtighed, præcision, recall, prædiktionsdrift, latenstid |

| Sikkerhedsmonitorering | Beskytte mod trusler og sikre compliance | Adgangslogs, detekterede anomalier, policy-overtrædelser, revisionsspor |

Organisationer står over for betydelige forhindringer, når de forsøger at implementere omfattende AI-synlighed i store, komplekse miljøer. Shadow AI repræsenterer måske den største udfordring—medarbejdere og afdelinger implementerer AI-værktøjer uden IT’s viden eller godkendelse, hvilket skaber blinde vinkler, der forhindrer centraliseret overvågning og governance. Datasiloer fragmenterer information på tværs af afdelinger, hvilket gør det umuligt at korrelere AI-brugsmønstre eller identificere dobbeltarbejde og spildte ressourcer. Integrationskompleksitet opstår, når organisationer skal forbinde synlighedsværktøjer med legacy-systemer, cloud-platforme og forskellige AI-rammeværk, der ikke er designet med monitorering for øje. Regulatorisk fragmentering kræver forskellige synlighedsstandarder for forskellige jurisdiktioner, hvilket skaber compliance-kompleksitet, der kræver fleksibel, tilpasningsdygtig monitoreringsinfrastruktur. Derudover rapporterer 84% af IT-ledere, at de mangler en formel governance-proces, og 72% af organisationer rapporterer datakvalitetsproblemer, der underminerer pålideligheden af selve synlighedsmålingerne.

Væsentlige synlighedsudfordringer inkluderer:

Effektiv enterprise AI-synlighed kræver tilpasning til etablerede governance-rammeværk og standarder, der giver struktur og troværdighed til monitoreringsindsatsen. NIST AI Risk Management Framework (RMF) tilbyder en omfattende tilgang til at identificere, måle og håndtere AI-risici og danner grundlag for synlighedskrav på tværs af alle organisatoriske funktioner. ISO/IEC 42001 fastsætter internationale standarder for AI-ledelsessystemer, herunder krav til overvågning, dokumentation og løbende forbedringer, der stemmer overens med synlighedsmål. EU AI Act pålægger strenge krav om gennemsigtighed og dokumentation for højrisiko AI-systemer og kræver detaljerede optegnelser over AI-systemers adfærd og beslutningsprocesser. Branchespecifikke rammeværk føjer yderligere krav til—finansielle tjenester skal overholde bankregulatorers forventninger til AI-governance, sundhedsorganisationer skal opfylde FDA-krav til kliniske AI-systemer, og offentlige myndigheder skal følge statslige AI-governance-direktiver. Organisationer bør vælge rammeværk, der passer til deres branche, geografi og risikoprofil, og derefter opbygge en synlighedsinfrastruktur, der dokumenterer compliance med de valgte standarder.

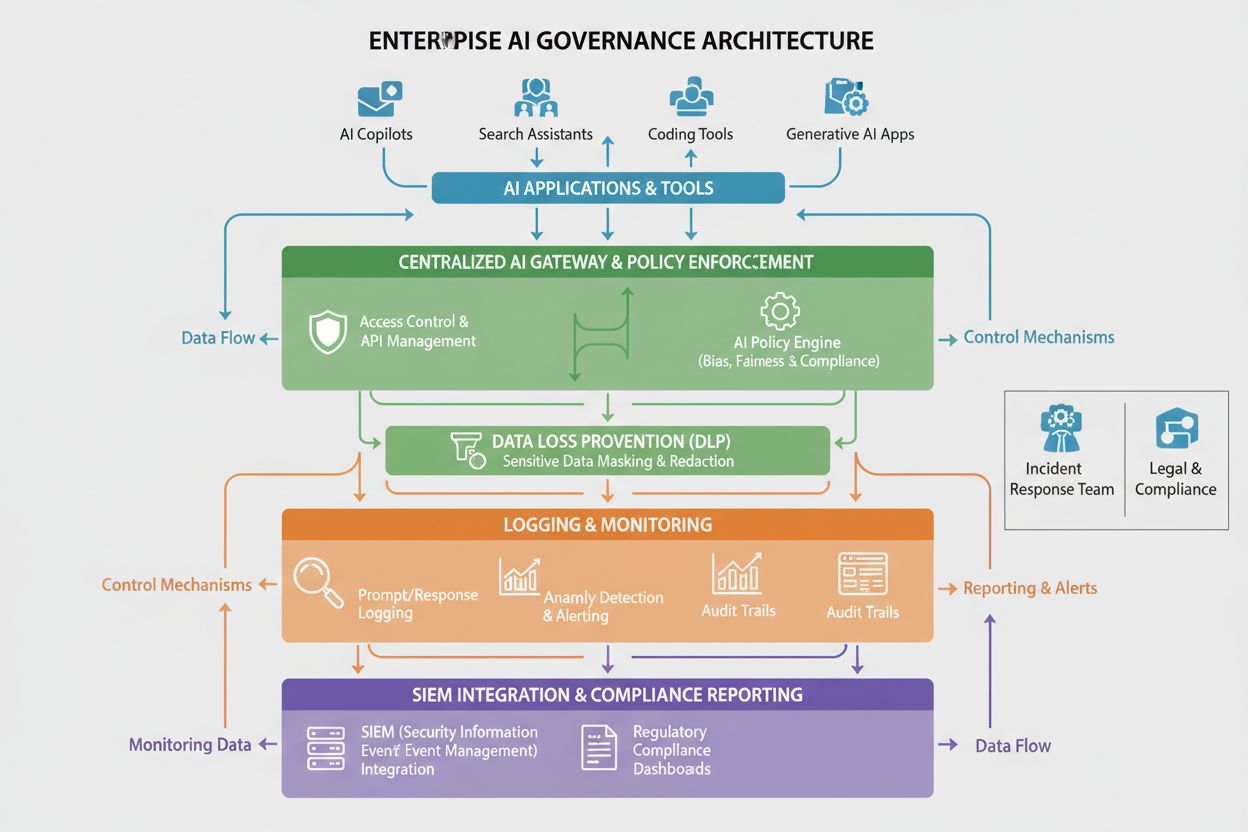

Implementering af enterprise AI-synlighed kræver et robust teknisk fundament, der indsamler, behandler og præsenterer data om AI-systemers adfærd og performance. Centraliserede AI-platforme fungerer som rygraden i synlighedsinfrastrukturen og giver et samlet overblik, hvor organisationer kan overvåge alle AI-systemer, uanset hvor de er implementeret. AI-gateways fungerer som mellemled mellem applikationer og AI-tjenester, indsamler metadata om hver anmodning og svar, og muliggør detaljeret brugs- og sikkerhedsmonitorering. Omfattende loggingsystemer registrerer alle AI-systemaktiviteter, modelprediktioner, brugerinteraktioner og systemperformance-målinger i centraliserede depoter, der understøtter revisionsspor og retsmedicinsk analyse. Data Loss Prevention (DLP)-værktøjer overvåger AI-systemer for forsøg på at udtrække følsomme data og forhindrer, at modeller trænes på fortrolige oplysninger eller returnerer beskyttede data i svar. SIEM-integration forbinder AI-synlighedsdata med bredere sikkerhedsinformations- og hændelsesstyringssystemer, hvilket gør det muligt at sammenkæde AI-relaterede sikkerhedshændelser med andre trusler i organisationen. Organisationer, der implementerer disse tekniske komponenter, rapporterer 30% reduktion i responstid på hændelser, når AI-relaterede sikkerhedsproblemer opstår. Platforme som Liminal, Ardoq og Knostic tilbyder governance-fokuserede synlighedsløsninger, mens AmICited.com er specialiseret i at overvåge AI-svarkvalitet på tværs af GPTs, Perplexity og Google AI Overviews.

Succesfuld enterprise AI-synlighed kræver klare organisatoriske strukturer og definerede roller, der fordeler ansvaret for monitorering og governance på tværs af organisationen. Et AI Governance Committee fungerer typisk som den ledende gruppe, der styrer AI-synlighedsstrategien, fastlægger politikker og sikrer overensstemmelse med forretningsmål og regulatoriske krav. Modelansvarlige har ansvar for specifikke AI-systemer og sikrer, at de er korrekt dokumenteret, overvåget og vedligeholdt efter organisationens standarder. AI-ambassadører placeret i forretningsenheder fungerer som bindeled mellem IT-governance-teams og slutbrugere, fremmer synlighedspraksis og identificerer shadow AI, før det bliver uoverskueligt. Datastyringsansvarlige varetager kvaliteten og tilgængeligheden af data, der bruges til at træne og overvåge AI-systemer, og sikrer, at synlighedsmålinger er pålidelige og troværdige. Sikkerheds- og compliance-teams fastlægger monitoreringskrav, udfører audits og sikrer, at synlighedsinfrastrukturen opfylder regulatoriske forpligtelser. Klare ansvarsstrukturer sikrer, at synlighed ikke kun betragtes som et IT-ansvar, men som en fælles organisatorisk forpligtelse, der kræver deltagelse fra forretnings-, tekniske og governance-funktioner.

Organisationer skal etablere klare key performance indicators (KPIs) og målerammer for at vurdere, om deres AI-synlighedsstrategi leverer værdi og understøtter organisationens mål. Synlighedsdækning måler procentdelen af AI-systemer, der er dokumenteret og overvåget, hvor modne organisationer sigter efter 95%+ dækning af alle AI-implementeringer. Governance-modning sporer fremgangen gennem definerede stadier—fra ad hoc-monitorering til standardiserede processer til optimeret, automatiseret governance—ved brug af rammeværk som CMMI-modellen tilpasset AI-governance. Detektion og respons på hændelser måler, hvor hurtigt organisationer identificerer og reagerer på AI-relaterede problemer, hvor forbedringer i detektionshastighed og responstid indikerer mere effektiv synlighed. Compliance-adherence sporer procentdelen af AI-systemer, der opfylder regulatoriske krav og interne standarder, hvor auditfund og afhjælpningsfrister fungerer som nøglemålepunkter. Realisering af forretningsværdi måler, om synlighedsinvesteringer omsættes til konkrete fordele som reduceret risiko, forbedret modelperformance, hurtigere time-to-market for AI-initiativer eller bedre ressourceallokering. Organisationer bør implementere realtids-dashboards, der viser disse målinger til interessenter, hvilket muliggør løbende monitorering og hurtig kurskorrektion, når synlighedshuller opstår.

Forskellige brancher står over for unikke krav til AI-synlighed, drevet af regulatoriske miljøer, risikoprofiler og forretningsmodeller, der kræver skræddersyede monitoreringsmetoder. Finansielle tjenester skal leve op til bankregulatorers forventninger til AI-governance, herunder detaljeret monitorering af AI-systemer brugt i kreditvurdering, svindeldetektion og handelsalgoritmer, med særlig fokus på bias-detektion og fairness-målinger. Sundhedssektoren skal opfylde FDA-krav til kliniske AI-systemer, herunder validering af modelperformance, overvågning af sikkerhedsproblemer og dokumentation af, hvordan AI-systemer påvirker kliniske beslutninger. Juridiske virksomheder, der anvender AI til kontraktanalyse, juridisk research og due diligence, skal sikre synlighed i modeltræningsdata for at forhindre brud på fortrolighed og opretholde advokat-klient privilegium. Offentlige myndigheder skal overholde statslige AI-governance-direktiver, herunder krav om gennemsigtighed, bias-audits og dokumentation af AI-systemers beslutningsprocesser for offentlig ansvarlighed. Detail- og e-handelsvirksomheder skal overvåge AI-systemer brugt i anbefalingsmotorer og personalisering for at sikre compliance med forbrugerbeskyttelsesregler og konkurrenceforhold. Produktionsvirksomheder skal spore AI-systemer brugt i kvalitetskontrol og prædiktivt vedligehold for at sikre sikkerhed og pålidelighed. Branchespecifikke synlighedskrav bør indarbejdes i governance-rammeværk i stedet for at blive betragtet som særskilte compliance-opgaver.

Organisationer, der implementerer enterprise AI-synlighed, bør tage en trinvis tilgang, der leverer hurtige gevinster, mens de bygger mod omfattende, modne governance-evner. Start med inventar og dokumentation—gennemfør en audit for at identificere alle AI-systemer i brug, inklusive shadow AI, og opret et centraliseret register, der dokumenterer hvert systems formål, ejer, datakilder og forretningskritikalitet. Identificer hurtige gevinster ved at fokusere de indledende monitoreringsindsatser på højrisikosystemer såsom kundeorienteret AI, systemer der behandler følsomme data eller modeller, der træffer væsentlige beslutninger om individer. Implementer centraliseret logging som en grundlæggende funktion, der indsamler metadata om alle AI-systemaktiviteter og muliggør både realtidsmonitorering og historisk analyse. Etabler governance-politikker, der definerer standarder for AI-systemdokumentation, monitorering og compliance, og kommuniker disse politikker klart til alle interessenter. Byg tværfunktionelle teams med deltagelse fra IT, sikkerhed, forretning og compliance, så synlighedsinitiativer adresserer bekymringer fra hele organisationens perspektiv. Mål og kommuniker fremdrift ved at spore synlighedsmålepunkter og dele resultater med ledelsen, demonstrere værdien af governance-investeringer og skabe organisatorisk opbakning til fortsatte investeringer i AI-synlighedsinfrastruktur.

AI-synlighed er evnen til at se og overvåge, hvad AI-systemer gør, mens AI-governance er det bredere rammeværk af politikker, processer og kontroller, der styrer, hvordan AI-systemer udvikles, implementeres og anvendes. Synlighed er en grundlæggende komponent i governance—du kan ikke styre, hvad du ikke kan se. Effektiv AI-governance kræver omfattende synlighed på tværs af alle tre dimensioner: brug, kvalitet og sikkerhedsovervågning.

Store organisationer står over for unikke udfordringer med at håndtere hundreder eller tusinder af AI-implementeringer på tværs af flere afdelinger, cloud-udbydere og forretningsenheder. Uden omfattende synlighed breder shadow AI sig, compliance-risici øges, og organisationer kan ikke optimere AI-investeringer eller sikre ansvarlig AI-brug. Synlighed gør det muligt for organisationer at identificere risici, håndhæve politikker og opnå maksimal værdi af AI-initiativer.

Dårlig AI-synlighed skaber flere risici: shadow AI-systemer opererer uden opsyn, følsomme data kan blive eksponeret gennem uovervågede AI-systemer, compliance-overtrædelser opdages ikke, modelpræstation forringes uden at blive identificeret, sikkerhedstrusler bliver ikke opdaget, og organisationer kan ikke demonstrere governance over for myndighederne. Disse risici kan resultere i databrud, regulatoriske bøder, omdømmeskade og tab af kundetillid.

Shadow AI—uautoriserede AI-værktøjer implementeret uden IT’s viden—skaber blinde vinkler, der forhindrer centraliseret overvågning og governance. Medarbejdere kan bruge offentlige AI-tjenester som ChatGPT uden organisationens opsyn, hvilket potentielt kan eksponere følsomme data eller overtræde compliance-krav. Shadow AI fører også til dobbeltarbejde, spildte ressourcer og manglende håndhævelse af organisationens AI-politikker og standarder.

Formålsbyggede AI-governance-platforme som Liminal, Ardoq og Knostic tilbyder centraliseret overvågning, policy-håndhævelse og compliance-rapportering. Disse platforme integrerer med AI-tjenester, indsamler detaljerede logs, detekterer anomalier og leverer dashboards til governance-teams. Derudover specialiserer AmICited sig i at overvåge, hvordan AI-systemer refererer til dit brand på tværs af GPTs, Perplexity og Google AI Overviews, og giver synlighed i AI-svarenes kvalitet.

Regulatoriske rammer som EU AI Act, GDPR, CCPA og branchespecifikke regler (OCC for bank, FDA for sundhedsvæsen) stiller specifikke krav til synlighed og dokumentation. Organisationer skal implementere overvågning, der dokumenterer compliance med disse regler, herunder revisionsspor, bias-tests, performance-overvågning og dokumentation af AI-systemers beslutningsprocesser. Synlighedsinfrastrukturen skal designes til at opfylde disse regulatoriske krav.

Nøglemålepunkter inkluderer: synlighedsdækning (procentdel af AI-systemer dokumenteret og overvåget), governance-modning (fremgang gennem definerede governance-stadier), detektering og responstid for hændelser, compliance-adherence (procentdel af systemer, der opfylder regulatoriske krav), og realisering af forretningsværdi (konkrete fordele af synlighedsinvesteringer). Organisationer bør også spore brugsmålinger (aktive brugere, API-kald), kvalitetsmålinger (nøjagtighed, drift), og sikkerhedsmål (detekterede anomalier, policy-overtrædelser).

Implementeringstidslinjer varierer afhængigt af organisationens størrelse og kompleksitet. Den indledende synlighedsinfrastruktur (inventar, basal logging, dashboards) kan etableres på 3-6 måneder. At opnå omfattende synlighed på tværs af alle AI-systemer kræver typisk 6-12 måneder. At nå moden, optimeret governance tager som regel 12-24 måneder. Organisationer bør tage en trinvis tilgang, begyndende med højrisikosystemer og hurtige gevinster og derefter udvide til fuld dækning.

AmICited sporer, hvordan AI-systemer som GPTs, Perplexity og Google AI Overviews refererer til dit brand og indhold. Få synlighed i AI-svarenes kvalitet og brandomtaler på tværs af alle større AI-platforme.

Komplet guide til enterprise AI-synlighedsløsninger. Sammenlign topplatforme som Conductor, Profound og Athena. Lær evalueringskriterier og udvælgelsesstrategie...

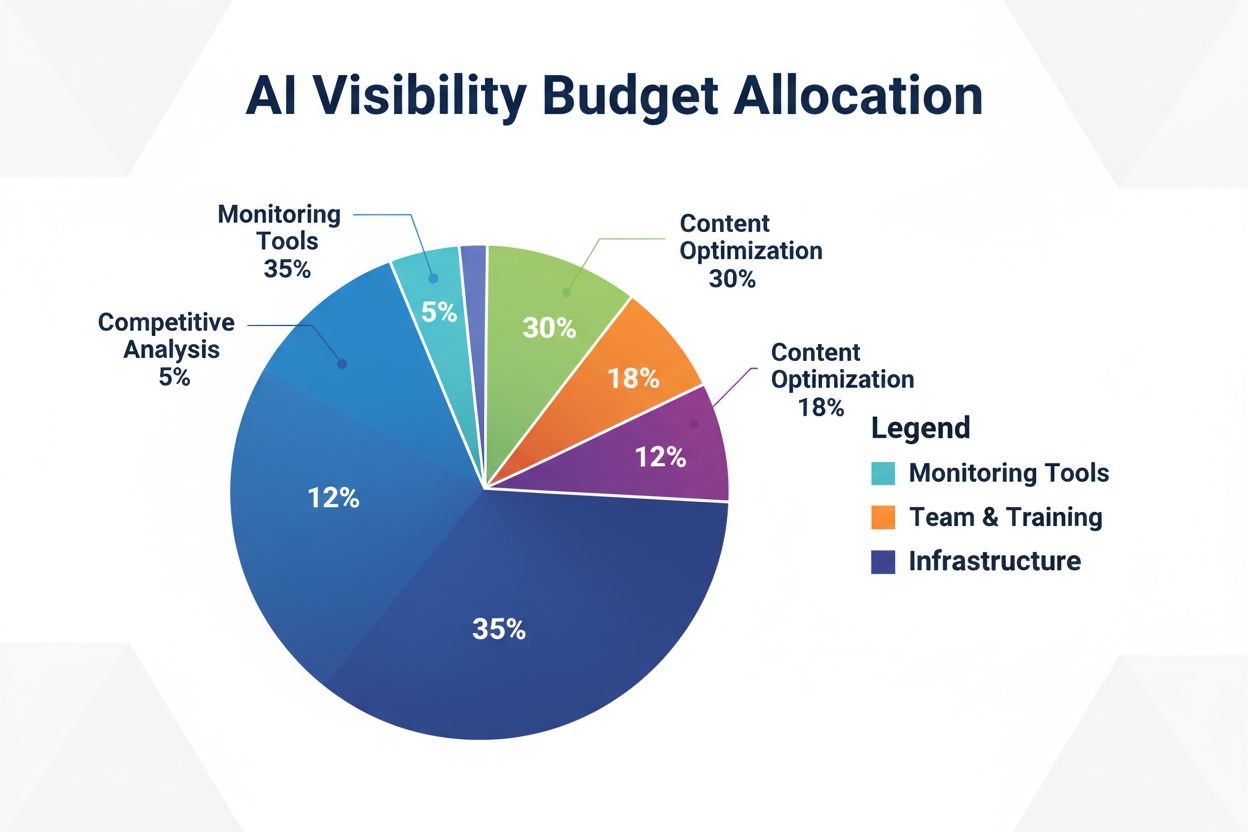

Lær hvordan du strategisk allokerer dit AI-synlighedsbudget på tværs af overvågningsværktøjer, indholdsoptimering, teamressourcer og konkurrentanalyse for at ma...

Lær hvordan du bygger ROI-baserede AI-synlighedsbudgetter med gennemtestede frameworks, målingsstrategier og fordelingsmetoder. Maksimér afkastet på dine AI-inv...