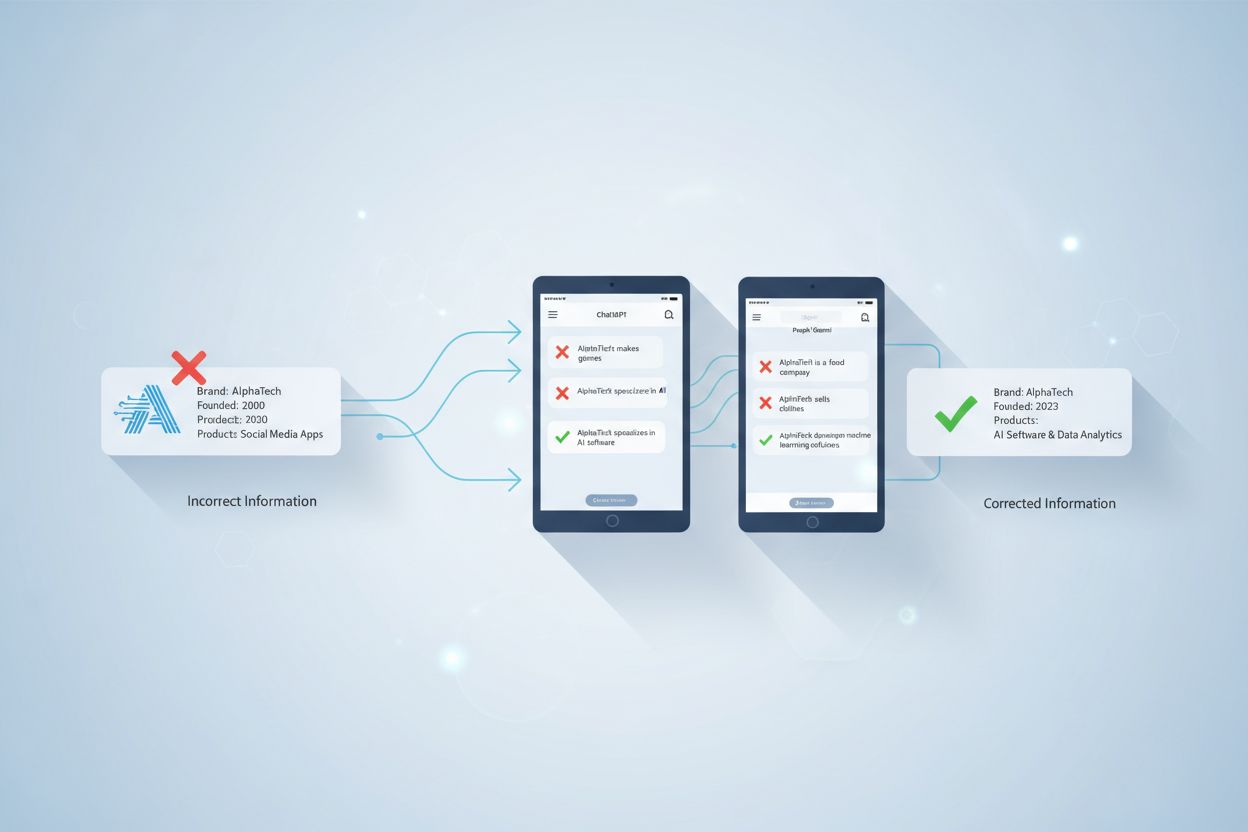

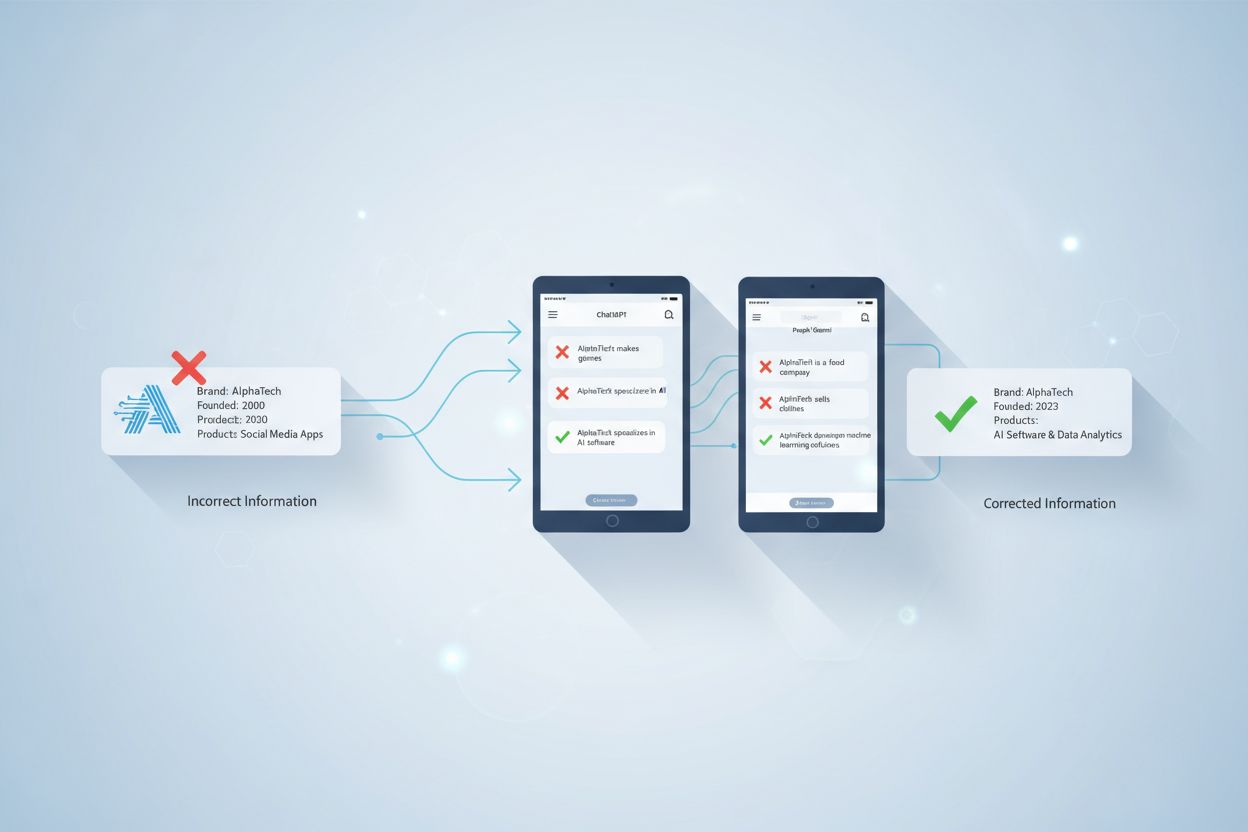

Korrektur von KI-Fehlinformationen

Erfahren Sie, wie Sie falsche Markeninformationen in KI-Systemen wie ChatGPT, Gemini und Perplexity identifizieren und korrigieren. Entdecken Sie Überwachungsto...

Erfahren Sie, wie Sie Korrekturen bei KI-Plattformen wie ChatGPT, Perplexity und Claude anfordern können. Verstehen Sie Korrekturmechanismen, Feedback-Prozesse und Strategien, um KI-generierte Antworten über Ihre Marke zu beeinflussen.

Obwohl Sie Informationen nicht direkt aus den KI-Trainingsdaten löschen können, können Sie Korrekturen über Feedback-Mechanismen anfordern, Ungenauigkeiten an der Quelle adressieren und zukünftige KI-Antworten beeinflussen, indem Sie autoritativen positiven Content erstellen und mit den Support-Teams der Plattformen zusammenarbeiten.

Korrekturanfragen bei KI-Plattformen erfordern ein grundlegendes Verständnis der Funktionsweise dieser Systeme. Im Gegensatz zu traditionellen Suchmaschinen, bei denen Sie einen Website-Betreiber kontaktieren können, um Inhalte zu entfernen oder zu aktualisieren, lernen KI-Sprachmodelle während spezifischer Trainingsphasen aus Trainingsdaten, die Milliarden von Webseiten, Nachrichtenartikeln und Textquellen umfassen. Sobald negative oder ungenaue Informationen Teil dieser Trainingsdaten werden, können Sie diese nicht direkt löschen oder bearbeiten, wie Sie es eventuell bei einem Website-Betreiber anfragen würden. Die KI hat während ihres Trainingszyklus bereits Muster und Zusammenhänge aus verschiedenen Quellen gelernt.

Der Korrekturprozess unterscheidet sich erheblich zwischen statischen und Echtzeit-KI-Systemen. Statische Modelle wie GPT-4 werden bis zu einem bestimmten Stichtag trainiert (beispielsweise Dezember 2023 für GPT-4-turbo) und behalten dieses Wissen, bis der nächste Trainingszyklus startet. Echtzeit-KI-Systeme wie Perplexity und Claude.ai greifen auf aktuelle Webinhalte zu, was bedeutet, dass Korrekturen an der Quelle unmittelbare Auswirkungen auf deren Antworten haben können. Es ist entscheidend zu verstehen, mit welchem Typ von KI-Plattform Sie es zu tun haben, um die effektivste Korrekturstrategie bestimmen zu können.

Die meisten großen KI-Plattformen bieten integrierte Feedback-Mechanismen, mit denen Nutzer Ungenauigkeiten melden können. ChatGPT beispielsweise enthält Daumen-hoch- und Daumen-runter-Schaltflächen bei Antworten, sodass Nutzer problematische Antworten markieren können. Wenn Sie negatives Feedback zu einer ungenauen Antwort geben, werden diese Informationen vom Team der Plattform gesammelt und analysiert. Diese Feedback-Schleifen helfen den KI-Systemen, ihre Leistung durch das Lernen aus Ergebnissen – sowohl erfolgreichen als auch fehlerhaften – zu verbessern. Das von Ihnen abgegebene Feedback wird Teil der Daten, die Entwickler nutzen, um Fehler-Muster zu identifizieren und die Genauigkeit des Modells zu steigern.

Perplexity und Claude bieten ähnliche Feedback-Optionen innerhalb ihrer Benutzeroberflächen. In der Regel können Sie melden, wenn eine Antwort ungenau, irreführend oder veraltet ist. Einige Plattformen erlauben es Ihnen, spezifische Korrekturen oder Klarstellungen anzugeben. Die Wirksamkeit dieses Feedbacks hängt davon ab, wie viele Nutzer das gleiche Problem melden und wie gravierend die Ungenauigkeit ist. Plattformen priorisieren Korrekturen bei weit verbreiteten Problemen, die viele Nutzer betreffen, sodass die Plattform eher ermittelt und handelt, wenn mehrere Personen die gleiche Ungenauigkeit über Ihre Marke melden.

Die langfristig effektivste Strategie zur Korrektur von KI-generierten Fehlinformationen besteht darin, die ursprüngliche Quelle der ungenauen Information zu adressieren. Da KI-Systeme aus Webinhalten, Nachrichtenartikeln, Wikipedia-Einträgen und anderen veröffentlichten Materialien lernen, beeinflusst eine Korrektur an diesen Quellen, wie KI-Plattformen Informationen in zukünftigen Trainingszyklen präsentieren. Fordern Sie Korrekturen oder Aktualisierungen direkt bei den ursprünglichen Herausgebern an, wo die ungenaue Information erschienen ist. Hat beispielsweise ein Nachrichtenportal fehlerhafte Informationen über Ihre Marke veröffentlicht, wenden Sie sich mit Belegen für die Unrichtigkeit an die Redaktion und bitten Sie um eine Korrektur oder Klarstellung.

Wikipedia ist eine besonders wichtige Quelle für KI-Trainingsdaten. Falls ungenaue Informationen über Ihre Marke oder Domain auf Wikipedia stehen, arbeiten Sie über die entsprechenden redaktionellen Kanäle der Plattform daran, diese zu korrigieren. Wikipedia verfügt über spezifische Prozesse zur Anfechtung von Informationen und zum Anfordern von Korrekturen, wobei deren Neutralitäts- und Überprüfbarkeitsrichtlinien beachtet werden müssen. Quellen mit hoher Autorität wie Wikipedia, große Nachrichtenorganisationen, Bildungseinrichtungen und Regierungsseiten haben ein erhebliches Gewicht in KI-Trainingsdatensätzen. Korrekturen an diesen Quellen werden mit hoher Wahrscheinlichkeit in zukünftige KI-Modell-Updates übernommen.

Für veraltete oder ungenaue Informationen auf Ihrer eigenen Website oder unter Ihrer Kontrolle stehenden Seiten sollten Sie diese zeitnah aktualisieren oder entfernen. Dokumentieren Sie alle vorgenommenen Änderungen, da diese Updates in zukünftige Trainingszyklen einfließen könnten. Wenn Sie Informationen auf Ihrer eigenen Domain korrigieren, stellen Sie KI-Systemen künftig genauere Ausgangsdaten zur Verfügung.

Konzentrieren Sie sich nicht ausschließlich auf das Entfernen negativer oder ungenauer Informationen, sondern entwickeln Sie starke Gegen-Narrative mit autoritativem, positivem Content. KI-Modelle gewichten Informationen teilweise anhand von Häufigkeits- und Autoritätsmustern in ihren Trainingsdaten. Wenn Sie deutlich mehr positiven, akkuraten und autoritativen Content erstellen, als es ungenaue Informationen gibt, werden KI-Systeme bei Antworten zu Ihrer Marke deutlich häufiger auf positive Inhalte stoßen.

| Content-Typ | Autoritätslevel | Einfluss auf KI | Zeitrahmen |

|---|---|---|---|

| Professionelle Biografie-Seiten | Hoch | Sofortiger Einfluss auf Antworten | Wochen bis Monate |

| Branchenpublikationen & Thought Leadership | Sehr hoch | Starkes Gewicht in KI-Antworten | Monate |

| Pressemitteilungen über große Presseverteiler | Hoch | Bedeutender Einfluss auf Narrative | Wochen bis Monate |

| Fallstudien und Erfolgsgeschichten | Mittel-Hoch | Kontextuelle Unterstützung für positive Aussagen | Monate |

| Akademische oder wissenschaftliche Veröffentlichungen | Sehr hoch | Langfristiger Einfluss auf Trainingsdaten | Monate bis Jahre |

| Wikipedia-Einträge | Sehr hoch | Kritisch für zukünftige KI-Trainingszyklen | Monate bis Jahre |

Erstellen Sie umfassende Inhalte auf mehreren glaubwürdigen Plattformen, damit KI-Systeme auf autoritative, positive Informationen stoßen. Dieser Ansatz der Inhaltsdurchdringung ist besonders wirkungsvoll, da er die eigentliche Ursache für KI-Fehlinformationen adressiert – ein Mangel an positiven Informationen, um ungenaue Behauptungen auszugleichen. Haben KI-Systeme Zugang zu mehr positivem, gut belegtem Content aus autoritativen Quellen, generieren sie automatisch günstigere Antworten über Ihre Marke.

Verschiedene KI-Plattformen verfügen über unterschiedliche Architekturen und Update-Zyklen, die maßgeschneiderte Korrekturansätze erfordern. ChatGPT und andere GPT-basierte Systeme beziehen sich auf Plattformen, die vor den Trainingsstichtagen enthalten sind: große Nachrichtenseiten, Wikipedia, professionelle Verzeichnisse und weit zitierte Webinhalte. Da diese Modelle nicht in Echtzeit aktualisiert werden, haben heutige Korrekturen Einfluss auf zukünftige Trainingszyklen, meist 12–18 Monate später. Perplexity und Echtzeit-KI-Suchsysteme integrieren aktuelle Webinhalte, sodass starke SEO und kontinuierliche Pressepräsenz unmittelbar Wirkung zeigen. Wird Content aus dem Live-Web entfernt oder korrigiert, bezieht sich Perplexity in der Regel innerhalb von Tagen oder Wochen nicht mehr darauf.

Claude- und Anthropic-Systeme legen besonderen Wert auf faktenbasierte, gut belegte Informationen. Anthropic betont die faktische Zuverlässigkeit, daher sollten positive Inhalte über Ihre Marke überprüfbar sein und auf vertrauenswürdige Quellen verlinken. Wenn Sie Korrekturen bei Claude anfordern, konzentrieren Sie sich auf evidenzbasierte Klarstellungen und verweisen Sie auf autoritative Quellen, die die korrekten Informationen stützen. Das Entscheidende ist zu verstehen, dass jede Plattform unterschiedliche Datenquellen, Update-Frequenzen und Qualitätsstandards besitzt. Passen Sie Ihre Korrekturstrategie entsprechend an.

Regelmäßige Überprüfung, wie KI-Systeme Ihren Namen oder Ihre Marke beschreiben, ist essenziell, um die Wirksamkeit von Korrekturen zu verfolgen. Starten Sie Abfragen in ChatGPT, Claude, Perplexity und anderen Plattformen mit sowohl positiver als auch negativer Formulierung (z. B. „Ist [Marke] vertrauenswürdig?“ versus „[Marke] Erfolge“). Protokollieren Sie die Ergebnisse über die Zeit und verfolgen Sie Fortschritte, um Ungenauigkeiten zu erkennen und zu messen, ob sich die Narrative durch Ihre Korrekturbemühungen verändern. Durch dieses Monitoring erkennen Sie neue Ungenauigkeiten frühzeitig und können schnell reagieren. Wenn Ihnen auffällt, dass eine KI-Plattform Wochen nach der Korrektur an der Quelle weiterhin auf veraltete oder fehlerhafte Informationen verweist, können Sie das Thema über die Support-Kanäle der Plattform eskalieren.

Dokumentieren Sie alle angeforderten Korrekturen und die erhaltenen Rückmeldungen. Diese Dokumentation dient mehreren Zwecken: Sie liefert Belege, falls Sie Themen eskalieren müssen, hilft dabei, Muster im Umgang verschiedener Plattformen mit Korrekturen zu erkennen, und beweist Ihre Bemühungen um korrekte Informationen. Notieren Sie, wann Sie Feedback eingereicht, welche Ungenauigkeit Sie gemeldet und welche Reaktionen Sie von der Plattform erhalten haben.

Eine vollständige Entfernung ungenauer Informationen aus KI-Suchsystemen ist selten möglich, aber Verdünnung und Kontextualisierung sind erreichbare Ziele. Die meisten KI-Anbieter aktualisieren Trainingsdaten periodisch, in der Regel alle 12–18 Monate für große Sprachmodelle. Maßnahmen, die Sie heute setzen, beeinflussen zukünftige Versionen, doch Sie sollten mit einer erheblichen Verzögerung zwischen Korrekturanfrage und der Umsetzung in KI-Antworten rechnen. Erfolg erfordert Geduld und Konsequenz. Durch die Fokussierung auf autoritativen Content, das Adressieren von Fehlern an der Quelle und den Aufbau von Glaubwürdigkeit können Sie langfristig beeinflussen, wie KI-Plattformen Ihre Marke darstellen.

Echtzeit-KI-Suchsysteme wie Perplexity zeigen Ergebnisse innerhalb von Wochen oder Monaten, während statische Modelle wie ChatGPT 12–18 Monate benötigen, um Korrekturen im Basismodell zu reflektieren. Allerdings können auch bei statischen Modellen Verbesserungen früher sichtbar werden, wenn die Plattform aktualisierte Versionen herausbringt oder gezielt Aspekte des Modells nachjustiert. Auch der Zeitrahmen hängt davon ab, wie verbreitet die Ungenauigkeit ist und wie viele Nutzer sie melden. Weit verbreitete Fehler, die viele Nutzer betreffen, werden schneller bearbeitet als Probleme, die nur wenige betreffen.

In einigen Rechtsgebieten stehen Ihnen rechtliche Mittel gegen falsche oder verleumderische Informationen zur Verfügung. Sollte eine KI-Plattform falsche, verleumderische oder schädliche Informationen über Ihre Marke generieren, könnten Sie rechtliche Schritte einleiten. „Recht auf Vergessenwerden“-Gesetze in bestimmten Ländern, insbesondere unter der DSGVO in Europa, bieten zusätzliche Möglichkeiten. Diese Gesetze erlauben es Ihnen, die Entfernung bestimmter personenbezogener Daten aus Suchergebnissen und in manchen Fällen auch aus KI-Trainingsdaten zu verlangen.

Kontaktieren Sie das Rechtsteam der KI-Plattform, wenn Sie glauben, dass Informationen gegen deren Nutzungsbedingungen oder geltende Gesetze verstoßen. Die meisten Plattformen haben Prozesse für rechtliche Beschwerden und Takedown-Anfragen. Legen Sie klare Belege für die Ungenauigkeit vor und erklären Sie, warum diese gegen Gesetze oder Richtlinien der Plattform verstoßen. Dokumentieren Sie alle Kommunikation mit der Plattform, um einen Nachweis für Ihre Bemühungen zur Problemlösung zu haben.

Die nachhaltigste Möglichkeit, Ihren Ruf in KI-Suchergebnissen zu steuern, ist, negative Informationen mit konsequent autoritativem, positivem Content zu übertreffen. Veröffentlichen Sie regelmäßig Experteninhalte, pflegen Sie professionelle Profile, sorgen Sie für stetige Medienpräsenz, bauen Sie Netzwerke zum Verstärken Ihrer Erfolge auf und heben Sie Ihr Engagement in der Community hervor. Dieser langfristige Ansatz stellt sicher, dass negative oder ungenaue Berichterstattung in der Gesamterzählung zu Ihrer Marke nur noch eine Randnotiz ist.

Setzen Sie strategisches SEO für zukünftiges KI-Training ein, indem Sie autoritative Inhalte in Suchmaschinen hoch ranken lassen. Nutzen Sie strukturierte Daten und Schema-Markup zur Kontextklärung, halten Sie konsistente NAP-Daten (Name, Adresse, Telefonnummer) und bauen Sie hochwertige Backlinks zu vertrauenswürdigem, positivem Content auf. Diese Maßnahmen erhöhen die Wahrscheinlichkeit, dass positive Informationen im nächsten KI-Training zur dominanten Erzählung werden. Da KI-Systeme immer ausgefeilter werden und stärker in den Alltag integriert sind, wächst die Bedeutung, im Web akkurate, autoritative Informationen zu pflegen. Investieren Sie jetzt in Ihre digitale Präsenz, damit KI-Plattformen auch in Zukunft Zugriff auf korrekte Informationen über Ihre Marke haben.

Verfolgen Sie, wie Ihre Marke, Domain und URLs in ChatGPT, Perplexity und anderen KI-Suchmaschinen erscheinen. Erhalten Sie Benachrichtigungen, wenn Korrekturen nötig sind und messen Sie die Wirkung Ihrer Maßnahmen.

Erfahren Sie, wie Sie falsche Markeninformationen in KI-Systemen wie ChatGPT, Gemini und Perplexity identifizieren und korrigieren. Entdecken Sie Überwachungsto...

Erfahren Sie, wie KI-Systeme die Relevanzscores von Inhalten im Laufe der Zeit durch Frische-Verfalls-Algorithmen reduzieren. Verstehen Sie zeitliche Verfallsfu...

Lernen Sie bewährte Content-Update-Strategien, um Ihre Marken-Sichtbarkeit in KI-Suchmaschinen wie ChatGPT, Google AI Overviews und Perplexity zu steigern. Entd...

Cookie-Zustimmung

Wir verwenden Cookies, um Ihr Surferlebnis zu verbessern und unseren Datenverkehr zu analysieren. See our privacy policy.