Vektorsuche

Die Vektorsuche verwendet mathematische Vektorrepräsentationen, um ähnliche Daten zu finden, indem semantische Beziehungen gemessen werden. Erfahren Sie, wie Em...

Erfahren Sie, wie die Vektorensuche maschinelle Lern-Einbettungen nutzt, um ähnliche Elemente anhand von Bedeutung statt exakter Schlüsselwörter zu finden. Verstehen Sie Vektordatenbanken, ANN-Algorithmen und reale Anwendungen.

Die Vektorensuche ist eine Technik, die maschinelles Lernen verwendet, um Daten in numerische Darstellungen – sogenannte Vektoren – umzuwandeln. Dadurch können Systeme ähnliche Elemente anhand von Bedeutung und Kontext statt exakten Schlüsselwörtern finden.

Vektorensuche ist eine Suchtechnik, die ähnliche Elemente oder Datenpunkte findet, indem sie deren numerische Darstellungen – sogenannte Vektoren oder Einbettungen – vergleicht. Im Gegensatz zu herkömmlichen, schlüsselwortbasierten Suchmaschinen, die nach exakten Wortübereinstimmungen suchen, versteht die Vektorensuche die Bedeutung und den Kontext hinter Anfragen und ermöglicht intelligentere und relevantere Ergebnisse. Diese Technologie ist heute grundlegend für moderne künstliche Intelligenz-Systeme, einschließlich KI-Antwortgeneratoren wie ChatGPT, Perplexity und andere semantische Suchmaschinen, die die nächste Generation der Informationsbeschaffung antreiben.

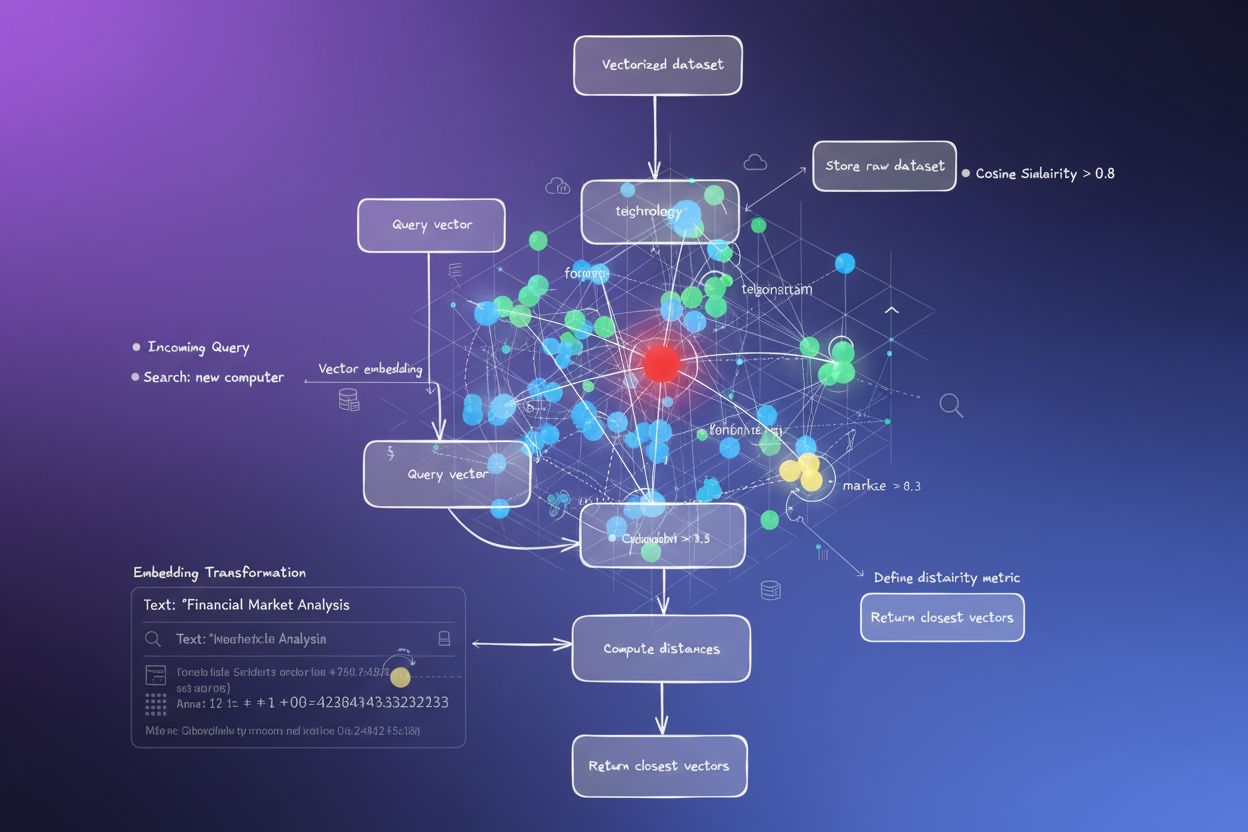

Das Kernprinzip der Vektorensuche ist, dass ähnliche Elemente ähnliche Vektordarstellungen besitzen. Wenn Sie nach Informationen suchen, wandelt das System sowohl Ihre Anfrage als auch die Daten in Vektoren in einem hochdimensionalen Raum um und berechnet dann den Abstand zwischen ihnen, um die Relevanz zu bestimmen. Dieser Ansatz erfasst semantische Beziehungen und verborgene Muster in den Daten, die bei traditionellem Schlüsselwortabgleich nicht erkannt werden, und ist daher essenziell für Anwendungen von Empfehlungssystemen bis hin zu Retrieval-Augmented Generation (RAG)-Frameworks in moderner KI.

Die traditionelle Schlüsselwortsuche arbeitet, indem sie exakte Begriffe oder Phrasen in Dokumenten abgleicht. Wenn Sie beispielsweise nach „bestes Pizzarestaurant“ suchen, gibt das System Seiten zurück, die genau diese Wörter enthalten. Dieser Ansatz stößt jedoch an erhebliche Grenzen, wenn es um Sprachvariationen, Synonyme oder fehlendes Fachvokabular beim Nutzer geht. Die Vektorensuche überwindet diese Grenzen, indem sie die Intention und Bedeutung versteht und nicht nur auf exakte Wortübereinstimmungen angewiesen ist.

Bei der Vektorensuche erkennt das System, dass „Top-Pizzerien“ und „bestes Pizzarestaurant“ eine ähnliche Bedeutung vermitteln, obwohl unterschiedliche Begriffe verwendet werden. Dieses semantische Verständnis ermöglicht es der Vektorensuche, kontextuell relevante Ergebnisse zu liefern, die traditionelle Systeme verpassen würden. So könnte eine Vektorensuche beispielsweise Artikel über sehr empfohlene Pizzerien in verschiedenen Orten anzeigen, auch wenn dort nie die exakte Phrase „bestes Pizzarestaurant“ vorkommt. Der Unterschied ist grundlegend: Traditionelle Suche fokussiert auf Schlüsselwörter, während Vektorensuche auf Bedeutungen setzt.

| Aspekt | Traditionelle Schlüsselwortsuche | Vektorensuche |

|---|---|---|

| Abgleichsmethode | Exakte Wort- oder Phrasenübereinstimmungen | Semantische Ähnlichkeit basierend auf Bedeutung |

| Datendarstellung | Diskrete Token, Schlüsselwörter, Tags | Dichte numerische Vektoren im hochdimensionalen Raum |

| Skalierbarkeit | Schwierigkeiten bei großen Datensätzen | Skaliert effizient auf Millionen oder Milliarden Einträge |

| Unstrukturierte Daten | Begrenzte Fähigkeit | Verarbeitet Text, Bilder, Audio und Video |

| Kontextverständnis | Minimal | Erfasst semantische Beziehungen und Kontext |

| Suchgeschwindigkeit | Variiert mit Datensatzgröße | Millisekunden, selbst bei sehr großen Datensätzen |

Die Grundlage der Vektorensuche ist der Vektorisierungsprozess, der Rohdaten in numerische Darstellungen umwandelt. Dieser Prozess beginnt mit der Datenaufbereitung, bei der rohe Texte oder andere Datentypen bereinigt und standardisiert werden. Anschließend wird ein Einbettungsmodell ausgewählt und auf dem Datensatz trainiert, um Einbettungen für jeden Datenpunkt zu erzeugen. Beliebte Einbettungsmodelle sind Word2Vec, GloVe, FastText und transformerbasierte Modelle wie BERT oder RoBERTa.

Vektoreinbettungen sind dichte numerische Arrays, bei denen die meisten oder alle Elemente ungleich null sind. So können sie mehr Informationen auf kleinerem Raum speichern als sparsame Darstellungen. Jede Dimension eines Vektors entspricht einem latenten Merkmal oder einer zugrundeliegenden Eigenschaft der Daten, die nicht direkt beobachtet, sondern durch mathematische Modelle erschlossen wird. Bei Texteinbettungen erfassen die Dimensionen beispielsweise semantische Konzepte wie Stimmung, Thema oder Entitätentyp. Diese Einbettungen werden dann in einer Vektordatenbank oder einem Vektorensuch-Plugin gespeichert, wobei Indizes mit Techniken wie Hierarchical Navigable Small World (HNSW)-Graphen für schnelle und effiziente Ähnlichkeitsabfragen erstellt werden.

Die Vektorensuche bestimmt die Relevanz, indem sie die Ähnlichkeit zwischen Anfrage- und Dokumentvektoren anhand mathematischer Distanzmetriken misst. Die beiden gebräuchlichsten Metriken sind euklidische Distanz und Kosinusähnlichkeit. Die euklidische Distanz berechnet den kürzesten Abstand zwischen zwei Punkten im Raum als Quadratwurzel der Summe der quadrierten Differenzen zwischen den jeweiligen Koordinaten. Sie eignet sich für niedrigdimensionale Räume, kann aber in hochdimensionalen Vektorräumen an Aussagekraft verlieren.

Die Kosinusähnlichkeit misst den Winkel zwischen zwei Vektoren und zeigt, wie eng sie aufeinander ausgerichtet sind. Sie berechnet den Kosinus des Winkels zwischen den Vektoren, wobei 1 perfekte Ausrichtung, 0 orthogonale Vektoren und -1 entgegengesetzte Richtungen bedeutet. Die Kosinusähnlichkeit ist besonders nützlich für die Vektorensuche, da sie auf Richtungsverhältnisse statt auf Beträge abzielt und sich daher ideal für den Vergleich hochdimensionaler Einbettungen eignet. Beim Vergleich von Vektoren mit Hunderten oder Tausenden von Dimensionen liefert die Kosinusähnlichkeit aussagekräftigere Ähnlichkeitswerte als die euklidische Distanz und ist daher das bevorzugte Maß in den meisten modernen Vektorensuchsystemen.

Jeden Vektor in einer Datenbank mit einem Anfragevektor zu vergleichen, wäre rechnerisch sehr aufwendig und bei großen Datensätzen nicht praktikabel. Um dieses Problem zu lösen, nutzen Vektorensuchsysteme Approximate Nearest Neighbor (ANN)-Algorithmen, die effizient Vektoren finden, die ungefähr am nächsten zu einer Anfrage liegen, ohne die exakten Abstände zu allen Vektoren berechnen zu müssen. ANN-Algorithmen tauschen einen kleinen Teil an Genauigkeit gegen immense Geschwindigkeits- und Effizienzgewinne ein und machen so Vektorensuche überhaupt erst in großem Maßstab möglich.

Einer der beliebtesten ANN-Algorithmen ist HNSW (Hierarchical Navigable Small World), der Vektoren in einer hierarchischen, mehrschichtigen Graphstruktur organisiert. Diese Struktur ermöglicht eine schnelle Navigation durch den Datensatz, indem beim Indexaufbau ähnliche Vektoren zusammen gruppiert werden. HNSW balanciert dabei längere Distanzen für schnelle Suche in oberen Schichten mit kürzeren Distanzen für präzise Suche in unteren Schichten aus und erreicht so hohe Recall-Raten (oft über 95%) bei Abfragezeiten im Millisekundenbereich – auch bei Milliarden von Vektoren. Weitere ANN-Methoden sind baumbasierte Ansätze wie ANNOY, clusterbasierte Methoden wie FAISS und Hashing-Techniken wie LSH, die jeweils unterschiedliche Kompromisse zwischen Latenz, Durchsatz, Genauigkeit und Aufbauzeit bieten.

Die Vektorensuche treibt zahlreiche Anwendungen in verschiedenen Bereichen und Branchen an. Retrieval Augmented Generation (RAG) ist eine der wichtigsten Anwendungen, bei der Vektorensuche mit großen Sprachmodellen kombiniert wird, um genaue und kontextuell relevante Antworten zu erzeugen. In RAG-Systemen ruft die Vektorensuche relevante Dokumente oder Passagen aus einer Wissensbasis ab, die dann einem LLM zur Verfügung gestellt werden, damit Antworten auf Basis realer Daten generiert werden – und nicht nur nach dem Trainingsstand des Modells. Diese Methode reduziert Halluzinationen deutlich und verbessert die faktische Genauigkeit KI-generierter Antworten.

Empfehlungssysteme nutzen die Vektorensuche, um Produkte, Filme, Musik oder Inhalte basierend auf Nutzerpräferenzen und -verhalten vorzuschlagen. Durch das Finden von Elementen mit ähnlichen Vektordarstellungen können Empfehlungssysteme Produkte vorschlagen, mit denen Nutzer noch nicht interagiert haben, die ihnen aber vermutlich gefallen. Semantische Suchanwendungen setzen Vektorensuche ein, um Suchmaschinen zu ermöglichen, die Nutzerintention verstehen, sodass relevante Informationen selbst ohne exakte Schlüsselwörter gefunden werden. Bild- und Videosuchsysteme verwenden Vektoreinbettungen, um visuelle Inhalte zu indexieren. Nutzer können so nach optisch ähnlichen Bildern oder Videos in großen Datensätzen suchen. Zudem ermöglicht die Vektorensuche multimodale Suchfunktionen, bei denen Nutzer gleichzeitig über verschiedene Datentypen suchen können – etwa Bilder anhand von Textbeschreibungen oder umgekehrt finden.

Die Vektorensuche ist zur kritischen Infrastruktur für KI-Antwortgeneratoren und semantische Suchmaschinen wie ChatGPT, Perplexity und vergleichbare Plattformen geworden. Diese Systeme nutzen Vektorensuche, um relevante Informationen aus ihren Trainingsdaten und indizierten Wissensbasen abzurufen, wenn sie Antworten auf Nutzeranfragen generieren. Stellen Sie einer KI eine Frage, wird Ihre Anfrage in einen Vektor umgewandelt und das System durchsucht riesige indizierte Datensätze nach den relevantesten Informationen, die dann zur Erzeugung kontextgerechter Antworten verwendet werden.

Für Unternehmen und Content-Ersteller ist das Verständnis der Vektorensuche entscheidend, um Markensichtbarkeit in KI-generierten Antworten sicherzustellen. Da KI-Systeme immer häufiger der primäre Weg zur Informationssuche werden, wird es zunehmend wichtiger, dass Ihre Inhalte über die Vektorensuche auffindbar und abrufbar sind. Monitoring-Plattformen wie AmICited verfolgen, wie Ihre Marke, Ihre Domain und Ihre URLs in KI-generierten Antworten verschiedener Systeme erscheinen, damit Sie Ihre Sichtbarkeit in diesem neuen Suchparadigma verstehen. Durch die Überwachung von Vektorensuchergebnissen können Sie Chancen erkennen, die Relevanz Ihrer Inhalte zu verbessern und sicherstellen, dass Ihre Marke erscheint, wenn KI-Systeme zu Ihrem Fachgebiet oder Ihrer Branche Antworten generieren.

Die Vektorensuche bietet erhebliche Vorteile gegenüber traditionellen Suchmethoden – insbesondere bei der Verarbeitung unstrukturierter Daten wie Dokumenten, Bildern, Audio und Video. Sie ermöglicht schnellere Suchen in riesigen Datensätzen, relevantere Ergebnisse durch semantisches Verständnis und die gleichzeitige Suche über verschiedene Datentypen hinweg. Die Technologie entwickelt sich rasant weiter: Verbesserungen bei Einbettungsmodellen, ANN-Algorithmen und Vektordatenbanken machen die Vektorensuche immer schneller, präziser und für Entwickler sowie Unternehmen jeder Größe zugänglicher.

Mit der zunehmenden Integration künstlicher Intelligenz in Suche und Informationsbeschaffung wird die Vektorensuche weiterhin eine zentrale Rolle spielen, wie Menschen Informationen entdecken. Organisationen, die Vektorensuchtechnologie verstehen und nutzen, werden besser in der Lage sein, ihre Inhalte in KI-generierten Antworten auffindbar zu machen und intelligente Anwendungen mit überlegenen Nutzererlebnissen zu schaffen. Der Wandel von schlüsselwortbasierter zu semantischer Suche stellt eine grundlegende Veränderung in der Organisation und dem Abruf von Informationen dar. Vektorensuch-Kompetenz wird daher für alle, die Inhalte erstellen, SEO betreiben oder KI-Anwendungen entwickeln, unverzichtbar.

Die Vektorensuche treibt moderne KI-Systeme wie ChatGPT und Perplexity an. Stellen Sie sicher, dass Ihre Marke in KI-generierten Antworten mit der Monitoring-Plattform von AmICited erscheint.

Die Vektorsuche verwendet mathematische Vektorrepräsentationen, um ähnliche Daten zu finden, indem semantische Beziehungen gemessen werden. Erfahren Sie, wie Em...

Erfahren Sie, wie Vektor-Einbettungen KI-Systemen ermöglichen, semantische Bedeutungen zu verstehen und Inhalte mit Anfragen abzugleichen. Entdecken Sie die Tec...

Erfahren Sie, wie KI-Suchindexierung Daten in durchsuchbare Vektoren umwandelt, sodass KI-Systeme wie ChatGPT und Perplexity relevante Informationen aus Ihren I...

Cookie-Zustimmung

Wir verwenden Cookies, um Ihr Surferlebnis zu verbessern und unseren Datenverkehr zu analysieren. See our privacy policy.