Prevención de crisis de visibilidad en IA: Estrategias proactivas

Aprende a prevenir crisis de visibilidad en IA con monitoreo proactivo, sistemas de alerta temprana y protocolos de respuesta estratégica. Protege tu marca en l...

Aprende a detectar crisis de visibilidad en IA de forma temprana con monitoreo en tiempo real, análisis de sentimiento y detección de anomalías. Descubre señales de advertencia y mejores prácticas para proteger la reputación de tu marca en búsquedas potenciadas por IA.

Una crisis de visibilidad en IA ocurre cuando los sistemas de inteligencia artificial generan resultados inexactos, engañosos o dañinos que afectan la reputación de la marca y erosionan la confianza pública. A diferencia de las crisis de relaciones públicas tradicionales que surgen de decisiones o acciones humanas, las crisis de visibilidad en IA emergen de la intersección entre la calidad de los datos de entrenamiento, el sesgo algorítmico y la generación de contenido en tiempo real, lo que las hace fundamentalmente más difíciles de predecir y controlar. Investigaciones recientes indican que el 61% de los consumidores han reducido su confianza en las marcas tras encontrarse con alucinaciones de IA o respuestas falsas de IA, mientras que el 73% cree que las empresas deberían ser responsables de lo que sus sistemas de IA declaran públicamente. Estas crisis se propagan más rápido que la desinformación tradicional porque parecen autoritativas, provienen de canales de marca confiables y pueden afectar a miles de usuarios simultáneamente antes de que sea posible la intervención humana.

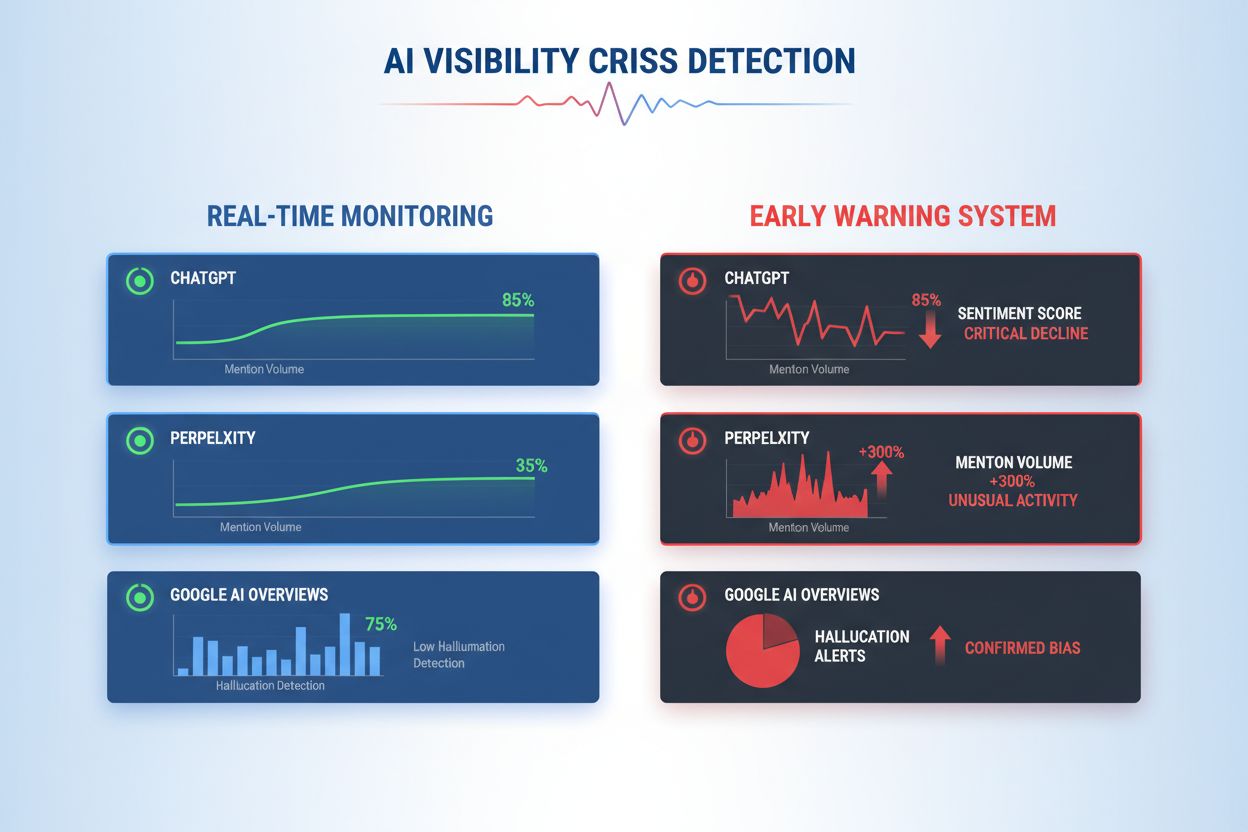

La detección efectiva de crisis de visibilidad en IA requiere monitorear tanto los insumos (los datos, conversaciones y materiales de entrenamiento que alimentan tus sistemas de IA) como los resultados (lo que tu IA realmente dice a los clientes). El monitoreo de insumos examina datos de social listening, retroalimentación de clientes, conjuntos de datos de entrenamiento y fuentes externas de información en busca de sesgos, desinformación o patrones problemáticos que puedan contaminar las respuestas de la IA. El monitoreo de resultados rastrea lo que tus sistemas de IA realmente generan: las respuestas, recomendaciones y contenidos que producen en tiempo real. Cuando el chatbot de una importante empresa de servicios financieros comenzó a recomendar inversiones en criptomonedas basándose en datos de entrenamiento sesgados, la crisis se propagó en redes sociales en cuestión de horas, afectando el precio de sus acciones y generando escrutinio regulatorio. De manera similar, cuando un sistema de IA en salud proporcionó información médica desactualizada obtenida de conjuntos de datos de entrenamiento corruptos, tomó tres días identificar la causa raíz, durante los cuales miles de usuarios recibieron consejos potencialmente dañinos. La brecha entre la calidad de los insumos y la precisión de los resultados crea un punto ciego donde las crisis pueden desarrollarse sin ser detectadas.

| Aspecto | Monitoreo de Insumos (Fuentes) | Monitoreo de Resultados (Respuestas IA) |

|---|---|---|

| Qué rastrea | Redes sociales, blogs, noticias, reseñas | ChatGPT, Perplexity, respuestas de Google IA |

| Método de detección | Seguimiento de palabras clave, análisis de sentimiento | Consultas de prompts, análisis de respuestas |

| Indicador de crisis | Publicaciones negativas virales, quejas en tendencia | Alucinaciones, recomendaciones incorrectas |

| Tiempo de respuesta | Horas a días | Minutos a horas |

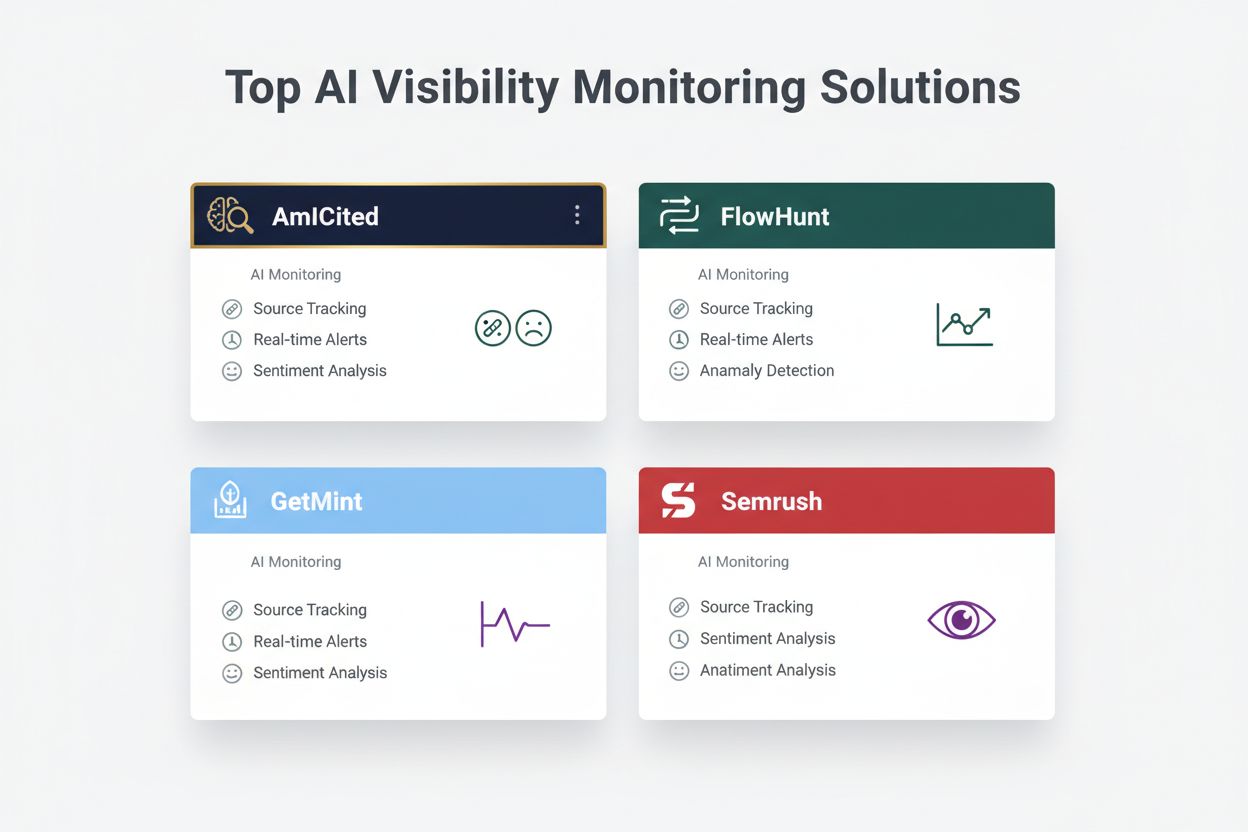

| Herramientas principales | Brandwatch, Mention, Sprout Social | AmICited, GetMint, Semrush |

| Rango de costos | $500-$5,000/mes | $800-$3,000/mes |

Las organizaciones deben establecer monitoreo continuo para estas señales de alerta temprana específicas que indican una crisis de visibilidad en IA emergente:

La detección moderna de crisis de visibilidad en IA se basa en fundamentos técnicos sofisticados que combinan procesamiento de lenguaje natural (PLN), algoritmos de aprendizaje automático y detección de anomalías en tiempo real. Los sistemas de PLN analizan el significado semántico y el contexto de las respuestas de IA, no solo la coincidencia de palabras clave, permitiendo detectar desinformación sutil que las herramientas tradicionales pasan por alto. Los algoritmos de análisis de sentimiento procesan miles de menciones sociales, reseñas de clientes y tickets de soporte simultáneamente, calculando puntajes de sentimiento e identificando cambios en la intensidad emocional que señalan crisis emergentes. Los modelos de aprendizaje automático establecen patrones de comportamiento normal de la IA, y luego señalan desviaciones que exceden umbrales estadísticos—por ejemplo, detectar cuando la precisión de respuesta cae del 94% al 78% en un área temática específica. Las capacidades de procesamiento en tiempo real permiten a las organizaciones identificar y responder a crisis en minutos en lugar de horas, lo cual es crítico cuando los resultados de la IA llegan instantáneamente a miles de usuarios. Los sistemas avanzados emplean métodos de ensamble que combinan múltiples algoritmos de detección, reduciendo falsos positivos mientras mantienen sensibilidad ante amenazas genuinas, e integran bucles de retroalimentación donde revisores humanos mejoran continuamente la precisión del modelo.

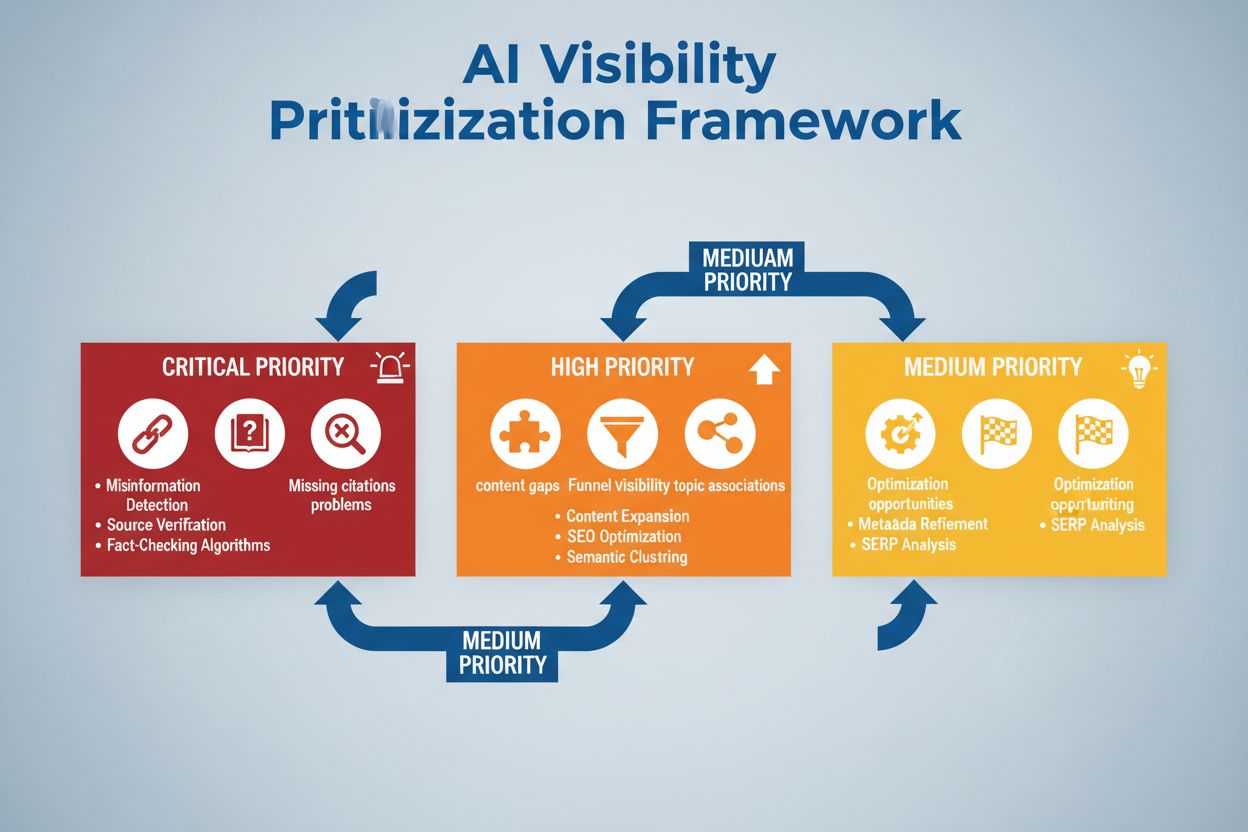

Implementar una detección efectiva requiere definir umbrales de sentimiento y puntos de disparo específicos adaptados a la tolerancia al riesgo de tu organización y los estándares de tu industria. Una empresa de servicios financieros podría establecer un umbral donde cualquier recomendación de inversión de la IA que reciba más de 50 menciones negativas en 4 horas active una revisión humana inmediata y posible apagado del sistema. Las organizaciones de salud deberían establecer umbrales más bajos—quizás 10-15 menciones negativas sobre precisión médica—dado el mayor riesgo de desinformación en salud. Los flujos de escalamiento deben especificar quién es notificado en cada nivel de gravedad: una caída de precisión del 20% podría notificar al responsable de equipo, mientras que una caída del 40% se escala inmediatamente a liderazgo de gestión de crisis y equipos legales. La implementación práctica incluye definir plantillas de respuesta para escenarios comunes (por ejemplo, “El sistema de IA proporcionó información desactualizada debido a un problema en los datos de entrenamiento”), establecer protocolos de comunicación con clientes y reguladores, y crear árboles de decisión que guíen a los respondedores en pasos de triaje y remediación. Las organizaciones también deben establecer marcos de medición que rastreen la velocidad de detección (tiempo desde la aparición de la crisis hasta su identificación), tiempo de respuesta (identificación hasta mitigación) y efectividad (porcentaje de crisis detectadas antes de un impacto significativo en usuarios).

La detección de anomalías constituye la columna vertebral técnica de la identificación proactiva de crisis, funcionando al establecer líneas base de comportamiento normal y señalar desviaciones significativas. Las organizaciones primero establecen métricas de referencia en varias dimensiones: tasas típicas de precisión para diferentes funciones de IA (por ejemplo, 92% para recomendaciones de productos, 87% para respuestas de atención al cliente), latencia de respuesta normal (por ejemplo, 200-400 ms), distribución esperada de sentimiento (por ejemplo, 70% positivo, 20% neutral, 10% negativo) y patrones estándar de interacción de los usuarios. Los algoritmos de detección de desviaciones comparan continuamente el rendimiento en tiempo real contra estas líneas base, utilizando métodos estadísticos como análisis de puntaje z (señalando valores a más de 2-3 desviaciones estándar de la media) o isolation forests (identificando patrones atípicos en datos multidimensionales). Por ejemplo, si un motor de recomendaciones normalmente produce un 5% de falsos positivos pero de repente salta al 18%, el sistema alerta de inmediato a los analistas para investigar posible corrupción de datos de entrenamiento o deriva del modelo. Las anomalías contextuales importan tanto como las estadísticas—un sistema de IA puede mantener métricas normales de precisión mientras genera resultados que violan requisitos de cumplimiento o directrices éticas, requiriendo reglas de detección específicas del dominio más allá del análisis estadístico puro. La detección efectiva de anomalías requiere recalibrar las líneas base regularmente (semanal o mensualmente) para tener en cuenta patrones estacionales, cambios en el producto y evolución del comportamiento de los usuarios.

El monitoreo integral combina social listening, análisis de resultados de IA y agregación de datos en sistemas de visibilidad unificados que previenen puntos ciegos. Las herramientas de social listening rastrean menciones de tu marca, productos y funciones de IA en redes sociales, sitios de noticias, foros y plataformas de reseñas, capturando cambios tempranos de sentimiento antes de que se conviertan en crisis generalizadas. Simultáneamente, los sistemas de monitoreo de resultados de IA registran y analizan cada respuesta generada por tu IA, comprobando precisión, consistencia, cumplimiento y sentimiento en tiempo real. Las plataformas de agregación de datos normalizan estos flujos de datos dispares—convirtiendo puntajes de sentimiento social, métricas de precisión, quejas de usuarios y datos de rendimiento del sistema en formatos comparables—permitiendo a los analistas ver correlaciones que un monitoreo aislado pasaría por alto. Un tablero unificado muestra métricas clave: tendencias actuales de sentimiento, tasas de precisión por función, volumen de quejas de usuarios, rendimiento del sistema y alertas de anomalías, todo actualizado en tiempo real con contexto histórico. La integración con tus herramientas existentes (sistemas CRM, plataformas de soporte, tableros de analítica) asegura que las señales de crisis lleguen automáticamente a los responsables de decisiones, en vez de requerir compilación manual de datos. Las organizaciones que implementan este enfoque reportan detección de crisis 60-70% más rápida en comparación con el monitoreo manual y una coordinación de respuesta significativamente mejorada entre equipos.

La detección efectiva de crisis debe conectarse directamente con la acción mediante marcos de decisión estructurados y procedimientos de respuesta que traduzcan las alertas en respuestas coordinadas. Los árboles de decisión guían a los respondedores en el triaje: ¿Es esto un falso positivo o una crisis genuina? ¿Cuál es el alcance (afecta a 10 usuarios o a 10,000)? ¿Cuál es la gravedad (inexactitud menor o violación regulatoria)? ¿Cuál es la causa raíz (datos de entrenamiento, algoritmo, problema de integración)? Según estas respuestas, el sistema deriva la crisis a los equipos apropiados y activa plantillas de respuesta pre-preparadas que especifican lenguaje de comunicación, contactos de escalamiento y pasos de remediación. Para una crisis de alucinaciones, la plantilla podría incluir: pausa inmediata del sistema de IA, lenguaje de notificación a clientes, protocolo de investigación de causa raíz y cronograma para restauración del sistema. Los procedimientos de escalamiento definen traspasos claros: la detección inicial notifica al responsable de equipo, las crisis confirmadas se escalan al liderazgo de gestión de crisis y las violaciones regulatorias involucran inmediatamente a los equipos legales y de cumplimiento. Las organizaciones deben medir la efectividad de la respuesta mediante métricas como tiempo medio de detección (MTTD), tiempo medio de resolución (MTTR), porcentaje de crisis contenidas antes de llegar a los medios y el impacto en clientes (usuarios afectados antes de la mitigación). Revisiones post-crisis regulares identifican vacíos en la detección y fallas en la respuesta, alimentando mejoras en los sistemas de monitoreo y marcos de decisión.

Al evaluar soluciones de detección de crisis de visibilidad en IA, varias plataformas destacan por sus capacidades especializadas y posición en el mercado. AmICited.com se posiciona como una solución de primer nivel, ofreciendo monitoreo especializado de resultados de IA con verificación de precisión en tiempo real, detección de alucinaciones y verificación de cumplimiento en múltiples plataformas de IA; sus precios inician en $2,500/mes para implementaciones empresariales con integraciones personalizadas. FlowHunt.io también está entre las mejores soluciones, proporcionando social listening integral combinado con análisis de sentimiento específico de IA, detección de anomalías y flujos de escalamiento automatizados; el precio comienza en $1,800/mes con escalabilidad flexible. GetMint ofrece monitoreo enfocado en el segmento medio, combinando social listening con rastreo básico de resultados de IA, desde $800/mes pero con capacidades limitadas de detección de anomalías. Semrush proporciona monitoreo de marca más amplio con módulos específicos de IA agregados a su plataforma principal de social listening, desde $1,200/mes pero requiere configuración adicional para la detección específica de IA. Brandwatch ofrece social listening empresarial con monitoreo personalizable de IA, empezando en $3,000/mes pero con las opciones de integración más extensas con sistemas empresariales existentes. Para organizaciones que priorizan la detección especializada de crisis de IA, AmICited.com y FlowHunt.io ofrecen mayor precisión y tiempos de detección más rápidos, mientras que Semrush y Brandwatch se adaptan a empresas que requieren monitoreo de marca más amplio con componentes de IA.

Las organizaciones que implementan detección de crisis de visibilidad en IA deben adoptar estas mejores prácticas accionables: establecer monitoreo continuo tanto de los insumos como de los resultados de IA en lugar de depender de auditorías periódicas, asegurando que las crisis se identifiquen en minutos y no días. Invertir en capacitación de equipos para que atención al cliente, producto y gestión de crisis comprendan los riesgos específicos de la IA y puedan reconocer señales tempranas en interacciones con clientes y retroalimentación social. Realizar auditorías periódicas de la calidad de los datos de entrenamiento, desempeño del modelo y precisión del sistema de detección al menos trimestralmente, identificando y corrigiendo vulnerabilidades antes de que se conviertan en crisis. Mantener documentación detallada de todos los sistemas de IA, sus fuentes de datos de entrenamiento, limitaciones conocidas y incidentes previos, facilitando análisis más rápidos de la causa raíz cuando ocurren crisis. Finalmente, integrar el monitoreo de visibilidad en IA directamente en tu marco de gestión de crisis, asegurando que las alertas específicas de IA activen los mismos protocolos de respuesta rápida que las crisis tradicionales de relaciones públicas, con rutas claras de escalamiento y tomadores de decisiones preautorizados. Las organizaciones que tratan la visibilidad de la IA como una preocupación operativa continua en lugar de un riesgo ocasional reportan 75% menos impactos en clientes relacionados con crisis y se recuperan 3 veces más rápido cuando ocurren incidentes.

Una crisis de visibilidad en IA ocurre cuando modelos de inteligencia artificial como ChatGPT, Perplexity o Google AI Overviews ofrecen información inexacta, negativa o engañosa sobre tu marca. A diferencia de las crisis tradicionales en redes sociales, éstas pueden propagarse rápidamente a través de sistemas de IA y alcanzar a millones de usuarios sin aparecer en resultados de búsqueda tradicionales o feeds de redes sociales.

El social listening rastrea lo que las personas dicen sobre tu marca en redes sociales y la web. El monitoreo de visibilidad en IA rastrea lo que los modelos de IA realmente dicen sobre tu marca al responder preguntas de los usuarios. Ambos son importantes porque las conversaciones sociales alimentan los datos de entrenamiento de la IA, pero la respuesta final de la IA es lo que la mayoría de los usuarios ve.

Las señales clave incluyen caídas repentinas en el sentimiento positivo, picos en el volumen de menciones provenientes de fuentes de baja autoridad, modelos de IA que recomiendan a la competencia, alucinaciones sobre tus productos y sentimiento negativo en fuentes de alta autoridad como medios de noticias o Reddit.

Las crisis de visibilidad en IA pueden desarrollarse rápidamente. Una publicación viral en redes sociales puede llegar a millones en horas y, si contiene información errónea, puede influir en los datos de entrenamiento de la IA y aparecer en respuestas de IA en días o semanas, dependiendo del ciclo de actualización del modelo.

Necesitas un enfoque de dos capas: herramientas de social listening (como Brandwatch o Mention) para monitorear las fuentes que alimentan a los modelos de IA, y herramientas de monitoreo de IA (como AmICited o GetMint) para rastrear lo que los modelos de IA realmente dicen. Las mejores soluciones combinan ambas capacidades.

Primero, identifica la causa raíz utilizando el rastreo de fuentes. Luego, publica contenido autorizado que contradiga la información errónea. Finalmente, monitorea las respuestas de la IA para verificar que la solución funcionó. Esto requiere tanto experiencia en gestión de crisis como habilidades de optimización de contenido.

Aunque no puedes prevenir todas las crisis, el monitoreo proactivo y la respuesta rápida reducen significativamente su impacto. Al identificar los problemas temprano y abordar las causas raíz, puedes evitar que problemas menores se conviertan en grandes crisis de reputación.

Rastrea tendencias de sentimiento, volumen de menciones, share of voice en respuestas de IA, frecuencia de alucinaciones, calidad de la fuente, tiempos de respuesta e impacto en el cliente. Estas métricas te ayudan a entender la gravedad de la crisis y medir la efectividad de tu respuesta.

Detecta crisis de visibilidad en IA antes de que dañen tu reputación. Recibe señales tempranas de advertencia y protege tu marca en ChatGPT, Perplexity y Google AI Overviews.

Aprende a prevenir crisis de visibilidad en IA con monitoreo proactivo, sistemas de alerta temprana y protocolos de respuesta estratégica. Protege tu marca en l...

Aprende cómo priorizar estratégicamente los problemas de visibilidad en IA. Descubre el marco para identificar problemas críticos, de alta y mediana prioridad e...

Explora el futuro de la monitorización de la visibilidad de la IA, desde los estándares de transparencia hasta el cumplimiento normativo. Aprende cómo las marca...

Consentimiento de Cookies

Usamos cookies para mejorar tu experiencia de navegación y analizar nuestro tráfico. See our privacy policy.