La visión a largo plazo para la visibilidad de la IA: hacia dónde nos dirigimos

Explora el futuro de la monitorización de la visibilidad de la IA, desde los estándares de transparencia hasta el cumplimiento normativo. Aprende cómo las marca...

Aprenda las mejores prácticas esenciales para la transparencia y divulgación de la IA. Descubra métodos de divulgación conductuales, verbales y técnicas para generar confianza y garantizar el cumplimiento de las regulaciones de IA en evolución.

La transparencia en IA se ha convertido en un imperativo crítico en una era donde los sistemas de inteligencia artificial influyen en todo, desde la creación de contenido hasta decisiones de contratación y recomendaciones financieras. A medida que el contenido generado por IA prolifera en las plataformas digitales, las organizaciones enfrentan una presión creciente para divulgar cuándo y cómo utilizan estas tecnologías, no solo como obligación legal, sino como un requisito fundamental para mantener la confianza y credibilidad con sus audiencias. Las apuestas son particularmente altas para marcas y creadores de contenido, ya que los consumidores cada vez demandan saber si la información que consumen proviene de experiencia humana o generación algorítmica. Sin prácticas de divulgación transparentes, las organizaciones corren el riesgo de erosionar la confianza que les llevó años construir, enfrentando posibles daños reputacionales, sanciones regulatorias y pérdida de confianza del público. La relación entre transparencia y credibilidad es simbiótica: las organizaciones que divulgan proactivamente su uso de IA demuestran integridad y respeto por sus grupos de interés, posicionándose como actores honestos en un panorama cada vez más impulsado por la IA.

La proliferación de contenido generado por IA ha creado una profunda paradoja de confianza: las audiencias luchan por distinguir entre trabajo auténticamente creado por humanos y alternativas sofisticadas generadas por IA, mientras que la transparencia sobre el uso de IA sigue siendo inconsistente entre industrias. Esta confusión socava el contrato fundamental entre creadores y consumidores, donde las audiencias esperan conocer el verdadero origen del contenido que encuentran. Cuando el contenido generado por IA se presenta sin divulgación, viola este acuerdo implícito, creando una dicotomía de “real vs. falso” que va más allá de simples preocupaciones de autenticidad: abarca cuestiones de engaño, manipulación y consentimiento informado. La paradoja se profundiza porque parte del contenido generado por IA puede ser indistinguible del trabajo humano en calidad y estilo, haciendo que las pistas visuales o estilísticas sean indicadores poco fiables del origen. La transparencia importa precisamente porque resuelve esta paradoja, dando a las audiencias la información necesaria para tomar decisiones informadas sobre el contenido que consumen y en el que confían. Las organizaciones que adoptan prácticas claras de divulgación transforman el escepticismo potencial en confianza, demostrando que no tienen nada que ocultar y todo que ganar con una comunicación honesta.

El entorno regulatorio en torno a la divulgación de IA evoluciona rápidamente, con múltiples jurisdicciones implementando o proponiendo requisitos que las organizaciones deben navegar con cuidado. La Ley de IA de la UE, uno de los marcos más completos, exige que el contenido generado o editado en gran medida por IA incluya divulgación visible o a nivel de metadatos, con requisitos específicos para sistemas de IA de alto riesgo y obligaciones de transparencia para los desarrolladores. En Estados Unidos, la FTC ha emitido advertencias indicando que no actualizar los Términos de Uso y las Políticas de Privacidad para el uso de IA podría constituir prácticas engañosas, mientras que regulaciones estatales—especialmente la reciente ley de divulgación de modelos frontera de IA de California—imponen obligaciones de transparencia y reporte reforzadas a los desarrolladores de grandes sistemas de IA. Las consideraciones de derechos de autor y propiedad intelectual añaden otra capa de complejidad, ya que las organizaciones deben divulgar si los datos de entrenamiento incluían material protegido y cómo se entrenaron los sistemas de IA. Además, los requisitos de GDPR y CCPA se extienden a sistemas de IA que procesan datos personales, exigiendo a las organizaciones divulgar la toma de decisiones automatizada y proporcionar a los individuos información significativa sobre el procesamiento de IA. La siguiente tabla resume los requisitos regulatorios clave en las principales jurisdicciones:

| Jurisdicción | Regulación | Requisitos clave | Fecha de entrada en vigor |

|---|---|---|---|

| Unión Europea | Ley de IA de la UE | Divulgación para IA de alto riesgo; reportes de transparencia; etiquetado de metadatos para contenido generado por IA | Fases (2024-2026) |

| Estados Unidos (Federal) | Guías FTC | Actualizar políticas de privacidad; divulgar uso de IA; evitar prácticas engañosas | En curso |

| California | Ley de Modelos Fronterizos de IA | Divulgación estandarizada; obligaciones de reporte; medidas de seguridad | 2025 |

| Unión Europea | GDPR | Divulgar decisiones automatizadas; informar sobre procesamiento de IA | En curso |

| Estados Unidos (Varios estados) | CCPA y similares | Divulgar uso de datos en sistemas de IA; ofrecer mecanismos de exclusión | Varía por estado |

| Internacional | Consideraciones de Derechos de Autor | Divulgar fuentes de datos de entrenamiento; abordar derechos de autor en salidas de IA | Emergente |

Las organizaciones que operan en múltiples jurisdicciones deben implementar prácticas de divulgación que satisfagan los requisitos más estrictos, ya que cumplir con un estándar suele superar el mínimo exigido por otros.

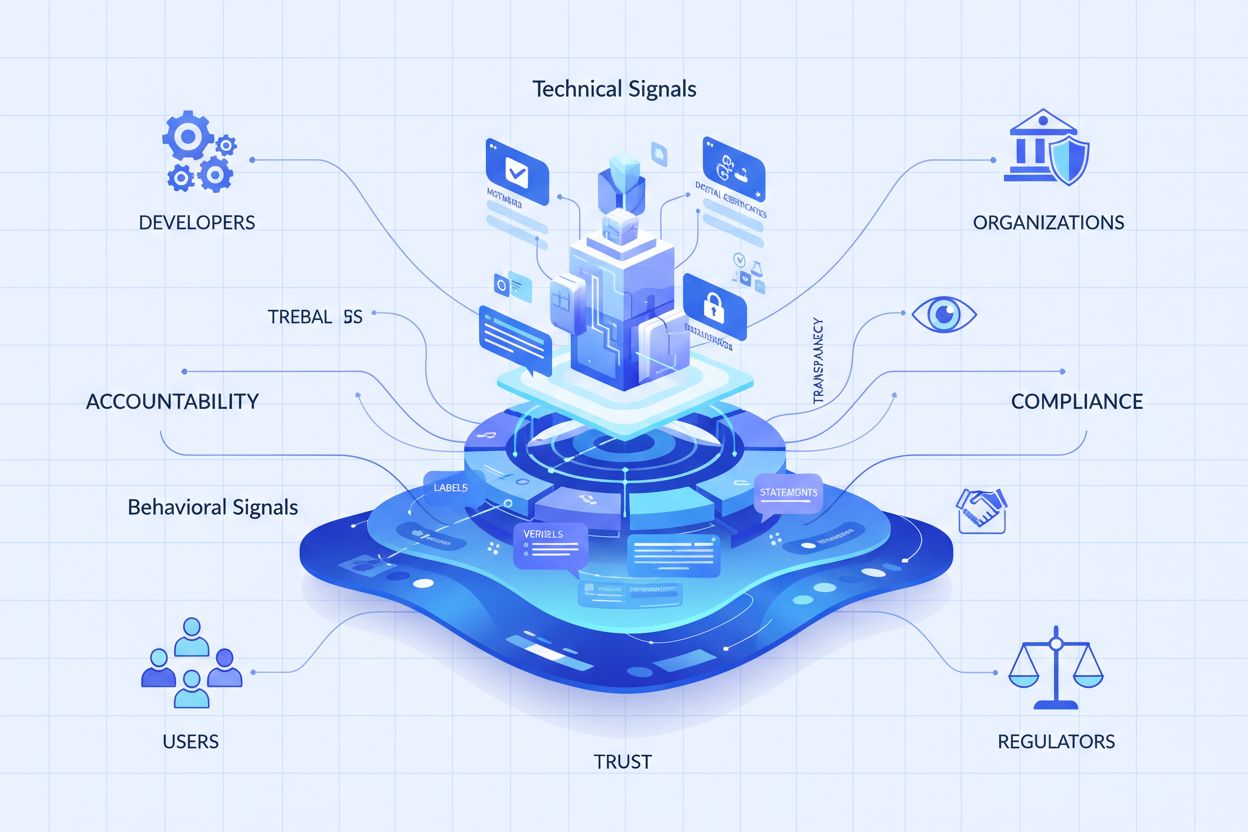

Las señales conductuales representan la forma más sutil pero poderosa de divulgación de IA, operando a través de la presentación, el estilo, la voz y las elecciones creativas que las audiencias procesan inconscientemente al evaluar la autenticidad del contenido. Estas señales incluyen patrones distintivos en el estilo de escritura, consistencia de la voz, elecciones de composición visual, características de avatares o personajes y el “grado de fidelidad” general de la representación del creador—esencialmente, el grado en que el contenido refleja una personalidad humana genuina y toma de decisiones auténtica. Por ejemplo, el texto generado por IA a menudo exhibe patrones particulares en la estructura de las oraciones, la selección de vocabulario y el flujo lógico que difieren de la escritura humana, mientras que las imágenes generadas por IA pueden mostrar inconsistencias sutiles en la iluminación, anatomía o detalles de fondo que los observadores entrenados pueden detectar. El concepto de fidelidad del creador es central aquí: las audiencias desarrollan expectativas sobre cómo debe sonar, verse y presentarse un creador en particular, y las desviaciones de este patrón establecido pueden señalar la participación de IA. Sin embargo, confiar únicamente en señales conductuales es problemático porque los sistemas de IA mejoran rápidamente en imitar características humanas, y no se puede esperar que las audiencias se conviertan en expertos forenses de IA. Por tanto, las señales conductuales deben complementar—y no reemplazar—los métodos explícitos de divulgación, sirviendo como una capa secundaria de transparencia que refuerza, en lugar de sustituir, la comunicación clara y directa sobre el uso de IA.

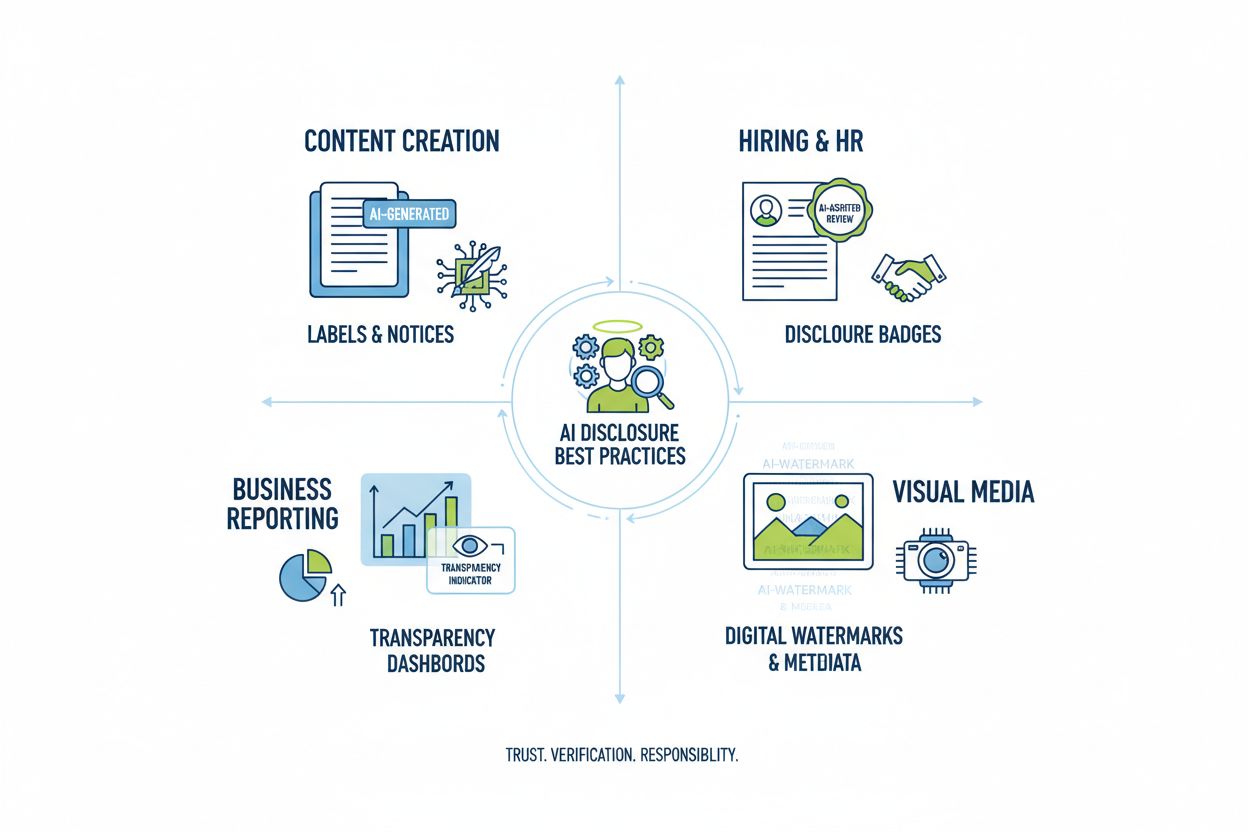

Las estrategias de divulgación verbal proporcionan una comunicación explícita y directa sobre el uso de IA mediante señales basadas en el lenguaje que no dejan ambigüedad acerca del origen del contenido y la participación de la IA. Estos métodos son esenciales porque crean un registro claro y documentado de la divulgación y aseguran que las audiencias reciban información inequívoca sobre el uso de IA. Las organizaciones pueden implementar la divulgación verbal a través de varios enfoques complementarios:

La idoneidad de cada método depende del contexto: las etiquetas funcionan bien para redes sociales y contenido visual, las marcas de agua para video y audio, las firmas para trabajos periodísticos y creativos, los campos de divulgación para contenido de mayor extensión y los agradecimientos brindan contexto integral en proyectos complejos. Las organizaciones deben seleccionar métodos de divulgación que se ajusten a su formato de contenido y expectativas de la audiencia, asegurando que la divulgación sea imposible de pasar por alto y, al mismo tiempo, no intrusiva en la experiencia de usuario.

Las señales técnicas y los metadatos proporcionan información estandarizada y legible por máquina sobre la participación de IA, permitiendo la detección, verificación y seguimiento automatizados del contenido generado por IA en los ecosistemas digitales. Estos enfoques aprovechan datos incrustados y técnicas criptográficas para crear registros permanentes y resistentes a manipulaciones sobre el origen del contenido y el historial de procesamiento. Los estándares IPTC, recientemente actualizados para incluir propiedades de metadatos específicas para IA, permiten a los creadores incrustar información estructurada sobre el uso de IA directamente en archivos de imagen, incluyendo detalles sobre qué sistemas se emplearon, qué procesamiento se aplicó y qué modificaciones humanas se hicieron. C2PA (Coalición para la Procedencia y Autenticidad del Contenido) representa un estándar emergente en la industria que utiliza firmas criptográficas y credenciales de contenido para establecer cadenas verificables de custodia de contenido digital, permitiendo a las audiencias rastrear el contenido hasta su fuente original y comprender todas las modificaciones aplicadas. Estos enfoques técnicos abordan una limitación crítica de la divulgación legible por humanos: crean registros permanentes y verificables que no pueden eliminarse o alterarse fácilmente, y permiten a los sistemas automatizados identificar y marcar contenido generado por IA a gran escala. Las organizaciones que implementen divulgación técnica deben considerar la adopción de credenciales C2PA para contenido de alto valor, la incrustación de metadatos IPTC en imágenes y archivos multimedia, y el mantenimiento de documentación detallada de tipo de fuente digital que rastree la participación de IA en todo el ciclo de vida del contenido. La ventaja de las señales técnicas es su permanencia y verificabilidad; el reto es asegurar que las audiencias y plataformas comprendan y respeten estas señales.

Divulgar el uso de IA con éxito requiere institucionalizar las prácticas de transparencia en todo el flujo de trabajo de creación de contenido, transformando la divulgación de un aspecto secundario a un componente fundamental de la gobernanza del contenido. Las organizaciones deben implementar marcos estructurados de contenido que capturen la participación de IA en cada etapa de la creación—desde la investigación inicial y el borrador, hasta la edición y la publicación—asegurando que la información de divulgación fluya naturalmente por los sistemas de gestión de contenido existentes. La automatización y la integración del flujo de trabajo son esenciales: los sistemas de gestión de contenido deben incluir campos obligatorios para la divulgación de IA, avisos automáticos que requieran a los creadores documentar el uso de IA antes de publicar y flujos de aprobación que verifiquen la completitud de la divulgación antes de que el contenido salga en vivo. Este enfoque trata la divulgación como un requisito de control de calidad, similar a cómo las organizaciones gestionan la verificación de hechos, la revisión legal o el cumplimiento de marca. Las organizaciones también deben establecer políticas claras que definan qué constituye uso de IA que requiere divulgación (por ejemplo, ¿usar IA para investigación requiere divulgación? ¿Y la edición asistida por IA?), asegurando coherencia entre equipos y evitando vacíos de divulgación. La capacitación y la documentación son igualmente importantes: los creadores de contenido necesitan instrucciones claras sobre cómo divulgar el uso de IA apropiadamente según el tipo de contenido y la plataforma. Al incorporar la divulgación en los modelos y flujos de trabajo de contenido, las organizaciones convierten la transparencia de una carga de cumplimiento en un procedimiento estándar que protege tanto a la organización como a sus audiencias.

Las distintas aplicaciones de IA requieren enfoques de divulgación adaptados que consideren el contexto, las expectativas de la audiencia y los requisitos regulatorios. La creación de contenido (artículos, redes sociales, textos de marketing) debe incluir etiquetas claras o modificaciones en la firma que indiquen la participación de IA, con campos de divulgación adicionales que expliquen qué herramientas se utilizaron y qué supervisión humana se aplicó; esto es especialmente importante en contenido noticioso y editorial donde la confianza de la audiencia depende de conocer el origen del contenido. Los contextos de contratación y reclutamiento exigen la divulgación más rigurosa, ya que los candidatos tienen derecho a saber cuándo sistemas de IA evalúan sus solicitudes o realizan preselecciones, incluyendo explicaciones detalladas sobre cómo se toman las decisiones de IA y qué procesos de revisión humana siguen. Los informes y análisis (informes financieros, investigación de mercados, análisis de datos) deben incluir divulgaciones técnicas y metadatos que indiquen qué análisis se realizaron con asistencia de IA, especialmente cuando los sistemas de IA identificaron patrones o generaron conclusiones que influyeron en los resultados. El contenido visual (imágenes, videos, gráficos) requiere tanto marcas de agua visuales como divulgación mediante metadatos, ya que las audiencias no pueden distinguir de manera fiable los visuales generados por IA de los auténticos; esto es fundamental para fotografía de noticias, imágenes de productos y cualquier contenido donde la autenticidad afecte decisiones de compra o confianza. Las comunicaciones de cara al cliente (chatbots, respuestas automáticas, servicio al cliente) deben identificar claramente la participación de IA desde el inicio de la interacción, permitiendo a los clientes solicitar asistencia humana si lo desean. Las organizaciones deben auditar su uso de IA en estos contextos e implementar prácticas de divulgación proporcionales a la sensibilidad e impacto de cada caso, reconociendo que los requisitos de transparencia varían según cómo afecten las decisiones de IA a las audiencias.

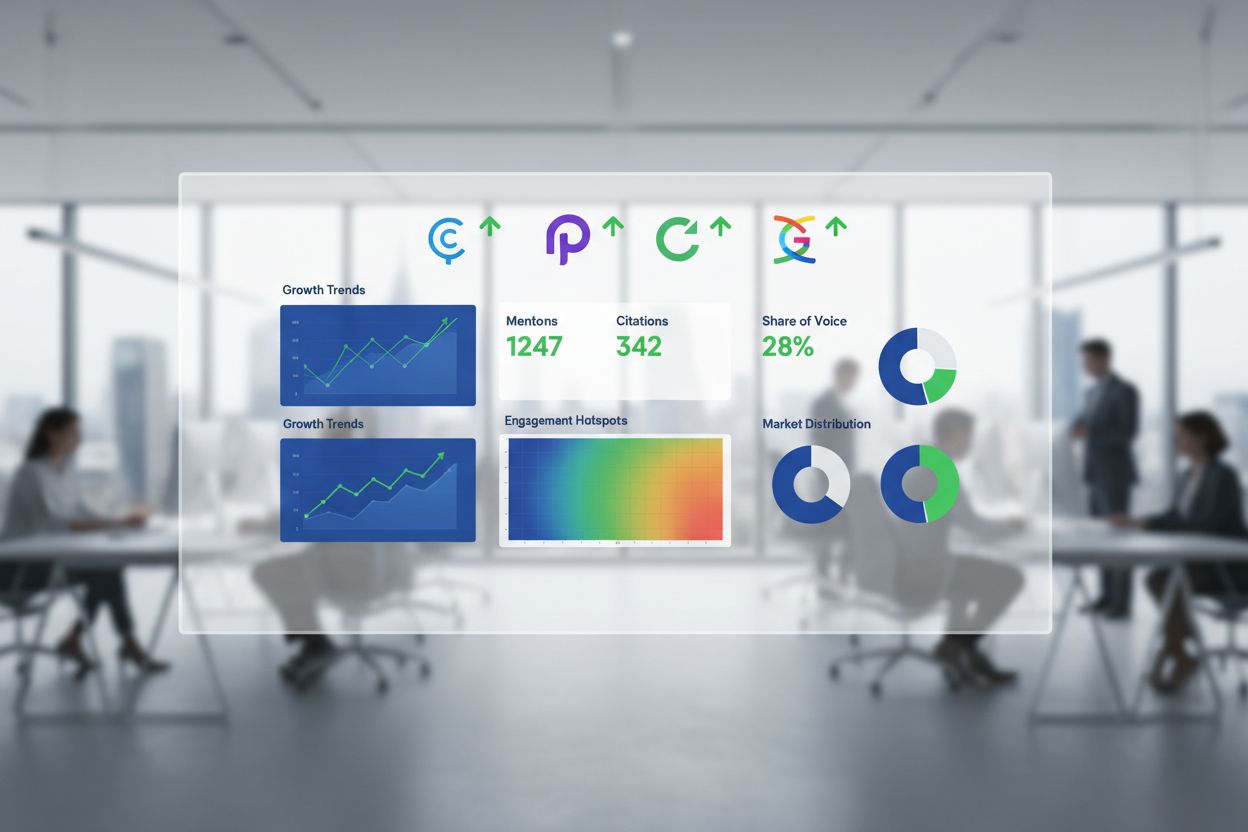

El futuro de la divulgación de IA depende de la estandarización a nivel industrial y del desarrollo de marcos interoperables que permitan una transparencia coherente y comparable entre organizaciones y plataformas. Los estándares emergentes como C2PA, las especificaciones de metadatos IPTC y el Marco de Gestión de Riesgos de IA de NIST proporcionan estructuras fundamentales, pero su adopción generalizada requiere un esfuerzo coordinado de plataformas tecnológicas, creadores de contenido, reguladores y organismos industriales. La Ley de IA de la UE y marcos regulatorios similares están impulsando la estandarización al exigir formatos de divulgación y categorías de información específicas, creando presión para la adopción industrial de estándares comunes en lugar de enfoques idiosincráticos. Las iniciativas industriales como las directrices éticas sobre IA de la PRSA y varios marcos de reportes de transparencia demuestran un creciente consenso sobre las mejores prácticas de divulgación, aunque la adopción voluntaria sigue siendo inconsistente. El siguiente paso crítico es pasar de estándares voluntarios a requisitos regulatorios que obliguen a la divulgación estandarizada, similar a cómo las etiquetas nutricionales de la FDA estandarizaron la transparencia alimentaria. Las plataformas de monitoreo y visibilidad—como AmICited.com—juegan un papel cada vez más importante en este ecosistema al rastrear cómo la IA referencia marcas y contenido en respuestas generadas, brindando a las organizaciones visibilidad sobre cómo aparece su trabajo en los resultados de IA y si se están produciendo la atribución y divulgación adecuadas. A medida que los sistemas de IA se vuelven más sofisticados y ubicuos, la capacidad para monitorear, verificar y auditar las prácticas de divulgación de IA será esencial para mantener la confianza en los ecosistemas de información digital. Las organizaciones que inviertan hoy en prácticas robustas de divulgación y capacidades de monitoreo estarán mejor posicionadas para navegar el cambiante entorno regulatorio y mantener la confianza de la audiencia en un futuro impulsado por la IA.

La divulgación conductual utiliza elecciones de presentación (estilo, voz, avatar) para señalar la participación de la IA. La divulgación verbal utiliza declaraciones explícitas, etiquetas y marcas de agua. La divulgación técnica incrusta metadatos legibles por máquina y firmas criptográficas. Cada método sirve a diferentes audiencias y contextos, y las organizaciones deben utilizar múltiples métodos juntos para lograr una transparencia integral.

Los requisitos legales varían según la jurisdicción. La Ley de IA de la UE exige divulgación para sistemas de IA de alto riesgo. La FTC exige divulgación cuando el uso de IA podría afectar las decisiones de los consumidores. Leyes estatales como la Ley de Modelos Fronterizos de IA de California imponen obligaciones de reporte. La ley de derechos de autor exige la divulgación de contenido generado por IA. Las organizaciones deben consultar a asesores legales para conocer los requisitos específicos de cada jurisdicción.

Las imágenes generadas por IA deben incluir marcas de agua visuales y divulgación mediante metadatos. Las marcas de agua visuales deben ser visibles pero no intrusivas, indicando claramente la generación por IA. Los metadatos deben incluir información IPTC sobre el tipo digital de fuente y credenciales C2PA cuando estén disponibles. Los subtítulos y campos de divulgación deben indicar explícitamente que las imágenes son generadas por IA, especialmente para contenido de noticias, productos o promocional.

Los estándares IPTC proporcionan campos estructurados de metadatos para documentar el uso de IA en imágenes y archivos multimedia. Permiten la detección y seguimiento automatizados de contenido generado por IA en diversas plataformas. Las categorías IPTC de tipo de fuente digital incluyen 'Medios Algorítmicos Entrenados', 'Sintético Compuesto' y 'Medios Algorítmicos'. Estos estándares son importantes porque crean registros permanentes y verificables de la participación de IA que no pueden eliminarse o alterarse fácilmente.

Las empresas deben realizar una auditoría de IA para identificar todos los casos de uso, implementar políticas de divulgación alineadas con las regulaciones aplicables, integrar la divulgación en los flujos de trabajo de gestión de contenido, capacitar a los equipos en los requisitos de divulgación y monitorear el cumplimiento regularmente. Es esencial consultar a expertos legales familiarizados con las regulaciones de IA en su jurisdicción, ya que los requisitos varían mucho entre regiones.

Las consecuencias incluyen sanciones regulatorias (multas de la FTC, violaciones de leyes estatales), daño reputacional y pérdida de confianza de la audiencia, responsabilidad legal por infracción de derechos de autor o prácticas engañosas, y posibles demandas de partes afectadas. Las organizaciones que no divulguen el uso de IA corren el riesgo de erosionar la credibilidad que llevó años construir, por lo que la divulgación proactiva es una inversión estratégica en la confianza a largo plazo.

Diferentes grupos de interés requieren distintos niveles de información. El público general necesita declaraciones simples y claras sobre la participación de la IA. Los reguladores requieren documentación técnica detallada y evidencia de cumplimiento. Periodistas y creadores de contenido necesitan información específica sobre las herramientas de IA y la supervisión humana. Los clientes deben entender cómo la IA afecta su experiencia. Adapte el formato y el nivel de detalle de la divulgación a las necesidades y expectativas de cada audiencia.

C2PA (Coalición para la Procedencia y Autenticidad del Contenido) proporciona credenciales criptográficas para la verificación de contenido. Los estándares IPTC permiten la incrustación de metadatos en imágenes. Los sistemas de gestión de contenido incluyen cada vez más campos de divulgación de IA. Plataformas de monitoreo como AmICited.com rastrean referencias y visibilidad de IA. Marcos industriales de PRSA, NIST y otros brindan orientación. La adopción de estas herramientas y estándares se está acelerando a medida que se endurecen las regulaciones.

Supervise cómo los sistemas de IA hacen referencia a su marca en GPTs, Perplexity y Google AI Overviews. Asegúrese de que su contenido reciba la atribución y visibilidad adecuada en las respuestas generadas por IA.

Explora el futuro de la monitorización de la visibilidad de la IA, desde los estándares de transparencia hasta el cumplimiento normativo. Aprende cómo las marca...

Aprende a construir informes de visibilidad en IA integrales que los ejecutivos entiendan. Haz seguimiento de las menciones de tu marca en ChatGPT, Perplexity y...

Descubre qué significa la transparencia en el ranking de la IA, por qué es importante para creadores de contenido y usuarios, y cómo diferentes plataformas de I...

Consentimiento de Cookies

Usamos cookies para mejorar tu experiencia de navegación y analizar nuestro tráfico. See our privacy policy.