Corrección de desinformación en IA

Aprende cómo identificar y corregir información incorrecta sobre marcas en sistemas de IA como ChatGPT, Gemini y Perplexity. Descubre herramientas de monitoreo,...

Aprende cómo impugnar información inexacta de IA, reportar errores a ChatGPT y Perplexity, e implementar estrategias para asegurar que tu marca esté representada con precisión en las respuestas generadas por IA.

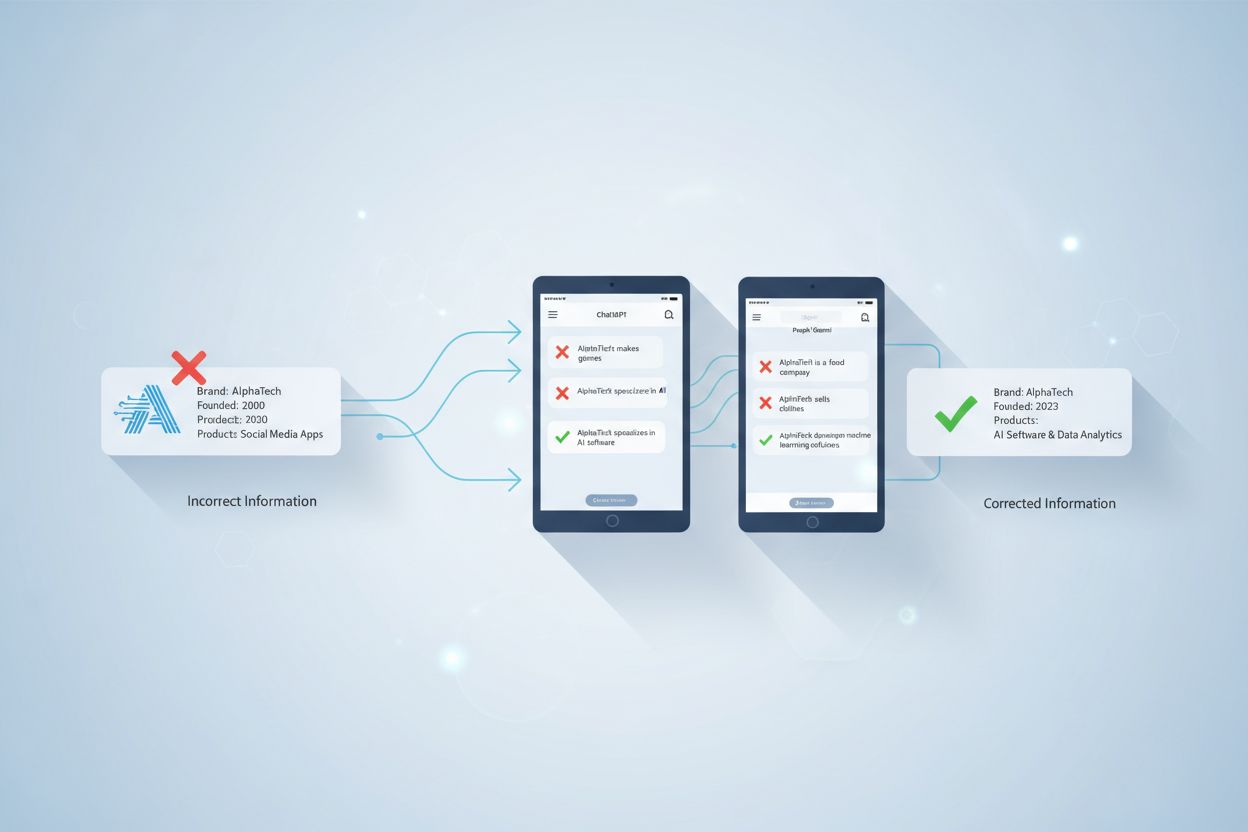

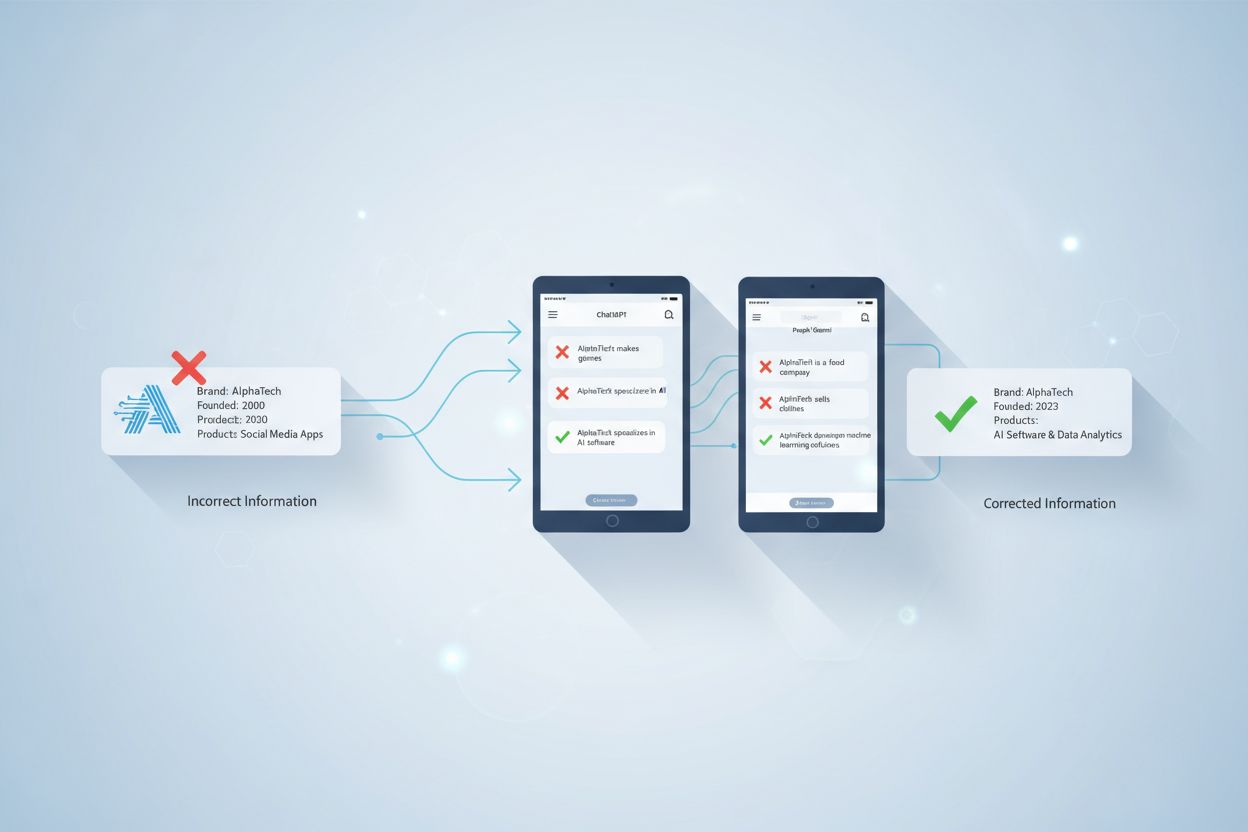

Puedes impugnar información inexacta generada por la IA reportándola directamente a la plataforma de IA, optimizando tu contenido para los sistemas de IA, utilizando herramientas de monitoreo de marca y aplicando datos estructurados para asegurar una representación precisa en ChatGPT, Perplexity y otros motores de búsqueda de IA.

La información inexacta en las respuestas de IA representa un desafío significativo para empresas e individuos en el entorno digital actual. Cuando sistemas de IA como ChatGPT, Perplexity y Gemini generan información incorrecta sobre tu marca, productos o servicios, puede dañar tu reputación, inducir a error a potenciales clientes y resultar en oportunidades de negocio perdidas. El problema es especialmente agudo porque estos motores de búsqueda impulsados por IA están reconfigurando fundamentalmente la forma en que los usuarios descubren y evalúan información en línea. Con el 60% de las búsquedas en Google finalizando sin un clic en 2024 y las tasas de clics orgánicos reduciéndose a más de la mitad cuando aparecen respuestas de IA, asegurar una representación precisa de la marca en las respuestas de IA se ha vuelto crítico para mantener una ventaja competitiva.

Los sistemas de IA generan información inexacta a través de múltiples mecanismos. Estos sistemas operan con una arquitectura dual que consiste en conocimiento preentrenado y aumento de búsqueda en tiempo real, lo que significa que la información incorrecta puede incorporarse de dos formas distintas. Primero, información desactualizada o incorrecta de los datos de entrenamiento puede persistir en las respuestas del modelo. Segundo, contenido inexacto de fuentes web actuales puede ser recuperado y citado por el sistema de IA. El problema fundamental es que los modelos de IA están diseñados para generar la secuencia de palabras más probable en respuesta a una consulta, no para verificar si la información es realmente correcta. Esto significa que la IA no puede distinguir entre información precisa e inexacta: simplemente produce lo que considera la respuesta más probable según sus datos de entrenamiento.

La mayoría de las principales plataformas de IA ofrecen mecanismos para que los usuarios reporten respuestas inexactas o problemáticas. Perplexity, por ejemplo, permite a los usuarios reportar respuestas incorrectas o inexactas utilizando el icono de bandera ubicado debajo de la respuesta. Los usuarios también pueden crear un ticket de soporte a través de la ventana de soporte de Perplexity o enviar un correo electrónico directamente a support@perplexity.ai con detalles sobre la inexactitud. Este mecanismo de reporte ayuda a la plataforma a identificar patrones de desinformación y mejorar la calidad de sus respuestas con el tiempo. Al reportar información inexacta, es importante ser específico sobre qué información es incorrecta, proporcionar evidencia de la información correcta y explicar cómo la inexactitud podría afectar a los usuarios o a tu negocio.

ChatGPT y otras plataformas de IA también ofrecen mecanismos de retroalimentación, aunque el proceso específico varía según la plataforma. Normalmente, los usuarios pueden marcar respuestas como problemáticas o inexactas mediante botones de retroalimentación integrados. Sin embargo, es importante comprender que reportar información inexacta a plataformas individuales de IA es un enfoque reactivo: aborda casos específicos pero no previene futuras ocurrencias. El verdadero reto es que los sistemas de IA generan continuamente nuevas respuestas basadas en sus datos de entrenamiento y resultados de búsqueda en tiempo real, por lo que un solo reporte puede no impedir que la misma inexactitud aparezca en futuras respuestas a consultas similares.

La estrategia más efectiva a largo plazo para impugnar información inexacta de IA es optimizar tu contenido específicamente para el consumo de sistemas de IA. Este enfoque, conocido como Optimización para Motores Generativos (GEO), difiere fundamentalmente del SEO tradicional. Mientras que el SEO tradicional se enfoca en posicionar en las páginas de resultados de búsqueda, GEO asegura que la información de tu marca sea citada y embebida con precisión en las respuestas generadas por IA. Esto implica estructurar y formatear tu contenido para que sea fácilmente comprendido, extraído y citado por las plataformas de IA.

El marcado de datos estructurados juega un papel crucial en este proceso. Al implementar el marcado schema adecuado en tu sitio web, provees a los sistemas de IA información clara y legible por máquinas sobre tu negocio, productos y servicios. Esto facilita significativamente que los sistemas de IA accedan a información precisa sobre tu marca en lugar de depender de datos desactualizados o incorrectos de otras fuentes. Además, un mensaje de marca claro y consistente en todos los puntos de contacto digitales ayuda a los sistemas de IA a comprender y representar correctamente tu marca. Cuando tu sitio web, perfiles en redes sociales y otras propiedades online presentan información coherente, los sistemas de IA son más propensos a citar esta información precisa en sus respuestas.

| Estrategia | Implementación | Resultado Esperado |

|---|---|---|

| Marcado de Datos Estructurados | Implementar schema.org en el sitio web | Los sistemas de IA acceden a datos precisos y legibles por máquinas |

| Optimización de Contenido | Crear contenido claro, factual y bien referenciado | Mayor precisión en las citas en las respuestas de IA |

| Consistencia de Marca | Mantener mensajes coherentes en todas las plataformas | Menos confusión y mala representación |

| Actualizaciones Regulares | Mantener el contenido actualizado | Los sistemas de IA priorizan información reciente y autorizada |

| Construcción de Autoridad | Desarrollar relaciones con publicaciones del sector | Señales de credibilidad mejoradas para los sistemas de IA |

Las herramientas de monitoreo de marca en IA ofrecen visibilidad esencial sobre cómo se representa tu marca en diferentes plataformas de IA. Estas herramientas especializadas monitorean continuamente cómo los sistemas de IA describen tu marca, identifican inconsistencias y rastrean los cambios en la representación de la marca a lo largo del tiempo. Al utilizar estas herramientas, puedes detectar inexactitudes rápidamente e implementar medidas correctivas antes de que causen daños significativos a tu reputación.

Las plataformas integrales de monitoreo de marca en IA ofrecen varias capacidades clave. Pueden auditar cómo aparece tu marca en ChatGPT, Perplexity y otros motores de búsqueda de IA, proporcionando información detallada sobre el sentimiento de marca, el uso de palabras clave y el posicionamiento competitivo. Estas herramientas suelen incluir Puntajes de Visibilidad en IA que combinan menciones, citas, sentimiento y rankings para formar una visión fiable de la visibilidad de tu marca en los sistemas de IA. Al monitorear regularmente la presencia de tu marca en IA, puedes identificar patrones de desinformación, rastrear la efectividad de tus esfuerzos correctivos y asegurar que se cite información precisa en las respuestas de IA.

La ventaja de utilizar herramientas de monitoreo dedicadas es que ofrecen seguimiento continuo y sistemático en lugar de depender de revisiones manuales ocasionales. Esto te permite detectar inexactitudes rápidamente y responder con contenido correctivo antes de que la desinformación se generalice. Además, estas herramientas suelen proporcionar inteligencia competitiva, mostrándote cómo se compara la representación de tu marca en IA frente a la competencia e identificando oportunidades para mejorar tu posicionamiento.

Una vez que hayas identificado información inexacta sobre tu marca en respuestas de IA, el remedio más efectivo es crear y distribuir contenido correctivo y autorizado. Este contenido debe abordar directamente las inexactitudes y proporcionar información clara y factual que los sistemas de IA puedan extraer y citar fácilmente. La clave del éxito es asegurar que este contenido correctivo sea altamente autorizado, bien referenciado y optimizado para la comprensión de la IA.

El contenido correctivo efectivo sigue varias mejores prácticas. Primero, debe contener afirmaciones claras y factuales que contradigan directamente la información inexacta. En lugar de simplemente indicar lo correcto, el contenido debe explicar por qué la información previa era incorrecta y proporcionar evidencia que respalde la información precisa. Segundo, el contenido debe usar formato estructurado con encabezados claros, viñetas y secciones organizadas que faciliten su interpretación y comprensión por parte de los sistemas de IA. Tercero, el contenido debe ser actualizado regularmente para reflejar la información más reciente sobre tu marca, señalando a los sistemas de IA que se trata de información autorizada y actualizada digna de ser citada.

La estrategia de distribución es tan importante como la creación del contenido. Tu contenido correctivo debe publicarse en plataformas de alta autoridad donde los sistemas de IA probablemente lo descubran y citen. Esto incluye tu sitio web oficial, publicaciones del sector y directorios relevantes. Al distribuir el contenido correctivo en múltiples canales, aumentas la probabilidad de que los sistemas de IA encuentren y citen esta información precisa en lugar de recurrir a fuentes desactualizadas o incorrectas. Además, amplificar este contenido a través de redes sociales e influencers del sector puede incrementar su visibilidad y señales de autoridad, haciendo más probable que sea citado por sistemas de IA.

Las alucinaciones de IA representan una forma especialmente desafiante de información inexacta, donde los sistemas de IA generan hechos, citas o fuentes completamente inventadas. No se trata de errores simples o malinterpretaciones: son casos en los que la IA presenta información falsa con confianza, como si fuera fáctica. Por ejemplo, una IA podría citar investigaciones inexistentes, inventar estadísticas falsas o crear citas falsas atribuidas a personas reales. Estas alucinaciones son especialmente problemáticas porque suelen presentarse con tanta seguridad que los usuarios pueden no cuestionar su exactitud.

La causa principal de las alucinaciones de IA radica en cómo se entrenan y operan estos sistemas. Los modelos de IA están optimizados para generar textos que suenen plausibles en lugar de verificar la exactitud factual. Cuando un sistema de IA se encuentra con una consulta para la que no tiene datos de entrenamiento claros, puede generar lo que parece ser una respuesta razonable basada en patrones de sus datos, aunque esa respuesta sea completamente inventada. Por eso los sistemas de IA a menudo generan citas y fuentes falsas: están creando lo que creen que son referencias plausibles en lugar de recuperar fuentes reales.

Para combatir las alucinaciones de IA sobre tu marca, necesitas asegurarte de que información precisa y autorizada sobre tu marca esté ampliamente disponible y sea fácilmente descubrible por los sistemas de IA. Cuando las IA tienen acceso a información clara y factual de fuentes autorizadas, es menos probable que inventen información alternativa. Además, monitoreando regularmente las respuestas de IA, puedes detectar alucinaciones rápidamente e implementar medidas correctivas antes de que se propaguen.

En casos donde la información inexacta de la IA cause un daño significativo a tu negocio, puede ser necesario recurrir a acciones legales. Varios casos de alto perfil han establecido precedentes para responsabilizar a los sistemas de IA y sus operadores por proveer información inexacta. Por ejemplo, Air Canada enfrentó responsabilidad legal cuando su chatbot de IA proporcionó información incorrecta sobre tarifas por duelo, resultando en un fallo del tribunal que consideró a la aerolínea responsable por representación negligente. Estos casos demuestran que las empresas pueden ser responsables por la información inexacta generada por sus sistemas de IA.

Más allá de la vía legal, consultar con consultores de marca y expertos en SEO puede ayudarte a desarrollar estrategias integrales para abordar la mala representación generalizada. Estos profesionales pueden ayudarte a identificar las causas raíz de las inexactitudes, desarrollar estrategias de contenido correctivo e implementar enfoques sistemáticos para mejorar la representación de tu marca en los sistemas de IA. Además, trabajar con tu equipo legal para comprender tus derechos y posibles remedios es importante, especialmente si la información inexacta está causando daños comerciales medibles.

Para problemas complejos de marca o mala representación generalizada, la ayuda profesional suele ser necesaria. Especialistas en Optimización para Motores Generativos y gestión de marca en IA pueden ayudarte a navegar las complejidades de corregir información inexacta en múltiples plataformas de IA. También pueden ayudarte a implementar procesos sistemáticos de monitoreo y corrección para prevenir futuras inexactitudes.

Impugnar eficazmente la información inexacta generada por IA requiere medición y seguimiento sistemático de tus esfuerzos. Estableciendo métricas claras y monitoreando el progreso a lo largo del tiempo, puedes determinar si tus estrategias correctivas están funcionando y ajustar el enfoque según sea necesario. Los indicadores clave de desempeño deben incluir mejoras en la exactitud, incrementos en visibilidad y cambios en el posicionamiento competitivo.

Las empresas que implementan estrategias sistemáticas de corrección suelen ver una reducción del 80-95% en errores fácticos en 30 días, junto con mejoras significativas en visibilidad de marca y posicionamiento competitivo. Estas mejoras se pueden medir mediante pruebas regulares de respuestas de IA a consultas relacionadas con la marca, seguimiento de los cambios en cómo los sistemas de IA describen tu marca y monitoreo de patrones de sentimiento y citas. Estableciendo mediciones de referencia antes de implementar estrategias correctivas, puedes demostrar claramente el impacto de tus esfuerzos.

Además, rastrear métricas de impacto en el negocio como calidad de los leads, consultas de clientes y tasas de conversión puede ayudarte a comprender las consecuencias reales de la información inexacta de IA y el valor de tus esfuerzos de corrección. Cuando puedes demostrar que corregir información inexacta de IA conduce a mejores resultados comerciales, resulta más fácil justificar la inversión en monitoreo y optimización continua.

Toma el control de cómo aparece tu marca en respuestas generadas por IA. Rastrea menciones, sentimiento y visibilidad en ChatGPT, Perplexity y otras plataformas de IA.

Aprende cómo identificar y corregir información incorrecta sobre marcas en sistemas de IA como ChatGPT, Gemini y Perplexity. Descubre herramientas de monitoreo,...

Aprende estrategias efectivas para identificar, monitorear y corregir información inexacta sobre tu marca en respuestas generadas por IA como ChatGPT, Perplexit...

Aprende métodos efectivos para identificar, verificar y corregir información inexacta en respuestas generadas por IA como ChatGPT, Perplexity y otros sistemas d...

Consentimiento de Cookies

Usamos cookies para mejorar tu experiencia de navegación y analizar nuestro tráfico. See our privacy policy.