Detección de contenido por IA

Aprende qué es la detección de contenido por IA, cómo funcionan las herramientas de detección utilizando aprendizaje automático y PLN, y por qué son importantes...

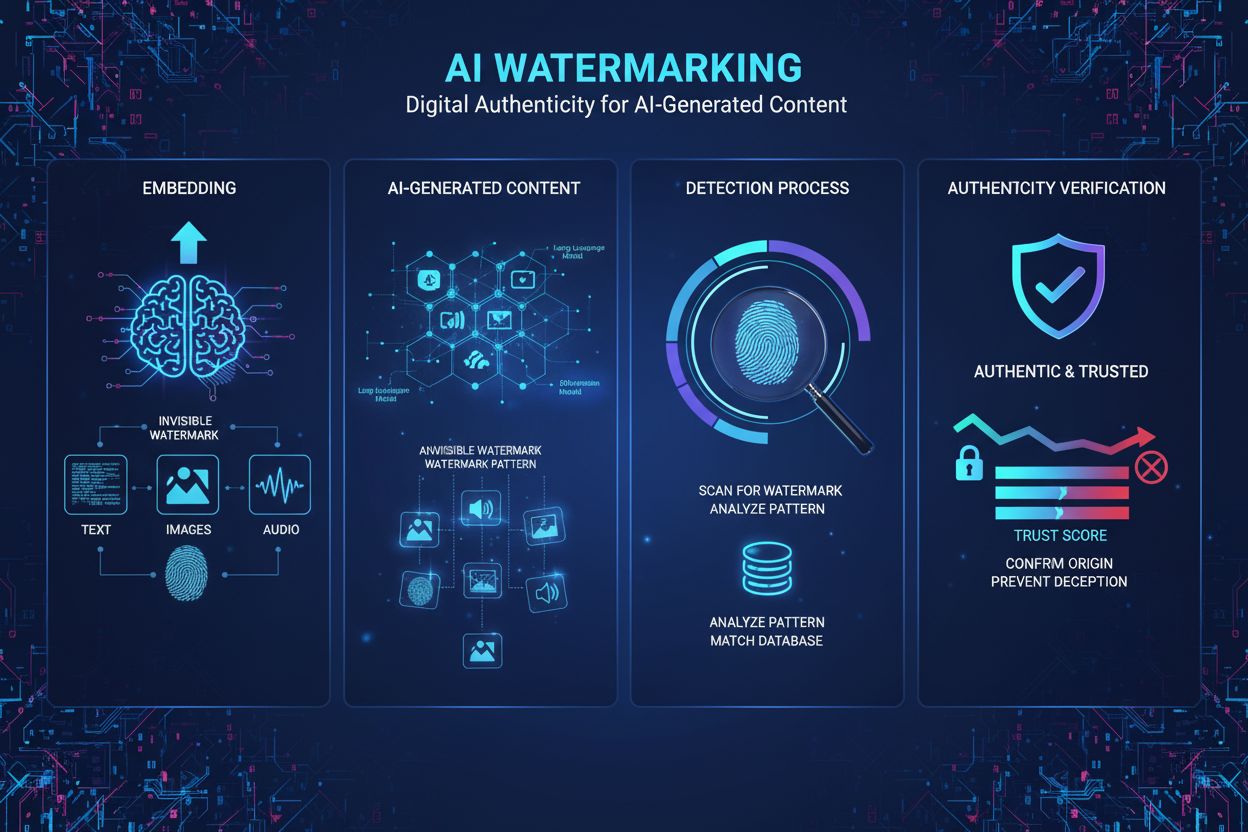

El marcado de contenido de IA es el proceso de incrustar marcas digitales invisibles o visibles en texto, imágenes, audio o video generados por IA para identificar y autenticar ese contenido como generado por máquina. Estas marcas actúan como huellas digitales que permiten la detección, verificación y seguimiento del material generado por IA a través de plataformas y aplicaciones.

El marcado de contenido de IA es el proceso de incrustar marcas digitales invisibles o visibles en texto, imágenes, audio o video generados por IA para identificar y autenticar ese contenido como generado por máquina. Estas marcas actúan como huellas digitales que permiten la detección, verificación y seguimiento del material generado por IA a través de plataformas y aplicaciones.

El marcado de contenido de IA se refiere al proceso de incrustar marcas, patrones o firmas digitales en material generado por IA para identificar, autenticar y rastrear su origen. Estas marcas funcionan como huellas digitales que distinguen el contenido generado por máquina del trabajo de autoría humana en formatos de texto, imágenes, audio y video. El propósito principal del marcado de contenido de IA es proporcionar transparencia sobre la procedencia del contenido mientras combate la desinformación, protege la propiedad intelectual y garantiza la responsabilidad en el panorama en rápida expansión de la inteligencia artificial generativa. A diferencia de las marcas tradicionales visibles en documentos físicos o imágenes, las modernas técnicas de marcado de IA suelen emplear patrones invisibles detectables solo mediante algoritmos especializados, preservando la calidad del contenido mientras mantienen capacidades sólidas de autenticación.

El concepto de marcado surgió en el mundo físico, donde marcas invisibles en billetes y documentos servían como medidas anticontrafacción. Con la proliferación de los medios digitales, los investigadores adaptaron técnicas de marcado para imágenes, audio y video durante las décadas de 1990 y 2000. Sin embargo, la aparición de sofisticados modelos generativos de IA como ChatGPT, DALL-E y Midjourney en 2022-2023 creó una necesidad urgente de métodos estandarizados de autenticación de contenido de IA. El rápido avance de las capacidades de IA que producen contenido sintético cada vez más realista impulsó a gobiernos, empresas tecnológicas y organizaciones de la sociedad civil a priorizar el marcado como salvaguarda crítica. Según investigaciones del Brookings Institution, más del 78% de las empresas reconocen la importancia de herramientas de monitoreo de contenido impulsadas por IA para gestionar los riesgos de medios sintéticos. La Ley de IA de la UE, adoptada formalmente en marzo de 2024, se convirtió en el primer marco regulatorio importante en exigir el marcado de contenido de IA, requiriendo que los proveedores de sistemas de IA marquen su salida como generada por IA. Este impulso regulatorio ha acelerado la investigación y el desarrollo en tecnologías de marcado, con empresas como Google DeepMind, OpenAI y Meta invirtiendo significativamente en soluciones de marcado robustas.

El marcado de IA opera a través de dos enfoques técnicos principales: marcado visible y marcado invisible. Los marcados visibles incluyen etiquetas, logotipos o indicadores de texto obvios agregados al contenido—como los cinco cuadros de colores que DALL-E coloca en imágenes generadas o el preámbulo de ChatGPT “como modelo de lenguaje entrenado por OpenAI”. Aunque son simples de implementar, los marcados visibles son trivialmente fáciles de eliminar mediante edición básica. El marcado invisible, en cambio, incrusta patrones sutiles imperceptibles para la percepción humana pero detectables por algoritmos especializados. Para imágenes generadas por IA, técnicas como los marcados de anillos de árbol desarrollados en la Universidad de Maryland incrustan patrones en el ruido aleatorio inicial antes del proceso de difusión, haciéndolos resistentes al recorte, rotación y filtrado. Para texto generado por IA, el marcado estadístico representa el enfoque más prometedor, donde el modelo de lenguaje favorece sutilmente ciertos tokens (“tokens verdes”) mientras evita otros (“tokens rojos”) según el contexto precedente. Esto crea una disposición estadísticamente inusual de palabras que los algoritmos de detección pueden identificar con alta confianza. El marcado de audio incrusta patrones imperceptibles en rangos de frecuencia fuera del oído humano (por debajo de 20 Hz o por encima de 20,000 Hz), similar al marcado de imágenes pero adaptado a propiedades acústicas. La tecnología SynthID de Google DeepMind ejemplifica el marcado moderno al entrenar conjuntamente modelos de generación y detección, asegurando robustez frente a transformaciones mientras se mantiene la calidad del contenido.

| Método de Marcado | Tipo de Contenido | Robustez | Impacto en la Calidad | Requiere Acceso al Modelo | Detectabilidad |

|---|---|---|---|---|---|

| Marcado Visible | Imágenes, Video | Muy Baja | Ninguno | No | Alta (Humana) |

| Marcado Estadístico | Texto, Imágenes | Alta | Mínima | Sí | Alta (Algorítmica) |

| Basado en Aprendizaje Automático | Imágenes, Audio | Alta | Mínima | Sí | Alta (Algorítmica) |

| Marcado de Anillos de Árbol | Imágenes | Muy Alta | Ninguno | Sí | Alta (Algorítmica) |

| Procedencia de Contenido (C2PA) | Todos los Medios | Media | Ninguno | No | Media (Metadatos) |

| Detección Post-Hoc | Todos los Medios | Baja | N/A | No | Baja (No fiable) |

El marcado estadístico representa la técnica más viable para autenticar texto generado por IA, abordando el desafío único de que el texto carece del espacio dimensional disponible en imágenes o audio para incrustar patrones. Durante el proceso de generación, un modelo de lenguaje recibe instrucciones para favorecer ciertos tokens según una clave criptográfica conocida solo por el desarrollador del modelo. La aleatoriedad del modelo se “carga” de acuerdo con este esquema, haciendo que seleccione preferentemente palabras o frases específicas mientras evita otras. Los protocolos de detección analizan el texto generado para calcular la probabilidad de observar los patrones de tokens detectados por mero azar; patrones estadísticamente improbables indican la presencia de una marca de agua. Investigaciones de la Universidad de Maryland y OpenAI han demostrado que este enfoque puede lograr alta precisión de detección sin sacrificar la calidad del texto. Sin embargo, el marcado estadístico para texto enfrenta limitaciones inherentes: las respuestas fácticas con poca flexibilidad de generación (como soluciones matemáticas o hechos históricos) son más difíciles de marcar eficazmente, y la reescritura exhaustiva o la traducción a diferentes idiomas puede degradar significativamente la confianza en la detección. La implementación SynthID Text, ya disponible en Hugging Face Transformers v4.46.0+, proporciona marcado de grado de producción utilizando parámetros configurables, incluidas claves criptográficas y longitud de n-gramas para equilibrar robustez y detectabilidad.

Las imágenes generadas por IA se benefician de enfoques de marcado más sofisticados debido al espacio de alta dimensión disponible para incrustar patrones. El marcado de anillos de árbol incrusta patrones ocultos en la imagen aleatoria inicial antes del proceso de difusión, creando marcas que sobreviven a transformaciones comunes como recortes, desenfoques y rotaciones sin degradar la calidad de la imagen. El marcado basado en aprendizaje automático de Meta y Google utiliza redes neuronales para incrustar y detectar marcas imperceptibles, logrando una precisión superior al 96% en imágenes no modificadas y resistiendo ataques a nivel de píxel. El marcado de audio emplea principios similares, incrustando patrones imperceptibles en rangos de frecuencia fuera de la percepción humana. AudioSeal, desarrollado por Meta, entrena conjuntamente modelos generadores y detectores para crear marcas robustas frente a transformaciones naturales de audio mientras mantiene una calidad indistinguible del original. La tecnología utiliza pérdida perceptual para asegurar que el audio marcado suene idéntico al original y emplea pérdida de localización para detectar marcas sin importar las perturbaciones. Estos enfoques demuestran que el marcado invisible puede lograr tanto robustez como preservación de la calidad cuando se implementa correctamente, aunque requieren acceso al modelo de IA subyacente para incrustar la marca.

El entorno regulatorio para el marcado de contenido de IA ha evolucionado rápidamente, con múltiples jurisdicciones implementando o proponiendo requisitos obligatorios de marcado. La Ley de IA de la UE, adoptada formalmente en marzo de 2024, representa el marco regulatorio más completo, exigiendo que los proveedores de sistemas de IA marquen su salida como contenido generado por IA. Esta regulación se aplica a todos los sistemas de IA generativa desplegados en la Unión Europea, estableciendo una obligación legal de cumplimiento de marcado. La Ley de Transparencia de IA de California (SB 942), vigente a partir del 1 de enero de 2026, exige que los proveedores de IA cubiertos pongan a disposición herramientas gratuitas y de acceso público de detección de contenido de IA, requiriendo en efecto mecanismos de marcado o autenticación equivalentes. La Ley de Autorización de la Defensa Nacional (NDAA) de EE. UU. para el año fiscal 2024 incluye disposiciones para una competencia de premios para evaluar la tecnología de marcado y dirige al Departamento de Defensa a estudiar e implementar “estándares técnicos abiertos de la industria” para incrustar información de procedencia en metadatos. La Orden Ejecutiva de la Casa Blanca sobre IA instruye al Departamento de Comercio a identificar y desarrollar estándares para etiquetar contenido generado por IA. Estas iniciativas regulatorias reflejan el creciente consenso de que el marcado de IA es esencial para la transparencia, la responsabilidad y la protección del consumidor. Sin embargo, los desafíos de implementación siguen siendo significativos, especialmente en lo que respecta a modelos de código abierto, coordinación internacional y la viabilidad técnica de estándares universales de marcado.

A pesar de los avances técnicos significativos, el marcado de IA enfrenta limitaciones sustanciales que restringen su efectividad práctica. La eliminación de marcas sigue siendo posible mediante varias técnicas de evasión: parafraseo de texto, recorte o filtrado de imágenes, traducción del contenido a otros idiomas o aplicación de perturbaciones adversarias. Investigaciones de la Universidad de Duke demostraron ataques de prueba de concepto contra detectores de marcas basados en aprendizaje automático, indicando que incluso los enfoques sofisticados son vulnerables a adversarios decididos. El problema de no universalidad representa otra limitación crítica: los detectores de marcas son específicos de cada modelo, por lo que los usuarios deben consultar el servicio de detección de cada empresa para verificar el origen del contenido. Sin un registro centralizado y protocolos estandarizados, verificar si un contenido es generado por IA se vuelve un proceso ineficiente y ad hoc. Las tasas de falsos positivos en la detección de marcas, especialmente para texto, siguen siendo problemáticas; los algoritmos pueden marcar incorrectamente contenido humano como generado por IA o no detectar contenido marcado tras modificaciones menores. La compatibilidad con modelos de código abierto presenta desafíos de gobernanza, ya que las marcas pueden deshabilitarse eliminando el código de los modelos descargados. La degradación de calidad se produce cuando los algoritmos de marcado restringen artificialmente la salida del modelo para incrustar patrones detectables, reduciendo potencialmente la calidad del contenido o limitando la flexibilidad de generación en tareas fácticas o de salida restringida. Las implicaciones de privacidad del marcado—especialmente si las marcas incluyen información de usuario—requieren consideración cuidadosa de políticas. Además, la confianza en la detección disminuye significativamente con la longitud del contenido; los textos cortos y el contenido muy modificado arrojan menor confianza, limitando la utilidad del marcado en ciertas aplicaciones.

El futuro del marcado de IA depende de la innovación técnica continua, la armonización regulatoria y el establecimiento de infraestructura confiable para la detección y verificación de marcas. Los investigadores exploran marcas detectables públicamente que mantengan robustez pese a la divulgación de los métodos de detección, posibilitando la verificación descentralizada sin requerir confianza en terceros. Los esfuerzos de estandarización a través de organizaciones como ICANN o consorcios industriales podrían establecer protocolos universales de marcado, reduciendo la fragmentación y permitiendo la detección eficiente entre plataformas. La integración con estándares de procedencia de contenido como C2PA puede crear enfoques de autenticación en capas combinando marcas y rastreo por metadatos. El desarrollo de marcas robustas ante traducción y parafraseo sigue siendo un área activa de investigación, con posibles aplicaciones en autenticación multilingüe. Sistemas de verificación basados en blockchain podrían proporcionar registros inmutables de detección de marcas y procedencia de contenido, aumentando la confianza en los resultados. A medida que las capacidades de IA generativa avanzan, las técnicas de marcado deberán evolucionar para mantener efectividad frente a intentos de evasión cada vez más sofisticados. El impulso regulatorio de la Ley de IA de la UE y la legislación de California probablemente impulsará la adopción global de estándares de marcado, creando incentivos de mercado para soluciones técnicas robustas. Sin embargo, las expectativas realistas reconocen que el marcado gestionará principalmente contenido de IA proveniente de modelos comerciales populares, permaneciendo limitado en escenarios de alto riesgo que requieren detección inmediata. La integración de plataformas de monitoreo de contenido de IA como AmICited con la infraestructura de marcado permitirá a las organizaciones rastrear la atribución de marca en sistemas de IA, asegurando el reconocimiento adecuado cuando sus dominios aparezcan en respuestas generadas por IA. Los desarrollos futuros probablemente enfatizarán la colaboración humano-IA en la autenticación de contenido, combinando la detección automatizada de marcas con la verificación humana para aplicaciones críticas en periodismo, procesos legales e integridad académica.

Las marcas de agua visibles son fácilmente detectables por humanos, como logotipos o etiquetas de texto agregadas a imágenes o clips de audio, pero son simples de eliminar o falsificar. Las marcas de agua invisibles incrustan patrones sutiles imperceptibles para la percepción humana pero detectables por algoritmos especializados, haciéndolas significativamente más robustas contra intentos de manipulación y eliminación. Las marcas de agua invisibles suelen preferirse para la autenticación de contenido de IA porque mantienen la calidad del contenido mientras proporcionan mayor seguridad contra la evasión.

El marcado estadístico para texto opera influyendo sutilmente en la selección de tokens del modelo de lenguaje durante la generación. El desarrollador del modelo 'carga los dados' usando un esquema criptográfico, haciendo que el modelo favorezca ciertos 'tokens verdes' mientras evita 'tokens rojos' según el contexto precedente. Los algoritmos de detección luego analizan el texto para identificar si los tokens favorecidos aparecen con una frecuencia estadísticamente inusual, lo que indica la presencia de una marca de agua. Este enfoque preserva la calidad del texto mientras incrusta una huella detectable.

Los principales desafíos incluyen la facilidad de eliminación de la marca de agua a través de ediciones o transformaciones menores, la falta de detección universal entre diferentes modelos de IA y la dificultad de marcar texto en comparación con imágenes o audio. Además, el marcado requiere la cooperación de los desarrolladores de modelos de IA, es incompatible con lanzamientos de modelos de código abierto y puede degradar la calidad del contenido si no se implementa cuidadosamente. Los falsos positivos y negativos en la detección también siguen siendo obstáculos técnicos significativos.

La Ley de IA de la UE, adoptada formalmente en marzo de 2024, requiere que los proveedores de sistemas de IA marquen su salida como contenido generado por IA. La Ley de Transparencia de IA de California (SB 942), vigente a partir del 1 de enero de 2026, exige que los proveedores de IA cubiertos pongan a disposición herramientas de detección de contenido gratuitas y de acceso público. La Ley de Autorización de la Defensa Nacional (NDAA) de EE. UU. para el año fiscal 2024 incluye disposiciones para la evaluación de la tecnología de marcado y el desarrollo de estándares industriales para la procedencia del contenido.

El marcado incrusta patrones identificativos directamente en el propio contenido generado por IA, creando una huella digital permanente que persiste incluso si el contenido se copia o modifica. La procedencia del contenido, como el estándar C2PA, almacena metadatos sobre el origen y el historial de modificaciones del contenido por separado en los metadatos del archivo. El marcado es más robusto contra la evasión pero requiere la cooperación del desarrollador del modelo, mientras que la procedencia es más fácil de implementar pero puede eliminarse al copiar el contenido sin los metadatos.

SynthID es la tecnología de Google DeepMind que marca e identifica contenido generado por IA al incrustar marcas digitales directamente en imágenes, audio, texto y video. Para texto, SynthID utiliza un procesador de logits que aumenta la canalización de generación del modelo para codificar información de marcado sin afectar significativamente la calidad. La tecnología emplea modelos de aprendizaje automático tanto para incrustar como para detectar marcas, haciéndola resistente a ataques comunes mientras mantiene la fidelidad del contenido.

Sí, actores motivados pueden eliminar o eludir las marcas de agua mediante diversas técnicas, incluyendo parafrasear texto, recortar o filtrar imágenes o traducir el contenido a diferentes idiomas. Sin embargo, eliminar marcas sofisticadas requiere experiencia técnica y conocimiento del esquema de marcado. Las marcas estadísticas son más robustas que los enfoques tradicionales, pero la investigación ha demostrado ataques de prueba de concepto incluso contra métodos avanzados, lo que indica que ninguna técnica de marcado es completamente infalible.

Comienza a rastrear cómo los chatbots de IA mencionan tu marca en ChatGPT, Perplexity y otras plataformas. Obtén información procesable para mejorar tu presencia en IA.

Aprende qué es la detección de contenido por IA, cómo funcionan las herramientas de detección utilizando aprendizaje automático y PLN, y por qué son importantes...

Aprende sobre los acuerdos de licenciamiento de contenido para IA que regulan cómo los sistemas de inteligencia artificial utilizan contenido protegido por dere...

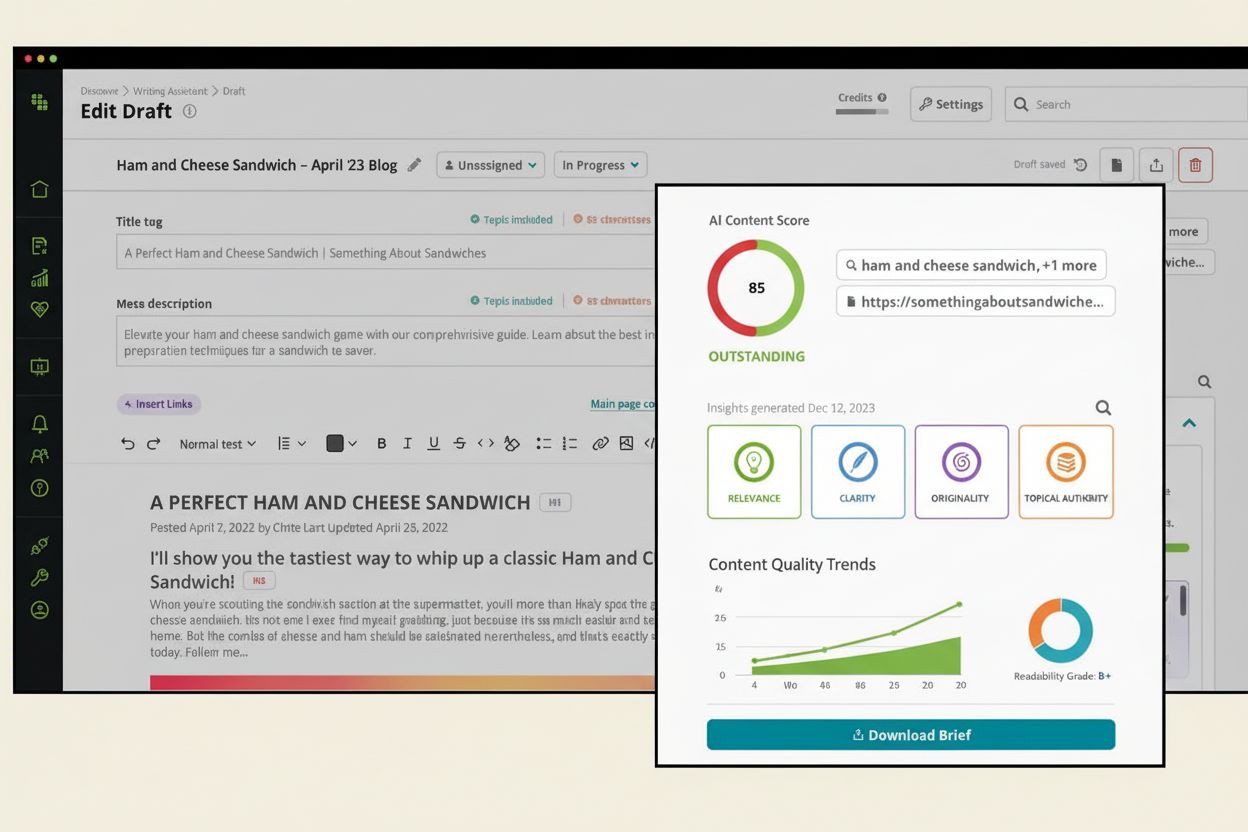

Descubre qué es un Puntaje de Contenido IA, cómo evalúa la calidad del contenido para sistemas de IA y por qué es relevante para la visibilidad en ChatGPT, Perp...

Consentimiento de Cookies

Usamos cookies para mejorar tu experiencia de navegación y analizar nuestro tráfico. See our privacy policy.