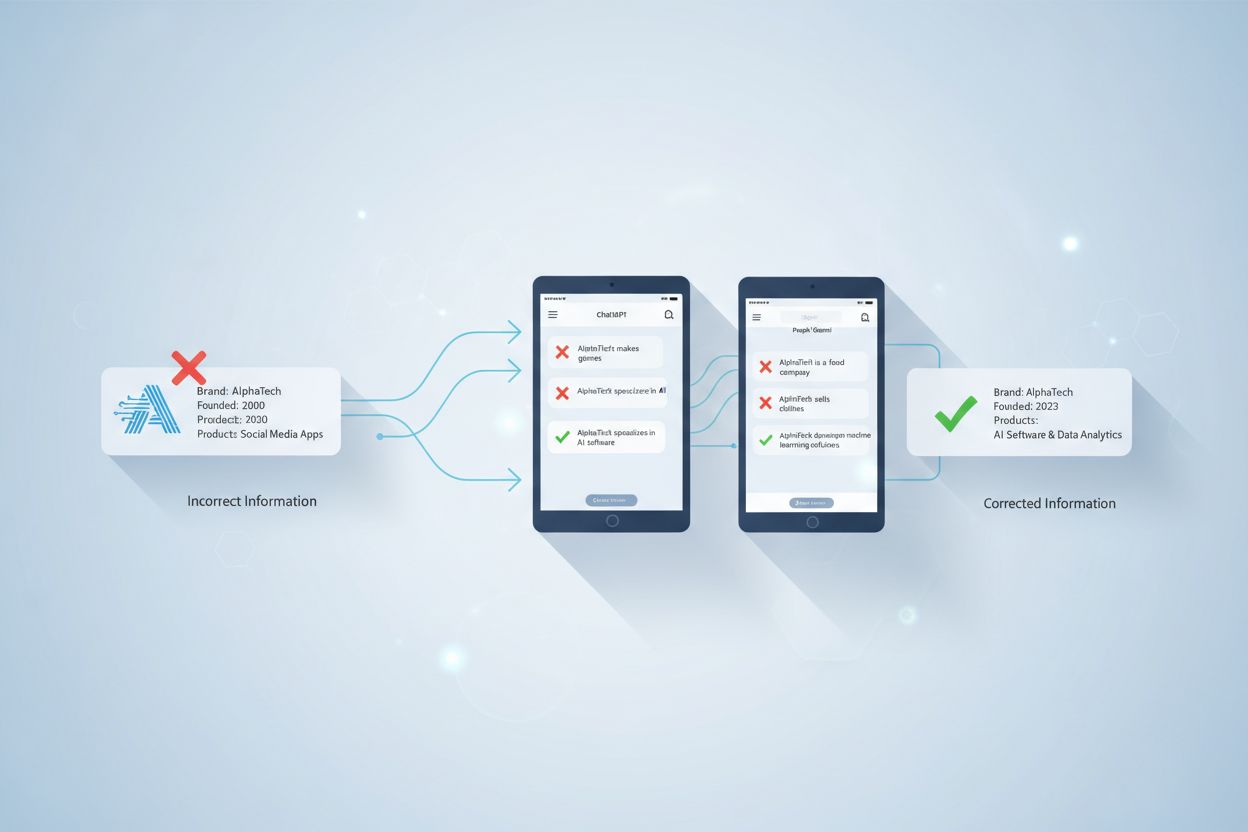

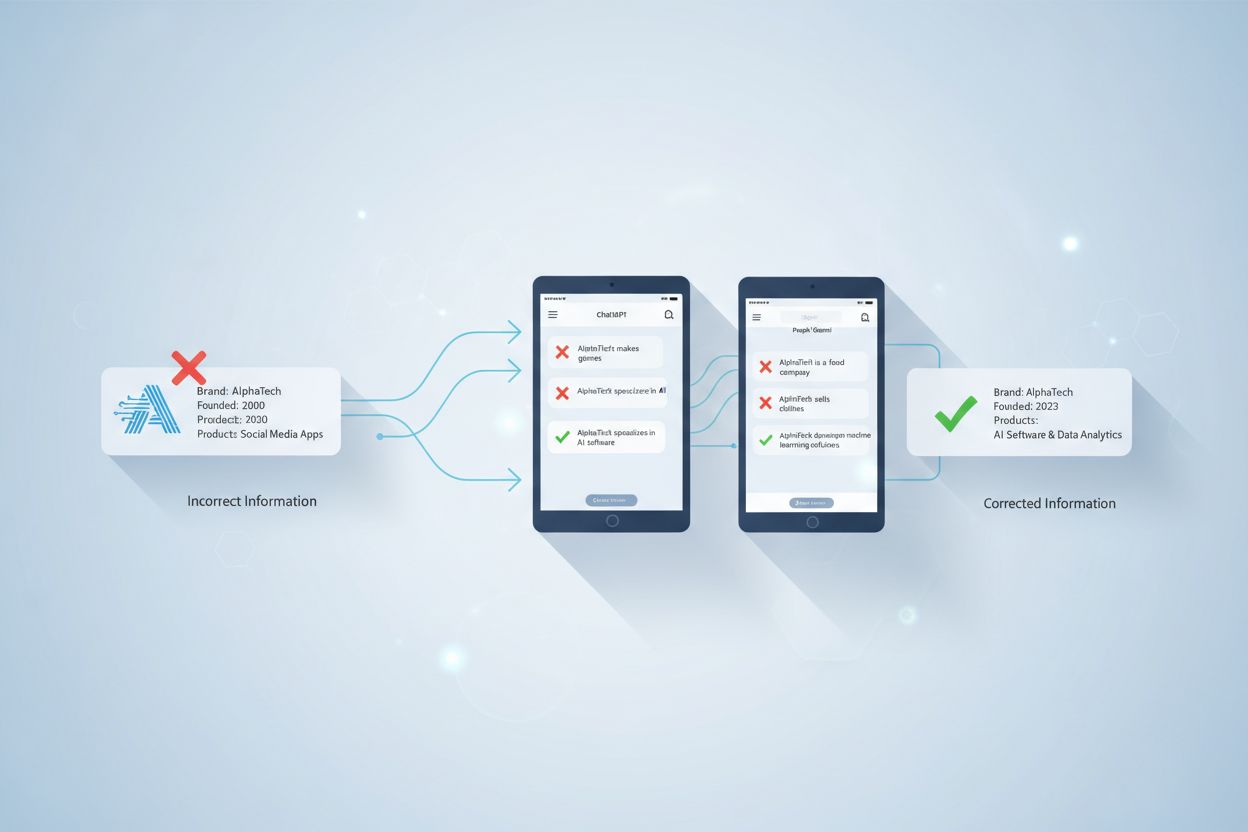

Correction de la désinformation par l'IA

Découvrez comment identifier et corriger les informations de marque incorrectes dans les systèmes d'IA tels que ChatGPT, Gemini et Perplexity. Découvrez des out...

Découvrez comment contester des informations inexactes produites par l’IA, signaler des erreurs à ChatGPT et Perplexity, et mettre en place des stratégies pour garantir une représentation fidèle de votre marque dans les réponses générées par l’IA.

Vous pouvez contester des informations inexactes produites par l’IA en les signalant directement sur la plateforme d’IA, en optimisant votre contenu pour les systèmes d’IA, en utilisant des outils de veille de marque et en mettant en place des données structurées pour garantir une représentation fidèle sur ChatGPT, Perplexity et autres moteurs de recherche IA.

Les informations inexactes dans les réponses de l’IA représentent un défi majeur pour les entreprises et les particuliers dans le paysage numérique actuel. Lorsque des systèmes d’IA comme ChatGPT, Perplexity et Gemini génèrent des informations erronées sur votre marque, vos produits ou vos services, cela peut nuire à votre réputation, induire en erreur des clients potentiels et entraîner la perte d’opportunités commerciales. Le problème est d’autant plus aigu que ces moteurs de recherche alimentés par l’IA transforment fondamentalement la manière dont les utilisateurs découvrent et évaluent l’information en ligne. Avec 60 % des recherches Google qui se terminent sans clic en 2024 et des taux de clics organiques en chute de plus de moitié lorsque des réponses IA apparaissent, garantir une représentation fidèle de votre marque dans les réponses IA est devenu essentiel pour maintenir un avantage concurrentiel.

Les systèmes d’IA génèrent des informations inexactes par plusieurs mécanismes. Ils reposent sur une double architecture composée de connaissances pré-entraînées et d’une augmentation par recherche en temps réel, ce qui signifie que des informations erronées peuvent s’y insérer de deux façons distinctes. D’abord, des informations obsolètes ou incorrectes issues des données d’entraînement peuvent persister dans les réponses du modèle. Ensuite, du contenu inexact provenant de sources web actuelles peut être récupéré et cité par le système IA. Le problème fondamental est que les modèles d’IA sont conçus pour générer la séquence de mots la plus probable pour répondre à une demande, sans vérifier si l’information est réellement correcte. Cela signifie que l’IA ne distingue pas entre informations exactes et inexactes – elle produit simplement ce qu’elle estime être la réponse la plus probable sur la base de ses données d’entraînement.

La plupart des grandes plateformes d’IA offrent des moyens aux utilisateurs de signaler des réponses inexactes ou problématiques. Perplexity, par exemple, permet aux utilisateurs de signaler des réponses incorrectes ou inexactes à l’aide de l’icône drapeau située sous la réponse. Les utilisateurs peuvent aussi créer un ticket via la fenêtre de support de Perplexity ou écrire directement à support@perplexity.ai avec les détails de l’inexactitude. Ce mécanisme de signalement aide la plateforme à identifier les schémas de désinformation et à améliorer la qualité de ses réponses au fil du temps. Lors du signalement, il est important d’être précis sur ce qui est incorrect, de fournir des preuves de l’information exacte et d’expliquer l’impact potentiel de l’erreur sur les utilisateurs ou votre entreprise.

ChatGPT et d’autres plateformes d’IA proposent également des systèmes de retour, bien que le processus exact varie selon la plateforme. Les utilisateurs peuvent généralement signaler les réponses problématiques ou inexactes via des boutons de retour intégrés. Cependant, il est important de comprendre que signaler des informations inexactes à chaque plateforme est une démarche réactive – elle traite des cas particuliers mais ne prévient pas leur réapparition. Le vrai défi est que les systèmes d’IA génèrent sans cesse de nouvelles réponses sur la base de leurs données d’entraînement et de recherches en temps réel, si bien qu’un signalement unique peut ne pas empêcher la même erreur de réapparaître lors de requêtes similaires.

La stratégie la plus efficace sur le long terme pour contester les informations inexactes générées par l’IA est d’optimiser votre contenu spécifiquement pour la consommation des systèmes d’IA. Cette approche, appelée Generative Engine Optimization (GEO), diffère fondamentalement du SEO traditionnel. Là où le SEO vise à améliorer le classement dans les résultats de recherche, le GEO garantit que les informations sur votre marque sont correctement citées et intégrées dans les réponses générées par l’IA. Cela implique de structurer et de formater votre contenu afin qu’il soit aisément compris, extrait et cité par les plateformes d’IA.

Le balisage de données structurées joue un rôle clé dans ce processus. En mettant en place un balisage schema approprié sur votre site web, vous fournissez aux systèmes d’IA des informations claires et lisibles par machine sur votre entreprise, vos produits et services. Cela facilite grandement l’accès à des informations exactes sur votre marque, au lieu que les IA s’appuient sur des données obsolètes ou erronées d’autres sources. De plus, une communication de marque claire et cohérente sur tous vos points de contact digitaux aide les IA à comprendre et à représenter fidèlement votre marque. Lorsque votre site internet, vos profils sociaux et autres propriétés en ligne présentent des informations cohérentes, les systèmes IA sont plus enclins à citer ces informations exactes dans leurs réponses.

| Stratégie | Mise en œuvre | Résultat attendu |

|---|---|---|

| Données structurées | Implémenter le balisage schema.org sur le site | Les IA accèdent à des données fiables et lisibles par machine |

| Optimisation du contenu | Créer un contenu clair, factuel et bien sourcé | Amélioration de la précision des citations dans les réponses IA |

| Cohérence de la marque | Maintenir un message cohérent sur toutes les plateformes | Réduction des confusions et des mauvaises interprétations |

| Mises à jour régulières | Actualiser le contenu en continu | Les IA privilégient l’information récente et autoritaire |

| Renforcement d’autorité | Développer des liens avec des publications sectorielles | Renforcement des signaux de crédibilité pour les IA |

Les outils de veille de marque IA offrent une visibilité essentielle sur la manière dont votre marque est représentée sur les différentes plateformes d’IA. Ces outils spécialisés surveillent en continu la façon dont les IA décrivent votre marque, identifient les incohérences et suivent l’évolution de votre image au fil du temps. En les utilisant, vous pouvez détecter rapidement les inexactitudes et mettre en œuvre des mesures correctives avant qu’elles n’endommagent votre réputation.

Les plateformes complètes de surveillance de marque IA offrent plusieurs fonctionnalités clés. Elles peuvent auditer la façon dont votre marque apparaît sur ChatGPT, Perplexity et d’autres moteurs de recherche IA, en fournissant des informations détaillées sur le sentiment associé, l’utilisation des mots-clés et le positionnement concurrentiel. Ces outils incluent souvent des indices de visibilité IA combinant mentions, citations, sentiment et classement pour donner une vue d’ensemble fiable de la visibilité de votre marque dans les systèmes IA. En surveillant régulièrement votre présence IA, vous pouvez repérer les schémas de désinformation, mesurer l’efficacité de vos correctifs et vérifier que les IA citent bien des informations exactes.

L’avantage d’utiliser ces outils spécialisés est de bénéficier d’un suivi continu et systématique, et non de simples contrôles ponctuels manuels. Cela permet de détecter rapidement les inexactitudes et d’y répondre avec du contenu correctif avant que la désinformation ne se propage. De plus, ces outils offrent souvent une veille concurrentielle, vous montrant comment votre marque est représentée par rapport à la concurrence et identifiant des opportunités d’amélioration.

Une fois que vous avez identifié des informations inexactes sur votre marque dans des réponses IA, le remède le plus efficace consiste à créer et diffuser du contenu correctif faisant autorité. Ce contenu doit s’adresser directement aux erreurs et fournir des informations claires et factuelles, facilement accessibles et citées par les systèmes d’IA. La clé du succès est de garantir que ce contenu correctif soit hautement autoritaire, bien sourcé et optimisé pour la compréhension par l’IA.

Un contenu correctif efficace suit plusieurs bonnes pratiques. D’abord, il doit contenir des affirmations claires et factuelles qui contredisent explicitement l’information erronée. Plutôt que de simplement énoncer ce qui est correct, le contenu doit expliquer pourquoi l’information précédente était inexacte et fournir des preuves à l’appui. Ensuite, le contenu doit utiliser une structuration claire avec des titres, des listes à puces et des sections organisées afin de faciliter l’analyse et la compréhension par les IA. Enfin, le contenu doit être mis à jour régulièrement pour refléter les informations les plus récentes concernant votre marque, signalant aux IA qu’il s’agit d’une source fiable et à jour digne d’être citée.

La stratégie de diffusion est aussi importante que la création du contenu. Votre contenu correctif doit être publié sur des plateformes à forte autorité où les IA sont susceptibles de le trouver et de le citer. Cela inclut votre site officiel, des publications sectorielles et des annuaires pertinents. En diffusant ce contenu sur plusieurs canaux, vous augmentez les chances que les IA accèdent à ces informations exactes plutôt que de s’appuyer sur des sources obsolètes ou erronées. De plus, amplifier ce contenu via les réseaux sociaux et les influenceurs du secteur peut accroître sa visibilité et ses signaux d’autorité, augmentant ainsi la probabilité d’être cité par les IA.

Les hallucinations IA représentent une forme particulièrement problématique d’informations inexactes, où les systèmes d’IA génèrent des faits, citations ou sources totalement inventés. Il ne s’agit pas de simples erreurs ou interprétations erronées – ce sont des cas où l’IA présente avec assurance des fausses informations comme si elles étaient vraies. Par exemple, une IA peut citer des études inexistantes, inventer de fausses statistiques ou attribuer de fausses citations à de vraies personnes. Ces hallucinations sont d’autant plus problématiques qu’elles sont souvent présentées avec une telle assurance que les utilisateurs ne remettent pas en question leur véracité.

La cause principale des hallucinations IA réside dans la façon dont ces systèmes sont entraînés et fonctionnent. Les modèles d’IA sont optimisés pour générer du texte plausible plutôt que de vérifier l’exactitude des faits. Lorsqu’un système IA fait face à une demande pour laquelle il n’a pas de données claires, il peut générer une réponse qui semble raisonnable selon ses schémas d’apprentissage, même si elle est totalement inventée. C’est pourquoi les IA génèrent souvent de fausses citations et sources – elles créent ce qu’elles estiment être des références plausibles sans réellement accéder à de vraies sources.

Pour lutter contre les hallucinations IA concernant votre marque, vous devez veiller à ce que des informations exactes et autoritaires soient largement disponibles et facilement accessibles pour les systèmes d’IA. Lorsque ces derniers ont accès à des données claires et fiables provenant de sources reconnues, ils sont moins enclins à inventer des informations alternatives. En outre, la surveillance régulière des réponses IA permet de détecter rapidement les hallucinations et de mettre en place des mesures correctives avant leur propagation.

Dans les cas où des informations erronées générées par l’IA causent un préjudice important à votre entreprise, une action en justice peut s’avérer nécessaire. Plusieurs affaires médiatisées ont établi la responsabilité potentielle des systèmes d’IA et de leurs exploitants en cas de diffusion d’informations inexactes. Par exemple, Air Canada a été reconnue responsable lorsque son chatbot IA a donné des informations incorrectes sur les tarifs de deuil, entraînant une décision du tribunal tenant la compagnie responsable de fausse déclaration par négligence. Ces cas montrent que les entreprises peuvent être tenues responsables des informations inexactes générées par leurs systèmes IA.

Au-delà de l’aspect juridique, faire appel à des consultants en stratégie de marque et à des experts SEO peut vous aider à élaborer des stratégies globales pour lutter contre la mauvaise représentation. Ces professionnels peuvent identifier les causes des inexactitudes, définir des stratégies de contenu correctif et mettre en place des processus systématiques pour améliorer la représentation de votre marque dans les IA. Il est également important de travailler avec votre service juridique pour comprendre vos droits et les recours possibles, en particulier si l’erreur cause un préjudice mesurable à votre activité.

Pour des problématiques complexes ou une mauvaise représentation généralisée, le recours à des experts spécialisés est souvent indispensable. Les spécialistes du Generative Engine Optimization et de la gestion de marque IA peuvent vous aider à naviguer dans la complexité de la correction d’informations inexactes sur plusieurs plateformes IA. Ils peuvent aussi vous accompagner dans la mise en œuvre de processus de veille et de correction systématiques pour prévenir de futures erreurs.

Contester efficacement des informations inexactes générées par l’IA nécessite une mesure systématique et un suivi de vos actions. En définissant des indicateurs précis et en surveillant leur évolution, vous pouvez déterminer l’efficacité de vos stratégies correctives et ajuster votre approche au besoin. Les indicateurs clés de performance doivent inclure l’amélioration de l’exactitude, le gain de visibilité et l’évolution du positionnement concurrentiel.

Les entreprises qui déploient des stratégies de correction systématique constatent généralement une réduction de 80 à 95 % des erreurs factuelles en moins de 30 jours, ainsi qu’une amélioration sensible de la visibilité et du positionnement de leur marque. Ces améliorations se mesurent par des tests réguliers des réponses IA aux requêtes liées à la marque, le suivi de l’évolution des descriptions IA de votre marque, et l’analyse des tendances de sentiment et de citations. En établissant des mesures de référence avant d’appliquer vos correctifs, vous pouvez démontrer clairement l’impact de vos actions.

En outre, le suivi des indicateurs d’impact business tels que la qualité des leads, les demandes de clients et les taux de conversion permet de comprendre les conséquences réelles des informations inexactes générées par l’IA et la valeur de vos actions correctives. Lorsque vous pouvez démontrer que la correction de ces erreurs améliore vos résultats commerciaux, il devient plus facile de justifier l’investissement dans une surveillance et une optimisation continues.

Reprenez le contrôle de l’apparence de votre marque dans les réponses générées par l’IA. Suivez les mentions, le sentiment et la visibilité sur ChatGPT, Perplexity et d’autres plateformes d’IA.

Découvrez comment identifier et corriger les informations de marque incorrectes dans les systèmes d'IA tels que ChatGPT, Gemini et Perplexity. Découvrez des out...

Découvrez des stratégies efficaces pour identifier, surveiller et corriger les informations inexactes concernant votre marque dans les réponses générées par l'I...

Découvrez comment identifier, prévenir et corriger la désinformation générée par l’IA à propos de votre marque. Découvrez 7 stratégies et outils éprouvés pour p...