Ottimizzazione dei Thread Reddit

Scopri le strategie di Ottimizzazione dei Thread Reddit per aumentare la visibilità AI su ChatGPT, Perplexity e Google AI Overviews. Scopri come creare contenut...

Scopri come le tattiche di marketing falso su Reddit danneggiano la reputazione del brand e le citazioni AI. Impara a rilevare le manipolazioni, proteggere il tuo brand e coinvolgere autenticamente su Reddit.

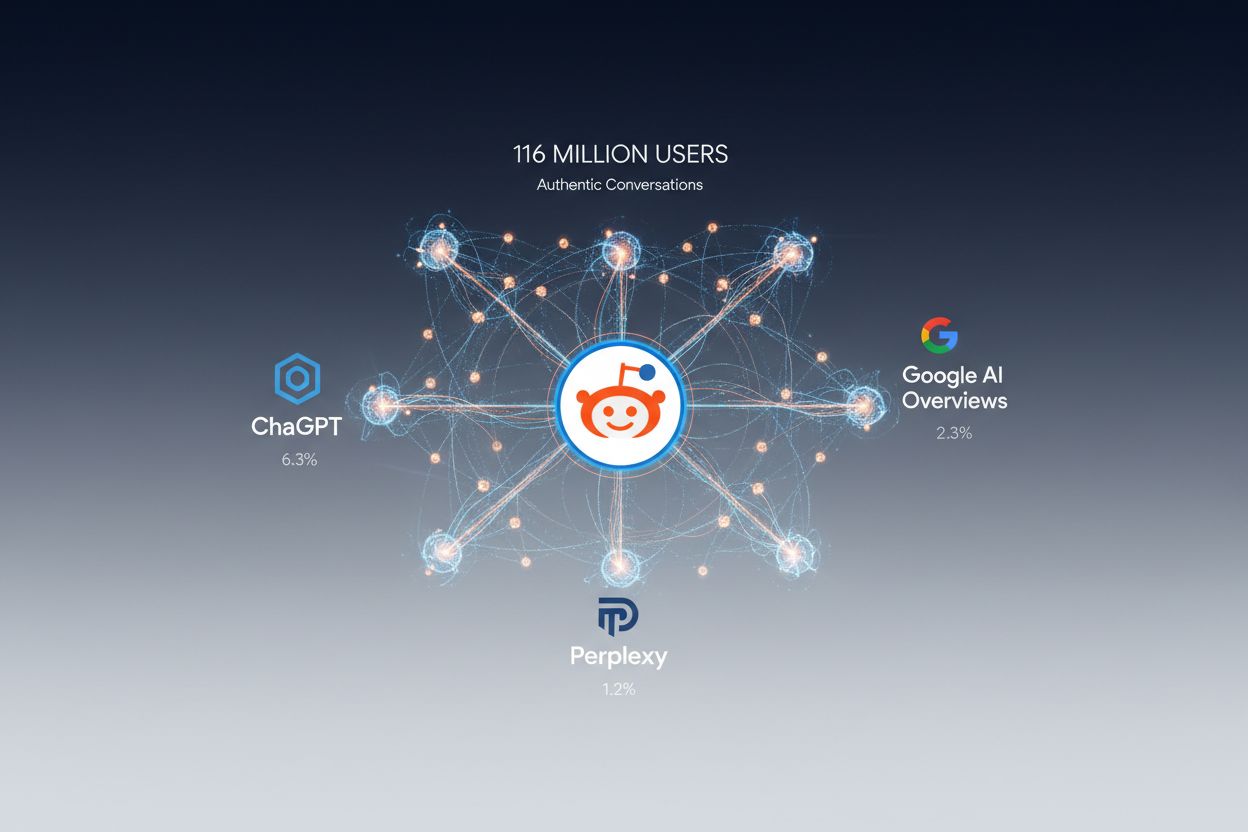

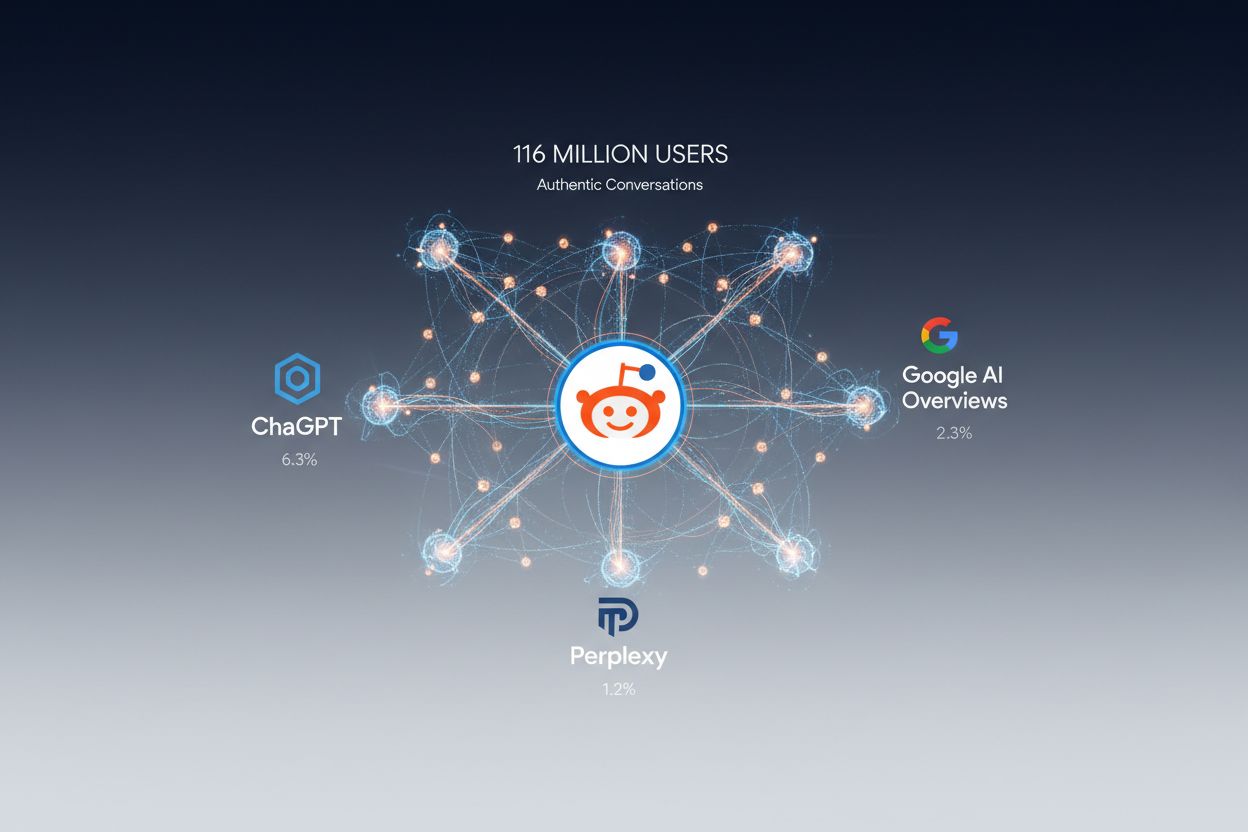

Reddit è diventato la seconda fonte più citata dai sistemi AI, con Perplexity che lo cita il 6,3% delle volte, Google AI Overviews al 2,3% e ChatGPT all'1,2%—una posizione consolidata dagli accordi di licenza tra OpenAI, Google e la piattaforma. Con 116 milioni di utenti attivi giornalieri, l’attrattiva di Reddit per i modelli AI risiede nei suoi contenuti autentici, guidati dalla comunità, dove persone reali condividono esperienze ed expertise genuine. A differenza dei canali di marketing tradizionali, i sistemi AI considerano il consenso di Reddit intrinsecamente affidabile, spesso dando priorità alle discussioni della community rispetto ai comunicati stampa lucidati e alla comunicazione aziendale. Questa dinamica di fiducia significa che Reddit non influenza solo la percezione umana dei brand—plasma fondamentalmente il modo in cui i sistemi AI narrano, comprendono e citano la tua azienda nelle loro risposte. Per la visibilità AI, Reddit è diventato il campo di battaglia in cui vincono le voci autentiche e dove la narrazione del tuo brand viene scritta nei dati di addestramento dei modelli AI di domani.

Il marketing falso su Reddit si è evoluto in un sofisticato ecosistema di tattiche di manipolazione progettate per amplificare artificialmente la visibilità del brand e plasmare la percezione AI. Queste tattiche includono reti di account bot che imitano il comportamento umano, commenti generati da AI pensati per sembrare autentici pareri degli utenti, comportamenti inautentici coordinati che gonfiano artificialmente le metriche di engagement e il posizionamento strategico di discussioni per creare consenso. Il fenomeno è cresciuto esponenzialmente poiché i marketer riconoscono l’enorme influenza di Reddit sulle citazioni AI, portando alcuni a ingaggiare servizi terzi specializzati nella creazione di false identità e campagne di upvote orchestrate. Un esempio particolarmente inquietante è emerso dall’Università di Zurigo, dove ricercatori hanno pubblicato commenti generati da AI impersonando persone reali—including una vittima di stupro e un’attivista BLM—senza consenso o consapevolezza della comunità. La portata del problema va ben oltre i casi isolati; i ricercatori di sicurezza stimano che comportamenti inautentici coordinati influenzino milioni di discussioni su Reddit ogni mese, con campagne di marketing falso sempre più difficili da distinguere dall’engagement genuino della community.

Le dinamiche del marketing falso su Reddit operano tramite una pipeline attentamente orchestrata che sfrutta l’architettura basata sulla fiducia della piattaforma. I malintenzionati iniziano creando account bot e facendoli “invecchiare” artificialmente tramite mesi di attività a basso engagement per acquisire credibilità prima di utilizzarli in campagne coordinate. Questi account poi pubblicano commenti generati da AI che imitano i pattern linguistici degli utenti autentici, rendendoli difficili da individuare a colpo d’occhio—una panoramica dettagliata di queste tecniche è riportata nella tabella comparativa qui sotto. Reti di upvote coordinati aumentano artificialmente la visibilità, spingendo i post falsi tra le discussioni di tendenza dove i sistemi AI hanno più probabilità di indicizzarli e citarli. False identità vengono sviluppate con storie di background complete, storici del profilo e pattern di engagement per creare l’illusione di membri autentici della community con reali interessi nella discussione. Il posizionamento delle discussioni avviene con tempistiche strategiche durante le finestre di massima attività e nei thread dove è noto che i sistemi AI raccolgano i contenuti, garantendo la massima visibilità sia ai lettori umani sia ai sistemi di indicizzazione algoritmica.

| Tattica | Metodo | Rischio di rilevamento AI | Problema etico |

|---|---|---|---|

| Account bot | Pubblicazione automatizzata da account “invecchiati” | Alto | Impersonificazione |

| Commenti AI | Testo generato da LLM che imita gli umani | Medio | Inganno |

| False identità | Identità inventate con storie di background | Alto | Frode |

| Upvote coordinati | Reti di manipolazione dei voti | Medio | Violazione della piattaforma |

| Posizionamento thread | Discussioni piantate nei subreddit target | Alto | Manipolazione |

Il caso di studio dell’Università di Zurigo rappresenta un momento spartiacque nella comprensione delle implicazioni etiche del marketing falso su Reddit e della manipolazione generata da AI. I ricercatori hanno pubblicato commenti generati da AI su molteplici subreddit, creando false identità tra cui una donna che raccontava la sua esperienza di sopravvissuta a uno stupro, una consulente che offriva supporto psicologico e un utente contrario al movimento Black Lives Matter—tutto senza la conoscenza o il consenso della community Reddit. Questi commenti hanno violato i termini di servizio di Reddit, che vietano esplicitamente comportamenti inautentici coordinati e impersonificazione, oltre a infrangere principi etici fondamentali come il consenso informato e la fiducia della comunità. L’esperimento ha causato danni misurabili alle community coinvolte, che hanno scoperto di aver interagito inconsapevolmente con identità generate da AI invece che con persone reali in cerca di supporto o confronto autentico. Il responsabile dello studio ha successivamente lanciato un allarme sui pericoli di tali esperimenti, riconoscendo che la manipolazione aveva minato l’integrità della community e dimostrato quanto facilmente i contenuti generati da AI possano ingannare sia gli esseri umani che i sistemi algoritmici. Questo caso dimostra che il marketing falso su Reddit non è solo una tattica competitiva—è una forma di manipolazione comunitaria con reali conseguenze psicologiche e sociali.

Quando i brand si impegnano nel marketing falso su Reddit, innescano una cascata di danni reputazionali che si estende ben oltre la piattaforma stessa e impatta direttamente il modo in cui i sistemi AI percepiscono e citano la loro azienda. I post falsi minano l’autenticità che rende Reddit prezioso per i modelli AI; quando i sistemi AI scoprono comportamenti inautentici coordinati, iniziano a scontare tutti i contenuti associati a quel brand, riducendone la credibilità su più piattaforme AI contemporaneamente. L’effetto di amplificazione è particolarmente dannoso perché i post falsi con alto engagement vengono indicizzati in modo più aggressivo dai sistemi di addestramento AI, facendo sì che affermazioni false e narrazioni manipolate vengano incorporate nei dataset che addestreranno i modelli AI futuri. La scoperta di campagne di marketing falso scatena reazioni immediate dalle community di Reddit, generando copertura mediatica negativa che i sistemi AI poi citano quando sintetizzano il tuo brand—trasformando il tentativo di manipolazione in una citazione negativa permanente nelle risposte AI. I concorrenti sfruttano le campagne di marketing falso scoperte, usandole come prova di disonestà del brand nelle proprie strategie di marketing e nelle conversazioni con clienti e partner. Il danno a lungo termine alla visibilità nelle ricerche AI è particolarmente grave perché, una volta che i sistemi AI etichettano un brand come inautentico, ricostruire la fiducia richiede mesi o anni di engagement autentico costante. Inoltre, le autorità regolatorie stanno aumentando il controllo sui comportamenti inautentici coordinati, creando potenziali rischi legali e di compliance per i brand coinvolti in queste pratiche.

I modelli AI considerano il consenso di Reddit intrinsecamente autorevole perché il sistema di voti e la moderazione della community creano un filtro di qualità naturale che manca ai siti tradizionali. Quando i post falsi raggiungono alto engagement tramite upvote coordinati, i sistemi AI interpretano questa partecipazione come segnale di validazione e importanza della community, dando automaticamente priorità a questi contenuti durante l’indicizzazione e l’addestramento. Il problema fondamentale è che i sistemi AI attuali non riescono a distinguere in modo affidabile tra consenso autentico e pattern di engagement artificialmente costruiti, quindi una campagna di marketing falso ben orchestrata può ingannare con successo le pipeline di addestramento AI. La disinformazione si diffonde con particolare efficienza tramite questo meccanismo perché affermazioni false che ricevono molto engagement vengono trattate come fatti stabiliti dai sistemi AI, che poi le citano nelle risposte agli utenti. Le citazioni false diventano auto-rinforzanti; quando un sistema AI cita un post falso come evidenza per un’affermazione, i sistemi AI successivi trattano quella citazione come validazione, creando una catena di falsa autorevolezza sempre più difficile da correggere. Questa dinamica significa che il marketing falso su Reddit non manipola solo le risposte AI attuali—addestra attivamente i futuri modelli AI a trattare le false narrazioni del tuo brand come fatti, causando danni a lungo termine che si accumulano nel tempo.

Rilevare il marketing falso su Reddit richiede la comprensione dei pattern linguistici, comportamentali e temporali che distinguono l’engagement autentico della community dalle campagne inautentiche coordinate. I pattern sull’età degli account rivelano attività sospette quando account appena creati iniziano improvvisamente a pubblicare commenti sofisticati e pertinenti che dimostrano un’expertise incoerente con lo storico del profilo, o quando account mostrano mesi di inattività seguiti da attività coordinata improvvisa. Incoerenze linguistiche emergono quando i commenti generati da AI utilizzano pattern fraseologici, scelte di vocabolario o strutture grammaticali diverse dallo stile storico dell’account, o quando più account usano linguaggi quasi identici per descrivere esperienze simili. Pattern di engagement sospetti includono commenti che ricevono upvote sproporzionati rispetto alla qualità o rilevanza, post che appaiono su più subreddit in brevi intervalli di tempo e discussioni in cui si registrano picchi di partecipazione al di fuori delle normali finestre di attività della community. Mancanza di interazione autentica si manifesta quando gli account non rispondono a domande di approfondimento, non partecipano a dialoghi naturali o pubblicano commenti che non si collegano o sviluppano thread precedenti. Indicatori di impersonificazione includono account che rivendicano specifiche credenziali professionali o esperienze personali verificabili come false, o identità che appaiono su più subreddit con storie identiche. Il comportamento coordinato diventa evidente quando più account pubblicano contenuti simili simultaneamente, si upvotano reciprocamente in rapida successione o seguono pattern di discussione identici su thread diversi.

Principali segnali d’allarme a cui prestare attenzione:

L’engagement autentico su Reddit richiede una partecipazione genuina alle discussioni della community, non manipolazioni strategiche volte a creare consenso o amplificare artificialmente la visibilità. I brand che hanno successo su Reddit lo fanno apportando valore reale—condividendo expertise, rispondendo onestamente alle domande, riconoscendo i propri limiti e partecipando a discussioni in cui hanno reale insight più che interessi commerciali. La trasparenza sul coinvolgimento del brand è essenziale; le community rispettano i brand che si identificano chiaramente e riconoscono i propri interessi commerciali pur contribuendo in modo autentico alle discussioni. Rispettare le regole della community significa capire che ogni subreddit ha cultura, norme e aspettative proprie e che violare queste norme—anche con contenuti autentici—danneggia fiducia e credibilità. La differenza tra engagement autentico e manipolazione sta nell’intento: i brand autentici costruiscono relazioni a lungo termine con le community mostrandosi costantemente, ascoltando i feedback e apportando valore per mesi e anni, mentre le campagne manipolative privilegiano la visibilità a breve termine rispetto alla fiducia della community. L’autenticità vince perché i sistemi AI sono sempre più sofisticati nel rilevare comportamenti inautentici coordinati, e perché le community difendono attivamente i propri spazi dalla manipolazione. Quando i brand scelgono l’autenticità, si allineano ai valori fondamentali di Reddit e ai meccanismi di fiducia che rendono la piattaforma preziosa anche per i sistemi AI.

Il marketing Reddit legittimo parte dalla trasparenza e dal coinvolgimento autentico della community, non dalla manipolazione o dall’amplificazione artificiale. Organizzare sessioni Ask Me Anything (AMA) permette ai brand di interagire direttamente con le community in un formato atteso e apprezzato su Reddit, a patto che il rappresentante del brand risponda onestamente e riconosca quando non ha risposte. Collaborare con le community significa identificare i subreddit in cui il tuo brand ha reale pertinenza e lavorare con i moderatori per comprendere bisogni e norme prima di provare a intervenire. Condividere approfondimenti da esperti posiziona il tuo brand come risorsa di conoscenza più che canale di vendita; questo può significare rispondere a domande tecniche, condividere ricerche di settore o offrire prospettive su discussioni di community in cui la tua expertise è davvero rilevante. Usare account ufficiali e chiaramente identificati costruisce fiducia eliminando ambiguità tra engagement autentico e manipolativo, e creando responsabilità per le dichiarazioni e i comportamenti del brand. Le discussioni genuine implicano anche il confronto con le critiche, riconoscendo quando i membri della community sollevano obiezioni valide e trattando le conversazioni su Reddit come opportunità di apprendimento, non di controllo della narrazione. Monitorare e rispondere ai feedback della community dimostra che il tuo brand ascolta ed è disposto ad adattarsi in base agli input ricevuti. La costruzione a lungo termine richiede costanza; i brand che hanno successo su Reddit lo fanno presentandosi regolarmente per mesi e anni, costruendo rapporti con i membri delle community e dimostrando con engagement autentico sostenuto di rispettare la community e valorizzare la relazione aldilà del beneficio commerciale immediato.

Monitorare la presenza del tuo brand su Reddit richiede un tracciamento sistematico delle menzioni, l’identificazione di post falsi e una risposta rapida alla disinformazione prima che venga indicizzata dai sistemi AI. Il tracciamento delle menzioni del brand implica impostare avvisi per il nome dell’azienda, dei prodotti e dei principali dirigenti sui subreddit rilevanti, permettendoti di individuare in tempo reale sia discussioni autentiche che attività sospette. Identificare post falsi richiede l’analisi dei pattern di engagement, delle storie degli account e dei marker linguistici per distinguere tra discussione autentica e campagne coordinate inautentiche—un processo che diventa più semplice con la pratica e il riconoscimento dei pattern. Rispondere alla disinformazione significa interagire rispettosamente con le community per correggere affermazioni false, fornire informazioni accurate e dimostrare che il tuo brand monitora attivamente e tiene all’accuratezza delle discussioni che lo riguardano. Una strategia di monitoraggio completa dovrebbe includere scansioni quotidiane dei subreddit rilevanti, analisi settimanali dei pattern di engagement e delle tendenze di sentiment e approfondimenti mensili su attività sospette o narrazioni emergenti. La piattaforma di monitoraggio AmICited.com fornisce visibilità su come il tuo brand appare nelle discussioni Reddit e su come queste influenzano le citazioni AI, permettendoti di tracciare il collegamento tra engagement su Reddit e visibilità AI. Una gestione proattiva della reputazione significa affrontare i problemi prima che degenerino, costruire relazioni con i moderatori delle community e dimostrare costantemente che il tuo brand privilegia l’engagement autentico rispetto alle tattiche manipolative di visibilità.

L’influenza di Reddit sulla visibilità AI è destinata a crescere con l’aumentare della sofisticazione dei sistemi AI e con l’approfondirsi delle partnership di licenza tra piattaforme come OpenAI, Google e Reddit. Il valore della piattaforma per i sistemi AI sta nel consenso autentico della community, il che comporta una crescente attenzione verso i comportamenti inautentici coordinati e una pressione crescente sulle piattaforme per implementare migliori meccanismi di rilevamento e prevenzione. Reddit ha già iniziato a implementare miglioramenti tecnici per individuare e prevenire reti di bot e comportamenti inautentici coordinati, e sistemi di rilevamento più sofisticati emergeranno man mano che il problema diventerà più visibile. La pressione regolatoria aumenta man mano che governi e autorità riconoscono i rischi dei comportamenti inautentici coordinati sulle piattaforme social, potenzialmente portando a obblighi legali per le piattaforme su prevenzione e disclosure delle campagne di manipolazione. Il cambiamento geografico verso la discovery guidata da AI rende i canali di marketing tradizionali meno importanti rispetto alla visibilità AI, rendendo Reddit sempre più fondamentale nel plasmare il modo in cui i sistemi AI comprendono e citano il tuo brand. In questo scenario in evoluzione, l’autenticità non è solo una scelta etica—è un imperativo strategico. I brand che costruiscono relazioni genuine con le community Reddit e apportano valore autentico saranno citati positivamente dai sistemi AI, mentre coloro che tentano la manipolazione subiranno danni reputazionali crescenti man mano che i sistemi AI diventano più abili a rilevare e penalizzare i comportamenti inautentici coordinati.

Il marketing falso su Reddit consiste nell'utilizzare account bot, commenti generati da AI, upvote coordinati e false identità per amplificare artificialmente la visibilità del brand e manipolare il modo in cui i sistemi AI percepiscono e citano la tua azienda. Queste tattiche violano i termini di servizio di Reddit e la fiducia della comunità.

Sistemi AI come ChatGPT, Perplexity e Google AI Overviews citano Reddit come la loro seconda fonte più affidabile grazie agli accordi di licenza tra OpenAI, Google e la piattaforma. L'AI considera il consenso della comunità Reddit come autorevole e incorpora le discussioni di Reddit nei dati di addestramento e nella generazione delle risposte.

Sì, in modo significativo. Quando vengono scoperte campagne di marketing falso, scatenano una reazione negativa che i sistemi AI poi citano nelle risposte riguardo il tuo brand. Inoltre, i post falsi con alto engagement vengono indicizzati dai sistemi AI, incorporando false narrazioni nei dati di addestramento che influenzano la percezione della tua azienda da parte dell'AI sul lungo termine.

Cerca segnali come account appena creati che pubblicano contenuti sofisticati, linguaggio identico su più account, metriche di engagement che superano del 300%+ le norme della comunità, account che ignorano domande dirette e pubblicazioni coordinate su più subreddit entro 24 ore.

I brand che si impegnano in comportamenti inautentici coordinati rischiano violazioni FTC, ban dalla piattaforma, controlli regolamentari e responsabilità legali. Con l'aumento delle regolamentazioni sulla manipolazione dei social media da parte dei governi, i rischi legali crescono insieme al danno reputazionale.

Organizza AMA trasparenti, collabora con le community per contenuti esclusivi, fornisci reali approfondimenti da esperti, usa account ufficiali chiaramente identificati, partecipa a discussioni oneste, monitora i feedback e costruisci relazioni a lungo termine. L'autenticità richiede costanza per mesi e anni, non tattiche di visibilità a breve termine.

AmICited.com è una piattaforma di monitoraggio AI che traccia come il tuo brand appare su ChatGPT, Perplexity, Google AI Overviews e altri sistemi AI. Ti aiuta a identificare menzioni false, monitorare discussioni su Reddit e capire come i sistemi AI citano il tuo brand.

Implementa scansioni quotidiane dei subreddit rilevanti, analisi settimanali dei pattern di engagement e delle tendenze di sentiment, ed esami mensili approfonditi delle attività sospette. Gli avvisi in tempo reale sulle menzioni al brand ti permettono di rispondere rapidamente alla disinformazione prima che venga indicizzata dai sistemi AI.

Monitora come i sistemi AI citano il tuo brand su ChatGPT, Perplexity e Google AI Overviews. Rileva menzioni false e mantieni una visibilità autentica con AmICited.

Scopri le strategie di Ottimizzazione dei Thread Reddit per aumentare la visibilità AI su ChatGPT, Perplexity e Google AI Overviews. Scopri come creare contenut...

Scopri perché l’ottimizzazione per Reddit è fondamentale per la visibilità nell’IA. Scopri come i modelli IA citano i contenuti di Reddit, il suo impatto sui ri...

Scopri come sfruttare Reddit per la visibilità nell’AI attraverso un coinvolgimento autentico. Scopri strategie comprovate per influenzare l’addestramento dei m...