Algoritmo Sonar

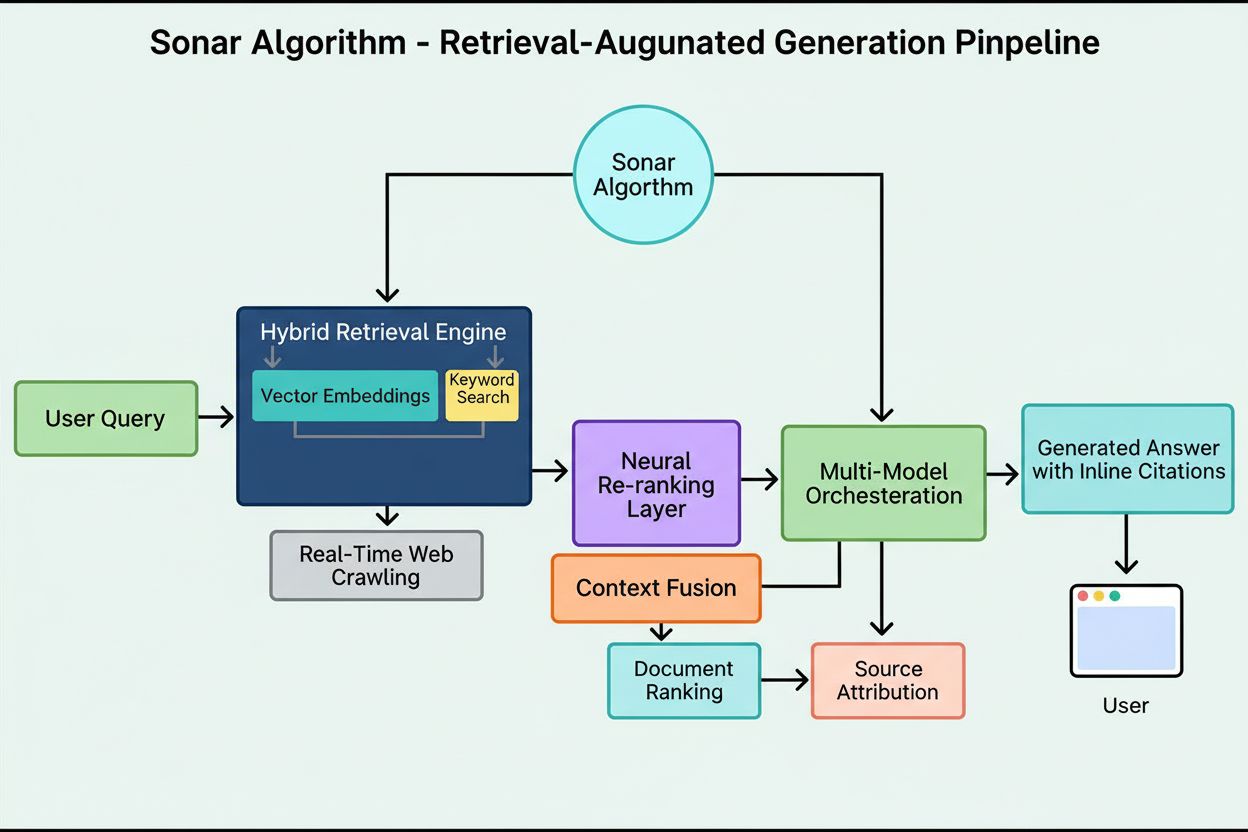

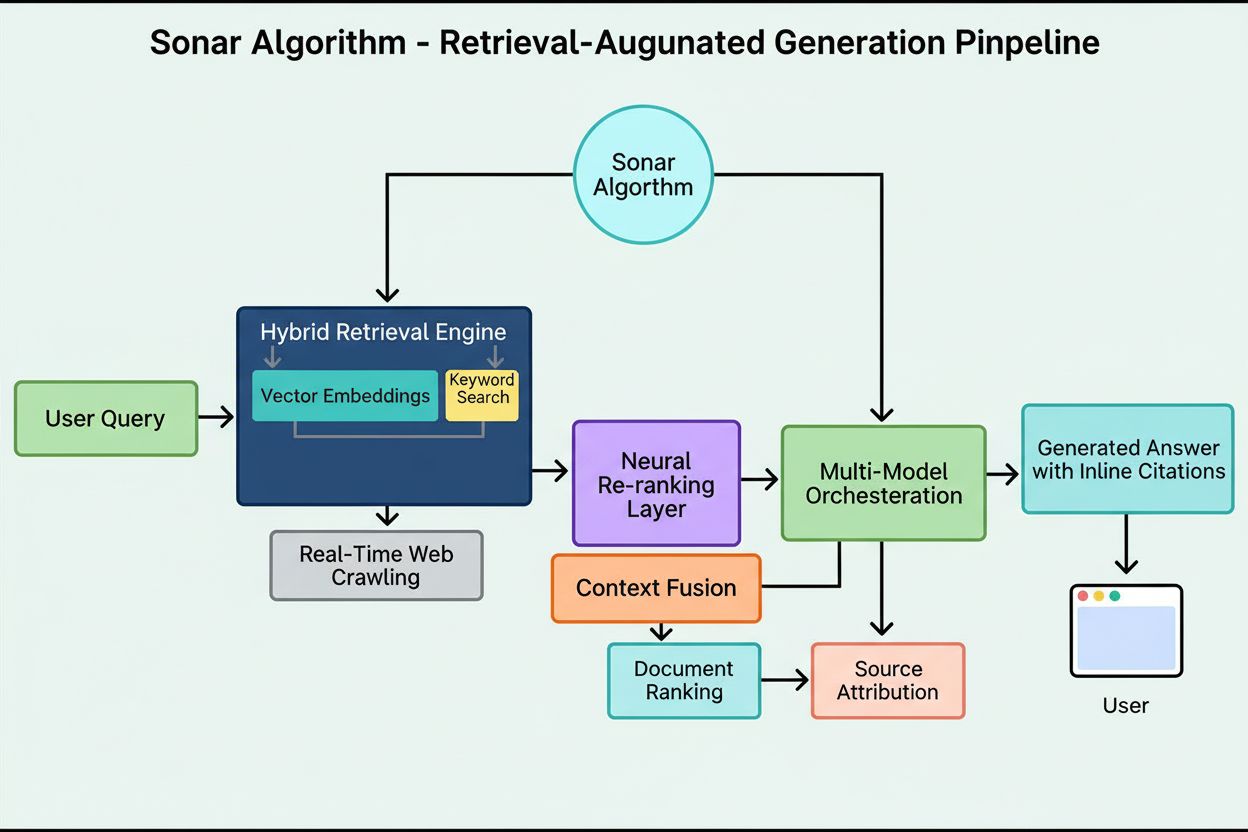

L'Algoritmo Sonar è il sistema proprietario di ranking RAG di Perplexity che combina recupero ibrido, riordino neurale e generazione di citazioni in tempo reale...

Scopri come l’algoritmo Sonar di Perplexity alimenta la ricerca AI in tempo reale con modelli economici. Esplora Sonar, Sonar Pro e Sonar Reasoning.

Sonar è la famiglia di modelli di ricerca leggeri ed economici di Perplexity, ottimizzata per l'integrazione della ricerca web in tempo reale con i grandi modelli linguistici. Combina un recupero rapido con risposte fondate, offrendo varianti tra cui Sonar base per domande e risposte veloci, Sonar Pro per query complesse e Sonar Reasoning per il problem solving basato su ragionamento a catena con accesso web live.

Sonar è la famiglia di modelli di ricerca proprietaria di Perplexity progettata per integrare direttamente le capacità di ricerca web in tempo reale nei grandi modelli linguistici al fine di generare risposte fondate e accurate. A differenza dei motori di ricerca tradizionali che restituiscono semplici collegamenti blu, gli algoritmi Sonar alimentano un’esperienza di ricerca guidata dall’AI, dove il modello sintetizza informazioni da più fonti per fornire risposte complete e citate. La famiglia Sonar rappresenta un cambiamento fondamentale nel modo in cui i sistemi AI accedono e processano informazioni attuali, permettendo ai modelli di rispondere su eventi recenti, ultime notizie e dati aggiornati senza basarsi su dati di addestramento statici. Questa tecnologia è cruciale nel panorama in evoluzione dei motori di ricerca AI come Perplexity, ChatGPT con ricerca web, Google AI Overviews e Claude, dove il recupero di informazioni in tempo reale è diventato essenziale per mantenere accuratezza e rilevanza.

L’infrastruttura di ricerca di Perplexity gestisce oltre 200 milioni di query giornaliere e mantiene un indice che traccia oltre 200 miliardi di URL unici, rendendolo uno degli indici web più grandi e aggiornati, ottimizzato specificamente per il consumo AI. L’algoritmo Sonar è stato sviluppato per risolvere limiti critici delle API di ricerca legacy, pensate per utenti umani e non per modelli AI. Le API tradizionali imponevano costi esorbitanti (alcuni fornitori chiedevano $200 ogni mille query), lavoravano su indici obsoleti e restituivano risultati a livello di documento troppo grossolani per modelli AI con finestre di contesto limitate. Sonar risolve questi problemi tramite una pipeline ibrida di recupero e ranking che combina segnali di ricerca lessicale (basata su parole chiave) e ricerca semantica (basata sul significato) per identificare le informazioni più rilevanti a livello sub-documentale.

L’architettura di Sonar si basa su tre principi fondamentali: completezza, freschezza e velocità. L’indice di ricerca deve mappare il web in modo completo, essere costantemente aggiornato per riflettere le ultime informazioni e rispondere alle query in millisecondi per supportare applicazioni AI in tempo reale. L’infrastruttura di crawling di Perplexity comprende decine di migliaia di CPU e centinaia di terabyte di RAM, consentendo al sistema di processare decine di migliaia di operazioni di indicizzazione al secondo. Modelli di machine learning prevedono quali URL necessitano di essere indicizzati e quando programmare tali operazioni, garantendo che documenti ad alto traffico e frequentemente aggiornati rimangano attuali, mantenendo al contempo un ritmo di crawling gestibile per gli operatori dei siti web.

| Variante Modello | Caso d’Uso Primario | Caratteristiche Chiave | Lunghezza Contesto | Focus di Ottimizzazione |

|---|---|---|---|---|

| Sonar (Base) | Domande e risposte rapide, ricerche semplici | Leggero, economico, ricerca web in tempo reale | 128K token | Velocità ed economicità |

| Sonar Pro | Query complesse e ricerche avanzate | Recupero potenziato, personalizzazione fonti, citazioni | 128K token | Accuratezza e gestione della complessità |

| Sonar Reasoning | Problem solving logico e analisi | Ragionamento Chain-of-Thought, inferenza passo-passo | 128K token | Ragionamento profondo con ricerca live |

| Sonar Reasoning Pro | Analisi complesse ad alte prestazioni | CoT multi-step avanzato, recupero migliorato | 128K token | Massima capacità di ragionamento |

La famiglia Sonar di Perplexity include quattro varianti di modello distinte, ciascuna ottimizzata per diversi casi d’uso e livelli di complessità. Il modello base Sonar è l’opzione più leggera ed economica, pensata per usi quotidiani come riassumere contenuti, cercare definizioni e consultare le notizie. Elabora le query a $1 per 1 milione di token in input e $1 per 1 milione di token in output, rendendolo notevolmente più accessibile rispetto alle soluzioni concorrenti. Sonar Pro amplia queste capacità per gestire query complesse e multi-step che richiedono analisi approfondita e personalizzazione delle fonti. Gli utenti possono specificare quali fonti privilegiare o escludere, ottenendo così un controllo granulare sul processo di recupero delle informazioni.

Sonar Reasoning introduce il ragionamento Chain-of-Thought (CoT), una tecnica in cui il modello affronta esplicitamente i problemi passo per passo prima di giungere alle conclusioni. Questa variante è alimentata dalla tecnologia DeepSeek-R1 ed eccelle in ragionamento logico, risoluzione di problemi matematici e analisi strutturata. Sonar Reasoning Pro rappresenta il livello prestazionale più alto, combinando ragionamento multi-step avanzato con capacità di recupero informazioni potenziate per i compiti analitici più impegnativi. Tutte le varianti Sonar mantengono una lunghezza di contesto di 128K token, offrendo ampio spazio per processare documenti lunghi, più fonti e prompt complessi.

L’algoritmo Sonar implementa una pipeline multi-stadio di recupero e ranking che affina progressivamente i risultati di ricerca con sofisticazione crescente. Il processo inizia con il recupero ibrido, dove il sistema interroga l’indice di ricerca sia con metodi lessicali che semantici simultaneamente, poi unisce i risultati in un set candidato completo. Questo approccio duale assicura che siano catturati sia i match specifici su parole chiave che i contenuti concettualmente simili. Gli stadi successivi applicano euristiche di pre-filtraggio per rimuovere contenuti chiaramente irrilevanti o obsoleti, seguiti da diversi round di ranking tramite modelli sempre più avanzati.

Le fasi iniziali di ranking usano scoring lessicali e basati su embedding ottimizzati per la velocità, mentre quelle successive sfruttano modelli reranker cross-encoder per analisi semantica sofisticata. L’intera pipeline opera sia a livello di documento che sub-documentale, il che significa che il sistema può identificare ed estrarre paragrafi, sezioni o persino frasi specifiche che rispondono direttamente a una query, senza costringere gli utenti a vagliare intere pagine web. Questa comprensione fine-grained dei contenuti è cruciale per i modelli AI, in cui ogni token di contesto conta e le informazioni irrilevanti possono compromettere le prestazioni. Il modulo di comprensione dei contenuti di Perplexity utilizza regole dinamiche e auto-miglioramento AI per analizzare la struttura eterogenea del web, adattandosi continuamente a nuovi layout e pattern di contenuto.

I modelli Sonar di Perplexity hanno dimostrato prestazioni eccezionali in rigorose valutazioni rispetto a soluzioni di ricerca AI concorrenti. In benchmark completi utilizzando framework come SimpleQA, FRAMES, BrowseComp e HLE, le varianti Sonar hanno costantemente superato i modelli di Google Gemini 2.0 Flash, OpenAI GPT-4o Search e altri sistemi AI leader. Sul benchmark SimpleQA, Sonar ha raggiunto un punteggio di 0.930, superando nettamente concorrenti come Brave Search (0.822) e API basate su SERP (0.890). Per compiti di ricerca approfondita valutati dal benchmark HLE, Sonar ha raggiunto 0.288, notevolmente avanti rispetto ai fornitori alternativi.

Oltre ai parametri di qualità, Sonar eccelle nelle prestazioni di latenza, un fattore critico per le applicazioni rivolte all’utente. La latenza media di ricerca di Perplexity è di 358 millisecondi, oltre 150 millisecondi più veloce del secondo provider più rapido. La latenza al 95° percentile resta sotto gli 800 millisecondi, garantendo prestazioni costanti anche in condizioni di massimo carico. Questo vantaggio di velocità deriva dagli investimenti infrastrutturali di Perplexity, inclusa l’indicizzazione distribuita su centinaia di terabyte di storage, strategie di caching intelligenti e pipeline di inferenza ottimizzate. La combinazione di qualità all’avanguardia e velocità leader di settore significa che gli sviluppatori non devono più scegliere tra applicazioni veloci e risultati accurati.

Gli algoritmi Sonar rappresentano un cambio di paradigma nell’accesso in tempo reale alle informazioni da parte dei sistemi AI, fondamentalmente diverso dai motori di ricerca tradizionali e dai primi chatbot AI. ChatGPT con ricerca web e Google AI Overviews offrono funzionalità in tempo reale, ma il design di Sonar è specificamente ottimizzato per il consumo AI invece di adattare la ricerca orientata all’uomo ai modelli AI. L’API Sonar fornisce agli sviluppatori accesso programmatico all’infrastruttura di ricerca di Perplexity, permettendo loro di costruire applicazioni AI che richiedono informazioni attuali senza gestire crawling, indicizzazione e sistemi di ranking propri.

L’infrastruttura di ricerca di Perplexity elabora query con risposte basate su ricerca web in tempo reale che includono risultati dettagliati e citazioni, consentendo agli utenti di verificare le fonti delle informazioni. Il sistema fornisce in media 5,01 link per risposta, collocandosi tra ChatGPT (10,42 link) e altri strumenti di ricerca AI. Questo approccio bilanciato offre sufficiente diversità di fonti per la verifica senza sovraccaricare gli utenti con troppe citazioni. La capacità dell’algoritmo Sonar di citare le fonti è particolarmente importante per il monitoraggio del brand e la visibilità dei contenuti, poiché le organizzazioni possono tracciare quando i loro domini appaiono nelle risposte generate dall’AI su piattaforme come Perplexity, ChatGPT, Claude e Google AI Overviews utilizzando strumenti come AmICited, specializzato nel monitoraggio delle apparizioni di brand e domini nei risultati di ricerca AI.

Gli algoritmi Sonar alimentano applicazioni diversificate in ricerca, business intelligence, creazione di contenuti e recupero di informazioni in tempo reale. I ricercatori usano Sonar per condurre revisioni della letteratura complete e sintetizzare informazioni da più fonti con citazioni corrette. Gli analisti aziendali sfruttano Sonar Pro per intelligence competitiva, ricerche di mercato e analisi di tendenze che richiedono dati aggiornati. I creatori di contenuti utilizzano Sonar per verificare fatti, trovare esempi recenti e assicurarsi che il loro lavoro rifletta gli ultimi sviluppi nel settore. Le organizzazioni di notizie e i fact-checker si affidano alle capacità di ricerca in tempo reale di Sonar per verificare affermazioni e fornire contesto per notizie dell’ultima ora.

Le varianti Sonar Reasoning sono particolarmente preziose per il problem solving tecnico, dove l’analisi passo-passo combinata con informazioni aggiornate produce risultati superiori. Gli sviluppatori software utilizzano Sonar Reasoning per risolvere problemi accedendo alla documentazione più recente, discussioni su Stack Overflow e repository GitHub. I data scientist sfruttano Sonar per restare aggiornati su metodologie in rapida evoluzione e accedere a nuovi paper di ricerca. I professionisti finanziari usano Sonar Pro per monitorare le condizioni di mercato, seguire i cambiamenti normativi e analizzare trend emergenti. La possibilità di combinare ricerca web in tempo reale con ragionamento avanzato rende Sonar particolarmente prezioso nei settori dove le informazioni cambiano rapidamente e l’accuratezza è fondamentale.

L’algoritmo Sonar rappresenta solo l’inizio dell’infrastruttura di ricerca nativa per l’AI. Le ricerche di Perplexity indicano che i motori di ricerca legacy si sono stabilizzati su circa 10 miliardi di query al giorno, mentre la prossima generazione di ricerca alimentata dall’AI servirà ordini di grandezza superiori di richieste man mano che gli agenti AI autonomi diventeranno onnipresenti. Le future iterazioni di Sonar dovranno affrontare sfide emergenti tra cui scalabilità efficiente di fronte a una crescita esponenziale delle query, nuovi approcci di context engineering ottimizzati per modelli AI sempre più sofisticati e la tensione costante tra completezza, attualità e latenza.

L’infrastruttura di Perplexity è posizionata in modo unico per affrontare queste sfide, combinando un enorme sistema di ricerca in produzione al servizio di milioni di utenti ogni giorno con talento tecnico e capacità di ricerca. Il modulo di comprensione dei contenuti auto-migliorante dell’azienda dimostra come l’AI possa migliorare costantemente la qualità della ricerca senza intervento manuale. Man mano che gli agenti AI diventano più autonomi e capaci, la qualità della loro infrastruttura di ricerca sottostante diventa sempre più critica. L’evoluzione di Sonar includerà probabilmente una maggiore integrazione con i workflow agentici, una curatela di contesto più sofisticata per architetture di modelli AI specifiche e capacità di verifica delle fonti potenziate per combattere la disinformazione. Le organizzazioni che vogliono mantenere visibilità in questo panorama in evoluzione dovrebbero monitorare le apparizioni del proprio brand sulle piattaforme di ricerca AI tramite strumenti specializzati, assicurandosi che i propri contenuti restino autorevoli e correttamente citati mentre i sistemi AI diventano l’interfaccia primaria per la scoperta delle informazioni.

Traccia quando il tuo dominio appare nelle risposte Sonar di Perplexity e in altri risultati di ricerca AI. Assicurati che i tuoi contenuti siano citati come fonte autorevole su tutte le principali piattaforme AI.

L'Algoritmo Sonar è il sistema proprietario di ranking RAG di Perplexity che combina recupero ibrido, riordino neurale e generazione di citazioni in tempo reale...

Perplexity AI è un motore di risposta AI che combina la ricerca web in tempo reale con LLM per offrire risposte citate e accurate. Scopri come funziona e il suo...

Comprendi come la tecnologia di ricerca live di Perplexity recupera informazioni in tempo reale dal web e genera risposte citate. Scopri il processo tecnico die...