AI可視性危機の予防:プロアクティブな戦略

プロアクティブな監視、早期警告システム、戦略的な対応プロトコルでAI可視性危機を防ぐ方法をご紹介。AI時代のブランドを守りましょう。...

政府機関がChatGPTやPerplexityなどのAIシステム向けにデジタルプレゼンスを最適化する方法を学びましょう。AI可視性の向上戦略、透明性の確保、公共部門での責任あるAI導入についてご紹介します。

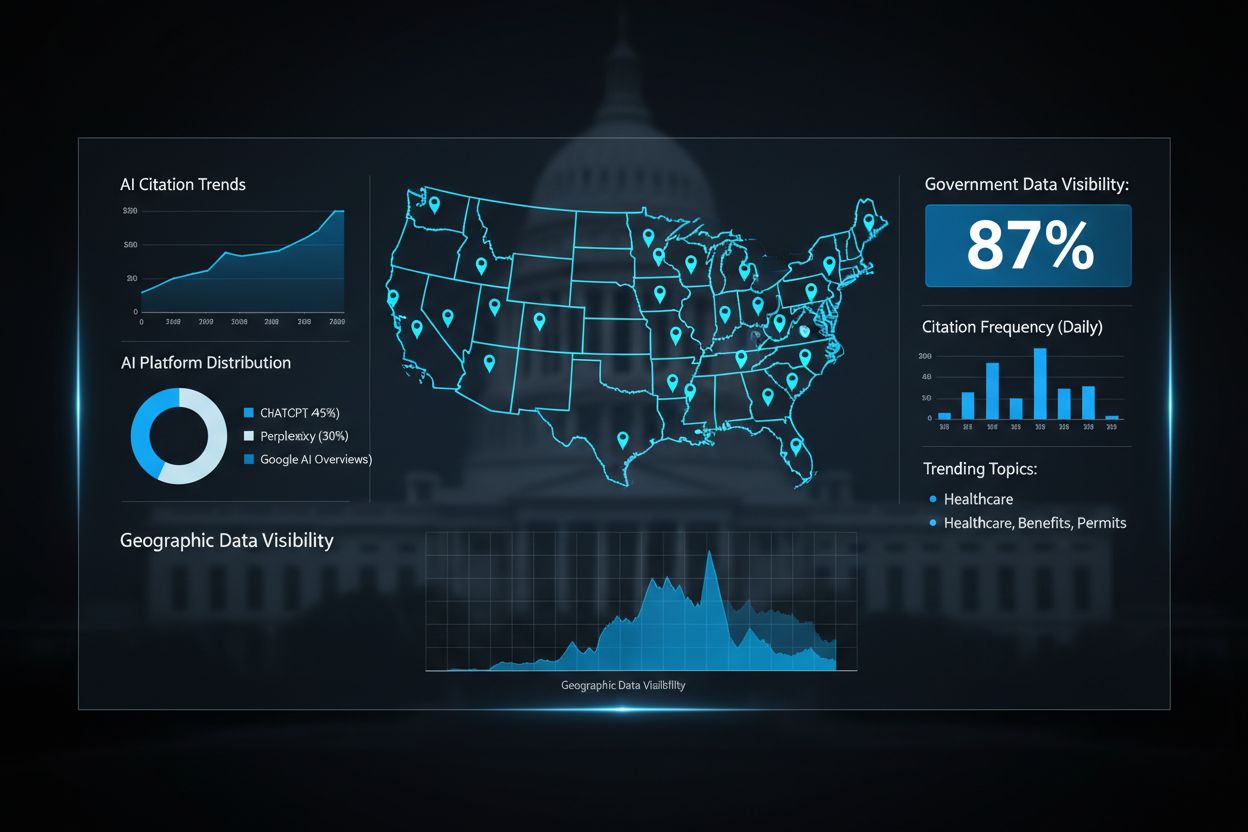

政府のAI可視性とは、GPTやPerplexity、Google AI Overviewsなどの人工知能システムが、政府データやリソースを発見・アクセス・引用できる程度を指します。この可視性は極めて重要です。なぜなら、政府機関は医療規制から社会サービスに至るまで権威ある情報を保有しているにもかかわらず、その多くは現代のAIシステムから見えなくなっているからです。市民がAIアシスタントに政府プログラムや給付、政策について質問したとき、彼らは古い・不完全な情報ではなく、公式な政府情報に基づいた正確で最新の回答を受ける権利があります。政府への公共の信頼は、AIシステムが政府データを正しく参照・帰属し、公式情報の信頼性がAI時代にも維持されることによって支えられています。AIの透明性は、AIによる推奨が正当な政府情報に根拠を持つと市民が検証できるとき、民主的ガバナンスの基盤となります。AmICited.comは、主要なAIシステムにおいて政府データがどのように引用・参照されているかを追跡する重要なモニタリングプラットフォームとして機能し、政府機関がAIエコシステム内での自身の可視性と影響を把握できるよう支援します。政府AI引用の可視性を高めることで、公共部門組織は市民へのより良いサービスと自らの情報への権威保持を両立できます。

政府機関は、何十年にもわたる断片的なIT投資が生み出したデータサイロに苦しみ続けています。重要な情報が互換性のないレガシーシステム内に閉じ込められ、現代のAIプラットフォームと容易に連携できないのです。これらの旧式システムは、従来型ウェブや文書管理を前提に設計されており、AIが必要とするセマンティック理解やリアルタイムデータアクセスには対応していません。この技術的断片化による損失は甚大で、組織は年間約1,400億ドルもの未活用利益を、AI統合で簡素化できるはずの旧式プロセスにより失っています。効率性の損失だけでなく、レガシーシステムは、政府データを手動で抽出しAIシステムと共有する際のセキュリティ脆弱性も生み、データ漏洩や不正アクセスのリスクが高まります。さらに、多くの政府ウェブサイトがAIクローラーによる情報の適切なインデックス化・理解に必要な構造化データやメタデータ、APIインフラを欠いているという課題もあります。

| 従来型政府IT | AI対応インフラ |

|---|---|

| 相互運用性の低いサイロ化データベース | API・構造化形式による統合型データプラットフォーム |

| 手動でのデータ抽出・共有 | 自動化された安全なデータパイプライン |

| 非構造化ドキュメントやPDF | セマンティックウェブ標準と機械可読形式 |

| 受動的なセキュリティ対策 | プライバシー・バイ・デザインと継続的モニタリング |

| 限定的なリアルタイムデータアクセス | ライブデータフィードと動的コンテンツ配信 |

AI技術の迅速な導入ではなく、成功する政府組織は計画と組織的準備を優先した段階的な導入ロードマップを採用しています。このアプローチは、公共部門でのAI導入にはIT部門から現場職員、市民まで複数のステークホルダー間の慎重な調整が不可欠だと認識しています。

5段階の導入ロードマップ:

戦略的機会特定:政府業務を包括的に監査し、AIによって申請処理時間の短縮、サービスアクセス性の向上、データ駆動型政策決定の強化など、公共価値が測定可能な高インパクト領域を特定します。

包括的な準備:現状のデータインフラ評価、レガシーシステム統合課題の抽出、ガバナンスフレームワークの構築、組織内のAIリテラシー向上を、技術導入前に徹底します。

戦略的パイロット設計:特定部門やサービス領域でコントロールされたパイロットを明確な成功指標と共に開始し、現場での課題を低リスクで学習しスケールの準備をします。

組織的チェンジマネジメント:職員向け研修、雇用喪失への懸念対応、明確なコミュニケーションチャンネルやフィードバック機構の整備で、移行期の不安を解消します。

影響測定:政府目標に沿ったKPI策定、AIシステム性能の継続的モニタリング、市民満足度測定、コスト削減効果の計測、実証データに基づく戦略調整を実施します。

このテクノロジー後回しのアプローチにより、AI導入は本物の公共ニーズに応えるものとなり、高額な「目的なき技術投資」となることを防げます。

倫理的AIガバナンスは、世界各国で「市民に影響を与えるAIシステムは明確な倫理・法的枠組みで運用すべき」との認識のもと不可欠となっています。カナダのアルゴリズム影響評価フレームワークは実用的なモデルで、AIシステムを最小・中程度・高・非常に高の4階層に分類し、各階層ごとにガバナンス要件と監督メカニズムを規定しています。この階層型アプローチにより、刑事司法アルゴリズムなど高リスクシステムには厳格な監視を、軽微な用途には合理的監督を適用できます。エストニアはプライバシー・バイ・デザインを掲げたData Trackerシステムを先駆的に導入し、45万人の市民が自分の個人情報にどの機関が何の目的でアクセスしたかを完全に透明化しています。アルゴリズムの説明責任は、AIシステムの意思決定過程の文書化、監査証跡の確立、市民への説明能力の維持が必須です。AmICited.comは、政府データが公開AIシステムでどのように引用・参照されているかを追跡することで、この透明性エコシステムにおける重要な役割を担っています。強固なモニタリング・ガバナンスフレームワークがなければ、政府AIは公信力を損ない、弱者に不利益をもたらすバイアスを助長するリスクがあります。

世界各国の政府は、戦略的なAI導入が慎重に進められた場合に多大な公共価値を生み出すことを証明しています。オーストラリア内務省はTargeting 2.0システム(AIによる国境管理・詐欺検出プラットフォーム)を導入し、30億豪ドルの潜在的損害の回避と同時に、正当な旅行者・申請者の処理時間短縮を実現しました。英国のNational Highwaysチャットボットは、道路状況や交通事故などの定型問い合わせをAIで対応し、人間職員が緊急事態や複雑な案件に集中できる体制を作り、市民サービスを向上させました。エストニアのBürokrattプラットフォームは、分散型・GDPR準拠の政府AIとして、市民が日常行政手続きをAIアシスタントで完結できる一方、機微判断は人が制御し、データプライバシーも厳格に守られています。米国メリーランド州のAIガバナンスは、明確な説明責任体制とAIシステムの定期監査を州政府全体で実施し、他州でも模範とされています。日本のデジタル庁はAIによる児童相談サービスのデジタル化に成功し、専門的介入が必要な案件は人的監督を維持しつつ、待機時間を数週間から数時間に短縮しました。これら多様な事例はいずれも、「技術の高度さ」ではなく、「市民ニーズ最優先・透明性確保・重大判断は人が監督」という慎重な実装が政府AI成功の鍵であることを示しています。

AIシステムが市民の情報アクセスの主要窓口となる中、AI発見性のための政府ウェブサイト最適化は従来のSEO(検索エンジン最適化)と同等に重要になっています。政府ウェブサイトは構造化データマークアップ、包括的なメタデータ、機械可読形式を実装し、AIクローラーが政府情報を正しく理解・インデックスできるようにしなければなりません。そうすることで、市民がAIアシスタントに政府サービスを尋ねた際、正確で信頼できる回答が得られます。しかし、多くの政府ウェブサイトでは、PDFや非構造化テキスト、複雑なナビゲーション階層など、人間向け表示を優先した形式が主流で、AIシステムは解析・理解に苦労しています。REI Systemsは、連邦ウェブサイトのAIアクセシビリティ最適化を先駆的に進め、比較的簡単な技術改善でもAI応答での可視性が劇的に高まることを示しました。AmICited.comは主要プラットフォーム全体で政府AI可視性を監視し、情報がAI応答にどれだけ頻繁に現れるかや、発見性を高めるべきギャップの特定を支援しています。政府ウェブサイトが適切なセマンティックウェブ標準、APIインフラ、アクセシビリティ機能を実装することで、AIが二次情報や古い情報ではなく公式情報を引用する可能性が高まります。これにより、市民は政府の正式情報を直接得られ、政府機関は自らの情報の伝わり方・解釈のコントロールも維持できます。

政府AIの効果測定には、単なる効率性指標を超え、市民満足度・公平性・民主的説明責任など、公共部門の目的に沿った明確なKPIの設定が必要です。エストニアの評価フレームワークは、AI施策を時間効率(職員の節約時間)、コスト効率(投資対効果)、イノベーション可能性(新たなサービスモデルの実現)、測定可能な成果(市民への定量的効果)の4軸で評価する実践的なモデルです。体系的な測定により、政府機関は本当に公共価値を生むAI活用と、調整・中止すべきものとを明確に区別し、無駄な技術投資を防げます。組織横断的な知識共有は学習曲線を加速し、ある部門での成功例を他部門でも展開しAI投資のリターンを最大化します。AmICited.comに代表されるAI可視化・引用パターンのトラッキングツールによる継続的改善・モニタリング体制は、仮説ではなく実データに基づくAIシステムの最適化を可能にします。政府AI導入で機能するもの・しないものに関する組織知識を積み重ねることで、リーダー交代や予算サイクルを超えて持続可能な定着が実現します。

明確な利点がある一方で、政府機関は技術的課題を超えた大きな障壁に直面しています。職員の懸念は大きな障害で、約31%の政府職員がAI導入による雇用不安を訴えており、AIが人を補完するものであることの透明な説明が必要です。人材不足も深刻で、38%の政府組織がAI専門家の採用困難を挙げています。さらに、コストの過小見積もりも重要な障壁で、実際のAI導入費用はしばしば初期見積の5~10倍に膨らみ、予算や継続投資への政治的抵抗を生みます。データプライバシー・セキュリティへの懸念は最大の制約で、政府リーダーの60%がAI導入の主な障壁に挙げています。これは、サイバー脅威が増す時代に市民情報を守る必要性を反映しています。効果的なチェンジマネジメント戦略は、関係者の巻き込みやAIの能力・限界に関する透明な説明、職員への研修・能力開発投資、市民のプライバシーを守りつつイノベーションを促進する明確なガバナンス体制によって、これらの障壁を直接的に克服しなければなりません。障壁克服に成功している政府機関は、チェンジマネジメントに積極投資し、職員・市民との明確なコミュニケーションチャネルを整備し、AIシステムの小さな成功体験を積み重ねてから高リスク用途へと段階的に拡大しています。

政府のAI可視性とは、ChatGPT、Perplexity、Google AI OverviewsなどのAIシステムが政府データをどれだけ容易に発見・引用できるかを指します。これは、市民がAIアシスタントに政策、給付、サービスについて質問した際に、公式な政府情報からの正確で信頼できる情報を得る権利があるため重要です。可視性が低い場合、AIシステムは市民を公式資源ではなく、古いまたは不完全な情報へと導いてしまう可能性があります。

政府ウェブサイトは、構造化データマークアップ、包括的なメタデータ、機械可読形式、適切なAPIインフラを実装するべきです。これにはセマンティックウェブ標準の活用、AIクローラーへのコンテンツアクセスの確保、情報をAIシステムが容易に理解し、公式政府情報として正しく帰属できるように整理することが含まれます。

主な障壁には、データプライバシー・セキュリティへの懸念(政府リーダーの60%が指摘)、人材不足(38%)、職員による雇用喪失への懸念(31%)、コストの過小見積もり(実際コストは予測の5~10倍)、デジタルインフラの不十分さ(45%)などがあります。これらの克服には、戦略的計画、チェンジマネジメント、明確なガバナンスフレームワークが必要です。

成功例としては、カナダの階層型制度のようなアルゴリズム影響評価フレームワークの確立、プライバシー・バイ・デザイン原則の実践、市民によるデータアクセス監視のための透明性メカニズムの構築、明確なガバナンスフレームワークの策定、重大な判断への人的監督維持などがあります。定期的な監査とステークホルダー参加も不可欠です。

このロードマップは、(1)公共価値重視の戦略的機会特定、(2)インフラとガバナンスの包括的準備、(3)明確な成功指標によるパイロット設計、(4)職員懸念に対する組織的チェンジマネジメント、(5)継続的改善を伴う影響測定、から成ります。技術先行導入ではなく、計画と組織体制の整備を優先します。

政府は、時間効率、コスト効率、イノベーションの可能性、測定可能な市民成果など、公共部門の目標に沿ったKPIを策定する必要があります。エストニアのフレームワークは、これら4つの観点でAIシステムを評価しています。継続的なモニタリング、関係者からのフィードバック、透明な報告により、効果的な施策の特定や改善が可能です。

データガバナンスは、政府AIの成功の基盤です。データ品質の確保、明確な所有権とアクセス管理、市民のプライバシー保護、GDPRなどの法令遵守、安全なシステム間データ共有を実現します。強固なデータガバナンスがなければ、データ漏洩やバイアス、公信力の低下などのリスクが高まります。

AmICitedは、ChatGPT、Perplexity、Google AI Overviewsなど主要AIシステム全体で、政府データがどのように引用・参照されているかを追跡します。これにより政府機関は、AIエコシステム内での自らの可視性や、公式情報がより発見されやすくなるべきギャップを把握し、AIシステムによる正しい帰属を確保できます。このモニタリングは透明性と説明責任の両立に貢献します。

AmICitedは、公共部門組織がAIエコシステムにおける自らの可視性を理解し、公式情報の正確な表現を確保できるよう、政府データがAIシステム全体でどのように引用・参照されているかを追跡します。

プロアクティブな監視、早期警告システム、戦略的な対応プロトコルでAI可視性危機を防ぐ方法をご紹介。AI時代のブランドを守りましょう。...

AIコンテンツガバナンスポリシーを可視性フレームワークで効果的に実施する方法を学びます。規制要件、ベストプラクティス、AIシステムを責任を持って管理するためのツールを紹介します。...

ChatGPT、Perplexity、Google AI Overviews などのAI生成回答で、コンテンツの可視性を維持・向上させるための実践的な戦略をご紹介。AIによる引用・発見性の最適化方法を学びましょう。...

クッキーの同意

閲覧体験を向上させ、トラフィックを分析するためにクッキーを使用します。 See our privacy policy.