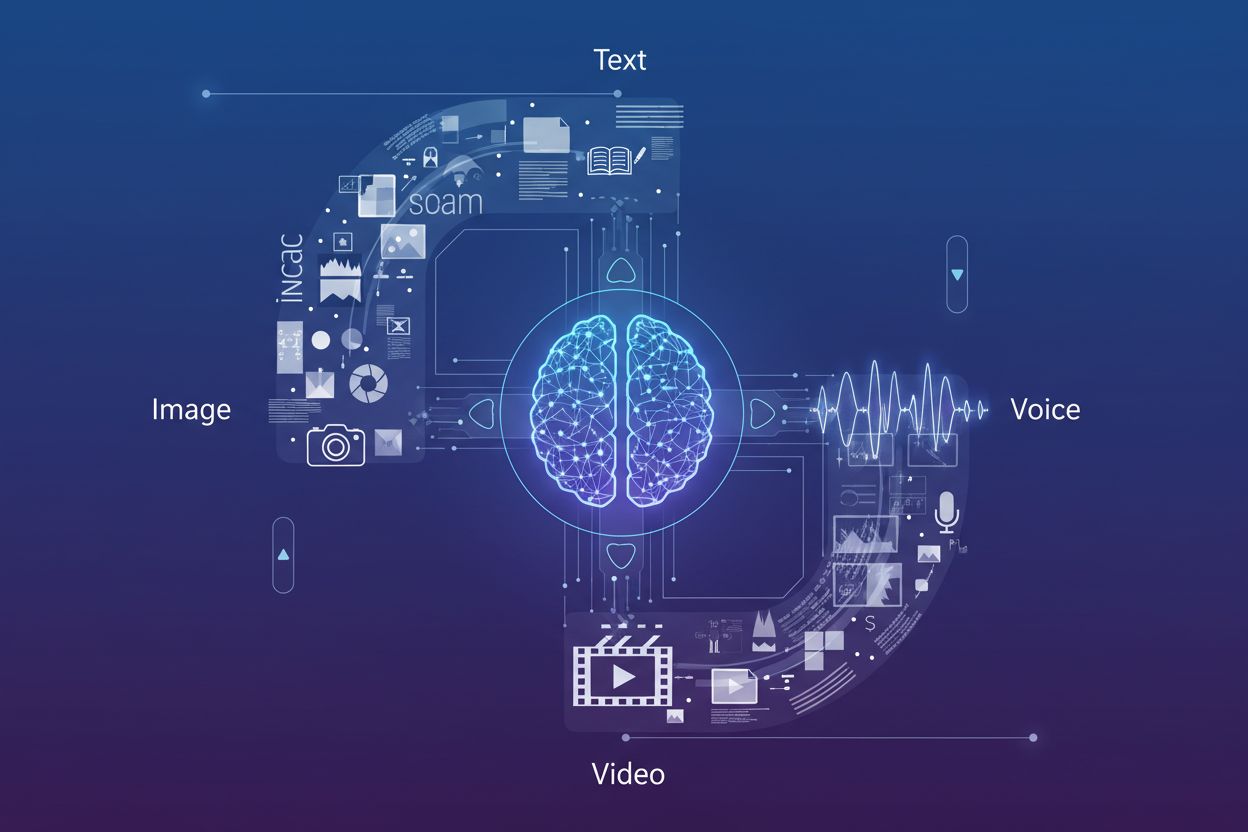

マルチモーダルAI検索

マルチモーダルAI検索システムがテキスト・画像・音声・動画を統合して処理し、単一モダリティAIよりも正確で文脈に合った結果を提供する仕組みを解説します。...

マルチモーダルAI検索最適化をマスターしましょう。AI搭載の検索結果で画像や音声クエリを最適化する方法を学び、GPT-4o、Gemini、LLM向けの戦略を紹介します。

マルチモーダルAI検索は、検索エンジンがユーザーのクエリを処理・理解する手法に根本的な変革をもたらし、テキスト・画像・音声・動画など複数のデータタイプを統合した検索体験を実現します。従来は各モダリティを別々のチャネルとして扱っていましたが、現代の検索システムはマルチモーダルAIモデルを活用することで、異なるフォーマットの情報を同時に解析・関連付けし、より文脈に沿った正確な結果をもたらします。この進化は、テキストクエリがテキスト結果のみを返す単一モダリティ検索から、統合的なマルチモーダルシステムへの移行を意味し、ユーザーが情報と自然にやり取りする現実(音声と視覚を組み合わせた質問、画像アップロードによる文脈提示、複数コンテンツタイプの統合的な回答要求)を反映しています。この変化は非常に重要であり、コンテンツ制作者はデジタルプレゼンスの最適化方法を根本から見直す必要があり、ブランドも検索チャネル全体での可視性をしっかりとモニタリングしなければなりません。マルチモーダル検索最適化の理解は、AI駆動型検索環境で競争力ある可視性を保つために、もはや選択肢ではなく必須です。

先進的なマルチモーダルモデルの登場により検索機能は大きく進化し、複数のモダリティを同時に処理・理解できる高度なビジョン・ランゲージモデルを主要プラットフォームが提供しています。主なプレイヤーの比較は以下の通りです:

| モデル名 | 開発元 | 主な機能 | 最適用途 |

|---|---|---|---|

| GPT-4o | OpenAI | リアルタイム画像解析、音声処理、320ms応答速度 | 複雑な視覚推論、マルチモーダル会話 |

| Gemini | 統合検索、動画理解、クロスモーダル推論 | 検索統合、包括的コンテンツ分析 | |

| Claude 3.7 | Anthropic | ドキュメント解析、画像解釈、微細な理解 | 技術文書、詳細なビジュアル分析 |

| LLaVA | オープンソースコミュニティ | 軽量ビジョン・ランゲージ処理、効率的な推論 | リソース制約環境、エッジ展開 |

| ImageBind | Meta | クロスモーダル埋め込み、音声・映像理解 | マルチメディアコンテンツの相関、セマンティック検索 |

これらのモデルはAI検索技術の最先端であり、それぞれ異なるユースケースや導入シナリオに最適化されています。ターゲットとする検索プラットフォームを支えるモデルを理解し、発見性向上のためにコンテンツを的確に最適化することが重要です。技術の急速な進化により、検索での可視性戦略は柔軟かつ適応的である必要があります。

画像検索機能が急速に拡大する中、最適化は必須となっています。Google Lensは2025年5月だけで1,000万件の訪問を記録し、画像ベース検索クエリの爆発的成長を示しています。画像検索AIでの可視性を最大化するため、コンテンツ制作者は包括的な最適化戦略を実行しましょう:

こうした多角的なアプローチにより、従来の画像検索だけでなく、周囲テキストやメタデータも分析するマルチモーダルAIにも画像が発見されやすくなります。

大規模言語モデル(LLM)の音声検索統合により、検索エンジンは発話クエリを解釈・応答する方法を根本的に変えました。従来の音声検索は音素マッチングや基本的な自然言語処理に依存していましたが、現代のLLM搭載音声検索は意図・文脈・ニュアンス・会話パターンを高精度に理解します。これにより、音声検索最適化は単なる完全一致キーワードではなく、ユーザーが自然に発話する会話型クエリの背後にある意図にコンテンツを構造化する必要があります。この違いは非常に大きく、「キッチンの蛇口の水漏れを直す最善の方法は?」と聞くユーザーと、「fix leaky faucet」と入力するユーザーでは、求めている情報が異なります。コンテンツは質問と暗黙のステップガイド両方に応える必要があります。強調スニペットは音声検索回答源の主流となり、検索エンジンは検索結果の最上位に簡潔・明確な回答を配置します。音声検索回答が強調スニペットから抽出されるという構造を理解することは、音声デバイスやアシスタントを狙ったコンテンツ戦略に不可欠です。

会話型クエリへの最適化には、キーワード主体のパラグラフから、実際の話し言葉に近い自然な質問・回答形式への抜本的なコンテンツ構造改革が必要です。質問形式の見出しでユーザーが発するであろうクエリを直接扱い、その直後に簡潔で権威ある回答を配置し、ユーザーが長文を読むことなく価値を得られるようにします。これは自然言語処理システムがウェブコンテンツから回答を抽出する方法と一致しており、明確な質問-回答ペアや直接的な記述が音声アシスタントで読み上げられます。構造化データマークアップを実装し、質問・回答を明示的に示すことで、検索エンジンはコンテンツの会話性を理解しやすくなり、音声検索で選ばれる可能性も高まります。ロングテールの会話型フレーズも不自然に詰め込むのではなく、自然な流れで全体に組み込みましょう。目標は、人間が声に出して読んだ際に自然なだけでなく、AIが機械的に情報抽出しやすいコンテンツを同時に作ることです。この“人間の可読性”と“機械の解釈性”のバランスが、音声検索最適化の要です。

適切なスキーママークアップ実装は、マルチモーダルAIシステムにコンテンツの性質や多様な検索文脈での解釈方法を示す上で不可欠です。構造化データの中でもFAQスキーマ(音声検索向けの質問-回答ペア)、HowToスキーマ(ステップバイステップの手順を機械可読化)、Local Businessスキーマ(ローカルなマルチモーダルクエリ対応)が特に効果的です。これに加え、Articleスキーマ・Productスキーマ・Eventスキーマも実装することで、AIがページ内容を正しく分類・理解しやすくなります。Googleのリッチリザルトテストでスキーマ実装状況を定期的に検証し、検索システムが正しく認識しているか確認しましょう。また、クリーンなHTML構造、高速なページロード、モバイル対応、正しいカノニカル設定といったテクニカルSEOの基礎も、マルチモーダル検索環境ではさらに重要です。AIシステムが様々なフォーマットでコンテンツを迅速に解析・理解できるよう、サイト全体を監査し、特にトラフィックの多いページや質問・手順形式コンテンツを優先的にスキーマ化しましょう。

マルチモーダル検索での成果トラッキングには、従来のオーガニックトラフィックとは異なる指標への転換が求められ、特に強調スニペット表示回数、音声検索エンゲージメント、マルチモーダル経由コンバージョン率に注目します。Google Search Consoleは、強調スニペットの表示頻度やどのクエリでスニペットが表示されたかを把握でき、これは音声検索での可視性と直結します。音声検索は主にモバイルやスマートスピーカーから利用されるため、モバイルでのコンバージョン率やセッション時間などのエンゲージメント指標が重要です。アナリティクスツールは、音声アシスタントや画像検索からのトラフィックを従来のオーガニック検索と分けて追跡し、どのマルチモーダルチャネルが最も価値あるトラフィックを生んでいるか可視化しましょう。音声検索指標はトラフィック量だけでなく、コンバージョンの質も含めて評価します。なぜなら音声検索ユーザーはテキスト検索と異なる意図や行動を示します。AIオーバービューやその他AI生成検索結果でのブランド言及もモニタリングし、新しい検索フォーマットでのブランド表現を把握できます。強調スニペット成果監査と音声検索トラフィック分析を組み合わせることで、マルチモーダル検索での可視性とROIを総合的に評価できます。

マルチモーダル検索の進化は、AI検索トレンドの高度化と、検索・閲覧・タスク完結の境界が曖昧になる方向へ進んでいます。AIオーバービューの利用も10%以上増加し、ユーザーがAI生成サマリーを積極的に活用し始めています。今後は、音声・画像・文脈情報を組み合わせたマルチモーダルクエリに基づき、予約・購入・予定作成といった行動をユーザーに代わって実行するエージェンティックAIが登場します。パーソナライズもさらに細分化され、AIはユーザーの好み・位置情報・購買履歴・行動パターンまで理解し、各モダリティで超関連性の高い結果を提示します。リアルタイム検索も進化し、ライブイベントや最新情報について即座に複数ソースから統合的な回答を提供できるようになります。動画検索も主要なモダリティとなり、AIは動画メタデータだけでなく映像そのものの内容も理解し、ユーザーは動画内の特定の瞬間や概念、情報を直接検索できるようになります。競争環境は、すべてのモダリティで最適化を進めたブランドが有利となり、一つのチャネル(強調スニペット・画像検索・音声結果)での可視性が他チャネルのランキングにも直接影響を与えるようになります。

マルチモーダル検索が主流となる中で、AIモニタリングは従来の順位監視から、画像検索・音声結果・AI生成オーバービューまでのブランド引用トラッキングへと進化しました。AmICitedはAIオーバービュー・強調スニペット・音声検索結果で自社ブランドがどのように表示・引用されているかを可視化し、単なるランクインだけでなく、AIが複数ソースを統合する中でブランドがどのように扱われているかまで把握できます。プラットフォームは画像検索結果での画像引用も追跡し、ビジュアルコンテンツへの正しい帰属と自社ドメインへのリンク維持を保証し、SEO権威やブランド可視性を守ります。音声検索でのブランド言及もスマートスピーカーや音声アシスタントを横断して監視し、従来のクリック率が適用されない音声ファースト環境でのブランド提示を把握します。AI生成検索結果がユーザーとのタッチポイントの大部分を占める現状、これら新しいフォーマットでの可視性把握は不可欠です。AmICitedは、すべてのマルチモーダル検索チャネルでのプレゼンスを追跡・測定・最適化するためのモニタリング基盤を提供します。AI駆動検索で競争力を維持したいブランドにとって、AmICitedのような包括的なマルチモーダル監視は、もはや選択肢ではなく、デジタルプレゼンスを理解・保護するための必須ツールです。

マルチモーダルAI検索は、テキスト・画像・音声・動画など複数のデータタイプを統合した検索体験です。最新の検索システムは、異なるフォーマットを同時に解析・関連付けできるマルチモーダルAIモデルを活用し、単一モダリティ検索よりも文脈に沿った正確な結果を実現します。

高品質でオリジナルの画像を使用し、説明的なファイル名や充実したaltテキストを付与して画像を最適化しましょう。スキーママークアップを実装し、文脈となる周辺テキストを用意し、同じ被写体の複数アングルも含め、読み込み速度向上のため圧縮も行います。これらの施策により、従来の画像検索とマルチモーダルAI両方で可視性が向上します。

強調スニペットは音声検索回答の主要な情報源です。音声アシスタントは検索結果ページのポジションゼロから簡潔で直接的な回答を取得します。音声検索での可視性や順位向上には、強調スニペットへの最適化が不可欠です。

よくある音声クエリを直接扱う質問形式の見出しを用い、その直後に簡潔な回答を配置しましょう。自然で会話的な言語を使い、構造化データ(FAQスキーマやHowToスキーマ)を実装して、AIが会話形式の内容を理解しやすくします。

主要なマルチモーダルモデルには、GPT-4o(OpenAI)、Gemini(Google)、Claude 3.7(Anthropic)、LLaVA(オープンソース)、ImageBind(Meta)などがあります。それぞれ異なる機能や展開環境を持つため、ターゲットとする検索プラットフォームを把握し、効果的にコンテンツを最適化しましょう。

Google Search Consoleで強調スニペット表示回数を追跡し、モバイルエンゲージメント指標をモニタリング、従来のオーガニック検索とは別に音声検索トラフィックを分析、マルチモーダル経由のコンバージョン率を測定します。AIオーバービューでのブランド言及も監視し、複数モダリティでの表示状況を追跡しましょう。

AmICitedはAIオーバービュー、強調スニペット、画像検索結果、音声検索回答におけるブランド表示をモニタリングします。AI生成検索結果が主流となる今、包括的なマルチモーダル監視は、全検索チャネルでのデジタルプレゼンスを把握・保護するために不可欠です。

未来は、ユーザーの代わりに行動するエージェンティックなAI、ユーザーの好みや行動履歴に基づくハイパーパーソナライズドな結果、ライブイベント対応のリアルタイム検索、成熟した動画検索能力などが含まれます。すべてのモダリティで最適化したブランドが競争優位を持つようになります。

AIオーバービュー、画像検索結果、音声検索回答で自社ブランドがどのように表示されているかを追跡。マルチモーダル検索でのプレゼンスをリアルタイムで可視化します。

マルチモーダルAI検索システムがテキスト・画像・音声・動画を統合して処理し、単一モダリティAIよりも正確で文脈に合った結果を提供する仕組みを解説します。...

テキスト・画像・動画をマルチモーダルAIシステム向けに最適化する方法を学びましょう。ChatGPT、Gemini、Perplexity などでAI引用や可視性を高める戦略を紹介します。...

AIのためのマルチモーダルコンテンツとは何か、その仕組みや重要性について学びましょう。マルチモーダルAIシステムの事例と業界横断での応用例も紹介します。...

クッキーの同意

閲覧体験を向上させ、トラフィックを分析するためにクッキーを使用します。 See our privacy policy.