BERTアップデート

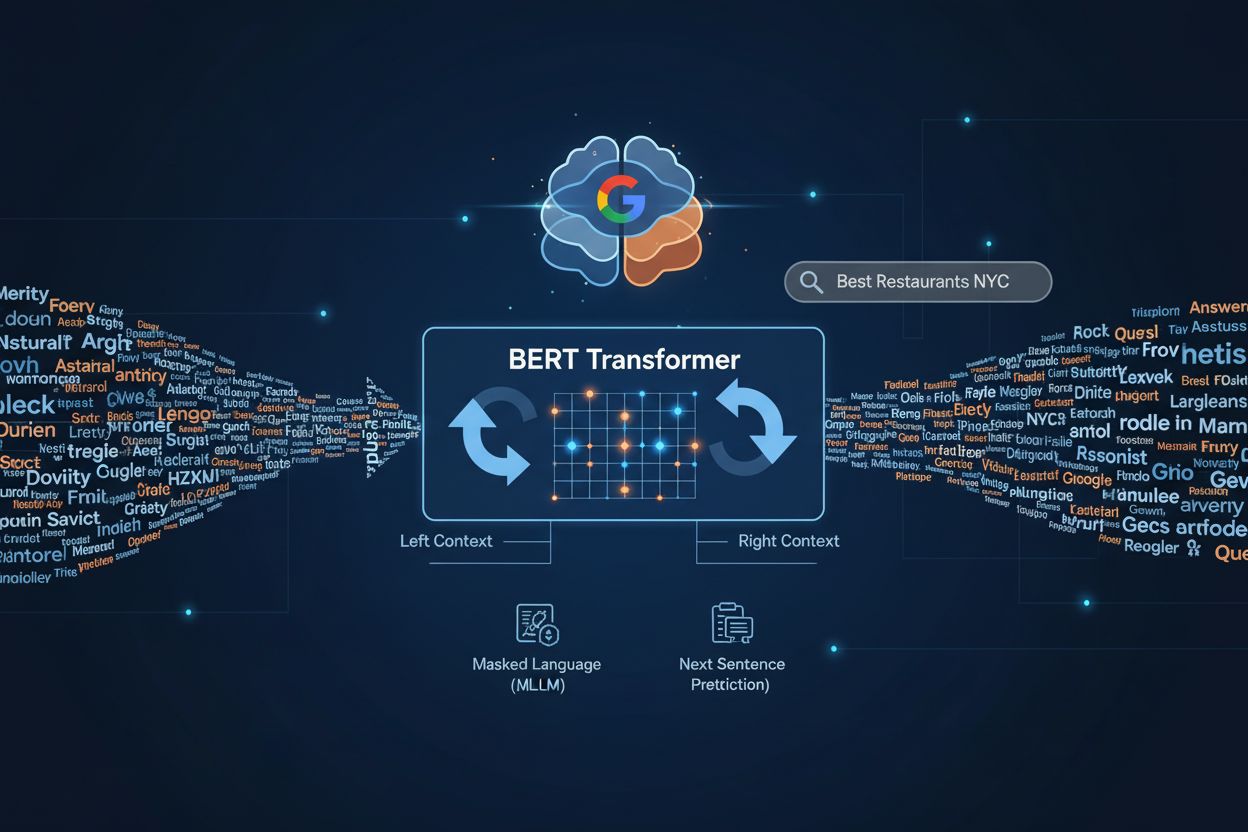

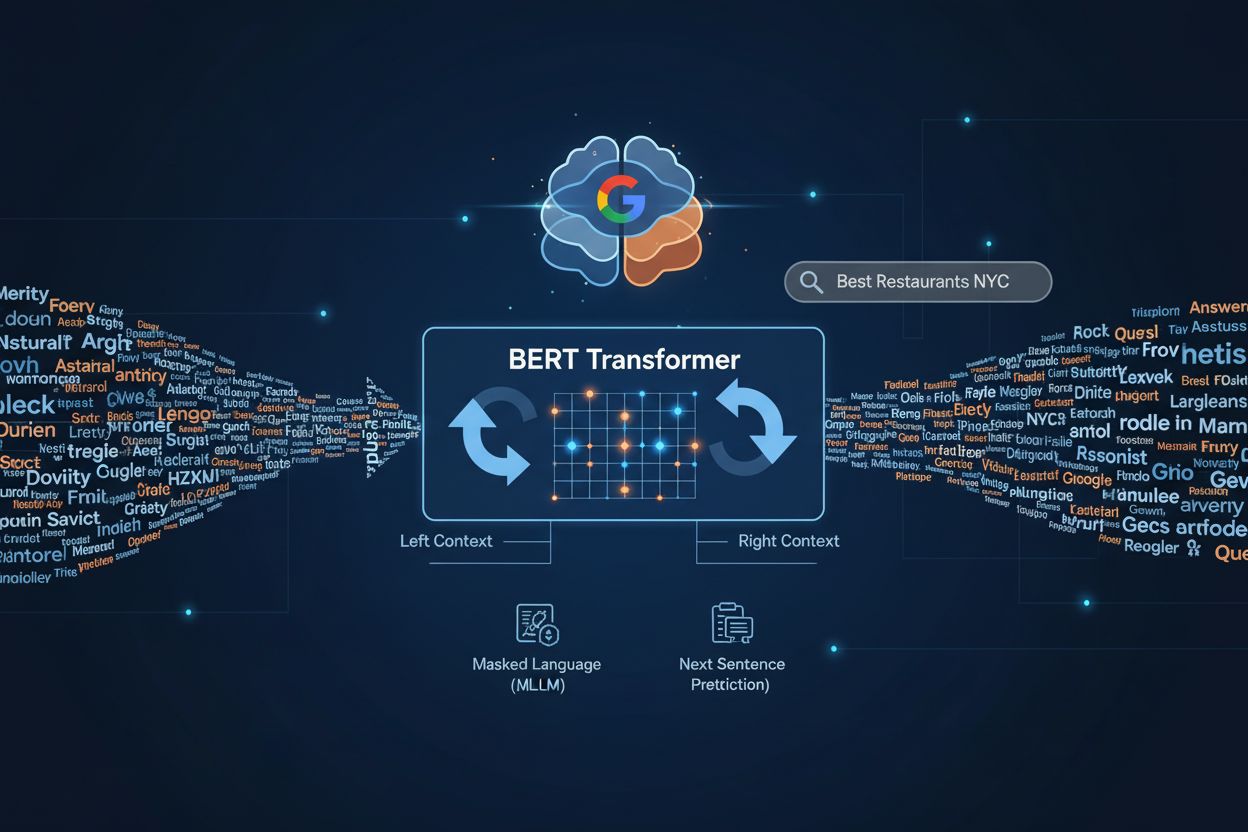

GoogleのBERTアップデートは、双方向トランスフォーマーを活用して検索クエリおよびランキングの自然言語理解を向上させる、2019年の主要なアルゴリズム変更について解説します。...

BERTについて相反する情報をよく目にします。

2019年当時、SEOを理解する上でBERTは最重要トピックでした。自然言語処理や文脈理解などです。

今はみんなGPT-4やClaude、Geminiの話ばかりで、正直混乱しています。

私の疑問:

ノイズを切り分けて、今コンテンツ最適化で本当に大事なことを知りたいです。

技術的な状況を整理します。

モデルの系譜:

Transformer (2017)

├── BERT系 (エンコーダ - テキスト理解)

│ ├── BERT (Google, 2018)

│ ├── RoBERTa (Meta)

│ ├── MUM (Google, 2021)

│ └── その他多数

└── GPT系 (デコーダ - テキスト生成)

├── GPTシリーズ (OpenAI)

├── Claude (Anthropic)

├── Gemini (Google)

└── その他多数

BERTはまだ重要ですが:

本当に重要なのは:

| 検索タイプ | 主なモデル傾向 | 注力ポイント |

|---|---|---|

| 従来のGoogle検索 | BERT/MUM(エンコーダ) | クエリとコンテンツの一致、意図理解 |

| AIオーバービュー | ハイブリッド | 抽出可能な回答 |

| ChatGPT/Perplexity | GPT系(デコーダ) | 包括的で引用可能なコンテンツ |

実務的な結論:

「BERT向け最適化」とは、常に自然で文脈豊かなコンテンツを書くことでした。それは今も変わりません。モデル名自体は最適化戦略に重要ではありません。

その通りです。「BERT向け最適化」は、要するに:

これらは今もすべて当てはまります。現代の言語モデルがテキストをどう理解するか、そのための最適化です。

全モデルに共通する原則:

これらは、BERTにはランキングで、GPT系モデルには引用抽出で、両方に有効です。

SEOの観点から見たBERTの進化です。

BERT時代(2019-2021):

MUM/AI時代(2021年以降):

実務的な変化:

正直、コンテンツ戦略はほとんど変わっていません。

アドバイスは常に:

BERT時代も、MUM時代も、GPT時代も同じです。

新しいのは:

引用/抽出レイヤーです。GPT系モデルは、コンテンツをクエリと一致させるだけでなく、抜き出して引用する必要があります。

そのためには

が求められます。ですが、自然言語の基盤は変わりません。

コンテンツ戦略の立場から。

クライアントへの説明の仕方:

「BERTはGoogleが“あなたの言いたいこと”を理解するためのもの。GPTはAIが“あなたが書いたこと”を利用するためのもの。」

実務的な違い:

従来検索(BERT/MUM的理解)の場合:

AI回答(GPT的抽出)の場合:

共通点:

どちらも

を重視します。

私の推奨:

「BERT向けかGPT向けか」ではなく、「言語モデルに“理解”され(BERT)、“抽出・引用”される(GPT)コンテンツをどう作るか」と考えましょう。

答えは同じです:明確で自然、構造的で専門的なコンテンツです。

研究の観点からの進化。

今のBERTの位置付け:

BERTは基礎的存在でした。双方向の文脈理解が有効だと業界に示しました。GoogleはBERTを「置き換え」たのではなく、進化させています。

進化の流れ:

Google検索に特化すると:

Googleはランキングスタックで複数のモデルを使っています:

これが意味すること:

戦略上、特定のモデル名は重要ではありません。大事なのは、すべてのモデルが:

これらの原則に最適化しましょう。モデル名にはこだわらなくてよいです。

テクニカルライティングの立場から。

BERTからAI時代で変わった執筆のポイント:

BERT時代の重視点:

AI時代に追加したこと:

変わらないこと:

私の実践ワークフロー:

BERTの原則が土台、AI最適化はその上の拡張です。

実務コンサルタントの視点。

クライアントに伝えるBERTについて:

「BERT自体を気にしなくていいです。現代の検索システムすべてに共通する原則に集中しましょう……」

変わらぬ原則:

AIで変わったこと:

追加で重視されるのは

結論:

「BERT最適化」は「自然に書き、質問に答える」のマーケティング表現でした。それは今も有効。加えてAIによる抽出最適化を重ねていくだけです。

データ観点から見たBERT関連の変化。

時代をまたいだコンテンツパフォーマンスの追跡:

2019-2025年の1,000記事を追跡しました:

BERT時代(2019-2021):

MUM/AI時代(2021-2025):

傾向:

自然言語で書く(=BERTの原則)は今も基礎です。ただしAI抽出のための構造化がプラスの効果を生みます。

実務的な示唆:

BERTの原則は捨てず、AIフレンドリーな構造を加えましょう。

私たちの利用ツール:

Am I Cited(AIによる引用傾向追跡)で、AIに最も引用されるコンテンツ形式を特定しています。自然言語だけでなく、どんな構造が効くかを把握できます。

おかげで混乱が解けました。まとめ:

BERTはまだ重要?

はい、ただし「基礎」としてであり、特定の最適化ターゲットではありません。BERTが示した原則(自然言語、文脈、意図)は今も不可欠です。

変化点:

今やっていること:

考え方のモデル:

BERT = 基礎(土台=理解) GPT = 上のレイヤー(抽出と引用)

どちらも本質的な質を重視。AI時代では構造要件が追加されただけです。

皆さん、スッキリしました。ありがとうございます。

Get personalized help from our team. We'll respond within 24 hours.

AIシステムがあなたのコンテンツをどのように理解し、引用しているかを追跡しましょう。異なる言語モデルでどのコンテンツ形式が最も効果的か確認できます。

GoogleのBERTアップデートは、双方向トランスフォーマーを活用して検索クエリおよびランキングの自然言語理解を向上させる、2019年の主要なアルゴリズム変更について解説します。...

BERTの概要、アーキテクチャ、用途、現在の関連性について学びます。BERTと最新の代替技術を比較し、なぜNLPタスクに不可欠であり続けるのかを理解しましょう。...

ベクトル検索と、それがAIコンテンツ発見をどのように支えるかについてのコミュニティディスカッション。セマンティックマッチングに向けたコンテンツ最適化を実践するテクニカルマーケターの実体験。...