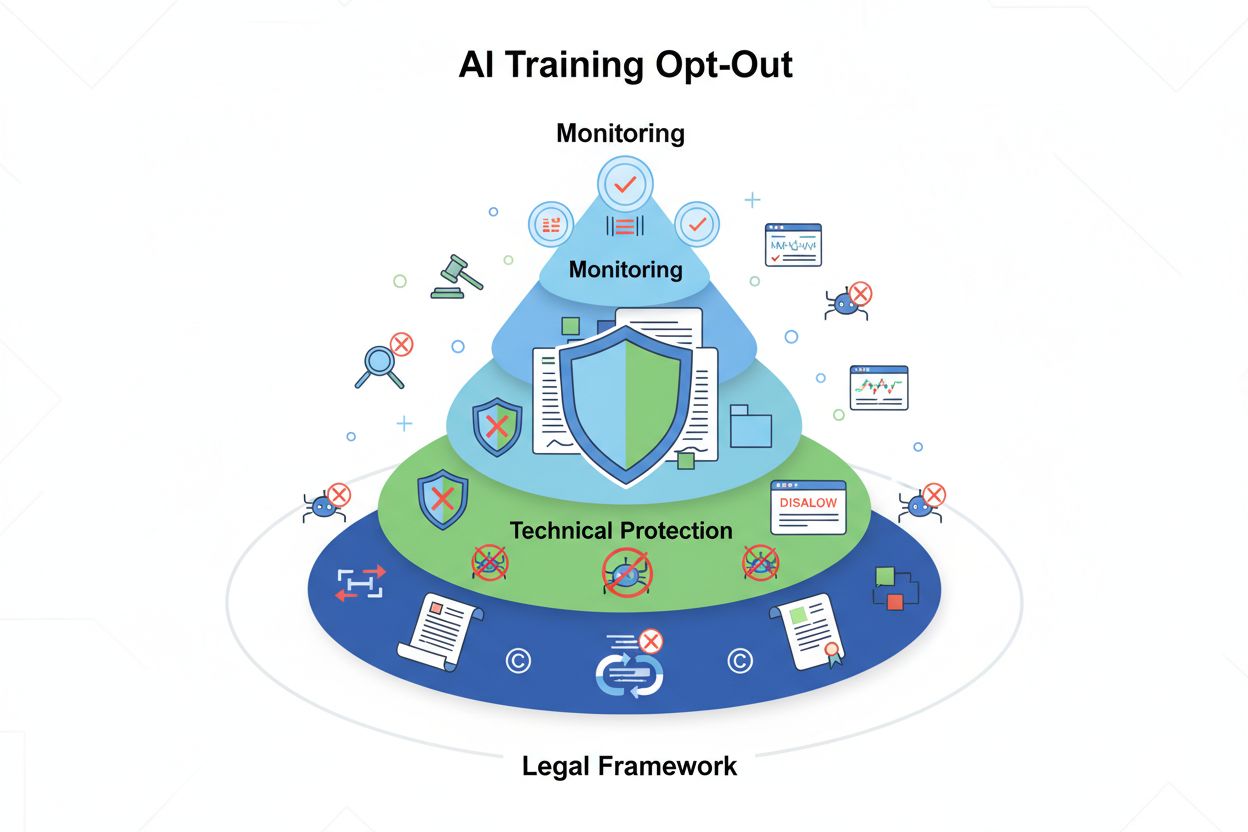

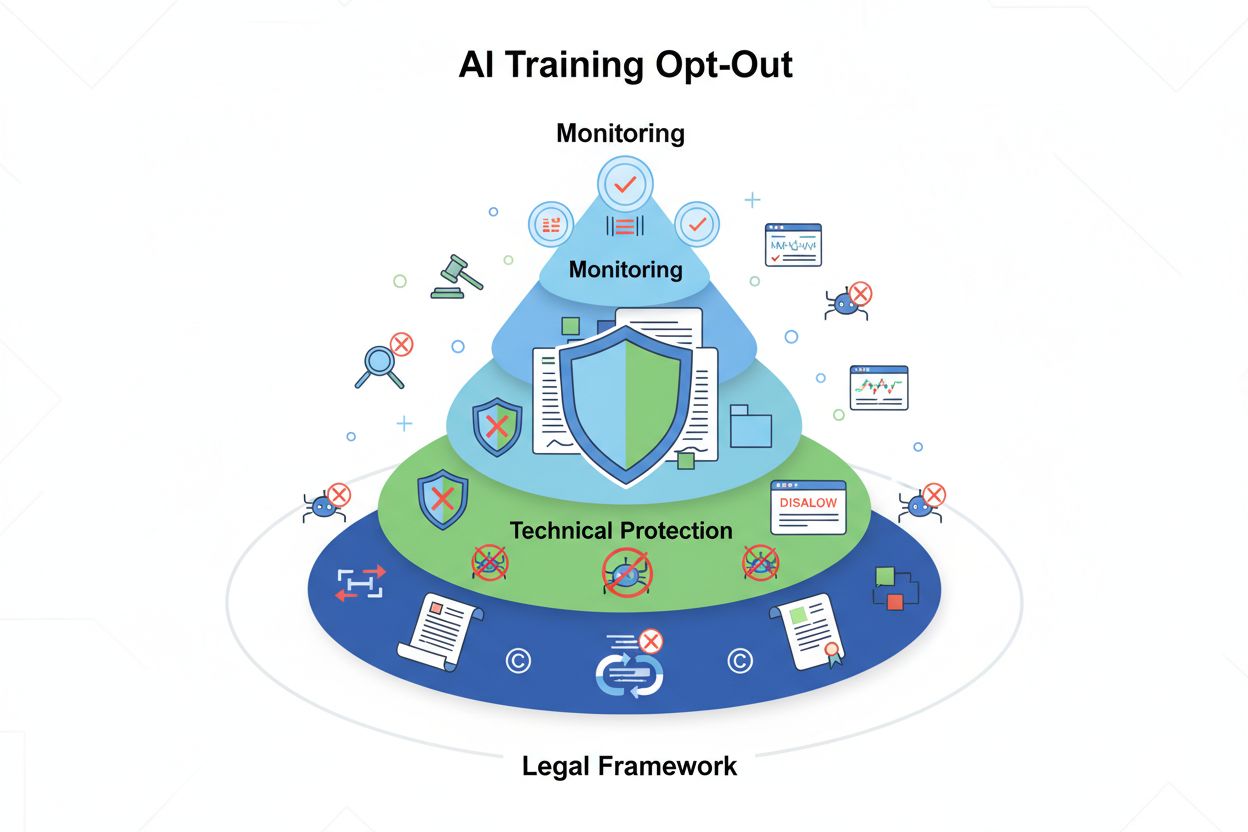

AIトレーニングオプトアウト

robots.txt、法的フレームワーク、LLMトレーニングデータセットでの不正使用からコンテンツを保護するためのベストプラクティスなど、AIトレーニングオプトアウトメカニズムについて学びましょう。...

ChatGPT、Perplexity、LinkedInなどの主要プラットフォームでAIトレーニングデータ収集をオプトアウトするための完全ガイド。AIモデルのトレーニングから自分のデータを守るための手順を学びましょう。

ほとんどの主要プラットフォームでは、アカウント設定にアクセスし、データ収集オプションを無効にすることでAIトレーニングをオプトアウトできます。ウェブサイトの場合は、robots.txtファイルを使用してAIクローラーをブロックします。方法はプラットフォームごとに異なり、ChatGPT、Perplexity、LinkedInには直接切り替えスイッチがあり、他のプラットフォームではメールでの申請やコンテンツ削除が必要な場合もあります。

AIトレーニングとは、人工知能企業が言語モデルやAIシステムを向上させるため、インターネットやユーザーのやり取りから大量のデータを収集するプロセスです。ChatGPT、Perplexity、ソーシャルメディアなどのサービスを利用すると、あなたの会話や投稿、やり取りが自動的に収集され、これらのAIモデルのトレーニングに使われることが多くあります。これはほとんどのプラットフォームでデフォルトとなっており、特にオプトアウトしない限り、あなたのデータが明確な同意なしにAIシステム向上のために利用されます。収集されるデータには、検索クエリ、会話履歴、アップロードした文書、サービス利用中に共有した個人情報などが含まれます。

このプロセスを理解することは重要です。なぜなら、AIトレーニングデータはAIモデルの学習や応答に直接影響するからです。企業は、こうしたデータ収集がより正確で役立つAIシステムの開発に役立つと主張しています。しかし、多くのユーザーは、個人情報や創作物、機密ビジネスデータが補償や明確な許可なしに利用されることに対して正当なプライバシー上の懸念を抱えています。良いニュースとして、現在ほとんどの主要プラットフォームではオプトアウトの方法が提供されていますが、その手順はサービスによって大きく異なります。

OpenAIのChatGPTは最も広く利用されているAIサービスの1つであり、デフォルトでユーザーデータを収集してモデル向上に利用しています。アカウントにログインせずにChatGPTを利用した場合、会話は自動的にトレーニング目的で収集されます。ただし、アカウントを持っている場合は、簡単な手順でこのデータ収集を無効にできます。

ChatGPTでオプトアウトするには、まずchatgpt.comでアカウントにログインし、画面右上のプロフィールアイコンを探します。このアイコンをクリックしてメニューを開き、設定を選択します。設定メニューに入ったら、データコントロールセクションに進みます。ここにはアカウントのプライバシー関連の設定がまとめられています。この中にある**「すべての人のためにモデルを改善」というオプションが、OpenAIがあなたの会話をトレーニングに使用するかどうかを管理する設定です。このスイッチを「オフ」に切り替える**ことで、今後の会話がAIトレーニングに使われるのを防げます。

OpenAIのDALL-E画像生成器の場合は、トレーニングデータセットから画像を削除するための専用フォームが用意されています。DALL-Eで作成した画像を今後のトレーニングデータから削除したい場合、OpenAIのウェブサイトで、名前・メールアドレス・画像所有の確認・特定画像の詳細を入力して申請できます。大量の画像削除リクエストの場合は、OpenAIはrobots.txtファイルにGPTBotを追加する方法を推奨しており、多数の画像管理にはこの方が効率的です。

| プラットフォーム | オプトアウト方法 | 難易度 | 効果 |

|---|---|---|---|

| ChatGPT | 設定 > データコントロール > オフに切り替え | 簡単 | 高い |

| DALL-E | 削除申請フォーム送信 | 中程度 | 高い |

| Perplexity | アカウント設定 > AIデータ保持 | 簡単 | 高い |

| 専用設定ページ | 簡単 | 高い | |

| X(Twitter) | Grok設定ページ | 簡単 | 高い |

Perplexity AIはAI搭載の検索エンジンで、利用者のやり取りをモデル向上のために収集しています。ChatGPTと同様、Perplexityはサービス利用時に検索クエリや会話履歴をデフォルトで保存します。プラットフォームはこのデータを使って検索アルゴリズムを改善し、より良い回答を提供しています。検索履歴の追跡やトレーニング利用が気になる場合、Perplexityでは簡単なオプトアウト設定が用意されています。

Perplexityでデータ収集を無効にするには、アカウントにログインし、アカウント設定に進みます。設定メニュー内で**「AIデータ保持」**のトグルスイッチを探してください。この設定が、Perplexityがプロンプトや検索クエリをトレーニング目的で保存するかどうかを管理します。このスイッチをオフにすることで、自分のデータがモデル改善に利用されるのを防げます。この設定は今後のやり取りにのみ適用されるため、設定前に収集されたデータは引き続きトレーニングに使われる可能性がある点に注意してください。

ソーシャルメディアプラットフォームは、AIトレーニングのオプトアウトに関してより複雑な環境です。LinkedIn(Microsoft傘下)は、ユーザーが自分のデータをAIトレーニングに利用されないよう管理できるよう大幅な改善を行いました。プラットフォームでは、投稿やプロフィール情報がAIモデルのトレーニングに使われるのを拒否できます。LinkedInのデータ設定ページにアクセスし、AI改善オプションをオフに切り替えてください。特に独自情報やビジネス戦略、機密情報を共有している専門家にとって、この設定は重要です。

Meta社のプラットフォーム(FacebookやInstagram)では、現時点でAIトレーニングのためのシンプルな切り替えスイッチは用意されていません。Metaは、ヘルプセンターを通じて正式な申請を行うことを求めています。自分のデータをAIトレーニングに使ってほしくない旨を申請できますが、Metaの対応は他プラットフォームより不透明です。同社は、ユーザーデータをAIシステムや生成AI機能の向上に利用していると述べており、オプトアウト申請が即時または完全に反映される保証はありません。

X(旧Twitter)は、独自のAIモデルGrokを導入し、プラットフォーム上のデータをトレーニングに利用しています。ただし、XではGrokのトレーニング用に投稿を利用しないようにする専用の設定ページが用意されています。設定とプライバシーに進み、Grokタブを見つけてデータ共有のオプションをオフにしてください。これにより、ツイートややり取りがGrokのトレーニングに使われるのを防げますが、Xが他目的でデータを利用する可能性は残ります。

ウェブサイトやブログを運営している場合は、AIクローラーによるコンテンツのスクレイピングを防ぐための追加の手段があります。最も一般的なのは、robots.txtファイルを使用する方法です。これはウェブサイトのルートディレクトリに配置するシンプルなテキストファイルで、ウェブクローラーにどのページへアクセスできるかを指示します。検索エンジンボットやAIクローラー向けの指示書となります。

OpenAIのGPTBotクローラーをブロックするには、robots.txtファイルに以下の行を追加してください。

User-agent: GPTBot

Disallow: /

これにより、OpenAIのクローラーはあなたのウェブサイトのページにアクセスできなくなります。同様に、GoogleのAIクローラー(Google-Extended。BardやVertex AIのトレーニング用)をブロックするには、次のようにします。

User-agent: Google-Extended

Disallow: /

複数のAIクローラーを同時にブロックしたい場合は、それぞれを個別に記載するか、ワイルドカードで全てのボットをブロックできます。

User-agent: *

Disallow: /

ただし、robots.txtはあくまで自主的なルールであることを理解しておきましょう。ほとんどの正規AI企業や検索エンジンはこれを守りますが、一部のボットは無視してスクレイピングを続ける場合があります。より強固な保護を望む場合は、パスワード保護、有料ウォール、ログイン必須などを導入しましょう。また、WordPress.com、Substack、SquarespaceなどのプラットフォームにはAIトレーニングをブロックするオプションがあり、各サービスの設定パネルから有効化できます。

ほとんどのプラットフォームでAIトレーニングのオプトアウトは可能ですが、いくつか重要な制限があります。まず、オプトアウトは通常「今後のデータ収集」のみに有効です。設定を無効にする前にスクレイピングされたデータや収集済みのデータは、引き続きトレーニングに利用される可能性があります。これは、すでにオンラインで公開・インデックス化されたコンテンツに特に当てはまります。

次に、robots.txtファイルやプラットフォームのオプトアウト設定には法的拘束力がありません。一部のAI企業や悪意のあるボットは、こうした指示を無視してスクレイピングを続ける可能性があります。実際、robots.txtルールを守らないAIクローラーが存在することも報告されており、対策を施してもコンテンツがトレーニングに使われるリスクは残ります。

さらに、オプトアウト手段の有効性はプラットフォームごとに大きく異なります。OpenAIやLinkedInなどは明確で使いやすい切り替えスイッチを提供していますが、Metaのように手動で申請しなければならず、結果も不透明な場合もあります。また、多くの無料サービスはデフォルトでデータを収集しており、オプトアウトには有料プランの契約が必要な場合もあります。

最後に、国際的な法規制がデータ収集の実態に影響します。欧州連合のユーザーは、GDPRや新しいEU AI法によって、AIトレーニングへの個人データ利用が強く制限されています。これに対し、他地域のユーザーは保護が弱い場合が多く、プライバシー設定を積極的に管理することがより重要となります。

複数のプラットフォームで体系的にデータを保護するため、以下の総合チェックリストをご活用ください。

AIトレーニングをオプトアウトするだけでなく、AIが生成した回答に自分のコンテンツがどのように表示されているかを監視することも同じくらい重要です。たとえトレーニングをオプトアウトしても、過去に公開したコンテンツがAIの回答で引用・参照されることがあります。こうしたAIシステムでのブランド監視は、ビジネスやクリエイターにとって非常に重要です。

ChatGPT、Perplexity、GoogleのGeminiなどのプラットフォームで、自分のブランド、ドメイン、URLがAI回答にどのように現れているかを把握することで、オンラインでの評判管理や適切な帰属表示の確保が可能です。これらの出現を追跡することで、コンテンツの可視性向上の機会を特定したり、ブランドが正確に表現されているかを確認したり、AI生成回答内で誤用や誤解があった場合には対応策を講じることができます。

robots.txt、法的フレームワーク、LLMトレーニングデータセットでの不正使用からコンテンツを保護するためのベストプラクティスなど、AIトレーニングオプトアウトメカニズムについて学びましょう。...

ChatGPT検索がウェブクローラー、インデックス作成、データプロバイダーとの提携を活用し、正確で引用付きの回答を提供するためにインターネットからリアルタイム情報を取得する方法を学びましょう。...

ChatGPTがどこから学習データを得ているのか、引用元の仕組み、ナレッジカットオフ日、そしてAI引用を監視することがブランドにとってなぜ重要なのかを解説します。...

クッキーの同意

閲覧体験を向上させ、トラフィックを分析するためにクッキーを使用します。 See our privacy policy.