AI可視性サービスの内容:範囲と成果物

AI可視性サービスが提供するものを発見:ブランドモニタリング、引用追跡、分析、競合ベンチマーク、コンテンツ最適化、ChatGPT・Perplexity・Google AIなどでの技術監査。...

企業全体でAIシステムの監視、追跡、透明性の確保に専念する組織単位。AIシステムのパフォーマンス、コンプライアンスステータス、リスク態勢のリアルタイムの可視性を提供しながら、AIガバナンスと監督の中央機関として機能します。

企業全体でAIシステムの監視、追跡、透明性の確保に専念する組織単位。AIシステムのパフォーマンス、コンプライアンスステータス、リスク態勢のリアルタイムの可視性を提供しながら、AIガバナンスと監督の中央機関として機能します。

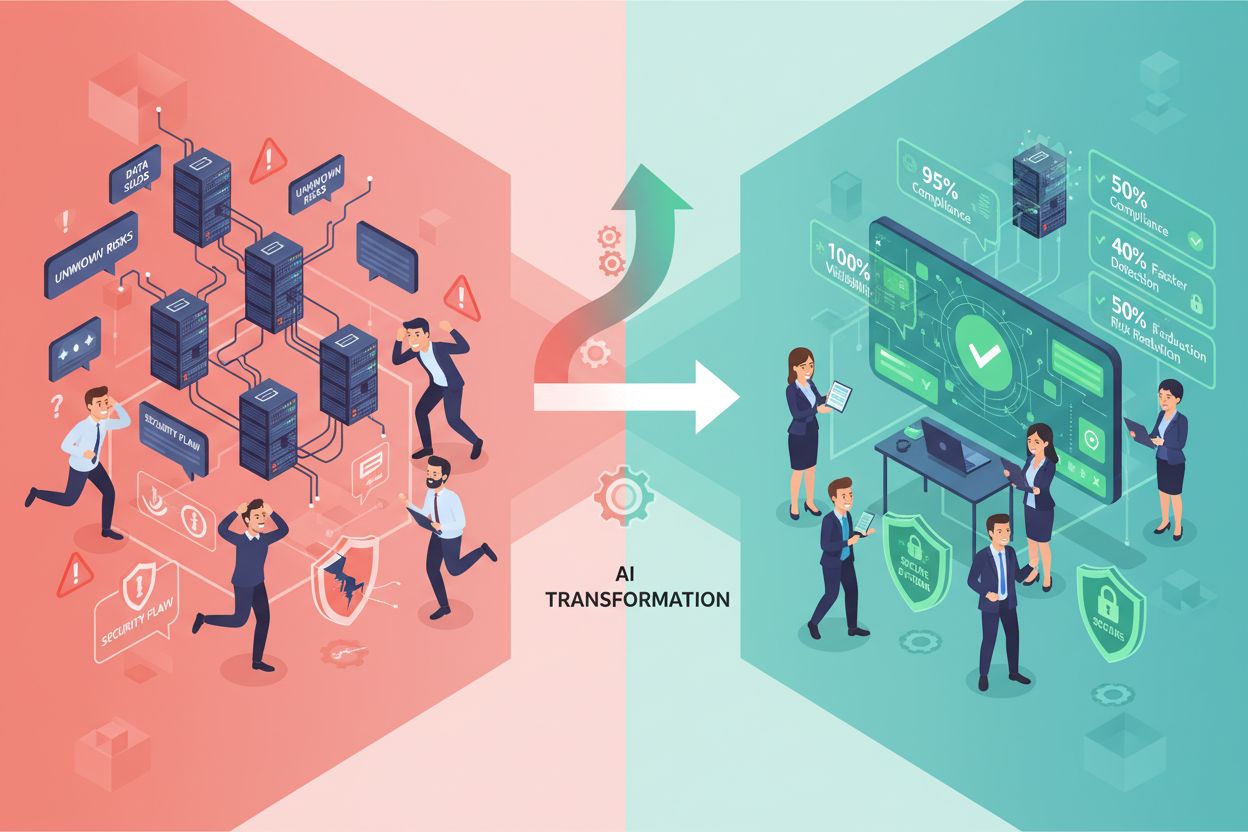

AI可視性センターオブエクセレンス(CoE)は、企業全体に展開された人工知能システムの包括的な監視、追跡、透明性を提供するために設立された専門的な組織単位です。このセンターは、AIシステムがどのように運用され、どのデータを処理し、ビジネス成果とステークホルダーの利益にどのように影響するかについてのリアルタイムの可視性を維持するための中央機関として機能します。主な目的は、組織全体のAIシステムのステータス、パフォーマンス指標、コンプライアンス態勢の単一の真実のソースを作成することです。AI可視性機能を統合することで、センターはリーダーシップがAI展開の全範囲とそれに関連するリスクを理解することを可能にします。AI可視性CoEは、技術的なAI運用と経営ガバナンスの間の重要な橋渡しとして機能し、意思決定者がAIシステムの動作とパフォーマンスについて正確でタイムリーな情報を持つことを保証します。

AI可視性センターオブエクセレンスは、エンタープライズAIガバナンスに不可欠ないくつかのコア責任を維持します。これには、組織全体で使用されているすべてのAIアプリケーション、モデル、システムをカタログ化する包括的なAIシステムインベントリの開発と維持が含まれます。センターは、精度指標、レイテンシ、リソース使用率、出力品質を含むAIシステムパフォーマンスの継続的監視を担当します。コンプライアンス追跡は別の重要な機能を表し、AIシステムが規制要件、内部ポリシー、業界標準を遵守することを保証します。センターは継続的なリスク評価と管理を実施し、モデルドリフト、データ品質の低下、バイアスの出現、セキュリティの脆弱性などの潜在的な問題を特定します。さらに、AI可視性CoEは、様々な組織レベルのステークホルダーにAIシステムステータスを伝達する定期的なレポートとダッシュボードを作成します。センターはまた、AI関連の問題に対するインシデント対応を管理し、すべてのAIシステムの変更と更新の文書を維持します。

| 機能 | 従来のAI CoE | AI可視性CoE |

|---|---|---|

| 焦点 | モデル開発とデプロイ | リアルタイム監視と透明性 |

| 主な活動 | AIシステムの構築とトレーニング | AIシステム動作の追跡と観察 |

| 主要指標 | モデルの精度とパフォーマンス | システムの可視性、コンプライアンス、リスク |

| ステークホルダーの焦点 | データサイエンティストとエンジニア | 経営リーダーとコンプライアンスチーム |

| レポート頻度 | プロジェクトベース | 継続的かつリアルタイム |

| リスク管理 | 開発フェーズのリスク軽減 | 運用上および継続的なリスク監視 |

AI可視性センターオブエクセレンスは、AIシステムの運用と影響の複数の次元にわたる包括的な監視を提供します。センターは以下を含む重要な監視カテゴリを追跡します:

これらの監視機能により、組織はAIポートフォリオ全体のAIシステムの健全性と動作についての継続的な認識を維持できます。

AI可視性センターオブエクセレンスは、より広いAIガバナンスフレームワーク内の重要なコンポーネントとして機能し、組織のAI戦略の運用上の目と耳として機能します。センターは、潜在的なリスクに関するリアルタイムデータを提供し、新たな問題のより迅速な特定と軽減を可能にすることで、AIリスク管理機能を直接サポートします。すべてのAIシステムが適用される法律、規制、業界標準への準拠を維持し、規制審査に必要な監査証跡と文書を提供することで、コンプライアンスと規制管理と統合します。AI可視性CoEは、AIシステムの決定のバイアス、公平性の問題、意図しない結果を監視することで倫理的AIイニシアチブをサポートします。センターはAI戦略と計画機能と連携して、AI投資、システムの廃止、ポートフォリオの最適化に関する決定を通知する洞察を提供します。透明性と可視性を維持することで、AI可視性CoEは組織が責任あるAI実践を実装し、ステークホルダー、規制当局、一般市民に対する説明責任を示すことを可能にします。

AI可視性センターオブエクセレンスは、包括的な監視と透明性を達成するために専門的な技術プラットフォームとツールを活用します。Datadog、New Relic、専門的なAI可観測性ソリューションなどのAI監視プラットフォームは、AIシステムパフォーマンスのリアルタイムダッシュボードとアラート機能を提供します。監査ログとデータリネージツールは、データフロー、モデルの入力と出力、システムアクセスパターンを追跡し、コンプライアンス文書を維持し、フォレンジック分析を可能にします。アナリティクスとビジネスインテリジェンスプラットフォームは、監視データを集約し、異なるステークホルダーオーディエンス向けに実行可能な洞察に変換します。機械学習システム向けに特別に設計されたモデル監視ソリューションは、パフォーマンス低下、データドリフト、予測品質の問題を検出します。セキュリティとアクセス制御システムは、AIシステムとその出力にアクセスできる人を管理し、すべてのインタラクションの詳細なログを記録します。ガバナンスとリスク管理プラットフォームは、AIシステムの文書、リスク評価、コンプライアンス証拠の集中リポジトリを提供します。技術スタックは、AI固有の監視と可視性に必要な専門機能を提供しながら、既存のエンタープライズシステムとシームレスに統合する必要があります。

AI可視性センターオブエクセレンスは通常、専門的な役割と責任を持つ学際的なチームで構成されます。AI可視性リードまたはセンターディレクターは、戦略的監督を提供し、ステークホルダー関係を管理し、組織のガバナンス目標との整合性を確保します。AI監視スペシャリストは、監視システムを設計・実装し、ダッシュボードを設定し、AI可視性のための技術インフラを維持します。コンプライアンスアナリストは、監視活動が規制要件を満たすことを保証し、監査文書を維持し、コンプライアンスおよび法務チームと調整します。セキュリティアナリストは、AIシステムに関連するセキュリティ脅威、不正アクセス、潜在的なデータ侵害の検出と対応に焦点を当てています。データエンジニアは、データパイプラインを管理し、監視システムのデータ品質を確保し、データ収集と分析のための技術インフラを維持します。ビジネスアナリストは、技術的な監視データを経営ステークホルダー向けのビジネス関連の洞察とレポートに変換します。チームサイズと特定の役割分布は、組織のAI成熟度レベル、運用中のAIシステムの数、規制環境の複雑さによって異なります。

AI可視性センターオブエクセレンスを設立することは、組織に実質的な有形および戦略的利益をもたらします。センターは以下を通じて測定可能な価値を提供します:

これらの利益が組み合わさって、組織に大きな投資収益率と戦略的価値を生み出します。

AI可視性センターオブエクセレンスを設立するには、慎重な計画と段階的な実装が必要です。組織は、既存のAIシステムをインベントリ化し、現在の監視機能を評価し、可視性とガバナンスのギャップを特定する発見フェーズから始めるべきです。計画フェーズでは、センターの憲章の定義、必要な役割とスキルの特定、技術プラットフォームの選択、成功指標の確立が含まれます。リソース要件には通常、専任の人員(組織の規模に応じて5-15人)、監視プラットフォームとツールへの技術投資、継続的なトレーニングと開発が含まれます。実装タイムラインは通常、初期能力展開に6-12ヶ月かかり、その後数年にわたって継続的な強化と拡張が行われます。一般的な課題には、監視を懸念するAI開発チームからの抵抗、レガシーシステムとの統合の困難さ、AI監視とガバナンスのスキルギャップ、多様なAI技術とユースケースの監視の複雑さが含まれます。成功には、強力な経営スポンサーシップ、センターの価値についての明確なコミュニケーション、AI開発チームとビジネスステークホルダーとの協力的な関係が必要です。

一般的な監視プラットフォームを超えて、専門的なAI可視性監視ツールが、AIシステムが外部コンテンツやブランドをどのように参照、引用、活用するかを追跡する独自の課題に対処するために登場しています。これらのソリューションは、AIシステムの出力を監視して、AIモデルがさまざまなソースからの情報をどのように組み込み、帰属するかを理解することに焦点を当てています。AmICited.comのようなAI回答監視プラットフォームは、AIシステム(大規模言語モデルや生成AIアプリケーションを含む)が回答でブランド、コンテンツ、ソースをどのように参照するかを追跡するための専門機能を提供します。これらのツールは、AIシステムによって処理されたときにコンテンツが受ける可視性と帰属を理解するのに役立ち、AIシステムがユーザーの主要な情報ソースになるにつれてますます重要になっています。このような監視ソリューションは、AIシステムが外部情報エコシステムとどのように相互作用し、出力でさまざまなエンティティとソースをどのように表現するかについての洞察を提供することで、従来のAIシステム監視を補完します。

従来のAI CoEはAIモデルの開発、トレーニング、デプロイに焦点を当てていますが、AI可視性CoEは運用中のAIシステムの監視、追跡、透明性の確保に特化しています。AI可視性CoEは、システムパフォーマンス、コンプライアンス、リスクのリアルタイムの監視を提供し、AIガバナンスの運用上の目と耳として機能します。

主な責任には、AIシステムインベントリの維持、パフォーマンス指標の継続的監視、コンプライアンス追跡、リスク評価と管理、インシデント対応、ステークホルダー向けのレポートとダッシュボードの作成が含まれます。センターは、すべてのAIシステムが組織のガバナンスポリシーに従って可視化、追跡、管理されることを保証します。

AI可視性CoEは、GDPRやCCPAなどの規制へのAIシステムの準拠を継続的に監視し、規制審査に必要な監査証跡と文書を提供し、すべてのAIシステムが適用される業界標準を満たすことを保証します。この予防的アプローチにより、コンプライアンス違反と規制リスクが軽減されます。

必須の技術には、リアルタイムダッシュボード用のAI監視プラットフォーム、データフローを追跡するための監査ログとデータリネージツール、洞察のためのアナリティクスプラットフォーム、パフォーマンス低下を検出するためのモデル監視ソリューション、アクセス制御のためのセキュリティシステム、文書とコンプライアンス証拠のためのガバナンスプラットフォームが含まれます。

主要な役割には、戦略的監督のためのAI可視性リード、技術的実装のためのAI監視スペシャリスト、規制整合性のためのコンプライアンスアナリスト、脅威検出のためのセキュリティアナリスト、インフラのためのデータエンジニア、ステークホルダーレポートのためのビジネスアナリストが含まれます。チームサイズは組織のAI成熟度と複雑さによって異なります。

初期能力展開には通常6-12ヶ月かかり、発見、計画、技術選定、実装フェーズが含まれます。タイムラインは組織の規模、既存の監視インフラ、利用可能なリソース、規制の緊急性によって異なります。初期実装後も継続的な強化と拡張が続きます。

主なメリットには、AIシステムの障害やセキュリティ脅威の早期検出、継続的な規制コンプライアンスの保証、より速いインシデント検出と対応、包括的な可視性による意思決定の改善、自動化による運用効率、ステークホルダーの信頼、コスト最適化、自信を持ったAI展開による競争優位性が含まれます。

AI可視性CoEはAIガバナンスの重要な運用コンポーネントとして機能し、リアルタイムデータを通じてリスク管理をサポートし、コンプライアンス監視を可能にし、バイアスと公平性を追跡することで倫理的AIイニシアチブをサポートし、AI戦略と計画のための洞察を提供します。技術的なAI運用と経営ガバナンスの間の橋渡しとして機能します。

AmICited.comのAI可視性モニタリングプラットフォームで、AIシステムがブランドをどのように引用し参照するかを発見しましょう。ChatGPT、Perplexity、Google AIオーバービュー、その他のAIシステム全体でのプレゼンスを追跡します。

AI可視性サービスが提供するものを発見:ブランドモニタリング、引用追跡、分析、競合ベンチマーク、コンテンツ最適化、ChatGPT・Perplexity・Google AIなどでの技術監査。...

エンタープライズAI可視化戦略とは何か、なぜ大規模組織に包括的な監視・追跡・ガバナンスのアプローチが必要なのかを学びましょう。効果的なAI可視化を実現するためのフレームワーク、技術基盤、ベストプラクティスを紹介します。...

ヘルプセンターが、構造化Q&Aコンテンツ、FAQスキーママークアップ、ChatGPT・Perplexity・Gemini向けの戦略的コンテンツ最適化により、AIでの可視性をどのように高めるかをご紹介します。...

クッキーの同意

閲覧体験を向上させ、トラフィックを分析するためにクッキーを使用します。 See our privacy policy.