GPT-5

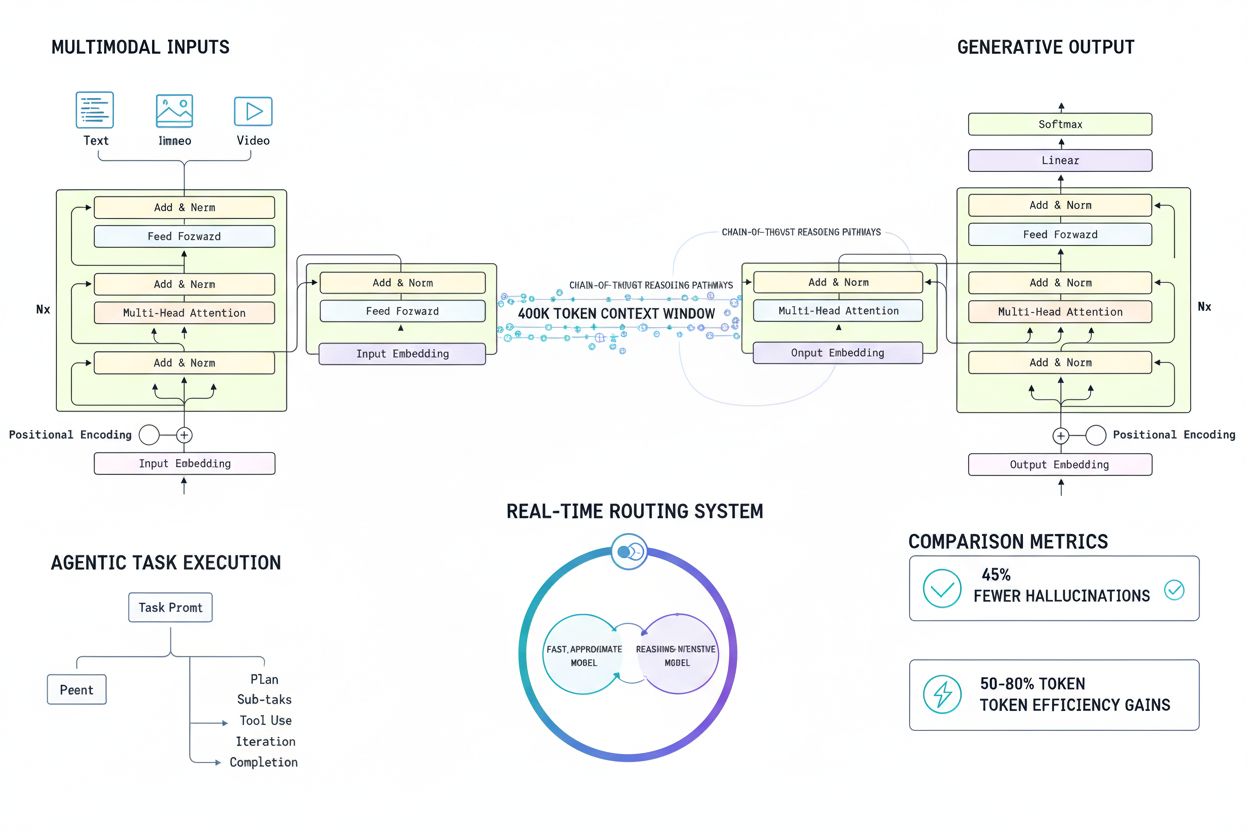

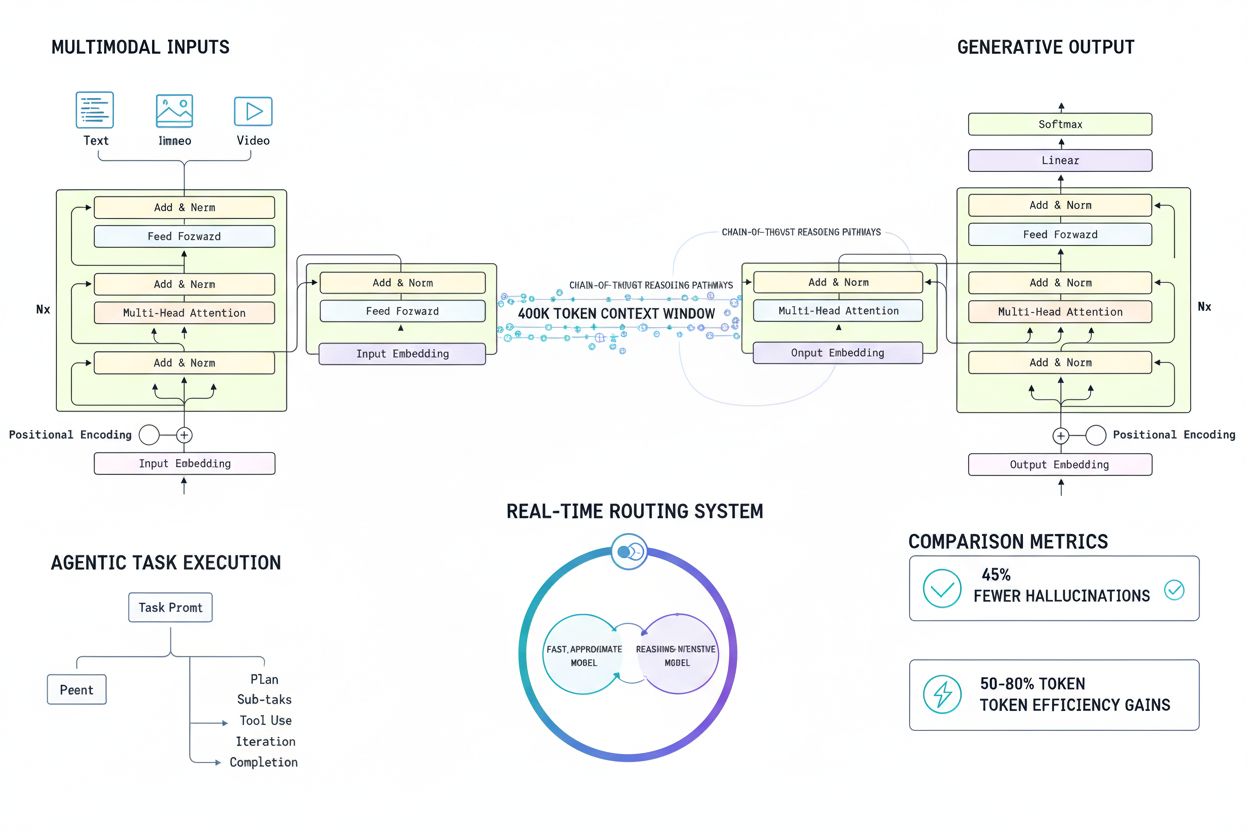

GPT-5は2025年8月にリリースされたOpenAIの最新LLMで、40万コンテキストウィンドウ、45%のハルシネーション削減、マルチモーダル機能、統合推論アーキテクチャにより、複雑なAIタスクやブランドモニタリングに対応します。...

GPT-4はOpenAIによる第4世代の大規模言語モデルであり、初のマルチモーダルLLMとしてテキストと画像の両方の入力を処理し、人間レベルの応答を生成できるモデルです。2023年3月にリリースされ、GPT-4は128Kのコンテキストウィンドウ、向上した推論能力、そして前世代のGPT-3.5と比較して強化された安全機能を備え、人工知能分野における大きな進化を示しています。

GPT-4はOpenAIによる第4世代の大規模言語モデルであり、初のマルチモーダルLLMとしてテキストと画像の両方の入力を処理し、人間レベルの応答を生成できるモデルです。2023年3月にリリースされ、GPT-4は128Kのコンテキストウィンドウ、向上した推論能力、そして前世代のGPT-3.5と比較して強化された安全機能を備え、人工知能分野における大きな進化を示しています。

GPT-4(Generative Pre-trained Transformer 4)はOpenAIによる第4世代の大規模言語モデルであり、人工知能開発における画期的な進歩を表します。2023年3月にリリースされたGPT-4は、初のマルチモーダル大規模言語モデルであり、テキストと画像の両方の入力を受け付け、洗練されたテキスト出力を生成できます。前世代のGPT-3.5はテキストのみを処理していましたが、GPT-4は自然言語処理とコンピュータビジョン機能を組み合わせて、テキスト情報とともに画像も理解・分析できます。このブレークスルーモデルは、数多くの専門・学術ベンチマークで人間レベルのパフォーマンスを示し、企業によるAI駆動コンテンツ生成・分析・意思決定のアプローチを根本的に変えつつあります。GPT-4の意義は単なる能力向上にとどまらず、AIシステムが世界とどのように相互作用・理解できるかというパラダイムシフトを象徴しています。

GPT-4の開発は、Googleの研究者が2017年に発表した画期的な論文「Attention Is All You Need」で導入されたトランスフォーマーアーキテクチャに基づいています。OpenAIはGPT-1からGPT-4まで指数関数的なモデルの高度化と能力向上を実現してきました。2020年リリースのGPT-3は1750億パラメータで学習され、現代の大規模言語モデルの基盤となりました。しかし、OpenAIはGPT-4の学習パラメータ数を公開していません。これはAI競争の激化や同社の営利化への移行の影響もあります。GPT-4が100兆パラメータ以上を使っているという憶測もありましたが、CEOのサム・アルトマンはこれを否定しています。モデル開発には安全性研究、人間のフィードバック、現実環境でのテストが広範囲に取り入れられ、誤情報やバイアス、有害出力といった従来の課題に対応しました。GPT-4はGPT-3.5のリリースから約18か月にわたる集中的な研究開発の成果であり、数百万件のユーザーインタラクションや専門家協議の知見が反映されています。

GPT-4のアーキテクチャは、従来モデルから大きく進化し、「Mixture of Experts(MoE)デザイン」を採用しています。この高度なニューラルネットワークアーキテクチャは、異なる種類の情報処理に最適化された複数の専門サブネットワークを活用します。GPT-3.5のような単一の密集型ネットワークとは異なり、MoEアプローチによりGPT-4は異なる入力を最適なエキスパートネットワークに効率的に振り分け、性能と計算効率を同時に向上させています。マルチモーダル機能はテキストエンコーダとVision Transformer(ViT)画像エンコーダの組み合わせで実現され、テキスト同様に高度な画像処理が可能です。アテンションメカニズムも大幅に改善され、テキスト・画像双方で離れた概念間の関係理解能力が向上しました。この革新的なアーキテクチャにより、GPT-4は長大な情報列にわたる一貫性維持や、複数モダリティ間の複雑な関係性の理解が可能です。128,000トークンのコンテキストウィンドウはGPT-3.5の8,000トークン制限と比べて8倍の短期記憶容量を持ち、全文書・長い会話・大規模コードリポジトリの分析でも文脈を失いません。

| 項目 | GPT-4 | GPT-3.5 | GPT-4 Turbo | Claude 3 |

|---|---|---|---|---|

| 入力モダリティ | テキスト+画像 | テキストのみ | テキスト+画像 | テキストのみ |

| コンテキストウィンドウ | 128Kトークン | 8Kトークン | 128Kトークン | 100Kトークン |

| 司法試験成績 | 90パーセンタイル | 10パーセンタイル | 88パーセンタイル | 88パーセンタイル |

| 生物学オリンピック | 99パーセンタイル | 31パーセンタイル | 97パーセンタイル | 96パーセンタイル |

| 安全機能 | 許可されていないコンテンツ応答が82%減 | 基準 | 強化 | 同等 |

| 事実精度 | 40%向上 | 基準 | 改善 | 類似 |

| パラメータ(公開) | 未公開 | 1,750億 | 未公開 | 未公開 |

| リリース日 | 2023年3月 | 2022年11月 | 2023年11月 | 2024年3月 |

| リアルタイムインターネットアクセス | あり(2023年9月更新) | 限定的 | あり | あり |

| API価格 | 高価格 | 低価格 | 中価格 | 競争力あり |

GPT-4のビジョン機能は、従来のテキストモデルでは不可能だった応用を実現する大きな変革点です。モデルは**ビジュアル質問応答(VQA)**に対応し、ユーザーが画像を提供してその内容について質問すると、詳細で文脈に合った回答を返します。画像からのテキスト転写によって手書きメモや印刷文書、スクリーンショットを高精度でデジタル化でき、文書管理やアクセシビリティ分野で重宝されています。物体検出・識別では、複雑なシーンでも複数の物体や光条件の違いを認識・説明できます。データビジュアライゼーションの解釈では、チャートやグラフ、インフォグラフィックを分析し、複雑なデータ関係を自然言語で説明します。実際には、手描きスケッチから動作するコード生成、ワイヤーフレーム画像からウェブサイト作成、ビジュアル仕様からゲーム開発まで可能です。Be My Eyesのような企業は、GPT-4のビジョン機能を活用して視覚障がい者支援を実現しています。Duolingoは会話型語学練習にGPT-4を活用し、モルガン・スタンレーは独自の金融データで訓練したGPT-4モデルを投資インサイトやウェルスマネジメント情報の即時提供に導入しています。これらの応用は、マルチモーダル処理が人間のビジュアル理解とAI言語能力の橋渡しとなることを証明しています。

GPT-4は標準的な学術・専門試験で前例のないパフォーマンスを示します。統一司法試験では人間の受験者と比較して90パーセンタイルを記録し、GPT-3.5の10パーセンタイルから大幅に向上しました。これは法曹資格を得られるスコアと不合格となるスコアの違いです。同様に生物学オリンピックではGPT-4が99パーセンタイル、GPT-3.5は31パーセンタイルです。数学・コーディング・作文・視覚的推論など、複数分野でベンチマークを塗り替えています。**マイクロソフトの研究者はGPT-4を「初期段階だが未完成の人工汎用知能(AGI)」**と評し、多様な分野での幅広い能力を強調しています。医学・法律・心理学・工学など専門分野でも優れた成果を示します。ただし、ベンチマーク成績が実世界での正確性を保証するものではなく、GPT-4も文脈によってはハルシネーションや誤情報生成が起こりえます。GPT-4はGPT-3.5よりも40%事実に即した応答を生成できるなど大きな進歩はありますが、完全無欠とは言えません。こうしたパフォーマンス指標により、高精度・高度推論が求められる企業用途でGPT-4は最適な選択肢となっています。

OpenAIはGPT-4に有害出力・誤情報・バイアスへの懸念に対応する包括的な安全対策を実装しました。モデルは許可されていないコンテンツ要求への応答がGPT-3.5比で82%減少しており、コンテンツフィルタリングや安全ガードレールが大幅に強化されています。これには人間のフィードバックによる強化学習(RLHF)、多分野のセキュリティ専門家との協議、公開前の現実環境でのテストなどが含まれます。GPT-4は「脱獄(Jailbreak)」試行への耐性も向上し、安全基準を無効化しようとする操作に強くなっています。訓練データには多様な視点を取り入れて偏りの軽減を図っていますが、バイアス課題は引き続きAI開発の難題です。OpenAIは特定のセンシティブ画像(特に人物画像など)に対して解析拒否機構を導入し、プライバシー保護と悪用防止を図っています。40%の事実精度向上はより良いデータ選定と検証プロセスの成果です。ただし、これらの安全性向上もリスクを完全には排除できません—GPT-4はまだ信頼性の低い医療アドバイスを出す場合や、特定文脈でバイアス応答・ハルシネーションを発生させる場合もあります。サイバーセキュリティ上の脆弱性(例:CAPTCHA解読の悪用可能性)も残るため、導入組織は追加のガードレールや人間による監督を必ず実施すべきです。

GPT-4の128,000トークンコンテキストウィンドウは、同時に処理できる情報量を革命的に増大させました。1トークンは英語で約0.75語に相当し、GPT-4は一度に約96,000語を処理できます。これは1冊の小説や付録付きの学術論文、数百ターンの長大な会話に相当します。GPT-4 Turbo(2023年11月リリース)も128Kウィンドウを維持しており、従来モデルではこの限界はずっと低いものでした。拡張されたウィンドウにより、ユーザーはコードベース全体の解析・リファクタリングや完全なプロジェクトドキュメントの提供、長大な会話の一貫性維持が可能です。この改善は、約8,000語で文脈を失うというGPT-3.5の大きな制限を解消しました。16倍の拡張で、ドキュメント重視のタスクへの応用が飛躍的に広がります。ただし、GPT-4の実効的な文脈利用は理論値よりも低い場合があり、8,000~40,000トークン程度が最適とする研究もあります。「コンテキストウィンドウの錯覚」と呼ばれる現象で、容量はあっても情報配置や複雑さにより実際の性能は変動します。

GPT-4の企業導入はリリース以降急拡大し、**コンピュータ分野で57%、経営・ビジネスで50%、エンジニアリング・科学で48%、その他専門職で44%**の導入率に達しています。顧客対応自動化、コンテンツ生成、コード開発、データ分析、戦略意思決定など多様な用途で活用されています。モルガン・スタンレーのような金融機関は独自データで訓練したGPT-4モデルを導入し、ウェルスマネジメント・投資助言の高度化を図っています。医療機関では医学研究・診断補助・患者コミュニケーションなどへの応用が模索されていますが、規制や精度への懸念も残ります。教育機関も個別指導、コンテンツ生成、アクセシビリティ支援にGPT-4を利用しています。API価格はGPT-3.5より高額で、その分計算資源や能力が優れています。コストと精度のトレードオフがあり、高精度・複雑タスク用途ではGPT-4のプレミアムが正当化され、コスト重視用途ではGPT-3.5が使われ続けています。企業導入の流れから、GPT-4が高度AI用途の標準となっていくことが予想されますが、データプライバシー、ハルシネーション、規制順守などの懸念が特に金融・医療分野では引き続き採用判断に影響しています。

GPT-4の支配的AIプラットフォーム化は、AmICitedのようなAIモニタリング・引用追跡システムに大きな影響をもたらします。企業が調査やコンテンツ生成、意思決定でGPT-4を活用する中、GPT-4による情報源の引用やブランド言及の把握はSEO戦略やブランド可視化に不可欠です。GPT-4のマルチモーダル機能により、引用はテキスト応答だけでなく画像ベースの検索にも現れ、ブランド言及の機会が拡大します。128Kのコンテキストウィンドウでは長大な文書を参照・引用でき、ブランドやドメイン名が応答に登場する可能性も高まります。**AIモニタリングプラットフォームは、テキスト応答での引用、画像分析・引用、ブランド言及頻度、その文脈など多次元でGPT-4引用を追跡する必要があります。GPT-4の事実精度向上により、引用の正確性も増し、AIによるブランド・ドメインの扱いを把握する上で特に価値ある情報となります。AmICitedを利用することで、どのコンテンツがGPT-4で最も引用されているかやAI発見性向上策、ChatGPT・Perplexity・Google AI Overviews・Claudeなど各AIプラットフォームでのブランドポジショニングの違いも把握できます。GPT-4モニタリングの戦略的重要性は単なる虚栄指標にとどまらず、AIが自社業界や競合、市場ポジションをどう理解・表現しているかの洞察につながります。

突出した能力を持つ一方で、GPT-4には導入前に理解すべき重大な制限事項も存在します。「ハルシネーション」—もっともらしいが実際は誤った情報の生成—は依然として課題で、特に専門分野や訓練データが不足している話題で顕著です。不正確な医療アドバイスを自信満々に提供する場合があり、専門家による確認なく使用すると危険です。画像から人物や場所を特定する能力によるプライバシー懸念や、画像分析におけるバイアスによる差別的結果のリスクもあります。センシティブ画像の解析拒否は安全機能である一方、正当な用途での機能制限ともなります。サイバーセキュリティ脆弱性にはCAPTCHA解読や敵対的コンテンツ生成の悪用リスクが含まれます。モデルの知識カットオフ(最新バージョンで2024年4月までの学習データ)により、ごく最近の出来事や情報は認識できません。計算コストも高く、中小企業には導入障壁となり得ます。冗長な応答を生成しやすいため、用途によっては非効率です。また、プロンプトの設計による性能のばらつきも大きく、不適切なプロンプトでは最適な結果を得にくい場合もあります。組織には人間による監督、事実確認、専門知識による妥当性検証が不可欠です。

GPT-4の今後の進化は、より高性能・高効率・専門特化型モデルへの発展を示唆します。OpenAIはすでにGPT-4 Turbo(性能向上・低コスト)やGPT-4.1(能力強化・最大100万トークンのコンテキスト対応)を発表済みです。GPT-4o(最適化版)・GPT-4 mini・GPT-4 nanoなどの専門特化型バリアントも登場し、用途や計算資源に応じたモデル多様化が進んでいます。**今後は音声・動画入力対応などマルチモーダル機能の強化、より高度な推論能力、外部ツールやAPIとの統合強化が予想されます。**Claude 3やGeminiなどの競合モデル登場により業界競争も激化し、イノベーションが加速しています。AI規制の枠組みも進化しつつあり、今後は透明性・説明責任・安全性の新要件がモデル開発に影響する可能性があります。**AIコストは競争や効率化により今後低下が見込まれ、先進的AIの民主化も期待されます。**エンタープライズシステムとの統合も深化し、GPT-4は生産性ツールやBI、業界特化型アプリケーションへの組み込みが進むでしょう。**AIモニタリングや引用追跡の重要性も一層高まり、AIによるブランド・コンテンツの扱い把握が経営戦略に不可欠となります。**GPT-4の未来は単なる能力向上だけでなく、AIが情報とどう相互作用し、文脈を理解し、多様な分野で人間の意思決定を支援するかという本質的転換にあります。

GPT-4は複数の面でGPT-3.5を大きく上回ります。GPT-4は統一司法試験で90パーセンタイルの成績を収めたのに対し、GPT-3.5は10パーセンタイルでした。また、生物学オリンピックではGPT-4が99パーセンタイル、GPT-3.5が31パーセンタイルです。GPT-4はマルチモーダルであり、テキストと画像の両方の入力を受け付けますが、GPT-3.5はテキストのみを処理します。さらに、GPT-4は8倍大きいコンテキストウィンドウ(64,000語対8,000語)を持ち、許可されていないコンテンツ要求への応答が82%少なくなっています。

マルチモーダルとは、GPT-4がテキスト、画像、その他のデータ形式を同時に理解して処理できる能力を指します。これによりGPT-4は画像を分析したり、ビジュアルコンテンツについて質問に答えたり、光学文字認識を行ったり、テキストとビジュアル情報を組み合わせた応答を生成したりできます。これらは異なる感覚入力を横断した人間のような理解を模倣します。

GPT-4のコンテキストウィンドウは128,000トークン(英語で約80,000語)で、GPT-4 Turboは完全な128K容量をサポートしています。これはGPT-4が非常に長い文書、会話、コードファイルにおいても一貫性を保って処理できることを意味します。より大きなコンテキストウィンドウにより、複雑な文書や長い会話を情報を失うことなく理解することが可能です。

GPT-4はテキスト生成、コード作成、数学的推論、画像分析、文書要約、複雑な問題解決に優れています。チャートやインフォグラフィックの解釈、画像からのテキスト転写、物体検出、画像に関する質問応答、スケッチやワイヤーフレームからのコード生成などが可能です。法務、医療、学術分野など専門領域でも精度が向上しています。

GPT-4の高度な推論とマルチモーダル機能は、AmICitedのようなAIモニタリングツールの重要なプラットフォームとなっています。企業がGPT-4を使ってコンテンツ生成や調査を行う中で、GPT-4の応答内でのブランド言及、引用、URL出現の追跡はSEOやブランド管理、AIコンテンツ配信パターンの把握に不可欠です。

GPT-4はMixture of Experts(MoE)デザインを採用しており、これは異なる種類の情報を処理する複数の専門的サブネットワーク(エキスパート)を利用するニューラルネットワークアーキテクチャです。このアプローチにより、GPT-4は多様なタスクを効率的に処理し、従来の密集型アーキテクチャと比べて計算リソースを効果的に管理しながら性能を向上させています。

OpenAIはGPT-4に複数の安全対策を実装しました。人間からのフィードバックによる学習、セキュリティ専門家との協議、現実の環境でのテストなどを行っています。GPT-4は許可されていないコンテンツ要求への応答が82%減少し、GPT-3.5よりも事実に即した応答を40%多く生成します。これらの改善は誤情報やバイアス、有害なコンテンツ生成への懸念に対応するものです。

GPT-4には偽情報の生成(ハルシネーション)、画像分析に伴うプライバシー懸念、応答のバイアス、センシティブ画像の分析拒否などの顕著な制限があります。医療アドバイスが不正確な場合や最新情報への対応が困難な場合もあるほか、CAPTCHA解読などサイバーセキュリティ上の脆弱性も指摘されています。

ChatGPT、Perplexity、その他のプラットフォームでAIチャットボットがブランドを言及する方法を追跡します。AI存在感を向上させるための実用的なインサイトを取得します。

GPT-5は2025年8月にリリースされたOpenAIの最新LLMで、40万コンテキストウィンドウ、45%のハルシネーション削減、マルチモーダル機能、統合推論アーキテクチャにより、複雑なAIタスクやブランドモニタリングに対応します。...

ChatGPTは、GPTモデルによって動作するOpenAIの会話型AIアシスタントです。その仕組みやAIモニタリング、ブランドの可視性、AI検索における重要性について解説します。...

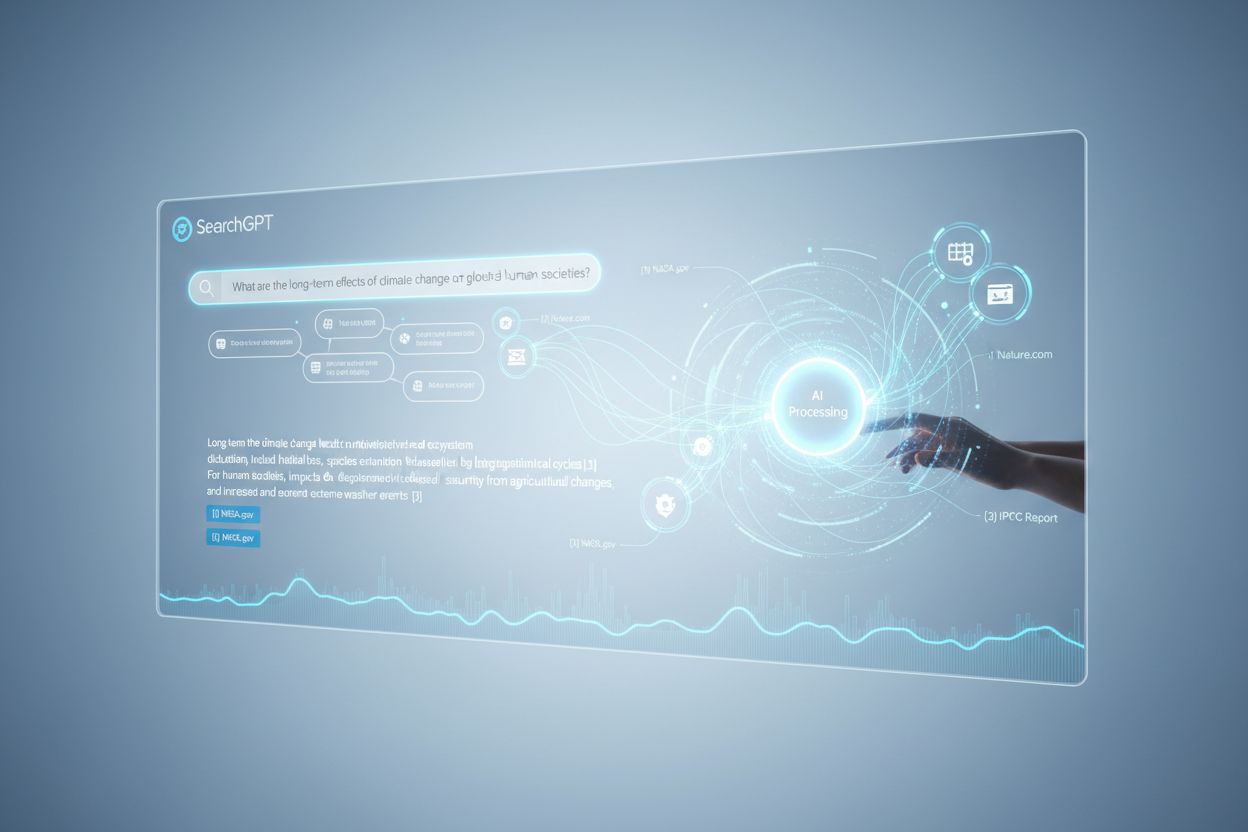

SearchGPTとは何か、その仕組みや検索・SEO・デジタルマーケティングへの影響を解説します。特徴、制限、AI搭載検索の今後についてもご紹介。...

クッキーの同意

閲覧体験を向上させ、トラフィックを分析するためにクッキーを使用します。 See our privacy policy.