AI検索における自然言語理解:AIはどのように人間の言語を理解するのか

AI検索エンジンにおける自然言語理解の仕組みを解説。NLUがChatGPT、Perplexity、その他のAIシステムでユーザーの意図や文脈、意味をどのように理解し、単なるキーワード照合を超えているかを紹介します。...

自然言語処理(NLP)は、人工知能の一分野であり、計算言語学、機械学習、ディープラーニング技術を通じて、コンピュータが人間の言語を理解、解釈、生成できるようにするものです。NLPは統計的手法とニューラルネットワークを組み合わせてテキストと音声データの両方を処理し、チャットボット、検索エンジン、AIモニタリングシステムなど、現代のAIアプリケーションに不可欠な技術となっています。

自然言語処理(NLP)は、人工知能の一分野であり、計算言語学、機械学習、ディープラーニング技術を通じて、コンピュータが人間の言語を理解、解釈、生成できるようにするものです。NLPは統計的手法とニューラルネットワークを組み合わせてテキストと音声データの両方を処理し、チャットボット、検索エンジン、AIモニタリングシステムなど、現代のAIアプリケーションに不可欠な技術となっています。

自然言語処理(NLP) は、人工知能およびコンピュータサイエンスの一分野であり、コンピュータが人間の言語を意味のある形で理解、解釈、操作、生成できるようにする技術です。NLPは計算言語学(人間の言語をルールベースでモデル化)、機械学習アルゴリズム、ディープラーニングニューラルネットワークを組み合わせ、テキストと音声データの両方を処理します。この技術により、マシンは言語の意味を把握し、人間のコミュニケーションパターンを認識し、人間の言語理解を模倣した一貫性のある応答を生成できます。NLPは現代AIアプリケーションの基盤であり、検索エンジンやチャットボット、音声アシスタント、ChatGPT・Perplexity・Google AI Overviewsのようなブランド監視システムまで、幅広く活用されています。

自然言語処理の分野は1950年代に誕生し、研究者が初めて機械翻訳に挑戦したことから始まります。1954年のジョージタウン-IBM実験では、60文のロシア語が英語に自動翻訳されるなどの成果がありました。しかし初期のNLPシステムは、特定の入力にしか対応できない厳密なルールベース方式に大きく制限されていました。1990年代から2000年代初頭には、統計的NLP手法の発展によって機械学習が導入され、スパムフィルタリングや文書分類、基本的なチャットボットなどが実現しました。本格的な革命は2010年代、ディープラーニングモデルとニューラルネットワークの台頭で起こります。これらはより長いテキストや複雑な言語パターンも解析できるようになりました。現在、NLP市場は爆発的な成長を遂げており、2024年の597億ドルから2030年には4,398億ドルに拡大すると予測され、年平均成長率(CAGR)は38.7%に達します。この成長は、企業向けソリューション、AI自動化、ブランドモニタリング用途でのNLPの重要性の高まりを反映しています。

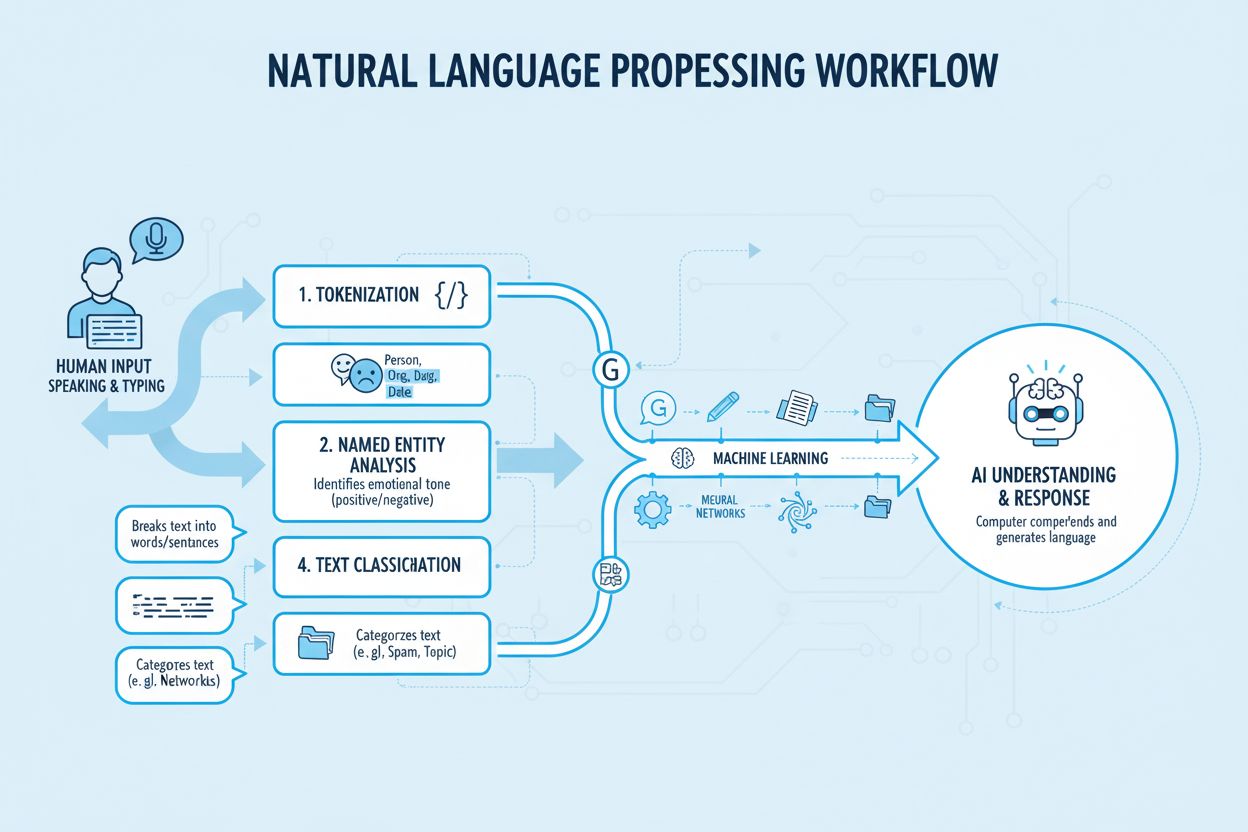

自然言語処理は、人間の言語を分解・分析するために複数の基本技術を用います。トークナイゼーションは、テキストを単語・文・フレーズなど小さな単位に分割し、機械学習モデルが扱いやすい形にします。ステミングとレンマタイゼーションは「running」「runs」「ran」など異なる語形を「run」という語根に統一し、同一語を認識しやすくします。固有表現抽出(NER)は、人名・地名・組織名・日付・金額など特定の実体をテキストから抽出するもので、企業名がAI生成コンテンツ内で言及された際の検出など、ブランド監視には欠かせません。感情分析は、テキストに表現された感情や意見を判定し、ポジティブ・ネガティブ・ニュートラルに分類します。これにより、AI応答でのブランドのイメージ把握が可能です。品詞タグ付けは、各単語の文法的役割(名詞、動詞、形容詞など)を特定し、文構造や意味理解を助けます。テキスト分類は、文書やテキスト片を事前定義されたカテゴリに分類し、情報の整理・フィルタリングを自動化します。これらの技術がNLPパイプラインの中で連携し、生の非構造化テキストをAIが処理・学習できる構造化データへと変換します。

| NLPアプローチ | 説明 | 主な用途 | 利点 | 限界 |

|---|---|---|---|---|

| ルールベースNLP | if-then型の決定木や文法規則を使用 | シンプルなチャットボット、基本的なテキストフィルタリング | 予測可能・透明性、訓練データ不要 | 拡張性がない、言語の多様性に対応不可、柔軟性に乏しい |

| 統計的NLP | ラベル付きデータからパターンを抽出する機械学習手法 | スパム検出、文書分類、品詞タグ付け | ルールベースより柔軟、データから学習可能 | ラベル付き訓練データが必要、文脈やニュアンスが苦手 |

| ディープラーニングNLP | ニューラルネットワークやトランスフォーマーモデルを大規模非構造データに適用 | チャットボット、機械翻訳、コンテンツ生成、ブランド監視 | 高精度、複雑な言語パターンや文脈を扱える | 莫大な計算資源が必要、訓練データのバイアスに影響されやすい |

| トランスフォーマーモデル(BERT, GPT) | 自己注意機構でシーケンス全体を同時処理 | 言語理解、テキスト生成、感情分析、NER | 最先端性能、効率的な訓練、文脈理解 | 計算コストが高い、大規模データが必要、解釈が難しい |

| 教師あり学習 | 入出力ペアでラベル付きデータを訓練 | 感情分類、固有表現抽出、テキスト分類 | 特定タスクで高精度、予測性能が安定 | 大量のラベル付きデータが必要、アノテーション工数大 |

| 教師なし学習 | ラベルなしデータからパターンを発見 | トピックモデリング、クラスタリング、異常検知 | ラベリング不要、隠れたパターンの発見 | 精度が低いことが多い、結果の解釈が困難、専門知識が必要 |

自然言語処理は、生の人間言語から機械可読なインサイトを得る体系的なパイプラインで動作します。まずテキスト前処理で入力をクリーンアップ・標準化します。トークナイゼーションで単語やフレーズに分割し、小文字化で「Apple」と「apple」を同じものとして扱い、ストップワード除去で「the」「is」など意味を持たない一般語を排除します。ステミング・レンマタイゼーションで語形を統一し、テキストクリーニングで句読点や特殊文字など不要要素を除去します。続く特徴抽出では、テキストを機械学習モデルが扱える数値表現に変換します。Bag of WordsやTF-IDFによる重要語の定量化、Word2VecやGloVeなどの単語埋め込みによる語彙の意味関係の数値化、さらに文脈埋め込みで前後関係まで考慮した表現を作成します。次にテキスト分析の段階で、固有表現抽出による実体認識、感情分析による感情判定、係り受け解析による文法構造理解、トピックモデリングによる主題抽出などを実行します。最後にモデル学習でパターンや関係性を学習し、訓練済みモデルが新規データに対して予測を行います。この一連のパイプラインにより、AmICitedのようなシステムはChatGPT、Perplexity、Google AI OverviewsなどのAI生成応答内でブランド言及を検出・分析できます。

ディープラーニングの登場により、自然言語処理は統計的手法から大規模データに基づくニューラルネットワークアーキテクチャへと大きく進化しました。RNN(リカレントニューラルネットワーク)やLSTM(長・短期記憶ネットワーク)は時系列データ処理で初期に活用されましたが、長期依存関係の処理に課題がありました。画期的だったのがトランスフォーマーモデルで、自己注意機構を導入し、シーケンス全体の単語を同時に考慮し、重要部分を特定できます。Google開発のBERT(Bidirectional Encoder Representations from Transformers)は双方向から文脈を理解し、現代の検索エンジンや言語理解タスクの基盤となっています。GPT(Generative Pre-trained Transformer)シリーズ(GPT-4など)は自己回帰型アーキテクチャで次の単語を予測し、高度なテキスト生成を実現します。これらのトランスフォーマー系モデルは自己教師あり学習により大規模テキストデータベースから効率的かつスケーラブルに学習可能です。IBM Graniteのようなファウンデーションモデルは、事前構築・調整済みで、コンテンツ生成・インサイト抽出・固有表現抽出など多様なNLPタスクに高速展開できます。これらモデルの強みは、微妙な意味関係の把握、長文の文脈理解、一貫性ある応答生成にあり、ブランド言及監視などAIモニタリングプラットフォームに不可欠な能力です。

自然言語処理は今やほぼ全産業で不可欠となり、膨大な非構造テキストや音声データから実用的なインサイトを抽出しています。金融では財務諸表や規制報告、ニュースリリースの分析を高速化し、トレーダーやアナリストの判断を支援します。医療分野では診療記録や論文、臨床ノートの解析によって診断・治療計画や研究が促進されます。保険業界はクレーム分析や不正検出、業務最適化にNLPを活用しています。法律分野では自動文書検索や判例整理を通じて調査コストを大幅に削減します。カスタマーサービス部門はNLP搭載チャットボットで定型問い合わせを自動処理し、担当者は複雑案件に集中できます。マーケティング・ブランド管理チームは感情分析やブランドモニタリングを通じてデジタルチャネルでのブランド言及や評価を追跡しています。特にAmICitedのミッションに関連し、NLPはAIモニタリングプラットフォームで、ChatGPT、Perplexity、Google AI Overviews、ClaudeなどのAI生成応答内でブランド言及を検出・分析する中核技術となっています。これらは固有表現抽出でブランド名を特定し、感情分析で文脈やトーンを把握、テキスト分類で言及の種類を分類します。生成AI時代、AI応答でのブランド可視性が発見性や評判に直結するため、この能力の重要性は今後ますます高まります。

目覚ましい進歩がありながらも、自然言語処理はその精度や適用範囲に関し重大な課題を抱えています。最大の課題は曖昧さで、単語やフレーズは文脈次第で複数の意味を持ち、文も様々な解釈が可能です。たとえば「I saw the man with the telescope」は、「望遠鏡で男を見た」か「望遠鏡を持った男を見た」か文脈によって異なります。文脈理解も難しく、長文や現実世界の知識が必要な場合は特に困難です。皮肉、慣用句、比喩表現は字義通りの意味と意図が異なるため、標準パターンで訓練されたシステムは誤解しやすいです。話し手のトーンや感情的ニュアンスもテキストだけでは捉えにくく、同じ言葉でも意図がまったく異なる場合があります。訓練データ内のバイアスも深刻で、ウェブから収集されたデータで学習したNLPモデルは社会的偏見を受け継ぎやすく、不正確または差別的な出力が生じます。新語や言語の進化もNLPにとって大きな挑戦で、スラングや新しい文法が登場するスピードにデータ更新が追いつきません。希少言語や方言は訓練データが少ないため、対応精度が著しく下がります。文法ミス、つぶやき、雑音、非標準発話など現実の音声データにも多くの課題があります。これらの限界により、最先端のNLPシステムでも、特に非公式・創造的・文化依存の言語処理では誤解が生じやすいのです。

自然言語処理分野は急速に進化しており、複数の新トレンドがその方向性に影響を与えています。マルチモーダルNLPはテキスト・画像・音声処理を組み合わせ、複数のモダリティを同時に理解・生成できる高度なAIを実現しています。Few-shot/Zero-shot Learningにより、膨大なラベル付きデータを必要とせず、少数例で新タスクに対応するモデルが登場しています。RAG(Retrieval-Augmented Generation)は、言語モデルを外部知識と連携させることで生成コンテンツの正確性と信頼性を向上させ、幻覚(ハルシネーション)を抑制します。効率的なNLPモデルの登場で、先進的なNLP機能が中小企業やエッジデバイスでも利用可能になりつつあります。説明可能なAI(XAI)も重要性を増し、モデルの意思決定過程の理解や規制対応が進んでいます。ドメイン特化型NLPモデルは医療・法律・金融など専門分野向けに調整され、専門用語や業界特有の表現にも高精度で対応します。倫理的AIとバイアス対策も注目されており、公平かつ偏りのないNLPシステムの実現が求められています。特にブランドモニタリングの観点では、NLPとAIモニタリングプラットフォームの連携が不可欠となりつつあります。ChatGPTやPerplexity、Google AI OverviewsのようなAIシステムが消費者の主要情報源となる今、これらでブランドがどう扱われているかを監視・把握する能力(高度なNLP技術による)は、現代マーケティングやブランド戦略の中核となっていきます。

自然言語処理は、AmICitedのようなプラットフォームでAIシステム横断的にブランド言及を追跡するための技術的基盤です。ユーザーがChatGPT、Perplexity、Google AI Overviews、Claudeなどにクエリを投げると、これらのシステムは大規模言語モデルと高度なNLP技術で応答を生成します。AmICitedはNLPアルゴリズムでAI生成応答を分析し、ブランドが言及されたタイミングやその文脈、感情を検出します。固有表現抽出でブランド名や関連実体を認識し、感情分析でポジティブ・ネガティブ・ニュートラルを判定、テキスト分類で推薦・比較・批判など言及の種別を分類します。これにより企業はAIプレゼンス——消費者の主要情報源であるAIシステム内でブランドがどのように発見・議論されているか——を可視化できます。NLP市場は2030年に4,398億ドルまで爆発的成長が予測されており、NLP駆動のブランドモニタリング重要性は今後さらに高まります。AI時代にブランド評判を守り・高めるためにも、これら技術を理解し積極的に活用することが企業にとって不可欠となるでしょう。

自然言語理解(NLU)はNLPのサブセットであり、特に文やテキストの意味を分析し理解することに焦点を当てています。NLPが人間の言語の処理全般(生成や操作も含む)を対象とするのに対し、NLUは意味や意図の抽出に特化しています。NLUにより、システムは文脈やニュアンス、実際の意図を理解できるため、ユーザーが本当に何を伝えたいのかを把握する必要があるチャットボットや音声アシスタントなどに不可欠です。

NLPはAIモニタリングプラットフォームにとって不可欠な技術です。NLPにより、システムはAI生成応答内でのブランド言及を検出・分析できます。固有表現抽出(NER)、感情分析、テキスト分類などの技術により、NLPアルゴリズムはブランドが言及されたタイミングやその文脈、感情を特定できます。これによりAmICitedのようなプラットフォームは、ChatGPT、Perplexity、Google AI Overviews、ClaudeなどのAI応答でのブランドの出現状況を追跡し、AI生成コンテンツ内でのブランドの可視性を提供します。

現代のNLPは、トークナイゼーション(テキストを単語やフレーズに分割)、感情分析(感情の判定)、固有表現抽出(人物・場所・組織の識別)、テキスト分類(内容のカテゴリ分け)など、いくつかの主要な技術に依存しています。高度な技術には、単語埋め込み(数値ベクトルによる単語表現)、BERTやGPTのようなトランスフォーマーモデル(アテンション機構の利用)、翻訳用のシーケンス・ツー・シーケンスモデルなどがあります。これらの技術はディープラーニングの枠組みで組み合わされ、AIが文脈を理解し、自然な応答を生成し、複雑な言語タスクを実行できるようにします。

トランスフォーマーモデルは、自己注意(セルフアテンション)機構を導入することでNLPを革新しました。これにより、モデルはシーケンス全体を同時に処理し、離れた単語同士の関係も理解できるようになります。BERT(Bidirectional Encoder Representations from Transformers)やGPT(Generative Pre-trained Transformer)のようなモデルは、トランスフォーマーアーキテクチャを活用して言語理解や生成で最先端の性能を発揮します。トランスフォーマーは自己教師あり学習で大規模データセットを使って訓練可能で、翻訳やコンテンツ生成など様々なNLPタスクにおいて高効率かつスケーラブルです。

NLPは、言語の曖昧さ(多義語)、文脈やニュアンスの理解、皮肉や慣用句への対応、文法の揺れや誤り、多言語処理など、いくつかの大きな課題に直面しています。また、NLPシステムは訓練データのバイアス、珍しい語彙や新語、発話のトーンや文化的文脈の解釈にも苦労します。これらの課題により、最先端のNLPモデルであっても、特に非公式な言葉や方言、専門用語では意味の取り違えが発生することがあります。

NLPの前処理は、生データを機械学習モデルが効果的に扱える形式に変換します。主な前処理手順には、トークナイゼーション(テキストの分割)、小文字化(表記の統一)、ストップワード除去(一般語の除外)、ステミングやレンマタイゼーション(語形の正規化)、句読点や特殊文字の削除などがあります。これらの手順によりノイズが減り、入力が標準化され、モデルが意味のある言語パターンに集中できるため、下流のNLPタスクやモデル学習の精度と効率が大きく向上します。

教師ありNLP手法は、入力と出力がラベル付けされたデータセットを使ってモデルを訓練します。そのため、感情分類や固有表現抽出など特定タスクで高い精度を発揮します。教師なしNLP手法はラベルなしデータから独自にパターンを発見し、トピックモデリングやクラスタリングなどに有用です。半教師あり手法は少量のラベル付きデータと大量のラベルなしデータを組み合わせます。手法の選択は、データの可用性やタスク要件、モデルの用途(特定用途か一般的な言語理解か)によって異なります。

ChatGPT、Perplexity、その他のプラットフォームでAIチャットボットがブランドを言及する方法を追跡します。AI存在感を向上させるための実用的なインサイトを取得します。

AI検索エンジンにおける自然言語理解の仕組みを解説。NLUがChatGPT、Perplexity、その他のAIシステムでユーザーの意図や文脈、意味をどのように理解し、単なるキーワード照合を超えているかを紹介します。...

会話型言語がAIとのやりとりにどのように影響するかを学びましょう。ChatGPT、Perplexity、Google AI Overviews向けの自然言語最適化をマスターし、あなたのコンテンツが引用されやすくなる方法を解説します。...

大規模言語モデル(LLM)の包括的定義:数十億のパラメータを持つAIシステムが言語を理解・生成します。LLMの仕組み、AIモニタリングや企業導入トレンドについて解説。...

クッキーの同意

閲覧体験を向上させ、トラフィックを分析するためにクッキーを使用します。 See our privacy policy.