ベクトル検索とは何か、その仕組みとは?

ベクトル検索が機械学習の埋め込みを利用して、正確なキーワードではなく意味に基づいて類似アイテムを見つける方法を解説します。ベクトルデータベース、ANNアルゴリズム、実際の応用例についても理解しましょう。...

ベクトル検索は、データを数学的なベクトルとして表現し、コサイン類似度やユークリッド距離などの距離指標を使って比較することで、データセット内から類似したアイテムを見つける手法です。このアプローチにより、キーワードの一致を超えた意味的な理解が可能となり、システムは単なるテキストの一致ではなく意味に基づいて関係性や類似性を発見できます。

ベクトル検索は、データを数学的なベクトルとして表現し、コサイン類似度やユークリッド距離などの距離指標を使って比較することで、データセット内から類似したアイテムを見つける手法です。このアプローチにより、キーワードの一致を超えた意味的な理解が可能となり、システムは単なるテキストの一致ではなく意味に基づいて関係性や類似性を発見できます。

ベクトル検索は、データを数学的なベクトルとして表現し、それらを距離指標で比較することで意味的な類似性を測定し、類似アイテムを見つける手法です。従来のキーワードベース検索が正確なテキスト一致に依存するのに対し、ベクトル検索は高次元の数値表現(ベクトル埋め込み)へ変換することで、データの意味や文脈を理解します。このアプローチによって、表面的な特徴ではなく意味内容に基づく関係性・類似性の発見が可能となり、文脈理解が求められる用途で特に強力です。ベクトル検索は現代AIシステムの基盤となっており、セマンティックサーチ、レコメンデーション、異常検知、検索拡張生成(RAG)などをChatGPT、Perplexity、Google AI Overviews、Claudeといったプラットフォームで実現しています。

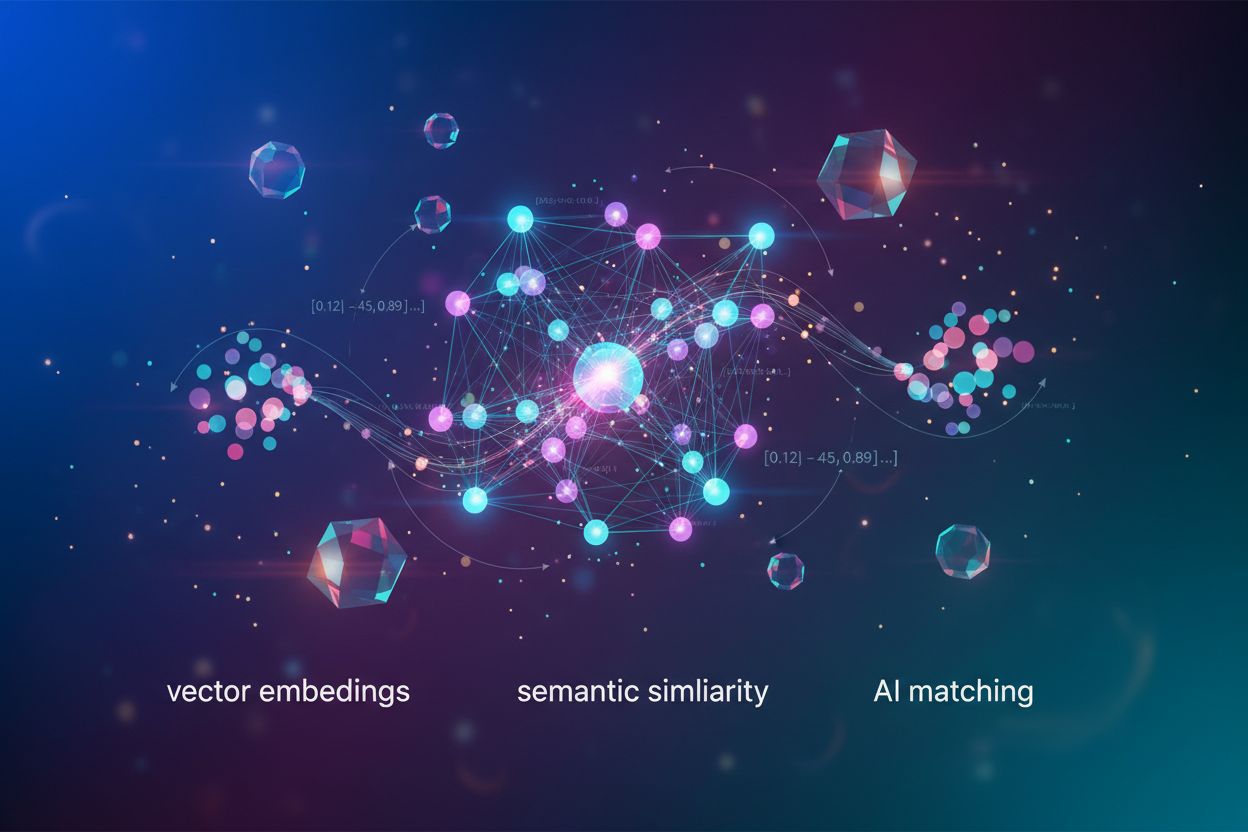

ベクトル検索の基本は、データを数値表現に変換し、空間上の近さが意味的な類似性を示すという考えです。テキスト・画像・音声などあらゆるデータポイントは、特徴や意味を示す数値の配列(ベクトル)となります。例えば、「レストラン」という単語は[0.2, -0.5, 0.8, 0.1]のように表され、各値が意味的特徴を担います。意味が近いアイテム同士は高次元空間でベクトルの距離が近くなり、異なるものは遠く配置されます。これにより、コンピュータはキーワード一致ではなく意味ベースで概念を比較でき、「美味しいディナーのアイデア」と検索しても、「高評価レストラン」などが出てくるのです。

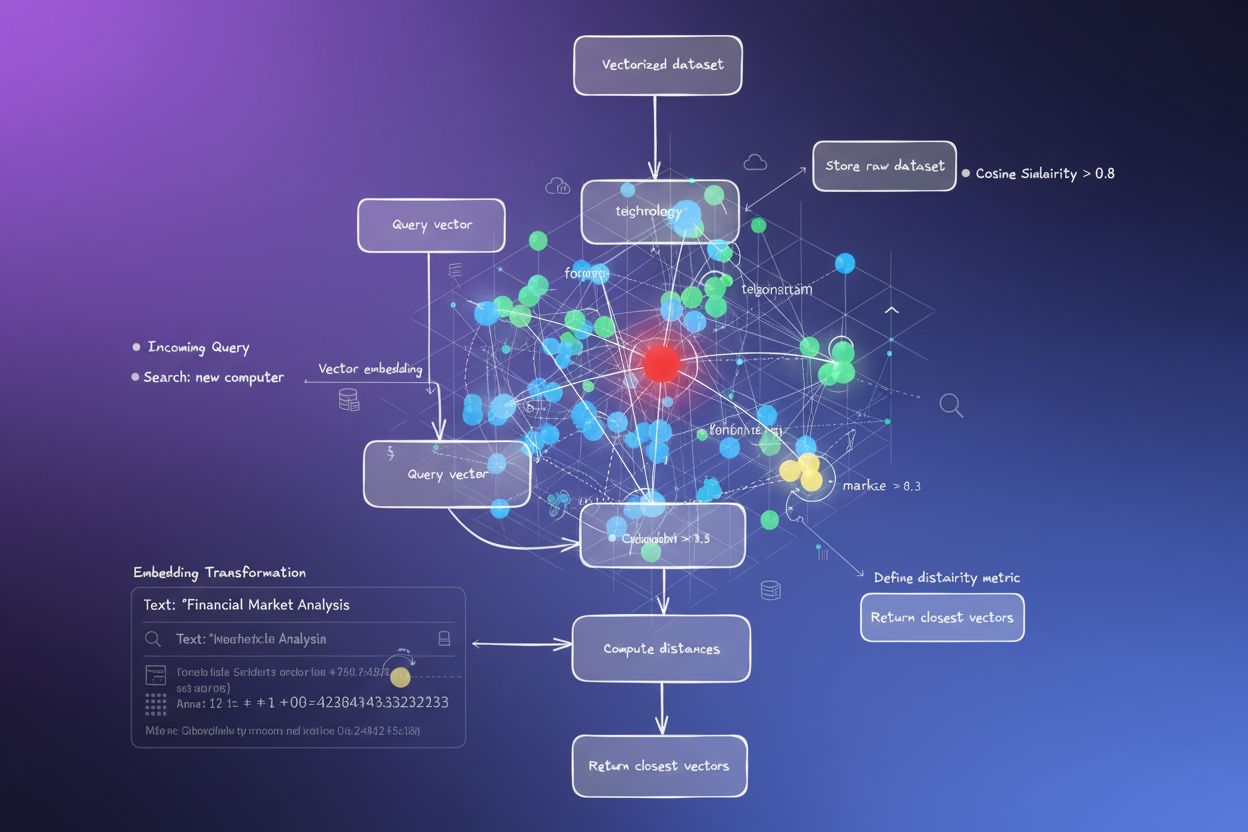

データをベクトルに変換する処理を**埋め込み(embedding)**と呼び、大規模データで学習した機械学習モデルが担います。こうしたモデルは、数十億の例から、意味的に近い概念をベクトル空間で近くに配置する方法を学習します。代表的な埋め込みモデルには、Word2Vec(文脈から単語関係を学習)、BERT(文脈的意味の把握)、CLIP(テキストと画像などマルチモーダル対応)などがあります。得られる埋め込みベクトルは100~1000次元以上となり、豊かな意味関係を数学的に表現します。検索時はクエリも同じモデルでベクトル化し、全データのベクトルと距離計算して最も近いものを見つけます。

ベクトル検索は、距離指標を用いて2つのベクトルの類似度を定量化します。主な指標はコサイン類似度、ユークリッド距離、ドット積類似度の3つで、それぞれ異なる数学的性質と用途があります。コサイン類似度は2つのベクトル間の角度を-1~1で測定し、1は完全に同じ方向(最大類似)、0は直交(関連なし)です。これはベクトルの大きさに左右されず方向に注目するため、文書長が異なるNLP用途に有効です。ユークリッド距離は多次元空間での直線距離を計算し、大きさと方向の両方を考慮します。ベクトルの大きさが意味を持つ(例:購買頻度)場合に有効です。

ドット積類似度は大きさと方向の両方を考慮しつつ計算効率にも優れ、多くの大規模言語モデルで訓練時に用いられています。したがって、用途に最適な距離指標の選択が重要です。研究によれば、埋め込みモデルの学習時に用いた指標と同じものをインデックスでも使うことで最良の精度が得られます。例えば、all-MiniLM-L6-v2モデルはコサイン類似度で学習されているため、インデックスでもコサイン類似度を使うべきです。ベクトル検索を実装する際は、モデルやユースケースに合った距離指標の選択が精度・パフォーマンス両面で重要です。

| 観点 | ベクトル検索 | キーワード検索 | ハイブリッド検索 |

|---|---|---|---|

| 一致方法 | 意味ベースの類似性 | 単語やフレーズの正確一致 | 意味とキーワード両方で一致 |

| クエリ理解 | 意図や文脈を理解 | キーワードが正確に必要 | 両アプローチで包括的結果 |

| 同義語対応 | 同義語や関連語も自動で発見 | 明示的なインデックスなしでは見逃す | 両手法で同義語をカバー |

| 曖昧なクエリ対応 | 優れている(意図を理解) | 弱い(正確なキーワード必須) | 良好(両解釈をカバー) |

| 計算コスト | 高い(埋め込み・類似度計算) | 低い(単純な文字列一致) | 中程度(双方を並行実行) |

| スケーラビリティ | 専用ベクトルDBが必要 | 従来DBで対応 | ハイブリッド対応システムが必要 |

| 用途例 | セマンティック検索、レコメンド、RAG、異常検知 | 正確なフレーズ検索、構造化データ | 企業検索、AIモニタリング、ブランド追跡 |

| 例 | 「ヘルシーな夕食レシピ」で「栄養バランスの良い食事準備」もヒット | 「ヘルシー」「夕食」完全一致のみヒット | 正確一致+意味的に関連するコンテンツ両方がヒット |

ベクトル検索の実装は、生データを検索可能な意味表現に変換する一連の工程からなります。最初にデータ取り込みと前処理で文書や画像等をクリーンアップ・正規化します。次にベクトル変換で、埋め込みモデルが各データを100~1000次元以上の数値ベクトルに変換します。これらは高次元データに最適化されたベクトルデータベースやインデックス構造に格納されます。検索クエリが来ると同様に埋め込みを作成し、距離指標でクエリベクトルと全ベクトルの類似度を計算、近い順にランキングします。

大規模運用の効率化のため、近似最近傍(ANN)アルゴリズム(例:HNSW、IVF、ScaNN)が使われます。これらは完全な精度と引き換えに、高速性を実現し、数百万・数十億ベクトルからの検索をミリ秒単位で可能にします。HNSWは多層グラフ構造で上層に長距離接続、下層に短距離接続を持ち、探索効率を線形O(n)から対数O(log n)へと大幅改善します。用途に応じてアルゴリズムを選択し、データ量・クエリ数・レイテンシ要件・計算資源に合わせ最適化します。

ベクトル検索は、AIシステム横断でブランド言及を追跡するAIモニタリングプラットフォーム(例:AmICited)に不可欠です。従来のキーワードモニタリングでは言い換えや文脈的参照、名前やURLのバリエーションを見逃しがちですが、ベクトル検索ならAI生成応答内で表現が異なってもブランドの言及を検出できます。例えば「amicited.com」が「AIプロンプトモニタリングプラットフォーム」や「生成AIでのブランド可視性」などの文脈で登場しても、意味的に関連すると判定できます。こうした意味理解はAI引用トラッキングにも不可欠で、ChatGPT、Perplexity、Google AI Overviews、Claudeなど多様なAIで網羅的な把握を可能にします。

ベクトル検索技術の市場も急成長しており、その価値が企業に認識されています。市場調査によれば、ベクトルデータベース市場は2024年に19.7億ドル、2032年には106億ドルに達し、年平均成長率(CAGR)は23.38%です。また、Databricksは2023年12月のベクトル検索一般公開からわずか1年で186%の導入増加を報告しています。こうした急速な普及は、企業がAIアプリ基盤としてベクトル検索を重視している証拠です。AIシステムでの存在感をモニタリングしたい組織にとって、ベクトル検索は意味的理解をもたらし、キーワード一致だけでは捉えきれない重要な言及も確実に把握できます。

ベクトル検索の大規模運用では、速度・精度・メモリ消費のバランスをとるため高度なインデックス手法が不可欠です。HNSW(階層型Navigable Small World)は、多層グラフ構造にベクトルを整理し、各層で接続距離を短くしていきます。探索は最上層の長距離接続から開始し、層ごとに精度を高めて降りていきます。研究では、HNSWは99%以上のリコールとサブミリ秒レイテンシを両立する最先端の性能を示しています。ただし、HNSWはメモリ消費も大きく、100万ベクトルで0.5GB~5GB必要とのベンチマークもあり、大規模運用ではメモリ最適化も重要です。

IVF(Inverted File Index)は、ベクトルをクラスタリングし、各クラスタの中心で索引化する手法です。これにより検索空間を関連クラスタに絞り、全体検索を回避できます。Google Research開発のScaNN(Scalable Nearest Neighbors)は内積検索に特化し、レコメンド用途で高性能です。**PQ(Product Quantization)**はベクトルをサブベクトルに分割して個別に量子化し、メモリ消費を10~100分の1に圧縮(精度はやや低下)します。ベクトル検索導入時は、リコール重視・速度重視・メモリ効率など要件に応じてインデックス手法を選定する必要があります。高次元ベクトル演算の計算課題に対応すべく、新たなアルゴリズムや最適化技術も続々登場しています。

ベクトル検索の定義と応用は、AIシステムの高度化と企業導入拡大に伴い進化を続けています。今後は、ベクトル検索と従来のキーワード検索、高度なフィルタリングを組み合わせたハイブリッド検索システムが主流となっていきます。ハイブリッド型はベクトル検索の意味理解とキーワード一致精度の両方を活かし、複雑なクエリへの高品質な応答を実現します。また、マルチモーダルベクトル検索も重要性を増しており、テキスト・画像・音声・動画を統一ベクトル空間で横断的に検索することが可能になります。これにより、多様なデータ型を直感的・包括的に検索できる体験が実現します。

AIシステムでのブランド露出をモニタリングする組織にとって、ベクトル検索の進化は大きな影響を及ぼします。今後、ChatGPT、Perplexity、Google AI Overviews、Claudeなど主要AIプラットフォームがベクトル検索を活用してコンテンツ検索やランキングを行う中、ブランドが意味的にどう扱われているかの把握が従来のキーワード可視性と同等以上に重要になります。意味理解へのシフトにより、ブランドモニタリングやAI引用トラッキングも単純なキーワード検出から、文脈的言及や意味的関係まで捉える必要があります。ベクトル検索の仕組みと応用を理解している組織は、生成AI時代の可視性最適化において優位に立てるでしょう。ベクトル検索とAIモニタリングの融合は、AI駆動時代のブランドマネジメントの根本的変化を示しています。

従来のキーワード検索は文書内の正確な単語一致を探しますが、ベクトル検索は意味や文脈を理解します。ベクトル検索はテキストを「埋め込み」と呼ばれる数値表現に変換し、正確なキーワードが一致しなくても関連する結果を見つけることができます。例えば、「ワイヤレスヘッドホン」でベクトル検索すると、「Bluetoothイヤホン」も意味的に近いため結果に含まれますが、キーワード検索ではこの関連を見逃します。

ベクトル埋め込みは、データ(テキスト、画像、音声など)を意味を捉えた数値の配列に変換したものです。Word2Vec、BERT、トランスフォーマーモデルなどの機械学習モデルが、似た概念同士を高次元空間で近くに配置するように学習します。例えば、「king」と「queen」は意味的に近いため埋め込みも近くなりますが、「king」と「banana」は離れた位置になります。

主な距離指標はコサイン類似度(ベクトル間の角度を測定)、ユークリッド距離(直線距離を測定)、ドット積類似度(大きさと方向の両方を考慮)の三つです。NLP用途では大きさに関係なく意味的な方向に注目するコサイン類似度が一般的です。最適な精度のためには、埋め込みモデルの学習時に使った指標と同じものを選ぶべきです。

ベクトル検索は、AmICitedのようなAIモニタリングプラットフォームがAI各種(ChatGPT、Perplexity、Google AI Overviews、Claude)におけるブランド言及を意味的な文脈で把握できるようにします。これにより、言い換えや関連概念、文脈的なブランド参照も検出でき、AI生成応答におけるドメインの可視性を多角的に把握できます。

HNSW(階層型Navigable Small World)などのANNアルゴリズムは、厳密な最近傍ではなく近似値を見つけることで、数百万のベクトルの中から高速に類似検索を実現します。これらは階層的なグラフ構造を使い、探索の計算量を線形から対数的に減らし、大規模な用途でも実用的にします。HNSWは上層で長距離接続、下層で短距離接続を持つ多層グラフで高速な探索を可能にします。

企業は従来のキーワード検索では整理が難しい大量の非構造化データ(メール、文書、サポートチケットなど)を生成しています。ベクトル検索はこれらのデータの意味的理解を実現し、インテリジェント検索、レコメンデーション、異常検知、RAG(検索拡張生成)などのアプリケーションに活用されています。市場調査によると、ベクトルデータベース市場は2025年に26.5億ドルから2030年には89.5億ドルへ成長すると予測されています。

ベクトルデータベースは、高次元ベクトルデータの保存・インデックス・検索に最適化された専門システムです。HNSW、IVF(Inverted File Index)、ScaNNなどの効率的なインデックス手法を実装し、大規模な類似検索を高速に実現します。Milvus、Pinecone、Weaviate、Zilliz Cloudなどが代表例です。これらはベクトル演算の計算負荷を担い、インフラ管理の複雑さなく本番レベルのセマンティック検索やAIアプリ構築を可能にします。

ChatGPT、Perplexity、その他のプラットフォームでAIチャットボットがブランドを言及する方法を追跡します。AI存在感を向上させるための実用的なインサイトを取得します。

ベクトル検索が機械学習の埋め込みを利用して、正確なキーワードではなく意味に基づいて類似アイテムを見つける方法を解説します。ベクトルデータベース、ANNアルゴリズム、実際の応用例についても理解しましょう。...

ベクトル検索と、それがAIコンテンツ発見をどのように支えるかについてのコミュニティディスカッション。セマンティックマッチングに向けたコンテンツ最適化を実践するテクニカルマーケターの実体験。...

ベクトル埋め込みがAIシステムに意味的な理解をもたらし、コンテンツとクエリのマッチングを可能にする仕組みを学びましょう。意味検索やAIによるコンテンツマッチングの技術を探ります。...