Wat is Prompt Engineering voor AI-zoekopdrachten - Complete Gids

Leer wat prompt engineering is, hoe het werkt met AI-zoekmachines zoals ChatGPT en Perplexity, en ontdek essentiële technieken om je AI-zoekresultaten te optima...

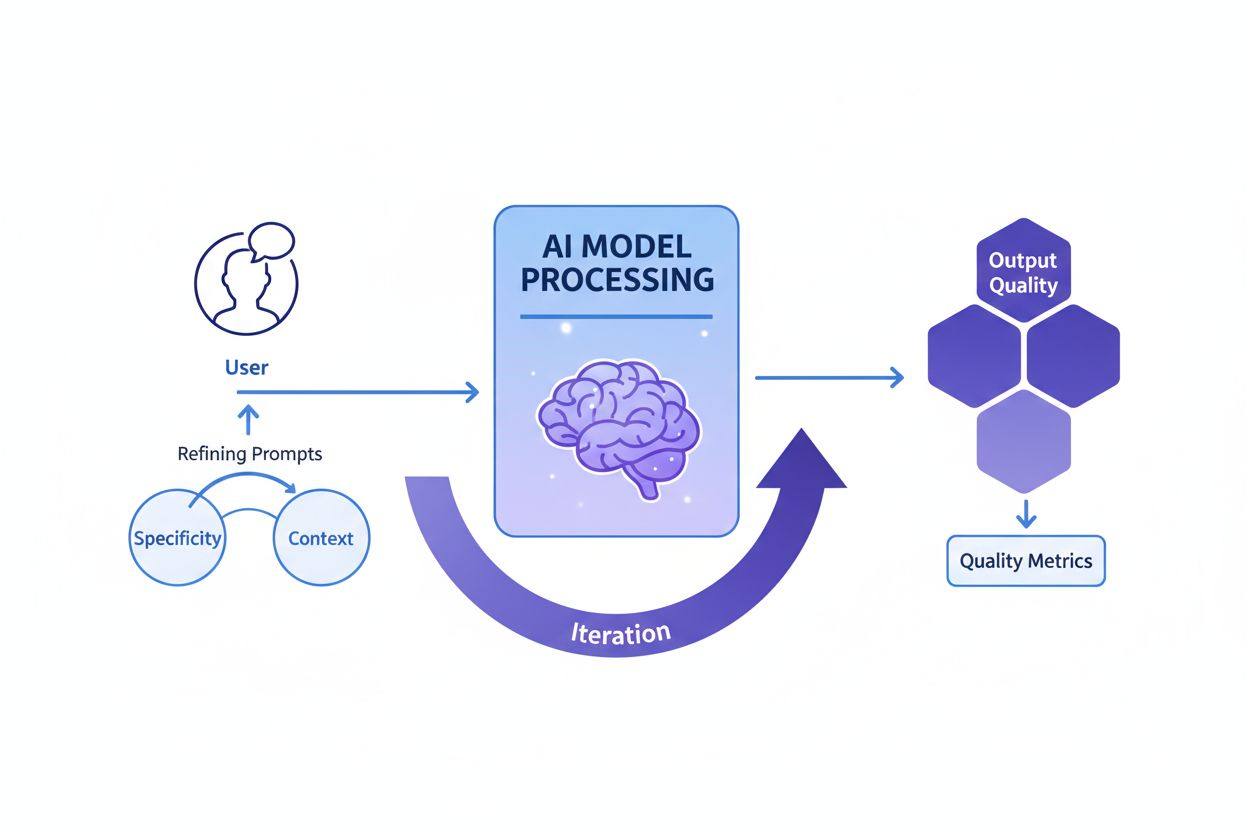

Prompt engineering is het proces van het opstellen, verfijnen en optimaliseren van instructies in natuurlijke taal om generatieve AI-modellen te sturen naar het produceren van gewenste, nauwkeurige en relevante output. Het omvat iteratief experimenteren met formulering, context en structuur om de AI-prestaties te maximaliseren zonder het onderliggende model aan te passen.

Prompt engineering is het proces van het opstellen, verfijnen en optimaliseren van instructies in natuurlijke taal om generatieve AI-modellen te sturen naar het produceren van gewenste, nauwkeurige en relevante output. Het omvat iteratief experimenteren met formulering, context en structuur om de AI-prestaties te maximaliseren zonder het onderliggende model aan te passen.

Prompt engineering is het systematisch ontwerpen, verfijnen en optimaliseren van instructies in natuurlijke taal—zogenaamde prompts—om generatieve AI-modellen te sturen naar het produceren van gewenste, nauwkeurige en contextueel relevante output. In plaats van het onderliggende AI-model zelf aan te passen, werken prompt engineers met de bestaande mogelijkheden van het model door hun input zorgvuldig te structureren en zo te beïnvloeden hoe het model informatie verwerkt en antwoorden genereert. Deze discipline ontstond als een essentiële vaardigheid tijdens de generatieve AI-boom van 2023-2025, toen organisaties beseften dat toegang tot krachtige AI-tools zoals ChatGPT, Claude, Perplexity en Google AI niet genoeg was zonder expertise in effectieve communicatie met deze systemen. Prompt engineering overbrugt de kloof tussen menselijke intentie en AI-capaciteit en vertaalt vage bedrijfsdoelen naar uitvoerbare, hoogwaardige AI-output. De praktijk is fundamenteel iteratief en vereist voortdurende experimentatie, testen en verfijning om optimale resultaten te behalen voor specifieke use cases.

Het concept van prompt engineering ontstond organisch na de publieke release van ChatGPT in november 2022, toen miljoenen gebruikers begonnen te experimenteren met hoe ze betere resultaten konden halen uit grote taalmodellen. Vroege gebruikers ontdekten dat de kwaliteit van AI-output sterk varieerde afhankelijk van hoe vragen werden geformuleerd, welke context werd gegeven en hoe specifiek de instructies waren. Deze observatie leidde tot de formalisering van prompt engineering als een apart vakgebied. In 2023 begonnen grote technologiebedrijven zoals OpenAI, Google, Microsoft en Anthropic toegewijde prompt engineers aan te nemen, met sommige functies die salarissen van meer dan $300.000 boden. De wereldwijde prompt engineering markt werd in 2023 gewaardeerd op ongeveer $222,1 miljoen en zal naar verwachting groeien tot $2,06 miljard in 2030, wat neerkomt op een aanzienlijk samengesteld jaarlijks groeipercentage (CAGR). Deze snelle groei weerspiegelt het toenemende besef dat prompt engineering geen tijdelijke trend is maar een fundamentele vaardigheid voor organisaties die AI op schaal inzetten. De discipline is geëvolueerd van simpel trial-and-error tot een geavanceerde praktijk met gevestigde technieken, evaluatiekaders en best practices, gedocumenteerd door toonaangevende AI-onderzoeksinstellingen en industrie-experts.

Effectieve prompt engineering rust op verschillende fundamentele principes die hoogwaardige prompts onderscheiden van ineffectieve. Specificiteit is cruciaal—hoe gedetailleerder en beschrijvender een prompt, hoe beter het AI-model de exacte eisen begrijpt en bijpassende output genereert. In plaats van een AI te vragen “schrijf over honden”, vraagt een specifieke prompt bijvoorbeeld “maak een veterinaire gids van 300 woorden over gezondheidsproblemen bij golden retrievers, geschreven voor huisdiereigenaren met leesniveau groep 8, gericht op preventieve zorg.” Context bieden is even belangrijk; relevante achtergrondinformatie, voorbeelden of beperkingen helpen het model zich te focussen en relevantere antwoorden te geven. Duidelijkheid zorgt ervoor dat instructies ondubbelzinnig zijn en direct communiceren wat de taak is, zonder dat het model vage taal moet interpreteren. Iteratieve verfijning erkent dat de eerste prompt zelden het beste resultaat oplevert; succesvolle prompt engineers testen voortdurend variaties, analyseren output en passen hun aanpak aan op basis van de resultaten. Afstemming op toon en stijl houdt in dat je het gewenste stemgebruik, formaliteitsniveau en presentatieformaat specificeert om output te laten aansluiten bij de verwachtingen van de organisatie of gebruiker. Deze principes gelden op alle AI-platforms, of gebruikers nu prompts maken voor ChatGPT, Perplexity, Claude of Google AI Overviews, en zijn dus universeel waardevol voor iedereen die AI-interacties wil optimaliseren.

Het vakgebied prompt engineering heeft tal van geavanceerde technieken ontwikkeld om verschillende soorten taken en complexiteitsniveaus aan te pakken. Zero-shot prompting is de meest directe aanpak: het AI-model krijgt een duidelijke instructie of vraag zonder voorbeelden of extra context. Deze methode werkt goed voor eenvoudige taken, maar heeft moeite met complexe redeneringen. Few-shot prompting verbetert prestaties door het model een of meer voorbeelden te geven die het gewenste outputformaat of redeneerpatroon demonstreren—het model leert als het ware door voorbeeld. Chain-of-thought (CoT) prompting breekt complexe problemen op in tussenliggende redeneerstappen, stimuleert het model om zijn denkproces te tonen en verhoogt de nauwkeurigheid bij meerstapsproblemen. Prompt chaining verdeelt een complexe taak in kleinere, opeenvolgende subtaken, waarbij de output van de ene prompt als input voor de volgende wordt gebruikt—dit vergroot de betrouwbaarheid en consistentie bij gecompliceerde workflows. Tree-of-thought prompting generaliseert chain-of-thought door meerdere mogelijke redeneerroutes tegelijk te verkennen, waardoor het model verschillende benaderingen kan evalueren en de beste kan kiezen. Maieutic prompting houdt in dat het model zijn redenering uitlegt en vervolgens vervolgvragen krijgt om specifieke delen van die uitleg uit te diepen—zo kunnen inconsistenties worden opgespoord en gecorrigeerd. Generated knowledge prompting vraagt het model eerst relevante feiten of achtergrondinformatie te genereren voordat het aan de hoofdtaak begint, zodat het model wordt gevoed met bruikbare context. Self-refine prompting laat het model een probleem oplossen, zijn eigen oplossing bekritiseren en vervolgens verbeteren op basis van die kritiek—dit proces wordt herhaald tot het gewenste resultaat is bereikt. Elke techniek dient specifieke doelen, en de meest effectieve prompt engineering combineert vaak meerdere technieken, strategisch afgestemd op de taak.

| Techniek | Beste Voor | Complexiteit | Typisch Gebruik | Effectiviteit |

|---|---|---|---|---|

| Zero-shot Prompting | Eenvoudige, directe taken | Laag | Basisvragen, eenvoudige instructies | Goed voor eenvoudige taken, beperkt bij complexe redenering |

| Few-shot Prompting | Taken die formatconsistentie vereisen | Middel | Contentgeneratie, classificatie, opmaak | Uitstekend om gewenste outputpatronen te tonen |

| Chain-of-Thought | Meertraps redeneerproblemen | Middel-Hoog | Rekensommen, logische deductie, analyse | Verhoogt nauwkeurigheid bij complexe taken aanzienlijk |

| Prompt Chaining | Complexe workflows met afhankelijkheden | Hoog | Meerfasige contentcreatie, dataverwerking | Uitstekend bij het opdelen van complexe problemen |

| Tree-of-Thought | Problemen met meerdere oplossingsroutes | Hoog | Strategische planning, creatief probleemoplossen | Superieur bij het verkennen van alternatieve benaderingen |

| Generated Knowledge | Taken die achtergrondcontext vereisen | Middel | Domeinspecifieke vragen, technische uitleg | Verbetert relevantie en nauwkeurigheid door context |

| Self-Refine | Kwaliteitskritische toepassingen | Hoog | Professioneel schrijven, technische documentatie | Levert de hoogste kwaliteit output door iteratie |

Begrijpen hoe prompts het gedrag van AI-modellen beïnvloeden, vereist basiskennis van hoe grote taalmodellen (LLMs) werken. Deze modellen verwerken tekst door deze op te delen in tokens (kleine tekstfragmenten) en voorspellen vervolgens het meest waarschijnlijke volgende token op basis van patronen die tijdens de training zijn geleerd. De prompt dient als initiële context die alle volgende voorspellingen vormgeeft. Als een prompt specifieke instructies, voorbeelden of beperkingen bevat, vernauwt dit de waarschijnlijkheidsverdeling van mogelijke output en stuurt het model richting antwoorden die aansluiten bij de intentie van de prompt. Temperature- en top-p sampling-parameters beïnvloeden de variabiliteit van de output: lagere temperaturen geven meer deterministische, gerichte antwoorden, terwijl hogere temperaturen de creativiteit en diversiteit verhogen. Het context window (hoeveel tekst het model tegelijk kan verwerken) beperkt hoeveel informatie in een prompt past; langere prompts nemen meer ruimte in beslag, waardoor er minder overblijft voor de daadwerkelijke taak. Effectieve prompt engineers begrijpen deze technische beperkingen en ontwerpen prompts die hierbinnen werken. Voor organisaties die merkzichtbaarheid op AI-platforms monitoren met tools als AmICited, is inzicht in deze mechanismen cruciaal, omdat de ingevoerde prompts bepalen welke informatie AI-systemen ophalen en citeren. Een goed ontworpen prompt als “noem de drie belangrijkste bedrijven in cloud computing” levert andere resultaten op dan “noem innovatieve cloud computing-bedrijven opgericht na 2015”, wat kan beïnvloeden welke merken zichtbaarheid krijgen in AI-gegenereerde antwoorden.

Effectieve prompt engineering implementeren binnen organisaties vereist het volgen van gevestigde best practices, ontstaan uit academisch onderzoek en praktijkervaring. Begin eenvoudig en iteratief is het basisprincipe—start met een eenvoudige prompt en voeg geleidelijk complexiteit toe, waarbij je bij elke stap test wat de resultaten verbetert. Wees expliciet over vereisten door het gewenste outputformaat, lengte, toon en beperkingen duidelijk te benoemen; vage prompts leveren vage resultaten op. Bied relevante context, maar overlaad het model niet; geef achtergrondinformatie die helpt, maar vermijd details die het context window onnodig vullen. Gebruik duidelijke scheidingstekens zoals “###” of “—” om verschillende delen van een prompt te onderscheiden (instructies, context, voorbeelden), zodat het model de structuur beter begrijpt. Vermijd ontkenningen en formuleer wat je wél wilt; zeg in plaats van “wees niet te formeel” liever “gebruik een informele toon”. Test systematisch meerdere variaties, verander telkens één element om te begrijpen wat de resultaten verbetert. Documenteer succesvolle prompts centraal, zodat teams een bibliotheek van geteste sjablonen kunnen hergebruiken en aanpassen. Monitor prestatie-indicatoren zoals nauwkeurigheid, relevantie, consistentie en gebruikers tevredenheid om objectief te beoordelen of prompts hun doel bereiken. Implementeer feedbackloops waarbij gebruikersfeedback direct leidt tot verfijning van prompts, zodat er een continue verbetercyclus ontstaat. Organisaties die deze werkwijzen toepassen, melden aanzienlijke verbeteringen in AI-outputkwaliteit en consistentie, en minder tijdverlies aan handmatige correcties.

De relatie tussen prompt engineering en AI-zichtbaarheid monitoring wordt steeds belangrijker voor organisaties die willen weten hoe hun merken, producten en content verschijnen in AI-gegenereerde antwoorden. Platforms als AmICited volgen merkvermeldingen op ChatGPT, Perplexity, Google AI Overviews en Claude, maar de prompts die gebruikers invoeren bepalen direct welke informatie de AI ophaalt en citeert. Organisaties die prompt engineering begrijpen, kunnen strategische zoekopdrachten samenstellen om te ontdekken hoe hun merk wordt weergegeven, welke concurrenten worden genoemd en of hun content correct wordt geciteerd. Een bedrijf kan bijvoorbeeld prompts ontwerpen als “Wat zijn de beste oplossingen voor enterprise data management?” om te zien hoe AI-systemen hun aanbod positioneren ten opzichte van concurrenten. Door te analyseren welke prompts gunstige of ongunstige merkvermeldingen opleveren, kunnen organisaties contentstrategieën ontwikkelen die hun zichtbaarheid in AI-antwoorden verbeteren. Dit vormt een nieuw terrein in search engine optimization (SEO) en merkbeheer, waarbij weten hoe je met AI-systemen communiceert net zo belangrijk wordt als traditionele zoekwoordoptimalisatie. Bedrijven die investeren in prompt engineering expertise verwerven strategisch voordeel in het AI-gedreven informatielandschap en verzekeren zich van passende zichtbaarheid en representatie.

Of een prompt echt effectief is, meet je aan de hand van duidelijke, objectieve criteria die aansluiten bij specifieke bedrijfsdoelen. Nauwkeurigheid meet of de output feitelijk correct is, essentieel voor sectoren als zorg, financiën en juridisch, waar fouten ernstige gevolgen kunnen hebben. Relevantie beoordeelt hoe goed de output aansluit op de oorspronkelijke intentie van de gebruiker, vaak gemeten met semantische vergelijkingsscores of handmatige evaluatie. Consistentie bekijkt of identieke prompts vergelijkbare antwoorden opleveren bij meerdere pogingen, cruciaal voor toepassingen die betrouwbare resultaten vereisen. Volledigheid bepaalt of antwoorden alle vereiste elementen bevatten, gemeten als de verhouding tussen gedekte en vereiste onderdelen. Specificiteit beoordeelt de mate van detail in antwoorden, belangrijk voor technische documentatie en specialistische domeinen. Leesbaarheid en samenhang meten de duidelijkheid en logische opbouw, geëvalueerd met leesbaarheidsformules of menselijke beoordeling. Gebruikerstevredenheid geeft aan hoe tevreden eindgebruikers zijn met de output, doorgaans verzameld via enquêtes of ingebouwde feedbackmechanismen. Organisaties die uitgebreide evaluatiekaders invoeren, melden dat de effectiviteit van prompts met 40-60% verbetert door systematische meting en verfijning. Tools als Portkey, DSPy en Hugging Face’s Evaluate Library bieden geautomatiseerde metrics voor deze dimensies, terwijl A/B-testplatformen zij-aan-zij vergelijking van promptversies mogelijk maken. De meest geavanceerde organisaties combineren meerdere evaluatiemethoden en wegen metrics volgens hun eigen prioriteiten om tot een totaalscore voor promptkwaliteit te komen.

De arbeidsmarkt voor prompt engineering is explosief gegroeid, wat het grote belang van deze vaardigheid in het AI-tijdperk weerspiegelt. In 2025 rapporteert Glassdoor een gemiddeld basissalaris van ongeveer $123.274 per jaar voor prompt engineers, met functies variërend van $90.000 (25e percentiel) tot meer dan $335.000 voor gespecialiseerde rollen bij toonaangevende AI-bedrijven zoals Anthropic. Indeed meldt meer dan 110.000 openstaande prompt engineer vacatures, wat duidt op aanhoudende vraag in diverse sectoren. Grote technologiebedrijven zoals Google, Microsoft, Amazon en Meta werven actief prompt engineers met salarissen tussen $110.000 en $250.000. AI-bedrijven als OpenAI, Anthropic, Cohere en Midjourney bieden uitdagende projecten met remote-first cultuur en aantrekkelijke aandelenopties. Grote ondernemingen in financiën, zorg, verzekeringen en andere gereguleerde sectoren zoeken prompt engineers voor AI-integratie, vaak met functietitels als “AI Solutions Architect”. Consultancybedrijven zoals de Big Four en specialisten als Booz Allen Hamilton bieden functies tot $212.000 voor overheids- en enterpriseprojecten. Freelance kansen op platforms als Upwork en Toptal leveren $100-$300 per uur op voor ervaren professionals. De carrière vereist meestal een bachelordiploma in informatica of een gerelateerd vakgebied, maar ook professionals met een achtergrond in schrijven, journalistiek of creatieve sectoren stappen succesvol over naar prompt engineering. Het belangrijkst is aantoonbare vaardigheid met AI-tools, een portfolio met prompt engineering prestaties en een houding van continu leren in een snel veranderend vakgebied.

Prompt engineering staat voor een grote ontwikkeling nu AI-technologie en organisatiepraktijken volwassen worden. Multimodale prompting zal steeds vaker tekst, code, afbeeldingen en andere datatypes combineren in één prompt, waardoor engineers moeten begrijpen hoe verschillende modaliteiten binnen AI-systemen samenwerken. Adaptieve prompts die zich automatisch aanpassen op basis van context, gebruikersgedrag en realtime feedback zullen geavanceerder worden en bewegen van statische sjablonen naar dynamische systemen. Context engineering ontstaat als doorontwikkeling van prompt engineering, met nadruk op de bredere context waarin prompts functioneren in plaats van alleen de prompttekst. Ethische en eerlijke prompting krijgt meer aandacht nu organisaties verantwoord AI-gebruik prioriteren, met prompts die bias tegengaan, transparantie waarborgen en voldoen aan regelgeving. Integratie met AI-agents vervaagt de grens tussen prompt engineering en bredere AI-orkestratie, waarbij prompts onderdeel worden van grotere autonome systemen. De rol van “prompt engineer” kan evolueren of samensmelten met functies als “AI-strateeg”, “context engineer” of “AI-productmanager”, wat de volwassenwording van het vakgebied weerspiegelt. Organisaties die nu investeren in prompt engineering expertise zijn goed gepositioneerd om te leiden in de AI-economie, nu effectief communiceren met en sturen van AI-systemen steeds centraler wordt voor concurrentievoordeel. Voor bedrijven die AmICited gebruiken om merkzichtbaarheid in AI-antwoorden te monitoren, wordt kennis van prompt engineering essentieel om hun aanwezigheid in het AI-zoeklandschap te optimaliseren en accurate representatie op platforms als ChatGPT, Perplexity, Google AI en Claude te waarborgen.

Prompt engineering verschilt fundamenteel van traditioneel programmeren: in plaats van expliciete code te schrijven die direct gedrag aanstuurt, sturen prompt engineers AI-modellen via instructies in natuurlijke taal. Traditioneel programmeren vereist precieze syntax en logica, terwijl prompt engineering gebaseerd is op iteratieve verfijning, het aanbieden van context en strategische formuleringen om AI-output richting het gewenste resultaat te sturen. Beide vereisen probleemoplossende vaardigheden, maar prompt engineering legt de nadruk op communicatie en experimenteren boven strikte codesyntax.

Prompt engineering beïnvloedt direct hoe merken verschijnen in AI-gegenereerde antwoorden op platforms als ChatGPT, Perplexity, Google AI Overviews en Claude. Goed ontworpen prompts kunnen bepalen of, en hoe, AI-systemen merken noemen of aanbevelen. Voor organisaties die tools als AmICited gebruiken om AI-zichtbaarheid te monitoren, helpt begrip van prompt engineering bij het voorspellen en optimaliseren van hoe hun merk verschijnt in AI-antwoorden, wat zorgt voor een accurate representatie en een sterke positie in het AI-zoeklandschap.

Belangrijke technieken zijn onder andere chain-of-thought prompting (complexe problemen in stappen opdelen), few-shot prompting (voorbeelden geven), zero-shot prompting (directe instructies), prompt chaining (taken splitsen in subtaken) en tree-of-thought prompting (meerdere redeneerpaden verkennen). De effectiviteit van elke techniek hangt af van de taakcomplexiteit, modelmogelijkheden en het gewenste type output. De meest succesvolle implementaties combineren meerdere technieken, afgestemd op het specifieke gebruiksdoel.

De effectiviteit van prompts wordt gemeten met metrics zoals nauwkeurigheid (feitelijke correctheid), relevantie (overeenstemming met intentie), consistentie (reproduceerbaarheid), volledigheid (dekking van vereiste elementen) en gebruikers tevredenheid. Evaluatiemethoden zijn onder meer handmatige beoordeling, automatische analyse met tools zoals BLEU en ROUGE scores, A/B-tests met verschillende promptversies en het verzamelen van directe gebruikersfeedback. Organisaties combineren vaak meerdere metrics tot een gewogen score die hun specifieke prioriteiten weerspiegelt.

Prompt engineers hebben sterke communicatie- en schrijfvaardigheden nodig, inzicht in hoe grote taalmodellen werken, bekendheid met AI-concepten als tokenisatie en contextvensters, en creatief probleemoplossend vermogen. Technische vaardigheden in Python, SQL of JavaScript zijn vaak gewenst, maar niet altijd vereist. Domeinkennis in specifieke sectoren (zorg, financiën, juridisch) levert extra beloning op. Het belangrijkste is dat succesvolle prompt engineers continu leren en experimenteren.

Prompt engineering is cruciaal voor AI-monitoring omdat de prompts die gebruikers invoeren in AI-systemen bepalen welke informatie die systemen ophalen en citeren. Door prompt engineering te begrijpen, kunnen organisaties zoekopdrachten samenstellen die inzicht geven in hoe hun merk, content of domein verschijnt in AI-antwoorden. AmICited volgt deze vermeldingen op meerdere AI-platforms, waardoor kennis van prompt engineering essentieel is voor het optimaliseren van merkzichtbaarheid in AI-gegenereerde content.

De arbeidsmarkt voor prompt engineering blijft sterk met een gemiddeld salaris van ongeveer $123.274 per jaar volgens Glassdoor, met functies variërend van $90.000 tot meer dan $335.000 afhankelijk van ervaring en bedrijf. Meer dan 110.000 prompt engineer posities staan momenteel open op vacaturesites. Het vakgebied ontwikkelt zich van een gespecialiseerde rol naar bredere AI-integratietaken, met kansen bij techbedrijven, enterprises, consultancy’s en freelanceplatforms. Thuiswerken is gebruikelijk, waardoor locatie minder beperkend is.

Prompt engineering zal zich waarschijnlijk ontwikkelen richting multimodale prompting (combinatie van tekst, code en afbeeldingen), adaptieve prompts die zich aanpassen aan context, en meer aandacht voor AI-ethiek en eerlijkheid. Naarmate AI-modellen capabeler worden, kan prompt engineering samenkomen met bredere AI-strategie- en context engineering-rollen. Het vakgebied zal waarschijnlijk nadruk leggen op verantwoord gebruik van AI, het tegengaan van bias en het waarborgen van transparantie in AI-output op platforms zoals die gemonitord worden door AmICited.

Begin met het volgen van hoe AI-chatbots uw merk vermelden op ChatGPT, Perplexity en andere platforms. Krijg bruikbare inzichten om uw AI-aanwezigheid te verbeteren.

Leer wat prompt engineering is, hoe het werkt met AI-zoekmachines zoals ChatGPT en Perplexity, en ontdek essentiële technieken om je AI-zoekresultaten te optima...

Leer hoe prompt engineering GEO-strategie versterkt om jouw merk door AI-zoekmachines als ChatGPT, Perplexity en Google AI Overviews te laten citeren.

Discussie in de community over de vraag of marketeers prompt engineering-vaardigheden nodig hebben om te optimaliseren voor AI-zoekopdrachten. Inzicht in hoe ge...