Hvorfor original forskning er viktig for AI-synlighet og siteringer

Oppdag hvorfor det å lage original forskning er kritisk for AI-synlighet. Lær hvordan original forskning hjelper merkevaren din å bli sitert i AI-genererte svar...

Lær hvordan du lager originale data og forskning som AI-systemer aktivt siterer. Oppdag strategier for å gjøre dine data synlige for ChatGPT, Perplexity, Google Gemini og Claude, samtidig som du bygger bærekraftig AI-synlighet.

I kunstig intelligens’ tidsalder har originale data blitt det nye konkurransefortrinnet for merkevarer som ønsker synlighet utover tradisjonelle søkerangeringer. Etter hvert som AI-plattformer som ChatGPT, Perplexity, Google Gemini og Claude i økende grad styrer hvordan publikum oppdager informasjon, har synlighetsreglene endret seg fundamentalt. I stedet for å konkurrere om posisjon null i Googles søkeresultater, må organisasjoner nå skape data som AI-systemer aktivt ønsker å sitere og referere til. Denne transformasjonen gjenspeiler et bredere skifte fra innholdsbasert SEO til det eksperter kaller “Generative Engine Optimization” (GEO), hvor AI-sitering har erstattet tradisjonelle rangeringer som hovedmåling for synlighet. Plattformene som syntetiserer informasjon til direkte svar—enten gjennom retrieval-augmented generation (RAG) eller modell-native synteser—foretrekker kilder som gir klare, utvinnbare og autoritative originale data. Organisasjoner som forstår dette skiftet og investerer i å skape originale data, egen forskning og unike innsikter, posisjonerer seg for å oppnå siteringer på tvers av flere AI-plattformer samtidig, og bygger bevissthet og troverdighet blant brukere som kanskje aldri ser tradisjonelle søkeresultater.

Ulike AI-plattformer benytter fundamentalt forskjellige arkitekturer for å oppdage og sitere kilder, noe som direkte påvirker hvordan dine originale data blir vist og kreditert. Å forstå disse mekanismene er avgjørende for å optimalisere innholdssynlighet i AI-landskapet. Skillet mellom modell-native synteser (der AI genererer svar fra treningsdatamønstre) og retrieval-augmented generation (der AI søker etter levende kilder og syntetiserer fra resultatene) forklarer hvorfor noen plattformer gir eksplisitte siteringer mens andre gir svar uten kildehenvisning. Plattformene som bruker RAG-systemer kan spore svarene sine tilbake til spesifikke kilder, noe som gjør sitering rett frem og sporbar. Modell-native systemer derimot, avhenger av sannsynlighetsbasert kunnskap lært under trening, noe som gjør kildehenvisning vanskelig eller umulig uten ekstra plugins eller integrasjoner.

| AI-plattform | Siteringsmetode | Datakildeprioritet | Synlighetsinnvirkning |

|---|---|---|---|

| ChatGPT | Modell-native (standard); lenkede siteringer med plugins/søkemodus aktivert | Treningsdata + levende nett når aktivert; prioriterer nylige, autoritative kilder når retrieval er aktiv | Lav uten plugins; moderat med søk aktivert; siteringer vises i svarteksten når tilgjengelig |

| Perplexity | Retrieval-først med inline nummererte siteringer | Live nettsøkresultater; prioriterer ferske, direkte relevante kilder; vektlegger kildens fremtredendehet | Høy; nummererte siteringer med klare kildelenker; førsteposisjonskilder får uforholdsmessig mye trafikk |

| Google Gemini | Integrert med Google Søk og Knowledge Graph | Live indekserte sider + Knowledge Graph-enheter; prioriterer sider med strukturerte data og E-E-A-T-signaler | Høy; siteringer vises som kildelenker i AI Overviews; strukturerte data øker siteringssannsynligheten |

| Claude | Modell-native (standard); nettsøkeevner lanseres i 2025 | Treningsdata + selektivt nettsøk; prioriterer sikre, autoritative kilder | Moderat; siteringer vises når nettsøk er aktivert; vekt på nøyaktighet og kilde-troverdighet |

De praktiske konsekvensene er betydelige: plattformer som Perplexity og Google Gemini, som aktivt søker på nettet, kan sitere innholdet ditt umiddelbart etter publisering hvis det møter deres kvalitets- og relevanskrav. ChatGPT og Claude, som i større grad er avhengige av treningsdata, kan bruke lengre tid på å inkorporere din forskning, men gir andre synlighetsmuligheter gjennom plugins og integrasjoner. For innholdsskapere betyr dette å forstå hvilke plattformer målgruppen din bruker og optimalisere dataene deretter—enten det innebærer utvinnbart, strukturert innhold for Perplexitys live retrieval, eller å bygge autoritetssignaler som påvirker treningsdatainkludering for modell-native systemer.

Strukturerte data har utviklet seg fra å være en ekstra SEO-taktikk til å bli en strategisk nødvendighet for AI-synlighet. Når du implementerer schema markup med Schema.org-vokabular, hjelper du ikke bare Google å forstå innholdet ditt—du lager et maskinlesbart lag som AI-systemer pålitelig kan forankre sine svar i. Dette strukturerte datalaget, ofte omtalt som en “content knowledge graph”, definerer eksplisitt enheter (personer, produkter, tjenester, steder, organisasjoner) og forholdene mellom dem, noe som gjør det dramatisk lettere for AI-systemer å forstå hva merkevaren din er, hva den tilbyr, og hvordan den bør tolkes. Ifølge nyere forskning fra BrightEdge, hadde sider med robust schema markup høyere siteringsrate i Googles AI Overviews, noe som tyder på at strukturerte data direkte påvirker sannsynligheten for sitering. Den nye Model Context Protocol (MCP), tatt i bruk av både OpenAI og Google DeepMind, representerer neste utviklingstrinn—i praksis en standardisert API for å koble AI-modeller til strukturerte datakilder. Ved å implementere schema markup i stor skala, bygger virksomheter et fundament som reduserer hallusinasjoner i AI-svar, forbedrer faktagrunnlaget og gjør dataene deres lettere tilgjengelige for retrieval-systemer. Dette er spesielt viktig fordi AI-systemer som trenes på ustrukturert tekst ofte sliter med nøyaktighet; strukturerte data gir den kontekstuelle klarheten som gjør at LLM-er kan generere mer pålitelige og attribuerbare svar som trygt siterer dine originale data.

Den mest effektive strategien for å oppnå AI-siteringer er å lage originale data som er utvinnbare, autoritative og tilpasset hvordan AI-systemer henter og syntetiserer informasjon. I stedet for å håpe at eksisterende innhold blir sitert, må du bevisst utforme dataprodukter som AI-plattformer lett kan oppdage, forstå og referere til. Her er de viktigste strategiene for å skape siteringsverdige originale data:

Utfør original forskning med åpen metodikk: AI-systemer prioriterer kilder som viser grundig forskningspraksis. Publiser studier, undersøkelser og analyser med klart dokumenterte metoder, utvalgsstørrelser og begrensninger. Når du viser arbeidet ditt, kan AI-plattformer trygt sitere funnene dine som autoritative. Eksempler inkluderer bransjebenchmarks, kundeatferdsstudier, markedsanalyser og egne dataanalyser som konkurrenter ikke kan kopiere.

Gjør data utvinnbare gjennom strukturerte formater: AI-systemer foretrekker innhold organisert som tabeller, lister, sammenligningsmatriser og FAQ-lignende Q&A-par fremfor tette avsnitt. En sammenligningstabell over konkurrentfunksjoner blir langt oftere sitert enn den samme informasjonen begravd i løpende tekst. Bruk overskrifter, punktlister og visuelle hierarkier som gjør innsiktene lett skannbare og tilgjengelige for AI-systemer.

Sørg for ferskhet og oppdateringssignaler: AI-plattformer, spesielt de som bruker live retrieval, prioriterer oppdatert informasjon. Inkluder synlige publiseringsdatoer, oppdateringstidspunkter og regelmessige innholdsoppdateringer. Når du viser at dataene dine er aktuelle og vedlikeholdte, regner AI-systemer dem som mer pålitelige enn utdaterte kilder. Dette er særlig viktig for tidskritiske data som priser, statistikk og markedstrender.

Bygg forfatter- og merkevareautoritet: AI-systemer vurderer kildens troverdighet før sitering. Bygg tydelig forfatterkompetanse (inkluder biografier med relevant ekspertise), organisatorisk autoritet (tilbakekoblinger, medieomtale, bransjeanerkjennelse) og domenekompetansesignaler. Når merkevaren din er anerkjent som autoritet i din kategori, blir du sitert oftere og mer fremtredende av AI-systemer.

Bruk klare enhetsdefinisjoner og relasjoner: Definer nøkkelenheter eksplisitt—selskapet ditt, produkter, tjenester, teammedlemmer og bransjebegreper. Bruk strukturerte data til å etablere relasjoner mellom disse enhetene. Når et AI-system forstår nøyaktig hvem du er og hvordan du henger sammen med bransjebegreper, kan det sitere deg mer nøyaktig og kontekstuelt.

Implementer korrekt attribusjon og kildehenvisning: Hvis dine originale data bygger på andre kilder, siter dem åpent. AI-systemer gjenkjenner og belønner kilder som krediterer sine egne kilder. Dette skaper en attribusjonskjede som øker tillit og siteringssannsynlighet i hele økosystemet.

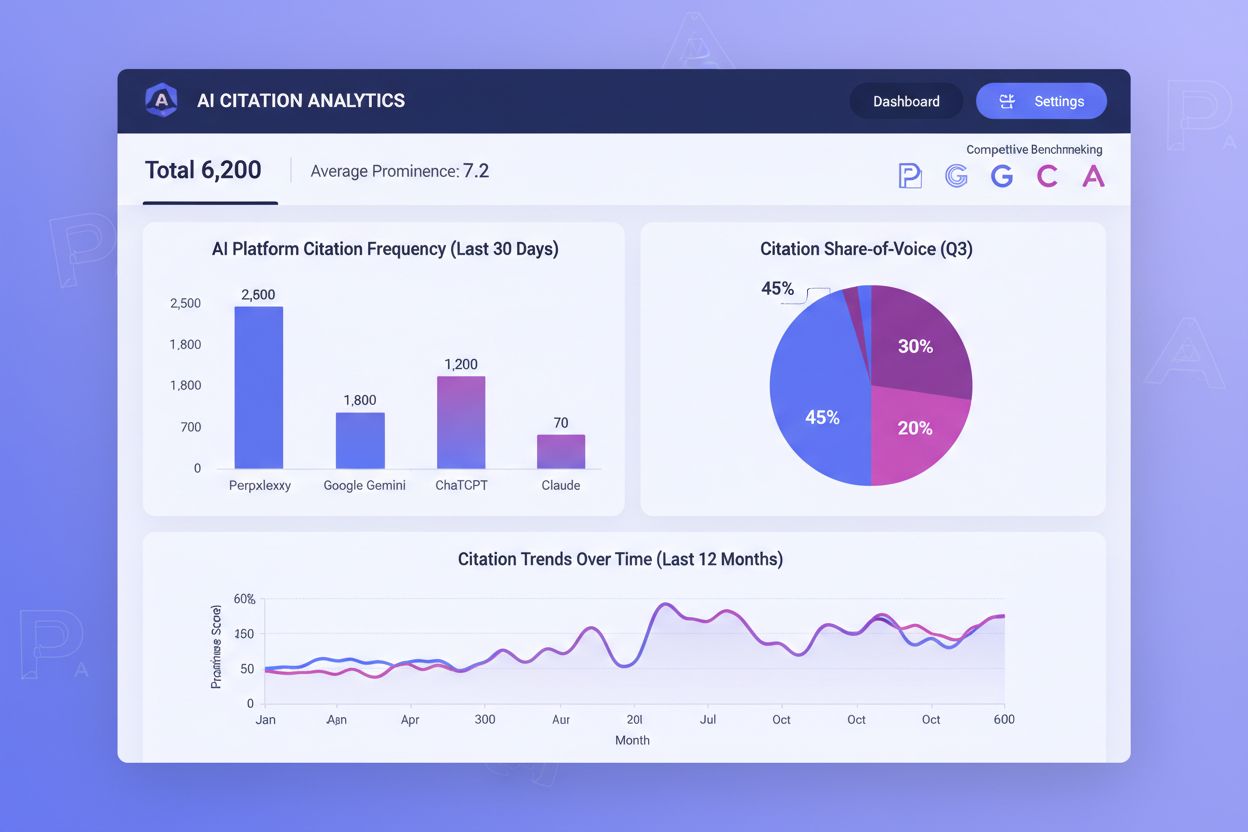

Å spore AI-siteringer har blitt like viktig som å overvåke tradisjonelle søkerangeringer, men de fleste organisasjoner mangler oversikt over hvor ofte innholdet deres blir sitert på tvers av AI-plattformer. Siteringsfrekvens, siteringsfremtredende og share-of-voice er de tre kjernekriteriene som avgjør suksessen din i AI-formidlet oppdagelse. Siteringsfrekvens måler hvor ofte innholdet ditt vises i AI-svar på dine målrettede spørsmål—hvis du blir sitert på 40% av relevante forespørsler mens konkurrentene får 60%, har du et tydelig optimaliseringsgap. Siteringsfremtredende er enda viktigere: et sitat i første posisjon i Perplexitys nummererte liste gir uforholdsmessig mer synlighet enn et sitat i femte posisjon. Share-of-voice viser din konkurranseposisjon—hvis merkevaren din får sitater på 25% av kategoridefinierende spørsmål mens toppkonkurrenten får 50%, mister du betydelig synlighet.

Verktøy som AmICited.com har blitt essensielle løsninger for å overvåke AI-siteringer på tvers av plattformer. Disse tjenestene sporer hvilke av dine sider som får siteringer på Perplexity, Google AI Overviews, ChatGPT med søk og andre AI-systemer, og viser hvilket innhold som faktisk gir AI-drevet synlighet. Ved å overvåke siteringsmønstre over tid, kan du identifisere hvilke innholdstyper, emner og formater som gir flest siteringer, og deretter gjenta de mest effektive strategiene. Konkurransebenchmarking gjennom slike verktøy viser nøyaktig hvor du taper siteringer til konkurrenter, slik at du kan optimalisere målrettet. Dataene avslører om dine siteringsutfordringer er universelle på tvers av AI-plattformer eller spesifikke for visse systemer—hvis du ofte blir sitert på Perplexity, men sjelden i Google AI Overviews, bør optimaliseringsstrategien tilpasses deretter. Posisjonsvektede målinger anerkjenner at tidlige siteringer gir uforholdsmessig mye verdi; et verktøy som vektlegger førsteposisjons-sitater høyere enn lavere posisjoner gir mer handlingsrettet innsikt enn rene tellemålinger. Ved å gjøre AI-siteringssporing til en kjernekomponent i innholdsstrategien din, kan du kontinuerlig optimalisere originale data for å øke både siteringsfrekvens og fremtredendehet, og dermed direkte forbedre synligheten din i et AI-drevet søkelandskap.

Å skape originale data som gir AI-siteringer kan ikke være et engangsprosjekt—det krever at man bygger en bærekraftig, tverrfaglig datastrategi som behandler data som en strategisk ressurs verdt kontinuerlig investering og styring. Organisasjoner som lykkes med AI-synlighet, implementerer strukturerte prosesser for jevnlige dataoppdateringer, slik at original forskning forblir aktuell og relevant. Dette innebærer å etablere regelmessige oppfriskningssykluser for sentrale datasett, oppdatere statistikk når ny informasjon oppstår, og opprettholde oppdateringssignaler som AI-systemene bruker for å vurdere kildens troverdighet. Utover innholdsoppdateringer må vellykkede organisasjoner samkjøre datastrategien på tvers av markedsføring, SEO, innhold, produkt og data-team gjennom enhetsstyring—felles definisjoner og taksonomier som sikrer konsistent, korrekt representasjon av merkevaren, produktene og bransjebegrepene på tvers av alle kanaler.

Den mest sofistikerte tilnærmingen behandler strukturerte data og kunnskapsgrafer som virksomhetskritisk infrastruktur. I stedet for å implementere schema markup side for side, bygger ledende organisasjoner omfattende kunnskapsgrafer som kobler alle enheter, temaer og relasjoner på tvers av digitale eiendeler. Dette krever teknisk kapasitet—verktøy og prosesser for å håndtere schema markup i stor skala—og organisatorisk enighet om datakvalitetsstandarder. Når det gjøres riktig, tjener denne infrastrukturen to formål: den forbedrer ekstern AI-synlighet samtidig som den muliggjør interne AI-initiativer. Ifølge Gartners 2024 AI Mandates for the Enterprise Survey er datatilgjengelighet og -kvalitet den største barrieren for vellykket AI-implementering; ved å investere i strukturerte data og enhetsstyring løser du både eksterne synlighetsutfordringer og interne AI-behov. Organisasjonene som vinner AI-synlighet, behandler original datastrukturering ikke som en markedsføringstaktikk, men som en grunnleggende forretningskapasitet, med dedikerte ressurser, tydelig ansvar og kontinuerlig optimalisering basert på siteringssporing og konkurransebenchmarking.

Spor hvor ofte dine originale data siteres på tvers av ChatGPT, Perplexity, Google AI Overviews og andre AI-plattformer. Få handlingsrettede innsikter for å optimalisere innholdet ditt for maksimal AI-synlighet.

Oppdag hvorfor det å lage original forskning er kritisk for AI-synlighet. Lær hvordan original forskning hjelper merkevaren din å bli sitert i AI-genererte svar...

Lær hvordan du lager original forskning og datadrevet PR-innhold som AI-systemer aktivt siterer. Oppdag de 5 egenskapene til innhold verdt å sitere og strategie...

Lær hvordan AI synlighets-APIer muliggjør sanntids overvåking av merkevareomtaler på tvers av ChatGPT, Perplexity og Gemini. Oppdag API-integrasjonsstrategier, ...