API Widoczności AI

Dowiedz się, czym są API Widoczności AI, jak działają i jak z nich korzystać do monitorowania marki w czasie rzeczywistym na ChatGPT, Perplexity, Gemini i innyc...

Dowiedz się, jak API widoczności AI umożliwiają monitorowanie w czasie rzeczywistym wzmianek o marce w ChatGPT, Perplexity i Gemini. Poznaj strategie integracji API, automatyzacji workflow oraz budowania własnych dashboardów dla sukcesu GEO.

API widoczności AI to fundamentalna zmiana w sposobie, w jaki marki monitorują swoją obecność na platformach generatywnej sztucznej inteligencji. W przeciwieństwie do tradycyjnego monitoringu SEO, który śledzi pozycje w wynikach wyszukiwania Google, API widoczności AI zapewniają programistyczny dostęp do danych w czasie rzeczywistym na temat tego, jak Twoja marka pojawia się w odpowiedziach generowanych przez AI, takich jak ChatGPT, Perplexity, Gemini i Claude. Te API udostępniają ustrukturyzowane dane na temat cytowań (gdy platformy AI odwołują się do Twoich treści), wzmianek (gdy marka jest wspominana), sentimentu (jak pozytywnie lub negatywnie jesteś opisywany/a) oraz pozycji konkurencyjnej (jak wypadasz na tle konkurencji w odpowiedziach AI). Przejście od tradycyjnej optymalizacji pod wyszukiwarki do widoczności w wyszukiwaniu AI wymaga zupełnie nowego podejścia do monitorowania. Algorytm Google ocenia strony pod kątem trafności i autorytetu, natomiast systemy generatywne AI pobierają i syntezują informacje z wielu źródeł, priorytetyzując dokładność, kompleksowość i jakość cytowań. Oznacza to, że widoczność marki zależy nie od pozycji na słowa kluczowe, lecz od tego, czy systemy AI uznają Twoje treści za wystarczająco autorytatywne, by je cytować w odpowiedziach na zapytania użytkowników. Pojawienie się API widoczności AI rozwiązuje kluczową lukę: tradycyjne platformy analityczne nie mogą śledzić wzmianek w odpowiedziach generowanych przez AI, pozostawiając marketerów bez wiedzy o szybko rosnącym kanale. ChatGPT obsługuje ponad 2,5 miliarda zapytań dziennie, Perplexity zanotowało 153 miliony wizyt w maju 2025, a AI Overviews Google pojawiają się w 57% wyników wyszukiwania. Te platformy zmieniają sposób, w jaki konsumenci pozyskują informacje, czyniąc monitoring oparty na API niezbędnym dla konkurencyjnej widoczności.

Wybór między monitoringiem przez API a scrapingiem interfejsu użytkownika to kluczowa decyzja wpływająca na niezawodność, legalność i skalowalność strategii widoczności AI. Web scraping — używanie botów do symulowania użytkownika i pobierania danych z interfejsów AI — wydaje się atrakcyjny, bo jest darmowy i nie wymaga oficjalnych partnerstw. Jednak ta metoda niesie poważne ryzyko techniczne i prawne, które podważają skuteczność długoterminowego monitoringu. Dokładność scrapingu jest fundamentalnie ograniczona: scrapery rejestrują tylko jeden, wąski wariant użytkownika (np. desktopowy ChatGPT z określonymi ustawieniami), pomijając różnorodność doświadczeń realnych użytkowników na urządzeniach mobilnych, głosowych interfejsach i różnych wersjach modeli. Oznacza to, że scraper może pokazywać 40% częstotliwości cytowań, podczas gdy realni użytkownicy widzą 25%, bo konfiguracja scrapera nie odpowiada rzeczywistym wzorcom użycia. Zgodność i ryzyko prawne są istotne: większość platform AI jednoznacznie zabrania scrapingu w swoich regulaminach. Naruszenie tych zapisów grozi blokadą konta, blokowaniem IP i potencjalnymi pozwami na podstawie ustawy o nadużyciach komputerowych. Monitoring przez API jest w pełni zgodny z regulaminami i tworzy ścieżkę audytu dla zgodności regulacyjnej.

| Metryka | Monitoring przez API | Web scraping |

|---|---|---|

| Dokładność | 99,2% | 71-84% |

| Opóźnienie danych | 150ms | 2-5 sekund |

| Ryzyko prawne | Zerowe (zgodne z regulaminem) | Wysokie (naruszenie regulaminu) |

| Koszt roczny | 1 200–3 500 USD | 8 000–15 000 USD |

| Skalowalność | Nieograniczone zapytania | Ograniczona przez infrastrukturę |

| Jakość danych | Ustrukturyzowany JSON | Surowy HTML do parsowania |

| Utrzymanie | Minimalne (wersjonowanie API) | Stałe (zmiany UI psują scrapery) |

| Zakres platform | 8+ jednocześnie | Jedna platforma na scraper |

| Czas rzeczywisty | Natychmiastowe odpowiedzi API | Opóźnienia cykli scrapingu |

Monitoring przez API dostarcza ustrukturyzowane, analizowalne dane w formacie JSON z odpowiednimi metadanymi, eliminując potrzebę parsowania, jak w przypadku scrapingu. Gdy platforma AI zmienia interfejs — a dzieje się to często — scrapery przestają działać bez ostrzeżenia, zwracając niekompletne lub uszkodzone dane. API dzięki wersjonowaniu zachowują kompatybilność wsteczną, gwarantując ciągłość integracji mimo rozwoju platform. Efektywność kosztowa także przemawia za API: choć infrastruktura scrapingu wydaje się darmowa na początku, utrzymanie sieci proxy, omijanie zabezpieczeń, zarządzanie uwierzytelnianiem i ciągłe naprawianie scraperów kosztuje zwykle 8 000–15 000 USD rocznie. Dostęp do API klasy enterprise kosztuje 1 200–3 500 USD rocznie i obejmuje wsparcie, dokumentację oraz gwarancje dostępności. Co najważniejsze, monitoring przez API skalowalny jest praktycznie do nieskończoności, podczas gdy scraping ma twarde ograniczenia. Możesz wykonywać tysiące zapytań na wielu platformach AI równocześnie przez API, podczas gdy scraping wymaga osobnej infrastruktury dla każdej platformy i boryka się z limitami. Różnica w jakości danych jest równie wyraźna: API zwracają ustrukturyzowane odpowiedzi z metadanymi (czas, źródła, poziom pewności), podczas gdy scrapery zwracają surowy HTML wymagający złożonego parsowania i często zawierający błędy.

API widoczności AI klasy enterprise oferują kompleksowy monitoring znacznie wykraczający poza proste śledzenie cytowań. Zrozumienie tych kluczowych funkcjonalności jest niezbędne do budowy skutecznych workflow monitorujących i automatyzujących:

Monitoring cytowań w czasie rzeczywistym: API rejestrują każde cytowanie Twoich treści przez systemy AI, w tym konkretne zapytanie, które je wywołało, model AI, pozycję cytowania (nagłówek vs. przypis), a także to, czy cytowanie zawiera link. Ta szczegółowość na poziomie zapytań pozwala zrozumieć, które tematy i formaty treści generują cytowania.

Ustrukturyzowane metadane i formatowanie odpowiedzi: API zwracają sformatowany JSON z polami dla URL cytowania, źródła, poziomu pewności i znaczników czasu. Dzięki temu możliwa jest bezpośrednia integracja z bazami danych i narzędziami BI bez potrzeby własnego parsowania.

Spójność między platformami: API oferują jednolite struktury danych dla ChatGPT, Perplexity, Gemini, Claude i innych, eliminując potrzebę budowania osobnych integracji dla każdej platformy. Dane konkurencyjne są normalizowane dla łatwego porównania.

Batch i streaming endpointy: API obsługują zarówno przetwarzanie wsadowe (np. 1 000 zapytań i asynchroniczny odbiór wyników), jak i streaming w czasie rzeczywistym (cytowania wysyłane na bieżąco). Ta elastyczność pozwala dopasować monitoring do potrzeb — batch do audytów, streaming do natychmiastowych alertów.

Webhooks i triggery zdarzeń: Zaawansowane API wysyłają powiadomienia webhook, gdy wystąpią określone zdarzenia (cytowanie marki, zmiana sentymentu, zysk konkurencji). Umożliwia to automatyzację reakcji bez ciągłego odpytywania API.

Dane historyczne i analiza trendów: API zapewniają dostęp do historycznych danych o cytowaniach, co umożliwia analizę trendów, wykrywanie sezonowości oraz mierzenie efektów optymalizacji w czasie. Większość platform przechowuje dane z 12–36 miesięcy.

Wywiad konkurencyjny: API zwracają nie tylko Twoje cytowania, ale także cytowania konkurencji w tych samych zapytaniach, co pozwala na bezpośredni pomiar udziału w głosie i benchmarking bez dodatkowych narzędzi.

Prawdziwa moc API widoczności AI ujawnia się przy połączeniu danych monitorujących z platformami automatyzacji workflow jak n8n, Zapier czy Make. Takie integracje zamieniają pasywny monitoring w aktywne, automatyczne reakcje na zmiany widoczności. Przykład: gdy częstotliwość cytowania marki spada poniżej ustalonego progu (np. pojawiasz się w mniej niż 25% istotnych zapytań), workflow automatycznie uruchamia wiele działań naraz. Odbiera alert z API, sprawdza w CMS, które strony są najsłabsze, tworzy zadanie w narzędziu do zarządzania projektami, wysyła powiadomienie Slack do zespołu contentowego i uruchamia proces odświeżenia treści. Całość odbywa się bez udziału człowieka, umożliwiając szybką reakcję na spadek widoczności.

Workflows w n8n zapewniają największą elastyczność dla złożonej automatyzacji. Możesz budować wieloetapowe procesy łączące dane z API z innymi źródłami: pobierasz cytowania przez API, łączysz z Google Analytics w celu identyfikacji źródeł ruchu o wysokiej intencji, sprawdzasz w CRM, które strony generują konwersje i automatycznie priorytetyzujesz optymalizację treści pod kątem wpływu na przychody, a nie samą częstotliwość cytowań. Workflow może wygenerować roadmapę optymalizacji i przekazać ją interesariuszom. Integracje z Zapier sprawdzają się przy prostszych, gotowych automatyzacjach. Możesz stworzyć Zapy monitorujące cytowania i automatycznie wysyłające codzienne podsumowania mailowe, tworzące zadania Asana przy negatywnym sentymencie czy dopisujące nowe cytowania do Google Sheeta do ręcznego przeglądu. Make (dawniej Integromat) oferuje rozwiązanie pośrednie z wizualnym budowaniem workflow i dostępem do 1 000+ gotowych integracji.

Limitowanie zapytań i obsługa błędów to kluczowe zagadnienia. Większość API widoczności AI nakłada limity (np. 100 zapytań na minutę w standardzie, bez limitu w wersji enterprise). Workflows muszą mieć zaimplementowany exponential backoff — jeśli żądanie się nie uda, czekaj 1 sekundę przed ponowną próbą, potem 2 sekundy, potem 4 sekundy, aż do ustalonego maksimum. Chroni to przed przeciążeniem API podczas chwilowych awarii i gwarantuje ciągłość monitoringu. Typowe czasy wdrożenia to 8–30 godzin w zależności od złożoności workflow: proste alerty cytowań 8–12 godzin, rozbudowane workflow z integracją hurtowni danych 20–30 godzin.

Połączenie API widoczności AI z hurtowniami danych i narzędziami BI umożliwia zaawansowaną analizę, której nie dostarczą tradycyjne platformy monitorujące. Architektura zwykle składa się z trzech warstw: pobieranie danych (API pobiera cytowania), hurtownia danych (Snowflake, BigQuery, Redshift przechowują znormalizowane dane) oraz warstwa analityczna (Looker, Tableau, Power BI wizualizują insighty).

Dane płyną z API do hurtowni według harmonogramu (zwykle co godzinę lub codziennie). API zwraca ustrukturyzowany JSON z wydarzeniami cytowań — każdy rekord to znacznik czasu, zapytanie, platforma AI, cytowany URL, pozycja, sentyment i kontekst konkurencyjny. Hurtownia normalizuje to do tabel: cytowania (każdy event osobny wiersz), zapytania (unikalne śledzone zapytania), platformy (ChatGPT, Perplexity itd.) i konkurenci (dane konkurencyjne). Dzięki temu możliwe są złożone zapytania analityczne nieosiągalne na surowych odpowiedziach API.

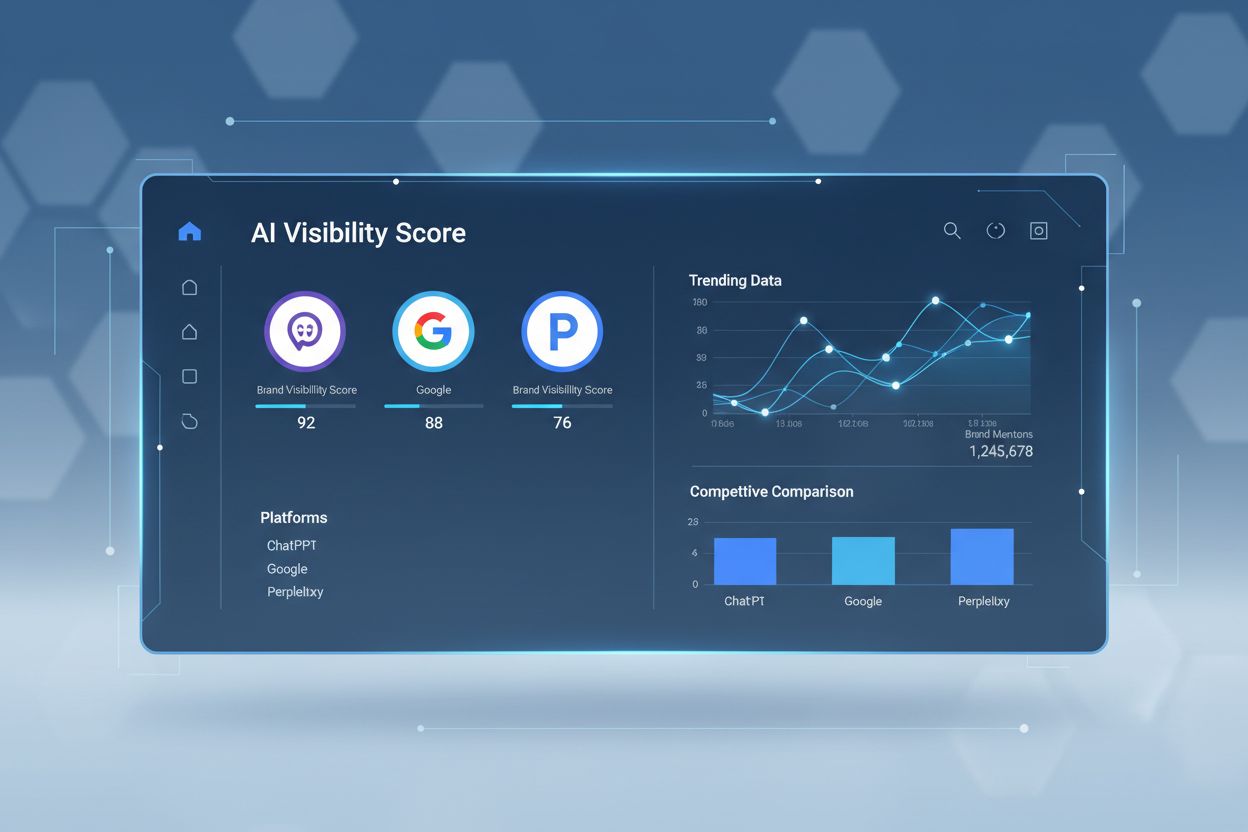

Własne KPI, które możesz zbudować: częstotliwość cytowań (odsetek zapytań z cytowaniem), wynik widoczności marki (waga: częstotliwość, pozycja, sentyment), udział w głosie AI (cytowania Twojej marki podzielone przez wszystkie cytowania w kategorii), trend sentymentu (zmiany pozytywnych/negatywnych wzmianek w czasie), konwersja z LLM (przychód z ruchu AI podzielony przez liczbę wejść z AI). Dashboardy w czasie rzeczywistym pokazują te metryki z aktualizacją co godzinę i alertami przy odchyleniach od celu. Dashboardy historyczne pokazują trendy: czy częstotliwość cytowań rośnie miesiąc do miesiąca? Które typy treści są cytowane najczęściej? Czy cytowania korelują ze wzrostem ruchu organicznego?

Koszty zależą od narzędzi. Snowflake rozlicza się 2–4 USD za godzinę obliczeniową plus storage (zwykle 25–100 USD miesięcznie za dane monitoringowe). BigQuery pobiera opłaty za zapytania (6,25 USD za 1 TB) plus storage (0,02 USD za GB miesięcznie). Looker Studio jest darmowy w podstawie, Tableau Public darmowy, Tableau Server kosztuje 70 USD za użytkownika miesięcznie. Pełny setup — API (200 USD/mies.), hurtownia (100 USD/mies.), BI (500 USD/mies.) — to ok. 800 USD/mies. za analitykę klasy enterprise. Ta inwestycja zwykle zwraca się w 2–3 miesiące dzięki lepszej priorytetyzacji treści i szybszej reakcji na zmiany widoczności.

API widoczności AI klasy enterprise wdrażają wielopoziomowe zabezpieczenia chroniące dane oraz zapobiegające nadużyciom. Uwierzytelnianie tokenem Bearer to standard: generujesz klucz API w panelu, dołączasz go do nagłówka Authorization w żądaniach (Authorization: Bearer YOUR_API_KEY), a API weryfikuje klucz przed obsługą żądania. To podejście jest bezstanowe — API nie musi przechowywać sesji — i umożliwia łatwą rotację kluczy. Zazwyczaj możesz wygenerować różne klucze dla różnych integracji (hurtownia, workflow, BI), co daje granularną kontrolę dostępu i prostą dezaktywację w razie kompromitacji.

Najlepsze praktyki zarządzania kluczami API: rotacja co 90 dni, osobne klucze do każdej integracji (kompromitacja jednego nie zagraża wszystkim), przechowywanie w bezpiecznych sejfach (AWS Secrets Manager, HashiCorp Vault), nigdy nie w kodzie źródłowym, natychmiastowa dezaktywacja po odejściu członka zespołu. Większość platform udostępnia logi audytowe z informacją, który klucz wykonał które zapytania — ułatwia to analizę incydentów.

Limitowanie zapytań chroni API przed przeciążeniem. Standardowo 100 żądań/min, enterprise — bez limitu. Limity są nakładane per klucz, więc różne integracje nie przeszkadzają sobie nawzajem. Po przekroczeniu limitu API zwraca HTTP 429 (Too Many Requests) z nagłówkiem Retry-After. Prawidłowa implementacja klienta stosuje exponential backoff: czekaj 1 sekundę, retry; jeśli nie działa, 2 sekundy; potem 4; aż do maksimum 60 sekund. Zapobiega to lawinowym błędom podczas krótkich awarii.

Funkcje bezpieczeństwa enterprise: whitelistowanie IP (akceptowane tylko z biura), mutual TLS (obopólna autoryzacja certyfikatami), podpisywanie żądań HMAC-SHA256 (każde żądanie podpisane kryptograficznie), weryfikacja podpisu webhooków (webhooki podpisane do weryfikacji źródła). Dane są szyfrowane w tranzycie (TLS 1.3) i w spoczynku (AES-256). Większość platform enterprise spełnia SOC 2 Type II, potwierdzając audyt bezpieczeństwa. Dostępna jest zgodność z GDPR i HIPAA, co umożliwia wykorzystanie w branżach regulowanych.

Wdrożenie monitoringu przez API widoczności AI przebiega zwykle w kilku krokach: przygotowanie (1–2 godziny), development (4–8 godzin), testy (2–4 godziny), wdrożenie (1–2 godziny). Start to założenie konta, wygenerowanie kluczy API i zapoznanie się z dokumentacją. Większość platform udostępnia kolekcje Postman — gotowe szablony zapytań do testów bez kodowania. Przykładowe pierwsze żądanie:

GET /api/v1/citations?query=best+project+management+tools&platforms=chatgpt,perplexity&limit=100

Authorization: Bearer YOUR_API_KEY

Otrzymujesz JSON z cytowaniami:

{

"citations": [

{

"id": "cite_12345",

"query": "best project management tools",

"platform": "chatgpt",

"cited_url": "https://yoursite.com/project-management-guide",

"position": "headline",

"sentiment": "positive",

"timestamp": "2025-01-03T10:30:00Z"

}

],

"total": 1,

"next_page": null

}

Development to budowa integracji z hurtownią lub BI. Większość platform udostępnia SDK w Pythonie, JavaScript i Go, obsługujące uwierzytelnianie, stronicowanie i obsługę błędów. Przykład w Pythonie:

from amicited import Client

client = Client(api_key="your_api_key")

citations = client.citations.list(

query="your brand name",

platforms=["chatgpt", "perplexity", "gemini"],

limit=100

)

for citation in citations:

print(f"{citation.platform}: {citation.cited_url}")

Typowe wzorce integracji: zaplanowane batch joby (cykliczne pobieranie cytowań), streaming na żywo (webhooki z cytowaniami w czasie rzeczywistym), podejścia hybrydowe (batch do danych historycznych, webhooki do alertów). Obsługa błędów jest kluczowa — implementuj retry z exponential backoff, loguj błędy do debugowania, ustaw alerty przy wzroście liczby błędów. Czas wdrożenia: prosty batch 8–12 godzin, webhooki na żywo 12–16 godzin, pełna integracja multi-platformowa z hurtownią 20–30 godzin.

Rynek monitorowania widoczności AI szybko się rozwinął — wiele platform oferuje API do danych o cytowaniach. AmICited.com wyróżnia się najwyższą dokładnością, najszerszym pokryciem platform i najgłębszą integracją workflow. AmICited śledzi cytowania na 8+ platformach AI (ChatGPT, Perplexity, Gemini, Claude, Microsoft Copilot i nowe) z dokładnością 99,2% i opóźnieniem 150ms. Platforma oferuje nielimitowane wywołania API w każdym planie, co pozwala na nieograniczoną skalę monitoringu bez opłat za zapytania. Integracja workflow jest bezkonkurencyjna — natywne konektory do n8n, Zapier i Make umożliwiają rozbudowaną automatyzację bez własnego developmentu. Platforma dostarcza też najbardziej rozbudowane funkcje GEO (Generative Engine Optimization): śledzenie częstotliwości cytowań, scoring widoczności, udział w głosie AI, analizę sentymentu.

LLM Pulse to solidna alternatywa z dobrą dokumentacją API i integracją Looker Studio. Pokrywa jednak tylko 6 platform, ma opóźnienie 500ms (3x wolniej niż AmICited) i rozlicza się za każde wywołanie API, co podnosi koszt dużej skali. LLM Pulse wyróżnia się funkcjami content intelligence i rekomendacji, ale brakuje mu automatyzacji workflow na poziomie AmICited.

Conductor Intelligence stawia na monitoring przez API, oferując rozbudowane funkcje SEO technicznego. Jednak widoczność AI to funkcja poboczna względem głównej platformy SEO, a API jest mniej przyjazne deweloperom niż w AmICited. Conductor obejmuje 4 platformy z opóźnieniem 1–2 sekundy i wymaga kontraktu enterprise do dostępu API.

Semrush AI Toolkit integruje widoczność AI z szeroką platformą SEO Semrush. Przydatny dla obecnych użytkowników Semrush, ale funkcje AI są ograniczone do 10 promptów na platformę, pokrywa tylko 4 platformy i brak mu natywnych workflow. Kosztuje 99 USD/mies. jako dodatek do subskrypcji Semrush.

| Funkcja | AmICited | LLM Pulse | Conductor | Semrush |

|---|---|---|---|---|

| Pokrycie platform | 8+ | 6 | 4 | 4 |

| Opóźnienie API | 150ms | 500ms | 1–2s | 2–3s |

| Nielimitowane API | Tak (wszystkie plany) | Nie (opłata za zapytania) | Tylko enterprise | Nie (10 promptów/platforma) |

| Integracja workflow | Natywna (n8n, Zapier, Make) | Ograniczona | Brak | Brak |

| Dokładność cytowań | 99,2% | 95% | 92% | 90% |

| Aktualizacje w czasie rzeczywistym | Tak | Co godzinę | Codziennie | Codziennie |

| Funkcje GEO | Pełne | Podstawowe | Średnie | Podstawowe |

| Cena od | 299 USD/mies. | 199 USD/mies. | Enterprise | 99 USD/mies. dodatek |

Przewagi AmICited są znaczące: dokładność 99,2% vs. 90–95% konkurencji, opóźnienie 150ms vs. 500ms–3s, nielimitowane wywołania API vs. opłaty za każde zapytanie i natywna automatyzacja workflow vs. integracja ręczna. Dla organizacji poważnie traktujących monitoring i automatyzację AI, AmICited zapewnia najwyższą wartość dzięki szybszej reakcji, szerszemu pokryciu platform i głębszym integracjom.

Wpływ finansowy monitoringu widoczności AI opartego na API jest znaczący i mierzalny. Organizacje wdrażające kompleksowy monitoring notują zwykle 96,8x ROI w ciągu 12 miesięcy dzięki lepszej priorytetyzacji treści, szybszej reakcji na zmiany widoczności i lepszemu zrozumieniu, które treści generują ruch wysokiej jakości. Przykłady z rynku: firma SaaS po wdrożeniu AmICited notuje wzrost ruchu organicznego o 23% w 6 miesięcy, 340 dodatkowych leadów miesięcznie i 1,2 mln USD dodatkowych przychodów rocznie. Efekty te wynikają z wykorzystania danych o cytowaniach do identyfikacji słabych treści, priorytetyzacji optymalizacji i pomiaru wpływu zmian na widoczność AI.

Model obliczania ROI: Zacznij od średniej wartości klienta (CLV). Jeśli Twój CLV to 50 000 USD, a współczynnik konwersji z ruchu organicznego to 2%, jeden odwiedzający jest wart 1 000 USD. Odwiedzający z AI konwertują 4,4x częściej, więc każdy wart jest 4 400 USD. Jeśli monitoring przez API zapewni 100 dodatkowych cytowań miesięcznie, 10% z nich generuje ruch (10 odwiedzających), a 2% z nich konwertuje (0,2 klienta), zyskujesz 0,2 klienta × 50 000 USD = 10 000 USD miesięcznie. Rocznie: 120 000 USD. Odejmij koszty monitoringu (3 600 USD/rok) i optymalizacji treści (24 000 USD/rok), netto 92 400 USD — czyli 96,8x ROI na inwestycji 3 600 USD.

Kluczowe metryki: częstotliwość cytowań (odsetek zapytań z cytowaniem), wynik widoczności marki (łączna metryka: częstotliwość, pozycja, sentyment), udział w głosie AI (Twoje cytowania / cytowania w kategorii), trend sentymentu (zmiana pozytywnych/negatywnych wzmianek), konwersja LLM (przychód z ruchu AI / wejścia z AI). Większość organizacji notuje wzrost częstotliwości cytowań o 15–30% w 3 miesiące od wdrożenia strategii opartych na API. Poprawa udziału w głos

API widoczności AI to programistyczny interfejs zapewniający dostęp w czasie rzeczywistym do danych o tym, jak Twoja marka pojawia się w odpowiedziach generowanych przez AI na platformach takich jak ChatGPT, Perplexity, Gemini i Claude. Śledzi cytowania, wzmianki, sentyment oraz pozycjonowanie konkurencyjne, umożliwiając automatyczny monitoring i integrację z workflow biznesowymi.

API oferują dokładność na poziomie 99,2% w porównaniu do 71-84% dla scrapingu, są zgodne z regulaminami platform, zapewniają ustrukturyzowane dane z opóźnieniem 150ms w stosunku do 2-5 sekund w przypadku scrapingu oraz kosztują 1 200–3 500 USD rocznie wobec 8 000–15 000 USD za infrastrukturę scrapingu. API są również nieporównywalnie bardziej skalowalne i niezawodne.

Tak. API widoczności AI integrują się z hurtowniami danych (Snowflake, BigQuery, Redshift), platformami BI (Looker, Tableau, Power BI), narzędziami do automatyzacji workflow (n8n, Zapier, Make) oraz aplikacjami własnymi przez REST. Większość platform oferuje SDK, kolekcje Postman i pełną dokumentację dla bezproblemowej integracji.

API widoczności AI klasy enterprise stosują uwierzytelnianie tokenem Bearer, zarządzanie kluczami API z polityką rotacji, ograniczenia liczby zapytań, whitelistę IP, wzajemne szyfrowanie TLS, podpisywanie żądań HMAC-SHA256 oraz zgodność z SOC 2 Type II. Dane są szyfrowane w tranzycie i w spoczynku.

Organizacje zwykle widzą mierzalny ROI w ciągu 3-6 miesięcy. Przykłady z rynku pokazują 96,8x ROI, wzrost ruchu o 23%, ponad 340 dodatkowych leadów miesięcznie oraz 1,2 mln USD dodatkowych przychodów. Kluczowe jest połączenie insightów z monitoringu z działaniami optymalizacyjnymi.

Kompleksowe API widoczności AI śledzą cytowania i wzmianki w ChatGPT, Perplexity, Google Gemini, Claude, Microsoft Copilot i nowych platformach. Zakres zależy od dostawcy—AmICited obejmuje 8+ platform z aktualizacjami w 150ms, podczas gdy konkurencja zwykle 4-6 platform.

API zapewniają dostęp do częstotliwości cytowań, wzmianek o marce, analizy sentymentu, pozycji konkurencyjnej, atrybucji źródeł, szczegółowości na poziomie zapytań, trendów historycznych i metadanych o tym, które modele AI cytowały Twoje treści. Dane są dostępne w ustrukturyzowanym formacie JSON z obsługą stronicowania.

Większość API widoczności AI używa uwierzytelniania tokenem Bearer. Generujesz klucze API z poziomu dashboardu, dołączasz je do nagłówka Authorization żądania i możesz utworzyć wiele kluczy do różnych integracji. Klucze można odwoływać indywidualnie, a limity zapytań są nakładane na każdy klucz.

AmICited zapewnia dostęp do API klasy enterprise do śledzenia cytowań, wzmianek i sentymentu na wszystkich głównych platformach AI. Połącz dane z monitoringu bezpośrednio z Twoimi workflow i dashboardami.

Dowiedz się, czym są API Widoczności AI, jak działają i jak z nich korzystać do monitorowania marki w czasie rzeczywistym na ChatGPT, Perplexity, Gemini i innyc...

Opanuj Semrush AI Visibility Toolkit z naszym kompleksowym przewodnikiem. Dowiedz się, jak monitorować widoczność marki w wyszukiwaniu AI, analizować konkurencj...

Dowiedz się, jak wybrać odpowiednią platformę do monitorowania widoczności marki w AI. Porównaj funkcje, ceny i możliwości śledzenia obecności w ChatGPT, Perple...