Visibilidade de IA em Sites Governamentais: Otimização no Setor Público

Saiba como órgãos governamentais podem otimizar sua presença digital para sistemas de IA como ChatGPT e Perplexity. Descubra estratégias para melhorar a visibil...

Aprenda como implementar políticas eficazes de governança de conteúdo em IA com estruturas de visibilidade. Descubra requisitos regulatórios, melhores práticas e ferramentas para gerenciar sistemas de IA de forma responsável.

Visibilidade em IA refere-se à capacidade abrangente de observar, rastrear e entender como sistemas de inteligência artificial operam dentro do seu ecossistema de conteúdo. Na governança de conteúdo, a visibilidade serve como a camada fundamental que permite às organizações manter o controle, garantir conformidade e mitigar riscos associados a conteúdo gerado e processado por IA. Sem visibilidade clara sobre os sistemas de IA, as organizações operam às cegas—incapazes de detectar vieses, assegurar conformidade regulatória ou responder a ameaças emergentes. A governança com foco em visibilidade transforma a gestão reativa de crises em prevenção proativa de riscos, permitindo que equipes tomem decisões informadas sobre qualidade, autenticidade e alinhamento do conteúdo com os valores organizacionais.

A maioria das organizações enfrenta um gap crítico de governança entre a velocidade de adoção de IA e sua capacidade de governar esses sistemas de forma eficaz. Pesquisas indicam que 63% das organizações não possuem programas formais de governança de IA, deixando-as vulneráveis a violações de conformidade, danos reputacionais e falhas operacionais. Esse gap se amplia à medida que sistemas de IA se tornam mais sofisticados e integrados a processos de negócios essenciais, tornando a visibilidade cada vez mais difícil de alcançar sem estruturas e ferramentas dedicadas. As consequências vão além de penalidades regulatórias—organizações sem visibilidade lutam para manter a qualidade do conteúdo, detectar resultados prejudiciais e demonstrar responsabilidade para stakeholders. Fechar esse gap requer investimento intencional em mecanismos de visibilidade que forneçam insights em tempo real sobre o comportamento dos sistemas de IA e os resultados do conteúdo.

| Aspecto | Governança Reativa | Governança Proativa |

|---|---|---|

| Descoberta | Problemas identificados após exposição pública | Monitoramento contínuo detecta problemas cedo |

| Resposta | Gestão de crise e controle de danos | Ação preventiva e mitigação de riscos |

| Conformidade | Correções pós-auditoria e penalidades | Verificação contínua de conformidade |

| Risco | Alta exposição a ameaças desconhecidas | Identificação e gestão sistemática de riscos |

Políticas eficazes de governança de conteúdo em IA baseiam-se em seis princípios fundamentais que orientam a tomada de decisão e as práticas operacionais em toda a organização. Esses princípios criam uma estrutura coerente que equilibra inovação com responsabilidade, garantindo que os sistemas de IA sirvam aos objetivos organizacionais ao mesmo tempo em que protegem os stakeholders. Ao incorporar esses princípios à política, você estabelece expectativas claras sobre como os sistemas de IA devem se comportar e como as equipes devem gerenciá-los. Os princípios atuam em sinergia—transparência possibilita responsabilidade, supervisão humana garante equidade e proteção de privacidade constrói confiança. Organizações que operacionalizam esses princípios de forma consistente superam os pares em conformidade regulatória, confiança dos stakeholders e sustentabilidade a longo prazo.

O cenário regulatório para governança de IA acelerou dramaticamente, com múltiplas estruturas agora estabelecendo requisitos obrigatórios para organizações que implantam sistemas de IA. O EU AI Act representa a abordagem regulatória mais abrangente, classificando sistemas de IA por nível de risco e impondo requisitos rigorosos para aplicações de alto risco, incluindo moderação e geração de conteúdo. O NIST AI Risk Management Framework oferece uma abordagem flexível e não prescritiva que ajuda as organizações a identificar, medir e gerenciar riscos de IA em suas operações. A ISO 42001 estabelece normas internacionais para sistemas de gestão de IA, oferecendo uma metodologia estruturada para implementar governança em toda a empresa. Além disso, Ordens Executivas nos Estados Unidos e regulamentações emergentes em nível estadual criam um mosaico de requisitos que as organizações precisam navegar. Essas estruturas convergem em temas comuns: transparência, responsabilidade, supervisão humana e monitoramento contínuo—tornando a visibilidade o facilitador crítico da conformidade regulatória.

Construir uma estrutura de políticas robusta requer avaliação sistemática de seus sistemas atuais de IA, fluxos de conteúdo e exposição a riscos. Comece realizando um inventário abrangente de IA que documente cada sistema que gera, processa ou distribui conteúdo, incluindo seu propósito, entradas de dados e potencial impacto nos stakeholders. Em seguida, estabeleça níveis de governança que atribuam diferentes graus de supervisão conforme o risco—sistemas de alto risco, como moderação de conteúdo, exigem monitoramento intensivo, enquanto aplicações de menor risco podem demandar governança mais leve. Desenvolva políticas claras especificando como cada sistema deve operar, quais resultados são aceitáveis e como as equipes devem responder a problemas. Crie estruturas de responsabilidade que atribuam propriedade pelo cumprimento das políticas e estabeleçam procedimentos de escalonamento para questões de governança. Por fim, implemente mecanismos de mensuração que acompanhem a aderência às políticas e forneçam dados para melhoria contínua da abordagem de governança.

Alcançar visibilidade em IA exige o uso de ferramentas especializadas e mecanismos de avaliação que forneçam insights em tempo real sobre o comportamento dos sistemas e resultados do conteúdo. Painéis de monitoramento agregam dados de sistemas de IA, plataformas de conteúdo e sistemas de conformidade em visualizações unificadas que permitem rápida detecção de problemas. Trilhas de auditoria registram detalhadamente decisões da IA, modificações de conteúdo e ações de governança, criando responsabilidade e apoiando investigações regulatórias. Estruturas de avaliação avaliam sistematicamente os sistemas de IA em relação a princípios de governança, identificando lacunas e oportunidades de melhoria antes que problemas se agravem. Sistemas automatizados de detecção sinalizam conteúdos potencialmente problemáticos, resultados enviesados ou violações de políticas, reduzindo a dependência de revisão manual e melhorando a consistência. Organizações que investem em ferramentas de visibilidade abrangentes ganham vantagens competitivas em conformidade regulatória, confiança dos stakeholders e eficiência operacional.

O monitoramento contínuo transforma a governança de um exercício periódico de conformidade em uma disciplina operacional constante que detecta e responde a problemas em tempo real. Estabeleça protocolos de monitoramento que definam quais métricas são mais relevantes para cada sistema de IA—taxas de acurácia, indicadores de viés, pontuações de qualidade do conteúdo e frequência de violações de políticas. Implemente sistemas automatizados de alerta que notifiquem as equipes apropriadas quando as métricas ultrapassarem limites aceitáveis, permitindo investigação e resposta rápidas. Crie ciclos de feedback que conectem os dados de monitoramento à melhoria dos sistemas, permitindo que as equipes refinem modelos de IA e processos de governança com base no desempenho observado. Agende revisões regulares de conformidade para avaliar se os próprios sistemas de monitoramento continuam eficazes e se as políticas de governança precisam ser atualizadas diante de novos riscos ou mudanças regulatórias. Organizações que incorporam o monitoramento contínuo às operações resolvem problemas mais rapidamente, reduzem custos de conformidade e conquistam maior confiança dos stakeholders.

A governança eficaz de conteúdo em IA requer esforço coordenado de múltiplas funções organizacionais, cada uma trazendo expertise e perspectivas essenciais para decisões de governança. Equipes jurídicas e de conformidade garantem que as políticas estejam alinhadas às exigências regulatórias e gerenciam relacionamento externo com reguladores. Equipes técnicas implementam sistemas de monitoramento, mantêm trilhas de auditoria e otimizam o desempenho dos sistemas de IA dentro dos limites da governança. Equipes de conteúdo e editoriais aplicam políticas de governança na prática, tomando decisões diárias sobre qualidade e adequação do conteúdo. Equipes de risco e ética avaliam ameaças emergentes, identificam potenciais danos e recomendam ajustes de política para enfrentar novos desafios. A liderança executiva fornece recursos, define prioridades organizacionais e demonstra compromisso com a governança por meio de decisões e comunicações. Organizações que alinham essas funções em torno de objetivos comuns de governança alcançam resultados superiores em comparação àquelas onde a governança permanece isolada em departamentos individuais.

Governança de conteúdo em IA é o conjunto de políticas, processos e controles que garantem que o conteúdo gerado e processado por IA permaneça confiável, em conformidade e alinhado aos valores organizacionais. Isso abrange desde a criação e validação do conteúdo até o monitoramento e resposta a incidentes.

A visibilidade permite que as organizações compreendam onde os sistemas de IA operam, como eles desempenham e quais riscos criam. Sem visibilidade, a governança torna-se reativa e ineficaz. A visibilidade transforma a governança de gestão de crises em prevenção proativa de riscos.

Os principais marcos incluem o EU AI Act (classificação de risco legalmente vinculativa), o NIST AI Risk Management Framework (orientação flexível), ISO 42001 (normas internacionais) e várias ordens executivas e regulamentações estaduais. Cada estrutura enfatiza transparência, responsabilidade e supervisão humana.

Use estruturas de avaliação estruturadas alinhadas a padrões reconhecidos como NIST AI RMF ou ISO 42001. Avalie os controles existentes em relação aos requisitos da estrutura, identifique lacunas e estabeleça níveis de maturidade-alvo. Avaliações regulares fornecem insights sobre fraquezas sistêmicas e oportunidades de melhoria.

Políticas eficazes devem abranger casos de uso aceitáveis, regras de origem de dados, requisitos de documentação, procedimentos de supervisão humana, mecanismos de monitoramento e procedimentos de escalonamento. As políticas devem ser operacionalizadas por meio de ferramentas e fluxos de trabalho realmente usados pelas equipes no cotidiano.

A governança deve ser monitorada continuamente com revisões formais regulares pelo menos trimestrais. O monitoramento em tempo real detecta problemas imediatamente, enquanto as revisões periódicas avaliam se as estruturas de governança continuam eficazes e se políticas precisam ser atualizadas em resposta a novos riscos ou mudanças regulatórias.

Ferramentas eficazes incluem painéis de monitoramento para métricas em tempo real, trilhas de auditoria para responsabilidade, estruturas de avaliação para avaliação de controles, sistemas automatizados de detecção de violações de políticas e plataformas de quantificação de riscos. Essas ferramentas devem se integrar à sua pilha tecnológica.

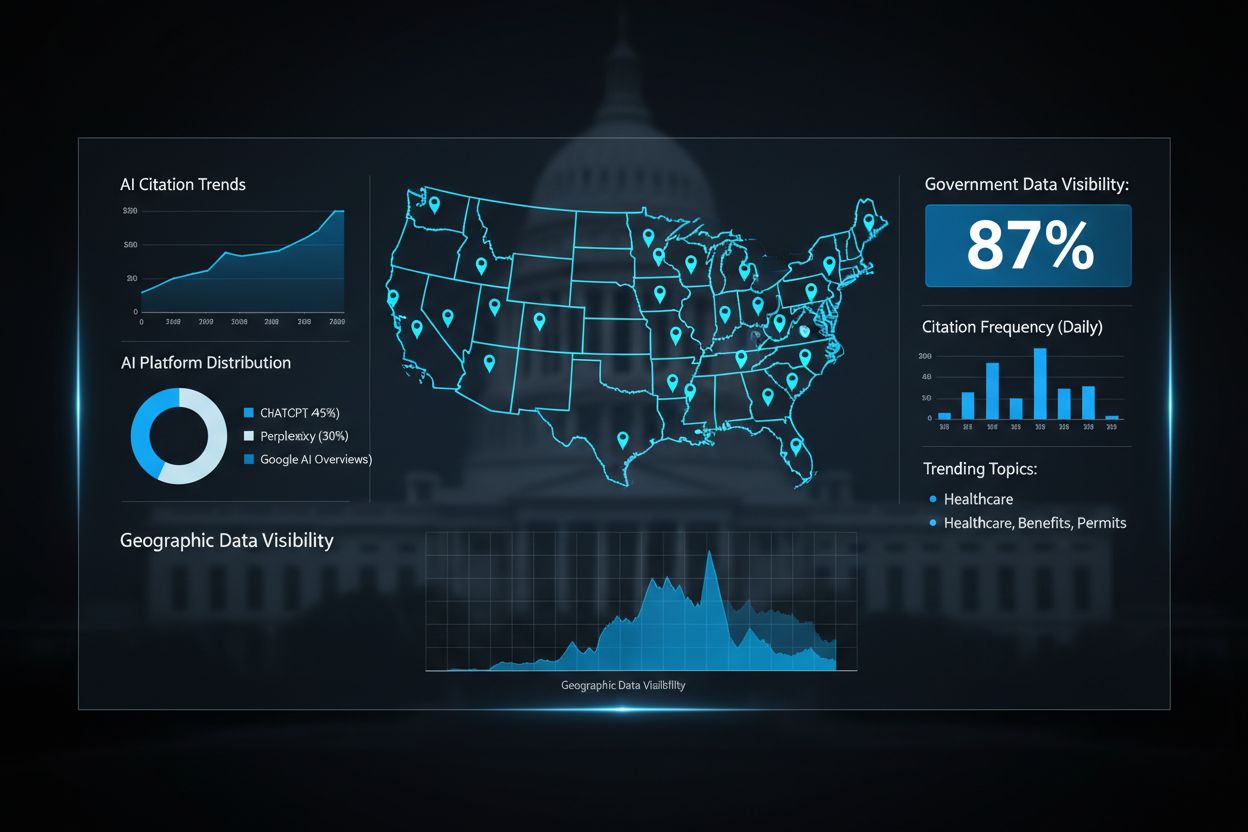

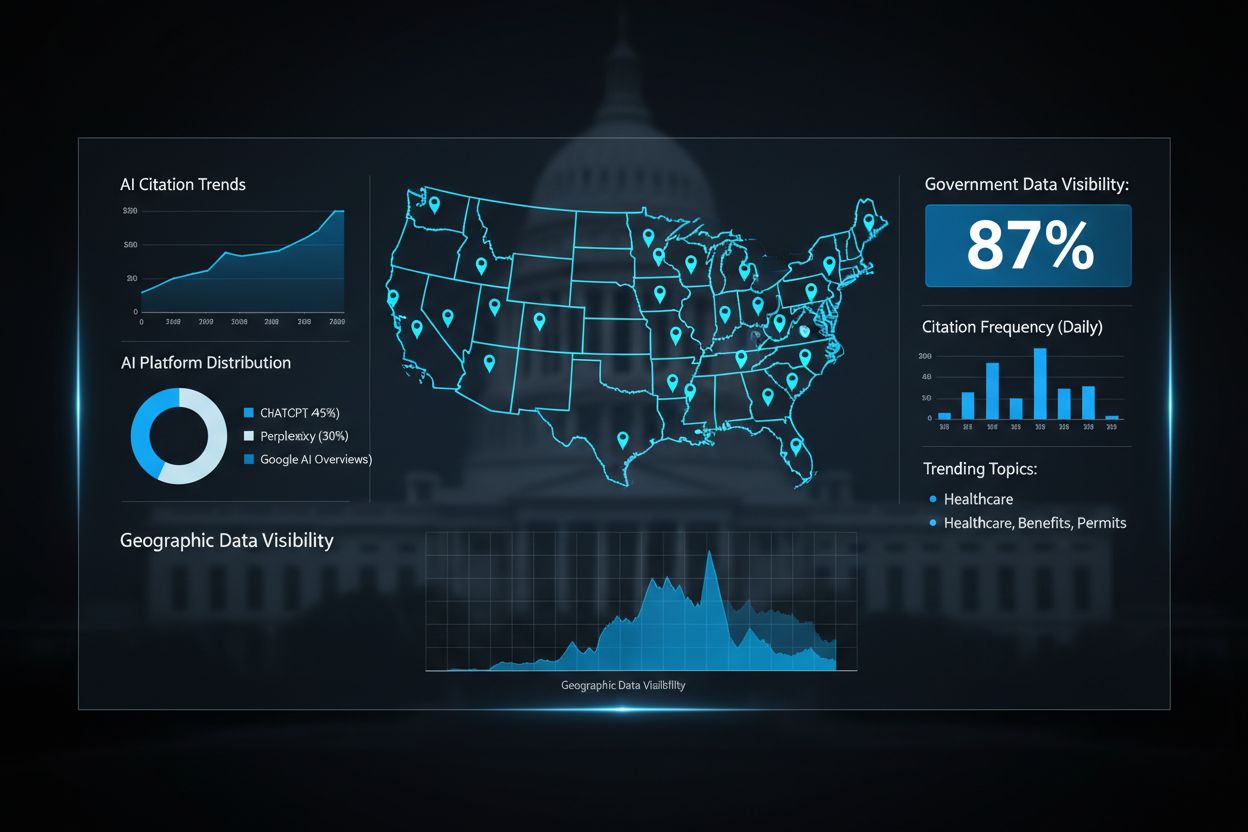

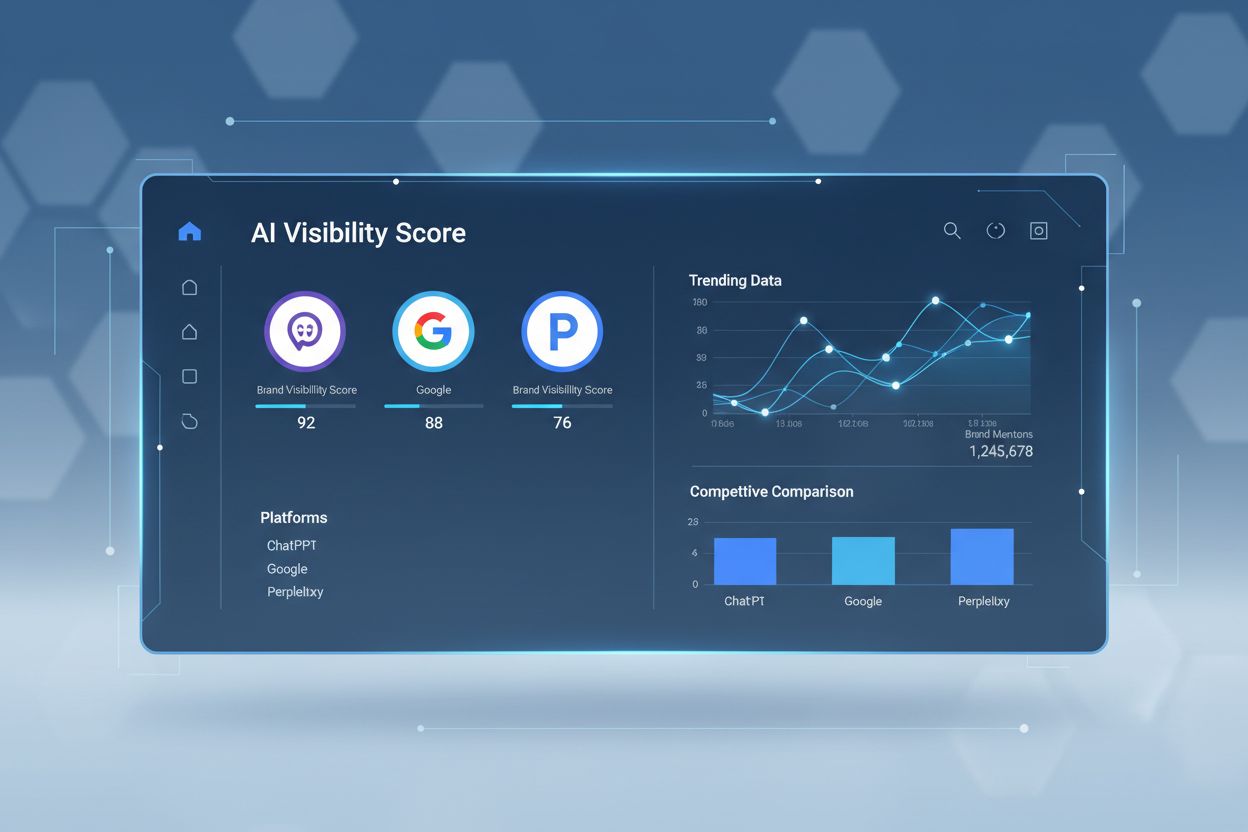

O AmICited monitora como sistemas de IA e LLMs referenciam sua marca em GPTs, Perplexity e Google AI Overviews. Isso proporciona visibilidade sobre sua presença em IA, ajuda a entender como seu conteúdo está sendo usado por sistemas de IA e permite proteger a reputação da sua marca no ecossistema de conteúdo movido por IA.

O AmICited rastreia como sistemas de IA e LLMs citam seu conteúdo em GPTs, Perplexity e Google AI Overviews. Ganhe visibilidade sobre sua presença em IA e proteja a reputação da sua marca.

Saiba como órgãos governamentais podem otimizar sua presença digital para sistemas de IA como ChatGPT e Perplexity. Descubra estratégias para melhorar a visibil...

Domine o Semrush AI Visibility Toolkit com nosso guia abrangente. Aprenda a monitorar a visibilidade da marca em buscas de IA, analisar concorrentes e otimizar ...

Saiba mais sobre governança de conteúdo de IA – as políticas, processos e estruturas que as organizações usam para gerenciar a estratégia de conteúdo em platafo...