Busca de IA Multimodal

Saiba como sistemas de busca de IA multimodal processam texto, imagens, áudio e vídeo juntos para entregar resultados mais precisos e relevantes do que abordage...

Domine a otimização para busca de IA multimodal. Aprenda como otimizar imagens e consultas de voz para resultados de busca movidos por IA, com estratégias para GPT-4o, Gemini e LLMs.

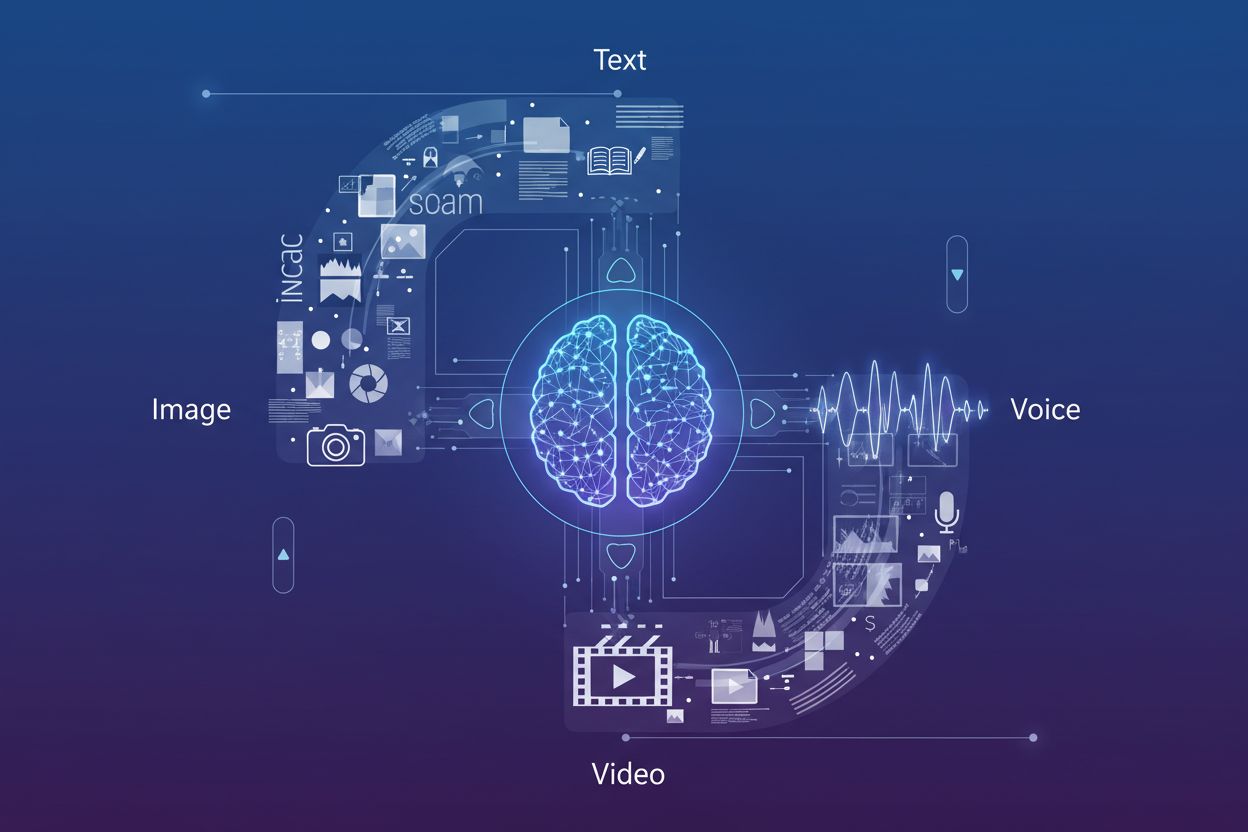

Busca de IA multimodal representa uma mudança fundamental na forma como os motores de busca processam e entendem consultas dos usuários, integrando múltiplos tipos de dados—texto, imagens, voz e vídeo—em uma experiência de busca unificada. Em vez de tratar cada modalidade como um canal separado, sistemas modernos de busca agora utilizam modelos de IA multimodal que analisam e correlacionam informações entre diferentes formatos simultaneamente, permitindo resultados mais contextuais e precisos. Essa evolução da busca de modalidade única (em que consultas de texto retornam resultados de texto) para sistemas multimodais integrados reflete a realidade de como os usuários interagem naturalmente com a informação—combinando perguntas faladas com referências visuais, fazendo upload de imagens para contexto e esperando resultados que sintetizem múltiplos tipos de conteúdo. A importância dessa mudança não pode ser subestimada: ela transforma fundamentalmente como criadores de conteúdo devem otimizar sua presença digital e como marcas precisam monitorar sua visibilidade em diferentes canais de busca. Entender a otimização para busca multimodal não é mais opcional para empresas que desejam manter visibilidade competitiva em ambientes de busca movidos por IA.

O surgimento de avançados modelos multimodais transformou as capacidades de busca, com diversas plataformas líderes oferecendo sofisticados modelos visão-linguagem capazes de processar e compreender conteúdo em múltiplas modalidades simultaneamente. Veja como os principais players se comparam:

| Nome do Modelo | Criador | Principais Capacidades | Melhor Para |

|---|---|---|---|

| GPT-4o | OpenAI | Análise de imagem em tempo real, processamento de voz, tempo de resposta de 320ms | Raciocínio visual complexo, conversas multimodais |

| Gemini | Busca integrada, compreensão de vídeo, raciocínio entre modalidades | Integração com busca, análise de conteúdo abrangente | |

| Claude 3.7 | Anthropic | Análise de documentos, interpretação de imagens, compreensão refinada | Documentação técnica, análise visual detalhada |

| LLaVA | Comunidade open-source | Processamento leve visão-linguagem, inferência eficiente | Ambientes com poucos recursos, implantação em edge |

| ImageBind | Meta | Embeddings entre modalidades, compreensão áudio-visual | Correlação de conteúdo multimídia, busca semântica |

Esses modelos representam o estado da arte em tecnologia de busca por IA, cada um otimizado para diferentes casos de uso e cenários de implantação. Organizações precisam entender quais modelos alimentam as plataformas de busca alvo para otimizar o conteúdo de maneira eficaz. Os avanços rápidos nessas tecnologias exigem que estratégias de visibilidade em busca sejam flexíveis e adaptáveis para acomodar novas capacidades e fatores de ranqueamento.

A otimização para busca por imagem tornou-se crítica à medida que as capacidades de busca visual se expandem dramaticamente—o Google Lens sozinho registrou 10 milhões de visitas em maio de 2025, demonstrando o crescimento explosivo das consultas baseadas em imagem. Para maximizar a visibilidade em resultados de IA de busca por imagem, criadores de conteúdo devem implementar uma estratégia abrangente de otimização:

Essa abordagem multifacetada garante que as imagens sejam descobertas não apenas na busca tradicional por imagens, mas também por sistemas de IA multimodal que analisam o conteúdo visual em contexto com o texto e metadados ao redor.

A integração de Large Language Models na busca por voz transformou fundamentalmente como os motores de busca interpretam e respondem a consultas faladas, indo muito além da simples correspondência de palavras-chave para um entendimento contextual sofisticado. A busca por voz tradicional confiava em correspondência fonética e processamento de linguagem natural básico, mas sistemas modernos de busca por voz movidos por LLM agora compreendem intenção, contexto, nuances e padrões conversacionais com notável precisão. Essa mudança significa que a otimização para busca por voz não pode mais focar somente em palavras-chave exatas; em vez disso, o conteúdo deve ser estruturado para abordar a intenção subjacente por trás de consultas conversacionais que os usuários falam naturalmente. As implicações são profundas: um usuário perguntando “Qual a melhor forma de consertar uma torneira de cozinha vazando?” é fundamentalmente diferente de digitar “consertar torneira vazando”, e o conteúdo precisa tratar tanto da pergunta quanto da necessidade implícita de orientações passo a passo. Featured snippets surgiram como a principal fonte para respostas em busca por voz, com motores de busca preferindo respostas concisas e diretas posicionadas no topo dos resultados. Compreender essa hierarquia—onde respostas de busca por voz são extraídas dos featured snippets—é essencial para qualquer estratégia de conteúdo voltada a dispositivos e assistentes com voz.

Otimizar para consultas conversacionais exige uma reestruturação fundamental de como o conteúdo é organizado e apresentado, migrando de parágrafos densos em palavras-chave para formatos naturais de pergunta e resposta que refletem como as pessoas realmente falam. O conteúdo deve ser estruturado com títulos baseados em perguntas que abordam diretamente dúvidas comuns dos usuários, seguidos de respostas concisas e autoritativas que entreguem valor imediato sem exigir que o usuário leia longas explicações. Essa abordagem está alinhada com o modo como sistemas de processamento de linguagem natural extraem respostas do conteúdo web—eles procuram pares claros de pergunta e resposta e declarações diretas que possam ser isoladas e lidas por assistentes de voz. Implementar dados estruturados que identifiquem explicitamente perguntas e respostas ajuda motores de busca a entender o caráter conversacional do seu conteúdo e aumenta as chances de ser selecionado nos resultados de busca por voz. Frases long tail e conversacionais devem ser integradas naturalmente ao longo do conteúdo, e não forçadas em locais artificiais. O objetivo é criar conteúdo que soe natural quando lido em voz alta e, ao mesmo tempo, esteja otimizado para sistemas de IA que analisam e extraem informações das suas páginas. Esse equilíbrio entre legibilidade humana e interpretabilidade por máquina é a base da otimização eficaz para busca por voz.

Implementar corretamente o schema markup é essencial para sinalizar aos sistemas de IA multimodal o que seu conteúdo representa e como deve ser interpretado em diferentes contextos de busca. As implementações de dados estruturados mais eficazes para busca multimodal incluem schema FAQ (que marca explicitamente pares de perguntas e respostas para busca por voz), schema HowTo (que fornece instruções passo a passo em formato legível por máquina) e schema Local Business (que auxilia consultas multimodais baseadas em localização). Além desses tipos principais, implementar schema Article, schema Product e schema Event garante que seu conteúdo seja corretamente categorizado e entendido por sistemas de IA que analisam suas páginas. O Rich Results Test do Google deve ser utilizado regularmente para validar se seu schema markup está corretamente implementado e sendo reconhecido pelos motores de busca. A base técnica do SEO—estrutura HTML limpa, carregamento rápido das páginas, responsividade mobile e canonicalização adequada—torna-se ainda mais crítica em ambientes de busca multimodal, onde sistemas de IA precisam rapidamente analisar e entender seu conteúdo em múltiplos formatos. Organizações devem auditar todo seu acervo de conteúdo para identificar oportunidades de implementação de schema, priorizando páginas de alto tráfego e conteúdo que se encaixe naturalmente em formatos de pergunta-resposta ou instrucionais.

Acompanhar o desempenho na busca multimodal exige uma mudança nas métricas além do tráfego orgânico tradicional, com foco especial em impressões de featured snippets, engajamento em busca por voz e taxas de conversão de fontes multimodais. O Google Search Console proporciona visibilidade sobre o desempenho de featured snippets, mostrando com que frequência seu conteúdo aparece na posição zero e quais consultas acionam seus snippets—dados que se correlacionam diretamente com visibilidade em busca por voz. Métricas de engajamento mobile tornam-se cada vez mais importantes, pois a busca por voz é predominantemente acessada via dispositivos móveis e alto-falantes inteligentes, tornando taxas de conversão mobile e duração de sessão KPIs críticos para conteúdo otimizado para voz. Plataformas de analytics devem ser configuradas para rastrear fontes de tráfego vindas de assistentes de voz e busca por imagem separadamente da busca orgânica tradicional, permitindo entender quais canais multimodais geram o tráfego mais valioso. Métricas de busca por voz devem incluir não apenas volume de tráfego, mas também qualidade de conversão, já que os usuários de busca por voz frequentemente têm intenção e comportamento diferentes dos de busca por texto. Monitorar menções de marca em AI Overviews e outros resultados de busca gerados por IA revela como sua marca está sendo representada nesses novos formatos de busca. Auditorias regulares do desempenho em featured snippets, combinadas à análise do tráfego de busca por voz, criam um panorama abrangente da visibilidade e ROI da sua busca multimodal.

A trajetória da busca multimodal aponta para tendências de busca por IA cada vez mais sofisticadas, que borram as linhas entre busca, navegação e execução direta de tarefas, com AI Overviews já mostrando aumento de uso acima de 10% à medida que usuários adotam resumos gerados por IA. Capacidades emergentes incluem IA agente capaz de executar ações em nome dos usuários—reservar, comprar, agendar compromissos—baseando-se em consultas multimodais que unem voz, imagem e informações contextuais. A personalização será cada vez mais granular, com sistemas de IA entendendo não só o que os usuários procuram, mas suas preferências, localização, histórico de compras e padrões de comportamento, entregando resultados hiper relevantes em todas as modalidades. Capacidades de busca em tempo real estão em expansão, permitindo aos usuários perguntar sobre eventos ao vivo, condições atuais ou notícias de última hora, esperando respostas imediatas e precisas sintetizadas de múltiplas fontes. A busca por vídeo amadurecerá como modalidade primária, com sistemas de IA compreendendo não só metadados, mas também o conteúdo real dos vídeos, permitindo buscas por momentos, conceitos ou informações específicas dentro de bibliotecas de vídeo. O cenário competitivo favorecerá cada vez mais marcas otimizadas em todas as modalidades, já que a visibilidade em um canal (featured snippets, busca por imagem, resultados de voz) impactará diretamente a visibilidade em outros por meio de sinais de ranqueamento entre modalidades.

À medida que a busca multimodal se torna o paradigma dominante, o monitoramento de IA evoluiu do simples acompanhamento de rankings de busca para o rastreamento abrangente de citação de marca em busca por imagem, resultados de voz e overviews gerados por IA. O AmICited oferece visibilidade essencial sobre como sua marca aparece em AI Overviews, featured snippets e resultados de busca por voz—monitorando não apenas se você ranqueia, mas como sua marca está sendo representada e citada por sistemas de IA que sintetizam informações de múltiplas fontes. A plataforma rastreia citações de imagens nos resultados de busca visual, garantindo que seu conteúdo visual seja devidamente atribuído e vinculado ao seu domínio, protegendo tanto sua autoridade de SEO quanto a visibilidade da marca. Menções em busca por voz são monitoradas em alto-falantes inteligentes e assistentes de voz, capturando como seu conteúdo é lido em voz alta e apresentado a usuários em contextos onde métricas tradicionais de clique não se aplicam. Com resultados de busca gerados por IA representando agora uma parcela significativa das interações dos usuários, entender sua visibilidade nesses novos formatos é fundamental—o AmICited oferece a infraestrutura de monitoramento necessária para acompanhar, medir e otimizar sua presença em todos os canais de busca multimodal. Para marcas que levam a sério a manutenção de visibilidade competitiva no cenário de busca movida por IA, o monitoramento multimodal abrangente por plataformas como o AmICited não é mais opcional, mas essencial para entender e proteger sua presença digital.

A busca de IA multimodal integra múltiplos tipos de dados—texto, imagens, voz e vídeo—em uma experiência de busca unificada. Sistemas de busca modernos agora utilizam modelos de IA multimodal capazes de analisar e correlacionar informações entre diferentes formatos simultaneamente, permitindo resultados mais contextuais e precisos do que a busca de modalidade única.

Otimize imagens utilizando arquivos originais de alta qualidade com nomes descritivos e texto alternativo abrangente. Implemente marcação de schema, forneça texto contextual ao redor, inclua múltiplos ângulos do mesmo assunto e compacte os arquivos para carregamento rápido. Essas práticas garantem visibilidade tanto na busca tradicional por imagens quanto em sistemas de IA multimodal.

Featured snippets são a principal fonte para respostas em buscas por voz. Assistentes de voz extraem respostas concisas e diretas dos resultados de posição zero nas páginas de resultados dos motores de busca. Otimizar conteúdo para aparecer em featured snippets é essencial para visibilidade e ranqueamento na busca por voz.

Estruture o conteúdo com títulos baseados em perguntas que abordam diretamente consultas comuns de voz, seguidos de respostas concisas. Use linguagem natural e conversacional e implemente marcação de dados estruturados (schema FAQ, schema HowTo) para ajudar os sistemas de IA a entender a natureza conversacional do seu conteúdo.

Os principais modelos multimodais incluem GPT-4o (OpenAI), Gemini (Google), Claude 3.7 (Anthropic), LLaVA (código aberto) e ImageBind (Meta). Cada um possui diferentes capacidades e contextos de aplicação. Entender quais modelos alimentam as plataformas de busca alvo é fundamental para otimizar o conteúdo de forma eficaz.

Acompanhe impressões de featured snippets no Google Search Console, monitore métricas de engajamento mobile, analise o tráfego de busca por voz separadamente da busca orgânica tradicional e meça taxas de conversão de fontes multimodais. Monitore menções de marca em AI Overviews e acompanhe como seu conteúdo aparece em diferentes modalidades.

O AmICited monitora como sua marca aparece em AI Overviews, featured snippets, resultados de busca por imagem e respostas de busca por voz. À medida que resultados de busca gerados por IA se tornam dominantes, o monitoramento multimodal abrangente é essencial para entender e proteger sua presença digital em todos os canais de busca.

O futuro inclui sistemas de IA cada vez mais sofisticados com capacidades agentes que podem agir em nome dos usuários, resultados hiperpersonalizados baseados em preferências e comportamento, busca em tempo real para eventos ao vivo e capacidades maduras de busca por vídeo. Marcas otimizadas em todas as modalidades terão vantagens competitivas.

Acompanhe como sua marca aparece em AI Overviews, resultados de busca por imagem e respostas de busca por voz. Tenha visibilidade em tempo real sobre sua presença em buscas multimodais.

Saiba como sistemas de busca de IA multimodal processam texto, imagens, áudio e vídeo juntos para entregar resultados mais precisos e relevantes do que abordage...

Saiba o que é conteúdo multimodal para IA, como funciona e por que é importante. Explore exemplos de sistemas de IA multimodal e suas aplicações em diferentes s...

Saiba como otimizar texto, imagens e vídeo para sistemas de IA multimodal. Descubra estratégias para melhorar citações de IA e visibilidade em ChatGPT, Gemini e...