Soluții Enterprise de Vizibilitate AI: Alegerea Platformei Potrivite

Ghid complet pentru soluțiile enterprise de vizibilitate AI. Compară platforme de top precum Conductor, Profound și Athena. Află criterii de evaluare și strateg...

Strategia de vizibilitate AI la nivel de întreprindere se referă la abordarea cuprinzătoare pe care organizațiile o implementează pentru a monitoriza, urmări și înțelege toate sistemele, modelele și aplicațiile de inteligență artificială care operează în cadrul infrastructurii lor. Această strategie cuprinde capacitatea de a vedea ce sisteme AI sunt utilizate, cum performează, cine le folosește și ce riscuri prezintă la nivelul întregii organizații. Pentru marile întreprinderi care gestionează sute sau mii de implementări AI, vizibilitatea devine critică deoarece AI-ul din umbră—instrumente AI neautorizate sau nedocumentate—se poate răspândi rapid fără supraveghere adecvată. Fără o vizibilitate cuprinzătoare, organizațiile nu pot asigura conformitatea, gestiona riscurile, optimiza performanța sau obține valoarea maximă din investițiile lor în AI.

Strategia de vizibilitate AI la nivel de întreprindere se referă la abordarea cuprinzătoare pe care organizațiile o implementează pentru a monitoriza, urmări și înțelege toate sistemele, modelele și aplicațiile de inteligență artificială care operează în cadrul infrastructurii lor. Această strategie cuprinde capacitatea de a vedea ce sisteme AI sunt utilizate, cum performează, cine le folosește și ce riscuri prezintă la nivelul întregii organizații. Pentru marile întreprinderi care gestionează sute sau mii de implementări AI, vizibilitatea devine critică deoarece AI-ul din umbră—instrumente AI neautorizate sau nedocumentate—se poate răspândi rapid fără supraveghere adecvată. Fără o vizibilitate cuprinzătoare, organizațiile nu pot asigura conformitatea, gestiona riscurile, optimiza performanța sau obține valoarea maximă din investițiile lor în AI.

Strategia de vizibilitate AI la nivel de întreprindere se referă la abordarea cuprinzătoare pe care organizațiile o implementează pentru a monitoriza, urmări și înțelege toate sistemele, modelele și aplicațiile de inteligență artificială care operează în cadrul infrastructurii lor. Această strategie cuprinde capacitatea de a vedea ce sisteme AI sunt utilizate, cum performează, cine le folosește și ce riscuri prezintă la nivelul întregii organizații. Pentru marile întreprinderi care gestionează sute sau mii de implementări AI, vizibilitatea devine critică deoarece AI-ul din umbră—instrumente AI neautorizate sau nedocumentate—se poate răspândi rapid fără supraveghere adecvată. Provocarea se intensifică la scară largă, unde 85% dintre întreprinderi folosesc acum AI într-o anumită măsură, însă doar 11% raportează valoare de afaceri clară, indicând un decalaj semnificativ între implementare și gestionarea eficientă. Fără o vizibilitate cuprinzătoare, organizațiile nu pot asigura conformitatea, gestiona riscurile, optimiza performanța sau obține valoarea maximă din investițiile lor în AI.

Vizibilitatea AI la nivel de întreprindere operează pe trei dimensiuni interconectate care, împreună, oferă o conștientizare completă la nivel organizațional asupra sistemelor AI și a impactului acestora. Prima dimensiune, monitorizarea utilizării, urmărește ce sisteme AI sunt implementate, cine le accesează, cât de des sunt folosite și în ce scopuri de afaceri. A doua dimensiune, monitorizarea calității, asigură că modelele AI performează conform așteptărilor, mențin standardele de acuratețe și nu se degradează în timp din cauza derivei de date sau a uzurii modelului. A treia dimensiune, monitorizarea securității, protejează împotriva accesului neautorizat, breșelor de date, atacurilor de tip prompt injection și asigură conformitatea cu cerințele de reglementare. Aceste trei dimensiuni trebuie să funcționeze împreună, susținute de sisteme centralizate de logare, tablouri de bord în timp real și sisteme automate de alertare. Organizațiile care implementează vizibilitate cuprinzătoare pe toate cele trei dimensiuni raportează rezultate semnificativ mai bune de guvernanță și timpi de răspuns la incidente mult mai rapizi.

| Dimensiune | Scop | Metrici Cheie |

|---|---|---|

| Monitorizarea Utilizării | Urmărește implementarea și utilizarea sistemelor AI | Utilizatori activi, apeluri API, versiuni de model, adopție la nivel de unitate de afaceri |

| Monitorizarea Calității | Asigură performanța și fiabilitatea modelului | Acuratețe, precizie, recall, derivă predicție, latență |

| Monitorizarea Securității | Protejează împotriva amenințărilor și asigură conformitatea | Jurnale de acces, anomalii detectate, încălcări de politici, urme de audit |

Organizațiile se confruntă cu obstacole semnificative atunci când încearcă să implementeze vizibilitate AI cuprinzătoare în medii mari și complexe. AI-ul din umbră este, probabil, cea mai mare provocare—angajații și departamentele implementează instrumente AI fără știrea sau aprobarea IT, creând zone oarbe care împiedică monitorizarea și guvernanța centralizată. Silo-urile de date fragmentează informațiile între departamente, făcând imposibilă corelarea modelelor de utilizare AI sau identificarea eforturilor duplicate și a resurselor irosite. Complexitatea integrării apare atunci când organizațiile trebuie să conecteze instrumente de vizibilitate cu sisteme vechi, platforme cloud și framework-uri AI diverse care nu au fost concepute pentru monitorizare. Fragmentarea reglementărilor impune standarde diferite de vizibilitate pentru jurisdicții diferite, generând complexitate de conformitate ce necesită infrastructură de monitorizare flexibilă și adaptabilă. În plus, 84% dintre liderii IT raportează lipsa unui proces formal de guvernanță, iar 72% dintre organizații semnalează probleme de calitate a datelor ce subminează fiabilitatea propriilor metrici de vizibilitate.

Principalele provocări de vizibilitate includ:

O vizibilitate eficientă AI la nivel de întreprindere necesită alinierea la cadre și standarde de guvernanță consacrate, care oferă structură și credibilitate eforturilor de monitorizare. Cadrul NIST AI Risk Management Framework (RMF) oferă o abordare cuprinzătoare pentru identificarea, măsurarea și gestionarea riscurilor AI, constituind o bază pentru cerințele de vizibilitate la toate nivelurile organizației. ISO/IEC 42001 stabilește standarde internaționale pentru sistemele de management AI, inclusiv cerințe pentru monitorizare, documentare și îmbunătățire continuă ce corespund obiectivelor de vizibilitate. Legea AI a UE impune cerințe stricte de transparență și documentare pentru sistemele AI cu risc ridicat, solicitând evidențe detaliate privind comportamentul și procesele decizionale AI. Cadrul specific industriei adaugă cerințe suplimentare—organizațiile din servicii financiare trebuie să respecte așteptările reglementatorilor bancari privind guvernanța AI, cele din sănătate trebuie să îndeplinească cerințele FDA pentru sistemele AI clinice, iar agențiile guvernamentale trebuie să respecte directivele federale de guvernanță AI. Organizațiile ar trebui să aleagă cadre potrivite industriei, geografiei și profilului lor de risc, apoi să construiască infrastructura de vizibilitate care să demonstreze conformitatea cu standardele selectate.

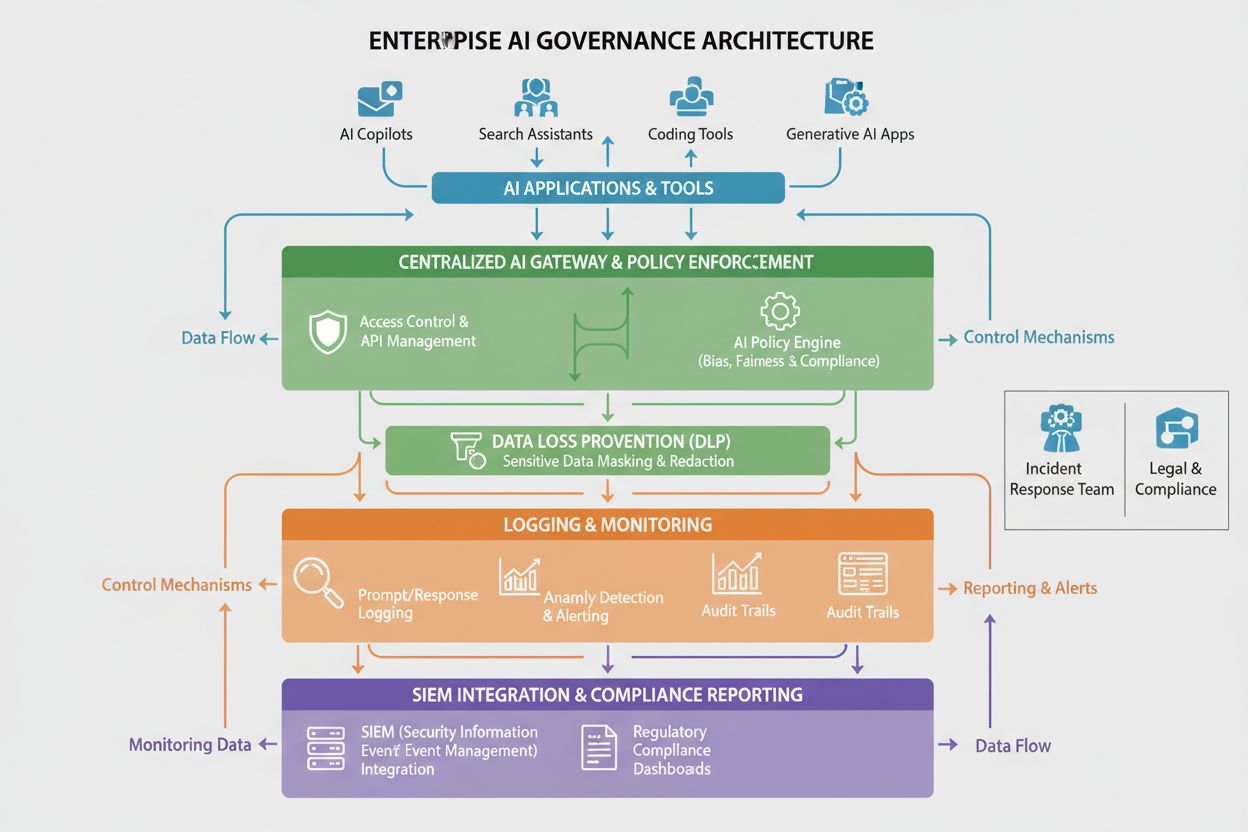

Implementarea vizibilității AI la nivel de întreprindere necesită o fundație tehnică robustă care să capteze, proceseze și prezinte date despre comportamentul și performanța sistemelor AI. Platformele AI centralizate servesc drept coloană vertebrală a infrastructurii de vizibilitate, oferind o interfață unică unde organizațiile pot monitoriza toate sistemele AI, indiferent unde sunt implementate. Gateway-urile AI acționează ca intermediari între aplicații și servicii AI, capturând metadate despre fiecare cerere și răspuns, permițând urmărirea detaliată a utilizării și monitorizarea securității. Sistemele cuprinzătoare de logare înregistrează toate activitățile sistemelor AI, predicțiile modelelor, interacțiunile utilizatorilor și metricile de performanță în depozite centralizate care susțin urme de audit și analize forensice. Instrumentele de Prevenire a Pierderii Datelor (DLP) monitorizează sistemele AI pentru încercări de exfiltrare a datelor sensibile, prevenind antrenarea modelelor pe informații confidențiale sau returnarea datelor protejate în răspunsuri. Integrarea SIEM conectează datele de vizibilitate AI cu sistemele mai largi de management informațional al securității și evenimentelor, permițând corelarea evenimentelor de securitate AI cu alte amenințări organizaționale. Organizațiile care implementează aceste componente tehnice raportează o reducere cu 30% a timpului de răspuns la incidente când apar probleme de securitate AI. Platforme precum Liminal, Ardoq și Knostic oferă soluții de vizibilitate orientate pe guvernanță, în timp ce AmICited.com este specializată în monitorizarea calității răspunsurilor AI pe GPT-uri, Perplexity și Google AI Overviews.

O vizibilitate AI de succes la nivel de întreprindere necesită structuri organizaționale clare și roluri bine definite care distribuie responsabilitatea monitorizării și guvernanței la nivelul întregii organizații. Un Comitet de Guvernanță AI servește de obicei drept organism executiv ce supraveghează strategia de vizibilitate AI, stabilește politici și asigură alinierea cu obiectivele de business și cerințele de reglementare. Proprietarii de modele își asumă responsabilitatea pentru sisteme AI specifice, asigurând documentarea, monitorizarea și menținerea acestora conform standardelor organizaționale. Campionii AI integrați în unități de afaceri servesc ca punți între echipele IT de guvernanță și utilizatorii finali, promovând practicile de vizibilitate și identificând AI-ul din umbră înainte ca acesta să devină necontrolabil. Administratorii de date gestionează calitatea și accesibilitatea datelor folosite pentru antrenarea și monitorizarea sistemelor AI, asigurând că metricile de vizibilitate sunt fiabile și demne de încredere. Echipele de securitate și conformitate stabilesc cerințele de monitorizare, efectuează audituri și se asigură că infrastructura de vizibilitate respectă obligațiile de reglementare. Structurile clare de responsabilitate garantează că vizibilitatea nu este tratată ca o responsabilitate exclusiv IT, ci ca un angajament organizațional comun ce necesită implicarea funcțiilor de business, tehnice și guvernanță.

Organizațiile trebuie să stabilească indicatori cheie de performanță (KPI) și cadre de măsurare clare pentru a evalua dacă strategia lor de vizibilitate AI livrează valoare și sprijină obiectivele organizaționale. Acoperirea vizibilității măsoară procentul de sisteme AI care sunt documentate și monitorizate, organizațiile mature vizând o acoperire de peste 95% a tuturor implementărilor AI. Maturitatea guvernanței urmărește progresul prin etape definite—de la monitorizare ad-hoc la procese standardizate până la guvernanță optimizată și automatizată—folosind cadre precum modelul CMMI adaptat pentru guvernanța AI. Metricile pentru detecția și răspunsul la incidente măsoară cât de rapid identifică și răspund organizațiile la problemele legate de AI, îmbunătățirea vitezei de detecție și timpului de răspuns indicând o vizibilitate mai eficientă. Respectarea conformității urmărește procentul sistemelor AI care respectă cerințele de reglementare și standardele interne, constatările auditului și termenele de remediere constituind metrici cheie. Realizarea valorii de afaceri măsoară dacă investițiile în vizibilitate se traduc în beneficii tangibile precum reducerea riscurilor, îmbunătățirea performanței modelelor, scurtarea timpului de lansare pe piață pentru inițiative AI sau alocarea mai bună a resurselor. Organizațiile ar trebui să implementeze tablouri de bord în timp real care să afișeze aceste metrici stakeholderilor, permițând monitorizare continuă și corectare rapidă a cursului atunci când apar lacune de vizibilitate.

Diferite industrii se confruntă cu cerințe unice de vizibilitate AI generate de mediile de reglementare, profilurile de risc și modelele de afaceri ce impun abordări de monitorizare adaptate. Organizațiile din servicii financiare trebuie să respecte așteptările reglementatorilor bancari privind guvernanța AI, inclusiv monitorizarea detaliată a sistemelor AI utilizate în deciziile de creditare, detectarea fraudelor și algoritmi de tranzacționare, cu accent pe detectarea bias-ului și metrici de echitate. Organizațiile din sănătate trebuie să îndeplinească cerințele FDA pentru sistemele AI clinice, inclusiv validarea performanței modelelor, monitorizarea problemelor de siguranță și documentarea modului în care AI-ul influențează deciziile clinice. Organizațiile juridice care folosesc AI pentru analiză de contracte, cercetare legală sau due diligence trebuie să asigure vizibilitate asupra datelor de antrenament pentru a preveni breșele de confidențialitate și păstrarea privilegiului avocat-client. Agențiile guvernamentale trebuie să respecte directivele federale de guvernanță AI, inclusiv cerințe de transparență, auditarea bias-ului și documentarea deciziilor sistemelor AI pentru responsabilitate publică. Organizațiile din retail și e-commerce trebuie să monitorizeze sistemele AI folosite în motoarele de recomandare și personalizare pentru conformitate cu reglementările de protecție a consumatorului și legile concurenței. Organizațiile manufacturiere trebuie să urmărească sistemele AI utilizate în controlul calității și mentenanța predictivă pentru a asigura siguranța și fiabilitatea. Cerințele de vizibilitate specifice industriei trebuie integrate în cadrele de guvernanță, nu tratate ca exerciții de conformitate separate.

Organizațiile care implementează vizibilitatea AI la nivel de întreprindere ar trebui să adopte o abordare etapizată care să livreze rezultate rapide, construind simultan către capabilități de guvernanță mature și cuprinzătoare. Pornește cu inventarierea și documentarea—realizează un audit pentru a identifica toate sistemele AI utilizate în prezent, inclusiv AI-ul din umbră, și creează un registru centralizat care documentează scopul fiecărui sistem, proprietarul, sursele de date și importanța pentru business. Identifică rezultate rapide concentrând monitorizarea inițială pe sistemele cu risc ridicat, cum ar fi AI-ul orientat către clienți, sistemele care procesează date sensibile sau modelele care iau decizii cu impact asupra persoanelor. Implementează logare centralizată ca o capabilitate de bază care captează metadate despre toate activitățile sistemelor AI, permițând atât monitorizare în timp real, cât și analiză istorică. Stabilește politici de guvernanță care definesc standarde pentru documentarea, monitorizarea și conformitatea sistemelor AI, apoi comunică aceste politici clar tuturor stakeholderilor. Construiește echipe cross-funcționale care includ IT, securitate, business și conformitate, astfel încât inițiativele de vizibilitate să răspundă preocupărilor din toate perspectivele organizaționale. Măsoară și comunică progresul urmărind metricile de vizibilitate și împărtășind rezultatele cu conducerea, demonstrând valoarea investițiilor în guvernanță și construind sprijin organizațional pentru investiții continue în infrastructura de vizibilitate AI.

Vizibilitatea AI reprezintă capacitatea de a vedea și monitoriza ceea ce fac sistemele AI, în timp ce guvernanța AI este cadrul mai larg de politici, procese și controale care gestionează modul în care sistemele AI sunt dezvoltate, implementate și utilizate. Vizibilitatea este o componentă fundamentală a guvernanței—nu poți guverna ceea ce nu poți vedea. O guvernanță eficientă AI necesită vizibilitate cuprinzătoare pe toate cele trei dimensiuni: monitorizarea utilizării, a calității și a securității.

Organizațiile mari se confruntă cu provocări unice în gestionarea a sute sau mii de implementări AI în mai multe departamente, furnizori cloud și unități de afaceri. Fără vizibilitate cuprinzătoare, AI-ul din umbră se răspândește, riscurile de conformitate cresc, iar organizațiile nu pot optimiza investițiile în AI sau asigura utilizarea responsabilă a acestuia. Vizibilitatea permite identificarea riscurilor, aplicarea politicilor și maximizarea valorii inițiativelor AI.

O vizibilitate AI deficitară generează multiple riscuri: sistemele AI din umbră operează fără supraveghere, date sensibile pot fi expuse prin sisteme AI nemonitorizate, încălcările de conformitate nu sunt detectate, degradarea performanței modelelor trece neobservată, amenințările la securitate nu sunt identificate, iar organizațiile nu pot demonstra guvernanță către autorități. Aceste riscuri pot duce la breșe de date, amenzi de reglementare, daune de reputație și pierderea încrederii clienților.

AI-ul din umbră—instrumente AI neautorizate implementate fără știrea IT—creează zone oarbe care împiedică monitorizarea și guvernanța centralizată. Angajații pot folosi servicii publice AI precum ChatGPT fără supravegherea organizației, expunând potențial date sensibile sau încălcând cerințele de conformitate. AI-ul din umbră duce, de asemenea, la eforturi duplicate, irosirea resurselor și imposibilitatea aplicării politicilor și standardelor AI ale organizației.

Platformele de guvernanță AI specializate precum Liminal, Ardoq și Knostic oferă monitorizare centralizată, aplicarea politicilor și rapoarte de conformitate. Aceste platforme se integrează cu serviciile AI, captează jurnale detaliate, detectează anomalii și oferă tablouri de bord pentru echipele de guvernanță. În plus, AmICited este specializată în monitorizarea modului în care sistemele AI fac referire la brandul tău pe GPT-uri, Perplexity și Google AI Overviews, oferind vizibilitate asupra calității răspunsurilor AI.

Cadrul de reglementare precum Legea AI a UE, GDPR, CCPA și reglementările specifice industriei (OCC pentru sectorul bancar, FDA pentru sănătate) impun cerințe specifice de vizibilitate și documentare. Organizațiile trebuie să implementeze monitorizare care să demonstreze conformitatea cu aceste reglementări, inclusiv jurnale de audit, testarea bias-ului, monitorizarea performanței și documentarea procesului decizional al sistemului AI. Infrastructura de vizibilitate trebuie proiectată pentru a îndeplini aceste obligații de reglementare.

Metricile cheie includ: acoperirea vizibilității (procentul de sisteme AI documentate și monitorizate), maturitatea guvernanței (progresul prin etapele definite ale guvernanței), timpul de detectare și răspuns la incidente, respectarea conformității (procentul de sisteme care îndeplinesc cerințele de reglementare) și realizarea valorii de afaceri (beneficii tangibile din investițiile în vizibilitate). Organizațiile ar trebui să urmărească și metrici de utilizare (utilizatori activi, apeluri API), metrici de calitate (acuratețe, derivă), și metrici de securitate (anomalii detectate, încălcări ale politicilor).

Timpul de implementare variază în funcție de dimensiunea și complexitatea organizației. Infrastructura inițială de vizibilitate (inventariere, jurnale de bază, tablouri de bord) poate fi stabilită în 3-6 luni. Atingerea vizibilității cuprinzătoare asupra tuturor sistemelor AI necesită, de obicei, 6-12 luni. Obținerea unei guvernanțe mature și optimizate durează de obicei 12-24 de luni. Organizațiile ar trebui să adopte o abordare etapizată, începând cu sistemele cu risc ridicat și rezultate rapide, extinzând apoi acoperirea.

AmICited urmărește modul în care sistemele AI precum GPT, Perplexity și Google AI Overviews fac referire la brandul și conținutul tău. Obține vizibilitate asupra calității răspunsurilor AI și a mențiunilor brandului pe toate platformele AI majore.

Ghid complet pentru soluțiile enterprise de vizibilitate AI. Compară platforme de top precum Conductor, Profound și Athena. Află criterii de evaluare și strateg...

Află cum companiile SaaS obțin vizibilitate în ChatGPT, Perplexity și Google AI Overviews. Descoperă strategii GEO, optimizare de conținut și tactici de monitor...

Află ce este Vizibilitatea AI în Producție și cum producătorii B2B își pot optimiza prezența în instrumente de căutare alimentate de AI precum ChatGPT, Perplexi...