SEO Tehnic

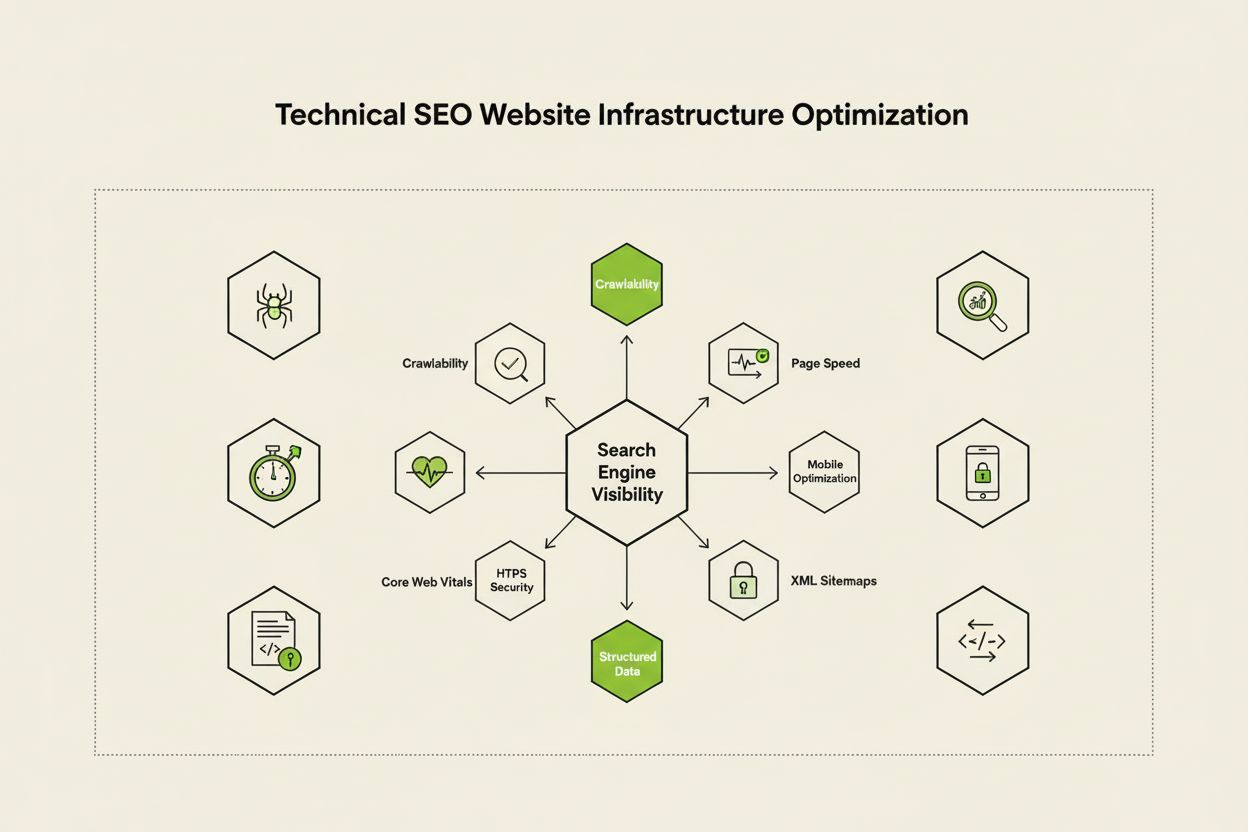

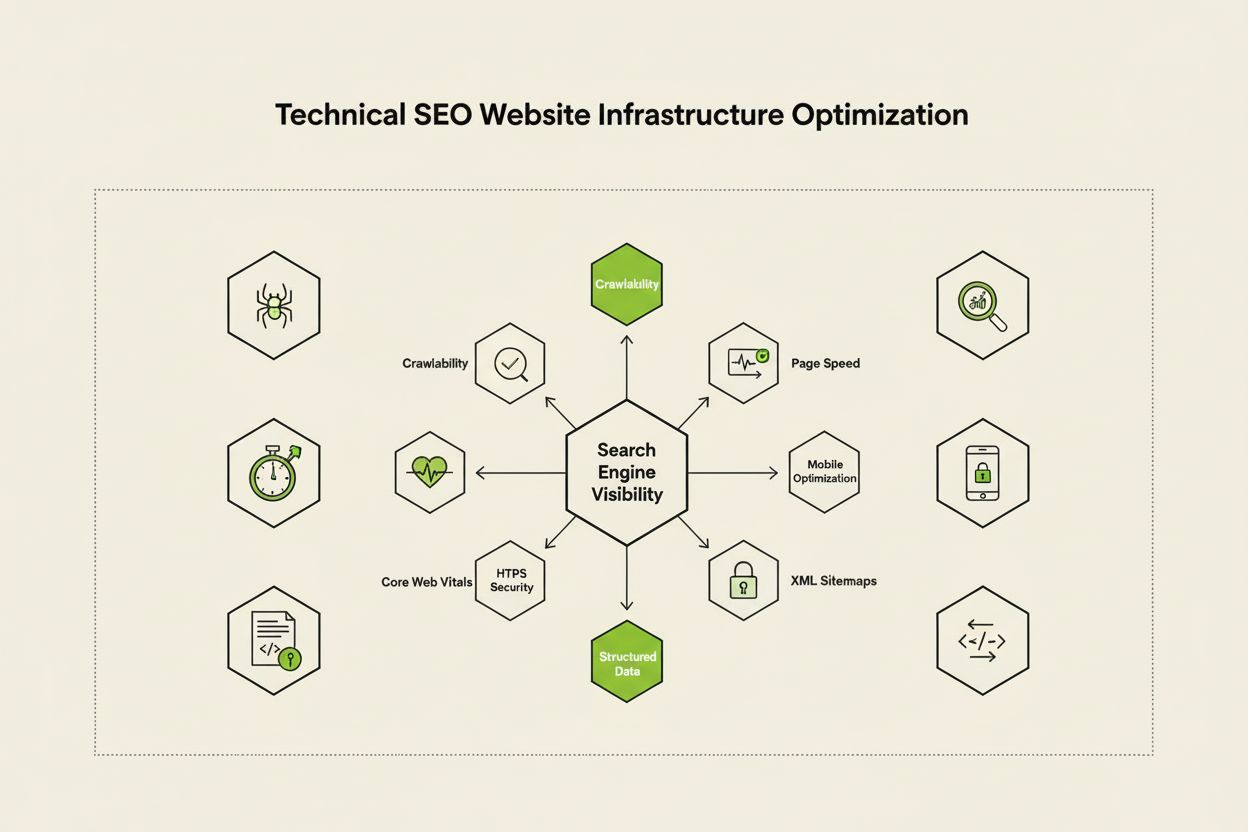

SEO tehnic optimizează infrastructura site-ului pentru accesarea, indexarea și clasarea de către motoarele de căutare. Află despre crawlabilitate, Core Web Vita...

JavaScript SEO este procesul de optimizare a site-urilor web generate cu JavaScript pentru a asigura că motoarele de căutare pot explora, reda și indexa eficient conținutul. Acesta include cele mai bune practici pentru a face aplicațiile web alimentate de JavaScript descoperibile și poziționabile în rezultatele căutării, menținând în același timp performanța optimă și o experiență bună pentru utilizator.

JavaScript SEO este procesul de optimizare a site-urilor web generate cu JavaScript pentru a asigura că motoarele de căutare pot explora, reda și indexa eficient conținutul. Acesta include cele mai bune practici pentru a face aplicațiile web alimentate de JavaScript descoperibile și poziționabile în rezultatele căutării, menținând în același timp performanța optimă și o experiență bună pentru utilizator.

JavaScript SEO este practica specializată de optimizare a site-urilor web generate cu JavaScript pentru a asigura că motoarele de căutare pot explora, reda și indexa eficient conținutul. Aceasta cuprinde un set cuprinzător de strategii tehnice, cele mai bune practici și metode de implementare concepute pentru a face aplicațiile web alimentate de JavaScript complet descoperibile și poziționabile în rezultatele căutării. Spre deosebire de site-urile tradiționale bazate pe HTML, unde conținutul este disponibil imediat în răspunsul serverului, conținutul redat cu JavaScript necesită pași suplimentari de procesare care pot influența semnificativ modul în care motoarele de căutare înțeleg și poziționează paginile tale. Disciplina combină expertiza tehnică SEO cu înțelegerea modului în care framework-urile moderne precum React, Vue și Angular interacționează cu crawler-ele motoarelor de căutare. JavaScript SEO a devenit din ce în ce mai critică, deoarece 98,7% dintre site-uri integrează acum JavaScript, făcând din aceasta o cunoaștere esențială pentru orice specialist SEO care lucrează cu tehnologii web contemporane.

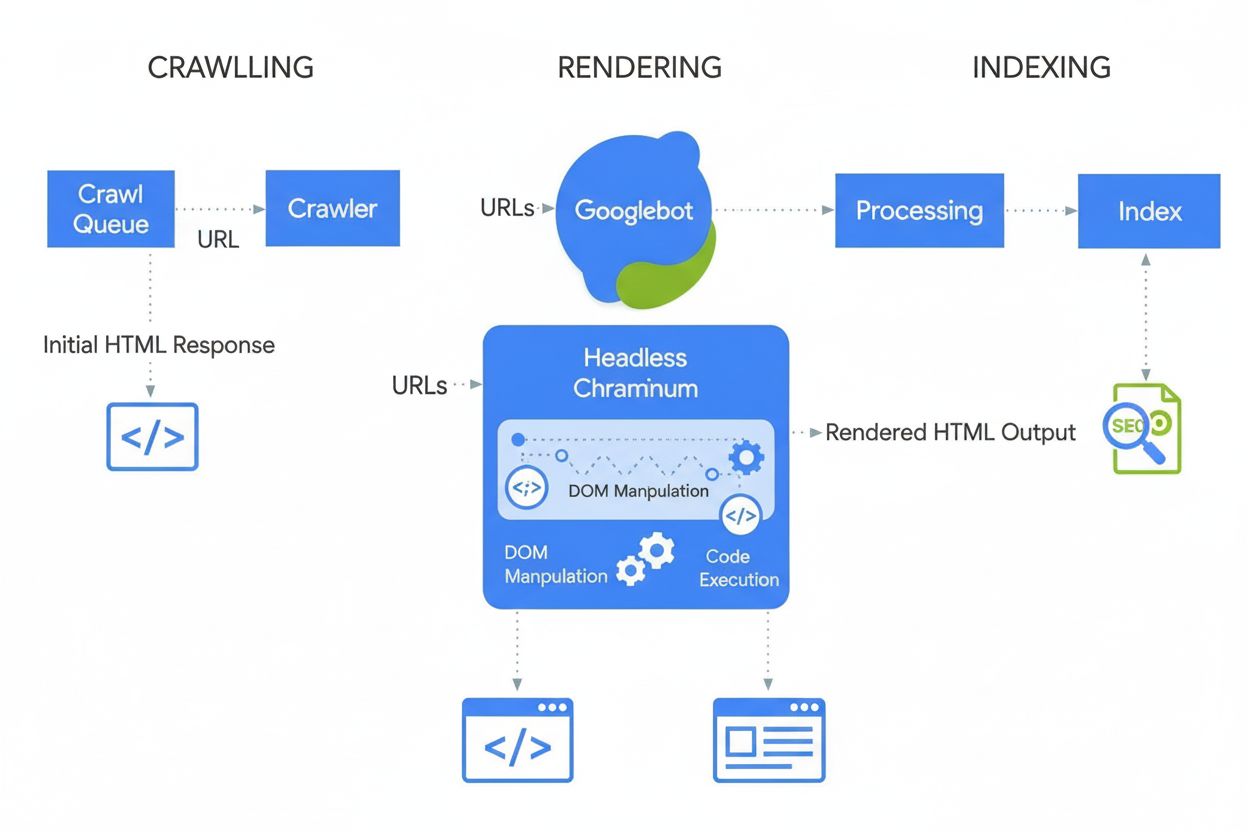

Ascensiunea framework-urilor JavaScript a transformat fundamental modul în care sunt construite site-urile web și modul în care motoarele de căutare trebuie să le proceseze. La începuturile web-ului, Googlebot pur și simplu parcurgea răspunsurile HTML de la servere, făcând SEO-ul direct — conținutul din HTML era indexat. Totuși, pe măsură ce dezvoltatorii au adoptat client-side rendering pentru experiențe mai interactive și dinamice, motoarele de căutare s-au confruntat cu o provocare majoră: conținutul nu mai era prezent în răspunsul HTML inițial, ci era generat de JavaScript în browser. Această schimbare a creat un decalaj semnificativ între ceea ce vedeau utilizatorii și ceea ce puteau accesa inițial motoarele de căutare. Google a răspuns dezvoltând capabilități de rendering cu headless Chromium, permițând Googlebot să execute JavaScript și să proceseze DOM-ul redat. Totuși, acest proces de rendering consumă multe resurse — aproximativ de 100 de ori mai scump decât simpla parcurgere a HTML-ului — motiv pentru care Google nu poate reda fiecare pagină imediat. Această constrângere a generat conceptul de render budget (buget de redare), unde paginile sunt puse la coadă pentru redare în funcție de importanța și potențialul de trafic estimat. Înțelegerea acestei evoluții este crucială deoarece explică de ce JavaScript SEO nu este opțional, ci o componentă fundamentală a strategiei moderne de SEO tehnic.

Abordarea Google pentru conținutul redat cu JavaScript urmează un proces sofisticat în trei faze, diferit fundamental de crawling-ul HTML tradițional. În faza de crawling, Googlebot solicită o adresă URL și primește răspunsul HTML inițial. Acesta este analizat imediat pentru extragerea link-urilor și verificarea directivelor de indexare precum meta robots și noindex. Esențial, dacă o pagină conține o etichetă noindex în HTML-ul inițial, Google nu va continua redarea — o distincție importantă adesea trecută cu vederea de specialiști. Simultan, URL-ul este pus la coadă pentru faza de rendering, unde Web Rendering Service (WRS) folosește headless Chromium pentru a executa JavaScript-ul, a construi DOM-ul și a genera HTML-ul complet redat. Acest pas poate dura secunde sau mai mult, în funcție de complexitatea JavaScript-ului, iar paginile pot aștepta mult în coadă dacă resursele Google sunt limitate. În final, în faza de indexare, Google procesează HTML-ul redat pentru a extrage conținut, link-uri și metadate pentru includerea în indexul de căutare. Informația esențială aici este că Google indexează pe baza HTML-ului redat, nu a răspunsului inițial — ceea ce înseamnă că JavaScript-ul poate schimba complet ce este indexat. Acest proces explică de ce site-urile JavaScript experimentează adesea întârzieri la indexare, de ce contează întârzierile de redare și de ce compararea HTML-ului din răspuns cu cel redat este vitală pentru diagnosticarea problemelor de JavaScript SEO.

| Metodă de Redare | Cum Funcționează | Avantaje SEO | Dezavantaje SEO | Recomandat Pentru |

|---|---|---|---|---|

| Server-Side Rendering (SSR) | Conținutul este complet redat pe server înainte de livrare către client | Conținutul este disponibil imediat în HTML-ul inițial; indexare rapidă; fără întârzieri de redare; suport pentru toți crawler-ii | Încărcare mai mare pe server; TTFB (Time to First Byte) mai lent; implementare complexă | Site-uri critice SEO, ecommerce, site-uri cu mult conținut, publicații de știri |

| Client-Side Rendering (CSR) | Serverul trimite HTML minim; JavaScript redă conținutul în browser | Încărcare redusă pe server; scalabilitate mai bună; tranziții de pagină mai rapide pentru utilizatori | Indexare întârziată; necesită redare; invizibil pentru crawler-ii LLM; încărcare inițială mai lentă; consum de buget de crawling | Aplicații web, dashboard-uri, conținut în spatele autentificării, site-uri fără dependență SEO |

| Rendering Dinamic | Serverul detectează crawler-ii și livrează HTML pre-redat; utilizatorii primesc CSR | Conținut disponibil imediat pentru crawler-i; echilibru între experiența bot-ului și a utilizatorului; mai ușor de implementat decât SSR | Configurare complexă; dependență de tool-uri; potențial risc de cloaking; necesită detecție de bot; soluție temporară | Site-uri mari cu mult JavaScript, SPA-uri ce necesită vizibilitate în căutare, soluție tranzitorie |

| Static Site Generation (SSG) | Conținutul este pre-redat la build și servit ca HTML static | Performanța cea mai rapidă; SEO optim; fără întârzieri la redare; Core Web Vitals excelente | Conținut dinamic limitat; rebuild necesar pentru actualizări; nepotrivit pentru date în timp real | Bloguri, documentație, site-uri de prezentare, conținut cu modificări rare |

Site-urile generate cu JavaScript prezintă mai multe obstacole tehnice care afectează direct performanța SEO și vizibilitatea în căutare. Cea mai importantă provocare este întârzierea la redare — deoarece redarea consumă multe resurse, Google poate întârzia redarea paginilor cu ore sau chiar zile, ceea ce înseamnă că noul conținut nu va fi indexat imediat după publicare. Acest lucru este deosebit de problematic pentru conținutul sensibil la timp, precum articolele de știri sau lansările de produse. O altă problemă critică este eroarea soft 404, care apare când aplicațiile single-page returnează codul 200 HTTP chiar și pentru pagini inexistente, inducând motoarele de căutare în eroare cu privire la ce ar trebui indexat. Modificările JavaScript asupra elementelor critice reprezintă un alt obstacol major: atunci când JavaScript modifică titluri, canonical tags, directive meta robots sau link-uri interne după răspunsul HTML inițial, motoarele de căutare pot indexa versiuni greșite sau pot rata semnale SEO importante. Problema consumului de buget de crawling este mai ales severă la site-urile mari — fișierele JavaScript sunt voluminoase și costisitoare, așa că Google va reda mai puține pagini, limitând adâncimea crawling-ului. În plus, crawler-ii LLM și instrumentele AI de căutare nu execută JavaScript, făcând conținutul disponibil doar după redare invizibil pe platforme AI emergente precum Perplexity, Claude și altele. Statisticile arată că 31,9% dintre specialiștii SEO nu știu cum să determine dacă un site depinde semnificativ de JavaScript, iar 30,9% nu se simt confortabil să investigheze probleme SEO cauzate de JavaScript, subliniind lipsa de cunoștințe în industrie.

Optimizarea conținutului redat cu JavaScript necesită o abordare multi-fațetată, care să cuprindă atât implementarea tehnică, cât și deciziile strategice. Prima și cea mai importantă practică este să inclusi conținutul esențial în răspunsul HTML inițial — titlurile, meta descrierile, canonical tags și conținutul cheie din body ar trebui să fie prezente în răspunsul serverului înainte de executarea JavaScript-ului. Astfel, motoarele de căutare primesc o imagine completă a paginii încă de la început și nu trebuie să aștepte redarea pentru a o înțelege. Evită blocarea fișierelor JavaScript în robots.txt, deoarece acest lucru împiedică Google să redea corect paginile; permite accesul la toate resursele JavaScript necesare pentru redare. Implementează coduri de stare HTTP corecte — folosește 404 pentru pagini inexistente și 301 pentru redirecționări, nu te baza pe JavaScript pentru aceste scenarii. Pentru aplicațiile single-page, utilizează History API în loc de fragmente URL pentru a asigura URL-uri unice și crawlable pentru fiecare view; fragmentele de tipul #/produse sunt nesigure pentru motoarele de căutare. Minimizează și amână JavaScript-ul neesențial pentru a reduce timpul de redare și a îmbunătăți Core Web Vitals — folosește code splitting pentru a încărca doar JavaScript-ul necesar pe fiecare pagină. Implementează lazy loading pentru imagini folosind atributul nativ loading="lazy" în loc de soluții bazate pe JavaScript, pentru ca motoarele de căutare să descopere imaginile fără redare. Folosește content hashing în numele fișierelor JavaScript (ex: main.2a846fa617c3361f.js) astfel încât Google să știe când codul s-a schimbat și trebuie re-descărcat. Testează implementarea folosind instrumente ca URL Inspection din Google Search Console, Screaming Frog cu rendering activat sau raportul Response vs Render din Sitebulb pentru a compara HTML-ul inițial cu cel redat și a identifica diferențele.

Alegerea metodei de redare adecvate este una dintre cele mai importante decizii pentru JavaScript SEO. Server-Side Rendering (SSR) este standardul de aur pentru site-urile critice SEO deoarece conținutul este complet redat pe server înainte de livrare, eliminând întârzierile și asigurând accesul tuturor crawler-ilor. Framework-uri precum Next.js și Nuxt.js facilitează implementarea SSR pentru echipele moderne de dezvoltare. Totuși, SSR necesită mai multe resurse de server și poate duce la TTFB mai lent, afectând experiența utilizatorului. Client-Side Rendering (CSR) este potrivit pentru aplicațiile web unde SEO nu este prioritar, precum dashboard-uri, instrumente în spatele autentificării sau aplicații interne. CSR reduce încărcarea pe server și permite experiențe interactive, dar creează întârzieri la indexare și face conținutul invizibil pentru crawler-ii LLM. Rendering-ul dinamic este o soluție de compromis: detectează crawler-ii și le livrează HTML pre-redat, în timp ce utilizatorii primesc experiența interactivă CSR. Instrumente precum Prerender.io gestionează acest lucru automat, dar Google recomandă explicit această metodă doar temporar, recomandând trecerea la SSR pe termen lung. Static Site Generation (SSG) este ideal pentru conținutul care nu se schimbă frecvent — conținutul este pre-redat la build și servit ca HTML static, oferind performanță și SEO optime. Decizia trebuie luată în funcție de prioritățile SEO, resursele tehnice și frecvența actualizării conținutului. Datele arată că 60% dintre specialiștii SEO folosesc acum crawlere JavaScript pentru audituri, ceea ce indică o conștientizare tot mai mare că redarea trebuie luată în calcul în analiza SEO tehnică.

Un JavaScript SEO eficient necesită monitorizarea continuă a unor metrici și indicatori specifici ce arată modul în care motoarele de căutare interacționează cu conținutul tău redat cu JavaScript. Compararea HTML-ului din răspuns cu cel redat este fundamentală — folosind instrumente precum raportul Response vs Render din Sitebulb, poți identifica exact ce schimbă JavaScript-ul pe pagini, inclusiv modificări ale titlurilor, meta descrierilor, canonical tags, linkurilor interne și directivelor robots. Statisticile arată că 18,26% dintre crawl-urile JavaScript au tag-urile H1 doar în HTML-ul redat (nu și în răspunsul inițial), iar critic, 4,60% dintre audituri JavaScript arată noindex doar în HTML-ul de răspuns — un scenariu de coșmar în care Google vede noindex și nu redă niciodată pagina, prevenind indexarea conținutului dorit. Consumul bugetului de redare trebuie monitorizat prin Raportul Coverage din Google Search Console, care arată câte pagini sunt puse la coadă pentru redare versus cele deja redate. Core Web Vitals sunt deosebit de importante pentru site-urile JavaScript deoarece execuția JavaScript influențează direct Largest Contentful Paint (LCP), First Input Delay (FID) și Cumulative Layout Shift (CLS). Monitorizează întârzierea la indexare — cât de repede apare conținutul tău în indexul Google după publicare, deoarece site-urile JavaScript au de obicei întârzieri mai mari decât cele HTML. Urmărește eficiența crawling-ului comparând numărul de pagini crawl-uite cu totalul de pagini ale site-ului; site-urile JavaScript au adesea eficiență mai scăzută din cauza constrângerilor de resurse. Folosește URL Inspection Tool din Google Search Console pentru a verifica dacă informațiile critice apar în HTML-ul redat procesat de Google, nu doar în răspunsul inițial.

Apariția platformelor de căutare alimentate de AI precum Perplexity, ChatGPT, Claude și Google AI Overviews a creat o nouă dimensiune pentru JavaScript SEO, dincolo de motoarele de căutare tradiționale. Majoritatea crawler-ilor LLM nu execută JavaScript — ei consumă HTML-ul brut și conținutul DOM așa cum apare în răspunsul inițial al serverului. Asta înseamnă că, dacă informațiile critice, produsele sau mesajele de brand apar doar după executarea JavaScript, acestea sunt complet invizibile pentru instrumentele AI de căutare. Se creează astfel o dublă problemă de vizibilitate: conținutul invizibil pentru crawler-ii LLM nu va fi citat în răspunsurile AI, iar utilizatorii care caută pe platforme AI nu vor descoperi conținutul tău. Pentru utilizatorii AmICited care monitorizează apariția brandului și domeniului în răspunsurile AI, acest aspect este crucial — dacă paginile generate cu JavaScript nu sunt accesibile crawler-ilor LLM, nu vei apărea deloc în citările AI. Soluția este să te asiguri că informațiile esențiale sunt prezente în răspunsul HTML inițial, făcându-le accesibile atât motoarelor de căutare tradiționale, cât și crawler-ilor AI. De aceea, Server-Side Rendering sau Rendering Dinamic devin și mai importante în era căutării AI — ai nevoie ca informațiile să fie vizibile nu doar pentru Googlebot, ci și pentru tot mai multe instrumente AI care nu execută JavaScript.

Peisajul JavaScript SEO continuă să evolueze odată cu progresul tehnologiilor web și al motoarelor de căutare. Google a făcut investiții semnificative pentru a îmbunătăți capabilitățile de redare JavaScript, trecând de la un proces în două faze (crawl și indexare) la unul în trei faze (crawl, render și indexare) ce gestionează mai bine aplicațiile moderne. Totuși, redarea rămâne limitată de resurse, iar Google nu va reda fiecare pagină imediat și nici bugetele de redare nu vor dispărea. Industria se îndreaptă spre abordări hibride de redare, unde conținutul critic este redat pe server, iar elementele interactive pe client, echilibrând nevoile SEO și experiența utilizatorului. Web Components și Shadow DOM devin tot mai prezente, necesitând ca specialiștii SEO să înțeleagă cum interacționează aceste tehnologii cu redarea motoarelor. Creșterea căutării AI aduce presiune suplimentară pentru ca informațiile să fie accesibile fără execuție JavaScript, ceea ce va stimula probabil adoptarea metodelor SSR și SSG. Core Web Vitals rămân un factor de ranking, iar impactul JavaScript asupra acestor metrici face ca optimizarea performanței să fie inseparabilă de JavaScript SEO. Datele din industrie arată că doar 10,6% dintre specialiștii SEO înțeleg perfect cum Google parcurge, redă și indexează JavaScript, ceea ce indică un potențial mare de educație și perfecționare. Pe măsură ce framework-urile JavaScript devin mai sofisticate și platformele AI de căutare se extind, expertiza JavaScript SEO va fi tot mai valoroasă și esențială pentru vizibilitate organică competitivă.

main.2a846fa617c3361f.js) pentru ca Google să știe când codul s-a schimbat și trebuie re-descărcatloading="lazy") în loc de soluții JavaScript pentru compatibilitate mai bună cu crawler-iiJavaScript SEO a evoluat de la o preocupare tehnică de nișă la o componentă fundamentală a optimizării moderne pentru motoarele de căutare. Odată cu 98,7% dintre site-uri care integrează JavaScript și 88% dintre specialiștii SEO care întâlnesc frecvent site-uri dependente de JavaScript, abilitatea de a optimiza conținutul redat cu JavaScript nu mai este opțională — este esențială. Complexitatea pipeline-ului de redare în trei faze, constrângerile bugetelor de redare și apariția platformelor AI de căutare au creat o provocare multifacetică ce necesită atât cunoștințe tehnice, cât și decizii strategice. Statisticile sunt îngrijorătoare: 41,6% dintre specialiștii SEO nu au citit documentația Google pentru JavaScript, 31,9% nu știu cum să identifice site-urile dependente de JavaScript, iar 30,9% nu se simt confortabil să investigheze problemele cauzate de JavaScript. Totuși, impactul este semnificativ — 4,60% dintre audituri JavaScript arată probleme critice precum etichete noindex doar în HTML-ul de răspuns, care împiedică complet indexarea. Soluția necesită investiții în educație, adoptarea strategiilor de redare potrivite și implementarea celor mai bune practici pentru ca informațiile să fie accesibile atât motoarelor de căutare, cât și crawler-ilor AI. Indiferent dacă folosești Server-Side Rendering, Rendering Dinamic sau optimizezi cu grijă Client-Side Rendering, scopul rămâne același: să faci conținutul generat cu JavaScript complet descoperibil, indexabil și vizibil pe toate platformele de căutare — de la Google Search la noile instrumente AI. Pentru organizațiile care folosesc AmICited pentru monitorizarea vizibilității brandului în răspunsurile AI, JavaScript SEO devine și mai critic, deoarece conținutul redat cu JavaScript neoptimizat va fi invizibil pentru crawler-ii LLM și nu va genera citări în rezultatele căutării AI.

Da, Google redă și indexează conținutul JavaScript utilizând headless Chromium. Totuși, redarea consumă multe resurse și este amânată până când Google dispune de resurse suficiente. Google procesează paginile în trei faze: crawling, rendering și indexing. Paginile marcate cu etichete noindex nu sunt redate, iar întârzierile de redare pot încetini indexarea. Cel mai important, HTML-ul redat — nu HTML-ul inițial din răspuns — este cel folosit de Google pentru deciziile de indexare.

Conform datelor din 2024, 98,7% dintre site-uri au acum un anumit nivel de dependență de JavaScript. În plus, 62,3% dintre dezvoltatori folosesc JavaScript ca limbaj principal de programare, iar 88% dintre specialiștii SEO lucrează cu site-uri dependente de JavaScript uneori sau tot timpul. Această adopție pe scară largă face ca cunoștințele de JavaScript SEO să fie esențiale pentru profesioniștii SEO moderni.

Provocările cheie includ întârzierile de redare care încetinesc indexarea, procesarea ce consumă multe resurse și reduce bugetul de crawling, posibile erori soft 404 la aplicațiile single-page și modificările aduse de JavaScript elementelor critice precum titlurile, canonicals și etichetele meta robots. În plus, majoritatea crawler-elor LLM și instrumentelor de căutare AI nu execută JavaScript, ceea ce face conținutul invizibil pentru platformele AI dacă acesta apare doar după redare.

Response HTML reprezintă HTML-ul inițial trimis de server (ce vezi în 'View Source'). Rendered HTML este DOM-ul final după executarea JavaScript (ce vezi în Inspectorul browserului). JavaScript poate modifica semnificativ DOM-ul prin injectarea de conținut, schimbarea metadatelor, rescrierea titlurilor și adăugarea sau eliminarea link-urilor. Motoarele de căutare indexează pe baza HTML-ului redat, nu a celui din răspuns.

Server-Side Rendering (SSR) este optim pentru SEO, deoarece conținutul este complet redat pe server înainte de livrare. Client-Side Rendering (CSR) cere motoarelor de căutare să redea paginile, ceea ce provoacă întârzieri și probleme de indexare. Rendering-ul dinamic livrează HTML pre-redat crawler-ilor, în timp ce utilizatorii primesc CSR, dar Google îl recomandă doar ca soluție temporară. Alege metoda în funcție de prioritățile SEO ale site-ului și resursele tehnice disponibile.

Folosește instrumentul de Inspecție URL din Google Search Console: accesează Inspecția URL, dă click pe 'Testare URL live', apoi vezi fila 'HTML' pentru a vedea HTML-ul redat procesat de Google. Alternativ, folosește instrumente precum Screaming Frog cu rendering activat, raportul Response vs Render din Sitebulb sau Chrome DevTools pentru a compara HTML-ul inițial cu DOM-ul redat și a identifica problemele cauzate de JavaScript.

Render budget reprezintă cantitatea de resurse pe care Google le alocă pentru redarea paginilor site-ului tău. Google prioritizează redarea pentru paginile care se așteaptă să primească mai mult trafic din căutări. Site-urile încărcate cu JavaScript, dar cu prioritate scăzută, pot avea întârzieri semnificative de redare, încetinind indexarea. De aceea, este esențial să optimizezi JavaScript-ul pentru a reduce timpul de redare și să te asiguri că informațiile critice sunt prezente în răspunsul HTML inițial pentru performanță SEO optimă.

Majoritatea crawler-elor LLM și instrumentelor AI de căutare (precum Perplexity, Claude și altele) nu execută JavaScript — ele consumă HTML-ul brut. Dacă informațiile critice apar doar după executarea JavaScript, acestea sunt invizibile atât pentru crawling-ul inițial Google, cât și pentru platformele AI. De aceea, JavaScript SEO este esențial nu doar pentru căutarea tradițională, ci și pentru vizibilitatea și citarea în AI.

Începe să urmărești cum te menționează chatbot-urile AI pe ChatGPT, Perplexity și alte platforme. Obține informații utile pentru a-ți îmbunătăți prezența în AI.

SEO tehnic optimizează infrastructura site-ului pentru accesarea, indexarea și clasarea de către motoarele de căutare. Află despre crawlabilitate, Core Web Vita...

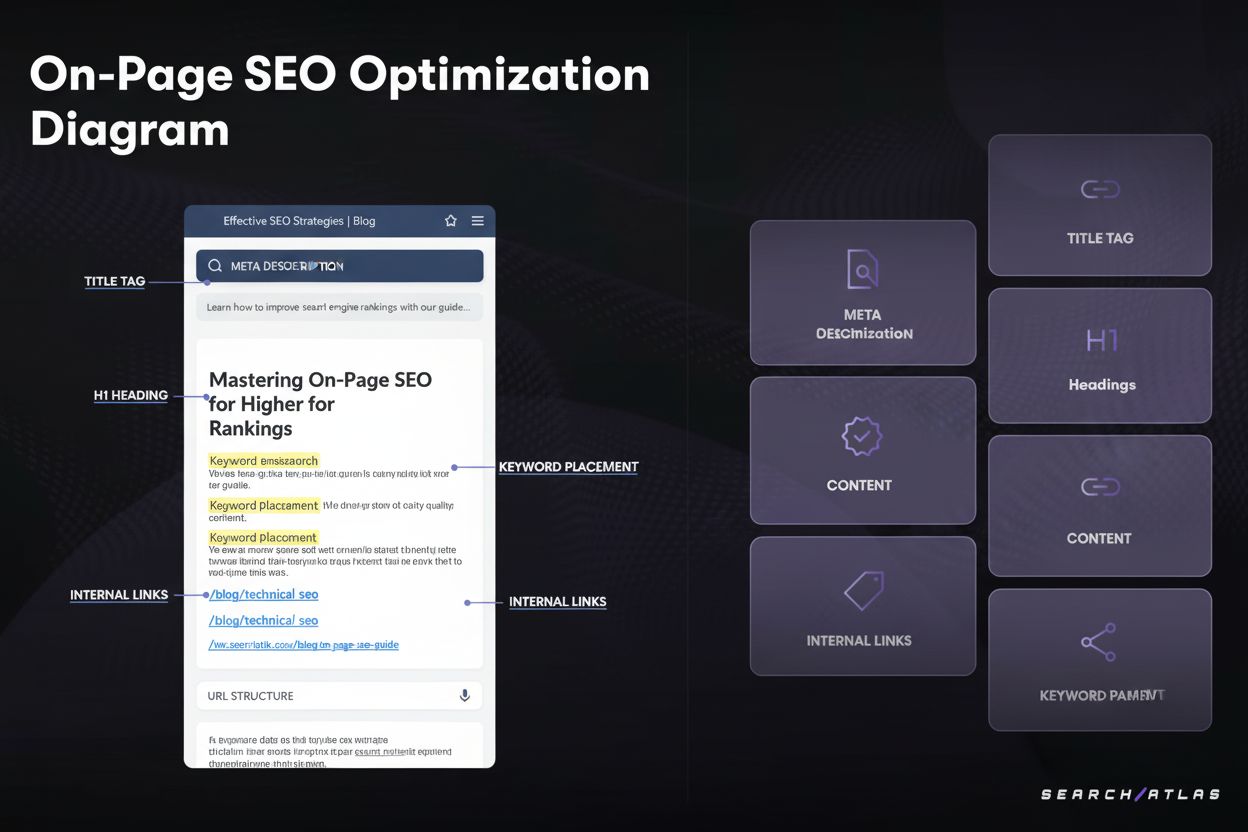

SEO pe pagină optimizează elemente ale paginii web precum titluri, conținut și legături pentru a îmbunătăți clasamentul în căutări. Află factorii cheie, tehnici...

News SEO este optimizarea specializată a articolelor de știri pentru Google News și Top Stories. Află factorii de clasare, cele mai bune practici și cum să îmbu...