Ako médiá získavajú AI viditeľnosť v ChatGPT, Perplexity a AI vyhľadávačoch

Zistite, ako mediálne spoločnosti dosahujú viditeľnosť v AI-generovaných odpovediach prostredníctvom optimalizácie obsahu, získaných médií, digitálneho PR a str...

Zistite, ako môžu vládne agentúry optimalizovať svoju digitálnu prítomnosť pre AI systémy ako ChatGPT a Perplexity. Objavte stratégie na zlepšenie AI viditeľnosti, zabezpečenie transparentnosti a zodpovednú implementáciu AI vo verejnom sektore.

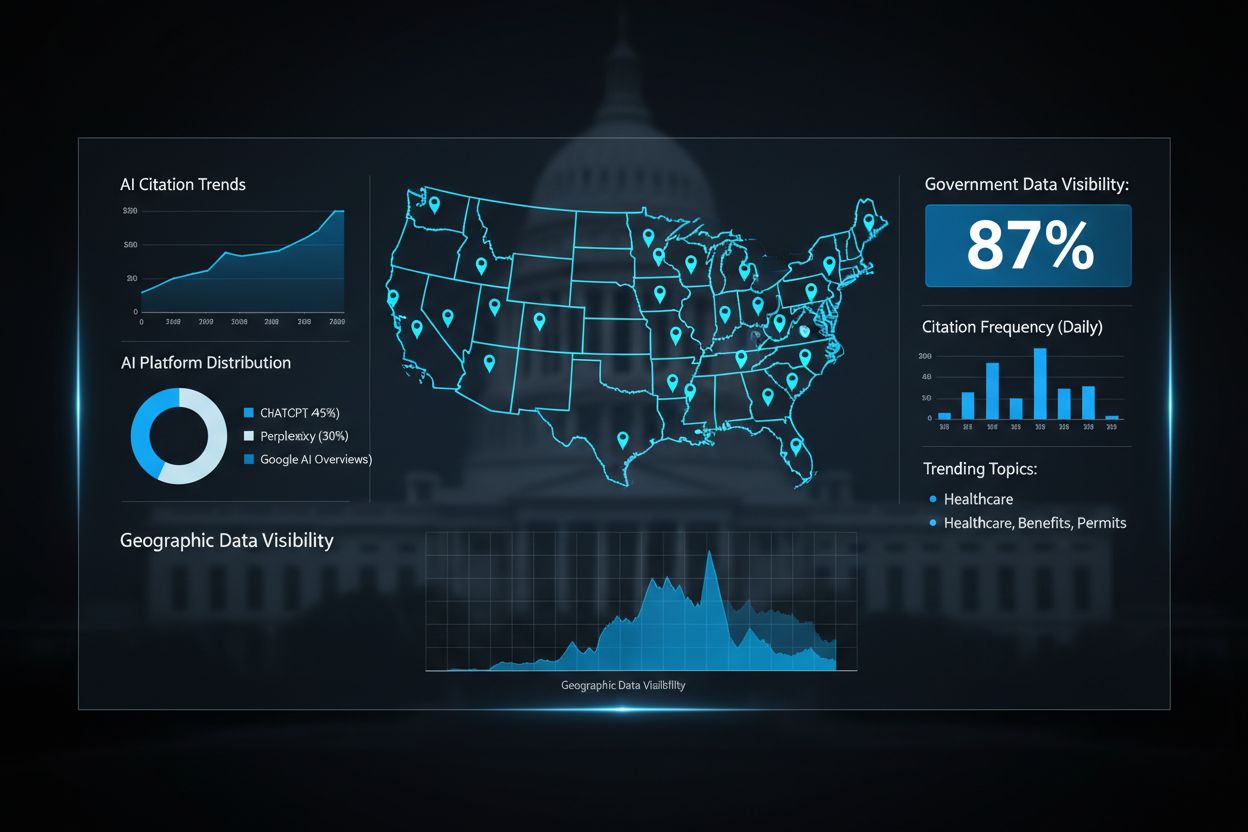

AI viditeľnosť vo vláde označuje mieru, do akej umelé inteligencie – vrátane GPT, Perplexity a Google AI Prehľadov – dokážu objaviť, získať prístup a citovať vládne dáta a zdroje pri odpovedaní na otázky verejnosti. Táto viditeľnosť je kľúčová, pretože vládne agentúry majú autoritatívne informácie o všetkom od zdravotníckych predpisov až po sociálne služby, no veľká časť týchto dát ostáva pre moderné AI systémy neviditeľná. Keď sa občania pýtajú AI asistentov na vládne programy, dávky alebo politiky, zaslúžia si presné, aktuálne odpovede zo zdrojov oficiálnych vládnych stránok namiesto zastaraných či neúplných informácií. Verejná dôvera vo vládu závisí od toho, či AI systémy správne referencujú a pripisujú vládne dáta, čím sa zachováva integrita oficiálnych informácií v čoraz viac AI-riadenom informačnom prostredí. Transparentnosť AI sa stáva základom demokratickej správy vecí verejných, keď si občania môžu overiť, že odporúčania AI vychádzajú z legitímnych vládnych zdrojov. AmICited.com slúži ako kritická monitorovacia platforma, ktorá sleduje, ako sú vládne dáta citované a referencované vo veľkých AI systémoch, a pomáha agentúram pochopiť ich viditeľnosť a dopad v AI ekosystéme. Zavedením jasnej viditeľnosti AI citácií vládnych údajov môžu organizácie verejného sektora lepšie slúžiť občanom a udržať si autoritu nad vlastnými informáciami.

Vládne agentúry naďalej zápasia s dátovými silami vytvorenými desaťročiami fragmentovaných IT investícií, kde kľúčové informácie ostávajú uzamknuté v nekompatibilných dedičných systémoch, ktoré sa nedokážu jednoducho prepojiť s modernými AI platformami. Tieto zastarané systémy boli navrhnuté na tradičné webové rozhrania a správu dokumentov, nie na sémantické porozumenie a prístup k dátam v reálnom čase, ktorý AI systémy vyžadujú. Náklady tejto technologickej fragmentácie sú ohromujúce: organizácie ročne premrhajú približne 140 miliárd dolárov na nevyužitých benefitoch zo zastaraných procesov, ktoré by mohli byť zefektívnené integráciou AI. Okrem strát efektivity vytvárajú dedičné systémy významné bezpečnostné riziká, keď sa vládne dáta musia manuálne extrahovať a zdieľať s verejnými AI systémami, čím rastie riziko únikov a neoprávneného prístupu. Výzva sa prehlbuje aj tým, že mnohé vládne weby postrádajú štruktúrované dáta, metadáta a API infraštruktúru potrebnú na to, aby AI crawleri mohli správne indexovať a chápať vládne informácie.

| Tradičné vládne IT | Infraštruktúra pripravená na AI |

|---|---|

| Oddelené databázy s obmedzenou interoperabilitou | Integrované dátové platformy s API a štruktúrovanými formátmi |

| Manuálne extrakcie a zdieľanie dát | Automatizované, bezpečné dátové toky |

| Neštruktúrované dokumenty a PDF | Sémantické webové štandardy a strojovo čitateľné formáty |

| Reaktívne bezpečnostné opatrenia | Ochrana súkromia už pri návrhu a kontinuálny monitoring |

| Obmedzený prístup k dátam v reálnom čase | Živé dátové toky a dynamické doručovanie obsahu |

Namiesto unáhleného nasadzovania AI technológií úspešné vládne organizácie uplatňujú strategický, fázovaný implementačný plán, ktorý uprednostňuje plánovanie a pripravenosť organizácie pred technologickými schopnosťami. Tento prístup uznáva, že prijatie AI vo verejnom sektore vyžaduje starostlivú koordináciu naprieč viacerými skupinami zainteresovaných – od IT oddelení cez pracovníkov v prvej línii až po samotných občanov.

Päťkroková implementačná cesta:

Identifikácia strategických príležitostí: Vykonajte komplexné audity vládnych operácií na identifikáciu prípadov s vysokým dopadom, kde AI môže priniesť merateľnú verejnú hodnotu, napr. skrátením doby spracovania žiadostí, zlepšením dostupnosti služieb či posilnením dátovo riadeného rozhodovania.

Komplexná príprava: Posúďte súčasnú dátovú infraštruktúru, identifikujte problémy integrácie dedičných systémov, nastavte rámce správy a vybudujte internú AI gramotnosť ešte pred akýmkoľvek technologickým nasadením.

Návrh strategického pilotu: Spustite kontrolované piloty v konkrétnych oddeleniach alebo oblastiach služieb s jasnými metrikami úspechu, čo umožní tímom poučiť sa z reálnych výziev v nízkorizikovom prostredí pred škálovaním.

Riadenie organizačných zmien: Vytvorte školiace programy, riešte obavy zamestnancov zo straty práce, nastavte jasné komunikačné kanály a feedback mechanizmy, aby sa pracovníci a zainteresovaní cítili vypočutí počas celého prechodu.

Meranie dopadu: Stanovte KPI v súlade s cieľmi vlády, neustále monitorujte výkonnosť AI systému, sledujte spokojnosť občanov, merajte úspory a upravujte stratégie implementácie podľa dôkazov.

Tento prístup „technológia až na druhom mieste“ zabezpečuje, že implementácia AI slúži naozaj verejným potrebám a nestáva sa len drahým riešením hľadajúcim problém.

Etická správa AI je nevyhnutná, keďže vlády na celom svete si uvedomujú, že AI systémy rozhodujúce o občanoch musia fungovať v jasných etických a právnych rámcoch. Kanadský rámec hodnotenia vplyvu algoritmov ponúka praktický model, ktorý rozdeľuje AI systémy do štyroch úrovní vplyvu – minimálny, stredný, vysoký a veľmi vysoký – pričom pre každý stupeň stanovuje požiadavky na správu a dohľad. Tento stupňovitý prístup umožňuje vládam prideliť zdroje primerane, aplikovať dôkladný dohľad na systémy s vysokým dopadom (napr. algoritmy v trestnom súdnictve) a zároveň zachovať rozumný dohľad nad aplikáciami s nižším vplyvom. Estónsko je priekopníkom ochrany súkromia už pri návrhu vďaka systému Data Tracker, ktorý monitoruje všetky prístupy k vládnym dátam v rámci digitálnej infraštruktúry a poskytuje 450 000 občanom úplnú transparentnosť o tom, ktoré agentúry pristupujú k ich osobným údajom a na aké účely. Zodpovednosť algoritmov znamená, že vládne agentúry musia dokumentovať, ako AI systémy robia rozhodnutia, viesť auditné stopy a udržiavať schopnosť vysvetliť odporúčania dotknutým občanom. AmICited.com zohráva dôležitú úlohu v transparentnosti tým, že monitoruje, ako sú vládne údaje citované a referencované vo verejných AI systémoch, a pomáha agentúram overiť, že ich informácie sú presne prezentované a správne pripísané. Bez robustného monitoringu a rámcov správy hrozí, že AI systémy vo vláde podlomia verejnú dôveru a prehĺbia zaujatosti, ktoré neúmerne zasiahnu zraniteľné skupiny.

Vlády po celom svete preukazujú, že strategická implementácia AI prináša značnú verejnú hodnotu, ak je realizovaná premyslene. Austrálsky Department of Home Affairs nasadil systém Targeting 2.0, AI platformu, ktorá zvýšila bezpečnosť hraníc a odhaľovanie podvodov, čím sa zabránilo škodám vo výške 3 miliárd AUD, pričom sa zároveň skrátili časy spracovania pre legitímnych cestujúcich a žiadateľov. Chatbot National Highways vo Veľkej Británii je príkladom, ako AI zlepšuje služby občanom tým, že rieši rutinné otázky o stave ciest a dopravných udalostiach, čím uvoľňuje ľudí pre zvládanie krízových situácií vyžadujúcich ľudský úsudok a empatiu. Estónska platforma Bürokratt predstavuje decentralizovaný, GDPR-kompatibilný prístup k AI vo vláde, ktorý umožňuje občanom komunikovať s AI asistentmi v rutinných administratívnych úlohách pri zachovaní prísnej ochrany údajov a toho, aby citlivé rozhodnutia zostali pod ľudskou kontrolou. Prístup k správe AI v Marylande zaviedol jasné štruktúry zodpovednosti a pravidelné audity AI systémov používaných v štátnej správe, čím vytvoril model, ktorý začali preberať aj ďalšie americké štáty. Digitálna agentúra Japonska úspešne digitalizovala konzultácie o starostlivosti o deti pomocou AI, čím skrátila čakacie doby z týždňov na hodiny pri zachovaní ľudského dohľadu v prípadoch vyžadujúcich špecializovaný zásah. Tieto rozmanité príklady ukazujú, že úspech AI vo vláde nezávisí od sofistikovanosti technológie, ale od premyslenej implementácie, ktorá uprednostňuje potreby občanov, zachováva transparentnosť a ponecháva rozhodnutia s dosahom na ľudí pod ľudskou kontrolou.

Ako sa AI systémy stávajú hlavným rozhraním, cez ktoré občania získavajú informácie, optimalizácia vládnych webových stránok na vyhľadateľnosť AI je rovnako dôležitá ako tradičné SEO. Vládne weby musia implementovať štruktúrované dáta, komplexné metadáta a strojovo čitateľné formáty, ktoré umožnia AI crawlerom porozumieť a správne indexovať vládne informácie. Výsledkom je, že keď sa občania pýtajú AI asistentov na vládne služby, dostanú presné, autoritatívne odpovede. Mnohé vládne weby dnes prezentujú informácie v podobách optimalizovaných pre ľudí – PDF, neštruktúrovaný text a zložité navigácie – s ktorými AI systémy zápasia. REI Systems sa venuje optimalizácii federálnych stránok na prístupnosť pre AI a ukazuje, že relatívne jednoduché technické úpravy môžu dramaticky zvýšiť viditeľnosť vlády v AI odpovediach. AmICited.com monitoruje AI viditeľnosť vládnych stránok na hlavných platformách, pomáha agentúram pochopiť, ako často sa ich informácie objavujú v AI odpovediach, a identifikovať medzery, kde by vládne dáta mali byť dostupnejšie. Keď vládne weby implementujú správne semantické webové štandardy, API infraštruktúru a funkcie prístupnosti, zvyšujú pravdepodobnosť, že AI systémy budú citovať oficiálne vládne zdroje namiesto sekundárnych alebo zastaraných informácií. Táto optimalizácia prospieva občanom tým, že im zabezpečuje prístup k autoritatívnym údajom priamo z vládnych zdrojov a zároveň pomáha agentúram udržať kontrolu nad tým, ako sú ich informácie prezentované a interpretované.

Meranie dopadu AI vo verejnej správe si vyžaduje jasne stanovené KPI v súlade s cieľmi verejného sektora a presahujúce bežné metriky efektivity – treba zachytiť širšie ukazovatele spokojnosti občanov, rovnosti a demokratickej zodpovednosti. Estónsky hodnotiaci rámec ponúka praktický model, ktorý posudzuje AI iniciatívy v štyroch dimenziách: časová efektivita (koľko času sa ušetrí zamestnancom), nákladová efektívnosť (návratnosť investícií), inovačný potenciál (či systém umožňuje nové modely služieb) a merateľný dopad (kvantifikovateľné zlepšenia pre občanov). Systematické meranie umožňuje vládnym agentúram identifikovať, ktoré AI aplikácie prinášajú skutočnú verejnú hodnotu a ktoré treba upraviť alebo ukončiť, čím sa predíde plytvaniu investíciami do technológií, ktoré neslúžia občanom. Zdieľanie vedomostí medzi agentúrami urýchľuje učenie, pretože úspešné implementácie v jednom oddelení môžu byť prispôsobené a nasadené inde, čím rastie návratnosť investícií do AI. Systémy kontinuálneho zlepšovania a monitoringu – podporené nástrojmi ako AmICited.com, ktoré sledujú AI viditeľnosť a vzorce citácií – umožňujú agentúram vylepšovať AI systémy na základe skutočných dát, nie predpokladov. Budovanie inštitucionálnych vedomostí o tom, čo v AI implementácii vo vláde funguje, vytvára základ pre udržateľné a dlhodobé prijatie, ktoré prežije zmeny vedenia aj rozpočtové cykly.

Napriek jasným potenciálnym prínosom čelia vládne agentúry významným prekážkam prijatia AI, ktoré ďaleko presahujú technologické výzvy. Obavy zamestnancov predstavujú zásadnú prekážku – 31 % vládnych zamestnancov uvádza bezpečnosť práce ako svoju hlavnú obavu pri implementácii AI, čo si vyžaduje transparentnú komunikáciu o tom, ako AI rozšíri, a nie nahradí ľudskú prácu. Nedostatok talentov tento problém prehlbuje, keďže 38 % vládnych organizácií uvádza ťažkosti s náborom AI špecialistov so znalosťami potrebnými na implementáciu a údržbu sofistikovaných systémov. Podcenenie nákladov predstavuje ďalšiu významnú prekážku, keďže agentúry často zistia, že skutočné náklady na implementáciu AI sú 5-10-krát vyššie ako pôvodné odhady, čo zaťažuje rozpočty a vytvára politický odpor voči ďalším investíciám. Obavy o ochranu súkromia a bezpečnosť dát sú najvýznamnejšou prekážkou, pričom 60 % vládnych lídrov ich uvádza ako hlavný dôvod neochoty zavádzať AI, čo odráža oprávnené obavy o ochranu údajov občanov v čase rastúcich kybernetických hrozieb. Efektívne stratégie riadenia zmien musia tieto prekážky priamo riešiť zapojením zainteresovaných strán, transparentnou komunikáciou o schopnostiach a limitoch AI, investíciami do školení zamestnancov a jasnými rámcami správy, ktoré chránia súkromie občanov a zároveň umožňujú inovácie. Vládne agentúry, ktoré tieto prekážky úspešne prekonajú, zvyčajne výrazne investujú do riadenia zmien, nastavujú jasné komunikačné kanály so zamestnancami a občanmi a preukazujú skoré úspechy, ktoré budujú dôveru v AI systémy pred rozšírením na aplikácie s vyšším dopadom.

AI viditeľnosť vlády označuje, ako jednoducho môžu AI systémy ako ChatGPT, Perplexity a Google AI Overviews objaviť a citovať vládne údaje. Je to dôležité, pretože občania si zaslúžia presné, autoritatívne informácie z oficiálnych vládnych zdrojov, keď sa pýtajú AI asistentov na politiky, dávky a služby. Slabá viditeľnosť znamená, že AI systémy môžu poskytovať zastarané alebo neúplné informácie namiesto toho, aby občanov smerovali na oficiálne vládne zdroje.

Vládne webové stránky by mali implementovať štruktúrované dáta, komplexné metadáta, strojovo čitateľné formáty a vhodnú API infraštruktúru. To zahŕňa použitie semantických webových štandardov, zabezpečenie prístupnosti obsahu pre AI crawlerov a organizovanie informácií spôsobom, ktorý AI systémy ľahko pochopia a správne priradia oficiálnym vládnym zdrojom.

Hlavné prekážky zahŕňajú obavy o ochranu súkromia a bezpečnosť dát (60 % vládnych lídrov), nedostatok talentov (38 %), obavy zamestnancov o stratu pracovných miest (31 %), podcenenie nákladov (skutočné náklady často 5-10x vyššie ako odhady) a nedostatočnú digitálnu infraštruktúru (45 %). Riešenie týchto prekážok si vyžaduje strategické plánovanie, riadenie zmien a jasné rámce správy.

Úspešné prístupy zahŕňajú zavedenie rámcov na hodnotenie vplyvu algoritmov (ako je kanadský systém úrovní), implementáciu zásad ochrany súkromia už pri návrhu, vytváranie mechanizmov transparentnosti pre občanov na monitorovanie prístupu k dátam, zavedenie jasných rámcov správy a zachovanie ľudského dohľadu nad rozhodnutiami s dôsledkami. Nevyhnutné sú pravidelné audity a zapojenie zainteresovaných strán.

Cesta zahŕňa: (1) Strategickú identifikáciu príležitostí zameranú na verejnú hodnotu, (2) Komplexnú prípravu infraštruktúry a správy, (3) Strategický návrh pilotov s jasnými metrikami úspechu, (4) Riadenie organizačných zmien so zohľadnením obáv zamestnancov a (5) Meranie vplyvu s neustálym zlepšovaním. Tento prístup uprednostňuje plánovanie a pripravenosť organizácie pred technologickým nasadením.

Vlády by mali stanoviť KPI v súlade s cieľmi verejného sektora, vrátane časovej efektivity, nákladovej efektívnosti, inovačného potenciálu a merateľných výsledkov pre občanov. Estónsky rámec hodnotí AI systémy v týchto štyroch dimenziách. Neustále monitorovanie, spätná väzba zainteresovaných strán a transparentné reportovanie pomáhajú agentúram identifikovať, čo funguje, a podľa dôkazov upravovať implementácie.

Správa dát je základom úspešnej AI vo vláde. Zabezpečuje kvalitu dát, stanovuje jasné vlastníctvo a prístupové pravidlá, chráni súkromie občanov, udržiava súlad s reguláciami ako GDPR a umožňuje bezpečné zdieľanie medzi systémami. Bez robustnej správy dát hrozí riziko únikov, zaujatosti a strata verejnej dôvery.

AmICited sleduje, ako sú vládne dáta citované a referencované v hlavných AI systémoch vrátane ChatGPT, Perplexity a Google AI Overviews. Pomáha vládnym agentúram pochopiť ich viditeľnosť v AI ekosystéme, identifikovať medzery, kde by oficiálne informácie mali byť dostupnejšie, a zabezpečiť, že AI systémy správne pripisujú vládne dáta. Tento monitoring podporuje transparentnosť aj zodpovednosť.

Sledujte, ako sú vaše vládne dáta citované a referencované v AI systémoch. AmICited pomáha organizáciám vo verejnom sektore pochopiť ich viditeľnosť v AI ekosystéme a zabezpečiť presné zastúpenie oficiálnych informácií.

Zistite, ako mediálne spoločnosti dosahujú viditeľnosť v AI-generovaných odpovediach prostredníctvom optimalizácie obsahu, získaných médií, digitálneho PR a str...

Zistite, ako môžu startupy zlepšiť svoju viditeľnosť v AI-generovaných odpovediach naprieč ChatGPT, Perplexity, Gemini a ďalšími AI platformami pomocou štruktúr...

Zistite osvedčené stratégie, ako udržať a zlepšiť viditeľnosť vášho obsahu v AI-generovaných odpovediach v ChatGPT, Perplexity a Google AI Overviews. Objavte, a...

Súhlas s cookies

Používame cookies na vylepšenie vášho prehliadania a analýzu našej návštevnosti. See our privacy policy.