Dlhodobá vízia pre AI viditeľnosť: Kam smerujeme

Preskúmajte budúcnosť monitorovania viditeľnosti v AI – od štandardov transparentnosti až po regulačnú zhodu. Zistite, ako sa môžu značky pripraviť na informačn...

Naučte sa zásadné najlepšie postupy pre transparentnosť a zverejňovanie AI. Objavte správanie, verbálne a technické metódy zverejňovania na budovanie dôvery a zabezpečenie súladu s vyvíjajúcimi sa predpismi o AI.

Transparentnosť AI sa stala kľúčovým imperatívom v dobe, keď systémy umelej inteligencie ovplyvňujú všetko od tvorby obsahu až po rozhodovanie pri prijímaní do zamestnania či finančné odporúčania. Ako sa AI-generovaný obsah šíri naprieč digitálnymi platformami, organizácie čelia narastajúcemu tlaku zverejňovať, kedy a ako tieto technológie používajú – nielen ako zákonnú povinnosť, ale ako základný predpoklad udržiavania dôvery a dôveryhodnosti voči svojmu publiku. Riziká sú obzvlášť vysoké pre značky a tvorcov obsahu, pretože spotrebitelia čoraz viac požadujú vedieť, či informácie, ktoré konzumujú, pochádzajú z ľudských znalostí alebo sú výsledkom algoritmického generovania. Bez transparentných postupov zverejňovania riskujú organizácie eróziu dôvery, ktorú budovali roky, a môžu čeliť poškodeniu reputácie, regulačným sankciám a strate dôvery publika. Vzťah medzi transparentnosťou a dôveryhodnosťou je symbiotický – organizácie, ktoré proaktívne zverejňujú svoje využívanie AI, preukazujú integritu a úctu k svojim zainteresovaným stranám, čím sa prezentujú ako čestní hráči v čoraz viac AI-orientovanom svete.

Rozmach AI-generovaného obsahu vytvoril zásadný paradox dôvery: publikum má problém rozlíšiť autentickú, človekom vytvorenú prácu od sofistikovaných AI-generovaných alternatív, pričom transparentnosť ohľadom používania AI je naprieč odvetviami stále nekonzistentná. Táto nejasnosť narúša základnú zmluvu medzi tvorcami a spotrebiteľmi, kde publikum očakáva poznať skutočný pôvod obsahu, s ktorým prichádza do kontaktu. Ak je AI-generovaný obsah prezentovaný bez zverejnenia, porušuje toto implicitné dojednanie, čím vytvára dichotómiu „skutočné vs. falošné“, ktorá presahuje jednoduché otázky autenticity – dotýka sa otázok zavádzania, manipulácie a informovaného súhlasu. Paradox sa prehlbuje aj preto, že niektorý AI-generovaný obsah môže byť na nerozoznanie od ľudskej práce čo do kvality aj štýlu, takže vizuálne alebo štylistické náznaky sú nespoľahlivým ukazovateľom pôvodu. Transparentnosť je dôležitá práve preto, že tento paradox rieši – poskytuje publiku informácie potrebné na informované rozhodovanie o obsahu, ktorý konzumujú a ktorému dôverujú. Organizácie, ktoré prijímajú jasné postupy zverejňovania, premieňajú potenciálny skepticizmus na dôveru, čím dokazujú, že nemajú čo skrývať a na čestnej komunikácii len získajú.

Regulačné prostredie týkajúce sa zverejňovania AI sa rýchlo vyvíja a viaceré jurisdikcie zavádzajú alebo navrhujú požiadavky, ktorými sa organizácie musia starostlivo riadiť. Akt o umelej inteligencii EÚ (EU AI Act), jeden z najkomplexnejších rámcov, vyžaduje, aby AI-generovaný alebo výrazne AI-upravený obsah obsahoval viditeľné alebo na úrovni metadát vkladané zverejnenie, so špecifickými požiadavkami pre vysoko rizikové AI systémy a povinnosťou transparentnosti pre vývojárov. V Spojených štátoch vydala FTC varovania, že neaktualizovanie podmienok používania a zásad ochrany osobných údajov pre použitie AI môže predstavovať klamlivé praktiky, zatiaľ čo štátne regulácie – najmä nedávny kalifornský zákon o zverejňovaní AI Frontier Model – ukladajú zvýšené povinnosti transparentnosti a oznamovania vývojárom veľkých AI systémov. Autorské práva a duševné vlastníctvo predstavujú ďalšiu úroveň zložitosti, pretože organizácie musia zverejniť, či výcvikové dáta zahŕňali chránený obsah a ako boli AI systémy trénované. Okrem toho sa požiadavky GDPR a CCPA vzťahujú na AI systémy pracujúce s osobnými údajmi, pričom organizácie musia zverejniť automatizované rozhodovanie a poskytnúť jednotlivcom zmysluplné informácie o spracovaní AI. Nasledujúca tabuľka sumarizuje kľúčové regulačné požiadavky v hlavných jurisdikciách:

| Jurisdikcia | Regulácia | Kľúčové požiadavky | Účinnosť |

|---|---|---|---|

| Európska únia | EU AI Act | Zverejnenie pre vysoko rizikové AI; správy o transparentnosti; metadátové označenie AI-generovaného obsahu | Postupne (2024-2026) |

| Spojené štáty (federálne) | Smernice FTC | Aktualizácia zásad ochrany osobných údajov; zverejnenie AI použitia; vyhýbanie sa klamlivým praktikám | Priebežne |

| Kalifornia | AI Frontier Model Law | Štandardizované zverejňovanie; povinnosti oznamovania; bezpečnostné opatrenia | 2025 |

| Európska únia | GDPR | Zverejnenie automatizovaného rozhodovania; poskytnutie informácií o spracovaní AI | Priebežne |

| Spojené štáty (viac štátov) | CCPA a podobné | Zverejnenie použitia dát v AI systémoch; poskytnutie možnosti odhlásenia | Rôzne podľa štátu |

| Medzinárodné | Autorské práva | Zverejnenie zdrojov výcvikových dát; riešenie autorských práv v AI výstupoch | Vznikajúce |

Organizácie pôsobiace vo viacerých jurisdikciách by mali implementovať postupy zverejňovania, ktoré spĺňajú najprísnejšie požiadavky, keďže súlad s jedným štandardom často presahuje minimá iných.

Signály správania predstavujú najnenápadnejšiu, no silnú formu zverejňovania AI, pôsobiacu prostredníctvom prezentácie, štýlu, hlasu a kreatívnych rozhodnutí, ktoré publikum podvedome spracováva pri hodnotení autenticity obsahu. Tieto signály zahŕňajú rozpoznateľné vzorce v štýle písania, konzistenciu hlasu, voľbu vizuálnej kompozície, charakteristiky avatara alebo osoby a celkovú „vernosť“ prezentácie tvorcu – v podstate mieru, do akej obsah odráža skutočnú ľudskú osobnosť a rozhodovanie. Napríklad AI-generovaný text často vykazuje špecifické vzorce vo vetnej štruktúre, výbere slov a logickom toku, ktoré sa líšia od ľudského písania, zatiaľ čo AI-generované obrázky môžu mať jemné nezrovnalosti v osvetlení, anatómii či pozadí, ktoré vyškolený pozorovateľ rozpozná. Kľúčovým pojmom je tu vernosť tvorcu: publikum si vytvára očakávania, ako by mal konkrétny tvorca znieť, vyzerať či sa prezentovať, a odchýlky od tohto vzorca môžu signalizovať zapojenie AI. Spoliehať sa však len na signály správania je problematické, pretože AI systémy sa rýchlo zlepšujú v napodobňovaní ľudských charakteristík a nemožno očakávať, že publikum sa stane expertmi na AI forenziku. Preto by signály správania mali dopĺňať, nie nahrádzať explicitné metódy zverejnenia, a slúžiť ako sekundárna vrstva transparentnosti, ktorá posilňuje jasnú a priamu komunikáciu o použití AI.

Stratégie verbálneho zverejňovania poskytujú explicitnú, priamu komunikáciu o použití AI prostredníctvom jazykových signálov, ktoré nedávajú priestor na pochybnosti o pôvode obsahu a zapojení AI. Tieto metódy sú nevyhnutné, pretože vytvárajú jasný, zdokumentovaný záznam zverejnenia a zabezpečujú, že publikum dostane jednoznačné informácie o použití AI. Organizácie môžu implementovať verbálne zverejňovanie viacerými doplnkovými spôsobmi:

Vhodnosť každej metódy závisí od kontextu: označenia sa hodia pre sociálne siete a vizuálny obsah, vodoznaky pre video a audio, podpisy pre žurnalistické a kreatívne práce, polia zverejnenia pre dlhšie formy obsahu a poďakovania poskytujú širší kontext pri zložitejších projektoch. Organizácie by mali voliť metódy zverejnenia podľa formátu obsahu a očakávaní svojho publika tak, aby bolo zverejnenie neprehliadnuteľné, no nezasahovalo do používateľského zážitku.

Technické signály a metadáta poskytujú strojovo čitateľné, štandardizované informácie o zapojení AI, ktoré umožňujú automatizovanú detekciu, overovanie a sledovanie AI-generovaného obsahu naprieč digitálnymi ekosystémami. Tieto prístupy využívajú vložené dáta a kryptografické techniky na vytvorenie trvalých, odolných záznamov o pôvode obsahu a jeho histórii spracovania. Štandardy IPTC, nedávno aktualizované o AI-špecifické metadátové vlastnosti, umožňujú tvorcom vkladať štruktúrované informácie o použití AI priamo do obrazových súborov vrátane detailov o použitých AI systémoch, aplikovanom spracovaní a ľudských úpravách. C2PA (Coalition for Content Provenance and Authenticity) predstavuje vznikajúci priemyselný štandard, ktorý využíva kryptografické podpisy a poverenia k vytvoreniu overiteľného reťazca pôvodu digitálneho obsahu, čím umožňuje publiku vystopovať obsah k pôvodnému zdroju a pochopiť všetky aplikované úpravy. Tieto technické prístupy riešia zásadné obmedzenie ľudsky čitateľného zverejnenia: vytvárajú trvalé, overiteľné záznamy, ktoré nemožno ľahko odstrániť či pozmeniť, a umožňujú automatizovaným systémom identifikovať a označovať AI-generovaný obsah vo veľkom rozsahu. Organizácie, ktoré implementujú technické zverejňovanie, by mali zvážiť prijatie C2PA poverení pre hodnotný obsah, vkladanie metadát IPTC do obrázkov a mediálnych súborov a viesť podrobnú dokumentáciu digitálneho zdroja, ktorá sleduje zapojenie AI počas životného cyklu obsahu. Výhodou technických signálov je ich trvácnosť a overiteľnosť; výzvou však zostáva zabezpečiť, aby publikum a platformy týmto signálom rozumeli a rešpektovali ich.

Úspešné zverejňovanie AI si vyžaduje začlenenie transparentnosti do celého procesu tvorby obsahu, čím sa zverejňovanie stáva základnou súčasťou správy obsahu a nie len dodatočným krokom. Organizácie by mali zaviesť štruktúrované rámce obsahu, ktoré evidujú zapojenie AI v každej fáze tvorby – od výskumu a návrhu cez úpravy až po publikovanie – aby informácie o zverejnení prirodzene prechádzali existujúcimi systémami správy obsahu. Automatizácia a integrácia do pracovných postupov sú kľúčové: systémy na správu obsahu by mali obsahovať povinné polia na zverejnenie AI, automatické výzvy požadujúce od tvorcov uvedenie použitia AI pred publikovaním a schvaľovacie procesy overujúce kompletnosť zverejnenia pred zverejnením obsahu. Tento prístup vníma zverejňovanie ako požiadavku na zabezpečenie kvality, podobne ako kontrolu faktov, právnu revíziu alebo súlad so značkou. Organizácie by mali tiež stanoviť jasné pravidlá, čo predstavuje použitie AI vyžadujúce zverejnenie (napr. vyžaduje zverejnenie použitie AI na výskum? A čo AI-asistovaná editácia?), čím zabezpečia konzistentnosť naprieč tímami a zabránia medzerám v zverejňovaní. Rovnako dôležité sú školenia a dokumentácia: tvorcovia obsahu potrebujú jasné pokyny, ako vhodne zverejňovať použitie AI pre rôzne typy obsahu a platformy. Začlenením zverejňovania do modelov a procesov tvorby obsahu sa transparentnosť mení z bremena súladu na štandardný pracovný postup, ktorý chráni organizáciu aj jej publikum.

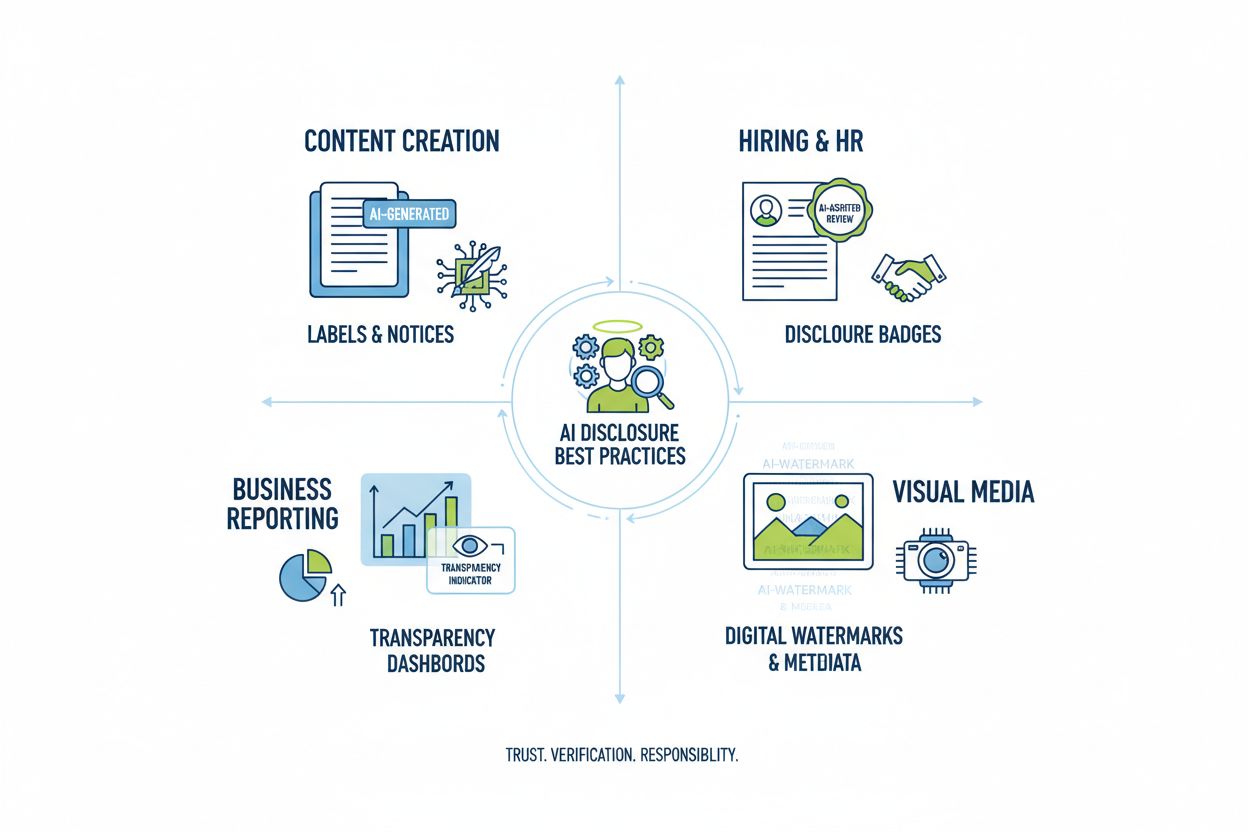

Rôzne aplikácie AI vyžadujú prispôsobené prístupy k zverejňovaniu, ktoré zohľadňujú kontext, očakávania publika a regulačné požiadavky. Tvorba obsahu (články, sociálne siete, marketingové texty) by mala obsahovať jasné označenia alebo úpravy podpisov signalizujúce zapojenie AI, s doplnkovými poľami vysvetľujúcimi použité AI nástroje a úroveň ľudského dohľadu; to je mimoriadne dôležité pri spravodajskom a redakčnom obsahu, kde dôvera publika závisí od pochopenia pôvodu obsahu. Nábor a prijímanie si vyžaduje najprísnejšie zverejňovanie – kandidáti majú právo vedieť, kedy ich posudzuje AI systém alebo kedy prebieha predbežný výber prostredníctvom AI, s detailným vysvetlením princípov rozhodovania AI a následných ľudských kontrol. Správy a analýzy (finančné prehľady, prieskum trhu, analýza dát) by mali obsahovať technické zverejnenie a metadáta signalizujúce, ktoré analýzy boli AI-asistované, najmä ak AI identifikovala vzory alebo generovala poznatky ovplyvňujúce závery. Vizuálny obsah (obrázky, videá, grafika) vyžaduje vizuálne vodoznaky aj metadátové zverejnenie, keďže publikum často nevie spoľahlivo rozlíšiť AI-generované vizuály od autentických – to je zásadné najmä pri spravodajských fotografiách, produktových obrázkoch či obsahu, kde autenticita ovplyvňuje nákupné alebo dôverové rozhodnutia. Komunikácia so zákazníkmi (chatboty, automatizované odpovede, zákaznícky servis) by mala jasne identifikovať zapojenie AI na začiatku interakcie, aby zákazník mohol požiadať o komunikáciu s človekom, ak si želá. Organizácie by mali zmapovať svoje využitie AI naprieč týmito kontextmi a implementovať zverejňovanie úmerné citlivosti a dopadu každého prípadu, pričom by mali uznať, že požiadavky na transparentnosť sa líšia v závislosti od toho, ako AI rozhodnutia ovplyvňujú publikum.

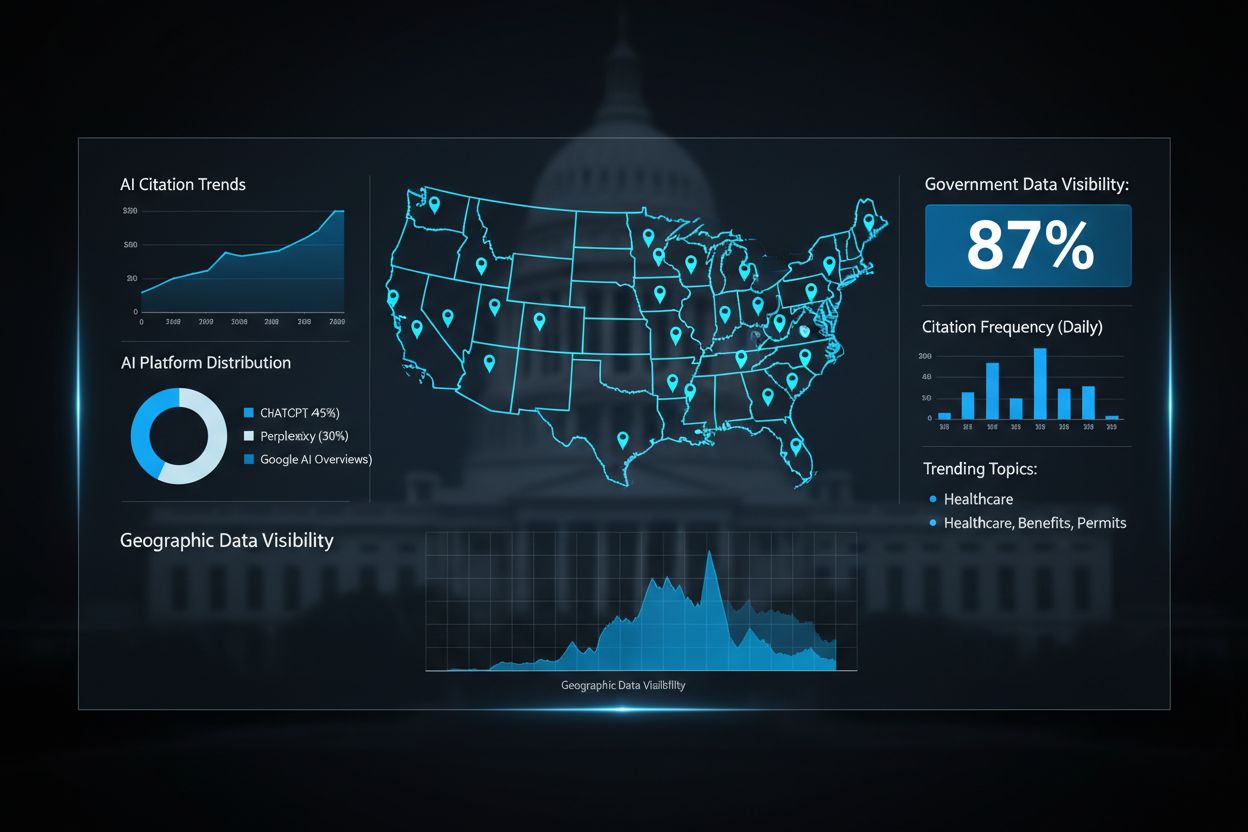

Budúcnosť zverejňovania AI závisí od celoodvetvovej štandardizácie a vývoja interoperabilných rámcov, ktoré umožnia konzistentnú a porovnateľnú transparentnosť naprieč organizáciami a platformami. Vynárajúce sa štandardy ako C2PA, špecifikácie metadát IPTC a rámec riadenia rizík AI od NIST poskytujú základné štruktúry, no široké prijatie vyžaduje koordinované úsilie technologických platforiem, tvorcov obsahu, regulátorov a profesijných združení. Akt o umelej inteligencii EÚ a podobné regulačné rámce podporujú štandardizáciu tým, že vyžadujú konkrétne formáty zverejňovania a kategórie informácií, čím vytvárajú tlak na celoodvetvové prijatie spoločných štandardov namiesto individuálnych riešení. Iniciatívy odvetvia ako etické usmernenia PRSA pre AI a rôzne rámce pre transparentné reportovanie ukazujú rastúci konsenzus okolo najlepších postupov zverejňovania, hoci dobrovoľné prijatie je stále nejednotné. Kľúčovým ďalším krokom je prechod od dobrovoľných noriem k povinným reguláciám, ktoré vyžadujú štandardizované zverejňovanie, podobne ako nutričné štítky FDA štandardizovali transparentnosť potravín. Monitorovacie a visibility platformy – ako AmICited.com – zohrávajú čoraz dôležitejšiu úlohu v tomto ekosystéme tým, že sledujú, ako AI odkazuje na značky a obsah v AI-generovaných odpovediach, dávajú organizáciám prehľad o tom, ako sa ich práca zobrazuje vo výstupoch AI a či dochádza k správnemu pripísaniu a zverejňovaniu. Ako sa AI systémy stávajú sofistikovanejšími a všadeprítomnými, schopnosť monitorovať, overovať a auditovať postupy zverejňovania AI sa stáva nevyhnutnou pre udržanie dôvery v digitálnych informačných ekosystémoch. Organizácie, ktoré dnes investujú do robustných postupov zverejňovania a monitorovacích schopností, budú najlepšie pripravené zvládnuť vyvíjajúce sa regulačné prostredie a udržať si dôveru publika v AI-budúcnosti.

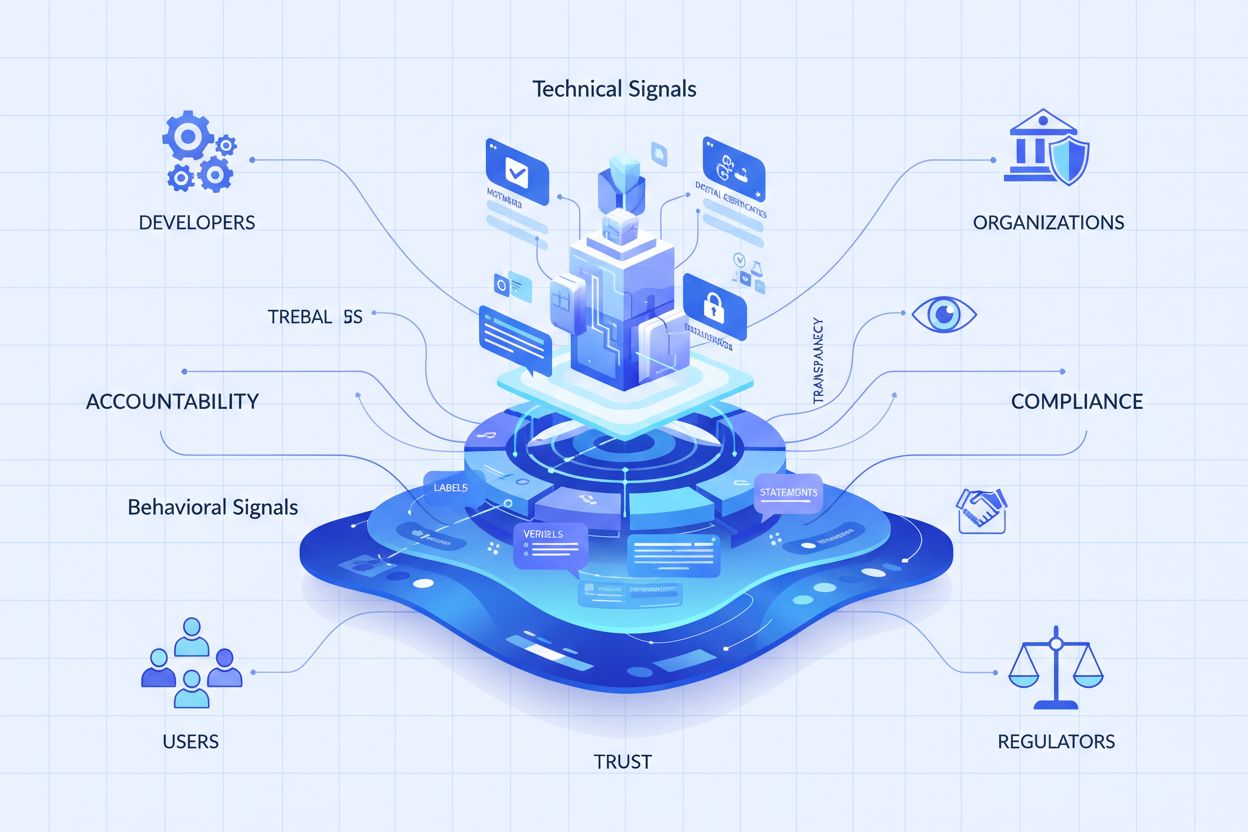

Správanie využíva možnosti prezentácie (štýl, hlas, avatar) na signalizáciu zapojenia AI. Verbálne zverejňovanie používa explicitné vyhlásenia, označenia a vodoznaky. Technické zverejňovanie vkladá strojovo čitateľné metadáta a kryptografické podpisy. Každá metóda slúži inému publiku a kontextu a organizácie by mali kombinovať viacero metód pre komplexnú transparentnosť.

Právne požiadavky sa líšia podľa jurisdikcie. Akt o umelej inteligencii EÚ vyžaduje zverejnenie pre vysoko rizikové AI systémy. FTC vyžaduje zverejnenie, ak používanie AI môže ovplyvniť rozhodnutia spotrebiteľov. Štátne zákony, ako napríklad Kalifornský zákon o AI Frontier Model, ukladajú povinnosti oznamovania. Autorské práva vyžadujú zverejňovanie AI-generovaného obsahu. Organizácie by sa mali poradiť s právnikom pre požiadavky špecifické pre ich jurisdikciu.

AI-generované obrázky by mali obsahovať viditeľné vodoznaky aj metadátové zverejnenie. Viditeľné vodoznaky by mali byť zreteľné, ale nenápadné a jasne uvádzať, že ide o AI-generovaný obsah. Metadáta by mali obsahovať informácie o digitálnom zdroji IPTC a ak sú dostupné, aj C2PA poverenia. Titulky a polia zverejnenia by mali jasne uvádzať, že obrázky sú vytvorené AI, najmä pri správach, produktoch alebo propagačnom obsahu.

Štandardy IPTC poskytujú štruktúrované metadátové polia na dokumentovanie použitia AI v obrázkoch a mediálnych súboroch. Umožňujú automatizovanú detekciu a sledovanie AI-generovaného obsahu naprieč platformami. Digitálne kategórie zdrojov IPTC zahŕňajú 'Trained Algorithmic Media', 'Composite Synthetic' a 'Algorithmic Media'. Tieto štandardy sú dôležité, pretože vytvárajú trvalé, overiteľné záznamy o zapojení AI, ktoré nemožno ľahko odstrániť alebo pozmeniť.

Firmy by mali vykonať audit AI na identifikáciu všetkých prípadov použitia AI, zaviesť politiky zverejňovania v súlade s platnými predpismi, integrovať zverejňovanie do riadenia obsahu, školiť tímy o požiadavkách zverejňovania a pravidelne monitorovať súlad. Konzultácia s právnymi odborníkmi so znalosťou AI predpisov vo vašej jurisdikcii je nevyhnutná, keďže požiadavky sa výrazne líšia podľa regiónu.

Dôsledkami sú regulačné sankcie (pokuty FTC, porušenia štátnych zákonov), poškodenie reputácie a strata dôvery publika, právna zodpovednosť za porušenie autorských práv alebo klamlivé praktiky a potenciálne žaloby od dotknutých strán. Organizácie, ktoré nezverejnia použitie AI, riskujú stratu dôvery, ktorú budovali roky, takže proaktívne zverejňovanie je strategickou investíciou do dlhodobej dôvery.

Rôzne zainteresované strany potrebujú rôzne úrovne informácií. Široká verejnosť potrebuje jednoduché, jasné vyhlásenia o zapojení AI. Regulátori vyžadujú podrobnú technickú dokumentáciu a dôkazy o súlade. Novinári a tvorcovia obsahu potrebujú presné informácie o AI nástrojoch a ľudskom dohľade. Zákazníci musia pochopiť, ako AI ovplyvňuje ich skúsenosť. Prispôsobte formát a úroveň detailu zverejnenia potrebám a očakávaniam jednotlivých skupín.

C2PA (Coalition for Content Provenance and Authenticity) poskytuje kryptografické poverenia na overenie obsahu. Štandardy IPTC umožňujú vkladanie metadát do obrázkov. Systémy na správu obsahu čoraz častejšie obsahujú polia na zverejňovanie AI. Monitorovacie platformy ako AmICited.com sledujú AI odkazy a viditeľnosť. Odvetvové rámce od PRSA, NIST a ďalších poskytujú usmernenia. Prijímanie týchto nástrojov a štandardov sa zrýchľuje s prísnejšími predpismi.

Sledujte, ako AI systémy odkazujú na vašu značku v GPTs, Perplexity a Google AI Overviews. Uistite sa, že váš obsah dostáva správne pripísanie a viditeľnosť v AI-generovaných odpovediach.

Preskúmajte budúcnosť monitorovania viditeľnosti v AI – od štandardov transparentnosti až po regulačnú zhodu. Zistite, ako sa môžu značky pripraviť na informačn...

Zistite, čo znamená transparentnosť AI rebríčkovania, prečo je dôležitá pre tvorcov obsahu a používateľov a ako rôzne AI platformy ako Perplexity, Google a Chat...

Zistite, ako môžu vládne agentúry optimalizovať svoju digitálnu prítomnosť pre AI systémy ako ChatGPT a Perplexity. Objavte stratégie na zlepšenie AI viditeľnos...

Súhlas s cookies

Používame cookies na vylepšenie vášho prehliadania a analýzu našej návštevnosti. See our privacy policy.