Získavanie citácií vo Wikipédii: Ne-manipulatívny prístup

Naučte sa etické stratégie, ako získať citácie vašej značky na Wikipédii. Pochopte obsahové pravidlá Wikipédie, dôveryhodné zdroje a ako využiť citácie na zvýše...

Zistite, ako citácie z Wikipédie ovplyvňujú tréningové dáta AI a vytvárajú efekt vlny naprieč LLM. Zistite, prečo záleží na vašej prítomnosti na Wikipédii pre zmienky v AI a vnímanie značky.

Wikipedia sa stala základným tréningovým datasetom pre prakticky každý významný veľký jazykový model dneška – od ChatGPT od OpenAI a Gemini od Google až po Claude od Anthropic a vyhľadávač Perplexity. V mnohých prípadoch predstavuje Wikipedia najväčší zdroj štruktúrovaného, kvalitného textu v tréningových dátach týchto AI systémov, často tvorí 5-15% celkového tréningového korpusu v závislosti od modelu. Táto dominancia vychádza z unikátnych vlastností Wikipédie: jej zásada neutrálneho pohľadu, prísne komunitné overovanie faktov, štruktúrovaný formát a slobodná licencia ju robia neprekonateľným zdrojom pre učenie AI systémov, ako uvažovať, citovať zdroje a komunikovať presne. Tento vzťah však zásadne zmenil úlohu Wikipédie v digitálnom ekosystéme – už nie je len cieľom pre ľudských čitateľov hľadajúcich informácie, ale aj neviditeľnou chrbticou poháňajúcou konverzačné AI, s ktorými denne interagujú milióny ľudí. Pochopenie tohto prepojenia odhaľuje zásadný efekt vlny: kvalita, zaujatosti a medzery na Wikipédii priamo formujú schopnosti a limity AI systémov, ktoré dnes sprostredkúvajú, ako miliardy ľudí pristupujú k informáciám a rozumejú im.

Keď veľké jazykové modely spracúvajú informácie počas tréningu, nepristupujú ku všetkým zdrojom rovnako – Wikipedia má v ich rozhodovacej hierarchii jedinečne privilegované postavenie. Počas procesu rozpoznávania entít LLM identifikujú kľúčové fakty a pojmy, ktoré následne krížovo overujú v rôznych zdrojoch na základe skóre dôveryhodnosti. Wikipedia v tomto procese funguje ako „primárny kontrolný orgán“, pretože má transparentnú históriu úprav, komunitné overovacie mechanizmy a zásadu neutrálneho pohľadu, ktoré spolu signalizujú AI systémom vysokú spoľahlivosť. Efekt násobiča dôveryhodnosti tento náskok ešte posilňuje: keď sa informácia objavuje konzistentne na Wikipédii, v štruktúrovaných znalostných grafoch ako Google Knowledge Graph a Wikidata, či v akademických zdrojoch, LLM jej priraďujú exponenciálne vyššiu dôveru. Tento systém váženia vysvetľuje, prečo Wikipedia dostáva v tréningu špeciálne zaobchádzanie – slúži ako priamy zdroj poznatkov aj validačná vrstva pre fakty získané z iných zdrojov. Výsledkom je, že LLM sa naučili vnímať Wikipédiu nie len ako jeden z mnohých zdrojov, ale ako základnú referenciu, ktorá potvrdzuje alebo spochybňuje informácie z menej overených miest.

| Typ zdroja | Váha dôveryhodnosti | Dôvod | Spracovanie v AI |

|---|---|---|---|

| Wikipedia | Veľmi vysoká | Neutrálna, komunitne editovaná, overená | Primárna referencia |

| Firemný web | Stredná | Sebapropagačný | Sekundárny zdroj |

| Spravodajské články | Vysoká | Nezávislý, ale potenciálne zaujatý | Potvrdzujúci zdroj |

| Znalostné grafy | Veľmi vysoká | Štruktúrované, agregované | Násobič autority |

| Sociálne médiá | Nízka | Neoverené, propagačné | Minimálna váha |

| Akademické zdroje | Veľmi vysoká | Recenzované, autoritatívne | Vysoká dôvera |

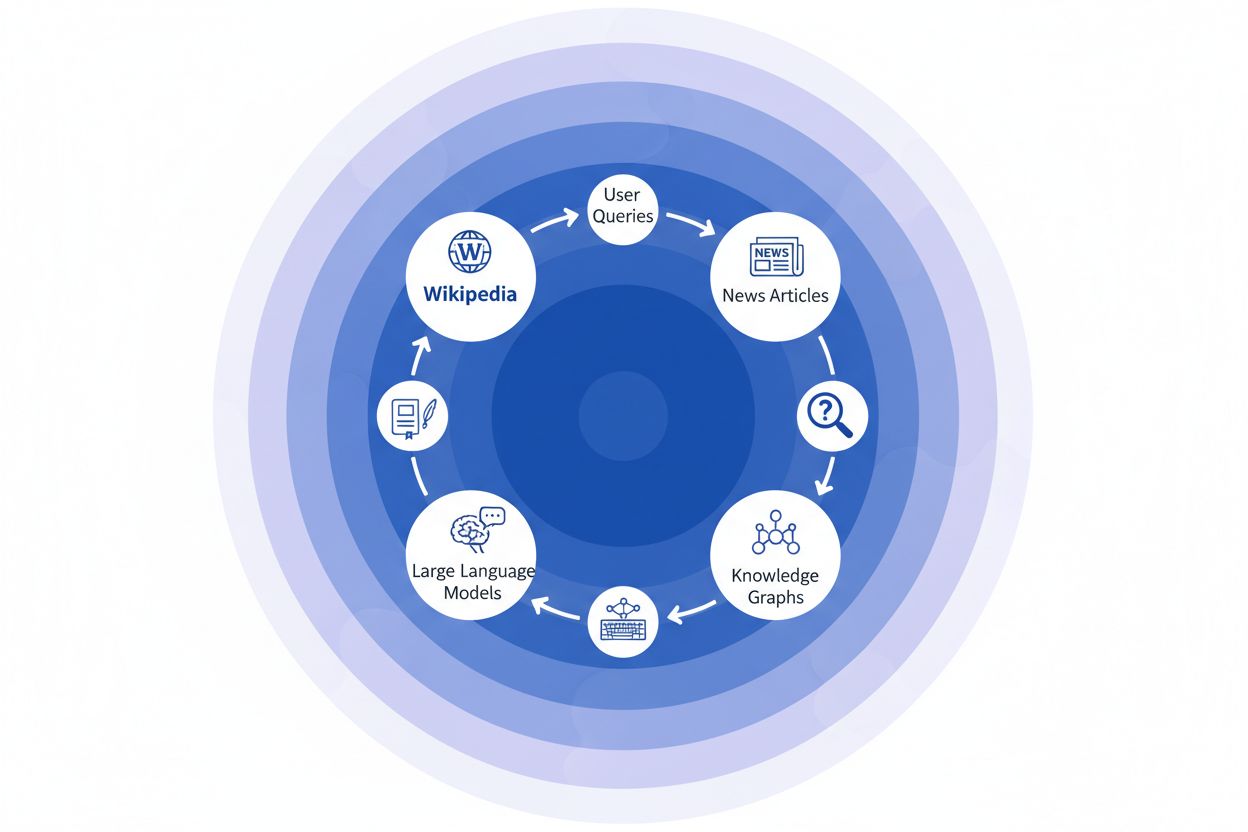

Keď spravodajská organizácia cituje Wikipédiu ako zdroj, vzniká tzv. „reťazec citácií“ – kaskádový mechanizmus, kde sa dôveryhodnosť znásobuje cez viaceré vrstvy informačnej infraštruktúry. Novinár píšuci o klimatickej vede môže odkazovať na článok Wikipédie o globálnom otepľovaní, ktorý sám cituje recenzované štúdie; tento článok je následne indexovaný vyhľadávačmi a zahrnutý do znalostných grafov, ktoré následne trénujú veľké jazykové modely, ktoré denne využívajú milióny ľudí. Takto vzniká silná spätná väzba: Wikipedia → Knowledge Graph → LLM → Používateľ, kde pôvodné rámcovanie a dôrazy Wikipédie môžu nenápadne ovplyvniť, ako AI prezentuje informácie koncovým používateľom – často bez ich vedomia, že informácia pochádza zo spoluprácnej encyklopédie. Konkrétny príklad: ak článok na Wikipédii o farmaceutickej liečbe zdôrazňuje určité klinické štúdie a iné potláča, toto redakčné rozhodnutie sa prenesie do spravodajstva, zakorení v znalostných grafoch a napokon ovplyvní, ako ChatGPT či iné modely odpovedajú pacientom na otázky o možnostiach liečby. Tento „efekt vlny“ znamená, že redakčné rozhodnutia Wikipédie neovplyvňujú len priamo jej čitateľov – zásadne formujú celý informačný priestor, z ktorého sa AI učí a ktorý následne sprostredkúva miliardám ľudí. Reťazec citácií v podstate premieňa Wikipédiu z referenčného cieľa na neviditeľnú, ale vplyvnú vrstvu AI tréningového procesu, kde presnosť a zaujatosti pri zdroji môžu byť znásobené v celom ekosystéme.

Efekt vlny v ekosystéme Wikipedia-AI je pravdepodobne najzásadnejšia dynamika, ktorú by mali značky a organizácie poznať. Jediná úprava na Wikipédii nezmení len jeden zdroj – prechádza cez prepojenú sieť AI systémov, z ktorých každý čerpá a zosilňuje informácie spôsobom, ktorý znásobuje ich dopad exponenciálne. Keď sa na stránke Wikipédie objaví nepresnosť, nezostane izolovaná; šíri sa celým AI prostredím a ovplyvňuje, ako je vaša značka denne popisovaná, chápaná a prezentovaná miliónom používateľov. Tento násobič znamená, že investícia do presnosti Wikipédie nie je len o jednej platforme – je to o kontrole vášho naratívu v celom generatívnom AI ekosystéme. Pre digitálnych PR a brand manažérov táto realita zásadne mení výpočet, kde sústrediť zdroje a pozornosť.

Kľúčové efekty vlny, ktoré treba sledovať:

Nedávny výskum IUP štúdie od Vetter a kol. poukázal na zásadnú zraniteľnosť našej AI infraštruktúry: udržateľnosť Wikipédie ako tréningového zdroja je čoraz viac ohrozená samotnou technológiou, ktorú pomáha poháňať. Ako sa veľké jazykové modely rozmáhajú a trénujú na narastajúcich datasetoch obsahu generovaného LLM, dochádza k zhoršujúcemu sa problému „kolapsu modelov“, keď umelé výstupy začínajú kontaminovať tréningový bazén a znižujú kvalitu modelov v nasledujúcich generáciách. Tento jav je obzvlášť akútny vzhľadom na to, že Wikipedia – encyklopédia vytvorená ľuďmi a dobrovoľníkmi – sa stala základným pilierom pre tréning pokročilých AI systémov, často bez priameho uvedenia alebo kompenzácie jej prispievateľov. Etické dôsledky sú zásadné: zatiaľ čo AI spoločnosti čerpajú hodnotu z voľne prispievaných poznatkov Wikipédie a súčasne zaplavujú informačný ekosystém syntetickým obsahom, motivačné štruktúry, ktoré udržiavali komunitu dobrovoľníkov Wikipédie viac než dve desaťročia, čelia bezprecedentnému tlaku. Bez úmyselného zásahu na ochranu ľudského obsahu ako oddeleného a chráneného zdroja riskujeme vytvorenie spätnoväzbovej slučky, v ktorej AI texty postupne nahradia autentické ľudské poznatky, čo napokon podkope samotný základ, na ktorom dnešné jazykové modely stoja. Udržateľnosť Wikipédie teda nie je len problémom samotnej encyklopédie, ale kritickou otázkou pre celý informačný ekosystém a budúcu životaschopnosť AI systémov závislých od skutočných ľudských poznatkov.

Ako umelá inteligencia čoraz viac spolieha na Wikipédiu ako základný zdroj poznatkov, monitorovanie toho, ako sa vaša značka objavuje v AI-generovaných odpovediach, je pre moderné organizácie nevyhnutné. AmICited.com sa špecializuje na sledovanie citácií Wikipédie, ako sa šíria cez AI systémy, a poskytuje značkám prehľad o tom, ako ich prítomnosť na Wikipédii preniká do AI zmienok a odporúčaní. Zatiaľ čo alternatívne nástroje ako FlowHunt.io ponúkajú všeobecné monitorovanie webu, AmICited sa jedinečne zameriava na reťazec citácií Wikipedia-AI a zachytáva konkrétny moment, keď AI systémy odkazujú na vašu Wikipédiu a ako to ovplyvňuje ich odpovede. Pochopenie tohto prepojenia je kľúčové, pretože citácie z Wikipédie majú veľkú váhu v tréningových dátach a generovaní AI odpovedí – dobre udržiavaná prítomnosť na Wikipédii neinformuje len ľudských čitateľov, ale formuje, ako AI systémy vnímajú a prezentujú vašu značku miliónom používateľov. Monitorovaním svojich zmienok na Wikipédii cez AmICited získate akčné poznatky o vašej AI stope a môžete optimalizovať svoju prítomnosť na Wikipédii s plným vedomím jej vplyvu na objavenie vašej značky a jej vnímanie prostredníctvom AI.

Áno, každý hlavný LLM vrátane ChatGPT, Gemini, Claude a Perplexity zahŕňa Wikipédiu vo svojich tréningových dátach. Wikipedia je často najväčším zdrojom štruktúrovaných, overených informácií v tréningových datasetoch LLM, zvyčajne tvorí 5-15% celkového tréningového korpusu.

Wikipedia slúži ako kontrolný bod dôveryhodnosti pre AI systémy. Keď LLM generuje informácie o vašej značke, viac zohľadňuje popis z Wikipédie než z iných zdrojov, vďaka čomu je vaša stránka na Wikipédii kľúčovým vplyvom na to, ako AI systémy prezentujú vašu značku naprieč ChatGPT, Gemini, Claude a ďalšími platformami.

Efekt vlny označuje, ako jediná citácia alebo úprava na Wikipédii vytvára následné dôsledky v celom AI ekosystéme. Jedna zmena na Wikipédii môže ovplyvniť znalostné grafy, ktoré ovplyvňujú AI prehľady, ktoré následne ovplyvňujú, ako viacero AI systémov opisuje vašu značku miliónom používateľov.

Áno. Keďže LLM považujú Wikipédiu za veľmi dôveryhodnú, nepresné informácie na vašej stránke sa šíria cez AI systémy. To môže ovplyvniť, ako ChatGPT, Gemini a iné AI platformy opisujú vašu organizáciu, čo môže poškodiť vnímanie vašej značky.

Nástroje ako AmICited.com sledujú, ako je vaša značka citovaná a spomínaná v AI systémoch vrátane ChatGPT, Perplexity a Google AI Overviews. Pomáha vám to pochopiť efekt vlny vašej prítomnosti na Wikipédii a optimalizovať ju podľa potreby.

Wikipedia má prísne pravidlá proti sebapropagácii. Každé úpravy by mali nasledovať smernice Wikipédie a vychádzať z dôveryhodných, nezávislých zdrojov. Mnohé organizácie spolupracujú so špecialistami na Wikipédiu, aby zabezpečili dodržiavanie pravidiel a zároveň udržiavali presnú prezentáciu.

LLM sú trénované na dátových snímkach, takže zmeny sa šíria postupne. Znalostné grafy sa však aktualizujú častejšie, takže efekt vlny môže začať v priebehu týždňov až mesiacov v závislosti od AI systému a termínu jeho opätovného tréningu.

Wikipedia je primárny zdroj, ktorý sa používa priamo pri tréningu LLM. Znalostné grafy ako Google Knowledge Graph agregujú informácie z viacerých zdrojov vrátane Wikipédie a následne ich poskytujú AI systémom, čím vytvárajú ďalšiu vrstvu vplyvu na to, ako AI systémy chápu a prezentujú informácie.

Sledujte, ako sa citácie z Wikipédie šíria cez ChatGPT, Gemini, Claude a ďalšie AI systémy. Pochopte svoju AI stopu a optimalizujte svoju prítomnosť na Wikipédii s AmICited.

Naučte sa etické stratégie, ako získať citácie vašej značky na Wikipédii. Pochopte obsahové pravidlá Wikipédie, dôveryhodné zdroje a ako využiť citácie na zvýše...

Zistite, ako Wikipédia slúži ako kľúčový dataset pre tréning AI, jej vplyv na presnosť modelov, licenčné dohody a prečo sa na ňu AI spoločnosti spoliehajú pri t...

Naučte sa, ako eticky získať citácie vašej značky na Wikipédii pre maximálnu AI viditeľnosť. Strategický sprievodca pokrývajúci pravidlá, dôveryhodné zdroje a s...

Súhlas s cookies

Používame cookies na vylepšenie vášho prehliadania a analýzu našej návštevnosti. See our privacy policy.