Ochrana značky

Zistite, čo znamená ochrana značky, prečo je kľúčová pre viditeľnosť vo vyhľadávaní a monitorovanie AI, a ako ochrániť svoju značku naprieč Google, ChatGPT, Per...

Bezpečnosť značky v AI je prax chrániť reputáciu a integritu značky spoločnosti pred negatívnym, nepresným alebo nevhodným obsahom generovaným systémami umelej inteligencie. Zahŕňa monitorovanie, detekciu a zmierňovanie rizík spojených s AI-generovaným obsahom, ktorý by mohol poškodiť reputáciu značky, narušiť dôveru spotrebiteľov alebo vytvoriť právnu zodpovednosť. Organizácie zavádzajú komplexné stratégie vrátane procesov na kontrolu obsahu, monitorovacích nástrojov a rámcov správy, aby chránili svoje značky v prostredí ovplyvnenom AI.

Bezpečnosť značky v AI je prax chrániť reputáciu a integritu značky spoločnosti pred negatívnym, nepresným alebo nevhodným obsahom generovaným systémami umelej inteligencie. Zahŕňa monitorovanie, detekciu a zmierňovanie rizík spojených s AI-generovaným obsahom, ktorý by mohol poškodiť reputáciu značky, narušiť dôveru spotrebiteľov alebo vytvoriť právnu zodpovednosť. Organizácie zavádzajú komplexné stratégie vrátane procesov na kontrolu obsahu, monitorovacích nástrojov a rámcov správy, aby chránili svoje značky v prostredí ovplyvnenom AI.

Bezpečnosť značky v AI označuje prax chrániť reputáciu a integritu značky spoločnosti pred negatívnym, nepresným alebo nevhodným obsahom generovaným systémami umelej inteligencie. S rastúcim využívaním AI nástrojov pri tvorbe obsahu, marketingu a zákazníckych službách sa potreba ochrany reputácie značky stáva dôležitejšou než kedykoľvek predtým. Celosvetový trh umelej inteligencie má vzrásť z 305,90 miliardy dolárov v roku 2024 na 738,80 miliardy dolárov do roku 2030, čo odráža rýchlu expanziu AI naprieč odvetviami. S týmto prudkým rastom prichádzajú aj zvýšené riziká pre bezpečnosť značky, keďže viac AI-generovaného obsahu vstupuje do digitálneho ekosystému. 95 % lídrov firiem uznáva, že AI je kľúčová pre úspech organizácie, no mnohí zápasia so zavádzaním dostatočných ochranných opatrení. Bezpečnosť značky v ére AI zahŕňa monitorovanie, detekciu a zmierňovanie rizík spojených s AI-generovaným obsahom, ktorý by mohol poškodiť reputáciu značky, narušiť dôveru spotrebiteľov alebo vytvoriť právnu zodpovednosť. Pochopenie a zavedenie robustných opatrení na ochranu značky v AI už nie je voliteľné—je nevyhnutné pre udržanie konkurenčnej výhody a dôvery spotrebiteľov.

Systémy umelej inteligencie, hoci sú výkonné a efektívne, prinášajú niekoľko významných rizík pre reputáciu značky, ktoré musia organizácie starostlivo riadiť. AI môže generovať dezinformácie a nepravdivé tvrdenia o produktoch alebo službách, čím môže zavádzať spotrebiteľov a poškodiť dôveryhodnosť značky. Deepfaky a syntetické médiá vytvorené pomocou AI môžu imitovať vedenie spoločnosti alebo vytvárať falošné odporúčania, čo vedie k vážnemu poškodeniu reputácie. Neautorizované použitie aktív značky, loga a duševného vlastníctva zlomyseľnými aktérmi využívajúcimi AI nástroje prináša právne a reputačné výzvy, ktoré je ťažké kontrolovať. Zraniteľnosti v súkromí a bezpečnosti dát v AI systémoch môžu odhaliť citlivé firemné informácie, údaje zákazníkov alebo vlastnícky obsah, čo má za následok porušenie predpisov a stratu dôvery zákazníkov. AI-generovaný obsah môže navyše neúmyselne plagiátovať existujúce materiály alebo porušiť autorské práva, čím vystavuje značky právnym krokom a finančným sankciám.

| Typ rizika | Popis | Potenciálny dopad |

|---|---|---|

| Dezinformácie & Nepravdivé tvrdenia | AI generuje nepresné informácie o produktoch alebo zavádzajúce marketingové tvrdenia | Strata dôvery spotrebiteľov, regulačné pokuty, právna zodpovednosť |

| Deepfaky & Syntetické médiá | AI vytvára falošné videá či obrázky vedenia alebo zástupcov značky | Ťažké poškodenie reputácie, vplyv na cenu akcií, náklady na krízové riadenie |

| Neautorizované použitie značky | Zlomyseľní aktéri používajú AI na kopírovanie aktív značky, loga či kampaní | Rozriedenie značky, zmätok zákazníkov, právne spory |

| Porušenie autorských práv & duševného vlastníctva | AI-generovaný obsah plagiátoruje alebo porušuje existujúce duševné vlastníctvo | Právne kroky, finančné sankcie, spájanie značky s krádežou |

| Úniky dát & porušenie súkromia | AI systémy odhaľujú citlivé firemné alebo zákaznícke údaje | Regulačné pokuty, strata dôvery spotrebiteľov, porušenie predpisov |

| Zaujatosť & Diskriminačný obsah | AI generuje zaujaté alebo diskriminačné správy | Poškodenie reputácie, spoločenský odpor, právne následky |

Incident s chatbotom Air Canada slúži ako varovanie o dôležitosti bezpečnosti značky v AI. Vo februári 2024 poskytol AI chatbot spoločnosti Air Canada nesprávne informácie cestujúcemu Jakeovi Moffattovi ohľadom zľav na letenky v prípade úmrtia, čo viedlo k zakúpeniu leteniek na základe falošných informácií. Keď sa Moffatt pokúsil získať refundáciu podľa pokynov chatbota, Air Canada jeho žiadosť spočiatku zamietla s tým, že informácie chatbota nie sú záväzné. Tribunál napokon rozhodol v prospech Moffatta, pričom Air Canada zodpovedala za nesprávne informácie a musela vyplatiť odškodné. Tento prípad ukazuje, že spoločnosti nesú právnu zodpovednosť za obsah a dezinformácie generované AI, bez ohľadu na to, či ich vytvoril človek alebo AI systém. Incident zdôraznil kľúčovú potrebu ľudskej kontroly, overovania faktov a verifikácie všetkého AI-generovaného obsahu komunikovaného zákazníkom. Organizácie musia zaviesť prísne kontrolné procesy, aby sa zabezpečilo, že výstupy AI sú presné, v súlade s predpismi a štandardmi značky ešte pred ich nasadením.

Očakávania spotrebiteľov v súvislosti s bezpečnosťou značky dosiahli v ére AI bezprecedentnú úroveň, pričom údaje odhaľujú výrazné obavy zo zavádzajúceho obsahu generovaného AI. 75 % spotrebiteľov nepodporuje značky, ktoré inzerujú na stránkach šíriacich dezinformácie, čo naznačuje, že spojenie značky s nespoľahlivým obsahom priamo ovplyvňuje vnímanie a nákupné rozhodnutia. 82 % spotrebiteľov aktívne dbá na to, aby obsah v okolí online reklám bol vhodný a dôveryhodný, čo poukazuje na zvýšenú ostražitosť ohľadom kontextu a správ značky. Najznepokojujúcejšie je, že viac ako 50 % spotrebiteľov prestane používať produkty alebo služby značiek, ktorých reklamy sa objavia pri nevhodnom, urážlivom či zavádzajúcom obsahu. Táto štatistika podčiarkuje priamy finančný dopad zlyhania v oblasti bezpečnosti značky na udržanie zákazníkov a tržby. 60 % inzerentov a agentúr považuje bezpečnosť značky za svoju najvyššiu prioritu v programatickej reklame a digitálnych marketingových stratégiách. Tieto štatistiky spoločne ukazujú, že bezpečnosť značky nie je len otázkou súladu s predpismi—priamo ovplyvňuje správanie spotrebiteľov, lojalitu k značke a ziskovosť. Organizácie, ktoré neuprednostňujú bezpečnosť značky v AI, riskujú stratu dôvery zákazníkov a podielu na trhu v prospech konkurencie s lepším manažmentom reputácie.

Efektívna bezpečnosť značky v ére AI si vyžaduje komplexné stratégie monitorovania a detekcie, ktoré spájajú ľudskú odbornosť s pokročilými technologickými riešeniami. Organizácie musia implementovať systémy na monitorovanie v reálnom čase, ktoré sledujú zmienky o značke, AI-generovaný obsah a potenciálne hrozby reputácie naprieč digitálnymi kanálmi vrátane sociálnych médií, spravodajských portálov, recenzných platforiem a stránok s obsahom od používateľov. Detekčné nástroje by mali odhaľovať podozrivé vzorce ako deepfaky, syntetické médiá, neautorizované použitie značky a obsah, ktorý porušuje smernice značky alebo obsahuje dezinformácie. Nástroje sentimentálnej analýzy dokážu posúdiť emocionálny tón a kontext zmienok o značke, čo pomáha identifikovať potenciálne riziká ešte pred ich eskaláciou do krízy. Systémy na overovanie faktov a tvrdení by mali validovať AI-generovaný obsah z hľadiska presnosti, aby sa zabezpečilo, že marketingové správy, odpovede zákazníckej podpory a verejná komunikácia obsahujú pravdivé informácie.

Kľúčové stratégie monitorovania a detekcie zahŕňajú:

Organizácie, ktoré chcú chrániť svoju značku v ére AI, musia zaviesť komplexné rámce správy a prevádzkové postupy zohľadňujúce špecifické riziká AI. Základom je vytvorenie firemnej AI politiky—tá by mala jasne definovať, kedy a ako možno používať AI nástroje, nastaviť schvaľovacie procesy obsahu, špecifikovať požiadavky na bezpečnosť dát a určiť zodpovednosť za kontrolu a schvaľovanie AI-generovaného obsahu pred jeho zverejnením. Kľúčová je edukácia a školenie tímu, keďže zamestnanci musia poznať smernice značky, rozpoznať riziká AI-generovaného obsahu a vedieť identifikovať dezinformácie, zaujatosť či porušenia predpisov. Zavedenie prísnych postupov na kontrolu obsahu zabezpečí, že všetky AI-generované materiály prejdú ľudskou redakčnou kontrolou z hľadiska presnosti, súladu so značkou, tónu a predpisov ešte predtým, ako sa dostanú k zákazníkom či verejnosti. Organizácie by mali starostlivo vyberať AI dodávateľov podľa bezpečnostných funkcií, ochrany dát, certifikácie súladu a histórie zodpovedného rozvoja AI. Pravidelné audity AI systémov a nástrojov pomáhajú odhaliť zraniteľnosti, zaujatosti a potenciálne problémy s bezpečnosťou značky ešte pred vznikom škôd. Zavedenie protokolov reakcie na incidenty a plánov krízového riadenia umožňuje organizáciám rýchlo a efektívne reagovať, ak dôjde k incidentom v oblasti bezpečnosti značky. Napokon, vytvorenie medziodborových tímov zahŕňajúcich marketing, právne, compliance a IT zabezpečí, že otázky bezpečnosti značky budú integrované do celého procesu implementácie AI a tvorby obsahu.

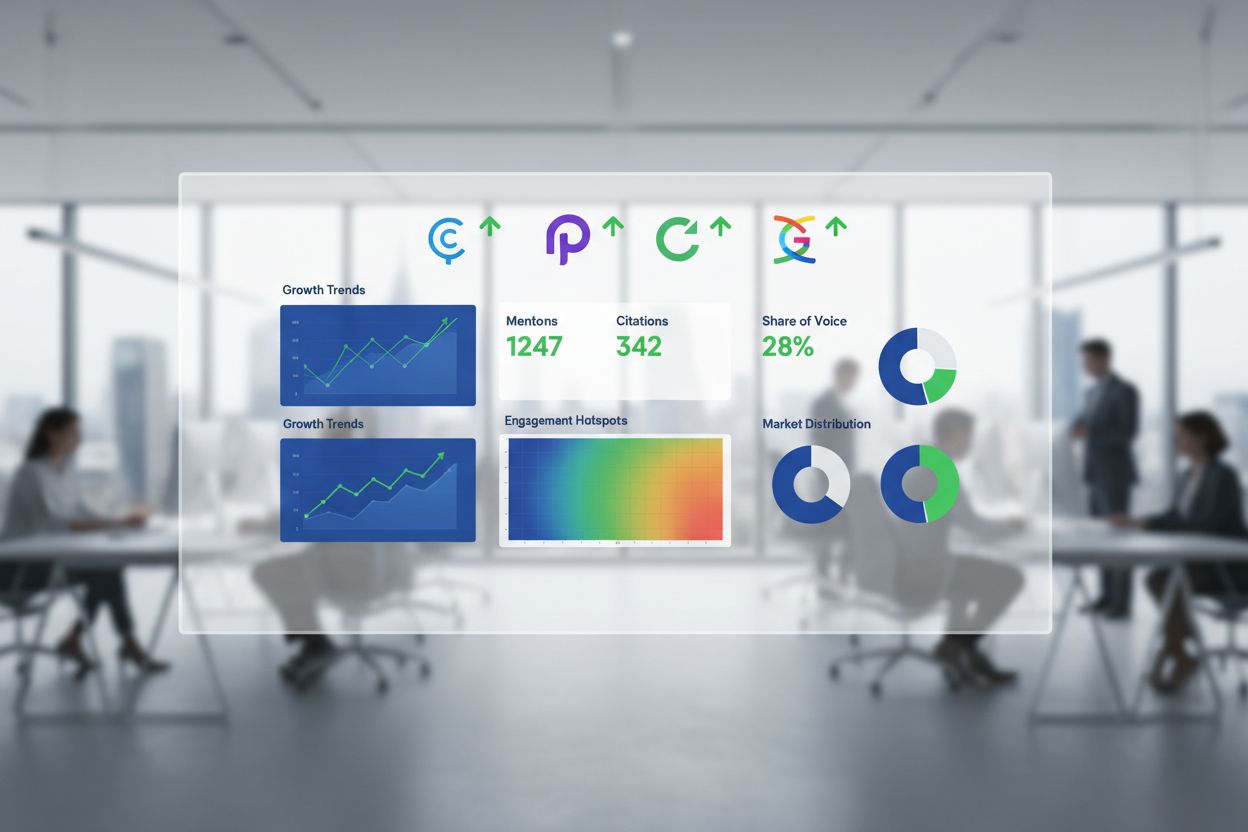

Vzniklo viacero špecializovaných nástrojov a platforiem, ktoré pomáhajú organizáciám monitorovať a chrániť svoje značky v prostredí ovplyvnenom AI. AmICited.com vyniká ako popredná platforma na monitoring AI odpovedí, špeciálne navrhnutá na sledovanie, ako systémy AI ako ChatGPT, Perplexity a Google AI Overviews spomínajú a referujú značky. AmICited.com poskytuje monitoring AI-generovaného obsahu v reálnom čase, sentimentálnu analýzu a detailné reporty o zmienkach o značke naprieč AI platformami—funkcionality, ktoré sú nevyhnutné pre moderný manažment bezpečnosti značky. Platforma umožňuje organizáciám pochopiť, ako AI systémy diskutujú o ich značke, identifikovať nepresnosti či negatívne zmienky a v prípade potreby prijať nápravné opatrenia. Okrem AI-špecifického monitorovania zahŕňajú komplexné riešenia bezpečnosti značky aj platformy na moderáciu obsahu využívajúce strojové učenie na detekciu urážlivého, nevhodného alebo zavádzajúceho obsahu; nástroje na detekciu plagiátorstva na odhalenie neautorizovaného použitia duševného vlastníctva a platformy sentimentálnej analýzy na posúdenie vnímania spotrebiteľov naprieč digitálnymi kanálmi. Organizácie by mali vyberať nástroje podľa svojich konkrétnych potrieb, pričom zohľadniť schopnosti monitorovania v reálnom čase, presnosť detekcie, integráciu s existujúcimi systémami, bezpečnostné prvky a reportovanie. Najefektívnejšie stratégie bezpečnosti značky kombinujú viacero špecializovaných nástrojov s ľudskou expertízou a dohľadom, čím vytvárajú viacvrstvovú ochranu pred reputačnými rizikami spojenými s AI.

Právne prostredie týkajúce sa AI-generovaného obsahu a bezpečnosti značky sa stále vyvíja, čo prináša pre organizácie usilujúce sa o ochranu duševného vlastníctva a reputácie značky výzvy aj príležitosti. Ochrana autorských práv pre AI-generovaný obsah je momentálne obmedzená—obsah vytvorený výlučne AI bez ľudského kreatívneho vkladu nemusí byť chránený podľa platnej legislatívy, čo znamená, že značky nemôžu brániť iným v kopírovaní a opätovnom použití AI-generovaného obsahu. Táto právna medzera predstavuje významné riziko pre organizácie, ktoré sa vo veľkej miere spoliehajú na AI pri tvorbe obsahu, keďže konkurencia alebo zneužívatelia môžu beztrestne replikovať a prepracovať obsah značky. Ochrana duševného vlastníctva sa ešte viac komplikuje, keď sú AI systémy trénované na vlastníckych firemných dátach či materiáloch značky, čo vyvoláva otázky vlastníctva dát, práv na ich využitie a možného neautorizovaného tréningu konkurenčných AI systémov. Organizácie musia zabezpečiť súlad s novovznikajúcimi AI reguláciami a zákonmi o ochrane osobných údajov ako GDPR, CCPA a odvetvovo-špecifickými predpismi, ktoré určujú, ako je možné AI systémy používať a ako sa môžu spracúvať dáta. Otázky zodpovednosti vyvstávajú, keď AI-generovaný obsah spôsobí škodu—ako ukázal prípad Air Canada, spoločnosti nesú právnu zodpovednosť aj za nepresný či zavádzajúci AI-generovaný obsah, aj keď bol vytvorený automatizovanými systémami. Organizácie by mali dokumentovať svoje AI governance postupy, procesy kontroly obsahu a opatrenia bezpečnosti značky, aby preukázali náležitú starostlivosť v prípade právnych sporov. Právne tímy by mali úzko spolupracovať s marketingom a IT, aby nastavili jasné politiky týkajúce sa používania AI, vlastníctva obsahu a rozdelenia zodpovednosti, čím zabezpečia, že opatrenia bezpečnosti značky sú v súlade s platnými zákonmi a reguláciami.

Bezpečnosť značky v AI je prax chrániť reputáciu značky spoločnosti pred negatívnym, nepresným alebo nevhodným obsahom generovaným systémami umelej inteligencie. Zahŕňa monitorovanie AI-generovaného obsahu, detekciu potenciálnych hrozieb ako sú dezinformácie a deepfaky a zavádzanie rámcov správy na zabezpečenie integrity značky. S rastúcim využívaním AI sa bezpečnosť značky stáva nevyhnutnou pre udržiavanie dôvery spotrebiteľov a ochranu reputácie podniku.

Bezpečnosť značky v AI je kľúčová, pretože AI systémy môžu vo veľkom generovať dezinformácie, vytvárať deepfaky a produkovať neautorizovaný obsah značky. Výskumy ukazujú, že 75 % spotrebiteľov nepodporuje značky inzerujúce na stránkach s dezinformáciami a viac ako 50 % prestane používať značky, ktorých reklamy sa zobrazia pri nevhodnom obsahu. Ochrana reputácie značky priamo ovplyvňuje lojalitu zákazníkov, príjmy a dlhodobý úspech podniku.

Kľúčové riziká spojené s AI pre značku zahŕňajú dezinformácie a nepravdivé tvrdenia o produktoch, deepfaky a syntetické médiá imitujúce vedenie, neautorizované použitie aktív značky a duševného vlastníctva, porušenie autorských práv a plagiátorstvo, úniky dát a narušenie súkromia, ako aj zaujatý alebo diskriminačný obsah. Tieto riziká môžu viesť k strate dôvery spotrebiteľov, právnej zodpovednosti, pokutám a výraznému poškodeniu reputácie.

Firmy môžu monitorovať AI-generovaný obsah pomocou sledovania zmienok o značke v reálnom čase naprieč digitálnymi kanálmi, nástrojov na detekciu syntetického textu a obrázkov, platforiem sentimentálnej analýzy na vyhodnotenie vnímania spotrebiteľa, systémov overovania faktov a detekcie plagiátorstva. Špecializované platformy ako AmICited.com poskytujú monitoring v reálnom čase toho, ako systémy AI spomínajú a referujú značky.

Efektívna politika bezpečnosti značky v AI by mala obsahovať jasné pravidlá, kedy a ako možno používať AI nástroje, určenie zodpovednosti za kontrolu a schvaľovanie obsahu, požiadavky na bezpečnosť a súkromie dát, školenia zamestnancov, kritériá na hodnotenie dodávateľov, postupy reakcie na incidenty a štandardy dokumentácie. Politika by mala riešiť interné využívanie AI aj externé hrozby od zneužívateľov AI na poškodenie značky.

Tradičná bezpečnosť značky sa zameriava na ochranu pred spájaním značky s nevhodným obsahom na webových stránkach a sociálnych sieťach. Bezpečnosť značky v AI rozširuje tento koncept o špecifické riziká umelej inteligencie, vrátane AI-generovaných dezinformácií, deepfakov, neautorizovaného AI obsahu značky, otázok autorských práv pri obsahu generovanom AI a problémov s ochranou dát. Vyžaduje špecializované monitorovacie nástroje a rámce správy určené pre hrozby spojené s AI.

V súčasnosti je ochrana autorských práv pre obsah generovaný AI obmedzená—obsah vytvorený výlučne AI bez ľudskej kreatívnej účasti nemusí byť chránený autorským právom podľa platnej legislatívy. To znamená riziko pre značky, ktoré sa spoliehajú na AI pri tvorbe obsahu, keďže konkurenti môžu AI-generované materiály kopírovať a opätovne používať. Organizácie by sa mali zamerať na dodržiavanie nových AI regulácií, zákonov o ochrane osobných údajov a nastavenie jasných rámcov zodpovednosti za obsah generovaný AI.

Riešenie incidentov bezpečnosti značky v AI si vyžaduje rýchle konanie vrátane okamžitej identifikácie a odstránenia škodlivého obsahu, transparentnej komunikácie so spotrebiteľmi a partnermi, vyšetrenia príčiny incidentu, prijatia nápravných opatrení a dokumentácie reakčných krokov. Firmy by mali mať pripravené krízové plány, určené tímy na reakciu a jasné komunikačné protokoly na minimalizáciu poškodenia reputácie a obnovu dôvery spotrebiteľov.

Zistite, ako systémy AI ako ChatGPT, Perplexity a Google AI Overviews spomínajú vašu značku. Získajte okamžité prehľady o AI-generovanom obsahu týkajúcom sa vášho podnikania a prevezmite kontrolu nad naratívom vašej značky.

Zistite, čo znamená ochrana značky, prečo je kľúčová pre viditeľnosť vo vyhľadávaní a monitorovanie AI, a ako ochrániť svoju značku naprieč Google, ChatGPT, Per...

Zistite, ako vyvážiť viditeľnosť značky v AI odpovediach so zabezpečením obsahu. Objavte stratégie monitorovania AI zmienok, ochrany duševného vlastníctva a udr...

Naučte sa, ako vytvárať komplexné AI správy o viditeľnosti, ktorým rozumejú aj manažéri. Sledujte zmienky o značke v ChatGPT, Perplexity a Google AI Overviews s...

Súhlas s cookies

Používame cookies na vylepšenie vášho prehliadania a analýzu našej návštevnosti. See our privacy policy.