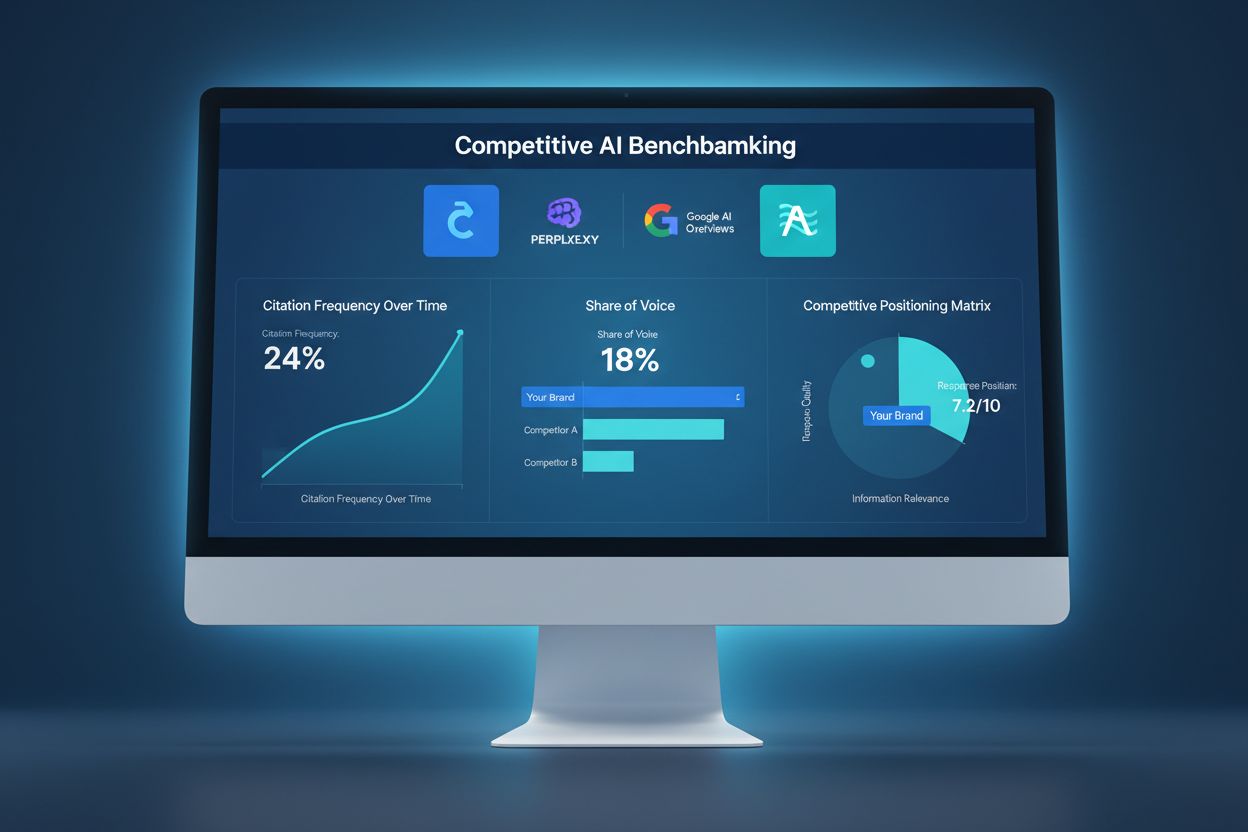

Súťažné AI benchmarking

Zistite, ako porovnávať svoju AI viditeľnosť s konkurenciou. Sledujte citácie, podiel hlasu a súťažnú pozíciu naprieč ChatGPT, Perplexity a Google AI. Objavte n...

Súťažná AI sabotáž označuje úmyselné pokusy konkurentov negatívne ovplyvniť viditeľnosť, vnímanie alebo výkonnosť značky vo výsledkoch AI vyhľadávania a odpovediach chatbotov. Zahŕňa to otravovanie dát, falošné recenzie, dezinformačné kampane a manipuláciu s tréningovými dátami AI s cieľom poškodiť reputáciu značky a znížiť počet citácií AI.

Súťažná AI sabotáž označuje úmyselné pokusy konkurentov negatívne ovplyvniť viditeľnosť, vnímanie alebo výkonnosť značky vo výsledkoch AI vyhľadávania a odpovediach chatbotov. Zahŕňa to otravovanie dát, falošné recenzie, dezinformačné kampane a manipuláciu s tréningovými dátami AI s cieľom poškodiť reputáciu značky a znížiť počet citácií AI.

Súťažná AI sabotáž označuje úmyselné pokusy manipulovať, otráviť alebo poškodiť dáta, ktoré AI vyhľadávače a jazykové modely používajú na generovanie výsledkov a citácií. Na rozdiel od tradičného negatívneho SEO, ktoré sa zameriava na poškodenie pozícií webstránok konkurencie prostredníctvom manipulačných schém odkazov alebo technických zneužití, AI sabotáž cieli tréningové dáta a zdroje, na ktoré sa AI systémy spoliehajú pri poskytovaní odpovedí. Toto rozlíšenie je kľúčové, pretože AI systémy ako Google AI Overviews, Perplexity a GPT priamo citujú zdroje zo svojich tréningových dát, čo ich robí zraniteľnými voči koordinovaným dezinformačným kampaniam. Dopad v reálnom svete je výrazný: keďže 60 % vyhľadávaní končí bez kliknutia na webstránku, konkurenti môžu otráviť AI výsledky, presmerovať návštevnosť, poškodiť reputáciu značky alebo šíriť nepravdivé informácie bez zásahu do tradičných pozícií vo vyhľadávačoch.

Súťažná AI sabotáž využíva niekoľko prepojených útokových vektorov, ktoré zneužívajú spôsob, akým AI systémy prijímajú a spracúvajú informácie. Otrávenie dát je hlavnou technikou, pri ktorej sa do zdrojov, ktoré AI používa na tréning – ako verejné databázy, fóra, recenzné stránky a spravodajské agregátory – vkladajú nepravdivé, zavádzajúce alebo škodlivé informácie. Útočníci využívajú label flipping (zmena metadát na nesprávne zatriedenie obsahu), data injection (pridanie falošných záznamov do datasetov) a backdoor útoky (vkladanie skrytých spúšťačov do tréningových dát). Konkurenti tiež spúšťajú koordinované kampane s falošnými recenziami, aby zaplavili platformy vymyslenými hodnoteniami, pričom šíria dezinformácie a deepfaky cez sociálne siete, blogy a AI-indexovaný obsah. Zraniteľnosť spočíva v tom, že AI systémy často dôverujú objemu a konzistentnosti informácií viac než ich pravosti. Tu je porovnanie rôznych metód sabotáže:

| Metóda | Ako funguje | Dopad na AI | Náročnosť detekcie |

|---|---|---|---|

| Otrávenie dát | Vkladanie nepravdivých informácií do tréningových datasetov | AI priamo cituje otrávené zdroje vo výsledkoch | Vysoká – vyžaduje analýzu dát |

| Falošné recenzie | Koordinované bombardovanie recenziami | Skresľuje AI analýzu sentimentu a odporúčania | Stredná – môže pomôcť analýza vzorcov |

| Dezinformačné kampane | Šírenie falošných tvrdení naprieč indexovanými webmi | AI zosilňuje falošné naratívy vo výsledkoch | Vysoká – vyžaduje fact-checking |

| Deepfaky | Tvorba syntetických médií o manažéroch alebo produktoch | Pri citovaní AI poškodzuje dôveryhodnosť značky | Veľmi vysoká – vyžaduje overenie |

| Únos adresárov | Prevzatie firemných profilov konkurencie | AI načítava falošné informácie z unesených adresárov | Stredná – pomáha overovanie |

| Falošné spravodajské články | Publikovanie vymyslených príbehov na spravodajských stránkach | AI ich berie ako dôveryhodné zdroje | Vysoká – vyžaduje overenie zdroja |

AI systémy sú zásadne zraniteľnejšie voči sabotáži ako tradičné vyhľadávače, pretože implicitne dôverujú tréningovým dátam viac ako ľudia. Zatiaľ čo Google hodnotí autoritu odkazov a reputáciu domény, AI modely sa učia vzory zo všetkých dát, ktoré majú – čo ich robí náchylnými na koordinované útoky. Výskumy ukazujú, že už 250 škodlivých dokumentov dokáže otráviť AI model, čo je oveľa nižšia bariéra vstupu v porovnaní s tradičnými SEO útokmi. Problém ešte zhoršuje fakt, že AI systémy citujú zdroje priamo, takže otrávené dáta nielen ovplyvňujú výsledky – stávajú sa autoritatívnou odpoveďou, ktorú používateľ vidí. Odhalenie otrávených dát je násobne ťažšie než identifikácia zlého spätného odkazu, pretože manipulácia prebieha na úrovni tréningu a je často neviditeľná pre externý audit. Pri náraste AI vyhľadávacej návštevnosti o 527 % za päť mesiacov (január – máj 2025) a 79 % Američanov dôverujúcich AI vyhľadávačom je motivácia konkurentov na sabotáž vyššia ako kedykoľvek predtým, zatiaľ čo bezpečnostná infraštruktúra zaostáva.

Najznámejší prípad AI sabotáže nastal, keď Target sa stal obeťou koordinovanej dezinformačnej kampane, ktorá falošne tvrdila, že predáva „satanistické“ detské oblečenie. AI systémy, natrénované na tomto vymyslenom naratíve, začali tieto nepravdy zobrazovať vo výsledkoch vyhľadávania a AI prehľadoch, čo spôsobilo značné poškodenie reputácie skôr, než firma stihla zareagovať. E-mailové systémy čelili podobným útokom cez otravu spamových filtrov, kde konkurencia vkladá škodlivé vzory do tréningových dát, aby boli legitímne e-maily označované ako spam. Bombardovanie recenzií konkurentov je čoraz bežnejšie – firmy zaplavujú profily rivalov falošnými negatívnymi recenziami, ktoré AI agreguje do sentimentu. Únos firemných adresárov predstavuje ďalší vektor, kedy útočníci prevezmú profily konkurencie na Google My Business či v odborových adresároch a vkladajú falošné informácie, ktoré AI indexuje a cituje. Tieto prípady dokazujú, že AI sabotáž nie je teória – už dnes reálne poškodzuje podniky, pričom škody umocňuje fakt, že AI výsledky pôsobia autoritatívne a sú často prvým zdrojom informácií pre používateľov.

Odhalenie súťažnej AI sabotáže si vyžaduje viacvrstvový monitoring sledujúci, ako sa vaša značka objavuje vo výsledkoch AI vyhľadávania a v citovaných zdrojoch. Prvým krokom je priebežné sledovanie výsledkov AI vyhľadávania pre vašu značku, produkty a kľúčových manažérov na platformách ako Google AI Overviews, Perplexity, ChatGPT a Claude. Sledovanie sentimentu v indexovaných zdrojoch pomáha odhaliť náhle zmeny v tom, ako sa o vašej značke píše – čo je varovný signál koordinovanej dezinformačnej kampane. Identifikácia falošných recenzií zahŕňa analýzu vzorcov hodnotení na štatistické anomálie, ako sú náhle nárasty jednovhviezdičkových recenzií alebo opakovanie rovnakého textu. Včasná detekcia je kľúčová; výskumy ukazujú, že prvých 48 hodín po začiatku útoku rozhoduje o jeho zamedzení. Monitoring by mal sledovať aj zdroje, ktoré AI cituje o vašej značke, aby ste otrávené dáta odhalili skôr, než spôsobia rozsiahle škody. Kľúčové metódy detekcie sú:

Budovanie odolnosti voči súťažnej AI sabotáži si vyžaduje proaktívnu, viacvrstvovú obranu, ktorá presahuje tradičný management reputácie. Tvorba kvalitného, autoritatívneho obsahu je najsilnejšou obranou – AI systémy sú trénované rozpoznávať a uprednostňovať obsah z osvedčených, dôveryhodných zdrojov, čím sa otrávené dáta ťažšie presadia proti pravdivým informáciám. Zosilňovanie pravdivých informácií na viacerých indexovaných platformách zabezpečí, že keď AI hľadá informácie o vašej značke, narazí na konzistentné a pravdivé naratívy z autoritatívnych zdrojov. Zabezpečenie prítomnosti značky znamená prevzatie a overenie všetkých profilov v adresároch, na sociálnych sieťach a v odborových zoznamoch, aby ste predišli únosom. Zaveste robustné monitoringové systémy, ktoré v reálnom čase sledujú vašu značku vo výsledkoch AI, čím umožníte rýchlu reakciu na vznikajúce hrozby. Vypracujte protokoly reakcie určujúce, ako váš tím reaguje na zistenú sabotáž – vrátane dokumentácie, hlásenia platformám a právnych krokov podľa potreby. Budovanie vzťahov s novinármi, odborovými influencermi a dôveryhodnými médiami vytvára ďalšiu vrstvu dôveryhodnosti, ktorú AI systémy rozpoznávajú a uprednostňujú.

Špecializované monitoringové platformy sa stali základnou infraštruktúrou na ochranu značky v ére AI vyhľadávania. Tieto nástroje poskytujú upozornenia v reálnom čase, keď sa vaša značka objaví vo výsledkoch AI vyhľadávania, čo vám umožňuje sledovať nielen pozície, ale aj skutočné citácie a zdroje, ktoré AI používa. AmICited.com je komplexné riešenie špeciálne určené na monitoring toho, ako sú vaša značka, produkty a manažéri citovaní naprieč AI vyhľadávačmi vrátane Google AI Overviews, Perplexity a GPT. Platforma sleduje, ktoré zdroje AI cituje o vašej značke, čo vám umožní identifikovať otrávené dáta a reagovať skôr, než spôsobia rozsiahle škody. Integrácia s vašou širšou stratégiou bezpečnosti značky znamená, že môžete prepojiť vzorce AI citácií s tradičnými metrikami vyhľadávania, sentimentom na sociálnych sieťach a recenznými platformami pre kompletný obraz konkurenčného prostredia. Spolu s existujúcimi nástrojmi na správu reputácie vytvoríte jednotný obranný systém, ktorý včas zachytí sabotáže a poskytne dáta potrebné na rýchlu reakciu.

S rastúcim výskytom súťažnej AI sabotáže sa mení aj legislatíva na riešenie týchto nových hrozieb. DMCA žiadosti o odstránenie obsahu možno použiť na stiahnutie otráveného obsahu z indexovaných zdrojov, hoci tento proces býva pomalý a vyžaduje jasné dôkazy o porušení autorských práv či vydávanie sa za niekoho. Zákony o ohováraní dávajú možnosť postihu, ak sabotáž zahŕňa nepravdivé tvrdenia poškodzujúce vašu reputáciu, aj keď dokazovanie škody v AI kontexte je zložité. Väčšina veľkých platforiem má už reportovacie mechanizmy špeciálne pre AI zneužitia vrátane otrávenia dát, falošných recenzií a dezinformačných kampaní, no vynucovanie je veľmi rôzne. Nové regulácie ako EU AI Act a pripravovaná americká legislatíva začínajú nastavovať rámce zodpovednosti za AI systémy, ktoré šíria nepravdivé informácie, čo môže otvoriť nové možnosti právnych krokov. Firmy by mali všetky pokusy o sabotáž dôkladne dokumentovať, pretože tento dôkaz je dôležitý pri právnych konaniach aj odvolaniach na platformách. Konzultácia s právnikom špecializovaným na AI a digitálnu reputáciu je čoraz dôležitejšia pre nastavenie reakčných stratégií v súlade s novými pravidlami.

Prostredie súťažnej AI sabotáže sa bude vyvíjať spolu s tým, ako útočníci aj obrancovia zdokonaľujú svoje techniky. AI-generované falošné recenzie pomocou veľkých jazykových modelov budú čoraz nerozoznateľnejšie od autentickej spätnej väzby, čo si vyžiada pokročilejšie detekčné systémy. Overovanie cez blockchain a decentralizované systémy dôveryhodnosti sa rysujú ako potenciálne riešenia na overenie zdrojov ešte predtým, ako ich AI použije na tréning. Poskytovatelia platforiem výrazne investujú do zlepšených obrán – lepšej validácie dát, overovania zdrojov a algoritmov detekcie otrávenia, no tieto opatrenia budú vždy zaostávať za novými typmi útokov. Komunitné systémy overovania, kde používatelia a experti označujú podozrivý obsah, sa môžu stať štandardom a vytvoriť kolektívnu obranu proti sabotáži. Konkurenčnú výhodu budú mať firmy, ktoré budú o krok vpred pred novými hrozbami vďaka nepretržitému monitoringu, rýchlym reakčným protokolom a vzdelávaniu tímu o AI. Organizácie, ktoré už dnes berú AI monitoring ako kľúčovú súčasť ochrany svojej značky, budú najlepšie pripravené brániť sa voči ešte sofistikovanejším útokom v budúcnosti.

Tradičné negatívne SEO cieli na pozície vo vyhľadávačoch manipuláciou odkazmi a kopírovaním obsahu. Súťažná AI sabotáž cieli na tréningové dáta AI a správanie modelu, otrávením zdrojov, ktoré AI cituje vo svojich odpovediach. AI systémy sú zraniteľnejšie, pretože priamo citujú zdroje a viac dôverujú tréningovým dátam ako tradičné algoritmy vyhľadávania.

Sledujte, ako AI platformy opisujú vašu značku každý týždeň pomocou nástrojov ako AmICited.com. Sledujte náhle zmeny v sentimentoch, falošné tvrdenia v AI odpovediach, koordinované negatívne recenzie alebo šírenie dezinformácií naprieč platformami. Včasná detekcia v prvých 48 hodinách je kľúčová pre zamedzenie šírenia.

Okamžite všetko zdokumentujte pomocou screenshotov a časových značiek. Nahláste to dotknutým platformám (OpenAI, Google, Anthropic). Šírte presné informácie vo vlastných kanáloch. Kontaktujte právneho zástupcu, ak došlo k ohováraniu alebo finančnej ujme. Zavedením monitorovacích systémov odhalíte budúce útoky skôr.

Výskumy ukazujú, že útočníkom stačí len 250 škodlivých dokumentov alebo 7-8 % datasetu, aby významne otrávili AI modely. Táto nízka vstupná bariéra robí AI systémy mimoriadne zraniteľnými v porovnaní s tradičnými vyhľadávačmi, ktoré majú sofistikovanejšie mechanizmy detekcie spamu.

Súčasné AI platformy majú obmedzené možnosti detekcie a väčšinou sa spoliehajú na hlásenia používateľov a občasné pretrénovanie na čistých dátach. Platformy však zavádzajú lepšie overovacie systémy, detekciu anomálií a kontrolu prístupov. Zodpovednosť za včasné odhalenie často leží na samotných značkách.

Budujte silnú autentickú reputáciu kvalitným obsahom, pravidelne monitorujte výsledky AI vyhľadávania, zabezpečte svoju značku naprieč adresármi, implementujte monitoring v reálnom čase a rýchlo reagujte na útoky. Prevencia budovaním reputácie je účinnejšia ako riešenie následkov po sabotáži.

AmICited.com monitoruje, ako AI platformy (ChatGPT, Perplexity, Google AI Overviews) odkazujú na vašu značku, sleduje zmeny sentimentu a vzorce citácií. Upozornenia v reálnom čase vás informujú o náhlych zmenách v tom, ako AI opisuje vašu značku, čo umožňuje rýchlu reakciu na možné pokusy o sabotáž.

Môžete sa domáhať nárokov z ohovárania, podať DMCA žiadosť o odstránenie falošného obsahu, nahlásiť porušenie pravidiel platforme a prípadne žiadať náhradu za finančnú ujmu. Dokumentácia sabotáže je kľúčová. Poradťe sa s právnikom so zameraním na digitálne práva a duševné vlastníctvo.

Chráňte svoju značku pred súťažnou AI sabotážou vďaka monitoringu v reálnom čase naprieč ChatGPT, Perplexity a Google AI Overviews. Odhaľte hrozby skôr, než poškodia vašu reputáciu.

Zistite, ako porovnávať svoju AI viditeľnosť s konkurenciou. Sledujte citácie, podiel hlasu a súťažnú pozíciu naprieč ChatGPT, Perplexity a Google AI. Objavte n...

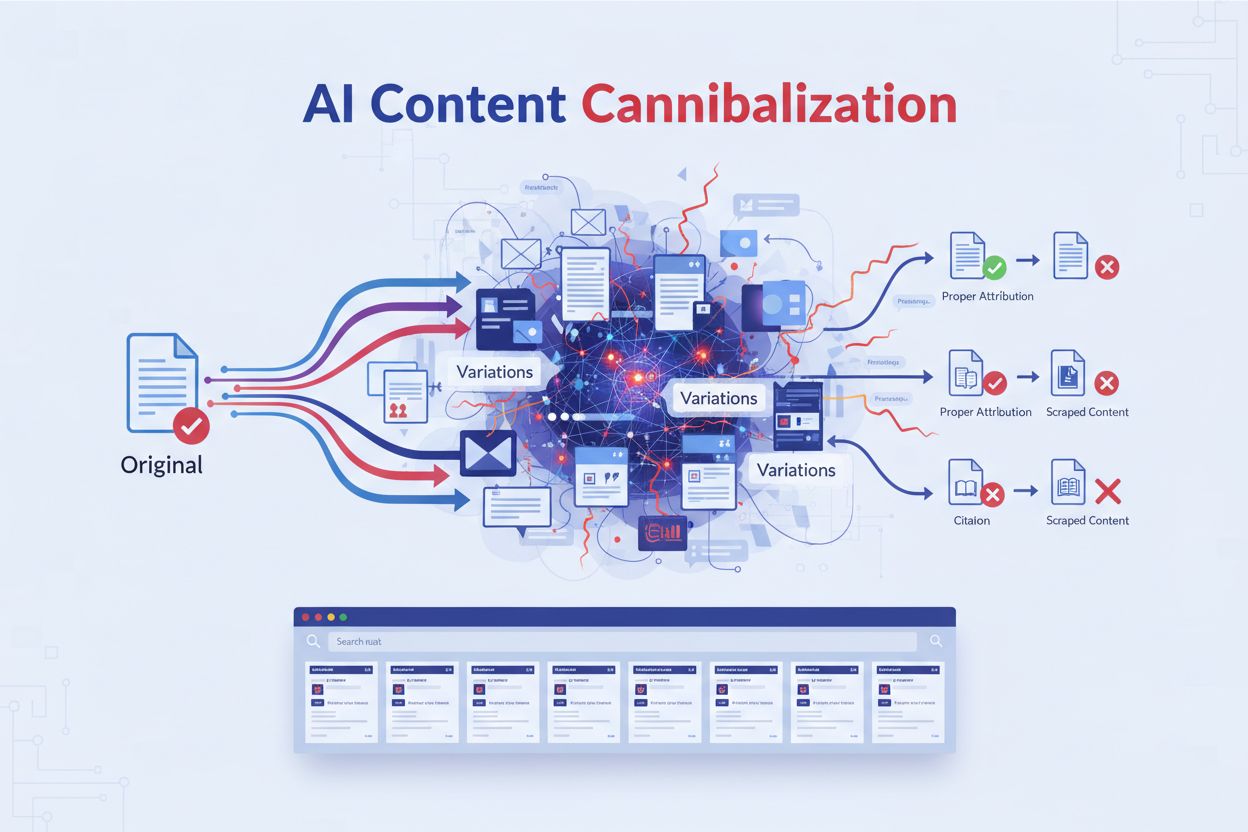

Zistite, čo je kanibalizácia AI obsahu, ako sa líši od duplicitného obsahu, prečo škodí pozíciám a aké stratégie ochránia váš obsah pred skenovaním a prepísaním...

Zistite, čo znamená kanibalizácia obsahu v AI vyhľadávaní, ako ovplyvňuje viditeľnosť vašej značky v AI odpovediach a prečo je dôležité sledovať prekrývanie obs...

Súhlas s cookies

Používame cookies na vylepšenie vášho prehliadania a analýzu našej návštevnosti. See our privacy policy.