Hur du bestrider och rättar felaktig information i AI-svar

Lär dig hur du bestrider felaktig AI-information, rapporterar fel till ChatGPT och Perplexity, samt implementerar strategier för att säkerställa att ditt varumä...

Processer för att bestrida felaktigt eller skadligt AI-genererat varumärkesinnehåll. Tvister om AI-innehåll avser formella utmaningar när artificiell intelligens genererar vilseledande information om varumärken, produkter eller organisationer. Dessa tvister uppstår från AI-hallucinationer, felaktiga källhänvisningar och felaktiga framställningar som skadar varumärkets rykte på plattformar som ChatGPT, Perplexity och Google AI Overviews. Effektiv tvistlösning kräver övervakning, dokumentation, direkt kontakt med AI-företag och strategisk innehållsskapande för att rätta till felinformation.

Processer för att bestrida felaktigt eller skadligt AI-genererat varumärkesinnehåll. Tvister om AI-innehåll avser formella utmaningar när artificiell intelligens genererar vilseledande information om varumärken, produkter eller organisationer. Dessa tvister uppstår från AI-hallucinationer, felaktiga källhänvisningar och felaktiga framställningar som skadar varumärkets rykte på plattformar som ChatGPT, Perplexity och Google AI Overviews. Effektiv tvistlösning kräver övervakning, dokumentation, direkt kontakt med AI-företag och strategisk innehållsskapande för att rätta till felinformation.

En tvist om AI-innehåll avser en formell utmaning eller klagomålsprocess när AI-system genererar, citerar eller presenterar felaktig, vilseledande eller skadlig information om ett varumärke, en produkt eller en organisation. Dessa tvister uppstår när AI-drivna sökmotorer, chattbottar och språkmodeller producerar innehåll som felrepresenterar fakta, tillskriver felaktig information eller skadar varumärkets rykte genom AI-hallucinationer—tillfällen då AI självsäkert presenterar felaktig information som fakta. I takt med att AI-sök blir allt mer centralt för hur konsumenter upptäcker och utvärderar varumärken, och plattformar som ChatGPT, Perplexity, Google AI Overviews och Gemini påverkar köpbeslut för miljontals användare, har förmågan att utmana och rätta felaktigt AI-genererat innehåll blivit avgörande för varumärkesskydd och rykteshantering.

Effekten av felaktigt AI-genererat innehåll sträcker sig långt utöver traditionella utmaningar kring varumärkesövervakning. Till skillnad från inlägg på sociala medier som försvinner från flöden inom timmar, kan AI-genererade varumärkesomnämnanden kvarstå på flera plattformar och påverka konsumenters uppfattning i månader eller år. Nästan 50 % av människor litar på AI-rekommendationer, och med över 700 miljoner veckovisa ChatGPT-användare kan ett enda felaktigt påstående om ditt varumärke nå tiotals miljoner potentiella kunder. När AI-system anger felaktiga priser, tillskriver produktegenskaper fel, eller rekommenderar konkurrenter istället för ditt varumärke, påverkar konsekvenserna direkt kundanskaffning, konverteringsgrad och marknadspositionering.

| Aspekt | Traditionella varumärkestvister | Tvister om AI-innehåll |

|---|---|---|

| Livslängd | Timmar till dagar (sociala medier) | Månader till år (kvarstår i AI-modeller) |

| Räckvidd | Begränsat till plattformsföljare | Miljontals AI-användare globalt |

| Korrigeringshastighet | Omedelbart svar möjligt | Kräver innehållsstrategi & kontakt |

| Verifiering | Mänsklig granskning | AI-genererat, svårare att faktagranska |

| Påverkan på sök | Påverkar SEO-ranking | Påverkar AI Share of Voice & rekommendationer |

| Publikens förtroende | Varierar per plattform | Högt (50 %+ litar på AI) |

| Permanent | Kan raderas av postaren | Inbäddat i AI-träningsdata |

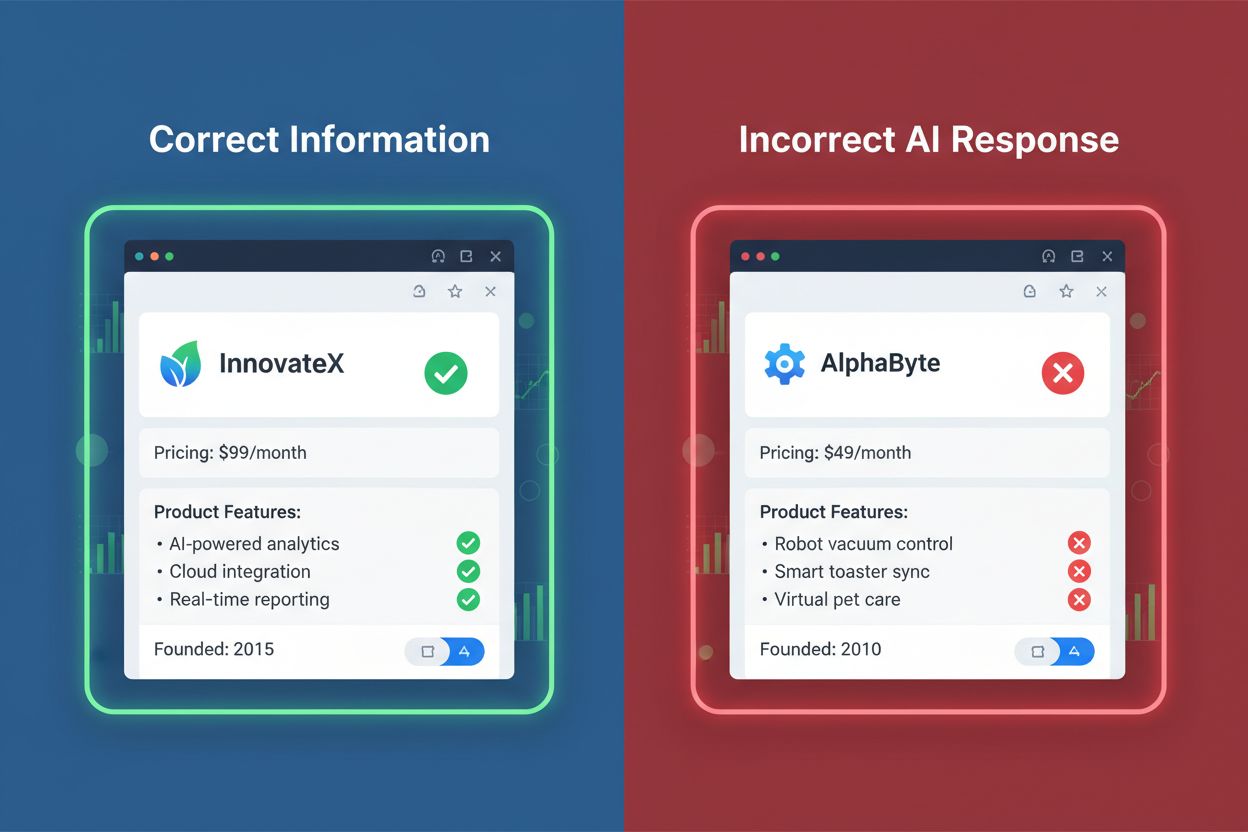

Exempel från verkligheten visar allvaret: AI-system har anger felaktiga priser för prenumerationstjänster, listat utgångna produkter som aktuella och tillskrivit funktioner till konkurrenter som egentligen tillhör originalvarumärket. Dessa fel påverkar köpbeslut direkt och kan leda till förlorade intäkter, skadade kundrelationer och försämrad konkurrensposition i AI-drivna sökresultat.

AI-system genererar olika kategorier av felaktigt eller skadligt innehåll om varumärken. Att förstå dessa typer hjälper organisationer att identifiera och prioritera tvistlösning:

Att förstå varför AI-system producerar felaktig varumärkesinformation är avgörande för att utveckla effektiva strategier för tvistlösning. AI-hallucinationer uppstår när språkmodeller genererar trovärdig men felaktig information, en grundläggande egenskap hos dessa system. Istället för att hämta fakta från en databas förutspår AI-modeller nästa ord utifrån statistiska mönster i träningsdata, och producerar ibland självsäkra påståenden om information som inte existerar eller är föråldrad. Många AI-system använder Retrieval Augmented Generation (RAG), som kompletterar träningsdata med webbsökningar i realtid, men denna process kan förstärka fel om källwebbplatser innehåller felaktig information eller om AI misstolkar kontexten. Begränsningar i träningsdata innebär att information om nya produkter, senaste företagsförändringar eller uppdaterade priser kanske inte återspeglas i AI-svar. Dessutom uppstår partiskhet i källval när AI-system ger oproportionerligt stor vikt åt vissa webbplatser—särskilt domäner med hög auktoritet som Wikipedia, Reddit eller branschspecifika recensionssajter—vilka kan innehålla föråldrad eller ofullständig information om ditt varumärke.

Effektiv tvisthantering börjar med systematisk övervakning av flera AI-plattformar. Manuell övervakning innebär att regelbundet fråga AI-system om varumärket och granska svaren för noggrannhet, men detta är tidskrävande och fångar bara en bråkdel av potentiella omnämnanden. Automatiserade AI-övervakningsverktyg ger heltäckande spårning över plattformar som ChatGPT, Perplexity, Google AI Overviews, Gemini, Claude och DeepSeek, och analyserar tusentals AI-genererade svar för att identifiera felaktigheter. Ledande plattformar som AmICited.com är specialiserade på att spåra hur AI-system refererar till varumärken, erbjuder sentimentanalys för att identifiera negativa framställningar och källhänvisningsanalys för att visa vilka källor AI-systemen använder om ditt varumärke. Konkurrerande lösningar som Authoritas erbjuder anpassningsbar promptspårning med statistisk tillförlitlighet, Profound tillhandahåller företagsklassad daglig övervakning med detaljerad svaranalys, och Ahrefs Brand Radar spårar AI-omnämnanden parallellt med traditionell sökbarhet. Verktyg som Otterly och Peec.ai erbjuder mer prisvärda alternativ för mindre varumärken som börjar övervaka sin AI-närvaro. Effektiv övervakning bör följa inte bara varumärkesomnämnanden utan även AI Share of Voice—andelen AI-rekommendationer ditt varumärke får jämfört med konkurrenter i relevanta kategorier.

När felaktigt AI-innehåll identifieras finns flera vägar till lösning beroende på tvistens allvar och art. Direkt kontakt med AI-företag innebär att kontakta plattformar som OpenAI, Anthropic, Google och Perplexity med dokumenterade bevis på felaktigheter, och begära rättelser eller omträning av modeller. Många AI-företag har etablerade feedbackmekanismer och tar varumärkets rykte på allvar, särskilt när fel påverkar kundförtroendet eller innefattar faktamässiga felaktigheter. Innehållsskapande och optimering angriper grundorsaken genom att säkerställa att din webbplats innehåller tydlig, korrekt och omfattande information om ditt varumärke, produkter, priser och företagshistoria—information som AI-systemen kommer att citera när de genererar svar. Att skapa dedikerade jämförelsesidor och FAQ-sektioner som direkt besvarar vanliga frågor och jämförelser med konkurrenter ökar sannolikheten att AI-systemen citerar ditt auktoritativa innehåll istället för tredjepartskällor. PR och mediakontakter kan förstärka rättelser via branschtidningar och nyhetsbevakning, vilket påverkar de webbkällor som AI-systemen använder. Influencersamarbeten och tredjepartsrecensioner på ansedda plattformar som G2, Capterra eller branschspecifika recensionssajter erbjuder alternativa källor för AI att citera, vilket förbättrar varumärkets representation i AI-svar. Den mest effektiva strategin kombinerar flera metoder: rätta fel på din webbplats, skapa auktoritativt innehåll som AI-systemen citerar och engagera dig direkt med AI-företag när tvister innefattar faktamässiga fel som skadar varumärkets rykte.

Ett växande ekosystem av specialiserade verktyg hjälper varumärken att övervaka, analysera och hantera sin närvaro i AI-genererat innehåll. AmICited.com leder marknaden för AI-varumärkesövervakning och spårar omnämnanden över stora AI-plattformar med detaljerad sentimentanalys och källhänvisningsspårning för att identifiera vilka källor som påverkar AI-svar om ditt varumärke. Authoritas kombinerar AI-sökövervakning med traditionell SEO-spårning, med anpassningsbar promptgenerering och statistiska tillförlitlighetsmått för analys i företagsklass. Profound ger daglig övervakning med omfattande svaranalys och konversationsutforskning för att förstå vilka frågor som triggar varumärkesomnämnanden. Ahrefs Brand Radar integrerar AI-omnämnandespårning med sökbarhetsmått, och visar hur ditt varumärke syns över sex stora AI-index tillsammans med traditionella sökresultat. Otterly.ai erbjuder prisvärd veckovis övervakning med automatiska rapporter, perfekt för varumärken som inleder sin AI-synlighetsresa. Peec.ai erbjuder mellannivålösningar med tydliga dashboards och benchmarking mot konkurrenter. Dessa plattformar delar funktioner som spårning av omnämnandefrekvens, sentimentanalys, konkurrentjämförelser och identifiering av källor, men skiljer sig åt i uppdateringsfrekvens (från realtid till veckovis), plattformsomfattning, anpassningsmöjligheter och prisstruktur. Att välja rätt verktyg beror på organisationens storlek, budget och hur djupgående analys av AI-sök som krävs.

I takt med att tvister om AI-innehåll blir vanligare utvecklas juridiska och regulatoriska ramar för att skydda varumärken och säkerställa innehållsnoggrannhet. Federal Trade Commission (FTC) har vidtagit åtgärder mot företag som gör vilseledande påståenden om AI-kapacitet, inklusive fall där AI-verktyg för innehållsdetektion annonserades med överdrivna noggrannhetssiffror. Upphovsrätts- och varumärkesfrågor uppstår när AI-system felaktigt tillskriver immateriella rättigheter eller genererar innehåll som bryter mot varumärkesrättigheter. Framväxande regleringar i EU, Storbritannien och föreslagen amerikansk lagstiftning kräver i allt högre grad att AI-system redovisar källor till träningsdata och erbjuder mekanismer för att rätta felaktig information. Ansvarsfrågor är fortfarande oklara: det är inte fastslaget om ansvaret för felaktigt AI-innehåll ligger hos AI-utvecklarna, företagen vars innehåll använts i träningen eller varumärkena själva. Framsynta organisationer bör följa regulatoriska utvecklingar och säkerställa att deras processer för tvistlösning stämmer överens med nya juridiska krav på AI-transparens och korrekthet.

Proaktiv varumärkeshantering i AI-eran kräver ett lager-på-lager-anslag med förebyggande, övervakning och snabb respons. Underhåll aktuell och korrekt information på alla webbplatser, och se till att priser, produktbeskrivningar, företagets historia och nyckelfakta är aktuella och tydligt presenterade—detta blir den auktoritativa källa som AI-systemen citerar. Skapa heltäckande varumärkesdokumentation inklusive detaljerade FAQ-sidor, jämförelsesidor mot konkurrenter och “om oss”-innehåll som direkt besvarar frågor AI-systemen sannolikt får. Övervaka regelbundet med specialiserade AI-övervakningsverktyg för att tidigt upptäcka felaktigheter innan de sprids på flera AI-plattformar. Agera snabbt när tvister identifieras, med både direkt kontakt med AI-företag och innehållsskapande för att rätta felinformation. Bygg varumärkesauktoritet via tredjepartsomnämnanden på ansedda sajter, branschrecensioner och medier som AI-system prioriterar som källor. Optimera för AI-sök genom att skapa innehåll som besvarar de specifika frågor användare ställer till AI-systemen, så att ditt varumärke syns i relevanta svar. Organisationer som kombinerar dessa åtgärder—korrekt information, heltäckande dokumentation, aktiv övervakning, snabb respons och auktoritetsbyggande—minskar risken och effekten av tvister om AI-innehåll avsevärt och förbättrar sin synlighet i AI-drivna sökresultat.

En tvist om AI-innehåll uppstår när AI-system genererar, citerar eller presenterar felaktig, vilseledande eller skadlig information om ett varumärke, en produkt eller en organisation. Dessa tvister uppstår från AI-hallucinationer—tillfällen då AI självsäkert presenterar felaktig information som fakta—och kan allvarligt skada varumärkets rykte på plattformar som ChatGPT, Perplexity och Google AI Overviews.

Till skillnad från inlägg på sociala medier som försvinner inom några timmar, kvarstår AI-genererade varumärkesomnämnanden i månader eller år och når miljontals användare. Nästan 50 % av människor litar på AI-rekommendationer, och med över 700 miljoner veckovisa ChatGPT-användare kan ett enda felaktigt påstående påverka tiotals miljoner potentiella kunder och direkt påverka köpbeslut.

Använd specialiserade AI-övervakningsverktyg som AmICited.com, Authoritas eller Profound för att spåra hur AI-system refererar till ditt varumärke på ChatGPT, Perplexity, Google AI Overviews och Gemini. Dessa verktyg erbjuder sentimentanalys, spårning av källhänvisningar och benchmarking mot konkurrenter för att identifiera felaktigheter, negativa framställningar och uteblivna omnämnanden.

Vanliga tvister inkluderar faktamässiga fel (felaktiga priser, grundandedatum, produktegenskaper), felaktigt tillskriven information, favorisering av konkurrenter i rekommendationer, förstärkning av negativt sentiment, uteblivna varumärkesomnämnanden i relevanta kategorier och skadliga kopplingar till orelaterade eller kontroversiella ämnen.

Effektiv lösning kombinerar flera strategier: direkt kontakt med AI-företag med dokumenterade bevis, skapa korrekt och heltäckande innehåll på din webbplats, utveckla jämförelsesidor och FAQ-sektioner, PR och mediakontakter för att påverka källmaterial samt bygga varumärkesauktoritet genom tredjepartsrecensioner och omnämnanden på plattformar med hög auktoritet.

AI-system producerar felaktigt innehåll på grund av hallucinationer (genererar trovärdig men felaktig information), begränsningar i träningsdata (föråldrad information), fel i Retrieval Augmented Generation (feltolkning av webbkällor) och partiskhet i källval (övervikt av vissa webbplatser och ignorerar andra).

Ledande plattformar inkluderar AmICited.com (specialiserad AI-varumärkesövervakning), Authoritas (anpassningsbar promptspårning med statistisk tillförlitlighet), Profound (övervakning i företagsklass dagligen), Ahrefs Brand Radar (AI-omnämnanden med sökbarhet), Otterly (prisvärd veckovis övervakning) och Peec.ai (lösningar på mellannivå med benchmarking mot konkurrenter).

Tidslinjer för lösning varierar kraftigt. Direkta rättelser på din webbplats kan påverka AI-svar inom några veckor när modellerna uppdateras. Direkt kontakt med AI-företag kan ta 1–3 månader. Att bygga auktoritet genom tredjepartsinnehåll och PR-insatser kräver vanligtvis 2–6 månader för att visa mätbar effekt på AI-rekommendationer.

Upptäck hur AmICited hjälper varumärken att spåra och hantera sin närvaro på ChatGPT, Perplexity, Google AI Overviews och andra AI-plattformar. Få aviseringar i realtid när AI-system felrepresenterar ditt varumärke och vidta åtgärder för att skydda ditt rykte.

Lär dig hur du bestrider felaktig AI-information, rapporterar fel till ChatGPT och Perplexity, samt implementerar strategier för att säkerställa att ditt varumä...

Lär dig effektiva strategier för att identifiera, övervaka och korrigera felaktig information om ditt varumärke i AI-genererade svar från ChatGPT, Perplexity oc...

Lär dig identifiera och åtgärda negativt varumärkessentiment i AI-genererade svar. Upptäck tekniker för att förbättra hur ChatGPT, Perplexity och Google AI Over...