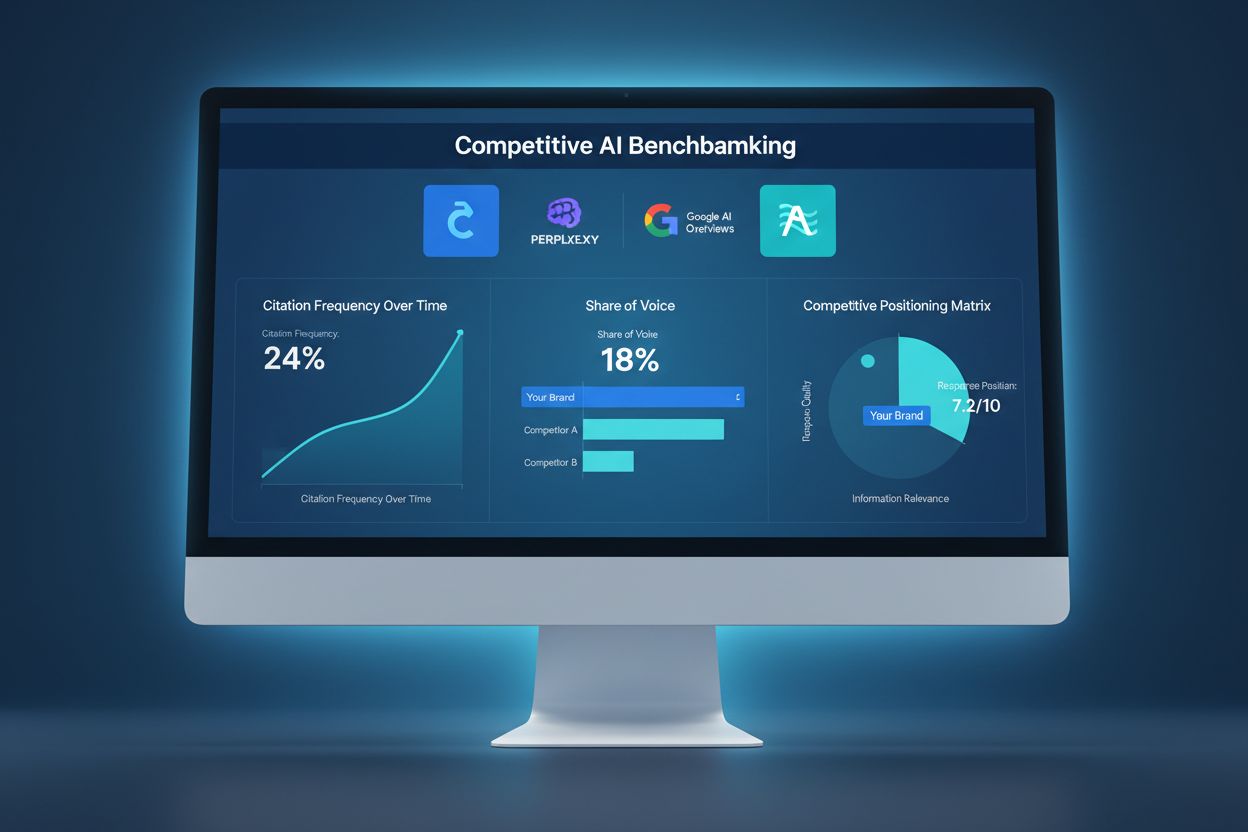

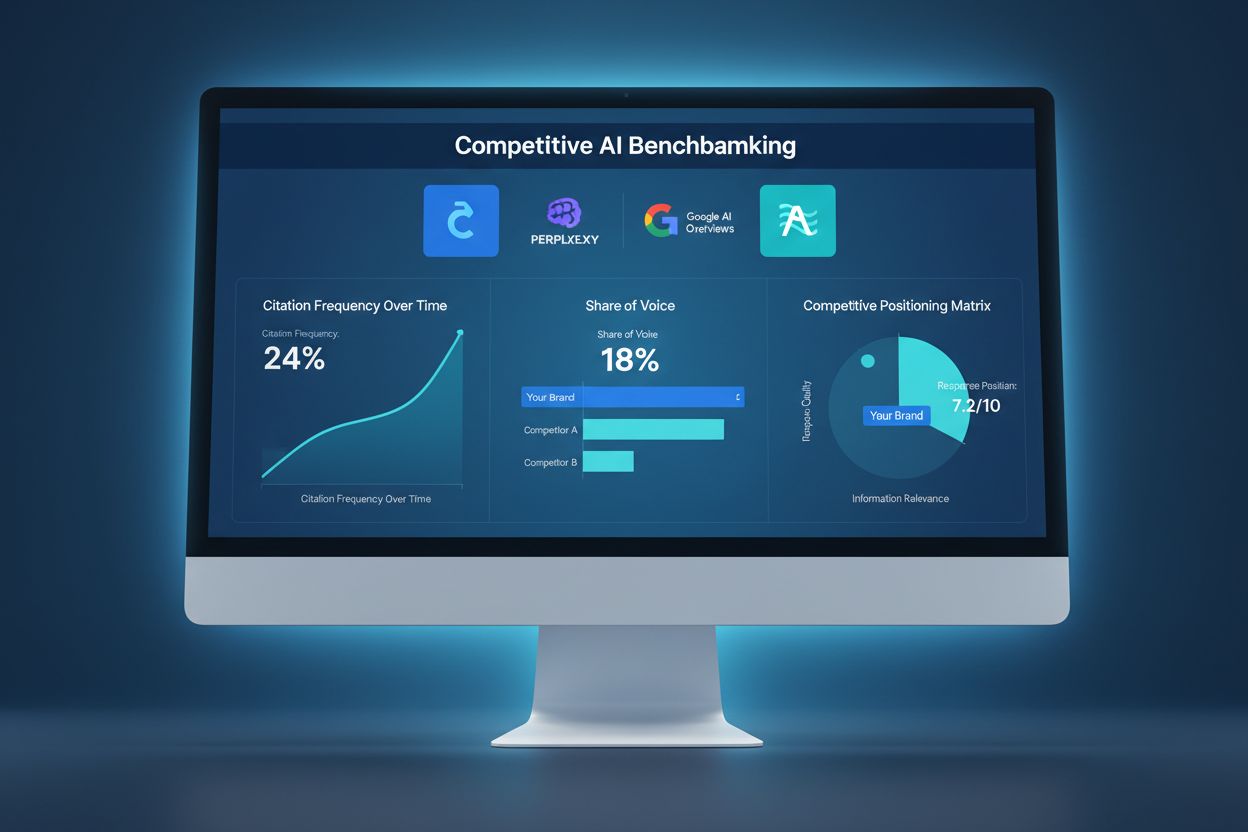

Konkurrenskraftig AI-benchmarking

Lär dig hur du kan benchmarka din AI-synlighet mot konkurrenter. Följ citeringar, andel av rösten och konkurrenspositionering över ChatGPT, Perplexity och Googl...

Konkurrensinriktad AI-sabotage avser avsiktliga försök från konkurrenter att negativt påverka ett varumärkes synlighet, sentiment eller prestation i AI-drivna sökresultat och chatbot-svar. Detta inkluderar datapåverkan (data poisoning), falska recensioner, desinformationskampanjer och manipulation av AI-träningsdata för att skada varumärkesryktet och minska AI-citeringar.

Konkurrensinriktad AI-sabotage avser avsiktliga försök från konkurrenter att negativt påverka ett varumärkes synlighet, sentiment eller prestation i AI-drivna sökresultat och chatbot-svar. Detta inkluderar datapåverkan (data poisoning), falska recensioner, desinformationskampanjer och manipulation av AI-träningsdata för att skada varumärkesryktet och minska AI-citeringar.

Konkurrensinriktad AI-sabotage syftar på avsiktliga försök att manipulera, förgifta eller korrumpera den data som AI-sökmotorer och språkmodeller använder för att generera resultat och citeringar. Till skillnad från traditionell negativ SEO, som fokuserar på att skada en konkurrents webbplatsrankningar genom länkscheman eller tekniska utnyttjanden, riktar sig AI-sabotage mot den träningsdata och de källor som AI-system förlitar sig på för att ge svar. Denna skillnad är avgörande eftersom AI-system som Google AI Overviews, Perplexity och GPT:er citerar källor direkt från sin träningsdata, vilket gör dem sårbara för samordnade desinformationskampanjer. Den verkliga effekten är betydande: med 60 % av sökningar som slutar utan att användaren klickar in på en webbplats kan konkurrenter nu förgifta AI-resultat för att styra trafik, skada varumärkesryktet eller sprida falsk information utan att påverka traditionella sökrankningar.

Konkurrensinriktad AI-sabotage sker genom flera sammanlänkade attackvektorer som utnyttjar hur AI-system hämtar in och bearbetar information. Datapåverkan (data poisoning) är den främsta tekniken och innebär injektion av falsk, vilseledande eller skadlig information i källor som AI-system använder för träning – exempelvis publika databaser, forum, recensionssajter och nyhetsaggregatorer. Angripare använder etikettväxling (label flipping, där metadata ändras för att felklassificera innehåll), datainjektion (lägg till falska poster i dataset) och bakdörrsattacker (gömda triggers i träningsdata). Konkurrenter driver också samordnade kampanjer med falska recensioner för att översvämma plattformar med påhittade omdömen, samtidigt som de sprider desinformation och deepfakes via sociala medier, bloggar och AI-indexerat innehåll. Sårbarheten ligger i att AI-system ofta litar mer på mängd och konsistens än på att verifiera äktheten. Så här jämförs olika sabotagemetoder:

| Metod | Hur det fungerar | AI-effekt | Upptäckts-svårighet |

|---|---|---|---|

| Datapåverkan | Injektion av falsk information i träningsdataset | AI citerar förgiftade källor direkt i resultat | Hög – kräver dataanalys |

| Falska recensioner | Samordnad recensionbombning på plattformar | Snedvrider AI:s sentimentanalys och rekommendationer | Medel – mönsteranalys kan hjälpa |

| Desinformationskampanjer | Spridning av falska påståenden på indexerade webbplatser | AI förstärker falska narrativ i sökresultat | Hög – kräver faktagranskning |

| Deepfakes | Skapande av syntetiska medier av chefer eller produkter | Skadar varumärkets trovärdighet när AI citerar | Mycket hög – kräver verifiering |

| Katalogkapning | Tar över konkurrenters företagsprofiler | AI hämtar falsk information från kapade kataloger | Medel – verifieringskontroller hjälper |

| Falska nyhetsartiklar | Publicering av påhittade artiklar på nyhetsliknande sajter | AI tolkar som auktoritativa källor | Hög – kräver källverifiering |

AI-system är grundläggande mer sårbara för sabotage än traditionella sökmotorer eftersom de litar mer implicit på träningsdata än vad människor gör. Medan Googles algoritm utvärderar länkauktoritet och domänrykte, lär sig AI-modeller bara mönster från all tillgänglig data – vilket gör dem mottagliga för samordnade attacker. Forskning visar att så få som 250 skadliga dokument kan förgifta en AI-modell, vilket är en dramatiskt lägre tröskel jämfört med traditionella SEO-attacker. Problemet förvärras av att AI-system citerar källor direkt, vilket innebär att förgiftad data inte bara påverkar resultat – det blir det auktoritativa svaret som användaren ser. Att upptäcka förgiftad data är exponentiellt svårare än att hitta en dålig bakåtlänk, eftersom manipulationen sker på träningsnivån och ofta är osynlig för externa granskningar. Med AI-söktrafik som ökar med 527 % på bara fem månader (januari–maj 2025) och 79 % av amerikaner som litar på AI-sökmotorer, är incitamentet för konkurrenter att sabotera större än någonsin, medan säkerhetsinfrastrukturen för att förebygga det fortfarande är underutvecklad.

Det mest uppmärksammade exemplet på AI-sabotage inträffade när Target utsattes för en samordnad desinformationskampanj som felaktigt hävdade att återförsäljaren sålde “satanistiskt” barnkläder. AI-system, tränade på detta påhittade narrativ, började visa dessa falska påståenden i sökresultat och AI-översikter, vilket orsakade betydande skada på varumärkets rykte innan företaget hann agera. E-postsystem har drabbats av liknande attacker genom spamfilter-förgiftning, där konkurrenter injicerar skadliga mönster i träningsdata så att legitima e-postmeddelanden fastnar i spam. Konkurrents recensionbombning har blivit allt vanligare, där företag översvämmar rivalers profiler med falska negativa recensioner som AI-system sedan räknar in i sentimentsbetyg. Kapning av kataloglistningar är en annan vektor, där angripare tar över konkurrenters företagsprofiler på Google My Business eller branschregister och matar in falsk information som AI-system indexerar och citerar. Dessa fall visar att AI-sabotage inte är teoretiskt – det skadar företag idag, och skadan förstärks eftersom AI-sökresultat uppfattas som auktoritativa och ofta är användarens första informationskälla.

Att upptäcka konkurrensinriktad AI-sabotage kräver ett flerskiktat övervakningsupplägg som spårar hur ditt varumärke framställs i AI-sökresultat och citeringskällor. Första steget är kontinuerlig övervakning av AI-sökresultat för ditt varumärke, produkter och nyckelpersoner på plattformar som Google AI Overviews, Perplexity, ChatGPT och Claude. Sentimentspårning över indexerade källor hjälper till att identifiera plötsliga förändringar i hur ditt varumärke diskuteras – ett varningstecken för samordnade desinformationskampanjer. Identifiering av falska recensioner innebär analys av recensionsmönster efter statistiska avvikelser, som plötsliga toppar i enstjärniga betyg eller recensioner med identiskt språk. Tidig upptäckt är avgörande; forskning visar att de första 48 timmarna efter en sabotageattack är kritiska för att kunna begränsa och bemöta skadan. Övervakningen bör även spåra vilka källor AI-systemen citerar om ditt varumärke, så att du kan identifiera förgiftade datakällor innan de får spridning. Här är de viktigaste metoderna för upptäckt:

Att bygga motståndskraft mot konkurrensinriktad AI-sabotage kräver en proaktiv, mångfacetterad försvarsstrategi som går utöver traditionell ryktesförvaltning. Att skapa högkvalitativt, auktoritativt innehåll är ditt starkaste försvar – AI-system tränas att känna igen och prioritera innehåll från etablerade, trovärdiga källor, vilket gör det svårare för förgiftad data att konkurrera med legitim information. Att förstärka korrekt information på flera indexerade plattformar säkerställer att AI-systemen möter konsekventa, sanna narrativ från auktoritativa källor när de söker efter information om ditt varumärke. Att säkra din varumärkesnärvaro innebär att du tar kontroll över och verifierar alla företagsprofiler, sociala medier och branschregister för att förebygga kapningsattacker. Implementera robusta övervakningssystem som spårar ditt varumärke i AI-sökresultat i realtid, så att du kan reagera snabbt på nya hot. Utveckla åtgärdsprotokoll som beskriver hur ditt team agerar vid upptäckt sabotage, inklusive dokumentation, rapportering till plattformar och juridiska åtgärder när det är lämpligt. Att bygga relationer med journalister, branschpåverkare och betrodda publikationer skapar ytterligare lager av trovärdighet som AI-systemen känner igen och prioriterar.

Dedikerade AI-övervakningsplattformar har blivit en nödvändig infrastruktur för varumärkesskydd i AI-sökens tidsålder. Dessa verktyg ger realtidsvarningar när ditt varumärke syns i AI-sökresultat, så att du kan spåra inte bara rankningar utan även faktiska citeringar och vilka källor AI-systemen använder. AmICited.com utmärker sig som en heltäckande lösning särskilt utformad för att övervaka hur ditt varumärke, dina produkter och ledande personer citeras i AI-sökmotorer som Google AI Overviews, Perplexity och GPT:er. Plattformen spårar vilka källor AI-systemen citerar om ditt varumärke, så att du kan identifiera förgiftade datakällor och agera innan de orsakar omfattande skada. Integrering med din bredare varumärkessäkerhetsstrategi gör att du kan korrelera AI-citeringsmönster med traditionella sökmetrik, sociala mediers sentiment och recensionsplattformar för att få en helhetsbild av det konkurrensutsatta landskapet. Genom att kombinera AI-övervakning med befintliga rykteshanteringsverktyg skapar du ett enhetligt försvarssystem som upptäcker sabotageförsök tidigt och ger data för snabb respons.

I takt med att konkurrensinriktad AI-sabotage blir vanligare utvecklas också de juridiska ramverken för att hantera dessa nya hot. DMCA-ansökningar kan användas för att ta bort förgiftat innehåll från indexerade källor, även om processen ofta är långsam och kräver tydliga bevis på upphovsrättsintrång eller identitetskapning. Förtalslagstiftning ger möjlighet till upprättelse när sabotage innebär falska uttalanden som skadar ditt rykte, även om att bevisa skada i AI-sammanhang förblir komplext. De flesta stora plattformar har nu rapporteringsmekanismer specifikt för AI-relaterat missbruk, inklusive datapåverkan, falska recensioner och desinformationskampanjer, även om tillämpningen varierar kraftigt. Nya regler som EU:s AI Act och föreslagen amerikansk lagstiftning börjar etablera ansvarsramverk för AI-system som förstärker falsk information, vilket potentiellt skapar nya möjligheter till juridiska åtgärder. Företag bör noggrant dokumentera alla sabotageförsök, då denna bevisning är avgörande både i juridiska processer och vid överklagan till plattformar. Rådgör med jurist med erfarenhet av AI och digitalt rykte för att utveckla insatsstrategier som följer de nya reglerna.

Landskapet för konkurrensinriktad AI-sabotage kommer att fortsätta utvecklas i takt med att både angripare och försvarare utvecklar mer sofistikerade tekniker. AI-genererade falska recensioner med stora språkmodeller kommer bli allt svårare att skilja från autentisk användarfeedback, vilket kräver mer avancerad detektering. Blockkedje-verifiering och decentraliserade trovärdighetssystem växer fram som potentiella lösningar för att verifiera källors äkthet innan AI-system inkorporerar data i träningsset. Plattformleverantörer investerar kraftigt i förbättrade försvar, inklusive bättre datavalidering, källverifiering och algoritmer för upptäckt av förgiftning, även om dessa åtgärder alltid kommer att ligga steget efter nya attackvektorer. Community-baserade verifieringssystem där användare och experter flaggar misstänkt innehåll kan bli standard, vilket skapar ett kollektivt försvar mot sabotage. Konkurrensfördelen kommer alltmer tillhöra de företag som ligger steget före nya hot genom kontinuerlig övervakning, snabba insatsprotokoll och satsningar på AI-kompetens i sina team. Organisationer som gör AI-övervakning till en kärnkomponent i sin varumärkesskydd idag kommer vara bäst rustade mot morgondagens mer sofistikerade attacker.

Traditionell negativ SEO riktar in sig på sökmotorrankningar genom länkmanipulation och kopiering av innehåll. Konkurrensinriktad AI-sabotage riktar in sig på AI:s träningsdata och modellbeteende, och förgiftar de källor som AI-system citerar i sina svar. AI-system är mer sårbara eftersom de citerar källor direkt och litar mer på träningsdata än traditionella sökalgoritmer.

Övervaka hur AI-plattformar beskriver ditt varumärke varje vecka med verktyg som AmICited.com. Leta efter plötsliga sentimentförändringar, falska påståenden i AI-svar, samordnade negativa recensioner eller desinformation som sprids över plattformar. Tidig upptäckt inom de första 48 timmarna är avgörande för att begränsa skadan.

Dokumentera allt omedelbart med skärmdumpar och tidsstämplar. Anmäl till drabbade plattformar (OpenAI, Google, Anthropic). Förstärk korrekt information via egna kanaler. Kontakta juridisk rådgivning om förtal eller ekonomisk skada uppstått. Implementera övervakningssystem för att upptäcka framtida attacker tidigt.

Forskning visar att angripare bara behöver 250 skadliga dokument eller 7-8 % av en datamängd för att påtagligt förgifta AI-modeller. Denna låga tröskel gör AI-system särskilt sårbara jämfört med traditionella sökmotorer, som har mer sofistikerade spamfilter.

Nuvarande AI-plattformar har begränsade upptäcktsmöjligheter och förlitar sig mest på användarrapporter och periodisk omträning med ren data. Dock införs bättre verifieringssystem, avvikelsedetektering och åtkomstkontroller. Ansvaret för tidig upptäckt ligger ofta på varumärkena själva.

Bygg ett starkt och autentiskt rykte med högkvalitativt innehåll, övervaka AI-sökresultat regelbundet, säkra din närvaro i kataloger, implementera realtidsövervakning och svara snabbt på attacker. Förebyggande arbete genom att bygga rykte är mer effektivt än att åtgärda efter sabotage.

AmICited.com övervakar hur AI-plattformar (ChatGPT, Perplexity, Google AI Overviews) refererar till ditt varumärke och spårar sentimentförändringar och citeringsmönster. Realtidsvarningar meddelar dig om plötsliga förändringar i hur AI beskriver ditt varumärke, vilket möjliggör snabb respons vid potentiella sabotageförsök.

Du kan väcka talan om förtal, skicka DMCA-anmälan för falskt innehåll, rapportera till plattformar för brott mot användarvillkor och eventuellt kräva skadestånd för ekonomisk förlust. Dokumentation av sabotaget är avgörande. Kontakta juridisk rådgivning med specialisering på digitala rättigheter och immateriell egendom.

Skydda ditt varumärke mot konkurrensinriktad AI-sabotage med realtidsövervakning i ChatGPT, Perplexity och Google AI Overviews. Upptäck hot innan de skadar ditt rykte.

Lär dig hur du kan benchmarka din AI-synlighet mot konkurrenter. Följ citeringar, andel av rösten och konkurrenspositionering över ChatGPT, Perplexity och Googl...

Lär dig vad AI-konkurrensunderrättelser är och hur du övervakar konkurrentsynlighet över ChatGPT, Perplexity och Google AI Overviews. Spåra citeringar, andel av...

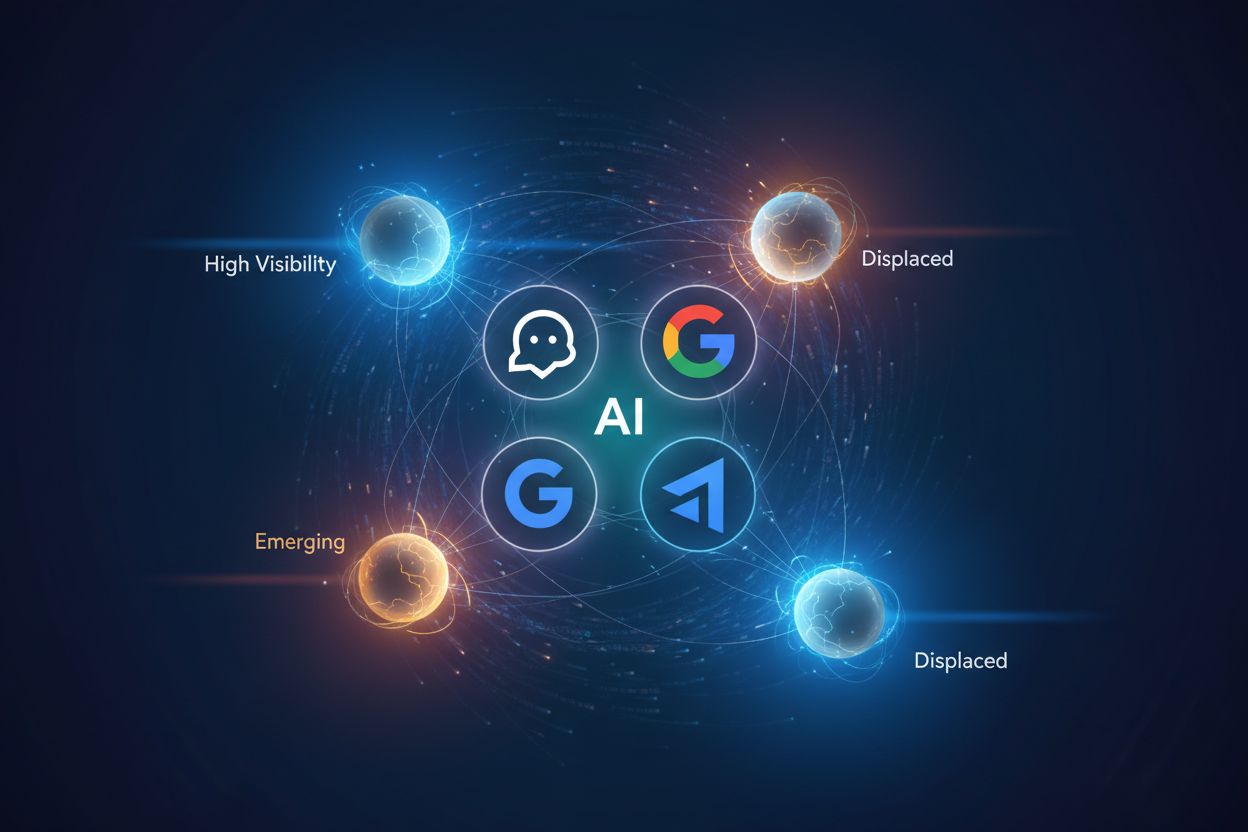

Lär dig vad AI-konkurrensförskjutning är, hur konkurrenter ersätter ditt varumärke i AI-svar och strategier för att förebygga eller återhämta dig från att tappa...