Förutseende av Frågor

Lär dig hur Förutseende av Frågor hjälper ditt innehåll att fånga utökade AI-konversationer genom att ta upp uppföljande frågor. Upptäck strategier för att iden...

Omformulering av frågor är processen där AI-system tolkar, omstrukturerar och förbättrar användarfrågor för att öka träffsäkerheten och relevansen vid informationssökning. Det omvandlar enkla eller tvetydiga användarfrågor till mer detaljerade, kontextuellt berikade versioner som överensstämmer med AI-systemets förståelse, vilket möjliggör mer precisa och heltäckande svar.

Omformulering av frågor är processen där AI-system tolkar, omstrukturerar och förbättrar användarfrågor för att öka träffsäkerheten och relevansen vid informationssökning. Det omvandlar enkla eller tvetydiga användarfrågor till mer detaljerade, kontextuellt berikade versioner som överensstämmer med AI-systemets förståelse, vilket möjliggör mer precisa och heltäckande svar.

Omformulering av frågor är processen att omvandla, utvidga eller skriva om en användares ursprungliga sökfråga för att bättre passa informationssöksystemets kapabiliteter och användarens verkliga avsikt. Inom artificiell intelligens och naturlig språkbehandling (NLP) överbryggar omformulering av frågor det kritiska gapet mellan hur användare uttrycker sina informationsbehov och hur AI-system tolkar och behandlar dessa. Denna teknik är avgörande i moderna AI-system eftersom användare ofta formulerar frågor otydligt, använder domänspecifika termer inkonsekvent eller utelämnar kontext som skulle förbättra träffsäkerheten. Omformulering verkar i skärningspunkten mellan informationssökning, semantisk förståelse och maskininlärning, vilket möjliggör mer relevanta resultat genom att tolka frågor via flera perspektiv—som synonymutvidgning, kontextuell berikning eller strukturell omorganisation. Genom att omformulera frågor intelligent kan AI-system kraftigt förbättra svarskvaliteten, minska tvetydighet och säkerställa att hämtad information bättre matchar användarens avsikt.

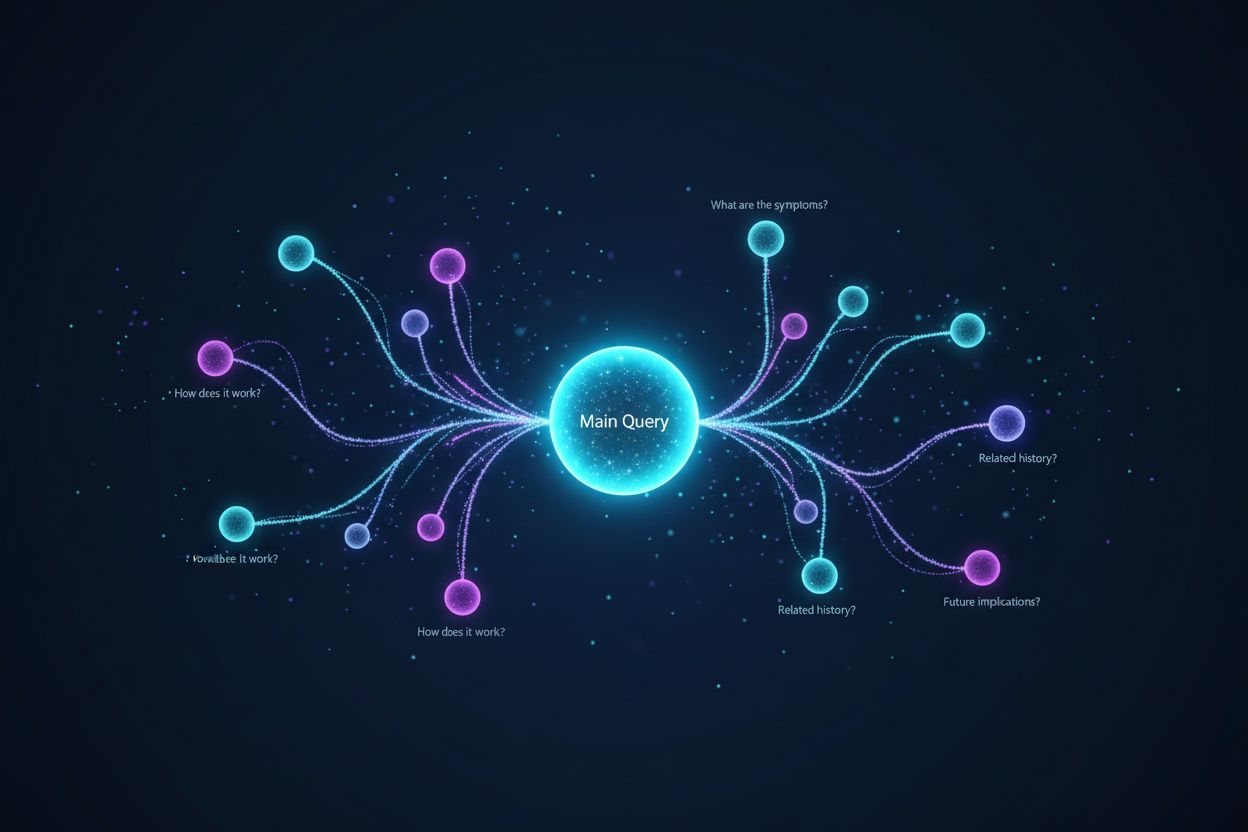

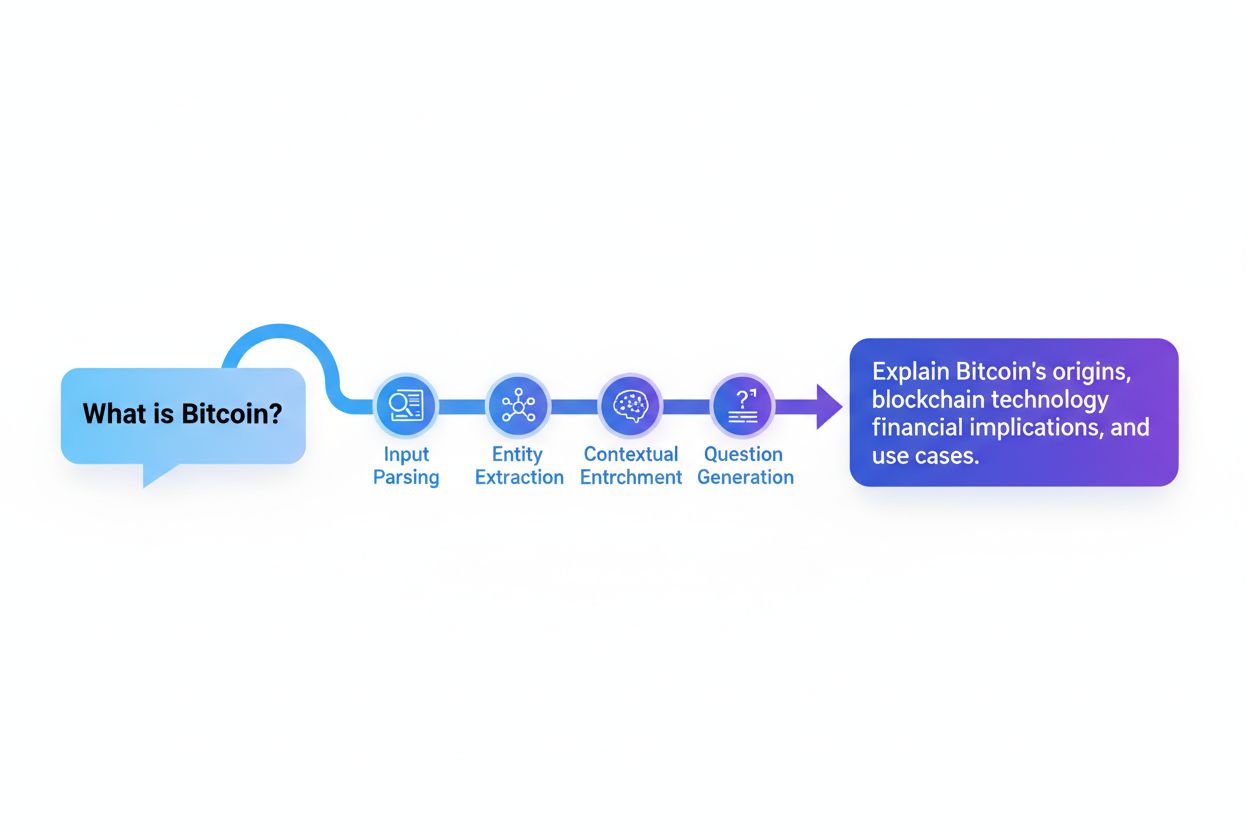

System för omformulering av frågor arbetar vanligtvis genom fem sammankopplade komponenter som tillsammans omvandlar rå användarinmatning till optimerade sökfrågor. Inmatningsparsning delar upp den ursprungliga frågan i dess beståndsdelar och identifierar nyckelord, fraser och strukturella element. Entitetsutvinning identifierar namngivna entiteter (personer, platser, organisationer, produkter) och domänspecifika begrepp med semantisk vikt. Sentimentanalys bevarar det känslomässiga tonläget eller den värderande hållningen i den ursprungliga frågan så att omformulerade versioner behåller användarens perspektiv. Kontextuell analys integrerar sessionshistorik, användarprofilinformation och domänkunskap för att berika frågan med underförstådd betydelse. Generering av frågor omvandlar påståenden eller fragment till välformulerade frågor som söksystem kan bearbeta mer effektivt.

| Komponent | Syfte | Exempel |

|---|---|---|

| Inmatningsparsning | Tokeniserar och segmenterar fråga i meningsfulla enheter | “bästa Python-bibliotek” → [“bästa”, “Python”, “bibliotek”] |

| Entitetsutvinning | Identifierar namngivna entiteter och domänbegrepp | “Apples senaste iPhone” → Entitet: Apple (företag), iPhone (produkt) |

| Sentimentanalys | Bevarar värderande ton och användarperspektiv | “dålig kundservice” → Bibehåller negativt sentiment i omformuleringen |

| Kontextuell analys | Inkluderar sessionshistorik och domänkunskap | Tidigare fråga om “maskininlärning” informerar aktuell fråga om “neurala nätverk” |

| Generering av frågor | Omvandlar fragment till strukturerade frågor | “Python felsökning” → “Hur felsöker jag Python-kod?” |

Processen för omformulering av frågor följer en systematisk sexstegsmetodik utformad för att successivt förbättra frågekvalitet och relevans:

Inmatningsparsning och normalisering

Entitets- och begreppsutvinning

Bevarande av sentiment och avsikt

Kontextuell berikning

Frågeutvidgning och synonymgenerering

Optimering och utvärdering

Omformulering av frågor använder en mängd olika tekniker från traditionella lexikala metoder till avancerade neurala tillvägagångssätt. Synonymbaserad utvidgning använder etablerade resurser som WordNet, inbäddningar som Word2Vec och GloVe samt kontextuella modeller som BERT för att hitta semantiskt liknande termer. Frågeavslappning lättar successivt på frågekraven för att öka återhämtningen när initiala resultat är otillräckliga—till exempel genom att ta bort ovanliga termer eller bredda datumintervall. Integration av användarfeedback och sessionskontext gör att system kan lära sig av användarinteraktion, förbättra omformuleringar baserat på vilka resultat användare faktiskt finner relevanta. Transformerbaserade omformulerare som T5 (Text-to-Text Transfer Transformer) och GPT-modeller genererar helt nya frågeformuleringar genom att lära sig mönster från stora dataset med frågepar. Hybrida tillvägagångssätt kombinerar flera tekniker—till exempel genom att använda regelbaserad synonymutvidgning för högkonfidensord och neurala modeller för tvetydiga fraser. Verkliga implementationer använder ofta ensemblemetoder som genererar flera omformuleringar och rankar dem med hjälp av inlärda relevansmodeller. E-handelsplattformar kan exempelvis kombinera domänspecifika synonymordlistor med BERT-inbäddningar för att hantera både standardiserad produktterminologi och vardagligt användarspråk, medan medicinska söksystem kan använda specialiserade ontologier tillsammans med transformermodeller för att säkerställa klinisk korrekthet.

Omformulering av frågor ger betydande förbättringar över flera dimensioner av AI-systemens prestanda och användarupplevelse:

Förbättrad sökträffsäkerhet: Omformulerade frågor fångar användarens avsikt mer exakt, vilket leder till högkvalitativa hämtade dokument och mer relevanta AI-genererade svar. Genom att utvidga frågor med synonymer och relaterade begrepp hämtar systemen dokument som kan använda annan terminologi än den ursprungliga frågan, vilket ökar sannolikheten att hitta riktigt relevant information dramatiskt.

Ökad återhämtning och täckning: Frågeutvidgning ökar antalet relevanta dokument genom att utforska semantiska variationer och relaterade begrepp. Detta är särskilt värdefullt i specialiserade domäner där terminologin varierar mycket, så att användare inte missar relevant information på grund av ordval.

Minskad tvetydighet och förtydligande: Omformuleringsprocessen undanröjer vaga eller tvetydiga frågor genom att lägga till kontext och skapa flera tolkningar. Detta gör att system kan hantera frågor som “apple” (frukt vs. företag) genom att skapa kontextspecifika omformuleringar som hämtar lämpliga resultat.

Bättre användarupplevelse och tillfredsställelse: Användare får mer relevanta resultat snabbare, vilket minskar behovet av att ändra frågor. Färre misslyckade sökningar och mer träffsäkra förstaträffar leder direkt till ökad användartillfredsställelse och minskad mental belastning.

Skalbarhet och effektivitet: Omformulering gör att system kan hantera olika användargrupper med varierande ordförråd, expertisnivåer och språkbakgrund. En enda omformuleringsmotor kan betjäna användare över olika domäner och språk, vilket förbättrar systemets skalbarhet utan motsvarande infrastrukturökning.

Kontinuerlig förbättring och inlärning: Omformuleringssystem kan tränas på användardata och kontinuerligt förbättra sina strategier baserat på vilka omformuleringar som leder till lyckade resultat. Detta skapar en positiv cirkel där systemet blir bättre ju mer användardata som samlas in.

Domänanpassning och specialisering: Omformuleringstekniker kan finjusteras för specifika domäner (medicinskt, juridiskt, tekniskt) genom träning på domänspecifika frågepar och inkorporering av domänontologier. Detta gör att specialiserade system kan hantera domänterminologi med större precision än generiska metoder.

Robusthet mot frågevariationer: System blir motståndskraftiga mot stavfel, grammatiska fel och vardagligt språk genom att omformulera frågor till standardiserade former. Denna robusthet är särskilt värdefull för röstbaserade gränssnitt och mobilsök där inmatningskvaliteten varierar mycket.

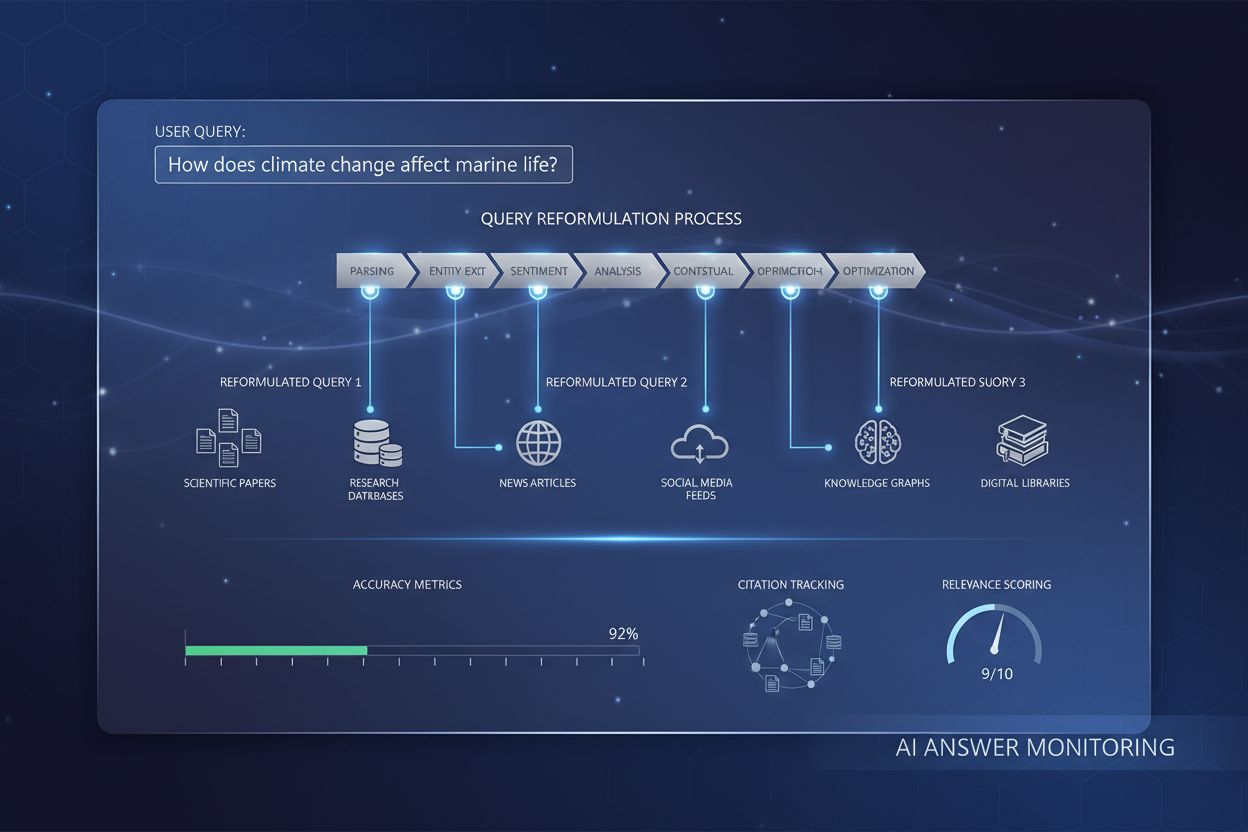

Omformulering av frågor spelar en avgörande roll för noggrannheten och tillförlitligheten i AI-genererade svar, vilket gör den central för AI-svarsövervakningsplattformar som AmICited.com. När AI-system omformulerar frågor innan svar genereras påverkar kvaliteten på dessa omformuleringar direkt om AI hämtar lämpligt källmaterial och ger exakta, välciterade svar. Dåligt omformulerade frågor kan få AI-system att hämta irrelevanta dokument, vilket leder till svar utan korrekt grund eller med felaktiga källhänvisningar. I kontexten av AI-övervakning och citeringsspårning är förståelse för hur frågor omformuleras avgörande för att verifiera att AI-system faktiskt besvarar användarens ursprungliga fråga och inte en förvrängd tolkning. AmICited.com spårar hur AI-system omformulerar frågor för att säkerställa att de källor som anges i AI-genererade svar verkligen är relevanta för användarens ursprungliga fråga och inte bara för en feltolkad omformulering. Denna övervakningskapacitet är särskilt viktig eftersom omformulering sker osynligt för slutanvändare—de ser bara slutgiltigt svar och källhänvisningar utan vetskap om hur frågan transformerades. Genom att analysera omformuleringsmönster kan AI-övervakningsplattformar identifiera när AI genererar svar baserade på omformuleringar som avviker kraftigt från användarens avsikt och flagga potentiella noggrannhetsproblem innan de når användaren. Dessutom hjälper förståelse för omformulering plattformar att bedöma om AI-system hanterar tvetydiga frågor på rätt sätt genom att skapa flera omformuleringar och syntetisera information från dem, eller om de gör obefogade antaganden om användarens avsikt.

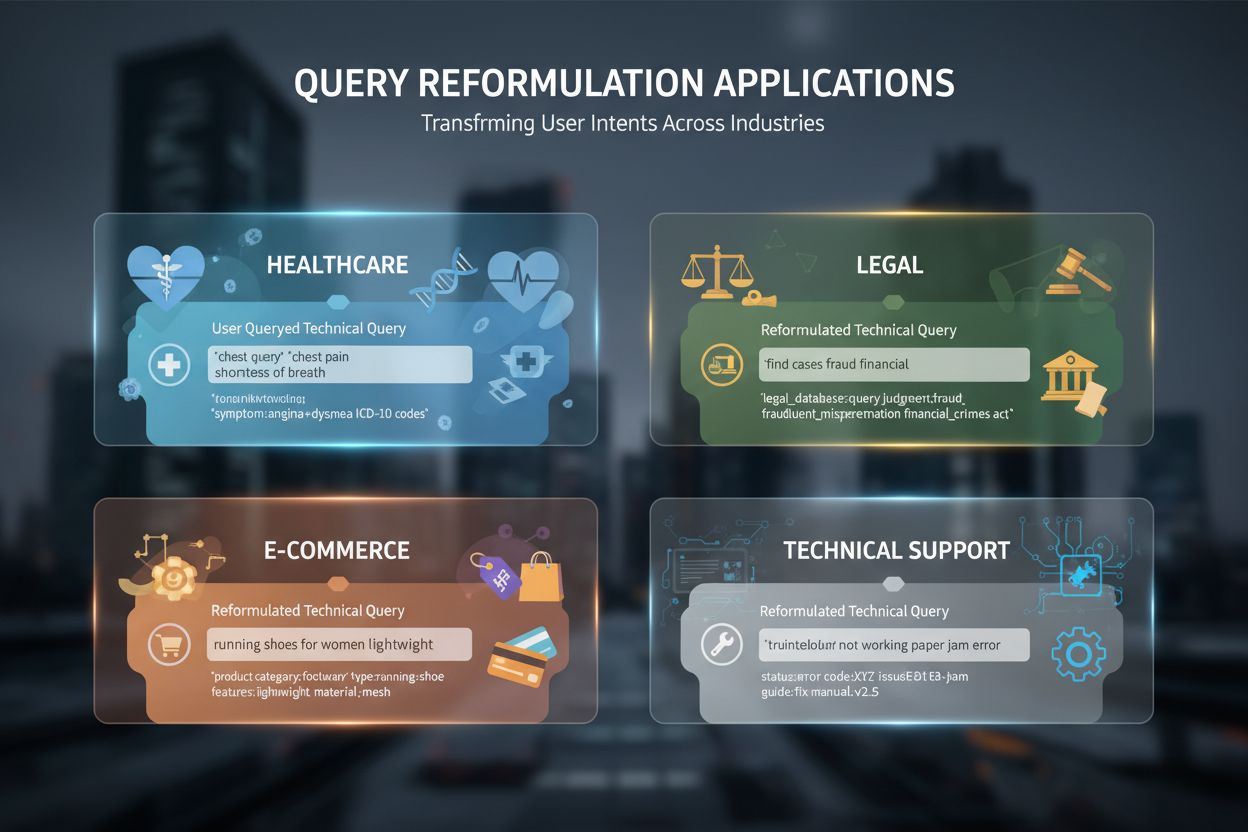

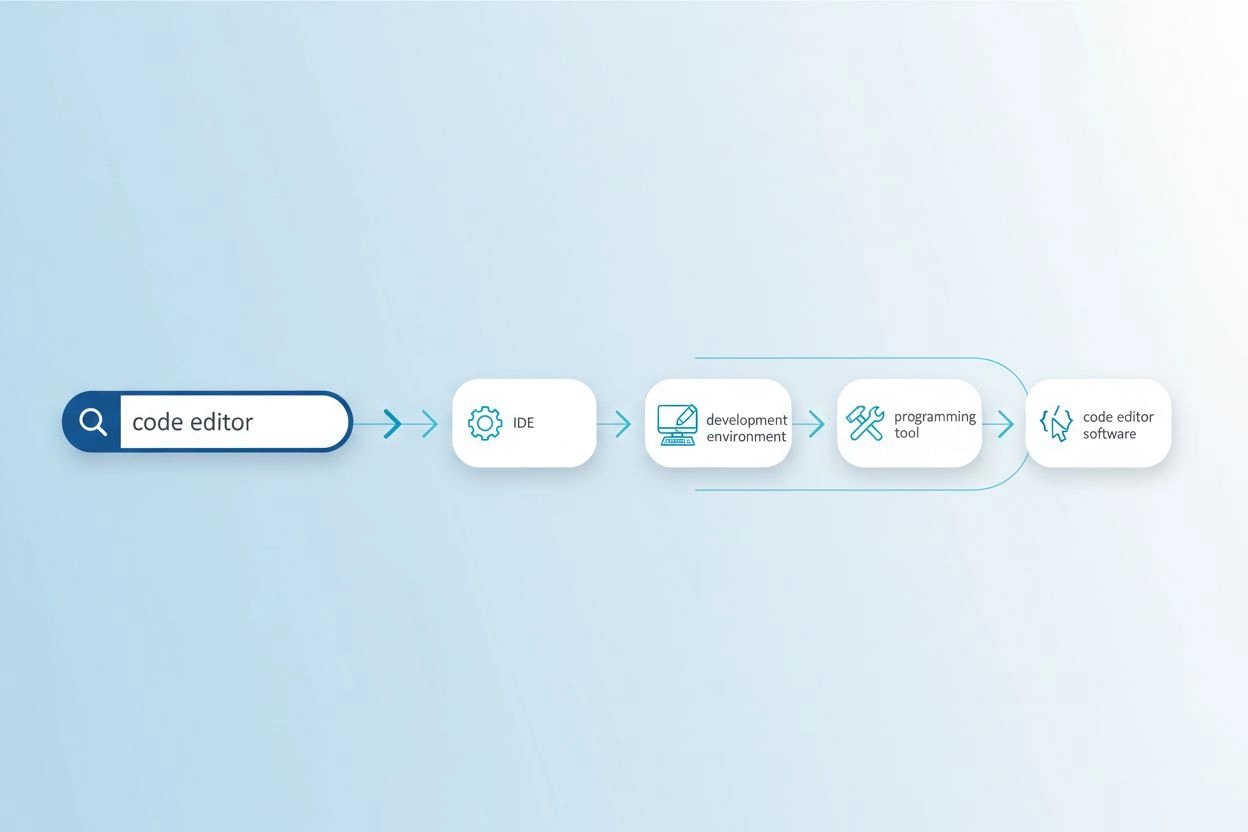

Omformulering av frågor har blivit oumbärlig i många AI-drivna applikationer och branscher. Inom hälso- och sjukvård och medicinsk forskning hanterar omformulering komplexiteten i medicinsk terminologi där patienter kan söka på “hjärtinfarkt” medan den kliniska litteraturen använder “myokardinfarkt”—omformulering överbryggar detta vokabulärgap för att hämta kliniskt korrekt information. Juridiska dokumentsystem använder omformulering för att hantera det exakta, ofta ålderdomliga språket i juridiska dokument samtidigt som moderna söktermer tillgodoses, så att jurister hittar relevanta prejudikat oavsett hur de formulerar sina frågor. Tekniska supportsystem omformulerar användarfrågor för att matcha kunskapsdatabasen och omvandlar vardagliga beskrivningar av problem (“min dator är långsam”) till tekniska termer (“systemprestandaförsämring”) för att hitta lämpliga felsökningsguider. E-handelsoptimering av sökningar använder omformulering för att hantera produktsökningar där användare söker “löparskor” medan katalogen använder “träningsskor” eller specifika varumärken, så att kunder hittar rätt produkter trots terminologisk skillnad. Konversations-AI och chattbottar använder omformulering för att bibehålla kontext i flerstegskonversationer och omformulerar följdfrågor för att inkludera implicit kontext från tidigare utbyten. Retrieval-Augmented Generation (RAG)-system är starkt beroende av omformulering för att säkerställa att hämtade kontextdokument verkligen är relevanta för användarens fråga och därmed direkt påverkar kvaliteten på genererade svar. Till exempel kan ett RAG-system som besvarar “Hur optimerar jag databasfrågor?” omformulera till flera varianter som “databasfrågeprestandaoptimering”, “SQL-optimeringstekniker” och “frågeexekveringsplaner” för att hämta omfattande kontext innan ett detaljerat svar genereras.

Trots sina fördelar innebär omformulering av frågor flera betydande utmaningar som praktiker måste hantera noggrant. Beräkningsmässig komplexitet ökar avsevärt när flera omformuleringar genereras och rangordnas efter relevans—varje omformulering kräver bearbetning och systemen måste balansera kvalitetsförbättringar mot svarstid, särskilt i realtidsapplikationer. Kvaliteten på träningsdata avgör direkt omformuleringens effektivitet; system tränade på bristfälliga frågepar eller partiska dataset kommer att förstärka dessa bias i sina omformuleringar och riskera att förvärra problemen istället för att lösa dem. Risk för överomformulering finns när systemet skapar så många varianter att de tappar fokus på ursprunglig avsikt och hämtar alltmer irrelevanta resultat. Domänspecifik anpassning kräver betydande insatser—modeller tränade på allmänna webbfrågor fungerar ofta dåligt på specialiserade områden som medicin eller juridik utan omfattande omträning och domänanpassning. Precision kontra återhämtningsbalans innebär en grundläggande kompromiss: aggressiv frågeutvidgning ökar återhämtning men kan minska precision genom att hämta irrelevanta resultat, medan försiktig omformulering bibehåller precision men missar relevanta dokument. Potentiell biasintroduktion kan ske när omformuleringssystemen kodar in samhälleliga bias från träningsdata, vilket riskerar att förstärka diskriminering i sökresultat eller AI-svar—till exempel kan omformulering av “sjuksköterska”-frågor oproportionerligt hämta kvinnligt associerade resultat om träningsdata återspeglar historiska könsbias.

Omformulering av frågor fortsätter att utvecklas snabbt i takt med AI:s framsteg och nya tekniker. Framsteg inom LLM-baserad omformulering möjliggör mer sofistikerade, kontextmedvetna frågeomvandlingar i takt med att stora språkmodeller bättre kan förstå nyanserad användaravsikt och skapa naturliga, semantiskt rika omformuleringar. Multimodal AI-integration kommer att utvidga omformulering från text till att även hantera bilder, ljud och video, där visuella frågor omformuleras till textbeskrivningar som går att söka på. Personalisering och inlärning kommer att möjliggöra att omformuleringssystem anpassar sig till varje användares preferenser, vokabulär och sökmönster, vilket ger alltmer personliga omformuleringar som speglar användarens unika stil. Realtidsanpassad omformulering gör det möjligt för system att omformulera frågor dynamiskt baserat på mellanresultat, med återkopplingsslingor där initiala omformuleringar påverkar efterföljande förbättringar. Kunskapsgrafsintegration gör att systemen kan utnyttja strukturerad kunskap om entiteter och relationer och skapa mer semantiskt precisa omformuleringar grundade i explicita kunskapsrepresentationer. Framväxande standarder för utvärdering och benchmarking av omformulering kommer att underlätta jämförelser mellan system och driva kvalitets- och konsekvensförbättringar i hela branschen.

Omformulering av frågor är den bredare processen att omvandla en fråga för att förbättra informationssökning, medan utvidgning av frågor är en specifik teknik inom omformulering där synonymer och relaterade termer läggs till. Utvidgning fokuserar på att bredda sökomfånget, medan omformulering omfattar flera tekniker inklusive tolkning, entitetsutvinning, sentimentanalys och kontextuell berikning för att grundläggande förbättra frågekvaliteten.

Omformulering av frågor hjälper AI-system att bättre förstå användarens avsikt genom att förtydliga tvetydiga termer, lägga till kontext och skapa flera tolkningar av den ursprungliga frågan. Detta leder till hämtning av mer relevanta källdokument, vilket i sin tur gör att AI kan generera mer exakta och välgrundade svar med korrekta källhänvisningar.

Ja, omformulering av frågor kan fungera som ett säkerhetslager genom att standardisera och sanera användarinmatningar innan de når huvud-AI-systemet. En specialiserad omformuleringsagent kan upptäcka och neutralisera potentiellt skadliga inmatningar, filtrera misstänkta mönster och omvandla frågor till säkra, standardiserade format som minskar risken för prompt injection-attacker.

I Retrieval-Augmented Generation (RAG)-system är omformulering av frågor avgörande för att säkerställa att hämtade kontextdokument verkligen är relevanta för användarens fråga. Genom att omformulera frågor till flera varianter kan RAG-system hämta mer omfattande och varierad kontext, vilket direkt förbättrar kvaliteten och noggrannheten på genererade svar.

Implementering innebär vanligtvis att välja lämpliga tekniker för ditt användningsområde: använd synonymbaserad utvidgning med BERT eller Word2Vec för semantisk likhet, tillämpa transformermodeller som T5 eller GPT för neurala omformuleringar, införliva domänspecifika ontologier för specialiserade områden och implementera feedbackloopar för att kontinuerligt förbättra omformuleringar baserat på användarinteraktioner och framgångsmått för hämtning.

Beräkningskostnaderna varierar beroende på teknik: enkel synonymutvidgning är lättviktig, medan transformerbaserad omformulering kräver betydande GPU-resurser. Genom att använda mindre specialiserade modeller för omformulering och större modeller endast för slutlig svarsgenerering kan kostnaderna optimeras. Många system använder caching och batchbearbetning för att fördela beräkningskostnader över flera frågor.

Omformulering av frågor påverkar citeringsnoggrannheten direkt eftersom den omformulerade frågan avgör vilka dokument som hämtas och citeras. Om omformuleringen avviker avsevärt från den ursprungliga användaravsikten kan AI:n citera källor som är relevanta för den omformulerade frågan snarare än för den ursprungliga frågan. AI-övervakningsplattformar som AmICited spårar dessa omvandlingar för att säkerställa att källhänvisningarna verkligen är relevanta för vad användaren faktiskt frågade.

Ja, omformulering av frågor kan förstärka befintliga bias om träningsdata återspeglar samhälleliga fördomar. Till exempel kan omformulering av vissa frågor oproportionerligt hämta resultat kopplade till specifika demografier. För att motverka detta krävs noggrann urval av dataset, biasdetekteringsmekanismer, varierade träningsexempel och kontinuerlig övervakning av omformuleringsresultat för rättvisa och representativitet.

Omformulering av frågor påverkar hur AI-system förstår och citerar ditt innehåll. AmICited spårar dessa omvandlingar för att säkerställa att ditt varumärke får korrekt attribution i AI-genererade svar.

Lär dig hur Förutseende av Frågor hjälper ditt innehåll att fånga utökade AI-konversationer genom att ta upp uppföljande frågor. Upptäck strategier för att iden...

Lär dig om AI-frågemönster – återkommande strukturer och formuleringar som användare använder när de ställer frågor till AI-assistenter. Upptäck hur dessa mönst...

Lär dig hur optimering av förfrågningsutvidgning förbättrar AI-sökningsresultat genom att överbrygga vokabulärsgap. Upptäck tekniker, utmaningar och varför det ...