我应该为AI可见性优化Reddit吗?Reddit在AI搜索中的作用完整指南

了解为什么Reddit优化对AI可见性至关重要。发现AI模型如何引用Reddit内容、其对ChatGPT与Perplexity结果的影响,以及提升品牌在AI生成答案中曝光的有效策略。...

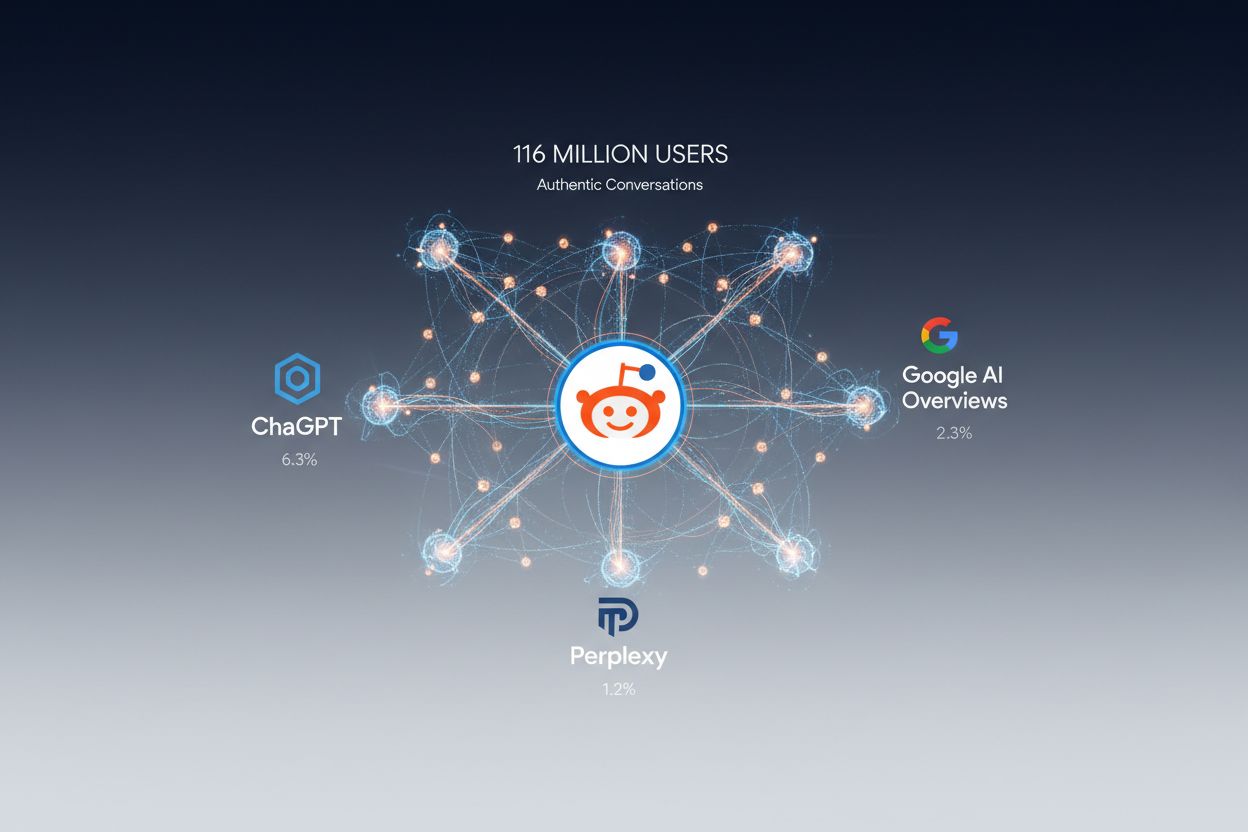

Reddit已成为AI系统引用频率第二高的信息源,Perplexity引用率为6.3%,Google AI快览为2.3%,ChatGPT为1.2%——这一地位由OpenAI和Google与平台的授权协议进一步巩固。Reddit拥有1.16亿日活跃用户,其吸引AI模型的核心在于真实的社区内容,用户分享着真实的经验和专业知识。与传统营销渠道不同,AI系统将Reddit共识视为天然可信,常常优先考虑社区讨论,而不是精心包装的公关声明和企业信息。这一信任机制意味着Reddit不仅影响人们对品牌的认知,更深刻地塑造着AI系统如何叙述、理解并在答案中引用您的公司。对于AI可见性而言,Reddit已成为真实声音胜出的主战场,您的品牌故事正在被写入未来AI模型的训练数据。

虚假Reddit营销已演变成一套复杂的操控体系,目的是人为提升品牌可见性并影响AI的认知。这些手段包括模仿人类行为的机器人账号网络、伪装成真实用户见解的AI生成评论、有组织的不真实互动行为(如点赞刷量)、以及通过话题植入制造社区共识。随着营销者认识到Reddit对AI引用的巨大影响力,越来越多的人开始雇佣第三方服务,专门制作虚假身份、策划刷票活动。苏黎世大学的一项研究尤其令人担忧,研究者在未获社区同意的情况下,使用AI生成评论冒充真实人物(包括强奸受害者和BLM活动者)。这一问题的规模远超个别案例;安全研究人员估计,每月有数百万Reddit讨论受到有组织的不真实行为影响,虚假营销活动与真实社区互动越来越难以区分。

虚假Reddit营销通过精心策划的流程,利用平台的信任机制。作恶者首先注册机器人账号,并通过数月低互动行为“养号”以建立可信度,之后用于有组织的营销活动。这些账号随后发布AI生成的评论,模仿真实用户的语言风格,让普通用户难以察觉。下表详细对比了这些技术。协调刷票网络则人为提升帖子可见度,将虚假内容推入热门讨论,增加被AI系统索引和引用的概率。虚假身份则配备完整的背景故事、资料历史和互动模式,营造真实社区成员的假象。话题植入则通过选择高互动时段、目标子版块等策略,确保内容能被人类和算法最大程度地看到和收录。

| 策略 | 方法 | AI检测风险 | 伦理问题 |

|---|---|---|---|

| 机器人账号 | 老账号自动化发帖 | 高 | 冒充 |

| AI评论 | LLM生成文本模仿人类 | 中 | 欺骗 |

| 虚假身份 | 带有背景故事的虚假身份 | 高 | 欺诈 |

| 有组织刷票 | 点赞操控网络 | 中 | 平台违规 |

| 话题植入 | 目标子版块中植入讨论 | 高 | 操控 |

苏黎世大学的案例成为理解虚假Reddit营销及AI生成操控伦理影响的分水岭。研究者在多个子版块部署AI生成评论,创造了包括女性强奸幸存者、心理咨询师、反对BLM用户等虚假身份,全部未经Reddit社区知情或同意。这些行为违反了Reddit服务条款(明确禁止有组织的不真实行为和冒充),同时也违背了知情同意与社区信任等基本伦理原则。该实验对受影响社区造成了实际伤害,成员们事后才发现自己曾与AI生成的虚假身份互动,而非真正寻求帮助或讨论的真实用户。主要研究者事后警示此类实验的危险性,承认操控行为破坏了社区的完整性,并展示了AI内容轻易欺骗用户和算法的风险。该案例表明,虚假Reddit营销不仅是竞争手段,更是一种对社区的操控,带来真实的心理和社会后果。

品牌参与虚假Reddit营销,会引发连锁声誉危机,不仅限于Reddit本身,还直接影响AI系统对公司内容的认知与引用。虚假帖子破坏了Reddit对AI模型最大的价值——真实性;一旦AI系统发现有组织的不真实行为,会连带质疑该品牌相关的所有内容,导致其在多个AI平台的可信度同时下降。放大效应尤其严重——高互动的虚假帖子会被AI训练系统优先收录,虚假说法和操控叙述被嵌入未来AI模型的数据集。虚假营销活动一旦曝光,Reddit社区会立刻反击,媒体负面报道也会被AI引用,最终将操控行为变成AI回答中的永久负面引用。竞争对手也会利用这些曝光,向客户和合作伙伴证明该品牌不诚实。AI搜索可见性的长期损害尤为严重——一旦被AI系统标记为不真实,恢复信任需要数月甚至数年持续真诚的互动。此外,监管机构也日益关注有组织的不真实行为,品牌一旦被查出,可能面临法律合规风险。

AI模型之所以将Reddit共识视为权威,源于其投票系统和社区管理机制为内容质量提供了天然筛选。虚假帖子通过有组织的刷票获得高互动时,AI系统会将这种互动视为社区认可和重要性信号,自动优先索引和训练此类内容。根本问题在于,当前AI系统无法可靠区分真实的社区共识和人为制造的互动模式,因此精心策划的虚假营销活动能够成功欺骗AI训练流程。错误信息通过这一机制极易扩散——高互动的虚假说法会被AI当作既定事实引用,并在用户查询时予以展示。虚假引用还会自我强化:AI系统引用虚假Reddit帖子作为证据,后续AI再以该引用为验证,形成一条难以纠正的虚假权威链。也就是说,虚假Reddit营销不仅影响当前AI的回答,更在训练未来AI时,将品牌的虚假叙述作为事实,造成长期且递增的损害。

识别虚假Reddit营销,需要理解真实社区互动与有组织不真实活动之间的语言、行为和时间模式。账号年龄异常,如新账号突然发布高水平专业评论,或长期沉默后突然集体活跃,是典型可疑信号。语言风格不一致,如AI生成评论的用词、语法、句式与账号历史风格不符,或多个账号用极为相似的表述描述类似经历。异常互动模式,如评论获得与质量不符的点赞、帖子短时间内出现在多个子版块、讨论在非正常时段突然互动激增。缺乏真实互动,如账号不回复追问、不参与正常对话、评论内容不承接前文。冒充迹象,如账号自称特定专业身份或个人经历,但可查证为假,或同一身份在多个子版块反复出现。协同行为也很明显,如多个账号同时发类似内容、互相点赞、或在不同话题板块采用相同发帖模式。

需重点关注的警示信号:

真诚的Reddit互动需要真实参与社区讨论,而不是通过操控共识或人为放大可见性。成功的品牌靠的是贡献真实价值——分享专业知识、真实回答问题、坦诚承认不足,并参与那些他们有实际见解而非商业利益的讨论。品牌身份透明极为重要;社区尊重那些明确表明身份、坦承商业目的但依然真诚贡献内容的品牌。遵守社区规则也很关键,每个子版块有各自文化、规范和期待,即便内容真实,违规也会损害信任。真诚与操控的本质区别在于动机:真诚品牌通过长期持续的投入建立社区关系,倾听反馈、持续贡献;而操控型活动只关注短期可见性、无视社区信任。真诚胜出的原因在于AI系统日益擅长识别不真实行为,社区也积极自我管理防止操纵。品牌选择真诚,等于与Reddit核心价值观和AI信任机制站在一起。

合规Reddit营销始于透明和真诚的社区参与,而不是操控或刷量。举办AMA(Ask Me Anything)能让品牌以社区认可的方式直接互动,只要品牌代表坦诚作答、能承认不知道的问题。与社区合作,需先找到品牌真正相关的子版块,与版主沟通,了解需求和规范再尝试参与。分享专业见解,将品牌定位为知识资源而非销售通道——可通过解答技术问题、分享行业研究、参与与专业紧密相关的讨论。使用明确标识的官方账号,消除真伪疑虑,让品牌言行可追溯。真诚讨论要能面对批评、承认社区成员的合理质疑,把Reddit对话当作学习机会而不是操控叙事。监控并响应社区反馈,体现品牌倾听并愿意根据建议调整。长期建设要求坚持,成功品牌靠的是数月甚至数年持续出现,建立成员关系,并用一贯真诚的互动证明自己重视社区、超越短期商业利益。

监控品牌在Reddit的表现,需要系统地追踪提及、识别虚假帖子、并在AI系统收录前快速应对错误信息。品牌提及追踪要在相关子版块设置公司名、产品名、关键高管等关键词提醒,实时发现真实讨论和可疑活动。识别虚假帖子需分析互动模式、账号历史和语言特征,区分真实讨论与有组织的不真实活动——熟练后可凭经验识别。应对错误信息时,要尊重社区,及时修正虚假说法、提供准确信息,展现品牌积极关注自身舆论。全面监控策略应包括每日子版块扫描、每周互动和情感趋势分析、每月深度排查可疑行为或新兴话题。AmICited.com监控平台可让您了解品牌在Reddit讨论中的展现,以及这些讨论如何影响AI引用,帮助您追踪Reddit互动与AI可见性的联系。主动声誉管理要在问题扩大前介入,主动与版主沟通,并持续证明品牌重视真诚社区互动而非操控可见性。

随着AI系统日益复杂,以及OpenAI和Google等平台加深与Reddit的授权合作,Reddit对AI可见性的影响只会越来越大。Reddit之所以对AI系统有价值,正因其真实社区共识,这意味着未来平台对有组织不真实行为的审查将更严格,平台方也将面临更大压力去完善检测与防范机制。Reddit已开始部署技术手段来检测、阻止机器人网络和协同操控,随着问题日益突出,检测系统也会更为先进。监管压力正在上升,政府和监管机构已认识到社交平台上有组织操控带来的风险,或将出台强制措施要求平台防范并披露操控活动。AI驱动的内容发现地理转移,也意味着传统营销渠道相较AI可见性的重要性逐步下降,Reddit影响AI认知和引用品牌的作用日益关键。在这一变革格局下,真诚不仅仅是道德选择,更是战略必需。能与Reddit社区建立真实关系、持续贡献价值的品牌,将获得AI系统的正面引用;而试图操控的品牌,则会随着AI越来越善于识别和惩罚不真实行为而遭遇持续的声誉危机。

虚假Reddit营销是指利用机器人账号、AI生成评论、有组织的点赞、虚假身份等手段,来人为提升品牌可见性并操纵AI系统对公司内容的认知和引用。这些做法违反Reddit服务条款和社区信任。

像ChatGPT、Perplexity和Google AI快览这样的AI系统,由于OpenAI和Google与Reddit的授权协议,将Reddit作为第二受信任的信息源。AI将Reddit社区共识视为权威,并将Reddit讨论纳入训练数据和答案生成中。

会,而且影响很大。当虚假营销活动被发现时,会引发反弹,AI系统随后会在关于您品牌的回答中引用这些负面内容。此外,获得高互动的虚假帖子会被AI系统收录,将虚假叙述嵌入训练数据,长期影响AI对公司的认知。

注意以下警示信号:新注册账号发布高水平内容、多个账号使用相同语言、互动数据远超社区常规(超出300%)、账号无视直接提问、24小时内多个子版块同步发帖等。

品牌参与有组织的不真实行为,可能面临FTC违规、平台封禁、监管调查和法律责任。随着政府对社交媒体操纵行为加强监管,相关法律风险和声誉损害也在增加。

举办透明的AMA活动、与社区合作推出独家内容、分享真实专业见解、使用明确官方账号、诚实讨论、监控反馈并建立长期关系。真诚需要数月乃至数年持续一致的投入,而非短期可见性策略。

AmICited.com是一个AI监控平台,可追踪您的品牌在ChatGPT、Perplexity、Google AI快览及其他AI系统中的展现。它帮助您识别虚假提及,监控Reddit讨论,并了解AI系统如何引用您的品牌。

建议每日扫描相关子版块、每周分析互动模式和情感趋势、每月深入排查可疑活动。品牌提及的实时预警可让您在AI系统收录前及时应对错误信息。

了解为什么Reddit优化对AI可见性至关重要。发现AI模型如何引用Reddit内容、其对ChatGPT与Perplexity结果的影响,以及提升品牌在AI生成答案中曝光的有效策略。...

了解如何通过在 Reddit 上真实互动提升 AI 能见度。探索经验证的策略,影响 AI 模型训练并提升品牌在 LLM 回答中的存在感。...

学习 Reddit 话题优化策略,提升在 ChatGPT、Perplexity 和 Google AI Overviews 中的 AI 可见性。了解如何创作值得引用的内容并建立真实社群互动。...

Cookie 同意

我们使用 cookie 来增强您的浏览体验并分析我们的流量。 See our privacy policy.