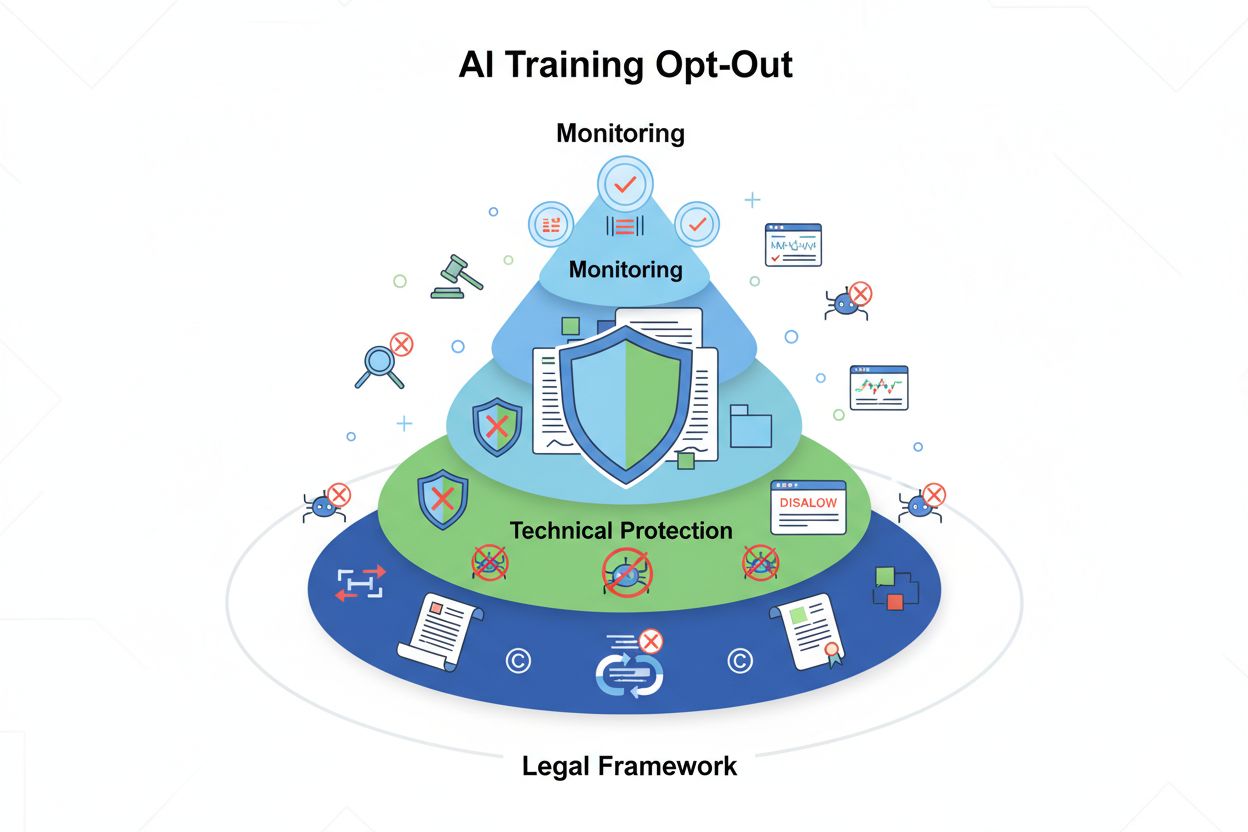

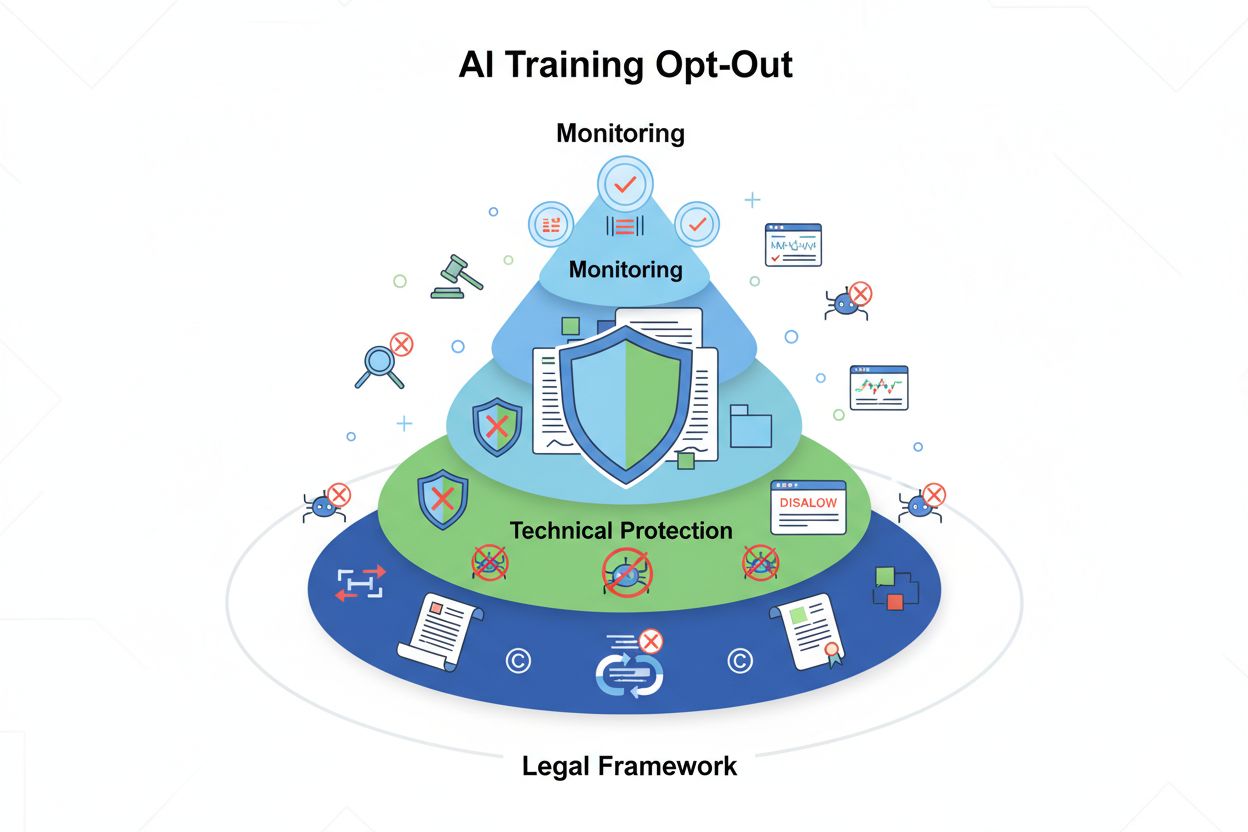

AI训练选择退出

了解AI训练选择退出机制,包括robots.txt、法律框架和保护内容免遭LLM训练数据集未经授权使用的最佳实践。

全面指南,教你如何在 ChatGPT、Perplexity、LinkedIn 及其他平台选择退出 AI 训练数据收集。一步步了解如何保护您的数据不被用于 AI 模型训练。

在大多数主流平台上,您可以通过访问账户设置并关闭数据收集选项来选择不参与 AI 训练。对于网站,可通过 robots.txt 文件阻止 AI 爬虫。不同平台方法不同——ChatGPT、Perplexity 和 LinkedIn 提供直接开关,其他平台则需邮件申请或删除内容。

AI 训练是指人工智能公司通过收集大量来自互联网和用户互动的数据,以提升其语言模型和 AI 系统的过程。当你使用如 ChatGPT、Perplexity 或社交媒体平台时,你的对话、帖子以及互动内容通常会被自动收集并用于训练这些 AI 模型。在大多数平台,这一行为是默认开启的,也就是说,除非你主动选择退出,否则你的数据会在你未明确同意的情况下被用于提升 AI 系统。被收集的数据可能包括你的搜索请求、对话记录、上传的文件,以及你在使用服务时分享的个人信息。

了解这一过程非常重要,因为AI 训练数据直接影响 AI 模型的学习和表现。企业普遍认为,数据收集有助于打造更准确、更有用的 AI 系统。然而,许多用户对于自己的个人信息、创作内容或敏感商业数据在未获补偿或明确许可的情况下被使用,存在合理的隐私担忧。好消息是,大多数主流平台现在都提供了选择退出的方式,尽管不同服务的具体流程差异较大。

OpenAI 的 ChatGPT 是最广泛使用的 AI 服务之一,该公司默认收集用户数据以改进模型。如果你在未登录账户的情况下使用 ChatGPT,你的对话会被自动用于训练。但如果你有账户,可以通过简单的步骤关闭此项数据收集。

要在 ChatGPT 退出数据收集,首先登录你的账户(chatgpt.com),在屏幕右上角找到你的个人头像,点击进入菜单后,选择设置。进入设置菜单后,找到数据控制(Data Controls)部分,这里包含了你账户所有隐私相关设置。在此部分,你会看到一个名为**“为所有人提升模型”的选项——它控制 OpenAI 是否使用你的对话进行训练。只需将此开关切换到“关闭”**,即可防止你的后续对话被用于 AI 训练。

对于 OpenAI 的 DALL-E 图像生成器,公司提供了专门的表单来申请将图像移出训练数据集。如果你希望移除自己用 DALL-E 创作的图像,可在 OpenAI 网站填写表单,提交你的姓名、邮箱、图像所有权确认及相关图像说明。若需大批量移除图像,OpenAI 建议你在网站 robots.txt 文件中添加 GPTBot,这样更高效。

| 平台 | 退出方法 | 难易程度 | 有效性 |

|---|---|---|---|

| ChatGPT | 设置 > 数据控制 > 关闭开关 | 简单 | 高 |

| DALL-E | 提交移除表单 | 中等 | 高 |

| Perplexity | 账户设置 > AI 数据保留 | 简单 | 高 |

| 专用设置页面 | 简单 | 高 | |

| X(推特) | Grok 设置页面 | 简单 | 高 |

Perplexity AI 是一款 AI 驱动的搜索引擎,会使用你的互动行为来优化模型。和 ChatGPT 类似,Perplexity 默认会收集你的搜索请求和对话历史,用于优化其搜索算法并持续改进答案。如果你不希望自己的搜索行为被追踪并用于训练,Perplexity 提供了直接的退出机制。

要关闭 Perplexity 的数据收集,登录你的账户,进入账户设置。在设置菜单中,找到 “AI 数据保留”(AI Data Retention)开关。这个选项控制 Perplexity 是否保留你的输入和搜索请求用于训练。将此开关关闭,即可防止平台保留你的数据用于模型优化。需要注意的是,此设置只适用于未来的互动——在关闭前已收集的数据,平台仍可能用于训练。

在社交媒体平台上,选择退出 AI 训练的方式更为复杂。LinkedIn(微软旗下)已在用户数据控制方面取得进展,允许用户选择不让自己的帖子和职业信息被用于训练 AI 模型。你可前往 LinkedIn 的数据偏好设置页面,关闭“用于 AI 改进”的选项。对于在平台上分享专有信息、商业战略或机密内容的专业人士来说,这一设置尤为重要。

Meta 旗下平台(Facebook 和 Instagram)目前尚无直接开关可供选择退出 AI 训练。相反,Meta 要求用户通过帮助中心提交正式申请,声明你不希望数据被用于 AI 训练。但 Meta 的处理流程相较其他平台更不透明。该公司表示会用用户数据改进 AI 系统(包括生成式 AI 功能),但无法保证你的退出申请会立即或完全生效。

X(原推特) 推出了 Grok AI 模型,并收集用户数据进行训练。不过,X 提供了专用设置页面,你可关闭将你的帖子用于 Grok AI 训练。在设置与隐私中,找到 Grok 标签,取消数据共享选项,即可防止你的推文和互动被用于训练 Grok,但 X 可能仍会将你的数据用于其他用途。

如果你运营网站或博客,还有额外工具可以防止AI 爬虫抓取你的内容用于训练。最常见的方法是使用 robots.txt 文件,它是放置在网站根目录的一个简单文本文件,用于指示网页爬虫哪些页面可以访问、哪些不能访问。它既适用于搜索引擎机器人,也适用于 AI 爬虫。

要屏蔽 OpenAI 的 GPTBot 爬虫,在你的 robots.txt 文件中添加如下内容:

User-agent: GPTBot

Disallow: /

这样可告知 OpenAI 的爬虫禁止访问你网站的任何页面。同理,若想屏蔽 Google 的 AI 爬虫(Google-Extended,用于 Bard 和 Vertex AI 训练),可添加:

User-agent: Google-Extended

Disallow: /

你还可以一次性屏蔽多个 AI 爬虫,分别列出它们,或者用通配符屏蔽所有爬虫:

User-agent: *

Disallow: /

但需明白,robots.txt 仅为自愿遵守的标准。大多数正规 AI 公司和搜索引擎会遵守,但有些爬虫可能会无视规定,继续抓取你的内容。若需更强保护,请考虑为敏感内容设置密码保护、付费墙或登录限制。此外,像 WordPress.com、Substack、Squarespace 等平台也内置了屏蔽 AI 训练的选项,可在各自的设置面板中启用。

虽然大多数平台允许选择退出 AI 训练,但也存在若干重要限制。首先,退出通常只能阻止未来的数据收集——在你关闭设置前已被抓取或收集的数据,平台仍可能用于训练。这对已发布并被搜索引擎或 AI 公司索引的内容尤其适用。

其次,robots.txt 文件和平台退出设置不具法律约束力。部分 AI 公司或恶意爬虫可能选择无视这些指令,继续抓取内容。已被证实有些 AI 爬虫并不遵守 robots.txt,因此即使采取防护措施,你的内容仍有可能被用于训练。

第三,退出机制的有效性在各平台差别很大。如 OpenAI、LinkedIn 提供了清晰、易用的开关,而像 Meta 则需人工申请且结果不确定。此外,许多免费服务默认收集数据,退出功能可能仅对付费用户开放。

最后,国际法规会影响数据收集行为。身在欧盟的用户,因受 GDPR 及新出台的 欧盟 AI 法案保护,其个人数据被用于 AI 训练会受到更严格限制。而其他地区用户保护较弱,更需主动管理隐私设置。

为帮助你系统性地在多平台保护数据,以下是一份全面的操作清单:

除了选择退出 AI 训练,监控你的内容在 AI 生成答案中的呈现同等重要。即使你已退出训练,之前发布的内容仍有可能被 AI 答案引用或提及。因此,品牌监控对于企业和内容创作者来说尤为关键。

了解你的品牌、域名及网址在 ChatGPT、Perplexity、Google Gemini 等平台的 AI 答案中出现的位置,有助于你维护线上声誉,确保被正确引用。通过跟踪这些曝光,你可以及时发现内容被引用的机会,核实品牌展现的准确性,并在发现内容被误用或错误引用时采取相应措施。

了解AI训练选择退出机制,包括robots.txt、法律框架和保护内容免遭LLM训练数据集未经授权使用的最佳实践。

了解AI搜索的关键数据隐私要求。掌握GDPR合规、数据保护最佳实践,以及如何在AI系统中保护企业数据。

了解 ChatGPT 的训练数据来源、引用方式、知识截止日期,以及为什么监测 AI 引用对您的品牌至关重要。