AI 模型中的上下文窗口是什么

了解什么是 AI 语言模型中的上下文窗口,它们的工作原理、对模型性能的影响,以及它们为何对 AI 应用和监控至关重要。...

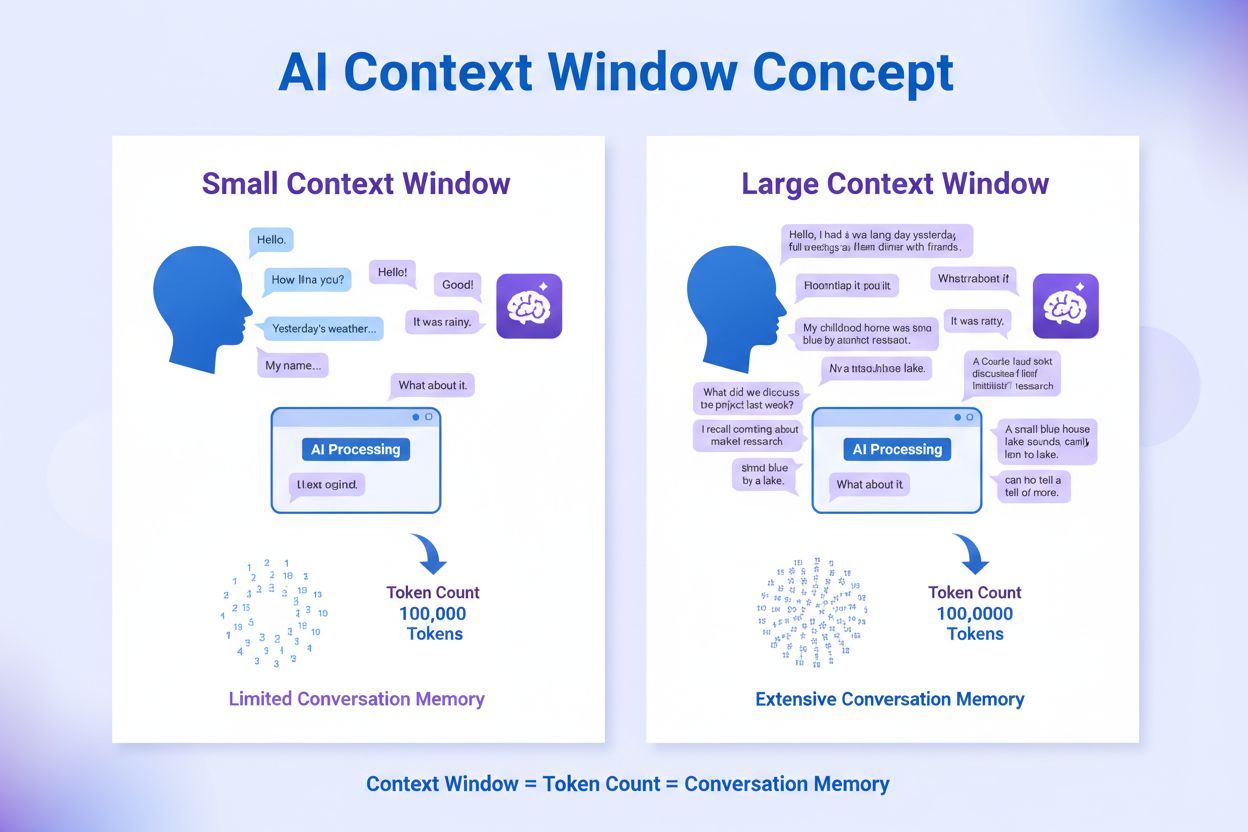

上下文窗口是大型语言模型在生成响应时一次能够处理和考虑的最大文本量(以 token 计量)。它决定了 LLM 在单次交互中能够保留和引用的信息量,直接影响模型在处理较长输入和对话时的连贯性、准确性和相关性。

上下文窗口是大型语言模型在生成响应时一次能够处理和考虑的最大文本量(以 token 计量)。它决定了 LLM 在单次交互中能够保留和引用的信息量,直接影响模型在处理较长输入和对话时的连贯性、准确性和相关性。

上下文窗口是大型语言模型一次能够同时处理和考虑的最大文本量(以 token 计量)。 可以把它看作 AI 系统的工作记忆——它决定了模型在某一时刻能“记住”并引用多少对话、文档或输入信息。上下文窗口直接限制了 LLM 无需截断或摘要即可处理的文档、代码样本和对话历史的规模。例如,如果模型的上下文窗口为 128,000 token,而你输入的文档有 150,000 token,模型就无法一次性处理全部内容,只能拒绝超出部分或依赖特殊技术来处理。理解上下文窗口对于使用现代 AI 系统至关重要,因为它影响从准确性、连贯性到计算成本,以及模型适用的实际场景。

要全面理解上下文窗口,首先需要了解分词是如何工作的。Token 是语言模型处理的最小文本单位——它可能代表单个字符、词的一部分、一个完整单词,甚至一个短语。单词与 token 的关系并不固定;在英文中,平均每个 token 约等于 0.75 个单词或 4 个字符。但这个比例会因语言、分词器和处理内容的不同而有很大差异。例如,代码和技术文档的分词效率往往低于自然语言文本,在相同的上下文窗口内会消耗更多 token。分词过程将原始文本拆分为这些可管理的单位,使模型能够学习语言元素之间的模式和关系。不同模型和分词器对同一段落的分词方式可能不同,因此即便两个模型声称 token 上限相同,实际可用的上下文窗口容量仍可能不同。这种差异也说明像 AmICited 这样的监测工具在追踪品牌提及和引用时,必须考虑不同 AI 平台的分词方式。

上下文窗口依赖 Transformer 架构的自注意力机制,这是现代大型语言模型的核心计算引擎。当模型处理文本时,会对输入序列中的每一个 token 之间的关系进行数学计算,判断每个 token 与其他 token 的相关性。这种自注意力机制让模型能够理解上下文、保持连贯性并生成相关响应。然而,这一过程有一个关键限制:计算复杂度随 token 数量呈二次方增长。如果你将上下文窗口的 token 数量加倍,模型计算所有 token 关系时所需的算力大约增加 4 倍。这种二次扩展导致扩展上下文窗口带来了显著的计算成本。模型必须为每对 token 存储注意力权重,需要大量内存资源。此外,随着上下文窗口增大,推理(即生成响应的过程)会变得越来越慢,因为模型需要将新生成的每个 token 与序列中之前的所有 token 计算关系。这也是实时应用中常常在窗口大小与响应延迟之间权衡的原因。

| AI 模型 | 上下文窗口大小 | 输出 Token | 主要应用场景 | 成本效率 |

|---|---|---|---|---|

| Google Gemini 1.5 Pro | 2,000,000 token | 不定 | 企业文档分析,多模态处理 | 计算成本高 |

| Claude Sonnet 4 | 1,000,000 token | 最多 4,096 | 复杂推理,代码库分析 | 中高成本 |

| Meta Llama 4 Maverick | 1,000,000 token | 最多 4,096 | 企业多模态应用 | 中等成本 |

| OpenAI GPT-5 | 400,000 token | 128,000 | 高级推理,智能代理流程 | 高成本 |

| Claude Opus 4.1 | 200,000 token | 最多 4,096 | 高精度编程,科研 | 中等成本 |

| OpenAI GPT-4o | 128,000 token | 16,384 | 视觉-语言任务,代码生成 | 中等成本 |

| Mistral Large 2 | 128,000 token | 最多 32,000 | 专业编程,企业部署 | 较低成本 |

| DeepSeek R1 & V3 | 128,000 token | 最多 32,000 | 数学推理,代码生成 | 较低成本 |

| 原始 GPT-3.5 | 4,096 token | 最多 2,048 | 基础对话任务 | 最低成本 |

上下文窗口大小的实际影响远超技术规格本身——它直接关系到业务成效、运维效率和成本结构。企业在文档分析、法律审查或代码库理解等场景中,受益于更大的上下文窗口,因为模型可以一次性处理整份文档,无需拆分成多个小块。这减少了复杂的预处理流程,并因保持完整文档上下文而提升准确率。例如,律师事务所分析 200 页合同时,可用 Claude Sonnet 4 的 100 万 token 窗口一次性审阅整个文件,而老旧的 4,000 token 模型则需拆成 50 余块再汇总结果——这很容易遗漏跨文档关系和上下文。然而,这种能力也带来了更高的计算资源需求,换言之,云服务 API 成本上升。OpenAI、Anthropic 等通常按 token 消耗计费,因此处理 10 万 token 的文档成本远高于 1 万 token。企业需要在全面上下文带来的价值与预算与性能的需求之间做出平衡。

尽管大窗口看似优势明显,研究发现存在重要限制:模型无法充分利用分散在长上下文各处的信息。2023 年 arXiv 发表的一项研究指出,LLM 在关键信息出现在输入序列开头或结尾时表现最佳,而当信息埋在长上下文中间时,性能大幅下降。这一现象被称为**“中间遗失”问题**,表明单纯扩大上下文窗口并不能带来成比例的性能提升。模型可能会变得“懒惰”,依赖认知捷径,未能全面处理所有可用信息。这对品牌监测和引用追踪等应用有深远影响。当 AmICited 监测 Perplexity、ChatGPT、Claude 等如何在响应中引用品牌时,品牌提及在上下文窗口中的位置会影响其是否被准确捕捉和引用。如果品牌名出现在长文档中间,模型可能忽略或降权,导致引用追踪不完整。科研人员开发了如 Needle-in-a-Haystack (NIAH)、RULER 和 LongBench 基准,用于衡量模型在大段落中查找和利用关键信息的能力,帮助企业理解实际表现而非理论窗口极限。

更大上下文窗口的最重要益处之一是有可能减少 AI 幻觉——即模型生成虚假或捏造信息。当模型能获取更多相关上下文时,响应更有据可依,不必仅依赖统计模式,减少出错。IBM 及其他机构的研究表明,扩大上下文窗口通常提升准确率、减少幻觉、输出更连贯。但这种关系并非线性,仅靠扩大窗口无法彻底消除幻觉。窗口内信息的质量与相关性和窗口大小同样重要。此外,增大上下文窗口也带来新的安全风险:Anthropic 的研究显示,增长上下文长度会提升模型对“越狱攻击”和对抗性提示的脆弱性。攻击者可将恶意指令深埋于长上下文中,利用模型对中间信息降权的倾向。对品牌引用监测而言,这意味着更大窗口有助于捕捉品牌提及的准确性,但若竞争对手或恶意方将虚假信息埋入长文档,AI 也可能被误导。

不同 AI 平台在上下文窗口的实现和权衡上各有策略。ChatGPT 的 GPT-4o 模型提供 12.8 万 token,兼顾通用任务的性能与成本。Claude 3.5 Sonnet(Anthropic 旗舰模型)近期从 20 万 token 扩展到 100 万,成为企业文档分析的领先者。Google Gemini 1.5 Pro 则突破到 200 万 token,可处理完整代码库和大规模文档集合。Perplexity 专注于检索与信息整合,利用上下文窗口在生成响应时融合多源信息。理解这些平台差异对AI 监测和品牌追踪至关重要,不同平台的窗口大小和注意力机制决定了品牌提及是否被深入引用。同一文档在 Gemini 的 200 万窗口下可能被引用,在小窗口模型中却被忽略。此外,各平台分词器不同,同一文档在不同平台消耗的 token 也不同。AmICited 在跨平台品牌监测时,必须考虑这些平台特定的上下文窗口行为。

AI 研究界提出了多种优化上下文窗口效率、突破理论极限的技术。**旋转位置编码(RoPE)**等方法改善了模型对远距离 token 的处理能力,提升长上下文任务表现。**检索增强生成(RAG)**系统通过动态检索外部数据库的相关信息,使模型实际可处理的信息量远超理论窗口。稀疏注意力机制通过只关注最相关的 token,减少了计算复杂度。自适应上下文窗口可根据输入长度自动调整窗口,节省资源。展望未来,上下文窗口的发展会继续扩展,但边际效益递减。Magic.dev 的 LTM-2-Mini 已可支持 1 亿 token,Meta 的 Llama 4 Scout 单卡可达 1,000 万 token。然而,业内对如此巨大的窗口是否真有实际需求存在争议。未来的突破点或许不是窗口本身,而在于提升模型对有效上下文的利用率,以及开发更高效的长上下文架构。

上下文窗口的演进对AI 引用监测与品牌追踪策略有深远影响。随着窗口扩大,AI 系统能在一次交互中处理更全面的品牌、竞品与行业信息。这意味着品牌提及、产品描述和竞争信息可被模型同时纳入考虑,带来更准确、更具上下文的引用。但同时,过时或错误的品牌信息也可能与最新信息一起被处理,导致 AI 响应混乱或失准。使用 AmICited 等平台的企业需调整监测策略,适应上下文窗口能力的变化。追踪不同窗口模型对品牌的引用频率,可揭示重要规律:窗口大者更容易捕捉品牌信息,窗口小者则可能遗漏。此外,随着窗口扩大,内容结构和信息布局的重要性也随之提升。品牌应关注自身内容在供 AI 处理的文档中的结构和位置,认识到埋在长文档中间的信息可能因“中间遗失”而被模型降权。这种战略性认知,使上下文窗口从纯技术参数转变为影响品牌可见度和引用准确性的业务关键因素,贯穿于 AI 搜索和响应系统。

Token 是 LLM 处理的最小文本单元,通常在英文中一个 token 大约代表 0.75 个单词或 4 个字符。相比之下,上下文窗口是模型一次能处理的 token 总数——本质上是容纳所有这些 token 的容器。如果说 token 是单独的构建块,那么上下文窗口就是你在任何时刻能用它们搭建的最大结构。

更大的上下文窗口通常会减少幻觉并提升准确性,因为模型在生成响应时有更多信息可供参考。然而,研究显示,当关键信息被埋在很长上下文的中间时,LLM 的表现反而变差——这被称为“中间遗失”问题。这意味着虽然更大的窗口有帮助,但信息在窗口中的位置和组织方式对输出质量有很大影响。

由于 Transformer 架构的自注意力机制,上下文窗口的复杂度会随着 token 数量呈二次方增长。当你将 token 数量加倍时,模型大约需要 4 倍的处理能力来计算所有 token 对之间的关系。这种指数级的算力需求直接带来更高的内存消耗、更慢的推理速度以及云端 AI 服务成本上升。

截至 2025 年,Google 的 Gemini 1.5 Pro 拥有商用最大上下文窗口,达到 200 万 token,其次是 Claude Sonnet 4 的 100 万 token 和 GPT-4o 的 12.8 万 token。不过,像 Magic.dev 的 LTM-2-Mini 等实验性模型已突破 1 亿 token。尽管窗口极大,实际应用中能有效利用的仅为其中一小部分。

上下文窗口大小直接影响 AI 生成响应时可参考的原始资料量。对于 AmICited 等品牌监测平台,理解上下文窗口至关重要,因为它决定了 AI 系统在决定是否引用或提及品牌时,能否处理完整的文档、网站或知识库。更大的窗口意味着 AI 可以同时考虑更多竞品信息和品牌引用。

部分模型支持通过如 LongRoPE(旋转位置编码)等方法扩展上下文窗口,但通常会带来性能上的权衡。此外,RAG(检索增强生成)系统可通过动态拉取外部相关信息,实质上扩展了可用上下文。然而,这些变通方案通常意味着更高的计算开销和复杂性。

不同语言因语言结构不同,分词效率也不同。例如,2024 年的一项研究发现,泰卢固语的译文所需 token 数比等量英文多出 7 倍,尽管字符更少。这是因为分词器通常针对英文和拉丁语系进行优化,非拉丁文字效率较低,导致多语言应用中的有效上下文窗口减小。

“中间遗失”问题指的是研究发现,当关键信息位于长上下文的中间时,LLM 的表现变差。模型在信息出现在输入开头或结尾时效果最佳。这说明即便上下文窗口很大,模型也不会均等充分利用所有可用信息,这对文档分析和信息检索任务有重要影响。

了解什么是 AI 语言模型中的上下文窗口,它们的工作原理、对模型性能的影响,以及它们为何对 AI 应用和监控至关重要。...

了解什么是对话上下文窗口,它如何影响AI回复,以及为何其对高效AI交互至关重要。掌握token、限制及实际应用。

社区讨论 AI 上下文窗口及其对内容营销的影响。了解上下文限制如何影响 AI 对您内容的处理。

Cookie 同意

我们使用 cookie 来增强您的浏览体验并分析我们的流量。 See our privacy policy.