Sådan fravælger du AI-træning på større platforme

Komplet guide til at fravælge indsamling af AI-træningsdata på tværs af ChatGPT, Perplexity, LinkedIn og andre platforme. Lær trin-for-trin instruktioner til at...

Lær hvordan du anmoder om rettelser fra AI-platforme som ChatGPT, Perplexity og Claude. Forstå rettelsesmekanismer, feedbackprocesser og strategier til at påvirke AI-genererede svar om dit brand.

Selvom du ikke direkte kan slette information fra AI's træningsdata, kan du anmode om rettelser gennem feedbackmekanismer, adressere unøjagtigheder ved kilden og påvirke fremtidige AI-svar ved at skabe autoritativt positivt indhold og samarbejde med platformens supportteams.

At anmode om rettelser fra AI-platforme kræver en forståelse af, hvordan disse systemer grundlæggende fungerer. I modsætning til traditionelle søgemaskiner, hvor du kan kontakte en hjemmesideejer for at få fjernet eller opdateret indhold, lærer AI-sproglige modeller fra træningsdata i bestemte træningsfaser, hvor de inkorporerer milliarder af websider, nyhedsartikler og tekstkilder. Når negativ eller unøjagtig information først er blevet del af disse træningsdata, kan du ikke direkte slette eller redigere det, som du kunne anmode en hjemmesideejer om. AI’en har allerede indlært mønstre og associationer fra flere kilder under sin træningscyklus.

Rettelsesprocessen er markant forskellig for statiske og realtidsbaserede AI-systemer. Statiske modeller som GPT-4 er trænet på data op til en specifik skæringsdato (for eksempel december 2023 for GPT-4-turbo), og når de først er trænet, fastholder de denne viden indtil næste træningscyklus. Realtids-AI-systemer som Perplexity og Claude.ai trækker live webindhold, hvilket betyder, at rettelser ved kilden kan have øjeblikkelig effekt på deres svar. Det er afgørende at forstå, hvilken type AI-platform du har med at gøre, for at kunne vælge den mest effektive rettelsesstrategi.

De fleste store AI-platforme tilbyder indbyggede feedbackmekanismer, der gør det muligt for brugere at rapportere unøjagtigheder. ChatGPT har for eksempel tommel-op og tommel-ned knapper på svar, hvor brugeren kan markere problematiske svar. Når du giver negativ feedback på et unøjagtigt svar, bliver denne information indsamlet og analyseret af platformens team. Disse feedbackloops hjælper AI-systemerne med at forbedre deres præstation ved at lære af både succesfulde og fejlagtige resultater. Den feedback du indsender, bliver en del af det datagrundlag, som udviklere bruger til at identificere fejlmønstre og forbedre modellens nøjagtighed.

Perplexity og Claude tilbyder lignende feedbackmuligheder i deres brugerflader. Du kan typisk rapportere, når et svar er unøjagtigt, misvisende eller indeholder forældet information. Nogle platforme lader dig også give specifikke rettelser eller præciseringer. Effektiviteten af denne feedback afhænger af, hvor mange brugere der rapporterer det samme problem, og hvor væsentlig unøjagtigheden er. Platformene prioriterer rettelser af udbredte problemer, der påvirker mange brugere, så hvis flere personer rapporterer den samme unøjagtighed om dit brand, er det mere sandsynligt, at platformen vil undersøge og håndtere det.

Den mest effektive langsigtede strategi for at rette AI-genereret misinformation handler om at rette den oprindelige kilde til den unøjagtige information. Da AI-systemer lærer fra webindhold, nyhedsartikler, Wikipedia og andre publicerede materialer, vil rettelser af information ved disse kilder påvirke, hvordan AI-platforme præsenterer information i fremtidige træningscyklusser. Anmod om rettelser eller opdateringer fra de oprindelige udgivere, hvor den unøjagtige information optræder. Hvis et medie har offentliggjort forkert information om dit brand, så kontakt deres redaktion med dokumentation for fejlen og anmod om en rettelse eller præcisering.

Wikipedia er en særlig vigtig kilde for AI’s træningsdata. Hvis der står urigtige informationer om dit brand eller domæne på Wikipedia, skal du bruge platformens redaktionelle kanaler til at få det rettet. Wikipedia har specifikke processer for at bestride information og anmode om rettelser, men du skal følge deres krav om neutralitet og verificerbarhed. Højautoritative kilder som Wikipedia, større nyhedsorganisationer, uddannelsesinstitutioner og myndighedssider vejer tungt i AI’s træningsdatasæt. Rettelser på disse kilder vil oftere blive inkorporeret i fremtidige AI-modelopdateringer.

For forældet eller urigtig information på dit eget website eller steder, du kontrollerer, bør du opdatere eller fjerne det hurtigt. Dokumentér alle ændringer, da disse opdateringer kan blive inkluderet i kommende retræningscyklusser. Når du retter information på dit eget domæne, giver du i praksis AI-systemerne mere nøjagtigt kildemateriale at lære ud fra i fremtiden.

I stedet for kun at fokusere på at fjerne negativ eller urigtig information, bør du udvikle stærke modfortællinger med autoritativt positivt indhold. AI-modeller vægter information delvist ud fra frekvens- og autoritetsmønstre i deres træningsdata. Hvis du skaber betydeligt mere positivt, korrekt og autoritativt indhold end der findes urigtige oplysninger, vil AI-systemerne møde langt mere positiv information, når de genererer svar om dit brand.

| Indholdstype | Autoritetsniveau | Indflydelse på AI | Tidsramme |

|---|---|---|---|

| Professionelle biografisider | Høj | Øjeblikkelig indflydelse på svar | Uger til måneder |

| Branchepublikationer & thought leadership | Meget høj | Stærk vægtning i AI-svar | Måneder |

| Pressemeddelelser via store nyhedsbureauer | Høj | Betydelig indflydelse på fortællinger | Uger til måneder |

| Cases og succeshistorier | Mellem-høj | Kontekstuel støtte til positive udsagn | Måneder |

| Akademiske eller forskningspublikationer | Meget høj | Varig indflydelse i træningsdata | Måneder til år |

| Wikipedia-opslag | Meget høj | Kritisk for fremtidige AI-træningscyklusser | Måneder til år |

Udvikl omfattende indhold på tværs af flere troværdige platforme for at sikre, at AI-systemer møder autoritativ, positiv information. Denne indholdsmættelsesstrategi er særligt effektiv, fordi den adresserer den egentlige årsag til AI-misinformation—utilstrækkelig positiv information til at balancere de urigtige påstande. Når AI-systemer har adgang til mere positiv, veldokumenteret information fra autoritative kilder, vil de naturligt generere mere favorable svar om dit brand.

Forskellige AI-platforme har forskellige arkitekturer og opdateringscyklusser, hvilket kræver tilpassede rettelsesmetoder. ChatGPT og andre GPT-baserede systemer fokuserer på platforme, der var inkluderet før træningsskæringsdatoen: store nyhedssider, Wikipedia, professionelle kataloger og udbredt webindhold. Da disse modeller ikke opdateres i realtid, vil rettelser, du foretager i dag, påvirke fremtidige træningscyklusser, typisk 12-18 måneder ude i fremtiden. Perplexity og realtidsbaserede AI-søgesystemer integrerer live webindhold, så det har øjeblikkelig effekt at holde SEO og løbende pressedækning stærk. Når du fjerner eller retter indhold fra det levende web, vil Perplexity som regel stoppe med at referere til det inden for dage eller uger.

Claude og Anthropic-systemer prioriterer faktabaseret, veldokumenteret information. Anthropic lægger vægt på faktuel pålidelighed, så sørg for, at positivt indhold om dit brand er verificerbart og linket til troværdige medier. Når du anmoder om rettelser fra Claude, bør du fokusere på evidensbaserede præciseringer og henvise til autoritative kilder, der understøtter den korrekte information. Det vigtigste er at forstå, at hver platform har forskellige datakilder, opdateringsfrekvenser og kvalitetsstandarder. Tilpas din rettelsesstrategi herefter.

Regelmæssig test af, hvordan AI-systemer beskriver dit navn eller brand, er afgørende for at spore rettelseseffektiviteten. Lav forespørgsler i ChatGPT, Claude, Perplexity og andre platforme ved at bruge både positive og negative formuleringer (for eksempel, “Er [brand] troværdig?” versus “[brand] resultater”). Registrer resultaterne over tid og følg udviklingen for at identificere unøjagtigheder og måle, om dine rettelsesindsatser ændrer fortællingen. Denne overvågning gør dig i stand til at opdage nye unøjagtigheder og reagere hurtigt. Hvis du bemærker, at en AI-platform stadig refererer til forældet eller forkert information uger efter, at du har rettet kilden, kan du eskalere sagen via platformens supportkanaler.

Dokumentér alle rettelser, du anmoder om, samt de svar, du modtager. Denne dokumentation tjener flere formål: den giver bevis, hvis du skal eskalere sager, hjælper dig med at identificere mønstre i, hvordan forskellige platforme håndterer rettelser, og den viser din gode vilje i bestræbelserne på at opretholde korrekt information. Gem oplysninger om, hvornår du indsendte feedback, hvilken unøjagtighed du rapporterede, og eventuelle svar fra platformen.

Fuldstændig fjernelse af urigtige oplysninger fra AI-søgning er sjældent muligt, men fortynding og kontekstskabelse er opnåelige mål. De fleste AI-virksomheder opdaterer træningsdata periodisk, typisk hver 12.-18. måned for store sprogmodeller. De handlinger, du foretager i dag, vil påvirke fremtidige iterationer, men du bør forvente en betydelig forsinkelse mellem anmodningen om rettelse og tidspunktet, hvor den afspejles i AI-genererede svar. Succes kræver tålmodighed og vedholdenhed. Ved at fokusere på autoritativ indholdsproduktion, adressere unøjagtigheder ved kilden og opbygge troværdighed kan du over tid forme, hvordan AI-platforme fremstiller dit brand.

Realtidsbaserede AI-søgeplatforme som Perplexity kan vise resultater inden for uger eller måneder, mens statiske modeller som ChatGPT kan tage 12-18 måneder, før rettelser afspejles i basismodellen. Dog kan du også opleve forbedringer tidligere, hvis platformen udgiver opdaterede versioner eller finjusterer specifikke modelaspekter. Tidsrammen afhænger også af, hvor udbredt unøjagtigheden er, og hvor mange brugere der rapporterer den. Udbredte fejl, der påvirker mange brugere, får hurtigere opmærksomhed end problemer, der kun angår få.

I visse jurisdiktioner har du juridiske muligheder ved urigtig eller ærekrænkende information. Hvis en AI-platform genererer falsk, ærekrænkende eller skadelig information om dit brand, kan du have grundlag for retlige skridt. Retten til at blive glemt i relevante jurisdiktioner, særligt under GDPR i Europa, giver yderligere muligheder. Disse regler giver dig ret til at anmode om fjernelse af visse personoplysninger fra søgeresultater og i visse tilfælde fra AI’s træningsdata.

Kontakt AI-platformens juridiske team, hvis du mener, at informationen overtræder deres brugerbetingelser eller gældende lovgivning. De fleste platforme har processer til håndtering af juridiske klager og anmodninger om fjernelse. Giv tydelig dokumentation for unøjagtigheden og forklar, hvorfor den overtræder lovgivningen eller platformens politikker. Dokumentér al kommunikation med platformen, da dette skaber en journal over dine bestræbelser på at løse problemet i god tro.

Den mest bæredygtige måde at styre dit omdømme i AI-søgning på er at overgå negativ information med vedvarende, autoritativ positivitet. Udgiv løbende ekspertindhold, vedligehold aktive professionelle profiler, opnå stabil mediedækning, opbyg netværk der forstærker resultater, og fremhæv dit engagement i fællesskabet. Denne langsigtede tilgang sikrer, at negativ eller urigtig omtale bliver fortyndet til en mindre fodnote i den overordnede fortælling om dit brand.

Implementér strategisk SEO med henblik på fremtidig AI-træning ved at sikre, at autoritativt indhold rangerer højt i søgemaskiner. Brug struktureret datamarkup og schema for at tydeliggøre kontekst, oprethold konsistente NAP-oplysninger (Navn, Adresse, Telefon) og opbyg stærke backlinks til troværdigt, positivt indhold. Disse tiltag øger chancen for, at positiv information bliver den dominerende fortælling i kommende AI-retræningscyklusser. Efterhånden som AI-systemer bliver mere sofistikerede og integrerede i dagligdagen, vil betydningen af at opretholde korrekt, autoritativ information på nettet kun vokse. Invester i din digitale tilstedeværelse nu for at sikre, at AI-platforme har adgang til korrekte oplysninger om dit brand i mange år frem.

Spor hvordan dit brand, domæne og dine URL'er vises på tværs af ChatGPT, Perplexity og andre AI-søgemaskiner. Få besked når der er behov for rettelser, og mål effekten af dine indsatser.

Komplet guide til at fravælge indsamling af AI-træningsdata på tværs af ChatGPT, Perplexity, LinkedIn og andre platforme. Lær trin-for-trin instruktioner til at...

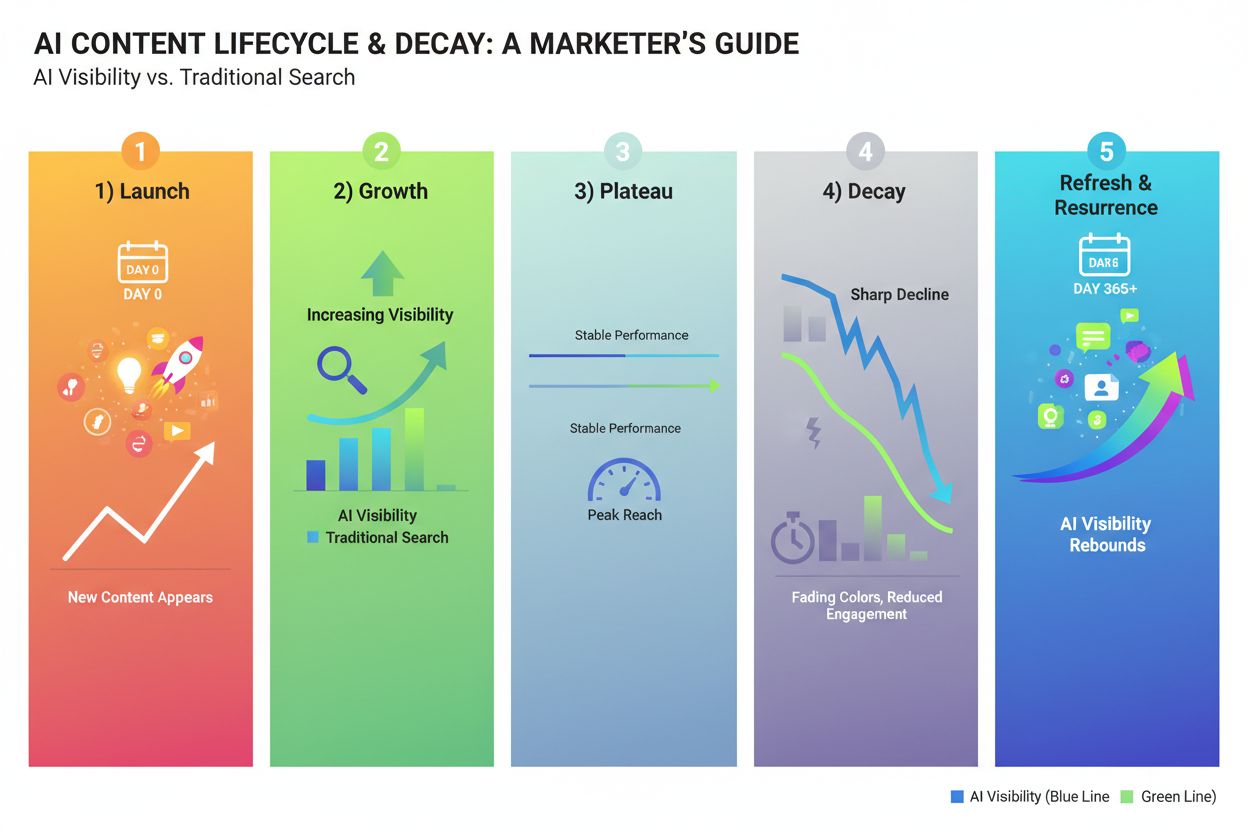

Lær hvor ofte du skal opdatere indhold for AI-synlighed. Opdag friskhedssignaler, retningslinjer for opdateringsfrekvens og overvågningsstrategier for ChatGPT, ...

Fællesskabsdiskussion om forskellen mellem AI-træningsdata og live-søgning (RAG). Praktiske strategier til at optimere indhold for både statiske træningsdata og...

Cookie Samtykke

Vi bruger cookies til at forbedre din browsingoplevelse og analysere vores trafik. See our privacy policy.