GPT-4

GPT-4 ist OpenAIs fortschrittliches multimodales LLM, das Text- und Bildverarbeitung kombiniert. Erfahren Sie mehr über seine Fähigkeiten, Architektur und Auswi...

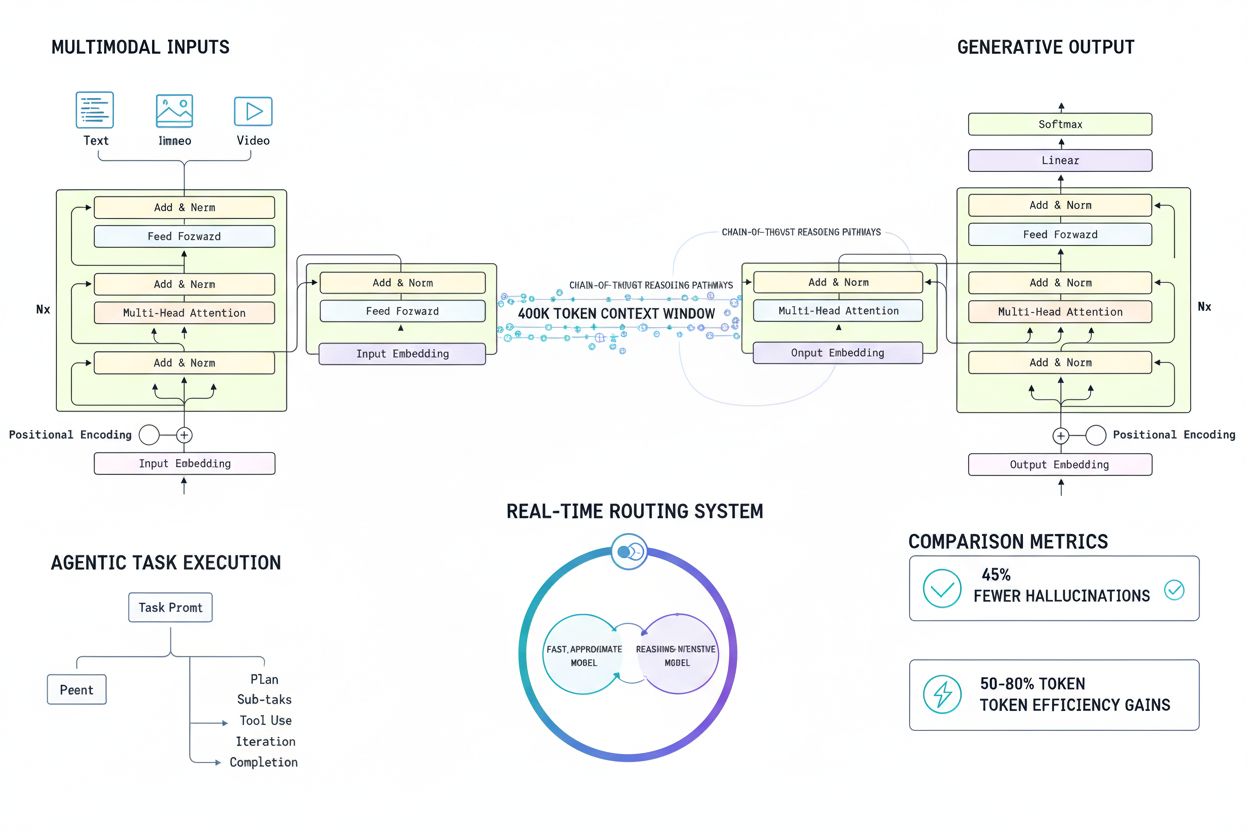

GPT-5 ist OpenAIs Large Language Model der fünften Generation, veröffentlicht am 7. August 2025, mit vereinheitlichten Reasoning- und Multimodal-Fähigkeiten, einem 400K Token-Kontextfenster, 45 % weniger Halluzinationen und fortschrittlicher agentischer Aufgabenausführung. Es stellt einen bedeutenden architektonischen Fortschritt dar, der ein reasoning-first Design mit einer adaptiven Echtzeit-Routing-Funktion zwischen schnellen und tiefgehenden Denkmodi kombiniert.

GPT-5 ist OpenAIs Large Language Model der fünften Generation, veröffentlicht am 7. August 2025, mit vereinheitlichten Reasoning- und Multimodal-Fähigkeiten, einem 400K Token-Kontextfenster, 45 % weniger Halluzinationen und fortschrittlicher agentischer Aufgabenausführung. Es stellt einen bedeutenden architektonischen Fortschritt dar, der ein reasoning-first Design mit einer adaptiven Echtzeit-Routing-Funktion zwischen schnellen und tiefgehenden Denkmodi kombiniert.

GPT-5 ist OpenAIs Large Language Model der fünften Generation, das offiziell am 7. August 2025 veröffentlicht wurde und einen grundlegenden architektonischen Wandel in der Art und Weise darstellt, wie KI-Systeme Reasoning, multimodale Verarbeitung und Aufgabenausführung angehen. Anders als seine Vorgänger vereint GPT-5 fortgeschrittene Reasoning-Fähigkeiten mit Nicht-Reasoning-Funktionalitäten in einem einzigen, adaptiven System, das Anfragen je nach Komplexität automatisch zwischen schneller Verarbeitung und tiefgehendem Denken routet. Das Modell verfügt über ein 400.000 Token-Kontextfenster, mit dem ganze Bücher, lange Besprechungsprotokolle und große Code-Repositories verarbeitet werden können, ohne dass der Kontext verloren geht. Besonders bemerkenswert ist, dass GPT-5 etwa 45 % weniger Halluzinationen als frühere Modelle aufweist und zudem 50-80 % effizienter im Tokenverbrauch ist, was es wesentlich genauer und kosteneffektiver für Unternehmens- und Verbraucher-Anwendungen macht. Dies markiert einen Wendepunkt in der Entwicklung generativer KI, da GPT-5 über die Rolle eines „besseren Chatbots“ hinausgeht und als echtes Reasoning-Engine für komplexe, mehrstufige Problemlösung, agentische Aufgabenbearbeitung sowie anspruchsvolles multimodales Verständnis von Text, Bildern und Videos fungiert.

Der Weg zu GPT-5 steht für nahezu ein Jahrzehnt inkrementeller und revolutionärer Fortschritte in der Large Language Model-Architektur und Trainingsmethodik. Die ursprünglichen GPT-Modelle (Generative Pre-trained Transformer), von OpenAI ab 2018 eingeführt, zeigten, dass sich durch Skalierung von Transformer-Architekturen auf riesigen Textdatensätzen überraschend kohärente Sprachgenerierung erzielen ließ. GPT-2 (2019) erregte durch die Erzeugung mehrerer kohärenter Absätze große Aufmerksamkeit, während GPT-3 (2020) mit seinen 175 Milliarden Parametern den Durchbruch der Large Language Models als transformative KI-Technologie markierte. Allerdings litten diese frühen Modelle unter erheblichen Einschränkungen: Sie halluzinierten häufig, taten sich schwer mit komplexem Reasoning und benötigten für verschiedene Aufgaben spezialisierte Einzelmodelle. GPT-4 (2023) brachte multimodale Fähigkeiten und verbessertes Reasoning, erforderte aber weiterhin das manuelle Wechseln zwischen Modellvarianten. Das Zwischenmodell GPT-4.5 (Orion), Anfang 2025 veröffentlicht, diente als Brücke und integrierte Reasoning-first-Prinzipien aus OpenAIs spezialisierten o1- und o3-Modellen. Diese Entwicklung kulminierte in GPT-5, das alle bisherigen Erkenntnisse in einer vereinheitlichten Architektur zusammenführt, die Modellwechsel überflüssig macht und Genauigkeit sowie Reasoning-Tiefe drastisch steigert. Laut Branchenanalysen nutzen inzwischen über 78 % der Unternehmen KI-gestützte Content-Monitoring-Tools, sodass die gesteigerte Genauigkeit von GPT-5 besonders für Markentracking und Zitationsmonitoring auf KI-Plattformen wertvoll ist.

Die Architektur von GPT-5 stellt eine Abkehr von reinen Transformer-Designs dar und integriert ein adaptives Echtzeit-Routing-System, das als intelligenter „Traffic-Controller“ für eingehende Anfragen fungiert. Gibt ein Nutzer einen Prompt ein, analysiert das Routing-System die Komplexität der Anfrage und leitet sie automatisch entweder an ein schnelles Hochdurchsatzmodell für einfache Anforderungen oder an ein „denkendes“ Modell für komplexe Reasoning-Aufgaben mit mehrstufiger Logik weiter. Dieser Ansatz eliminiert die rechnerische Verschwendung früherer Systeme, bei denen Nutzer zwischen Geschwindigkeit und Reasoning-Tiefe wählen mussten. Das 400.000 Token-Kontextfenster des Modells ist etwa 3,1-mal so groß wie das von GPT-4o (~128.000 Tokens) und ermöglicht erstmals die Verarbeitung sehr langer Inhalte. Jede GPT-5-Variante (gpt-5, gpt-5-mini, gpt-5-nano und gpt-5-chat) basiert auf derselben Architektur, ist jedoch für unterschiedliche Leistungs-Kosten-Abwägungen optimiert. Die gpt-5-Variante, ausgelegt für maximale Reasoning-Fähigkeit, hat einen Wissensstichtag vom 30. September 2024, während gpt-5-mini und gpt-5-nano auf den 30. Mai 2024 begrenzt sind, dafür aber signifikant schnellere Inferenzzeiten bieten. Im Kern integriert GPT-5 Chain-of-Thought Reasoning nativ, sodass das Modell komplexe Probleme in Zwischenschritte zerlegen kann, bevor es finale Antworten generiert. Diese architektonische Innovation, zusammen mit verbesserten Self-Attention-Mechanismen und optimiertem Position-Encoding, ermöglicht GPT-5, Langzeitabhängigkeiten und Kontextbeziehungen effektiver als frühere Modelle zu erfassen.

| Feature | GPT-5 | GPT-4o | GPT-5 Pro | o3 | Claude 3.5 Sonnet |

|---|---|---|---|---|---|

| Kontextfenster | 400K Tokens | ~128K Tokens | 400K Tokens | 200K Tokens | 200K Tokens |

| Halluzinationsrate | 45 % Reduktion | Basiswert | 50 %+ Reduktion | 40 % Reduktion | 35 % Reduktion |

| Token-Effizienz | 50–80 % weniger Tokens | Basiswert | 60–80 % weniger | 45 % weniger | 40 % weniger |

| Multimodale Unterstützung | Text/Vision/Video | Text/Vision/Voice | Erweitert multimodal | Eingeschränkt | Text/Vision |

| Reasoning-Fähigkeit | Vereinheitlicht adaptiv | Basiswert | Tiefgehendes Reasoning | Fortgeschrittenes Reasoning | Starkes Reasoning |

| Echtzeit-Routing | Ja (automatisch) | Nein | Ja (erweitert) | Nein | Nein |

| Input-Kosten (pro 1M Tokens) | $1,25 | $2,50 | $3,00+ | $3,00 | $3,00 |

| Output-Kosten (pro 1M Tokens) | $10,00 | $10,00 | $15,00+ | $12,00 | $15,00 |

| Veröffentlichung | 7. Aug. 2025 | Mai 2024 | 7. Aug. 2025 | Dez. 2024 | Juni 2024 |

| Bester Anwendungsfall | Komplexe Workflows | Allzweck | Enterprise Reasoning | Wissenschaftliche Probleme | Langform-Analyse |

Die multimodale Architektur von GPT-5 stellt einen bedeutenden Fortschritt darin dar, wie KI-Systeme verschiedene Datentypen integrieren. Das Modell überzeugt in visuellem Reasoning, räumlichem Verständnis und wissenschaftlichen Reasoning-Benchmarks und übertrifft frühere Generationen deutlich. Anders als frühere Systeme, die Text-, Bild- und Videoverarbeitung als getrennte Aufgaben behandelten, wechselt GPT-5 nahtlos zwischen den Modalitäten, ohne explizite Moduswechsel oder separate API-Aufrufe. Besonders hervorzuheben sind die Vision-Fähigkeiten: GPT-5 kann komplexen Frontend-UI-Code aus minimalem Prompting generieren, komplexe Diagramme und technische Zeichnungen analysieren und anspruchsvolle bildbasierte Reasoning-Aufgaben bewältigen. In unabhängigen Tests belegte GPT-5 Platz 1 bei Vision-Bewertungen in über 80 realen Aufgaben und übertraf in vielen Szenarien sogar spezialisierte Vision-Modelle. Die Videoverstehensfähigkeiten ermöglichen GPT-5, zeitliche Abläufe zu analysieren, Handlungsstränge zu erfassen und Informationen mit Kontextbewusstsein aus Videoinhalten zu extrahieren. Diese multimodale Integration ist besonders wertvoll für Unternehmensanwendungen, in denen Dokumente gemischte Inhaltstypen enthalten – etwa bei der Analyse von Finanzberichten mit eingebetteten Diagrammen, technischer Dokumentation mit Zeichnungen oder medizinischen Akten mit Bilddaten. Die verbesserte Mehrsprachigkeit erweitert diese Fähigkeiten auf zahlreiche Sprachen, wobei GPT-5 in Dutzenden wichtiger Sprachen hohe Sprachkompetenz bei gleichbleibender Reasoning-Qualität zeigt. Für Markenüberwachungsanwendungen bedeuten diese multimodalen Fähigkeiten, dass AmICited Markennennungen nicht nur in textbasierten KI-Antworten, sondern auch in Bildbeschreibungen, Videotranskriptionen und crossmodalen Reasoning-Ausgaben verfolgen kann.

Die Reasoning-Architektur von GPT-5 transformiert grundlegend die Herangehensweise an komplexe Probleme durch native Chain-of-Thought-Verarbeitung, die mehrstufige Aufgaben in Zwischenschritte zerlegt. Bei komplexen Anfragen versucht GPT-5 nicht, direkt zur Antwort zu springen, sondern generiert explizite Reasoning-Spuren, die den logischen Verlauf aufzeigen. Dieser Ansatz, inspiriert von o1- und o3-Modellen, verbessert die Genauigkeit bei mathematischen, logischen und mehrstufigen Aufgaben erheblich. Das Echtzeit-Routing-System entscheidet, wann dieser tiefgehende Reasoning-Modus aktiviert wird: Einfache Tatsachenanfragen umgehen die Reasoning-Pipeline für Geschwindigkeit, während komplexe Anfragen automatisch das „denkende Modell“ auslösen. Untersuchungen zeigen, dass dieser adaptive Ansatz die Latenz bei einfachen Anfragen um rund 60 % reduziert und dennoch die Reasoning-Qualität bei komplexen Aufgaben erhält. Die Chain-of-Thought-Fähigkeit ist besonders für professionelle Anwendungen wertvoll: Juristen können GPT-5 zur Analyse komplexer Rechtsdokumente mit explizitem Reasoning zu Präzedenzfällen und Auslegung nutzen, Ingenieure für das Debugging großer Codebasen mit schrittweiser Logik und Forschende zur Literatursynthese mit transparenter Herleitung von Verbindungen zwischen Arbeiten. Die Fähigkeit des Modells, Reasoning über lange Kontexte hinweg aufrechtzuerhalten, ermöglicht logische Konsistenz über 400.000 Tokens hinweg – eine Herausforderung, an der frühere Modelle oft scheiterten. Beispielsweise kann GPT-5 eine ganze wissenschaftliche Arbeit analysieren, alle zitierten Quellen im Blick behalten und Schlussfolgerungen ziehen, die schlüssig aus den präsentierten Beweisen folgen – eine Aufgabe, bei der frühere Modelle sich häufig widersprachen oder frühere Informationen aus den Augen verloren.

Die 45%ige Reduktion von Halluzinationen bei GPT-5 ist eine der wichtigsten praktischen Verbesserungen und wurde durch mehrere komplementäre Techniken erreicht. Das erweiterte Kontextfenster ermöglicht eine bessere Informationsbeibehaltung und verringert so die Wahrscheinlichkeit von Widersprüchen oder erfundenen Details. Die verbesserte Trainingsmethodik mit Reinforcement Learning from Human Feedback (RLHF) und Supervised Fine-Tuning (SFT) auf hochwertigen Datensätzen hat die Fähigkeit des Modells verfeinert, sichere von unsicheren Vorhersagen zu unterscheiden. Am bedeutendsten ist jedoch, dass das native Chain-of-Thought-Reasoning GPT-5 ermöglicht, logische Inkonsistenzen vor der Ausgabe zu erkennen und zu korrigieren – wenn Zwischenschritte widersprüchlich sind, kann das Modell dies vor der Antworterstellung feststellen und anpassen. Unabhängige Forschung des NIH dokumentierte deutliche Rückgänge bei Halluzinationsraten in medizinischen Reasoning-Aufgaben, wobei GPT-5 bei fachlichen Fragen signifikant höhere Faktengenauigkeit als GPT-4o zeigte. Verbesserte Token-Effizienz (50–80 % weniger Tokens für vergleichbare Ausgaben) trägt zur Genauigkeit bei, da das Modell weniger dazu neigt, Antworten mit Füllinhalt zu strecken. Für Markenüberwachung und Zitations-Tracking sind diese Genauigkeitssteigerungen bahnbrechend: Wenn GPT-5 eine Marke oder Quelle zitiert, ist die Wahrscheinlichkeit einer korrekten und kontextuell passenden Angabe deutlich höher. Forschung von Profound zeigt, dass der Zitationsdrift (Wechsel der Quellenauswahl auf KI-Plattformen) um bis zu 60 % schwanken kann, wodurch die verbesserte Konsistenz von GPT-5 für Organisationen, die ihre Markenpräsenz in KI-Antworten verfolgen, besonders wertvoll ist. Die Fähigkeit des Modells, Faktengenauigkeit über lange Dokumente zu sichern, macht das AmICited-Monitoring von Markennennungen in KI-generierten Inhalten zuverlässiger und verwertbarer.

Die agentischen Fähigkeiten von GPT-5 markieren einen grundlegenden Wandel vom passiven Textgenerator hin zur aktiven Aufgabenausführung. Das Modell kann jetzt als autonomer Agent agieren, mehrstufige Workflows planen, externe APIs aufrufen, Entscheidungen auf Basis von Echtzeitinformationen treffen und komplexe Geschäftsprozesse ausführen. Dies wird durch native Tool-Calling-Funktionalität ermöglicht, wodurch GPT-5 direkt mit externen Systemen – CRMs, Datenbanken, Office-Software und individuellen APIs – interagieren kann, ohne zwischengeschaltete Verarbeitungsschichten. Das agentische Reasoning in GPT-5 geht über einfaches Funktionsaufrufen hinaus: Das Modell versteht den Aufgabenkontext, zerlegt komplexe Ziele in Teilaufgaben, verarbeitet Fehler und Sonderfälle und passt sein Vorgehen nach Zwischenresultaten an. Beispielsweise könnte ein GPT-5-Agent eigenständig einen Kundensupport-Workflow managen: Ticket entgegennehmen, Problem analysieren, relevante Dokumentation abrufen, Antwort verfassen und bei Bedarf an den Support eskalieren – und dabei stets Kontext und Reasoning zum optimalen Vorgehen berücksichtigen. Das Echtzeit-Routing-System ist für agentische Anwendungen besonders wichtig: Routinetätigkeiten laufen schnell im Fast-Modell, komplexe Entscheidungen werden automatisch an das Thinking-Modell weitergeleitet. Diese Architektur ermöglicht kosteneffiziente Automatisierung, bei der Organisationen nur für tiefgehendes Reasoning zahlen, wenn es wirklich benötigt wird. Laut OpenAIs Benchmarks zeigt GPT-5 deutliche Fortschritte bei Befolgen von Anweisungen und agentischer Tool-Nutzung – Fähigkeiten, die zuverlässigen autonomen Agentenbetrieb ermöglichen. Für Unternehmen bedeutet das, dass GPT-5 anspruchsvolle KI-Agenten für Kundenservice, Inhaltsmoderation, Datenanalyse und Workflow-Automatisierung mit minimalem menschlichen Eingriff antreiben kann.

Die Preisgestaltung von GPT-5 ist so aufgebaut, dass sie verschiedene Anwendungsfälle und Budgets durch Varianten abdeckt. Die gpt-5-Variante kostet 1,25 $ pro eine Million Eingabetokens und 10,00 $ pro eine Million Ausgabetokens – das entspricht einer Kostenhalbierung für Inputs im Vergleich zu GPT-4o (2,50 $), bei identischem Output-Preis. Die gpt-5-mini-Variante bietet dramatische Kostenvorteile zu 0,05 $ und 0,40 $ und ist ideal für Anwendungen mit hohem Volumen, bei denen Reasoning-Tiefe nicht entscheidend ist. Die gpt-5-nano-Variante mit 0,25 $ und 2,00 $ richtet sich an ultraschnelle Embedded-Anwendungen. Für Nutzer mit höchsten Reasoning-Anforderungen bietet GPT-5 Pro erweiterte Kontextfenster und bevorzugten Zugang zu Premiumpreisen. Verfügbarkeit besteht über verschiedene Kanäle: ChatGPT-Nutzer (kostenlos und bezahlt) erhalten automatisch Zugriff auf GPT-5 als Standardmodell, GPT-5 Pro steht ChatGPT Pro-Abonnenten zur Verfügung. API-Nutzer greifen auf alle Varianten über die OpenAI Platform oder das OpenAI Python SDK zu und können GPT-5 in eigene Anwendungen integrieren. Die GitHub Models Playground bietet Entwicklern einen kostenlosen Testraum für GPT-5. Bereitstellungsflexibilität ist ein großer Vorteil: Organisationen können GPT-5 über ChatGPTs Webinterface interaktiv nutzen, via API produktiv integrieren oder über Plattformen wie Botpress KI-Agenten ohne Coding bauen. Die Kontextfenster-Caching-Funktion ermöglicht 90 % Rabatt auf gecachte Eingabetokens, was besonders bei wiederholter Verarbeitung derselben Dokumente oder Wissensdatenbanken erhebliche Kosteneinsparungen bringt. Für Markenüberwachungsanwendungen heißt das: Organisationen können mit der verbesserten Genauigkeit von GPT-5 ihre Markennennungen plattformübergreifend kostengünstig verfolgen, ohne prohibitive Ausgaben.

Die Veröffentlichung von GPT-5 hat tiefgreifende Auswirkungen auf KI-Monitoring-Plattformen wie AmICited, die Marken- und Domainvorkommen in KI-generierten Antworten erfassen. Die 45 % reduzierte Halluzinationsrate bedeutet, dass Markenzitationen in GPT-5-Antworten wesentlich zuverlässiger und genauer sind als bei früheren Modellen. Das erweiterte 400K Token-Kontextfenster ermöglicht GPT-5, Konsistenz über längere Dokumente hinweg zu wahren und den Zitationsdrift zu reduzieren, bei dem KI-Modelle je nach Kontext verschiedene Quellen angeben. Studien zeigen, dass Zitationsmuster auf verschiedenen KI-Plattformen um bis zu 60 % abweichen können, aber die verbesserte Konsistenz von GPT-5 sollte diese Schwankungen verringern. Das Echtzeit-Routing-System wirkt sich auch auf das Monitoring aus: Einfache Markennennungen laufen durchs Fast-Modell, komplexe Reasoning-Aufgaben zu Marken oder Produkten werden durch das Thinking-Modell bearbeitet, was beeinflussen kann, wie Marken in verschiedenen Kontexten diskutiert werden. Die multimodalen Fähigkeiten erweitern den Überwachungsbereich über Text hinaus: Markennennungen in Bildbeschreibungen, Videotranskriptionen und crossmodalen Reasoning-Ausgaben müssen ebenfalls beobachtet werden. Für Organisationen, die mit AmICited ihre Markenpräsenz überwachen, ist GPT-5 sowohl Chance als auch Herausforderung: Einerseits liefern die gesteigerte Genauigkeit und Konsistenz zuverlässigere Markendaten, andererseits kann die abweichende Architektur im Vergleich zu GPT-4o auch zu anderen Zitationsmustern führen. Die agentischen Fähigkeiten schaffen neue Überwachungsdimensionen: Wenn GPT-5-Agenten autonom Aufgaben ausführen, kann es zu Markenzitationen in Reasoning-Prozessen kommen, was neue Schnittstellen für die Markenverfolgung schafft. Durch die native Tool-Calling-Funktion können GPT-5-Agenten direkt auf Markenwebsites oder APIs zugreifen – neue Möglichkeiten, wie KI-Systeme mit digitalen Marken-Eigenschaften interagieren und wie deren Nutzung nachvollzogen werden kann.

GPT-5 ist eher ein Meilenstein als ein Endpunkt in der Entwicklung von Large Language Models, mit klar absehbaren Weiterentwicklungen. OpenAI hat mitgeteilt, dass GPT-5.2 (veröffentlicht Ende 2025) erhebliche Verbesserungen bei allgemeiner Intelligenz, Langkontextverständnis, agentischem Tool-Calling und Vision-Fähigkeiten bringt – ein Hinweis darauf, dass die Grundarchitektur weiterentwickelt wird. Die von den o1- und o3-Modellen eingeführte Reasoning-first-Designphilosophie wird vermutlich zum Standard in der LLM-Entwicklung, mit mehr Modellen, die explizites Chain-of-Thought-Processing und adaptives Routing nutzen. Branchentrends zeigen, dass die Modellspezialisierung zunehmen wird: Während GPT-5 ein Generalist ist, könnten künftig spezialisierte Varianten für bestimmte Domänen (rechtlich, medizinisch, wissenschaftlich) oder Modalitäten (vision-, audiofokussiert) entstehen. Die Effizienzgewinne von GPT-5 (50–80 % weniger Tokens) dürften sich angesichts von Wettbewerbs- und Umweltaspekten weiter beschleunigen. Multimodale Integration wird sich vertiefen, mit künftigen Modellen, die Audio, strukturierte Daten und Echtzeitdatenströme neben Text, Bild und Video einbeziehen. Für Markenüberwachung und KI-Zitations-Tracking bedeutet das: Organisationen müssen ihre Monitoring-Strategien kontinuierlich an die Entwicklung der KI-Modelle anpassen. Das Phänomen des Zitationsdrifts könnte sich durch Modellverbesserungen verändern – entweder stabilere Markenmuster schaffen oder neue Schwankungen einführen, wenn Modelle neue Fähigkeiten erhalten. Die agentischen Fähigkeiten werden vermutlich expandieren und neue Kanäle schaffen, über die Marken in KI-Systemen genannt oder referenziert werden. Organisationen sollten GPT-5 nicht als statisches Ziel für Monitoring sehen, sondern als dynamisches System, dessen Architektur und Fähigkeiten sich weiterentwickeln – Monitoring-Strategien müssen entsprechend adaptiv sein. Das Wettbewerbsumfeld wird sich verschärfen, wenn andere Organisationen (Anthropic, Google, Meta) konkurrierende Modelle mit ähnlichen oder überlegenen Fähigkeiten veröffentlichen, was die KI-Antwortlandschaft fragmentiert und umfassendes Markenmonitoring immer wichtiger macht.

Vereinheitlichte Architektur: GPT-5 vereint Reasoning- und Nicht-Reasoning-Fähigkeiten in einem Modell mit adaptivem Echtzeit-Routing und macht manuelles Wechseln zwischen Spezialmodellen überflüssig.

Kontextfenster-Vorteil: Das 400K Token-Kontextfenster ermöglicht die Verarbeitung ganzer Bücher, langer Transkripte und großer Codebasen ohne Kontextverlust oder Inkonsistenz.

Halluzinationsreduktion: 45 % weniger Halluzinationen gegenüber GPT-4o, ermöglicht durch verbessertes Training, Chain-of-Thought-Reasoning und besseres Kontextverständnis über lange Dokumente hinweg.

Token-Effizienz: 50–80 % weniger Tokens für gleichwertige Ausgaben, was Latenz und API-Kosten senkt und die Antwortqualität erhält oder verbessert.

Multimodale Integration: Nahtlose Verarbeitung von Text, Bildern und Video ohne separate Modelle, mit überlegener Leistung bei visuellem Reasoning und räumlichem Verständnis.

Agentische Fähigkeiten: Native Tool-Calling-Funktionen und autonome Aufgabenausführung ermöglichen GPT-5 den Einsatz als eigenständiger Agent für Workflow-Automatisierung und komplexe Geschäftsprozesse.

Echtzeit-Routing: Automatische Entscheidung zwischen schneller Verarbeitung für einfache und tiefem Reasoning für komplexe Aufgaben, was Geschwindigkeit und Genauigkeit optimiert.

Variantenspektrum: Vier Modellvarianten (gpt-5, gpt-5-mini, gpt-5-nano, gpt-5-chat) ermöglichen kosteneffizienten Einsatz für verschiedene Anwendungsfälle und Leistungsanforderungen.

Markenmonitoring-Zuverlässigkeit: Verbesserte Genauigkeit und Konsistenz machen GPT-5-Antworten zuverlässiger für die Nachverfolgung von Markenzitationen und die Überwachung der Markenpräsenz in KI-generierten Inhalten.

Bereitstellungsoptionen: Verfügbar über ChatGPT, OpenAI API, Python SDK und No-Code-Plattformen wie Botpress – für Integration in Consumer- und Enterprise-Anwendungen.

GPT-5 markiert einen Wendepunkt in der KI-Entwicklung und stellt keinen bloßen inkrementellen Fortschritt, sondern einen grundlegenden architektonischen Wandel im Umgang von Large Language Models mit Reasoning, multimodaler Verarbeitung und Aufgabenausführung dar. Die vereinheitlichte Architektur, 45 % weniger Halluzinationen, das 400K Token-Kontextfenster und native agentische Fähigkeiten adressieren die Hauptlimitationen früherer Generationen. Für Organisationen, die Markenpräsenz und Zitationen in KI-generierten Antworten nachverfolgen, machen die verbesserte Genauigkeit und Konsistenz von GPT-5 es zu einem essenziellen Baustein umfassender KI-Monitoring-Strategien. Da sich die KI-Landschaft mit konkurrierenden Modellen und neuen Fähigkeiten weiterentwickelt, wird das Verständnis der Architektur, Fähigkeiten und Implikationen von GPT-5 für Unternehmen, die Sichtbarkeit und Kontrolle über ihre Markenpräsenz in KI-Systemen sichern wollen, immer wichtiger.

GPT-5 führt eine vereinheitlichte Architektur ein, die Reasoning- und Nicht-Reasoning-Fähigkeiten in einem einzigen Modell vereint, während GPT-4o zwischen spezialisierten Modellen wechseln musste. GPT-5 verfügt über ein 400K Token-Kontextfenster (im Vergleich zu den ~128K von GPT-4o), produziert 50-80 % weniger Tokens für die gleiche Ausgabe und zeigt etwa 45 % weniger Halluzinationen. Das Echtzeit-Routing-System von GPT-5 wählt automatisch zwischen schnellen und tiefgehenden Denkmodi je nach Komplexität der Anfrage aus und macht manuelles Modellwechseln überflüssig.

GPT-5 erreicht eine Reduzierung der Halluzinationen um 45 % durch verbessertes Chain-of-Thought-Reasoning, bessere Kontextverständnis und verbessertes Training mit Reinforcement Learning from Human Feedback (RLHF). Die vereinheitlichte Architektur ermöglicht es dem Modell, komplexe Probleme in kleinere Reasoning-Schritte zu zerlegen, bevor finale Ausgaben generiert werden. Das erweiterte Kontextfenster sorgt für eine bessere Beibehaltung früherer Informationen ohne Widersprüche. Zusätzlich integriert GPT-5 Prinzipien des reasoning-first Designs aus Modellen wie o1 und o3, die mehrstufige logische Prozesse direkter Vorhersage vorziehen.

GPT-5 gibt es in vier Varianten: gpt-5 (am besten für tiefgehendes Reasoning mit 400K Kontext), gpt-5-mini (schnellere, kostengünstigere Option), gpt-5-nano (ultraschnell für Echtzeitanwendungen) und gpt-5-chat (optimiert für Konversationen). Wählen Sie gpt-5 für komplexe, mehrstufige Workflows und Forschungsaufgaben, gpt-5-mini für ausgewogene Leistung und Kosten, gpt-5-nano für eingebettete Systeme oder latenzkritische Anwendungen und gpt-5-chat für interaktive Dialoge. Alle Varianten nutzen dieselbe vereinheitlichte Architektur, sind jedoch auf unterschiedliche Leistungs-Kosten-Abwägungen abgestimmt.

GPT-5 verfügt über eine vereinheitlichte multimodale Architektur, die Text-, Bild- und Videoeingaben nahtlos verarbeitet, ohne separate Modelle oder Moduswechsel zu benötigen. Das Modell überzeugt bei visuellen Reasoning-, räumlichen Verständnis- und wissenschaftlichen Reasoning-Benchmarks. Dank verbesserter Vision-Fähigkeiten kann es komplexe Frontend-UI-Generierung mit minimalem Prompting umsetzen und fortgeschrittene Bildanalysen durchführen. Die multimodale Integration ist insbesondere bei Aufgaben von Wert, die crossmodales Reasoning erfordern, wie z. B. das Analysieren von Dokumenten mit eingebetteten Bildern oder das Generieren von Code auf Basis visueller Mockups.

Das Echtzeit-Routing-System von GPT-5 ist ein adaptiver Mechanismus, der automatisch entscheidet, ob eine Anfrage sofort mit einem schnellen Hochdurchsatzmodell beantwortet oder an ein 'denkendes' Modell für komplexes Reasoning weitergeleitet werden soll. Damit entfällt für Nutzer die Notwendigkeit, je nach Aufgabenkomplexität manuell zwischen Modellen zu wählen. Der Router analysiert eingehende Anfragen und bestimmt den optimalen Verarbeitungsweg, wodurch API-Kosten reduziert werden und gleichzeitig die Reasoning-Qualität bei komplexen Aufgaben erhalten bleibt. Diese Architektur stellt einen bedeutenden Wandel gegenüber bisherigen Ansätzen dar, bei denen Nutzer zwischen Geschwindigkeit und Reasoning-Tiefe entscheiden mussten.

Die erhöhte Genauigkeit und die reduzierte Halluzinationsrate von GPT-5 machen es zuverlässiger für Markenüberwachung und Zitations-Tracking über KI-Plattformen hinweg. Mit 45 % weniger Halluzinationen und besserem Kontextverständnis liefert GPT-5 genauere Marken-Nennungen und Quellzitate in KI-generierten Antworten. Das erweiterte 400K Token-Kontextfenster ermöglicht es GPT-5, Konsistenz über längere Dokumente und Konversationen zu bewahren und den Zitationsdrift zu reduzieren. Für Plattformen wie AmICited, die Markenauftritte in KI-Antworten verfolgen, bedeuten das verbesserte Reasoning und die höhere Genauigkeit von GPT-5 zuverlässigere Daten für die Überwachung, wie Marken in ChatGPT, Perplexity, Google AI Overviews und Claude zitiert werden.

Die Preise für GPT-5 variieren je nach Variante: gpt-5 kostet 1,25 $ pro eine Million Eingabetokens und 10,00 $ pro eine Million Ausgabetokens, gpt-5-mini kostet jeweils 0,05 $ und 0,40 $, und gpt-5-nano kostet 0,25 $ und 2,00 $. Zum Vergleich: GPT-4o kostet 2,50 $ und 10,00 $, während o3 bei 3,00 $ und 12,00 $ liegt. GPT-5 Pro bietet erweiterte Kontextfenster und bevorzugten Zugang zu höheren Tarifen. Die Preisstruktur ermöglicht es Entwicklern, die Kosten durch Wahl der passenden Variante für ihren Anwendungsfall zu optimieren, wobei gpt-5-mini für die meisten Anwendungen das beste Verhältnis von Leistung und Preis bietet.

Beginnen Sie zu verfolgen, wie KI-Chatbots Ihre Marke auf ChatGPT, Perplexity und anderen Plattformen erwähnen. Erhalten Sie umsetzbare Erkenntnisse zur Verbesserung Ihrer KI-Präsenz.

GPT-4 ist OpenAIs fortschrittliches multimodales LLM, das Text- und Bildverarbeitung kombiniert. Erfahren Sie mehr über seine Fähigkeiten, Architektur und Auswi...

ChatGPT ist OpenAIs konversationaler KI-Assistent, der von GPT-Modellen angetrieben wird. Erfahren Sie, wie er funktioniert, welchen Einfluss er auf KI-Monitori...

Erfahren Sie, was SearchGPT ist, wie es funktioniert und welche Auswirkungen es auf Suche, SEO und digitales Marketing hat. Entdecken Sie Funktionen, Einschränk...

Cookie-Zustimmung

Wir verwenden Cookies, um Ihr Surferlebnis zu verbessern und unseren Datenverkehr zu analysieren. See our privacy policy.