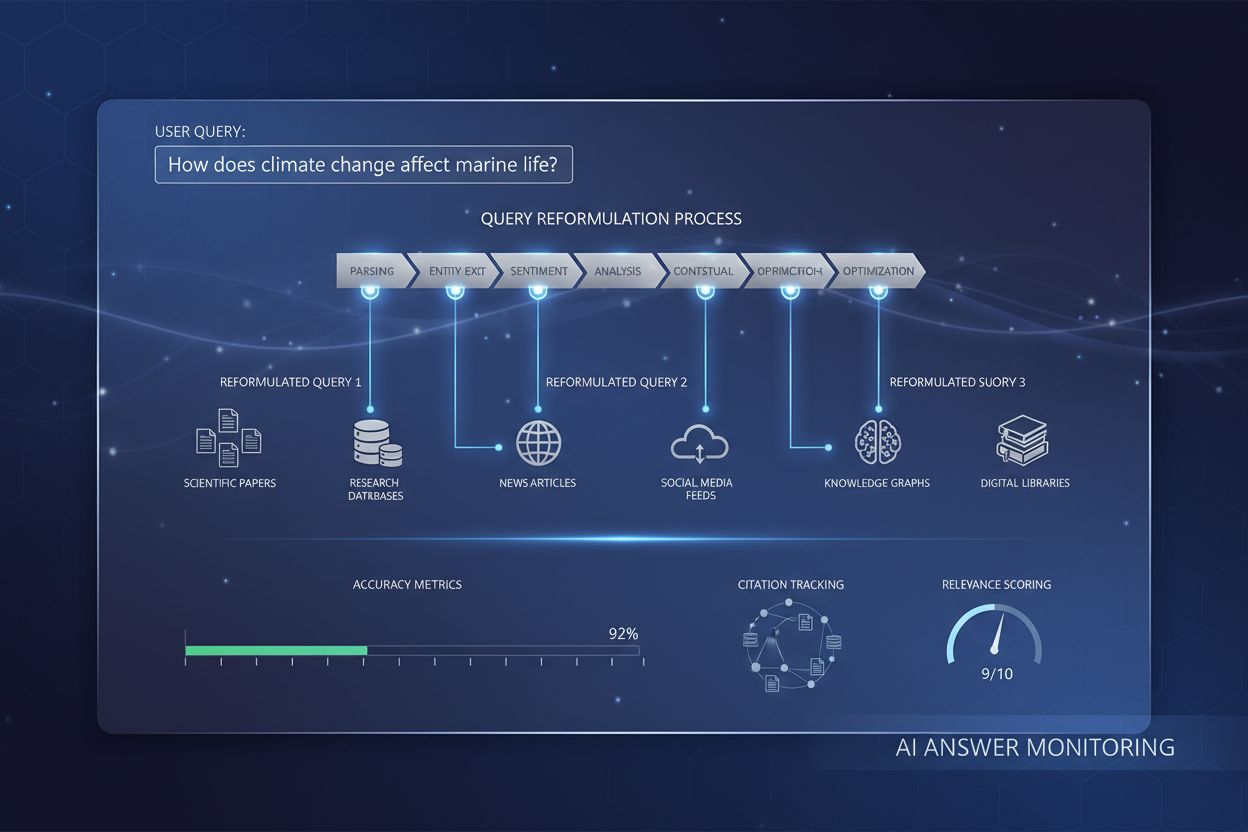

Reformulación de consultas

Descubre cómo la reformulación de consultas ayuda a los sistemas de IA a interpretar y mejorar las consultas de los usuarios para una mejor recuperación de info...

La optimización de expansión de consultas es el proceso de mejorar las consultas de búsqueda de los usuarios añadiendo términos relacionados, sinónimos y variaciones contextuales para mejorar la precisión de recuperación y la relevancia del contenido en sistemas de IA. Esta técnica salva las diferencias de vocabulario entre las consultas de los usuarios y los documentos relevantes, asegurando que sistemas de IA como GPTs y Perplexity puedan encontrar y referenciar contenido más apropiado. Es esencial para mejorar tanto la exhaustividad como la precisión de las respuestas generadas por IA. Al expandir las consultas de manera inteligente, las plataformas de IA pueden mejorar drásticamente la forma en que descubren y citan fuentes relevantes.

La optimización de expansión de consultas es el proceso de mejorar las consultas de búsqueda de los usuarios añadiendo términos relacionados, sinónimos y variaciones contextuales para mejorar la precisión de recuperación y la relevancia del contenido en sistemas de IA. Esta técnica salva las diferencias de vocabulario entre las consultas de los usuarios y los documentos relevantes, asegurando que sistemas de IA como GPTs y Perplexity puedan encontrar y referenciar contenido más apropiado. Es esencial para mejorar tanto la exhaustividad como la precisión de las respuestas generadas por IA. Al expandir las consultas de manera inteligente, las plataformas de IA pueden mejorar drásticamente la forma en que descubren y citan fuentes relevantes.

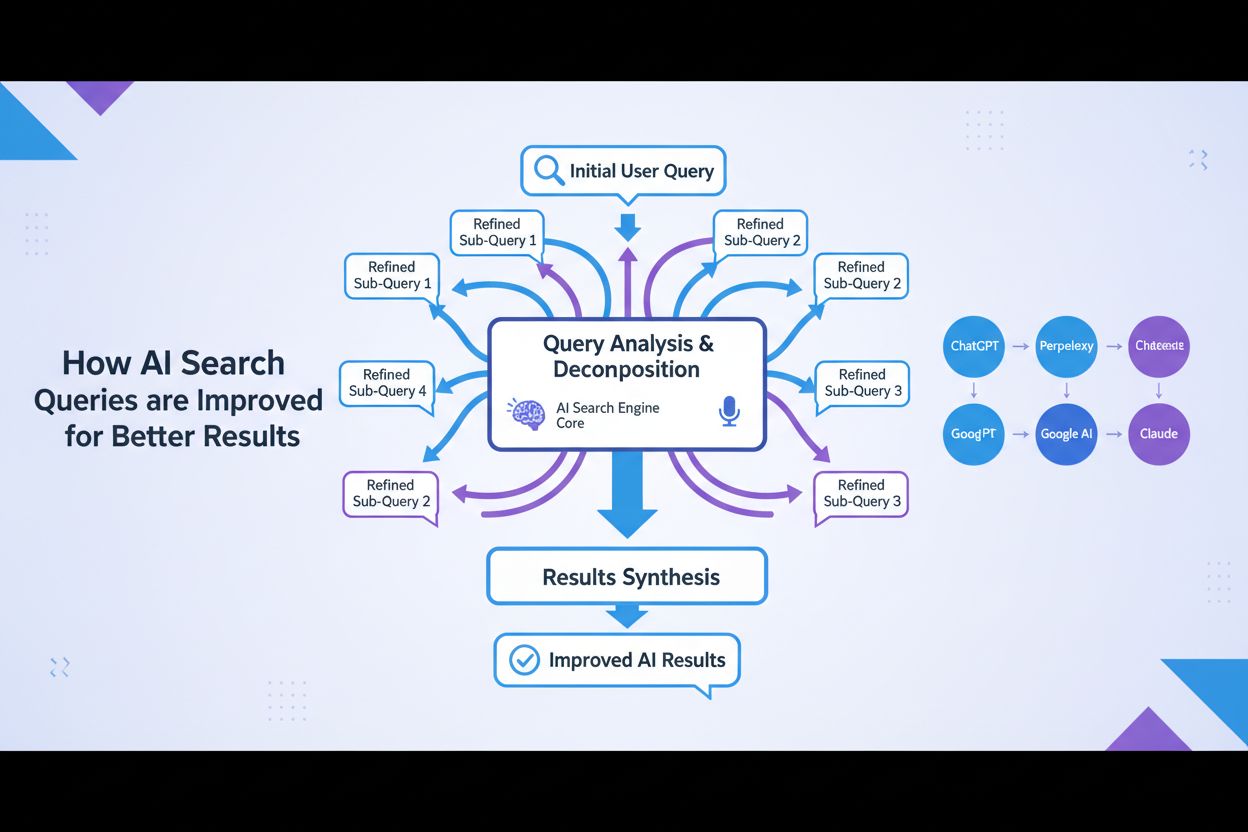

La Optimización de Expansión de Consultas es el proceso de reformular y mejorar las consultas de búsqueda añadiendo términos relacionados, sinónimos y variaciones semánticas para mejorar el rendimiento de recuperación y la calidad de las respuestas. En esencia, la expansión de consultas aborda el problema de desincronización de vocabulario—el desafío fundamental de que los usuarios y los sistemas de IA a menudo usan terminología diferente para describir los mismos conceptos, lo que lleva a perder resultados relevantes. Esta técnica es crítica para los sistemas de IA porque salva la brecha entre cómo las personas expresan sus necesidades de información y cómo el contenido está realmente indexado y almacenado. Al expandir las consultas de manera inteligente, las plataformas de IA pueden mejorar drásticamente tanto la relevancia como la exhaustividad de sus respuestas.

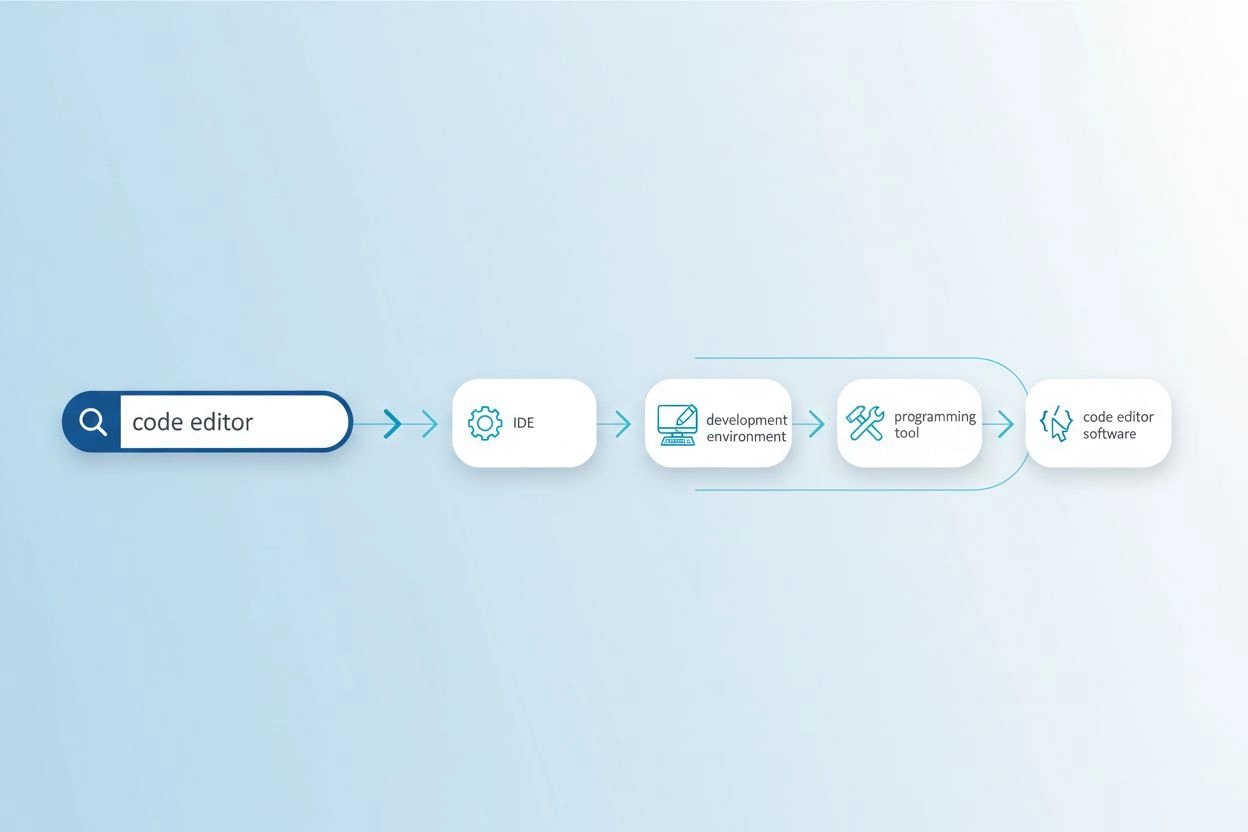

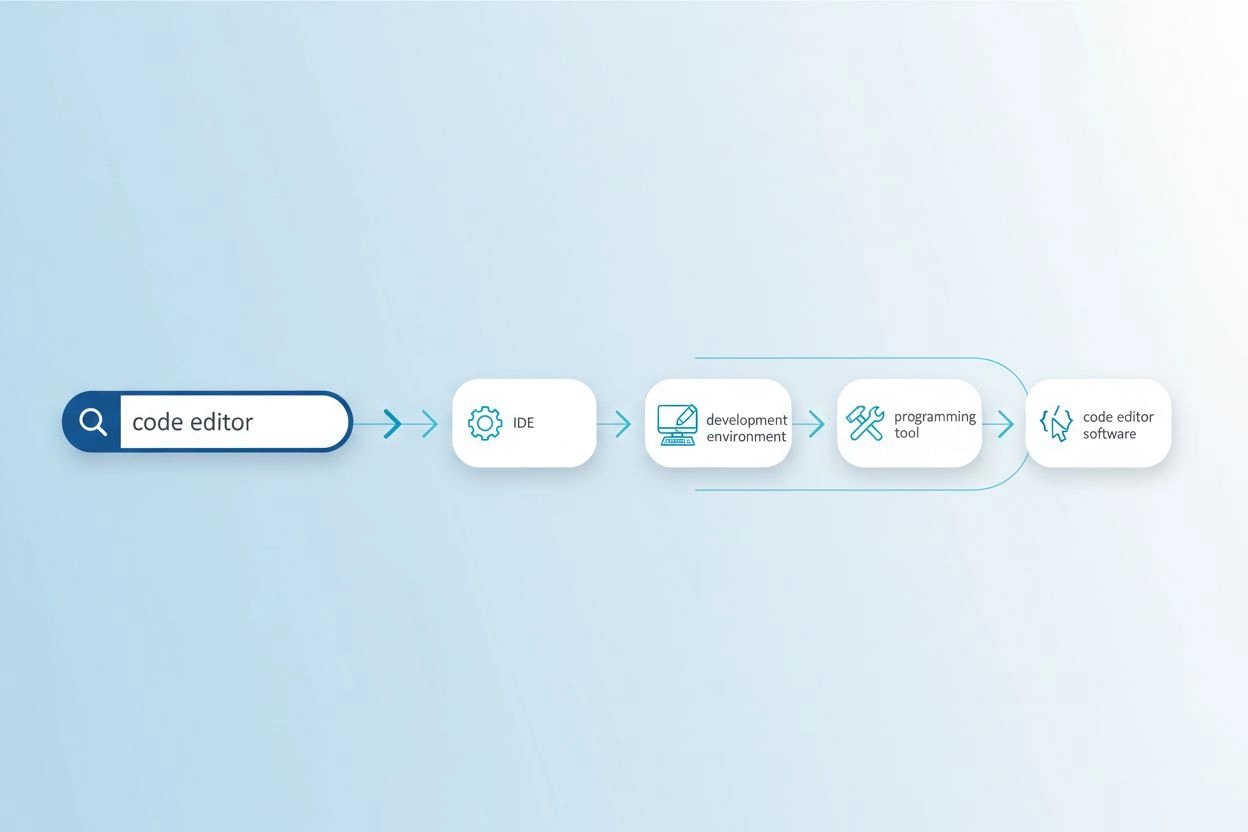

El problema de desincronización de vocabulario ocurre cuando las palabras exactas usadas en una consulta no coinciden con la terminología presente en los documentos relevantes, haciendo que los sistemas de búsqueda pierdan información valiosa. Por ejemplo, un usuario que busca “editor de código” podría no ver resultados sobre “IDEs” (Entornos de Desarrollo Integrados) o “editores de texto”, aunque sean alternativas altamente relevantes. De igual manera, alguien que consulta “vehículo” podría no hallar resultados etiquetados como “coche”, “automóvil” o “vehículo motorizado”, a pesar de la clara superposición semántica. Este problema se agrava en dominios especializados donde múltiples términos técnicos describen el mismo concepto, y afecta directamente la calidad de las respuestas generadas por IA al limitar el material fuente disponible para la síntesis. La expansión de consultas soluciona esto generando automáticamente variaciones relacionadas de la consulta que capturan diferentes formas de expresar la misma información.

| Consulta Original | Consulta Expandida | Impacto |

|---|---|---|

| editor de código | IDE, editor de texto, entorno de desarrollo, editor de código fuente | Encuentra 3-5 veces más resultados relevantes |

| aprendizaje automático | IA, inteligencia artificial, deep learning, redes neuronales | Captura variaciones terminológicas del dominio |

| vehículo | coche, automóvil, vehículo motorizado, transporte | Incluye sinónimos y términos relacionados comunes |

| dolor de cabeza | migraña, cefalea tensional, alivio del dolor, tratamiento para dolor de cabeza | Aborda variaciones de terminología médica |

La expansión moderna de consultas emplea varias técnicas complementarias, cada una con ventajas específicas según el caso de uso y el dominio:

Cada técnica ofrece diferentes compensaciones entre costo computacional, calidad de expansión y especificidad de dominio, siendo los enfoques basados en LLM los de mayor calidad pero también los que requieren más recursos.

La expansión de consultas mejora las respuestas de IA al proporcionar a los modelos de lenguaje y sistemas de recuperación un conjunto más rico y amplio de materiales fuente para generar respuestas. Cuando una consulta se expande para incluir sinónimos, conceptos relacionados y frases alternativas, el sistema de recuperación puede acceder a documentos que utilizan terminología diferente pero contienen información igualmente relevante, aumentando drásticamente la exhaustividad del proceso de búsqueda. Este contexto ampliado permite a los sistemas de IA sintetizar respuestas más completas y matizadas, ya que dejan de estar limitados por las elecciones léxicas específicas de la consulta original. Sin embargo, la expansión de consultas introduce un compromiso entre precisión y exhaustividad: mientras las consultas expandidas recuperan más documentos relevantes, también pueden introducir ruido y resultados menos relevantes si la expansión es excesiva. La clave de la optimización es calibrar la intensidad de la expansión para maximizar la mejora de relevancia minimizando el ruido irrelevante, asegurando que las respuestas de IA sean más completas sin sacrificar precisión.

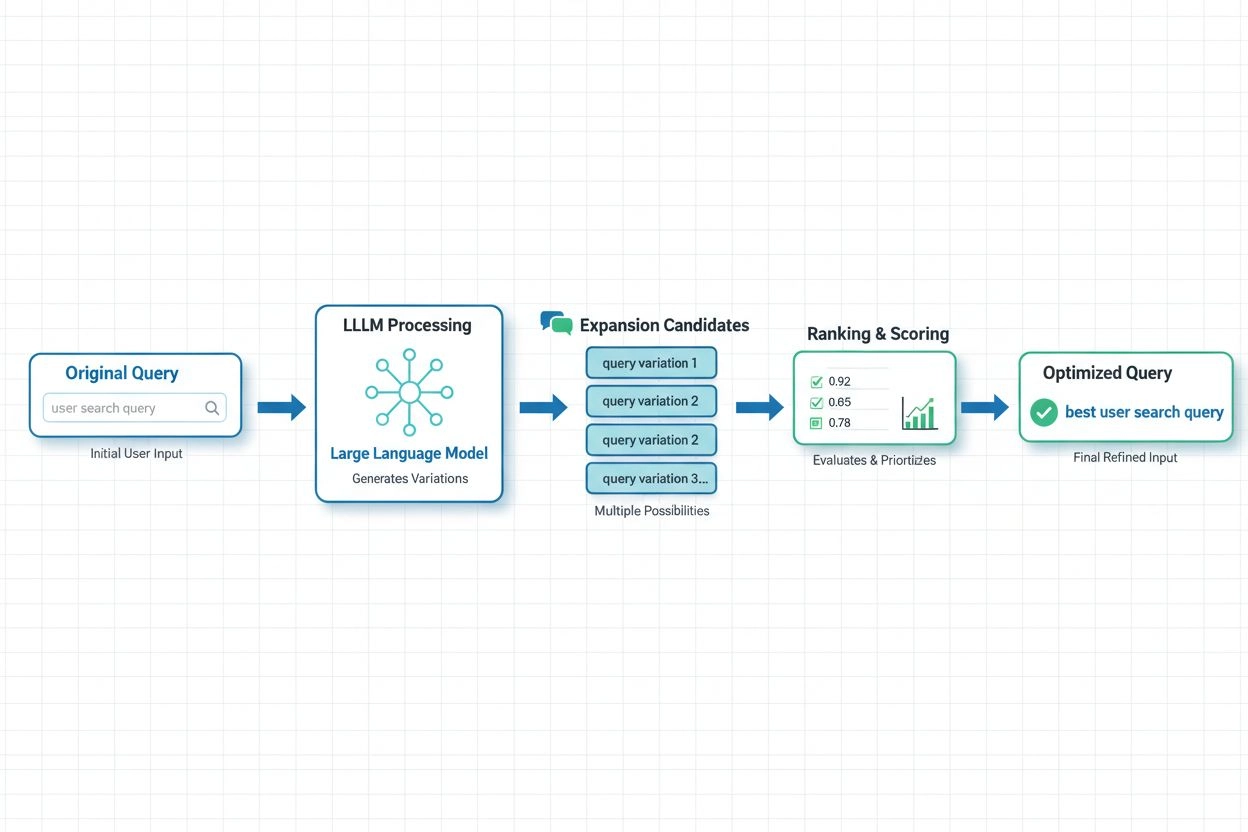

En los sistemas de IA modernos, la expansión de consultas basada en LLM ha surgido como el enfoque más sofisticado, aprovechando la comprensión semántica de los grandes modelos de lenguaje para generar variaciones de consulta contextualmente apropiadas. Investigaciones recientes de Spotify demuestran el poder de este enfoque: su implementación usando técnicas de alineación de preferencias (combinando métodos RSFT y DPO) logró aproximadamente una reducción del 70% en el tiempo de procesamiento mientras mejoraba la precisión de recuperación top-1. Estos sistemas funcionan entrenando modelos de lenguaje para entender las preferencias e intenciones del usuario, y luego generar expansiones alineadas con lo que los usuarios realmente consideran valioso, en lugar de simplemente añadir sinónimos arbitrarios. Los enfoques de optimización en tiempo real adaptan continuamente las estrategias de expansión según el feedback del usuario y los resultados de recuperación, permitiendo que los sistemas aprendan qué expansiones funcionan mejor para tipos de consulta y dominios específicos. Este enfoque dinámico es especialmente valioso para plataformas de monitorización de IA, ya que permite rastrear cómo la expansión de consultas afecta la precisión de citación y el descubrimiento de contenido en diferentes temas e industrias.

A pesar de sus beneficios, la expansión de consultas presenta desafíos importantes que requieren estrategias de optimización cuidadosas. El problema de la sobreexpansión ocurre cuando se añaden demasiadas variaciones de consulta, introduciendo ruido y recuperando documentos irrelevantes que diluyen la calidad de las respuestas y aumentan los costos computacionales. La adaptación a dominios específicos es esencial porque las técnicas que funcionan bien para búsquedas generales pueden fracasar en campos especializados como la investigación médica o la documentación legal, donde la precisión terminológica es crítica. Las organizaciones deben equilibrar cobertura versus precisión—expandir lo suficiente para captar variaciones relevantes sin sobreexpandir al punto de que los resultados irrelevantes opaquen la señal. Los enfoques de validación efectivos incluyen pruebas A/B de diferentes estrategias de expansión frente a juicios de relevancia humana, el monitoreo de métricas como precisión@k y exhaustividad@k, y el análisis continuo de qué expansiones realmente mejoran el desempeño en tareas posteriores. Las implementaciones más exitosas emplean expansión adaptativa que ajusta la intensidad según las características de la consulta, el contexto del dominio y la calidad de recuperación observada, en lugar de aplicar reglas uniformes de expansión a todas las consultas.

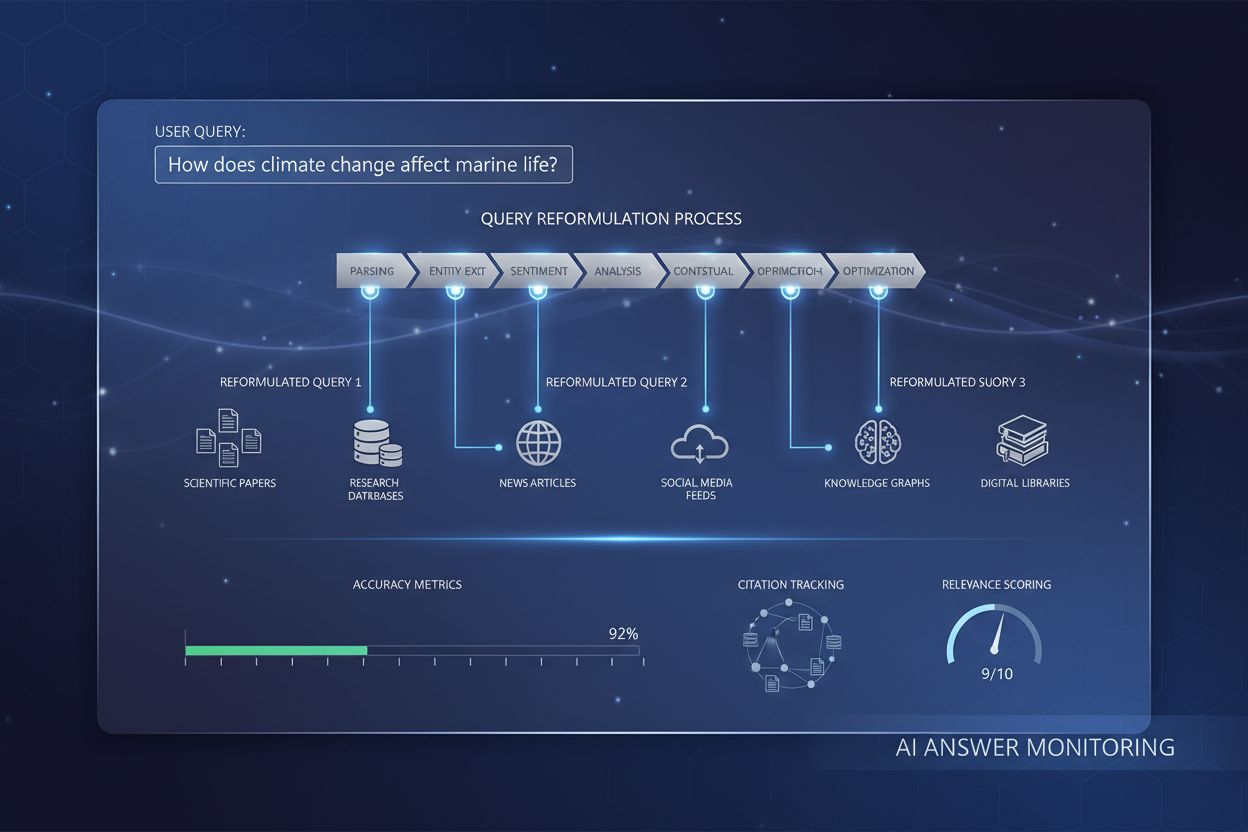

Para AmICited.com y plataformas de monitorización de IA, la optimización de expansión de consultas es fundamental para rastrear con precisión cómo los sistemas de IA citan y referencian fuentes en diferentes temas y contextos de búsqueda. Cuando los sistemas de IA utilizan consultas expandidas internamente, acceden a una gama más amplia de materiales fuente potenciales, lo que afecta directamente qué citas aparecen en sus respuestas y cuán exhaustivamente cubren la información disponible. Esto significa que monitorear la calidad de las respuestas de IA requiere comprender no solo lo que preguntan los usuarios, sino qué variaciones expandidas de la consulta podría estar usando el sistema de IA en segundo plano para recuperar información de apoyo. Las marcas y creadores de contenido deben optimizar su estrategia considerando cómo su material puede ser descubierto mediante expansión de consultas—usando múltiples variaciones terminológicas, sinónimos y conceptos relacionados en todo su contenido para asegurar visibilidad en diferentes formulaciones de consulta. AmICited ayuda a las organizaciones a rastrear esto monitoreando cómo su contenido aparece en respuestas generadas por IA para varios tipos y expansiones de consulta, revelando brechas donde el contenido podría pasar desapercibido por desincronización de vocabulario y proporcionando información sobre cómo las estrategias de expansión de consultas afectan los patrones de citación y el descubrimiento de contenido en sistemas de IA.

La expansión de consultas añade términos relacionados y sinónimos a la consulta original manteniendo intacta la intención principal, mientras que la reescritura de consultas reformula toda la consulta para ajustarse mejor a las capacidades del sistema de búsqueda. La expansión es aditiva—amplía el alcance de la búsqueda—mientras que la reescritura es transformadora, cambiando cómo se expresa la consulta. Ambas técnicas mejoran la recuperación, pero la expansión suele ser menos arriesgada ya que preserva la intención original de la consulta.

La expansión de consultas impacta directamente en qué fuentes descubren y citan los sistemas de IA porque cambia los documentos disponibles para la recuperación. Cuando los sistemas de IA usan consultas expandidas internamente, acceden a una gama más amplia de fuentes potenciales, lo que afecta las citas que aparecen en sus respuestas. Esto significa que monitorear la calidad de las respuestas de IA requiere comprender no solo lo que preguntan los usuarios, sino qué variaciones expandidas de la consulta podría estar usando el sistema de IA en segundo plano.

Sí, una sobreexpansión puede introducir ruido y recuperar documentos irrelevantes que diluyen la calidad de la respuesta. Esto ocurre cuando se añaden demasiadas variaciones de consulta sin el filtrado adecuado. La clave está en equilibrar la intensidad de la expansión para maximizar la mejora de la relevancia minimizando el ruido irrelevante. Las implementaciones eficaces usan expansión adaptativa que ajusta la intensidad según las características de la consulta y la calidad de recuperación observada.

Los grandes modelos de lenguaje han revolucionado la expansión de consultas al permitir una comprensión semántica de la intención del usuario y generar variaciones de consulta contextualmente apropiadas. La expansión basada en LLM utiliza técnicas de alineación de preferencias para entrenar modelos que generen expansiones que realmente mejoran los resultados de recuperación, en lugar de simplemente añadir sinónimos arbitrarios. Investigaciones recientes muestran que los enfoques basados en LLM pueden reducir el tiempo de procesamiento en un ~70% mientras mejoran la precisión de recuperación.

Las marcas deben utilizar múltiples variaciones terminológicas, sinónimos y conceptos relacionados en todo su contenido para asegurar la visibilidad en diferentes formulaciones de consulta. Esto implica considerar cómo tu material podría ser descubierto mediante expansión de consultas—usando términos técnicos y coloquiales, incluyendo frases alternativas y abordando conceptos relacionados. Esta estrategia asegura que tu contenido sea descubrible sin importar qué variaciones de consulta utilicen los sistemas de IA.

Las métricas clave incluyen precisión@k (relevancia de los k mejores resultados), exhaustividad@k (cobertura de contenido relevante en los k mejores resultados), Mean Reciprocal Rank (posición del primer resultado relevante) y desempeño en tareas posteriores. Las organizaciones también monitorean el tiempo de procesamiento, costos computacionales y métricas de satisfacción del usuario. Las pruebas A/B de diferentes estrategias de expansión frente a juicios de relevancia de evaluadores humanos ofrecen la validación más confiable.

No, son técnicas complementarias pero distintas. La expansión de consultas modifica la consulta de entrada para mejorar la recuperación, mientras que la búsqueda semántica utiliza embeddings y representaciones vectoriales para encontrar contenido conceptualmente similar. La expansión de consultas puede ser parte de una canalización de búsqueda semántica, pero la búsqueda semántica también puede funcionar sin expansión explícita. Ambas técnicas abordan la desincronización de vocabulario pero mediante mecanismos diferentes.

AmICited rastrea cómo los sistemas de IA citan y referencian fuentes en diferentes temas y contextos de búsqueda, revelando qué consultas expandidas llevan a que tu marca sea referenciada. Al monitorear patrones de citación entre varios tipos de consulta y expansiones, AmICited proporciona información sobre cómo las estrategias de expansión de consultas afectan el descubrimiento de contenido y la precisión de las citas en sistemas de IA como GPTs y Perplexity.

La optimización de expansión de consultas afecta cómo sistemas de IA como GPTs y Perplexity descubren y citan tu contenido. Usa AmICited para rastrear qué consultas expandidas llevan a que tu marca sea referenciada en respuestas de IA.

Descubre cómo la reformulación de consultas ayuda a los sistemas de IA a interpretar y mejorar las consultas de los usuarios para una mejor recuperación de info...

Aprenda cómo la Expansión de FAQ desarrolla pares integrales de preguntas y respuestas para sistemas de IA. Descubra estrategias para mejorar las citas de IA, l...

El refinamiento de consultas es el proceso iterativo de optimizar consultas de búsqueda para obtener mejores resultados en motores de búsqueda de IA. Descubre c...

Consentimiento de Cookies

Usamos cookies para mejorar tu experiencia de navegación y analizar nuestro tráfico. See our privacy policy.