Rilevamento dei contenuti AI

Scopri cos'è il rilevamento dei contenuti AI, come funzionano gli strumenti di rilevamento utilizzando machine learning e NLP, e perché sono importanti per il m...

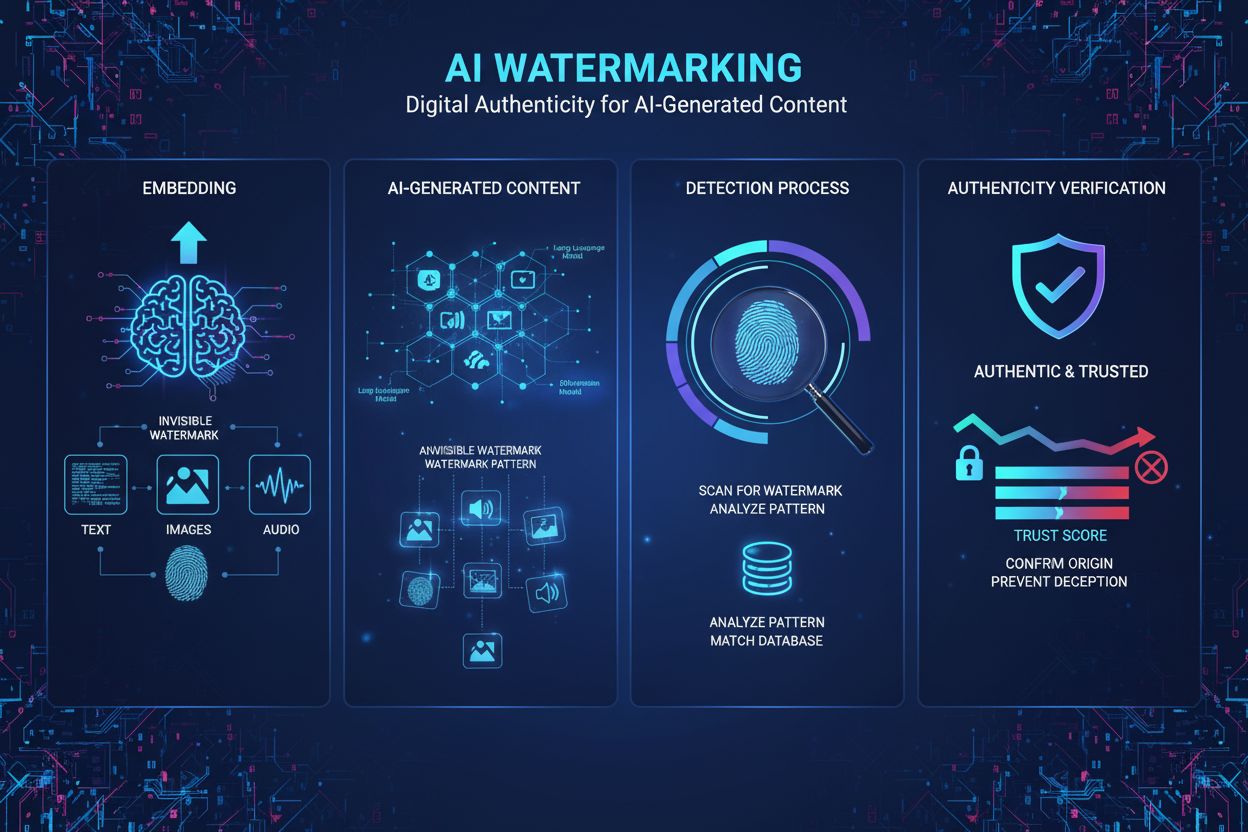

La filigranatura dei contenuti AI è il processo di inserimento di marcatori digitali invisibili o visibili all’interno di testi, immagini, audio o video generati dall’AI, per identificare e autenticare tali contenuti come creati da una macchina. Queste filigrane servono come impronte digitali che consentono la rilevazione, la verifica e il tracciamento dei materiali generati dall’AI su diverse piattaforme e applicazioni.

La filigranatura dei contenuti AI è il processo di inserimento di marcatori digitali invisibili o visibili all'interno di testi, immagini, audio o video generati dall'AI, per identificare e autenticare tali contenuti come creati da una macchina. Queste filigrane servono come impronte digitali che consentono la rilevazione, la verifica e il tracciamento dei materiali generati dall'AI su diverse piattaforme e applicazioni.

La filigranatura dei contenuti AI si riferisce al processo di inserimento di marcatori digitali, motivi o firme nei materiali generati dall’AI per identificarli, autenticarli e tracciarne l’origine. Queste filigrane funzionano come impronte digitali che distinguono i contenuti creati dalle macchine da quelli prodotti da esseri umani, sia per testi, immagini, audio che video. Lo scopo principale della filigranatura dei contenuti AI è fornire trasparenza sull’origine dei contenuti, contrastando la disinformazione, proteggendo la proprietà intellettuale e garantendo responsabilità in un panorama di intelligenza artificiale generativa in rapida espansione. A differenza delle tradizionali filigrane visibili su documenti o immagini fisiche, le moderne tecniche di filigranatura AI utilizzano spesso motivi invisibili rilevabili solo tramite algoritmi specializzati, preservando la qualità dei contenuti e garantendo robuste capacità di autenticazione.

Il concetto di filigranatura nasce nel mondo fisico, dove segni invisibili su banconote e documenti servivano come misura anticontraffazione. Con la diffusione dei media digitali, i ricercatori hanno adattato tecniche di filigranatura per immagini, audio e video negli anni ’90 e 2000. Tuttavia, l’emergere di sofisticati modelli generativi AI come ChatGPT, DALL-E e Midjourney nel 2022-2023 ha creato un urgente bisogno di metodi standardizzati di autenticazione dei contenuti AI. Il rapido progresso dell’AI nella produzione di contenuti sintetici sempre più realistici ha spinto governi, aziende tecnologiche e organizzazioni civili a considerare la filigranatura come misura di sicurezza fondamentale. Secondo una ricerca della Brookings Institution, oltre il 78% delle imprese riconosce l’importanza di strumenti di monitoraggio dei contenuti guidati dall’AI per gestire i rischi dei media sintetici. L’AI Act dell’UE, adottato formalmente a marzo 2024, è diventato il primo quadro normativo importante a imporre la filigranatura dei contenuti AI, richiedendo ai fornitori di sistemi AI di marcare i loro output come generati dall’AI. Questo slancio regolatorio ha accelerato la ricerca e lo sviluppo di tecnologie di filigranatura, con aziende come Google DeepMind, OpenAI e Meta che investono significativamente in soluzioni robuste.

La filigranatura AI opera attraverso due principali approcci tecnici: filigranatura visibile e filigranatura invisibile. Le filigrane visibili includono etichette, loghi o indicatori testuali evidenti aggiunti ai contenuti—come i cinque quadrati colorati che DALL-E inserisce nelle immagini generate o il preambolo di ChatGPT “come modello linguistico addestrato da OpenAI”. Sebbene semplici da implementare, le filigrane visibili sono facilmente rimovibili con modifiche di base. Al contrario, la filigranatura invisibile inserisce motivi sottili impercettibili all’occhio umano ma rilevabili da algoritmi specializzati. Per le immagini generate dall’AI, tecniche come le tree-ring watermark sviluppate all’Università del Maryland inseriscono motivi nel rumore iniziale prima del processo di diffusione, rendendole resistenti a ritaglio, rotazione e filtri. Nei testi generati dall’AI, la filigranatura statistica rappresenta l’approccio più promettente, in cui il modello linguistico privilegia certi token (“token verdi”) ed evita altri (“token rossi”) in base al contesto precedente. Questo crea una disposizione statisticamente insolita delle parole che gli algoritmi di rilevamento possono identificare con alta affidabilità. La filigranatura audio inserisce motivi impercettibili in bande di frequenza fuori dalla percezione umana (sotto i 20 Hz o sopra i 20.000 Hz), similmente alle immagini ma adattata alle proprietà acustiche. La tecnologia SynthID di Google DeepMind rappresenta la filigranatura moderna, addestrando congiuntamente modelli di generazione e rilevamento, garantendo robustezza alle trasformazioni e mantenendo la qualità dei contenuti.

| Metodo di filigranatura | Tipo di contenuto | Robustezza | Impatto sulla qualità | Richiede accesso al modello | Rilevabilità |

|---|---|---|---|---|---|

| Filigranatura visibile | Immagini, Video | Molto bassa | Nessuno | No | Alta (Umana) |

| Filigranatura statistica | Testi, Immagini | Alta | Minima | Sì | Alta (Algoritmica) |

| Basata su apprendimento automatico | Immagini, Audio | Alta | Minima | Sì | Alta (Algoritmica) |

| Tree-Ring Watermarking | Immagini | Molto alta | Nessuno | Sì | Alta (Algoritmica) |

| Provenienza dei contenuti (C2PA) | Tutti i media | Media | Nessuno | No | Media (Metadati) |

| Rilevazione post-hoc | Tutti i media | Bassa | N/D | No | Bassa (Inaffidabile) |

La filigranatura statistica rappresenta la tecnica più valida per autenticare i testi generati dall’AI, affrontando l’unicità che i testi non hanno lo spazio dimensionale disponibile in immagini o audio per inserire motivi. Durante la generazione, un modello linguistico riceve istruzioni per favorire certi token in base a una chiave crittografica nota solo allo sviluppatore. La casualità del modello viene “caricata” secondo questo schema, portandolo a selezionare preferenzialmente parole o frasi specifiche ed evitarne altre. I protocolli di rilevamento analizzano il testo generato per calcolare la probabilità che i motivi rilevati siano frutto del caso; motivi statisticamente improbabili indicano la presenza di una filigrana. Studi dell’Università del Maryland e di OpenAI hanno dimostrato che questo approccio può ottenere alta accuratezza di rilevamento senza compromettere la qualità del testo. Tuttavia, la filigranatura statistica nei testi presenta limiti intrinseci: risposte fattuali con poca flessibilità generativa (come soluzioni matematiche o fatti storici) sono più difficili da filigranare efficacemente, e riscritture o traduzioni in altre lingue possono ridurre notevolmente la confidenza nel rilevamento. L’implementazione SynthID Text, ora disponibile in Hugging Face Transformers v4.46.0+, offre filigranatura di livello produttivo tramite parametri configurabili come chiavi crittografiche e lunghezza degli n-grammi per bilanciare robustezza e rilevabilità.

Le immagini generate dall’AI beneficiano di approcci di filigranatura più sofisticati grazie all’elevato spazio dimensionale disponibile. La tree-ring watermarking inserisce motivi nascosti nell’immagine casuale iniziale prima del processo di diffusione, creando filigrane che sopravvivono a trasformazioni comuni come ritaglio, sfocatura e rotazione senza compromettere la qualità. La filigranatura basata su apprendimento automatico di Meta e Google utilizza reti neurali per inserire e rilevare filigrane impercettibili, raggiungendo oltre il 96% di accuratezza su immagini non modificate e mantenendo resistenza ad attacchi a livello di pixel. La filigranatura audio applica principi simili, inserendo motivi impercettibili in bande di frequenza fuori dalla percezione umana. AudioSeal, sviluppato da Meta, addestra generatori e rilevatori congiuntamente per creare filigrane robuste alle trasformazioni audio naturali mantenendo la qualità indistinguibile dall’originale. La tecnologia utilizza la perdita percettiva per assicurare che l’audio filigranato sia identico all’originale e la localizzazione della perdita per rilevare le filigrane nonostante le perturbazioni. Questi approcci dimostrano che la filigranatura invisibile può coniugare robustezza e preservazione della qualità se implementata correttamente, sebbene richieda accesso al modello AI sottostante per l’inserimento.

Il quadro normativo relativo alla filigranatura dei contenuti AI si è evoluto rapidamente, con diverse giurisdizioni che hanno introdotto o proposto requisiti obbligatori. L’AI Act dell’UE, adottato formalmente a marzo 2024, rappresenta il quadro più completo, imponendo ai fornitori di sistemi AI di marcare i loro output come generati dall’AI. Questo regolamento si applica a tutti i sistemi AI generativi distribuiti nell’Unione Europea, istituendo un obbligo legale di conformità. L’AI Transparency Act della California (SB 942), in vigore dal 1° gennaio 2026, impone ai fornitori AI coperti di mettere a disposizione strumenti gratuiti e pubblici per la rilevazione dei contenuti AI, rendendo di fatto obbligatoria la filigranatura o meccanismi equivalenti di autenticazione. Il National Defense Authorization Act (NDAA) degli Stati Uniti per l’anno fiscale 2024 include una competizione a premi per la valutazione delle tecnologie di filigranatura e incarica il Dipartimento della Difesa di studiare e sperimentare l’implementazione di “standard tecnici aperti di settore” per inserire informazioni sulla provenienza nei metadati. L’Executive Order on AI della Casa Bianca incarica il Dipartimento del Commercio di identificare e sviluppare standard per l’etichettatura dei contenuti generati dall’AI. Queste iniziative riflettono un consenso crescente che la filigranatura AI sia essenziale per trasparenza, responsabilità e protezione dei consumatori. Tuttavia, le sfide attuative rimangono significative, specie per i modelli open source, la coordinazione internazionale e la fattibilità tecnica di standard universali di filigranatura.

Nonostante i progressi tecnici, la filigranatura AI presenta limitazioni che ne condizionano l’efficacia pratica. La rimozione della filigrana è possibile tramite diverse tecniche di elusione: parafrasi dei testi, ritaglio o filtraggio delle immagini, traduzione dei contenuti o applicazione di perturbazioni avverse. Ricerche della Duke University hanno dimostrato attacchi proof-of-concept contro i rilevatori basati su apprendimento automatico, indicando che anche gli approcci sofisticati sono vulnerabili ad avversari determinati. Il problema della non universalità rappresenta un altro limite: i rilevatori sono specifici per modello, quindi per verificare l’origine dei contenuti occorre interrogare separatamente i servizi di ogni azienda AI. Senza un registro centralizzato e protocolli standardizzati, la verifica diventa inefficiente e frammentaria. I tassi di falsi positivi nella rilevazione, specie per i testi, restano problematici; gli algoritmi possono segnalare erroneamente contenuti umani come generati dall’AI o non rilevare filigrane dopo modifiche minori. La compatibilità con modelli open source pone sfide di governance, poiché le filigrane possono essere rimosse dal codice scaricato. Si può verificare una degradazione della qualità quando gli algoritmi impongono schemi troppo vincolanti, riducendo la qualità o la flessibilità di generazione, soprattutto per task fattuali o a output vincolato. Le implicazioni privacy della filigranatura—specie se includono dati identificativi—richiedono attente valutazioni politiche. Inoltre, la confidenza nella rilevazione cala sensibilmente con la lunghezza dei contenuti: testi brevi o molto modificati riducono la sicurezza della filigranatura, limitandone l’utilità in certi casi.

Il futuro della filigranatura AI dipende da continue innovazioni tecniche, armonizzazione normativa e dalla creazione di infrastrutture affidabili per la rilevazione e verifica. I ricercatori stanno esplorando filigrane pubblicamente rilevabili che mantengano la robustezza anche divulgando il metodo di rilevazione, abilitando la verifica decentralizzata senza dover dipendere da terzi. Gli sforzi di standardizzazione tramite organismi come ICANN o consorzi di settore potrebbero fissare protocolli universali, riducendo la frammentazione e consentendo una rilevazione efficiente tra piattaforme. L’integrazione con standard di provenienza come C2PA potrebbe creare approcci stratificati, combinando filigrane e tracciamento su base metadati. Lo sviluppo di filigrane robuste a traduzione e parafrasi resta un filone di ricerca attivo, con possibili applicazioni per l’autenticazione multilingue. Sistemi di verifica basati su blockchain potrebbero fornire registri immutabili della rilevazione e della provenienza, aumentando la fiducia nei risultati. Con l’avanzare delle capacità generative dell’AI, anche le tecniche di filigranatura dovranno evolvere per restare efficaci contro tentativi di elusione sempre più sofisticati. Lo slancio regolatorio dato dall’AI Act UE e dalla normativa californiana guiderà probabilmente l’adozione globale di standard, creando incentivi di mercato per soluzioni robuste. Tuttavia, è realistico aspettarsi che la filigranatura servirà soprattutto a gestire i contenuti generati dai modelli commerciali più diffusi, restando limitata negli scenari critici che richiedono rilevazione immediata. L’integrazione di piattaforme di monitoraggio dei contenuti AI come AmICited con l’infrastruttura di filigranatura consentirà alle organizzazioni di tracciare l’attribuzione del brand nei sistemi AI, assicurando il giusto riconoscimento quando i loro domini appaiono tra le risposte AI. Gli sviluppi futuri punteranno probabilmente sulla collaborazione umano-AI nell’autenticazione, combinando la rilevazione automatica delle filigrane con la verifica umana per applicazioni critiche nel giornalismo, nel legale e nell’integrità accademica.

Le filigrane visibili sono facilmente rilevabili dagli esseri umani, come loghi o etichette testuali aggiunte a immagini o clip audio, ma sono semplici da rimuovere o falsificare. Le filigrane invisibili inseriscono motivi sottili impercettibili alla percezione umana ma rilevabili da algoritmi specializzati, risultando molto più robuste contro tentativi di manomissione e rimozione. Le filigrane invisibili sono generalmente preferite per l'autenticazione dei contenuti AI poiché mantengono la qualità dei contenuti offrendo una sicurezza superiore contro l'elusione.

La filigranatura statistica per i testi opera influenzando sottilmente la selezione dei token da parte del modello linguistico durante la generazione. Lo sviluppatore del modello 'carica i dadi' utilizzando uno schema crittografico, facendo sì che il modello privilegi determinati 'token verdi' evitando i 'token rossi' in base al contesto precedente. Gli algoritmi di rilevamento analizzano poi il testo per verificare se i token privilegiati compaiono con una frequenza statisticamente insolita, indicando la presenza di una filigrana. Questo approccio preserva la qualità del testo mentre inserisce un'impronta rilevabile.

Le sfide principali includono la facilità di rimozione della filigrana tramite modifiche o trasformazioni minori, la mancanza di una rilevazione universale tra diversi modelli AI e la difficoltà di filigranare i testi rispetto a immagini o audio. Inoltre, la filigranatura richiede la collaborazione degli sviluppatori dei modelli AI, è incompatibile con rilasci open source e può degradare la qualità dei contenuti se implementata senza attenzione. I falsi positivi e falsi negativi nella rilevazione rimangono ostacoli tecnici rilevanti.

L'AI Act dell'UE, adottato formalmente a marzo 2024, richiede ai fornitori di sistemi AI di marcare i loro output come contenuti generati dall'AI. L'AI Transparency Act della California (SB 942), in vigore dal 1° gennaio 2026, impone ai fornitori AI coperti di mettere a disposizione strumenti gratuiti e pubblici per la rilevazione dei contenuti. Il National Defense Authorization Act (NDAA) degli Stati Uniti per l'anno fiscale 2024 include disposizioni per la valutazione delle tecnologie di filigranatura e lo sviluppo di standard industriali per la provenienza dei contenuti.

La filigranatura inserisce motivi identificativi direttamente nei contenuti generati dall'AI, creando un'impronta digitale permanente che persiste anche se il contenuto viene copiato o modificato. La provenienza dei contenuti, come lo standard C2PA, memorizza separatamente nei metadati informazioni sull'origine e la storia delle modifiche. La filigranatura è più robusta contro l'elusione ma richiede la collaborazione degli sviluppatori del modello, mentre la provenienza è più facile da implementare ma può essere rimossa copiando il contenuto senza metadati.

SynthID è la tecnologia di Google DeepMind che filigrana e identifica i contenuti generati dall'AI inserendo filigrane digitali direttamente in immagini, audio, testo e video. Per i testi, SynthID utilizza un elaboratore di logits che arricchisce la pipeline di generazione del modello per codificare le informazioni di filigranatura senza influire significativamente sulla qualità. La tecnologia impiega modelli di apprendimento automatico sia per inserire sia per rilevare le filigrane, risultando resistente agli attacchi comuni e mantenendo la fedeltà dei contenuti.

Sì, attori motivati possono rimuovere o aggirare le filigrane attraverso varie tecniche, tra cui parafrasare il testo, tagliare o filtrare immagini oppure tradurre i contenuti in altre lingue. Tuttavia, la rimozione di filigrane sofisticate richiede competenze tecniche e conoscenza dello schema di filigranatura. Le filigrane statistiche sono più robuste rispetto agli approcci tradizionali, ma la ricerca ha dimostrato attacchi proof-of-concept anche contro metodi di filigranatura avanzati, indicando che nessuna tecnica è completamente infallibile.

Inizia a tracciare come i chatbot AI menzionano il tuo brand su ChatGPT, Perplexity e altre piattaforme. Ottieni informazioni utili per migliorare la tua presenza AI.

Scopri cos'è il rilevamento dei contenuti AI, come funzionano gli strumenti di rilevamento utilizzando machine learning e NLP, e perché sono importanti per il m...

Scopri cos'è la generazione di contenuti AI, come funziona, i suoi vantaggi e sfide, e le best practice per utilizzare strumenti AI nella creazione di contenuti...

Scopri cosa significa creazione di contenuti AI-native, in che modo si differenzia dagli approcci tradizionali e come sfruttare le tecnologie AI per creare cont...

Consenso Cookie

Usiamo i cookie per migliorare la tua esperienza di navigazione e analizzare il nostro traffico. See our privacy policy.