ウィキペディア引用

ウィキペディア引用とは何か、その仕組み、そしてAI検索での可視性においてなぜ重要なのかを解説します。引用がChatGPT、Perplexity、Google AIにどのように伝播するかを理解しましょう。...

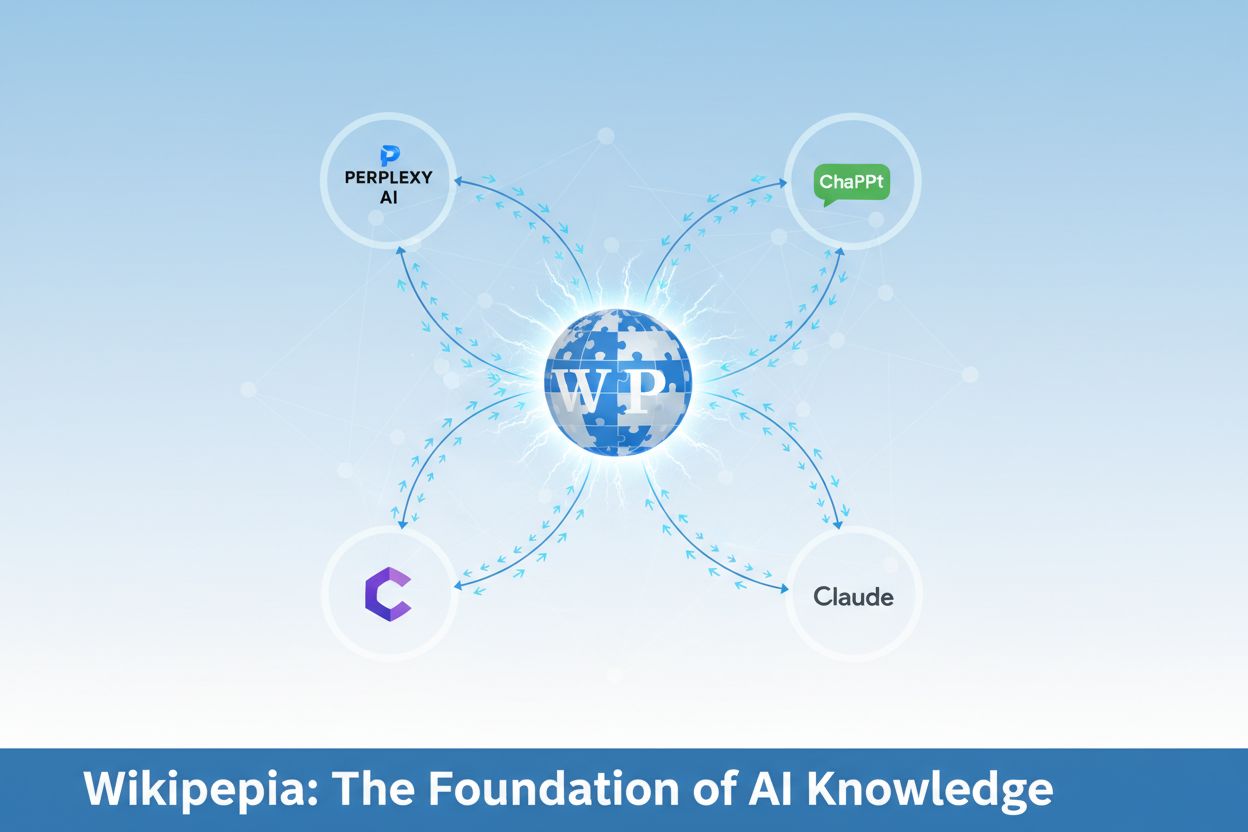

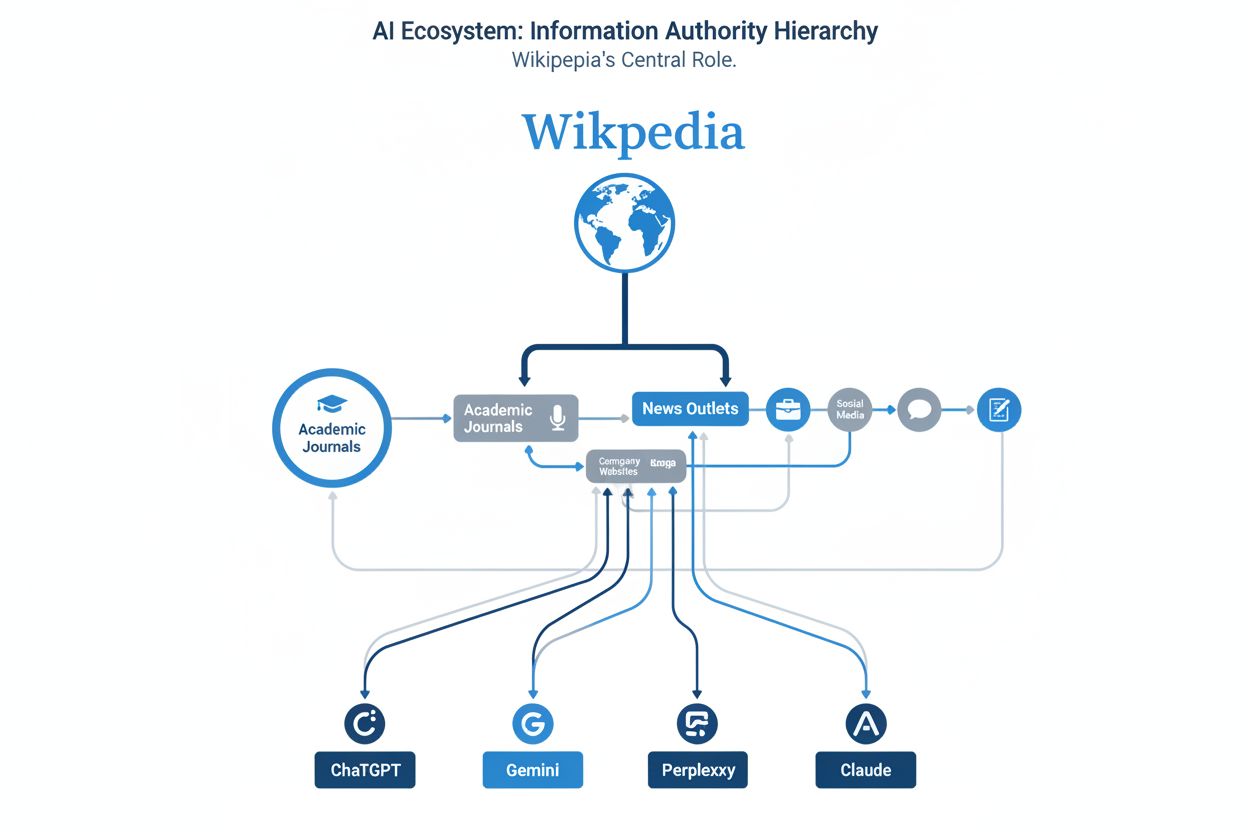

ウィキペディアは人工知能の“見えない背骨”となり、AIシステムがブランドや業界、トピックについてどのように理解し、情報を提示するかを形作っています。ChatGPTの7.8%の引用がウィキペディア由来、ビジネステーマのAI回答の84%がウィキペディアを引用している事実は、そのAI可視性への影響力の大きさを示しています。GPT-4からClaude、Geminiまで、すべての主要な大規模言語モデルがウィキペディアの膨大なデータベースで学習しており、AIシステムが知識を生成する基盤となっています。さらにAI回答の89%でウィキペディア引用が最初に登場することから、ブランドのウィキペディア掲載はAIが見込み顧客にどのように紹介するかへ直接影響します。AI可視性を目指す現代ブランドにとって、ウィキペディアは「選択肢」ではなく、「不可欠なインフラ」です。

AIシステムがウィキペディアを重視する根本的な理由は、その構造や方針が機械学習モデルの「信頼性評価」の仕組みに合致しているからです。ウィキペディアが他と一線を画す理由は以下の通りです。

中立的観点(NPOV)の厳守: ウィキペディアは中立的観点ポリシーを徹底しており、記事はバイアスや宣伝語を排して記述されます。そのためAIの学習や引用において、情報の信頼性が高まります。

コミュニティ主導のファクトチェック: ウィキペディア上のあらゆる主張は、世界中の数千人の編集者によって精査され、誤りや誤情報が従来の出版物より速く発見・修正されます。

構造化された引用システム: ウィキペディアはインライン引用と厳格なフォーマットを義務付け、AIが主張の出典をたどり元情報を検証できるようになっています。

信頼性基準の維持: ウィキペディアは信頼できる情報源のガイドラインが厳格で、質の低い情報や宣伝的コンテンツは自動的に排除されます。AIが独自に評価しきれない情報もフィルタリングされるのです。

AIシステムにとって、すべての引用が同じ重みを持つわけではありません。以下の比較から、ウィキペディアの引用がAIの学習や回答生成でどれほど重視されているかが分かります。

| 情報源の種類 | 信頼性スコア | AI学習での利用 | 検証可能性 | 永続性 |

|---|---|---|---|---|

| ウィキペディア | 非常に高い | 広範囲 | 完全に追跡可能な引用 | 編集履歴付きで恒久的 |

| プレスリリース | 低〜中 | 限定的 | 多くが自己発信 | 頻繁に削除・アーカイブ |

| 企業ウェブサイト | 中 | ごくわずか | 循環参照 | 削除されやすい |

| SNS | 低 | 稀 | 検証困難 | 一時的・消えやすい |

ウィキペディアの引用は信頼性の増幅器として機能します。というのも、公開前に複数の検証プロセスをクリアしているからです。AIがウィキペディア引用を検出した場合、それは「人間の編集者による検証」「信頼できる情報源の裏付け」「世界的知識ベースに掲載されるだけの重要性」を担保している証拠と見なされます。これは、宣伝色の強いプレスリリースや独立検証のない企業サイトとは根本的に異なります。また永続性も重要です。ウィキペディアの記事は編集履歴を全て保持し、AIは情報の変遷や修正履歴も追跡できます。一方プレスリリースはウェブから消えたり、AIがアクセスできない形でアーカイブされがちです。AIへの引用を目指すブランドにとって、**「ウィキペディア引用こそが信頼性・検証性・永続性の三拍子を兼ね備えた“ゴールドスタンダード”」**というメッセージがはっきりしています。

ウィキペディアで倫理的に引用されるには、掲載可否を左右する4つの基本方針を理解しておく必要があります。これらは単なるルールではなく、「AIにとってウィキペディアが信頼できる」土台そのものです。

ノートビリティ(知名度): ウィキペディアには、すべての人物・企業・製品が掲載されるわけではありません。信頼できる独立情報源で十分に取り上げられていることが必要です。ブランドの場合、単なる自社発信やプレスリリースではなく、記者や業界アナリスト、研究者にしっかり書かれている必要があります。重要なのは「自分にとっての重要性」ではなく、「世界にとっての重要性」です。

検証可能性: ウィキペディアのすべての記述は、信頼できる情報源にたどれる必要があります。これは誤情報防止とAIによる独自検証を担保するためです。投稿や記事改善時は、主要メディア、学術誌、業界誌、政府データベースなど信頼できる情報源による裏付けが必須です。自己発信や宣伝資料、未検証の主張は禁止です。

中立的観点(NPOV): ウィキペディア記事は、賛美やバイアス、宣伝意図を排して記述しなければなりません。実績は事実として淡々と記載し、功績だけでなく批判も併記し、宣伝語ではなく中立的な表現を使います。NPOVこそAIがウィキペディアを信頼する理由です。

独自研究の禁止: ウィキペディアは三次情報源であり、二次情報源の内容をまとめる場所です。自社独自の研究や内部データ、未発表リサーチは直接引用できません。独自研究が信頼できる独立情報源で取り上げられるのを待ち、その情報源を引用する必要があります。この方針によって、ウィキペディアが「確立した知識」の反映であり、「新情報や独自主張の発信源」にならないようになっています。

信頼できる情報源の基準: ウィキペディアは信頼できる情報源リストを詳細に管理しています。一般的には、主要新聞社・通信社、査読付き学術誌、確立した業界誌、著名出版社の書籍、政府データベース、認定組織のレポートなどが該当します。反対に、自社ブログ、SNS投稿、プレスリリース、自己発信物、明確な利益相反があるサイトなどは該当しません。

多くのブランドが後になって気付く不都合な真実があります。「自分でウィキペディアを編集してブランドを宣伝することはできません」。これは推奨事項ではなく、ウィキペディアのコミュニティが厳格に運用する基本方針で、違反すれば永久追放もあり得ます。

利益相反(COI)ポリシー: ウィキペディアは、自分自身・雇用主・クライアントについて記事に大幅な編集を加えることを明確に禁止しています。理由は単純明快で、「自己について書くと必然的にバイアスがかかり、宣伝を許せばウィキペディアの信頼性が損なわれる」からです。⚠️注意: 直接編集は投稿の削除やアカウントのフラグ付けにつながる最速ルートです。たとえ正確で根拠があっても、COIがあるだけで差し戻されます。

なぜ直接編集は失敗するのか: ウィキペディア編集者は宣伝語や自己利益的な編集、知名度の水増しを見抜く訓練を受けています。自己宣伝のパターンを特定するツールや、COI回避のための偽アカウント(ソックパペット)を見抜くノウハウもあります。仮にうまく編集できても、他の編集者にトーンやタイミングを怪しまれ、結局差し戻されます。

違反の結果: COIポリシー違反は、アカウント停止、記事の差し戻し、悪質な場合は永久追放となります。技術的なペナルティだけでなく、コミュニティからの信頼を失い、今後正当な手段で編集者と協力するのが難しくなります。

正しいアプローチ: ブランド記事を改善したい場合は、トークページを使いましょう。ここは編集者同士が変更を議論する場で、利益相反を開示し、具体的な改善案(根拠付き)を提案し、独立編集者が実装判断を下します。これがウィキペディアの方針を尊重しつつ、自分の意見も伝えられる唯一の倫理的手段です。

透明性の要件: 編集者とやり取りする場合は、必ず自分の関係性を開示しましょう。多くの編集者は誠実な透明性を評価し、率直な説明があれば協力してくれます。関係性を隠すことは、開示するよりはるかにダメージが大きいです。

ウィキペディアで引用を獲得するには、システムをかいくぐるのではなく、本物の知名度を築くための長期的な戦略が必要です。倫理的なプレイブックはこちら。

1. 信頼できる情報源となる素材を生成

2. 関連ウィキペディアページを特定

3. 引用の空白を監査

4. 中立的な文言を準備

5. トークページで透明に提案

6. 継続的な監視と維持

ウィキペディアは、すでに世間で十分な評価を得ているブランドしか引用しません。そのためには多角的なアプローチで「ウィキペディアに値する権威」を築きましょう。

信頼できる媒体でのメディア露出: 主要新聞、ビジネス誌、業界誌に取り上げられましょう。ウィキペディア編集者はThe New York Times、Wall Street Journal、Forbesなどの掲載を重視します。これは知名度確立の最重要要素です。

業界賞や公的な評価の獲得: 認定団体、アナリスト、業界団体から表彰された実績を持ちましょう。第三者評価は自己宣伝とは異なる客観的指標です。

オピニオンリーダーとしての発信: 他者に引用される研究やホワイトペーパー、業界に影響を与えるインサイトを発信しましょう。

研究成果の創出: メディアで取り上げられる独自調査やデータ分析を行いましょう。調査やデータは客観的かつ検証性が高く、引用されやすいです。

学術・アナリストとの連携: Gartner、Forrester、IDCといったアナリストレポートや、学術的な引用もウィキペディア編集者から高く評価されます。

原則は明快です。ウィキペディアは「すでに世界で重要と認められたブランド」を引用するのであり、ウィキペディア内での重要性を示そうとするブランドを引用するのではありません。まず権威を築き、その後にウィキペディアで引用されるのが自然な流れです。

ウィキペディアで引用される価値は、ウィキペディア内だけにとどまりません。そこからAIエコシステム全体へ引用が波及するスタート地点となります。このネットワーク効果を理解すれば、ウィキペディア掲載がAI可視性にどれだけ重要かが分かります。

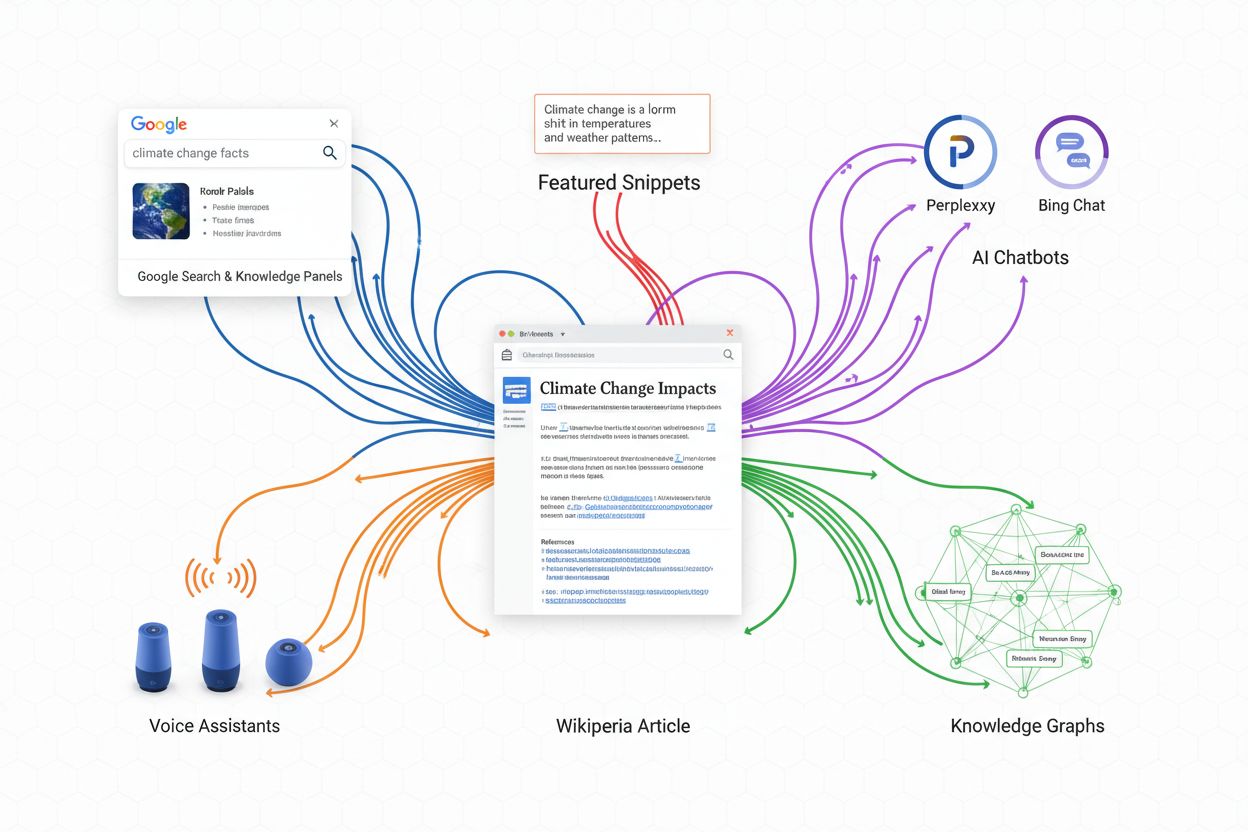

ブランドがウィキペディア記事で正しく引用されると、その引用はGoogleナレッジパネルに取り込まれ、検索者への情報提示に直接影響します。さらにPerplexityやBing ChatのようなAI検索エンジンでは、ブランドや業界情報への回答でウィキペディアを明示的に引用します。AlexaやGoogleアシスタントなどの音声アシスタントもウィキペディア情報に大きく依存しているため、音声検索での説明文にも影響します。

検索以外でも、ウィキペディア引用はナレッジグラフ(AIによる事実・関係性・エンティティ理解のための構造化データベース)に反映されます。ブランドがウィキペディアで信頼できる情報源とともに言及されれば、AIはその情報をナレッジグラフに組み込み、様々なAIアプリケーションで活用できるようにします。だからこそAI回答の89%でウィキペディア引用が最初に登場するのです。単なる情報源のひとつではなく、他AIシステムが参照・構築する「権威ある情報源」なのです。

Google検索結果のトップに表示されるフィーチャードスニペットもウィキペディアの内容から抜粋されることが多いです。ブランドがウィキペディアで引用されていれば、その情報が高可視性のポジションに表示される可能性が高まります。ネットワーク効果により、たった1つのウィキペディア引用が、数十のAIプラットフォームや検索インターフェイスに一斉に波及します。だからこそ、ウィキペディアへの投資はAI可視性で「費用対効果が抜群」と言えるのです。単なる1引用ではなく、**「デジタルエコシステム全体で反響し続ける引用」**を獲得できるのです。

ウィキペディアで引用を獲得するのは始まりに過ぎません。維持管理には継続的な注意と戦略が欠かせません。アクションチェックリストはこちら。

監視アラートの設定

定期監査の実施

古い情報の更新

編集へのプロフェッショナルな対応

長期的な資産管理

ウィキペディア引用獲得への道には、近道を選んで失敗したブランドが数多く存在します。努力を水の泡にする失敗例は以下の通りです。

| やってはいけない | やるべきこと |

|---|---|

| 自分でウィキペディア記事を直接編集 | トークページ経由で利益相反を開示し提案 |

| プレスリリースを主な情報源に使う | 独立系メディアでの報道を引用 |

| 宣伝やマーケティング語を使う | 中立かつ事実に基づいたトーンで執筆 |

| ソックパペットアカウントで身元を隠す | 関係性を透明に開示 |

| 編集者に依頼し開示せずに修正させる | 公開・透明な議論に参加 |

⚠️ 重大な警告: 隠れアカウント、不開示の有償編集、宣伝語を装った中立的な表現など、ウィキペディアの方針を欺く行為は、信用に永久的なダメージを残します。ウィキペディアのコミュニティはこれらの手口を見抜くノウハウを持ち、アカウント停止以上の結果を招きます。一度「不正編集」とマークされると、以降の正当な投稿も厳しく監視され、正規引用の獲得は極めて困難になります。

最も多い失敗は「焦り」です。ブランドはウィキペディア引用をすぐに得たいと考え、方針違反の近道を選びがちです。しかし倫理的アプローチは時間がかかるものの、長期的な成果をもたらします。メディア露出や業界評価による本物の知名度を築き、ウィキペディア編集者と透明に協力して初めて、その知名度が正当に記録されます。これこそがウィキペディアの理念を尊重しつつ、ブランドを持続的にAIで可視化する最善策なのです。

AIシステムは宣伝的なコンテンツよりも百科事典的で中立的な情報源を優先します。ウィキペディアは、ChatGPTやClaudeなど主要なLLMの主要な学習データです。調査によると、ビジネステーマのAI回答の84%にウィキペディアの引用が含まれているのに対し、企業サイトはわずか31%です。つまり、ウィキペディアで言及されることで、自社メディアよりはるかに多くのAIシステムにブランドが届くのです。

いいえ。ウィキペディアの利益相反(COI)ポリシーにより、トピックと直接関係のある人がその内容を編集することは禁止されています。自己編集を行うと、投稿が削除され、アカウントがマークされてしまいます。代わりに、トークページを使って利益相反を開示しつつ、透明性をもって編集提案を行ってください。この倫理的なアプローチの方が、成功する可能性がはるかに高いです。

信頼できる情報源には、主流メディア(BBC、The Guardian、Forbes)、査読付き学術誌、政府文書、確立された業界誌が含まれます。プレスリリース、自社サイト、SNSは該当しません。ウィキペディアは独立した公開情報源で、読者が検証できるものを求めます。この厳格な基準が、AIシステムが情報を信頼できる理由です。

PerplexityのようなリアルタイムAI検索エンジンは、ウィキペディアの更新をほぼ即時に反映します。ChatGPTのような大規模言語モデルは、定期的に新データで再学習されるため、反映まで数週間から数か月かかる場合があります。Googleナレッジパネルは通常、数日から数週間以内にウィキペディアの更新を表示します。引用が数週間安定していると、AIの学習データセットに組み込まれる可能性が高くなります。

ウィキペディアの引用は、CS1(Citation Style 1)標準化に従い、特定の主張を完全な書誌情報で検証する構造化された参照です。機械可読で元の情報源まで追跡可能です。ハイパーリンクは検証構造のない単なるナビゲーション手段です。ウィキペディアの検証可能性ポリシーに引用は不可欠ですが、リンクは補助的です。AIシステムは引用を信頼性のシグナルとして認識し、優先します。

自ブランド名+「ウィキペディア」でGoogleアラートを設定しましょう。関連するウィキペディアのトークページを監視し、ブランドを言及する記事の編集通知にも登録してください。四半期ごとに監査を行い、情報と引用が正確か確認しましょう。AmICitedなどのツールを使えば、ウィキペディアの引用がAIや検索エンジンでどう拡散されているかを追跡できます。

編集は差し戻され、アカウントはフラグ付けやブロック、悪質な場合は永久追放となることもあります。技術的な結果にとどまらず、ウィキペディアのコミュニティからの信用を失い、今後の正当な投稿もしづらくなります。極端な場合、あなたのサイトがウィキペディアで情報源としてブラックリストに載ることも。透明性が常に最善の方法です。

メディア露出で信頼できる媒体に取り上げてもらいましょう。業界団体からの受賞や評価を得てください。他者に引用される研究やオピニオンリーダーとしての発信も有効です。学術研究やアナリストレポートに参加するのも効果的です。重要なのは、ウィキペディアは「世界にとって重要である」と認められたブランドを引用するということ。まず本物の権威を築けば、ウィキペディアの引用は自然とついてきます。

ウィキペディア引用とは何か、その仕組み、そしてAI検索での可視性においてなぜ重要なのかを解説します。引用がChatGPT、Perplexity、Google AIにどのように伝播するかを理解しましょう。...

ウィキペディアの著名性がAIでの可視性にどのように影響するかを解説します。著名性基準の4本柱、ウィキペディアの内容がAIトレーニングデータセットに与える影響、そしてウィキペディア上でブランドの存在感を高めるための倫理的な戦略について学びましょう。...

ウィキペディアの引用がAIの学習データにどのように伝播し、ChatGPT、Gemini、Perplexity、その他のAIプラットフォーム全体でブランドの可視性に影響を与えるかを学びましょう。ウィキペディア・リップル効果とAI可視性への影響を理解しましょう。...

クッキーの同意

閲覧体験を向上させ、トラフィックを分析するためにクッキーを使用します。 See our privacy policy.