エンタープライズAI可視化ソリューション:最適なプラットフォームの選び方

エンタープライズAI可視化ソリューションの完全ガイド。Conductor、Profound、Athenaなどの主要プラットフォームを比較。大企業向けの評価基準や選定戦略も解説。...

エンタープライズAI可視化戦略とは、組織が自社インフラ内で稼働するすべての人工知能システム、モデル、アプリケーションを監視・追跡・理解するために実施する包括的なアプローチを指します。この戦略には、どのAIシステムが使われているか、それらがどのように機能しているか、誰が使用しているか、そして組織全体にどのようなリスクがあるかを可視化する能力が含まれます。何百、何千ものAI導入を管理する大規模企業にとって、可視化は極めて重要です。なぜなら、シャドーAI(未承認または記録されていないAIツール)は、適切な監督がなければ急速に拡大する可能性があるからです。包括的な可視化がなければ、組織はコンプライアンスの確保、リスク管理、パフォーマンス最適化、AI投資からの最大価値の引き出しができません。

エンタープライズAI可視化戦略とは、組織が自社インフラ内で稼働するすべての人工知能システム、モデル、アプリケーションを監視・追跡・理解するために実施する包括的なアプローチを指します。この戦略には、どのAIシステムが使われているか、それらがどのように機能しているか、誰が使用しているか、そして組織全体にどのようなリスクがあるかを可視化する能力が含まれます。何百、何千ものAI導入を管理する大規模企業にとって、可視化は極めて重要です。なぜなら、シャドーAI(未承認または記録されていないAIツール)は、適切な監督がなければ急速に拡大する可能性があるからです。包括的な可視化がなければ、組織はコンプライアンスの確保、リスク管理、パフォーマンス最適化、AI投資からの最大価値の引き出しができません。

エンタープライズAI可視化戦略とは、組織が自社インフラ内で稼働するすべての人工知能システム、モデル、アプリケーションを監視・追跡・理解するために実施する包括的なアプローチを指します。この戦略には、どのAIシステムが使われているか、それらがどのように機能しているか、誰が使用しているか、そして組織全体にどのようなリスクがあるかを可視化する能力が含まれます。何百、何千ものAI導入を管理する大規模企業にとって、可視化は極めて重要です。なぜなら、シャドーAI(未承認または記録されていないAIツール)は、適切な監督がなければ急速に拡大する可能性があるからです。規模が大きくなるほど課題は深刻化し、85%の企業が何らかの形でAIを利用している一方で、**明確なビジネス価値を報告しているのはわずか11%**にとどまり、導入と効果的な管理の間に大きなギャップがあることを示しています。包括的な可視化がなければ、組織はコンプライアンスの確保、リスク管理、パフォーマンス最適化、AI投資からの最大価値の引き出しができません。

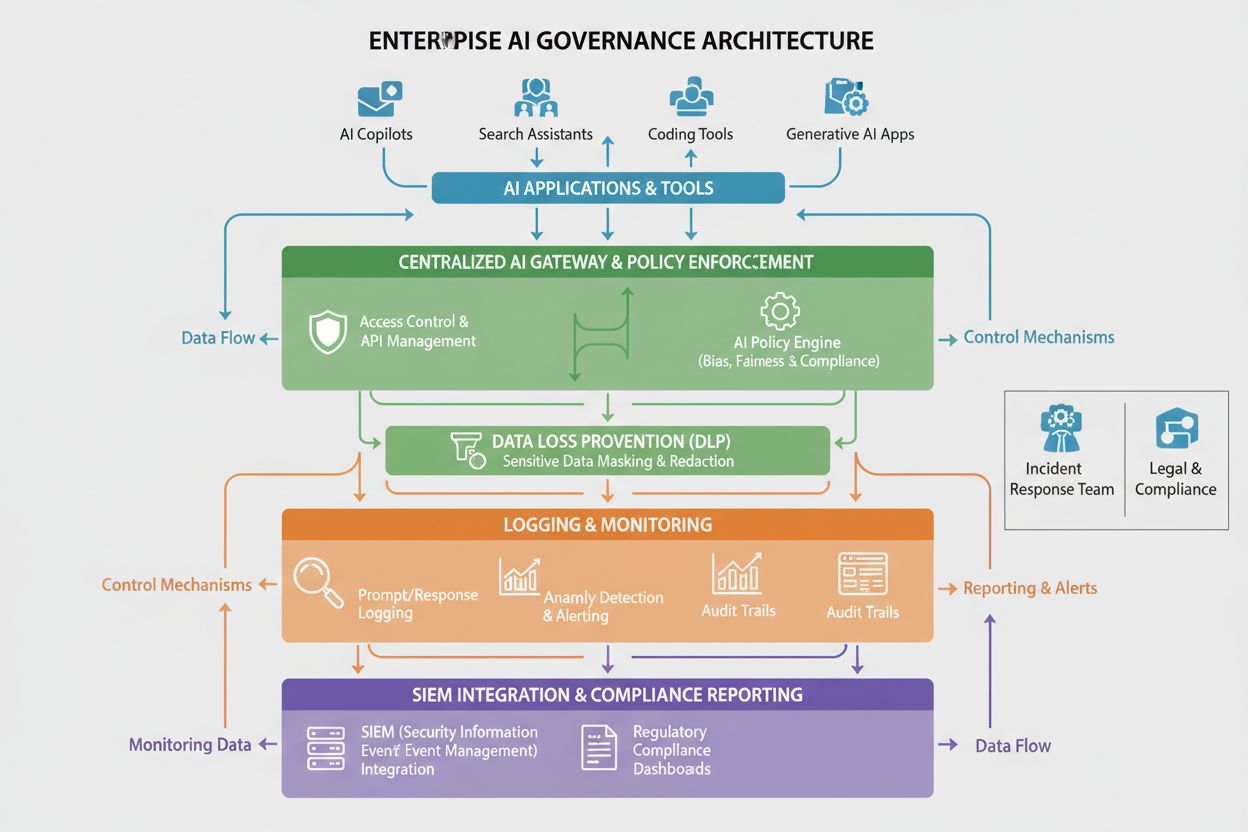

エンタープライズAI可視化は、AIシステムとその影響について組織全体の認識を提供する3つの相互に関連した側面で機能します。第一の側面である利用状況監視では、どのAIシステムが導入されているか、誰がアクセスしているか、利用頻度、ビジネスでの用途を追跡します。第二の側面である品質監視は、AIモデルが意図通りに機能し、精度基準を維持し、データドリフトやモデル劣化による性能低下が発生しないようにします。第三の側面であるセキュリティ監視は、不正アクセス・情報漏洩・プロンプトインジェクション攻撃から守り、規制要件への準拠を保証します。これら3つの側面は、中央集約的なログ取得、リアルタイムダッシュボード、自動アラートシステムによって支えられ、連携して機能する必要があります。3側面すべてにわたる包括的な可視化を実施している組織は、ガバナンス成果やインシデント対応速度が大きく向上しています。

| 側面 | 目的 | 主な指標 |

|---|---|---|

| 利用状況監視 | AIシステムの導入と利用パターンを追跡 | アクティブユーザー数、APIコール数、モデルバージョン、事業部門での採用状況 |

| 品質監視 | モデル性能と信頼性の確保 | 精度、適合率、再現率、予測ドリフト、レイテンシ |

| セキュリティ監視 | 脅威からの保護とコンプライアンス確保 | アクセスログ、異常検知数、ポリシー違反、監査証跡 |

大規模かつ複雑な環境で包括的なAI可視化を実現しようとする際、組織は多くの障害に直面します。シャドーAIは最大の課題の一つであり、従業員や部門がIT部門の認知や承認なしにAIツールを導入することで、中央集約的な監視やガバナンスを妨げる死角が生まれます。データサイロによって部門ごとに情報が断片化され、AI利用パターンの相関や作業重複・リソース浪費の特定が困難になります。統合の複雑さも問題となり、従来型システムやクラウド基盤、多様なAIフレームワークと可視化ツールを接続する必要がありますが、これらは監視を前提に設計されていないことが多いです。規制の断片化も、地域ごとに異なる可視化基準が求められ、柔軟で適応性の高い監視基盤が必要になります。さらに、ITリーダーの84%が正式なガバナンスプロセスを持っていない、72%の組織がデータ品質課題を抱えているといった現状により、可視化指標そのものの信頼性が損なわれています。

主な可視化課題:

効果的なエンタープライズAI可視化には、確立されたガバナンスフレームワークや標準との整合性が必要です。これらは監視活動に構造と信頼性を与えます。**NIST AIリスク管理フレームワーク(RMF)**は、AIリスクの特定・測定・管理のための包括的アプローチを提供し、可視化要件の基盤となります。ISO/IEC 42001はAIマネジメントシステムの国際標準であり、監視・記録・継続的改善の要件が可視化目的と合致します。EU AI法は高リスクAIシステムに厳格な透明性・記録義務を課し、AIシステムの行動や意思決定プロセスの詳細記録を義務付けています。業界固有のフレームワークも追加要件を定めており、金融サービスでは銀行規制当局のAIガバナンス基準、ヘルスケアでは臨床AIシステムに関するFDA要件、政府機関では連邦AIガバナンス指令などがあります。組織は自社の業界・地域・リスク特性に合ったフレームワークを選定し、選択した基準への準拠を示す可視化基盤を構築すべきです。

エンタープライズAI可視化を実現するには、AIシステムの挙動や性能に関するデータを収集・処理・表示する堅牢な技術基盤が必要です。中央集約型AIプラットフォームは可視化基盤の中核となり、導入場所を問わずすべてのAIシステムを一元的に監視できます。AIゲートウェイはアプリケーションとAIサービスの間でやり取りされるリクエスト・レスポンスのメタデータを取得し、詳細な利用状況追跡やセキュリティ監視を可能にします。包括的なログシステムは、AIシステムの全活動・モデル予測・ユーザー操作・システム性能指標を中央リポジトリに記録し、監査証跡やフォレンジック分析を支援します。**データ損失防止(DLP)**ツールは、AIシステムによる機密情報の流出を監視し、モデルが機密データで学習されたり、応答で保護されたデータを返したりするのを防ぎます。SIEM連携でAI可視化データを他のセキュリティ情報・イベント管理システムと統合し、AI関連セキュリティイベントと他の脅威を相関分析できます。これら技術要素を導入した組織では、AI関連セキュリティインシデントの対応時間が30%短縮したという報告もあります。Liminal、Ardoq、Knosticなどのプラットフォームはガバナンス特化の可視化ソリューションを提供し、AmICited.comはGPTs、Perplexity、Google AI OverviewsにおけるAI回答品質の監視を専門としています。

エンタープライズAI可視化の成功には、責任分担が明確な組織構造と役割定義が不可欠です。AIガバナンス委員会は、AI可視化戦略を統括し、ポリシー策定・ビジネス目標・規制要件との整合性を担保します。モデルオーナーは特定AIシステムの責任者として、組織標準に従った記録・監視・保守を管理します。各事業部門のAIチャンピオンは、ITガバナンスチームと現場ユーザーの橋渡し役として可視化実践を推進し、シャドーAIの早期発見に貢献します。データスチュワードは、AIシステムの学習・監視に使われるデータの品質・アクセス性を管理し、可視化指標の信頼性を担保します。セキュリティ・コンプライアンスチームは監視要件を策定し、監査を実施し、可視化基盤が規制義務を満たしていることを保証します。こうした明確な責任体制により、可視化はIT部門だけの責任ではなく、ビジネス・技術・ガバナンス部門が連携して取り組む全社的なコミットメントとなります。

組織は、AI可視化戦略が価値を生み、組織目標を支援しているかどうかを評価するために、明確なKPI(主要業績評価指標)と測定フレームワークを確立する必要があります。可視化カバレッジは、記録・監視されているAIシステムの割合を測定し、成熟組織は全AI導入の95%以上を目標とします。ガバナンス成熟度は、アドホック監視から標準化、さらに最適化・自動化されたガバナンス段階への進展をCMMIモデル等のフレームワークで管理します。インシデント検知・対応指標は、AI関連課題の特定・対応速度を測定し、検知・対応の迅速化が効果的な可視化の証となります。コンプライアンス遵守は、AIシステムが規制や内部基準を満たしている割合を追跡し、監査結果や是正期間も指標となります。事業価値実現は、可視化投資がリスク低減、モデル性能向上、AI施策の市場投入期間短縮、リソース配分最適化などの具体的成果につながっているかを測定します。リアルタイムダッシュボードでこれら指標をステークホルダーに可視化し、継続的なモニタリングと迅速な軌道修正を可能にしましょう。

業界ごとに規制環境・リスク特性・ビジネスモデルが異なり、AI可視化要件にも個別の対応が求められます。金融サービスでは、貸付判断・不正検知・トレーディングアルゴリズムに用いるAIシステムの詳細監視やバイアス検出・公平性指標の重視など、銀行規制当局の期待に応える必要があります。ヘルスケアでは、臨床AIシステムの性能検証・安全性監視・意思決定への影響記録など、FDA要件への準拠が必要です。法律分野では、契約分析・法務リサーチ・デューデリジェンスにAIを用いる際、モデルの学習データの可視化により機密保持や弁護士・依頼者間特権を守る必要があります。行政機関は、連邦AIガバナンス指令への準拠(透明性・バイアス監査・意思決定の記録)を通じて公共責任を果たさなければなりません。小売・ECでは、推薦エンジンやパーソナライゼーションAIの消費者保護・公正競争法遵守のための監視が求められます。製造業では、品質管理・予知保全AIシステムの安全性・信頼性を追跡する必要があります。業界固有の可視化要件は、ガバナンスフレームワークに組み込むべきであり、別個のコンプライアンス対応として扱わないようにしましょう。

エンタープライズAI可視化の導入には、クイックウィンを積み重ねながら包括的・成熟したガバナンス体制を目指す段階的アプローチが推奨されます。まずインベントリ化と記録から始め、現在利用中の全AIシステム(シャドーAIを含む)を監査し、各システムの目的・責任者・データソース・ビジネス重要度を記録した中央レジストリを作成しましょう。クイックウィンの特定として、初期監視対象を顧客対応AIや機微情報処理AI、重要意思決定AIなど高リスクシステムに絞ります。中央集約型ログ取得を基盤機能として導入し、全AIシステムの活動メタデータを取得することでリアルタイム監視と履歴分析の両方を可能にします。ガバナンスポリシーを策定し、AIシステムの記録・監視・コンプライアンス基準を定義し、全ステークホルダーに明確に伝えましょう。IT・セキュリティ・ビジネス・コンプライアンスのクロスファンクショナルチームを編成し、多角的な懸念をカバーできる可視化施策を推進します。進捗を測定・共有し、可視化指標をリーダー層に報告してガバナンス投資の価値を示し、AI可視化基盤への継続的な組織的支持を得ましょう。

AI可視化はAIシステムが何をしているかを見て監視する能力であり、AIガバナンスはAIシステムがどのように開発・導入・利用されるかを管理するためのより広範なポリシー、プロセス、コントロールの枠組みです。可視化はガバナンスの基盤的要素であり、見えないものをガバナンスすることはできません。効果的なAIガバナンスには、利用状況・品質・セキュリティ監視という3つの側面すべてにわたる包括的な可視化が必要です。

大規模組織は、複数の部門・クラウドプロバイダー・事業ユニットにまたがる何百、何千ものAI導入を管理する独自の課題に直面しています。包括的な可視化がなければ、シャドーAIが拡大し、コンプライアンスリスクが増加し、AI投資の最適化や責任あるAI活用ができません。可視化によりリスクの特定、ポリシーの強制、AI施策からの最大価値の引き出しが可能になります。

AI可視化が不十分だと、複数のリスクが生じます。シャドーAIが監督なしで稼働し、監視されていないAIシステムを通じて機密データが漏洩し、コンプライアンス違反が見逃され、モデル性能の低下やセキュリティ脅威が検知されず、ガバナンスを規制当局に示すこともできません。これらのリスクは、情報漏洩・規制罰金・評判損失・顧客信頼の喪失につながります。

シャドーAI(IT部門の認知なしに導入された未承認AIツール)は、中央集約的な監視やガバナンスを妨げる死角を生み出します。従業員がChatGPTなどのパブリックAIサービスを組織の監督なしで利用し、機密データの漏洩やコンプライアンス違反の可能性があります。シャドーAIはまた、作業の重複やリソースの浪費、AIポリシーや基準の強制不能も招きます。

Liminal、Ardoq、KnosticなどのAIガバナンス専用プラットフォームは、中央集約的な監視、ポリシーの強制、コンプライアンスレポートを提供します。これらのプラットフォームはAIサービスと連携し、詳細なログ取得、異常検知、ガバナンスチーム向けのダッシュボードを提供します。さらに、AmICitedはGPTs、Perplexity、Google AI OverviewsなどでAIがブランドをどのように参照しているかを監視し、AI回答の品質可視化を専門としています。

EU AI Act、GDPR、CCPA、業界固有の規制(銀行業のOCC、ヘルスケアのFDAなど)は、可視化・記録要件を義務付けています。組織は、監査証跡、バイアステスト、性能監視、AIシステムの意思決定記録など、これらの規制への準拠を示す監視を実装しなければなりません。可視化基盤はこれらの規制義務を満たすよう設計する必要があります。

主な指標は、可視化カバレッジ(記録・監視されているAIシステムの割合)、ガバナンス成熟度(定義されたガバナンス段階の進捗)、インシデント検知・対応時間、コンプライアンス遵守率(規制要件を満たすシステムの割合)、可視化投資による事業価値実現(可視化による具体的なメリット)などです。また、利用指標(アクティブユーザー数、APIコール数)、品質指標(精度、ドリフト)、セキュリティ指標(異常検知数、ポリシー違反数)も追跡しましょう。

導入期間は組織の規模と複雑さによって異なります。初期の可視化基盤(インベントリ、基本的なログ取得、ダッシュボード)は3~6か月で構築できます。全AIシステムへの包括的な可視化達成には通常6~12か月かかります。成熟した最適化ガバナンス体制の確立は通常12~24か月を要します。リスクの高いシステムやクイックウィンから段階的に開始し、徐々にカバレッジを拡大するアプローチが推奨されます。

AmICitedはGPTs、Perplexity、Google AI OverviewsなどのAIシステムがあなたのブランドやコンテンツをどのように参照しているかを追跡します。主要なAIプラットフォーム全体でAI回答の品質とブランド言及を可視化します。

エンタープライズAI可視化ソリューションの完全ガイド。Conductor、Profound、Athenaなどの主要プラットフォームを比較。大企業向けの評価基準や選定戦略も解説。...

代理店とインハウスのAI可視性監視を比較。コスト、タイムライン、専門知識要件、ハイブリッド戦略を探り、ブランドに最適な戦略の選択をサポートします。...

エンタープライズAI検索戦略:統合、ガバナンス、ROI指標。大企業がChatGPT、Perplexity、社内システム向けにAI検索プラットフォームをどのように導入しているかを学びます。...

クッキーの同意

閲覧体験を向上させ、トラフィックを分析するためにクッキーを使用します。 See our privacy policy.