金融サービスAI可視性:コンプライアンスと最適化

AIが生成した回答に自社の金融ブランドがどのように表示されているかを監視しましょう。規制された金融サービスのためのコンプライアンス要件、可視性戦略、最適化テクニックについて学べます。...

金融機関が意思決定、リスク管理、顧客向けアプリケーションにおける人工知能の利用について、透明性を持って開示するための規制要件。SEC、CFPB、FINRAなどの規制当局が、AIガバナンス、モデルパフォーマンス、消費者や市場への影響の記録を求める期待を含みます。

金融機関が意思決定、リスク管理、顧客向けアプリケーションにおける人工知能の利用について、透明性を持って開示するための規制要件。SEC、CFPB、FINRAなどの規制当局が、AIガバナンス、モデルパフォーマンス、消費者や市場への影響の記録を求める期待を含みます。

金融AI開示とは、金融機関が意思決定プロセス、リスク管理、顧客向けアプリケーションにおける人工知能の利用について、透明性を持って開示するための規制要件およびベストプラクティスを指します。これは、AIガバナンス、モデルパフォーマンス、消費者や市場への潜在的影響の記録がSEC、CFPB、FINRAなどの規制当局から求められることを含みます。2024年12月、SECの投資家諮問委員会(IAC)は、AIが企業に与える影響に関する情報開示を発行体に求めるガイダンスを同庁に正式勧告しました。IACは、現行のAI開示の「一貫性の欠如」が「明確かつ比較可能な情報を求める投資家にとって問題となる」と指摘しました。AI関連の開示を行うS&P500企業は40%に過ぎず、取締役会によるAI監督について情報開示しているのは15%のみである一方、S&P500企業の60%がAIを重要リスクと見なしています。

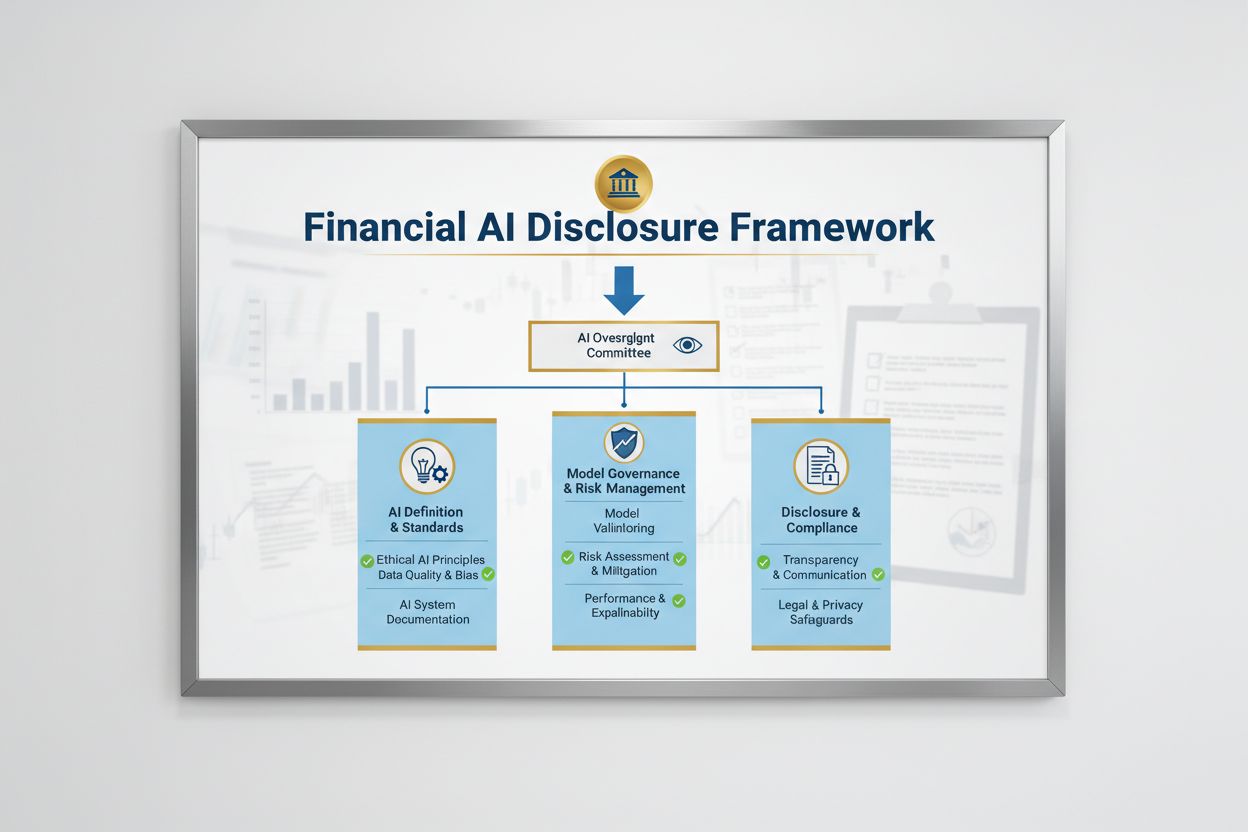

金融AI開示の規制環境は、複数の連邦機関がAIシステムに既存の技術中立的法律を適用することで形成されています。SECの投資家諮問委員会は、(1)発行体に「人工知能」の定義を求める、(2)AI導入に関する取締役会による監督体制を開示する、(3)重要なAI導入とそれが内部業務や消費者向け商品に与える影響を報告する、という3つの柱からなる初期枠組みを提案しました。SEC以外にも、CFPB、FINRA、OCC、連邦準備制度理事会が、AIシステムには公正な貸付、データプライバシー、詐欺防止などの既存消費者保護法が技術を問わず適用されることを強調するガイダンスを発表しています。これらの機関は技術中立的なアプローチを取り、AI利用時でも平等信用機会法(ECOA)、公正信用報告法(FCRA)、グラム・リーチ・ブライリー法(GLBA)、不公正・詐欺的行為(UDAAP)基準による遵守義務は変わりません。

| 規制当局 | 重点分野 | 主な要件 |

|---|---|---|

| SEC | 投資家開示、利益相反 | AI定義、取締役会監督の開示、重要導入の報告 |

| CFPB | 公正な貸付、消費者保護 | AIモデルがECOAに準拠、否決通知の提供 |

| FINRA | ブローカー運用、顧客コミュニケーション | AIガバナンスポリシー策定、全機能でAI利用を監督 |

| OCC/連邦準備/FDIC | 銀行モデルガバナンス、オペレーショナルリスク | AIモデルの検証、統制文書化、信頼性評価 |

| FTC | 詐欺的行為、データ取扱い | AI関連主張の監視、不公正なデータ利用防止 |

効果的な金融AI開示には、人工知能の導入とリスク管理に関する明確な取締役会レベルでの監督が不可欠です。SECのIAC勧告は、投資家がAI技術の導入に対する権限の所在について理解する正当な利益を持つことを強調しています。金融機関は、AI監督の責任を取締役会または指定委員会に明確に割り当て、AIリスクを組織の最上層で管理できるガバナンス体制を構築しなければなりません。このガバナンス枠組みには、AI開発、テスト、検証、導入に関する文書化された方針と手順、取締役会へのモデルパフォーマンス・リスク・是正措置の定期報告が含まれるべきです。明確な取締役会責任がなければ、重大なAIシステムの監督不備として規制当局に指摘され、執行リスクが高まります。

金融機関は、AI導入が内部業務と消費者向け商品にもたらす重要な影響を個別に開示しなければなりません。内部業務については、AIが人材(人員削減やスキル向上要件)、財務報告の正確性、ガバナンスプロセス、サイバーセキュリティリスクに与える影響を開示します。消費者向けでは、AI駆動プラットフォームへの投資、商品・サービスへのAI統合、AI利用による規制上の影響、AIが価格戦略や事業指標に及ぼす影響を開示します。SECは、これらの開示を新たなカテゴリーではなく、既存の規則S-K(項目101、103、106、303など)に重要性を考慮して統合することを推奨しています。これにより、金融機関は既存の開示枠組みを活用しつつ、投資家にAIの役割について明確で比較可能な情報を提供できます。

高品質なデータは金融サービスにおける責任あるAI導入の基盤ですが、多くの金融機関は規制当局の期待に応えるデータガバナンス体制の構築に苦戦しています。AIモデルのトレーニング・テスト・検証に用いるデータは、クリーンで完全・標準化され、十分な網羅性があり、データソースや系譜、既知の制限を明確に文書化する必要があります。データセキュリティは、「データポイズニング」(トレーニングデータの改ざんによるモデルの信頼性低下)を防止し、機密情報への不正アクセスや漏洩から保護しなければなりません。グラム・リーチ・ブライリー法(GLBA)は消費者金融データの基本的保護を規定しますが、AIの文脈では十分でないとの指摘も多く、モデル学習のためのデータ利用拡大により、消費者保護や知的財産権の課題も生じます。金融機関は、AI開発へのデータ利用許諾や第三者知的財産権の尊重も確認しなければなりません。データ最小化原則、アクセス管理、定期監査などを含む強固なデータガバナンス体制の導入が規制上不可欠です。

規制当局は、金融意思決定に用いるAIモデルは、精度やパフォーマンスに関わらず、バイアスや差別的結果の有無をテストする必要があると明言しています。複雑なAIシステムが説明困難な「ブラックボックス」化しやすい点は、特に信用審査や価格設定、不正検知など消費者向け領域で大きなコンプライアンスリスクとなります。金融機関は、モデル開発・検証・継続モニタリングの全過程でバイアス検出・軽減の体制を整えるべきです。公正な貸付のためには、否決理由を具体的に説明でき、AIモデルが保護属性に不当な影響を与えていないことを証明する必要があります。「より少ない差別的代替策」のテスト—同等のビジネス目的を公正に達成できる方法—も規制当局から期待されています。多くの機関では、説明可能AI(xAI)技術(特徴量重要度分析や決定木など)を導入し、AI判断の透明性と説明責任を高めています。

消費者向けAI活用には、否決通知やデータプライバシー開示、公正な取り扱いなど既存の消費者保護法の遵守が求められます。AIシステムがクレジットや保険、その他金融商品の判断に直接または大きな影響を与える場合、消費者はなぜ否決・不利な条件となったのか知る権利があります。CFPBは、平等信用機会法(ECOA)の対象となる債権者は、具体的かつ正確な否決理由を説明できない「ブラックボックス」モデルを使用できないと強調しています。また、不公正・詐欺的行為(UDAAP)の基準は、不透明なデータ収集やプライバシー侵害、不適切な商品への誘導などAI主導システムにも適用されます。金融機関は、顧客対応や商品提案、口座管理などでAIを利用する場合、その利用実態を透明にし、消費者データの収集・利用・保護について明確に開示する義務があります。

多くの金融機関は、AIシステムの開発・導入・保守を第三者ベンダーに依存しているため、重大な第三者リスク管理(TPRM)が求められます。連邦銀行当局の第三者関係に関する共同ガイダンスは、たとえ自社でモデルを開発していなくても、第三者AIシステムのパフォーマンスやコンプライアンスに金融機関が責任を負うことを強調しています。AIのTPRMには、ベンダー採用前の厳格なデューデリジェンス(データガバナンス体制・モデル検証・運用透明性の評価)が不可欠です。さらに、少数のAI提供者が障害を起こした場合のシステミックリスク(集中リスク)も監視しなければなりません。データソースの信頼性や外部インフラの安定性といったサプライチェーンリスクも評価・文書化すべきです。AIベンダーとの契約では、データセキュリティ、モデルパフォーマンス監視、インシデント報告、AIシステムの監査・テスト権限などを明記する必要があります。特に中小規模金融機関では、複雑なAIシステムを評価する技術的専門知識が不足しがちなため、業界標準や認証プログラムの活用によるベンダー評価が望まれます。

国境を越えて事業を展開する金融機関は、EUのAI法をはじめとする複雑なAI規制のパッチワークに直面しています。EU AI法は、信用スコアリング・不正防止・マネロン対策に用いられるAIシステムを「高リスク」と位置づけ、文書化・バイアステスト・人の監督・適合性評価を義務付けています。OECDやG7も、金融サービスにおける責任あるAIガバナンスの原則や勧告を示し、透明性・公正性・説明責任・人の監督を重視しています。こうした国際基準の多くには域外適用があり、EUや英国など規制地域の顧客を持つ金融機関は、本拠地がどこであれ遵守が求められる場合があります。規制調和の努力は進行中ですが、地域間で大きな違いも残っており、グローバル金融機関のコンプライアンス課題となっています。EU AI法やOECD原則など最高水準の国際基準に能動的に整合することで、将来の規制や複数地域での執行リスクに備えることが可能です。

金融機関は、金融AI開示の期待に沿ったコンプライアンスを示すため、包括的な文書化およびガバナンス体制を構築すべきです。主なベストプラクティスは以下の通りです:

これらの実践を通じて、金融機関は規制リスクを低減し、ステークホルダーからの信頼を構築し、金融サービス業界における責任あるAI導入のリーダーとしての地位を築くことができます。

金融AI開示とは、金融機関が意思決定、リスク管理、顧客向けアプリケーションにおける人工知能の利用について、透明性を持って開示するための規制要件を指します。これは、AIガバナンスやモデルパフォーマンス、消費者や市場への影響の記録を求めるSEC、CFPB、FINRAなどの規制当局の期待を含みます。SECの投資家諮問委員会は2024年12月、金融機関がAIの利用状況の定義、取締役会による監督体制、重要なAI導入の報告を行うよう勧告しました。

金融機関は投資家、消費者、市場の健全性を守るためにAI利用を開示しなければなりません。規制当局によれば、S&P500企業のうちAI関連の開示を行っているのは40%に留まり、情報の不均一やギャップが生じています。開示要件により、利害関係者はAIが金融判断、リスク管理、消費者への影響にどのように関与しているかを理解できます。さらに、公正な貸付やデータプライバシー法など既存の消費者保護法もAIシステムに適用されるため、開示は規制遵守のために不可欠です。

SECの投資家諮問委員会は、AI開示のために3つの柱を勧告しました:(1)発行体が「人工知能」の定義を明確にすること、(2)AI導入に関する取締役会の監督体制を開示すること、(3)重要なAI導入とそれが内部業務や消費者向け商品に与える影響を報告することです。これらの勧告は、投資家に対しAIが金融機関の運営や戦略にどう影響するかを明確かつ比較可能な情報として提供することを目的としています。

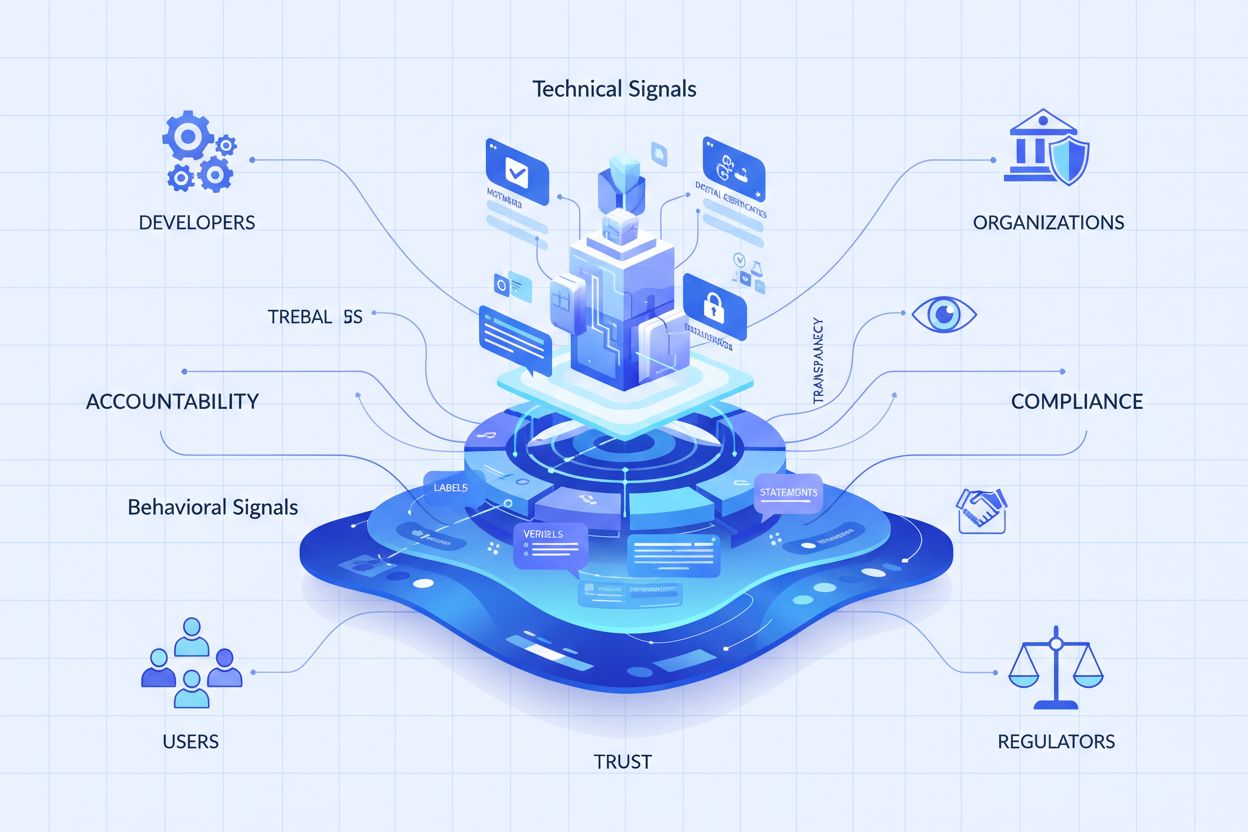

金融AI開示は、AI利用について外部ステークホルダー(投資家、規制当局、消費者)への透明性のある情報伝達に関する規制要件に特化しています。一方、一般的なAIガバナンスは、AIシステム運用のための内部プロセスや管理体制を指します。開示はAIガバナンスの外部向け要素であり、AI導入やリスク、影響についてステークホルダーが重要情報にアクセスできるようにします。どちらも金融サービスにおける責任あるAI導入に不可欠です。

AI導入の開示は、内部業務と消費者向けへの影響の両方を対象とすべきです。内部業務については、人材管理、財務報告、ガバナンス、サイバーセキュリティリスクへの影響を開示します。消費者向け商品には、AI駆動プラットフォームへの投資、商品のAI統合、規制上の影響、AIが価格や事業戦略に与える影響などを含めます。開示はSEC規則S-Kのような既存の規制開示項目に統合し、重要性に基づいて行うべきです。

公正な貸付法(ECOAやFCRAなど)は、技術の種類を問わず、信用判断に使用されるAIシステムにも適用されます。金融機関は、否決など不利益な判断の具体的理由を説明でき、AIモデルが保護された属性に不当な影響を与えていないことを示さなければなりません。規制当局はAIモデルのバイアス検証、「より少ない差別的代替策」の検討、フェアネステストや検証の記録維持を求めています。

多くの金融機関はAIシステムを第三者ベンダーに依存しているため、重大な第三者リスク管理(TPRM)義務が生じます。金融機関は、モデルを自ら開発していなくても、第三者AIシステムのパフォーマンスとコンプライアンスに責任を持ちます。AIのTPRMでは、厳格なデューデリジェンス、継続的なモニタリング、ベンダーのデータガバナンス評価、モデルパフォーマンスの文書化が必要です。また、少数のAI提供者に障害が起きた場合のシステミックリスク(集中リスク)も監視しなければなりません。

EUのAI法は最も包括的なAI規制枠組みであり、金融AIシステムを「高リスク」と分類し、詳細な文書化やバイアステスト、人による監督を義務付けています。OECDやG7も責任あるAIガバナンスに関する原則を公表しています。こうした国際基準の多くは域外適用があり、規制対象地域の顧客を持つ金融機関は遵守が求められる場合があります。国際基準に先行して整合することで、将来の規制や執行リスクに備えることができます。

GPTs、Perplexity、Google AI OverviewsなどのAI回答で、あなたの金融機関がどのように言及されているかを追跡しましょう。AI生成の金融コンテンツにおいてブランドの可視性と正確性を確保します。

AIが生成した回答に自社の金融ブランドがどのように表示されているかを監視しましょう。規制された金融サービスのためのコンプライアンス要件、可視性戦略、最適化テクニックについて学べます。...

AIの透明性と開示のベストプラクティスを学びましょう。信頼構築と進化するAI規制への対応のため、行動的・言語的・技術的な開示手法を紹介します。...

Cスイート幹部にAI可視性の結果を提示する方法を学びます。主要指標、ダッシュボード設計、エグゼクティブ向けAIレポートおよびガバナンスのベストプラクティスをご紹介します。...

クッキーの同意

閲覧体験を向上させ、トラフィックを分析するためにクッキーを使用します。 See our privacy policy.