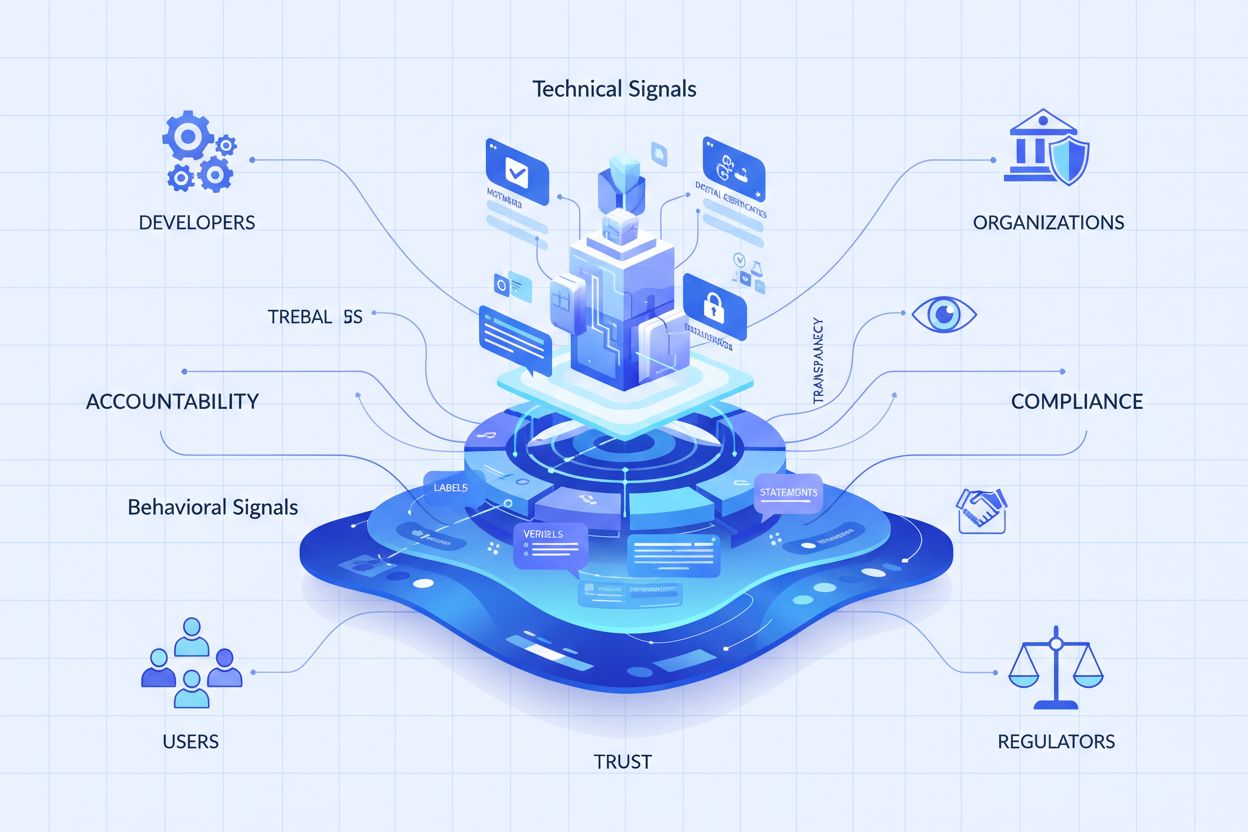

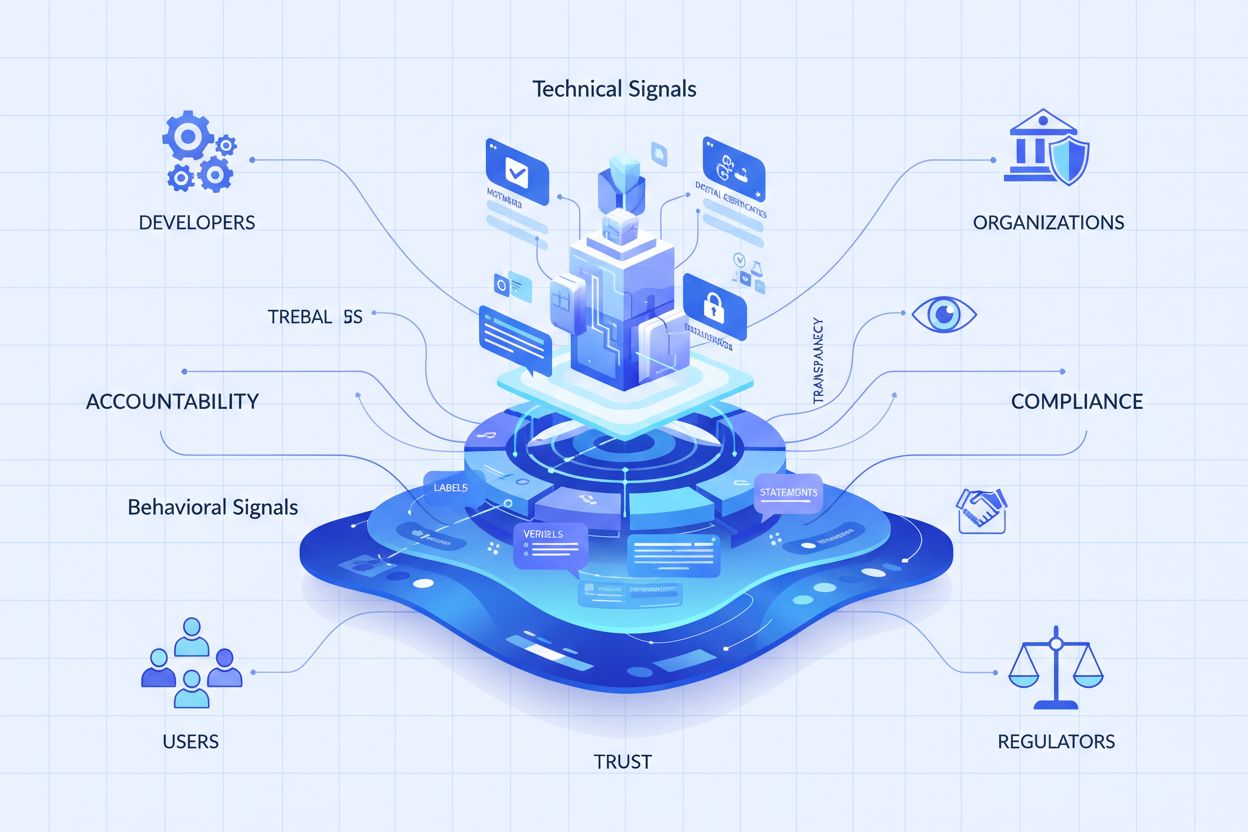

Transparantie in AI-zichtbaarheidsinspanningen: Beste praktijken voor openbaarmaking

Leer essentiële AI-transparantie en beste praktijken voor openbaarmaking. Ontdek gedrags-, verbale en technische openbaarmakingsmethoden om vertrouwen op te bou...

Ontdek hoe overheidsinstanties hun digitale aanwezigheid kunnen optimaliseren voor AI-systemen zoals ChatGPT en Perplexity. Leer strategieën voor het verbeteren van AI-zichtbaarheid, het waarborgen van transparantie en het verantwoord implementeren van AI in de publieke sector.

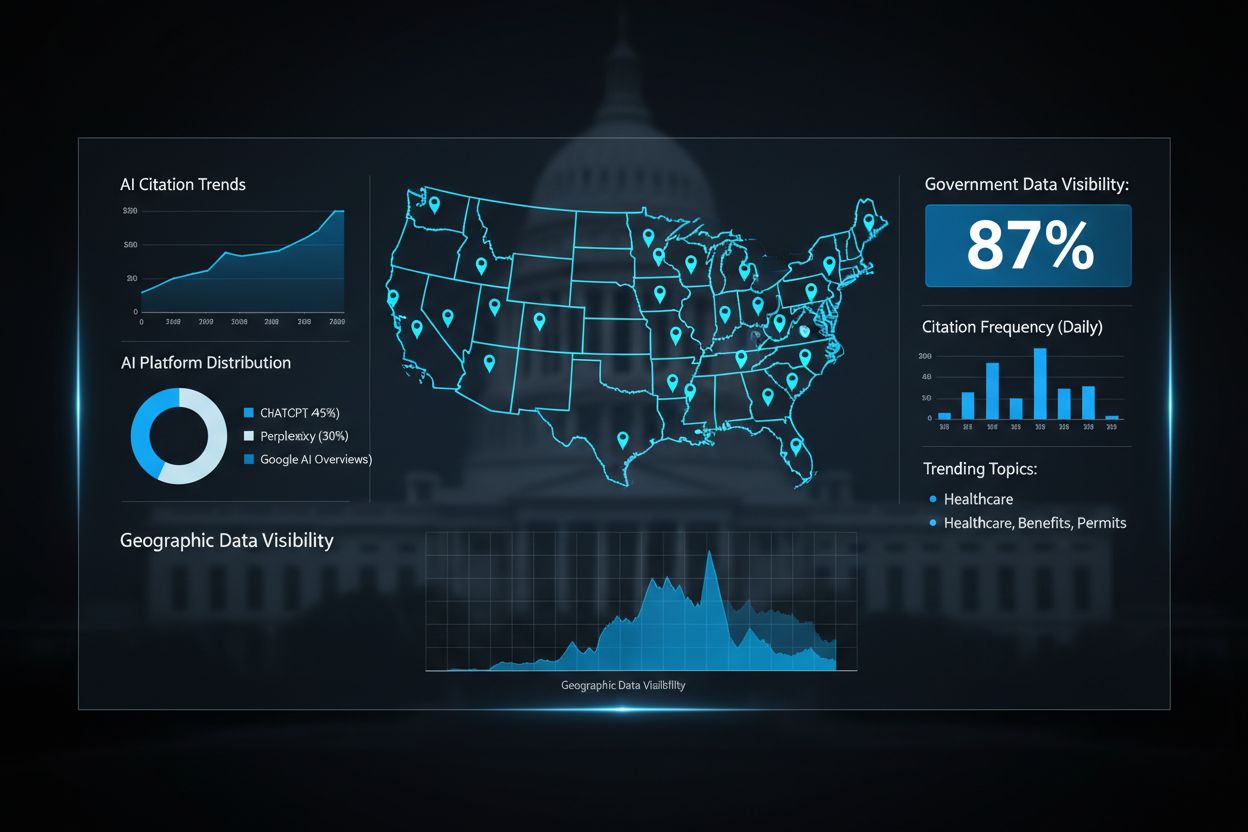

AI-zichtbaarheid van de overheid verwijst naar de mate waarin kunstmatige intelligentiesystemen—including GPT’s, Perplexity en Google AI Overviews—overheidsdata en -bronnen kunnen ontdekken, benaderen en citeren bij het beantwoorden van publieke vragen. Deze zichtbaarheid is cruciaal omdat overheidsinstanties gezaghebbende informatie bezitten over alles van gezondheidszorgregelingen tot sociale diensten, maar veel van deze data blijft onzichtbaar voor moderne AI-systemen. Wanneer burgers AI-assistenten vragen stellen over overheidsprogramma’s, uitkeringen of beleid, verdienen ze nauwkeurige, actuele antwoorden afkomstig van officiële overheidsbronnen in plaats van verouderde of onvolledige informatie. Publiek vertrouwen in de overheid hangt af van het waarborgen dat AI-systemen overheidsdata correct refereren en toeschrijven, waardoor de integriteit van officiële informatie behouden blijft in een steeds meer door AI gedreven informatielandschap. AI-transparantie wordt een hoeksteen van democratisch bestuur wanneer burgers kunnen verifiëren dat AI-aanbevelingen gebaseerd zijn op legitieme overheidsbronnen. AmICited.com fungeert als een kritisch monitoringplatform dat bijhoudt hoe overheidsdata wordt geciteerd en geraadpleegd in grote AI-systemen, waarmee instanties inzicht krijgen in hun zichtbaarheid en impact binnen het AI-ecosysteem. Door duidelijke zichtbaarheid te creëren in AI-citaties van de overheid, kunnen organisaties in de publieke sector burgers beter bedienen en het gezag over hun eigen informatie behouden.

Overheidsinstanties worstelen nog steeds met datasilo’s die zijn ontstaan door decennia van gefragmenteerde IT-investeringen, waarbij cruciale informatie opgesloten blijft in niet-compatibele legacy systemen die niet gemakkelijk kunnen communiceren met moderne AI-platforms. Deze verouderde systemen zijn ontworpen voor traditionele webinterfaces en documentbeheer, niet voor het semantisch begrijpen en realtime datatoegang die AI-systemen vereisen. De kosten van deze technologische fragmentatie zijn enorm: organisaties verspillen ongeveer $140 miljard per jaar aan onbenutte voordelen door verouderde processen die gestroomlijnd zouden kunnen worden door AI-integratie. Naast efficiëntieverlies zorgen legacy systemen voor aanzienlijke beveiligingsrisico’s wanneer overheidsdata handmatig moet worden geëxporteerd en gedeeld met publiek toegankelijke AI-systemen, wat het risico op datalekken en ongeautoriseerde toegang verhoogt. De uitdaging wordt groter gezien het feit dat veel overheidswebsites niet beschikken over de gestructureerde data, metadata en API-infrastructuur die nodig zijn zodat AI-crawlers overheidsinformatie correct kunnen indexeren en begrijpen.

| Traditionele Overheids-IT | AI-Ready Infrastructuur |

|---|---|

| Gesloten databases met beperkte interoperabiliteit | Geïntegreerde dataplatforms met API’s en gestructureerde formaten |

| Handmatige data-extractie en delingsprocessen | Geautomatiseerde, veilige datapijplijnen |

| Ongestructureerde documenten en PDF’s | Semantische webstandaarden en machineleesbare formaten |

| Reactieve beveiligingsmaatregelen | Privacy-by-design en continue monitoring |

| Beperkte realtime datatoegang | Live datafeeds en dynamische contentlevering |

In plaats van te haasten met de uitrol van AI-technologie, volgen succesvolle overheidsorganisaties een strategisch, gefaseerd implementatietraject dat planning en organisatorische gereedheid boven technologische mogelijkheden stelt. Deze aanpak erkent dat AI-adoptie in de publieke sector zorgvuldige coördinatie vereist tussen verschillende belanghebbenden, van IT-afdelingen tot frontliniewerknemers en burgers zelf.

Het Vijfstappen Implementatietraject:

Strategische Kansidentificatie: Voer grondige audits uit van overheidsoperaties om gebruikssituaties met grote impact te identificeren waar AI meetbare publieke waarde kan leveren, zoals het verkorten van verwerkingstijden van aanvragen, het verbeteren van toegankelijkheid van diensten of het versterken van datagedreven beleidsbeslissingen.

Grondige Voorbereiding: Beoordeel de huidige datainfrastructuur, identificeer uitdagingen rond integratie van legacy systemen, stel governancekaders op en bouw AI-kennis op binnen de organisatie voordat enige technologie wordt uitgerold.

Strategisch Pilotontwerp: Start gecontroleerde pilots in specifieke afdelingen of dienstgebieden met duidelijke succescriteria, zodat teams kunnen leren van implementatie-uitdagingen in de praktijk in een laagrisico-omgeving voordat wordt opgeschaald.

Organisatieverandering en Management: Ontwikkel trainingsprogramma’s, adresseer zorgen van het personeel over baanverlies, stel heldere communicatiekanalen in en creëer feedbackmechanismen zodat medewerkers en belanghebbenden zich gehoord voelen tijdens de transitie.

Impactmeting: Stel KPI’s op die in lijn zijn met overheidsdoelen, monitor continu de prestaties van AI-systemen, volg burgertevredenheid, meet kostenbesparingen en pas implementatiestrategieën aan op basis van bewijs.

Deze technologie-tweede aanpak zorgt ervoor dat AI-implementaties echte publieke behoeften dienen in plaats van dure oplossingen te worden op zoek naar een probleem.

Ethische AI-governance is essentieel geworden nu overheden wereldwijd beseffen dat AI-systemen die beslissingen nemen voor burgers moeten opereren binnen duidelijke ethische en juridische kaders. Het Canadese Algorithmic Impact Assessment-framework biedt een praktisch model, waarbij AI-systemen in vier impactniveaus worden gecategoriseerd—minimaal, matig, hoog en zeer hoog—met bijbehorende governance-eisen en toezicht voor elk niveau. Deze getrapte aanpak stelt overheden in staat middelen proportioneel toe te wijzen en streng toezicht toe te passen op risicovolle systemen zoals algoritmes binnen het strafrecht, terwijl redelijk toezicht wordt gehouden op toepassingen met een lager risico. Estland heeft een privacy-by-design aanpak ontwikkeld via het Data Tracker-systeem, dat alle overheidsdatatoegang monitort binnen haar digitale infrastructuur en 450.000 burgers volledige transparantie biedt over welke instanties hun persoonsgegevens benaderen en met welk doel. Algoritmische verantwoording vereist dat overheidsinstanties documenteren hoe AI-systemen beslissingen nemen, audittrails opzetten en aanbevelingen aan betrokken burgers kunnen verklaren. AmICited.com speelt een vitale rol in dit transparantie-ecosysteem door te monitoren hoe overheidsdata wordt geciteerd en geraadpleegd in publieke AI-systemen, waarmee instanties kunnen verifiëren dat hun informatie accuraat wordt weergegeven en correct wordt toegeschreven. Zonder robuuste monitoring- en governancekaders lopen overheids-AI-systemen het risico het publieke vertrouwen te ondermijnen en vooroordelen te versterken die kwetsbare groepen onevenredig treffen.

Wereldwijd laten overheden zien dat strategische AI-implementatie substantiële publieke waarde oplevert wanneer deze weloverwogen wordt uitgevoerd. Het Australische Department of Home Affairs introduceerde het Targeting 2.0-systeem, een AI-platform dat grensbeveiliging en fraudedetectie verbeterde en zo AUD$3 miljard aan potentiële schade voorkwam, terwijl de verwerkingstijd voor legitieme reizigers en aanvragers werd verkort. De National Highways-chatbot in het Verenigd Koninkrijk toont aan hoe AI de dienstverlening aan burgers kan verbeteren door routinematige vragen over verkeerssituaties af te handelen, waardoor menselijk personeel zich kan richten op complexe noodgevallen die menselijke beoordeling en empathie vereisen. Het Estse Bürokratt-platform is een gedecentraliseerde, AVG-conforme benadering van overheids-AI, waarmee burgers AI-assistenten kunnen gebruiken voor routinematige administratieve taken, met behoud van strikte privacybescherming en menselijk toezicht op gevoelige beslissingen. De AI-governancebenadering van Maryland heeft duidelijke verantwoordingsstructuren en regelmatige audits voor AI-systemen van de deelstaat ingevoerd, wat inmiddels als voorbeeld dient voor andere Amerikaanse staten. Het Japanse Digital Agency digitaliseerde met succes kinderadviesdiensten met AI en verkortte de wachttijden van weken naar uren, met behoud van menselijk toezicht voor gevallen die gespecialiseerde interventie vereisen. Deze uiteenlopende voorbeelden tonen aan dat succes met overheids-AI niet afhankelijk is van de technologische verfijning, maar van een doordachte implementatie die de behoeften van burgers centraal stelt, transparantie waarborgt en menselijk toezicht houdt op ingrijpende beslissingen.

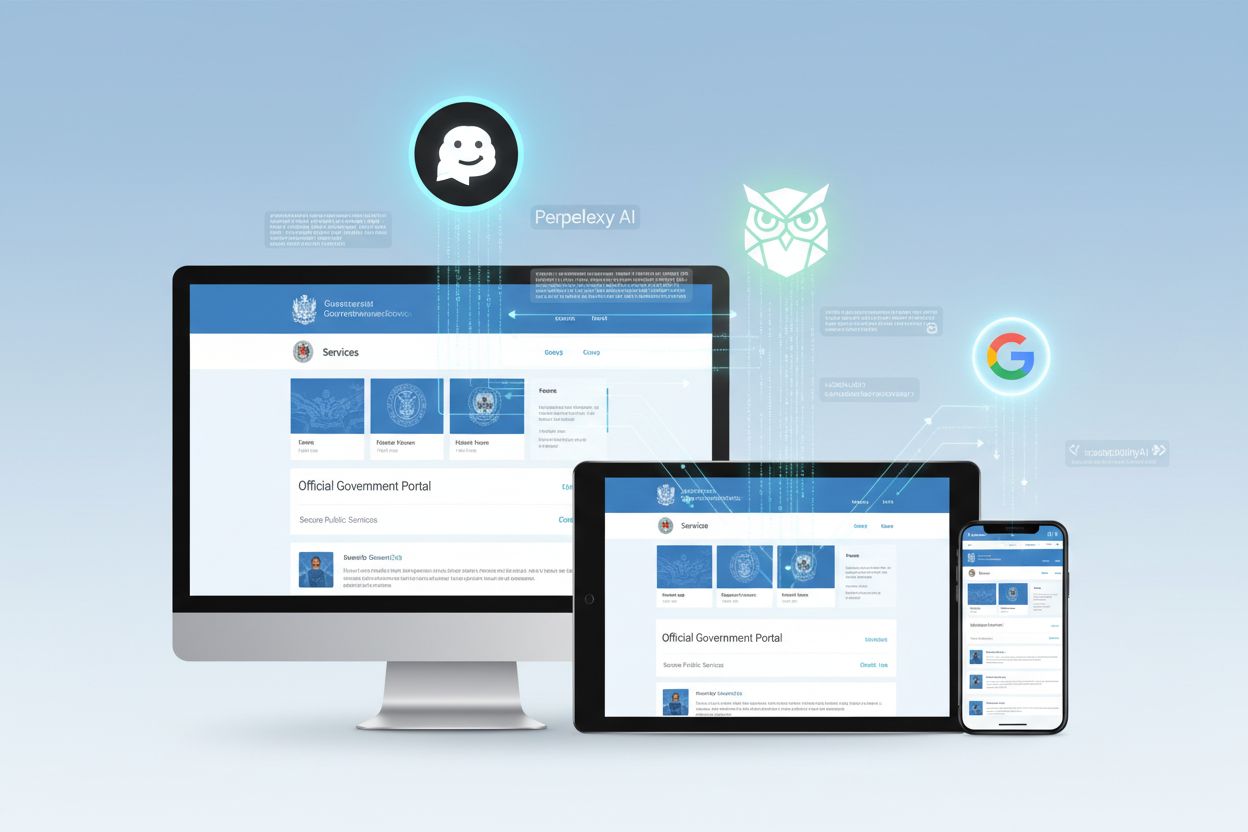

Nu AI-systemen het primaire toegangspunt worden voor burgers tot informatie, is optimalisatie van overheidswebsites voor AI-vindbaarheid net zo belangrijk geworden als traditionele zoekmachineoptimalisatie. Overheidswebsites moeten gestructureerde data-markup, uitgebreide metadata en machineleesbare formaten implementeren die AI-crawlers in staat stellen overheidsinformatie te begrijpen en correct te indexeren, zodat burgers die AI-assistenten raadplegen over overheidsdiensten, accurate en gezaghebbende antwoorden ontvangen. Veel overheidswebsites presenteren informatie momenteel in formaten die zijn geoptimaliseerd voor menselijke lezers—PDF’s, ongestructureerde tekst en complexe navigatie—waarmee AI-systemen moeite hebben om te lezen en te interpreteren. REI Systems heeft baanbrekend werk verricht in het optimaliseren van federale websites voor AI-toegankelijkheid en aangetoond dat relatief eenvoudige technische verbeteringen de zichtbaarheid van de overheid in AI-antwoorden aanzienlijk kunnen vergroten. AmICited.com monitort de AI-zichtbaarheid van de overheid op grote platforms, waardoor instanties inzicht krijgen in hoe vaak hun informatie voorkomt in AI-antwoorden en waar hiaten bestaan die overheidsdata beter vindbaar moeten maken. Wanneer overheidswebsites correcte semantische webstandaarden, API-infrastructuur en toegankelijkheidsfuncties toepassen, vergroten ze de kans dat AI-systemen officiële overheidsbronnen citeren in plaats van secundaire of verouderde informatie. Deze optimalisatie is in het voordeel van burgers omdat zij zo gezaghebbende informatie direct van de overheid ontvangen, terwijl instanties controle houden over hoe hun informatie wordt gepresenteerd en geïnterpreteerd.

Impactmeting van overheids-AI vereist het opstellen van duidelijke KPI’s die aansluiten bij doelstellingen in de publieke sector en verder gaan dan alleen efficiëntie om ook burgertevredenheid, gelijkheid en democratische verantwoording te meten. Het Estse evaluatieframework biedt een praktisch model en beoordeelt AI-initiatieven op vier dimensies: tijdsefficiëntie (hoeveel personeelstijd wordt bespaard), kosteneffectiviteit (return on investment), innovatiepotentieel (of het systeem nieuwe dienstverleningsmodellen mogelijk maakt) en meetbare impact (kwantificeerbare verbeteringen in burgerresultaten). Systematische meting stelt overheidsinstanties in staat te bepalen welke AI-toepassingen echte publieke waarde leveren en welke bijgestuurd of beëindigd moeten worden, zodat verspilling aan technologie die niet aansluit bij burgerbehoeftes wordt voorkomen. Kennisdeling tussen instanties versnelt het leerproces, zodat succesvolle implementaties in één afdeling kunnen worden aangepast en elders worden ingezet, wat het rendement op AI-investeringen vergroot. Continue verbetering en monitoringsystemen—ondersteund door tools zoals AmICited.com die AI-zichtbaarheid en citaatpatronen volgen—maken het mogelijk AI-systemen te verfijnen op basis van praktijkdata in plaats van aannames. Het opbouwen van institutionele kennis over wat werkt bij overheids-AI-implementatie, vormt de basis voor duurzame, langetermijnadoptie die bestand is tegen wisselingen in leiderschap en begrotingscycli.

Ondanks de duidelijke potentiële voordelen, staan overheidsinstanties voor aanzienlijke barrières bij de adoptie van AI die verder reiken dan alleen technologische uitdagingen. Zorgen bij het personeel vormen een belangrijk obstakel, met 31% van de overheidsmedewerkers die baanzekerheid als grootste zorg over AI-implementatie noemen, wat vraagt om transparante communicatie over hoe AI het werk zal aanvullen in plaats van vervangen. Tekorten aan talent versterken deze uitdaging, aangezien 38% van de overheidsorganisaties moeite heeft AI-specialisten te vinden met de benodigde expertise voor implementatie en onderhoud van geavanceerde systemen. Onderschatting van kosten is een andere cruciale barrière, omdat overheidsinstanties vaak ontdekken dat de werkelijke kosten voor AI-implementatie 5-10 keer hoger liggen dan aanvankelijk geraamd, wat budgetten onder druk zet en politieke weerstand oproept tegen verdere investeringen. Zorgen over gegevensprivacy en -beveiliging vormen de meest significante beperking, met 60% van de overheidsleiders die data-privacy en -beveiliging als voornaamste barrière voor AI-adoptie aangeven, wat de terechte bezorgdheid weerspiegelt over de bescherming van burgergegevens in een tijd van toenemende cyberdreigingen. Effectieve verandermanagementstrategieën moeten deze barrières direct aanpakken via betrokkenheid van belanghebbenden, transparante communicatie over AI-mogelijkheden en -beperkingen, investering in opleiding en ontwikkeling van het personeel en duidelijke governancekaders die burgerprivacy beschermen en tegelijk innovatie mogelijk maken. Overheidsinstanties die deze barrières succesvol overwinnen investeren doorgaans veel in verandermanagement, stellen heldere communicatiekanalen in met medewerkers en burgers en tonen snelle successen die het vertrouwen in AI-systemen vergroten voordat wordt opgeschaald naar toepassingen met grotere impact.

Overheids-AI-zichtbaarheid verwijst naar hoe gemakkelijk AI-systemen zoals ChatGPT, Perplexity en Google AI Overviews overheidsdata kunnen ontdekken en citeren. Dit is belangrijk omdat burgers recht hebben op nauwkeurige, gezaghebbende informatie uit officiële overheidsbronnen wanneer zij AI-assistenten raadplegen over beleid, uitkeringen en diensten. Slechte zichtbaarheid betekent dat AI-systemen mogelijk verouderde of onvolledige informatie geven in plaats van burgers naar officiële overheidsbronnen te leiden.

Overheidswebsites dienen gestructureerde data-markup, uitgebreide metadata, machineleesbare formaten en een goede API-infrastructuur te implementeren. Dit omvat het gebruik van semantische webstandaarden, zorgen dat de inhoud toegankelijk is voor AI-crawlers en informatie organiseren op een manier die AI-systemen gemakkelijk kunnen begrijpen en correct kunnen toeschrijven aan officiële overheidsbronnen.

De belangrijkste barrières zijn zorgen over gegevensprivacy en -beveiliging (aangegeven door 60% van de overheidsleiders), een tekort aan talent (38%), zorgen bij het personeel over baanverlies (31%), onderschatting van de kosten (de werkelijke kosten zijn vaak 5-10x hoger dan de schattingen) en een ontoereikende digitale infrastructuur (45%). Het aanpakken van deze barrières vereist strategische planning, verandermanagement en duidelijke governancekaders.

Succesvolle benaderingen omvatten het opzetten van frameworks voor algoritmische impactbeoordeling (zoals het getierde systeem van Canada), het implementeren van privacy-by-design principes, het creëren van transparantiemechanismen zodat burgers datatoegang kunnen monitoren, het opstellen van heldere governancekaders en het behouden van menselijk toezicht op ingrijpende beslissingen. Regelmatige audits en betrokkenheid van belanghebbenden zijn essentieel.

De routekaart omvat: (1) Strategische kansidentificatie gericht op publieke waarde, (2) Grondige voorbereiding van infrastructuur en governance, (3) Strategisch ontwerp van pilots met duidelijke succescriteria, (4) Organisatieverandering en management rond personeelszorgen en (5) Impactmeting met continue verbetering. Deze benadering geeft prioriteit aan planning en organisatorische gereedheid boven technologie-gedreven uitrol.

Overheden moeten KPI's opstellen die aansluiten bij de doelstellingen van de publieke sector, waaronder tijdsefficiëntie, kosteneffectiviteit, innovatiepotentieel en meetbare burgerresultaten. Het Estse framework evalueert AI-systemen op deze vier dimensies. Continue monitoring, feedback van belanghebbenden en transparante rapportage helpen instanties te bepalen wat werkt en implementaties op bewijs bij te sturen.

Datagovernance is fundamenteel voor succesvolle overheids-AI. Het waarborgt datakwaliteit, stelt duidelijke eigenaarschap- en toegangsrechten vast, beschermt de privacy van burgers, zorgt voor naleving van regelgeving zoals de AVG en maakt veilige uitwisseling tussen systemen mogelijk. Zonder robuuste datagovernance lopen overheids-AI-systemen risico op datalekken, vooringenomenheid en verlies van publiek vertrouwen.

AmICited volgt hoe overheidsdata wordt geciteerd en geraadpleegd in grote AI-systemen zoals ChatGPT, Perplexity en Google AI Overviews. Het helpt overheidsinstanties inzicht te krijgen in hun zichtbaarheid binnen het AI-ecosysteem, hiaten te identificeren waar officiële informatie beter vindbaar moet zijn en zorgt ervoor dat AI-systemen overheidsdata correct toeschrijven. Deze monitoring ondersteunt zowel transparantie als verantwoording.

Volg hoe uw overheidsdata wordt geciteerd en geraadpleegd in AI-systemen. AmICited helpt organisaties in de publieke sector inzicht te krijgen in hun zichtbaarheid binnen het AI-ecosysteem en zorgt voor een accurate weergave van officiële informatie.

Leer essentiële AI-transparantie en beste praktijken voor openbaarmaking. Ontdek gedrags-, verbale en technische openbaarmakingsmethoden om vertrouwen op te bou...

Leer essentiële AI-zichtbaarheidsbronnen en tools voor beginners. Ontdek hoe je jouw merk kunt monitoren in ChatGPT, Perplexity en Google AI Overviews met onze ...

Ontdek bewezen strategieën om de zichtbaarheid van je merk te vergroten in AI-zoekmachines zoals ChatGPT, Perplexity en Gemini. Leer over contentoptimalisatie, ...

Cookie Toestemming

We gebruiken cookies om uw browse-ervaring te verbeteren en ons verkeer te analyseren. See our privacy policy.