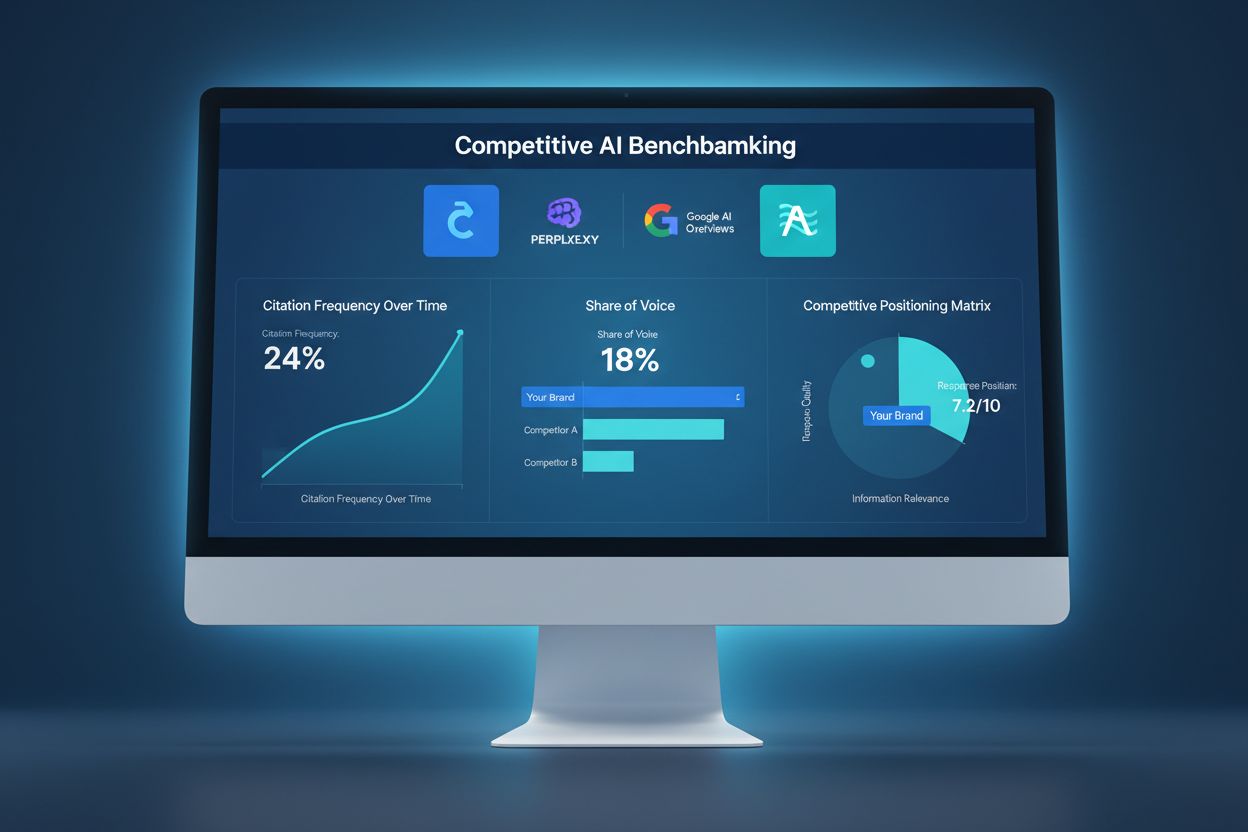

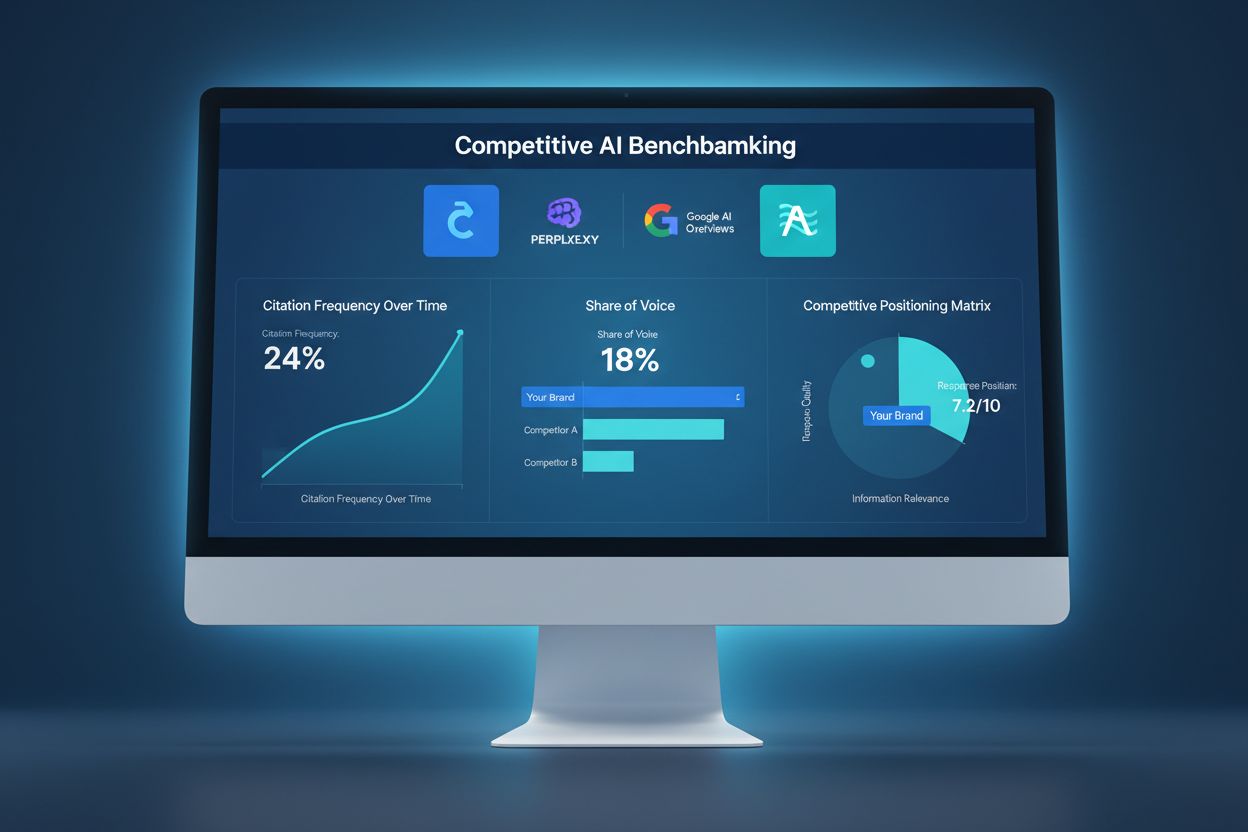

Competitieve AI-benchmarking

Leer hoe je je AI-zichtbaarheid kunt vergelijken met die van concurrenten. Volg citaties, aandeel in het totaal en competitieve positionering op ChatGPT, Perple...

Competitieve AI-sabotage verwijst naar opzettelijke pogingen van concurrenten om de zichtbaarheid, het sentiment of de prestaties van een merk negatief te beïnvloeden in AI-gestuurde zoekresultaten en chatbot-antwoorden. Dit omvat datapoisening, nepbeoordelingen, desinformatiecampagnes en manipulatie van AI-trainingsdata om de merkreputatie te schaden en AI-vermeldingen te verminderen.

Competitieve AI-sabotage verwijst naar opzettelijke pogingen van concurrenten om de zichtbaarheid, het sentiment of de prestaties van een merk negatief te beïnvloeden in AI-gestuurde zoekresultaten en chatbot-antwoorden. Dit omvat datapoisening, nepbeoordelingen, desinformatiecampagnes en manipulatie van AI-trainingsdata om de merkreputatie te schaden en AI-vermeldingen te verminderen.

Competitieve AI-sabotage verwijst naar opzettelijke pogingen om de data te manipuleren, vergiftigen of corrumperen die AI-zoekmachines en taalmodellen gebruiken om resultaten en citaties te genereren. In tegenstelling tot traditionele negatieve SEO, die zich richt op het beschadigen van de websiteposities van een concurrent via link-schema’s of technische exploits, richt AI-sabotage zich op de trainingsdata en bronnen waar AI-systemen op vertrouwen om antwoorden te geven. Dit onderscheid is cruciaal omdat AI-systemen zoals Google AI Overviews, Perplexity en GPT’s bronnen rechtstreeks uit hun trainingsdata citeren, waardoor ze kwetsbaar zijn voor gecoördineerde desinformatiecampagnes. De impact in de praktijk is aanzienlijk: met 60% van de zoekopdrachten die eindigen zonder door te klikken naar websites kunnen concurrenten nu AI-resultaten vergiftigen om verkeer om te leiden, merkreputatie te schaden of valse informatie te promoten zonder ooit de traditionele zoekresultaten te raken.

Competitieve AI-sabotage werkt via verschillende onderling verbonden aanvalsvectoren die gebruik maken van hoe AI-systemen informatie opnemen en verwerken. Datapoisening is de primaire techniek, waarbij valse, misleidende of kwaadaardige informatie wordt geïnjecteerd in bronnen die AI-systemen gebruiken voor training—zoals openbare databases, fora, beoordelingssites en nieuwsaggregatoren. Aanvallers gebruiken label flipping (het veranderen van metadata om content verkeerd te classificeren), datainjectie (het toevoegen van nepvermeldingen aan datasets) en backdoor-aanvallen (het inbouwen van verborgen triggers in trainingsdata). Concurrenten starten ook gecoördineerde nepbeoordelingscampagnes om platforms te overspoelen met verzonnen testimonials, terwijl ze desinformatie en deepfakes verspreiden via sociale media, blogs en AI-geïndexeerde content. De kwetsbaarheid ligt in het feit dat AI-systemen vaak vertrouwen op het volume en de consistentie van informatie in plaats van op de authenticiteit ervan te controleren. Hier ziet u hoe verschillende sabotagemethoden zich tot elkaar verhouden:

| Methode | Hoe het werkt | AI-impact | Moeilijkheid van detectie |

|---|---|---|---|

| Datapoisening | Valse informatie injecteren in trainingsdatasets | AI citeert direct vergiftigde bronnen in resultaten | Hoog - vereist data-analyse |

| Nepbeoordelingen | Gecoördineerde review bombing op platforms | Vertekent AI-sentimentanalyse en aanbevelingen | Middel - patroonanalyse kan helpen |

| Desinformatiecampagnes | Verspreiden van valse beweringen via geïndexeerde websites | AI versterkt valse verhalen in zoekresultaten | Hoog - vereist factchecking |

| Deepfakes | Maken van synthetische media van bestuurders of producten | Schaadt de merkcredibiliteit wanneer door AI geciteerd | Zeer hoog - vereist verificatie |

| Directory-kaping | Claim van concurrent zijn bedrijfsvermelding | AI haalt valse informatie uit gekaapte directories | Middel - verificatie kan helpen |

| Nepnieuwsartikelen | Publiceren van verzonnen verhalen op nieuwsachtige sites | AI beschouwt als gezaghebbende bronnen | Hoog - vereist bronverificatie |

AI-systemen zijn fundamenteel kwetsbaarder voor sabotage dan traditionele zoekmachines omdat ze trainingsdata implicieter vertrouwen dan mensen. Terwijl het Google-algoritme linkautoriteit en domeinreputatie beoordeelt, leren AI-modellen simpelweg patronen van alle data waarop ze getraind zijn—en zijn dus gevoelig voor gecoördineerde aanvallen. Onderzoek toont aan dat slechts 250 kwaadaardige documenten een AI-model al kunnen vergiftigen, een veel lagere drempel dan bij traditionele SEO-aanvallen. Het probleem wordt verergerd door het feit dat AI-systemen bronnen direct citeren, waardoor vergiftigde data niet alleen de resultaten beïnvloedt, maar ook het gezaghebbende antwoord wordt dat gebruikers zien. Het detecteren van vergiftigde data is exponentieel moeilijker dan het identificeren van een slechte backlink, omdat de manipulatie plaatsvindt op het trainingsniveau en vaak onzichtbaar is voor externe audits. Met AI-zoekverkeer dat in slechts vijf maanden (januari-mei 2025) met 527% is gestegen en 79% van de Amerikanen die AI-zoekmachines vertrouwen, is de prikkel voor concurrenten om te saboteren groter dan ooit, terwijl de beveiligingsinfrastructuur om dit te voorkomen nog onderontwikkeld is.

Het meest opvallende voorbeeld van AI-sabotage vond plaats toen Target slachtoffer werd van een gecoördineerde desinformatiecampagne die ten onrechte beweerde dat de retailer ‘satanisch gethematiseerde’ kinderkleding verkocht. AI-systemen, getraind op dit verzonnen verhaal, begonnen deze valse beweringen te tonen in zoekresultaten en AI-overzichten, wat aanzienlijke reputatieschade veroorzaakte voordat het bedrijf kon reageren. E-mailsystemen zijn op vergelijkbare wijze aangevallen via spamfilter-poisoning, waarbij concurrenten kwaadaardige patronen in trainingsdata injecteren zodat legitieme e-mails als spam worden gemarkeerd. Concurrent review bombing komt steeds vaker voor, waarbij bedrijven de vermeldingen van rivaliserende ondernemingen overspoelen met nep-negatieve beoordelingen die AI-systemen vervolgens samenvoegen tot sentimentsscores. Directory listing-kaping is een andere vector, waarbij aanvallers bedrijfsprofielen van concurrenten claimen op platforms zoals Google Mijn Bedrijf of branchegidsen, en vervolgens valse informatie aanleveren die door AI-systemen wordt geïndexeerd en geciteerd. Deze gevallen tonen aan dat AI-sabotage geen theorie is—het schaadt bedrijven actief vandaag de dag, met extra schade omdat AI-zoekresultaten gezaghebbend lijken en vaak de eerste informatie zijn die gebruikers tegenkomen.

Het detecteren van competitieve AI-sabotage vereist een gelaagde monitoringsaanpak die volgt hoe uw merk verschijnt in AI-zoekresultaten en citatiebronnen. De eerste stap is continue monitoring van AI-zoekresultaten voor uw merk, producten en belangrijke bestuurders op platforms als Google AI Overviews, Perplexity, ChatGPT en Claude. Sentimenttracking over geïndexeerde bronnen helpt plotselinge verschuivingen te identificeren in hoe uw merk wordt besproken—een waarschuwingssignaal voor gecoördineerde desinformatiecampagnes. Identificatie van nepbeoordelingen vereist analyse van beoordelingspatronen op statistische afwijkingen, zoals plotselinge pieken in één-sterbeoordelingen of beoordelingen met identieke bewoordingen. Vroege detectie is cruciaal; onderzoek laat zien dat de eerste 48 uur na een sabotage-aanval van cruciaal belang zijn voor indamming en respons. Monitoring moet ook bijhouden welke bronnen AI-systemen citeren over uw merk, zodat u vergiftigde databronnen kunt identificeren voordat ze grootschalige schade veroorzaken. Dit zijn de essentiële detectiemethoden:

Weerbaarheid opbouwen tegen competitieve AI-sabotage vereist een proactieve, veelzijdige verdedigingsstrategie die verder gaat dan traditionele reputatiemanagement. Hoogwaardige, gezaghebbende content creëren is uw sterkste verdediging—AI-systemen zijn getraind om content van gevestigde, geloofwaardige bronnen te herkennen en te prioriteren, waardoor het voor vergiftigde data moeilijker wordt om met legitieme informatie te concurreren. Accurate informatie versterken op meerdere geïndexeerde platforms zorgt ervoor dat AI-systemen bij het zoeken naar informatie over uw merk consistente, waarheidsgetrouwe verhalen tegenkomen van gezaghebbende bronnen. Uw merkpresentie beveiligen betekent alle bedrijfsvermeldingen, socialmediaprofielen en branchegidsen claimen en verifiëren om kaping te voorkomen. Implementeer robuuste monitoringsystemen die uw merk in realtime volgen in AI-zoekresultaten, zodat u snel kunt reageren op opkomende bedreigingen. Ontwikkel responsprotocollen die beschrijven hoe uw team reageert op gedetecteerde sabotage, inclusief documentatie, meldingen bij platforms en juridische stappen indien nodig. Relaties opbouwen met journalisten, branche-influencers en vertrouwde publicaties zorgt voor extra lagen van geloofwaardigheid die door AI-systemen worden erkend en gewaardeerd.

Specifieke AI-monitoringplatforms zijn essentieel geworden voor merkbescherming in het tijdperk van AI-zoeken. Deze tools bieden realtime waarschuwingen wanneer uw merk verschijnt in AI-zoekresultaten, zodat u niet alleen posities kunt volgen maar ook daadwerkelijke citaties en de bronnen die AI-systemen gebruiken. AmICited.com springt eruit als een uitgebreide oplossing die specifiek is ontworpen voor het monitoren van hoe uw merk, producten en bestuurders worden geciteerd in AI-zoekmachines zoals Google AI Overviews, Perplexity en GPT’s. Het platform volgt welke bronnen AI-systemen citeren over uw merk, zodat u vergiftigde databronnen kunt identificeren en reageren voordat ze grootschalige schade veroorzaken. Integratie met uw bredere merkveiligheidsstrategie betekent dat u AI-citatiepatronen kunt correleren met traditionele zoekstatistieken, socialmediasentiment en beoordelingsplatforms om een compleet beeld van uw concurrentielandschap te krijgen. Door AI-monitoring te combineren met bestaande reputatiemanagementtools, creëert u een geïntegreerd verdedigingssysteem dat sabotagepogingen vroegtijdig signaleert en de gegevens levert die nodig zijn voor snelle respons.

Nu competitieve AI-sabotage vaker voorkomt, ontwikkelen juridische kaders zich om deze nieuwe bedreigingen aan te pakken. DMCA-verwijderingsverzoeken kunnen worden ingezet om vergiftigde content uit geïndexeerde bronnen te verwijderen, al is het proces vaak traag en vereist het duidelijk bewijs van auteursrechtschending of identiteitsfraude. Lasterwetgeving biedt mogelijkheden wanneer sabotage bestaat uit valse verklaringen die uw reputatie schaden, al blijft het aantonen van schade in de AI-context complex. De meeste grote platforms hebben nu meldingsmechanismen specifiek voor AI-gerelateerd misbruik, inclusief datapoisening, nepbeoordelingen en desinformatiecampagnes, al verschilt de handhaving sterk. Opkomende regelgeving zoals de EU AI Act en voorgestelde Amerikaanse wetgeving beginnen aansprakelijkheidskaders op te stellen voor AI-systemen die valse informatie versterken, wat mogelijk nieuwe juridische routes opent. Bedrijven moeten alle sabotagepogingen grondig documenteren, aangezien dit bewijs cruciaal is voor zowel juridische procedures als platformberoepen. Overleg met juridisch adviseurs met ervaring in AI en digitale reputatie wordt steeds belangrijker voor het ontwikkelen van responsstrategieën die voldoen aan de veranderende regelgeving.

Het landschap van competitieve AI-sabotage blijft zich ontwikkelen naarmate zowel aanvallers als verdedigers geavanceerdere technieken ontwikkelen. AI-gegenereerde nepbeoordelingen met grote taalmodellen zullen steeds moeilijker te onderscheiden zijn van authentieke gebruikersfeedback, waardoor geavanceerdere detectiesystemen nodig zijn. Blockchain-verificatie en gedecentraliseerde geloofwaardigheidssystemen ontstaan als mogelijke oplossingen om de bronauthenticiteit te waarborgen voordat AI-systemen data in trainingssets opnemen. Platformaanbieders investeren fors in verbeterde verdediging, waaronder betere datavalidatie, bronverificatie en algoritmes voor vergiftigingsdetectie, al zullen deze maatregelen altijd achterlopen op nieuwe aanvalsvectoren. Community-gebaseerde verificatiesystemen waarbij gebruikers en experts verdachte content markeren, kunnen de norm worden en zo zorgen voor een collectieve verdediging tegen sabotage. Het concurrentievoordeel komt steeds meer toe aan bedrijven die voorop blijven lopen bij opkomende bedreigingen door continue monitoring, snelle responsprotocollen en investeren in AI-geletterdheid binnen hun teams. Organisaties die AI-monitoring vandaag als kernonderdeel van hun merkbeschermingstrategie beschouwen, zijn het best gepositioneerd om zich te verdedigen tegen de geavanceerdere aanvallen van morgen.

Traditionele negatieve SEO richt zich op zoekmachineresultaten via linkmanipulatie en het scrapen van content. Competitieve AI-sabotage richt zich op AI-trainingsdata en modelgedrag, door de bronnen te vergiftigen die AI-systemen in antwoorden citeren. AI-systemen zijn kwetsbaarder omdat ze direct bronnen citeren en trainingsdata meer vertrouwen dan traditionele zoekalgoritmen.

Monitor wekelijks hoe AI-platforms uw merk beschrijven met tools zoals AmICited.com. Let op plotselinge sentimentveranderingen, valse beweringen in AI-antwoorden, gecoördineerde negatieve beoordelingen of verspreiding van desinformatie op platforms. Vroege detectie binnen de eerste 48 uur is cruciaal voor indamming.

Documenteer onmiddellijk alles met screenshots en tijdstempels. Meld het bij de betrokken platforms (OpenAI, Google, Anthropic). Verspreid accurate informatie via uw eigen kanalen. Neem contact op met juridisch advies als er sprake is van laster of financiële schade. Implementeer monitoringsystemen om toekomstige aanvallen vroegtijdig te signaleren.

Onderzoek toont aan dat aanvallers slechts 250 kwaadaardige documenten of 7-8% van een dataset nodig hebben om AI-modellen daadwerkelijk te vergiftigen. Deze lage drempel maakt AI-systemen bijzonder kwetsbaar in vergelijking met traditionele zoekmachines, die geavanceerdere spamdetectiemechanismen hebben.

Huidige AI-platforms hebben beperkte detectiemogelijkheden en vertrouwen vooral op gebruikersmeldingen en periodieke hertraining met schone data. Platforms implementeren echter betere verificatiesystemen, anomaliedetectie en toegangscontroles. De verantwoordelijkheid voor vroege detectie ligt vaak bij de merken zelf.

Bouw een sterke authentieke reputatie op met hoogwaardige content, monitor AI-zoekresultaten regelmatig, beveilig uw merkvermelding in directories, implementeer realtime monitoringsystemen en reageer snel op aanvallen. Preventie via reputatieopbouw is effectiever dan herstel nadat sabotage heeft plaatsgevonden.

AmICited.com monitort hoe AI-platforms (ChatGPT, Perplexity, Google AI Overviews) uw merk noemen, volgt sentimentveranderingen en citatiepatronen. Realtime waarschuwingen melden plotselinge verschuivingen in hoe AI uw merk beschrijft, zodat u snel kunt reageren op sabotagepogingen.

U kunt een lasterzaak aanspannen, DMCA-verwijderingsverzoeken indienen voor onjuiste content, overtredingen melden bij platforms en mogelijk schadevergoeding eisen voor financiële schade. Documentatie van de sabotage is cruciaal. Raadpleeg een jurist gespecialiseerd in digitale rechten en intellectueel eigendom.

Bescherm uw merk tegen competitieve AI-sabotage met realtime monitoring via ChatGPT, Perplexity en Google AI Overviews. Detecteer bedreigingen voordat ze uw reputatie schaden.

Leer hoe je je AI-zichtbaarheid kunt vergelijken met die van concurrenten. Volg citaties, aandeel in het totaal en competitieve positionering op ChatGPT, Perple...

Leer hoe je vermeldingen van concurrenten in AI-zoekmachines volgt. Monitor ChatGPT, Perplexity, Claude en Google AI-zichtbaarheid met share of voice-metrics.

Echte voor-en-na case study die laat zien hoe strategische website-optimalisaties het aantal AI-citaties met 47+ maandelijkse vermeldingen verhoogden. Leer de e...

Cookie Toestemming

We gebruiken cookies om uw browse-ervaring te verbeteren en ons verkeer te analyseren. See our privacy policy.