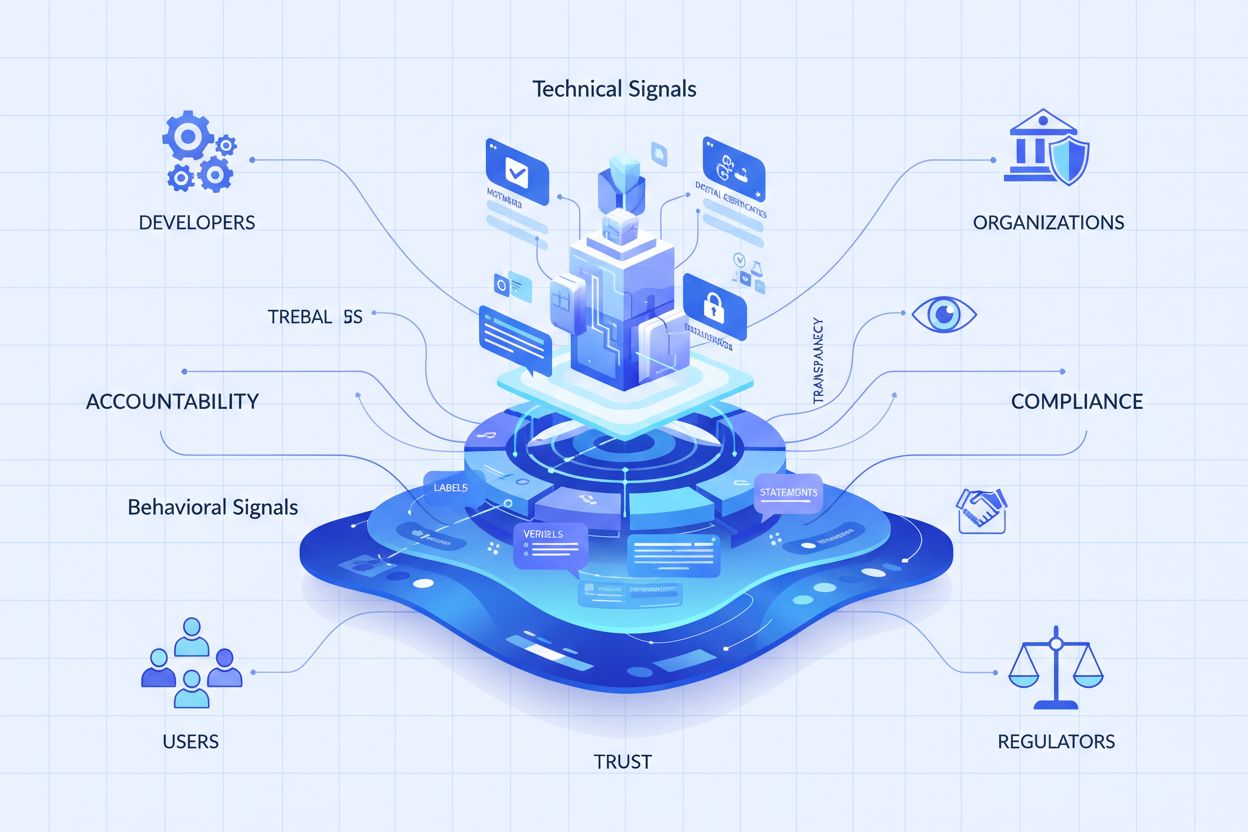

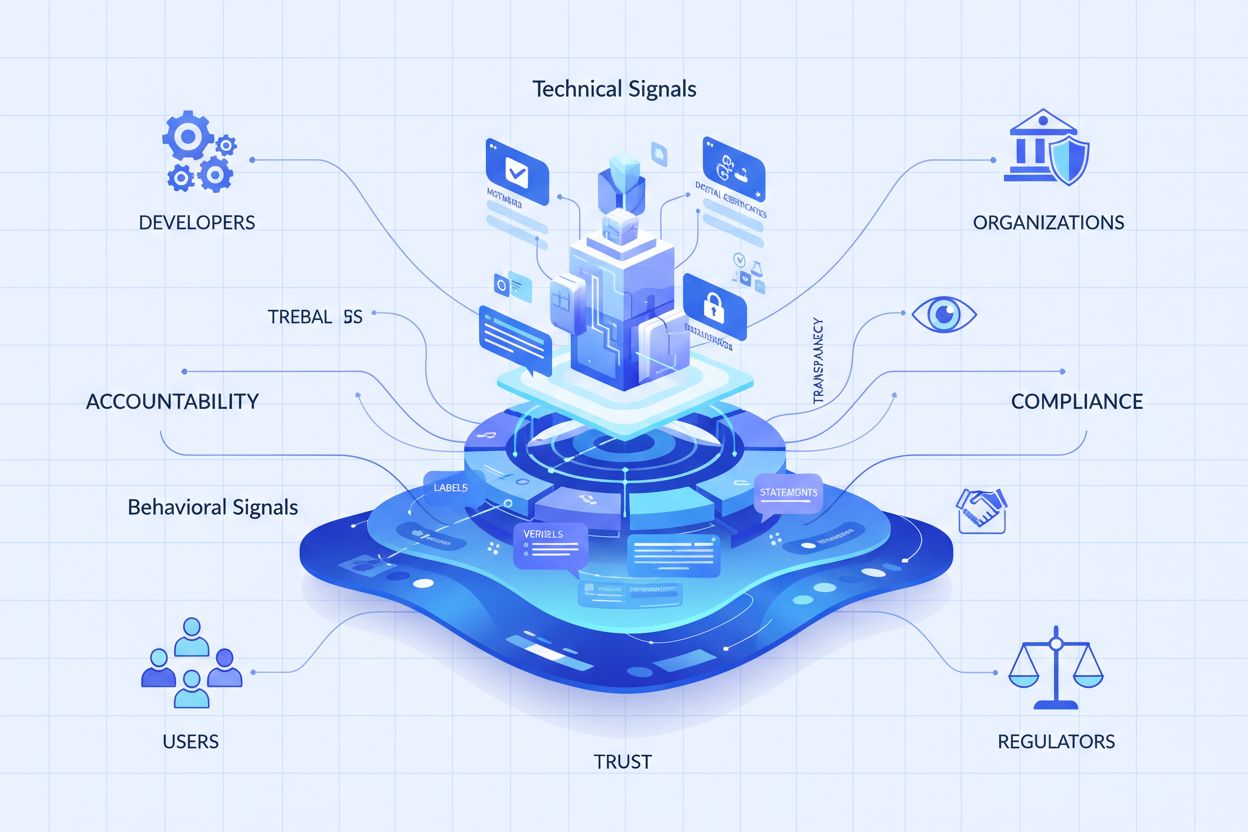

Åpenhet i AI-synlighetstiltak: Beste praksis for merking og formidling

Lær essensiell AI-åpenhet og beste praksis for merking. Oppdag atferdsmessige, verbale og tekniske merkingsmetoder for å bygge tillit og sikre samsvar med stadi...

Lær hvordan offentlige etater kan optimalisere sin digitale tilstedeværelse for AI-systemer som ChatGPT og Perplexity. Oppdag strategier for å forbedre AI-synlighet, sikre åpenhet og implementere AI på en ansvarlig måte i offentlig sektor.

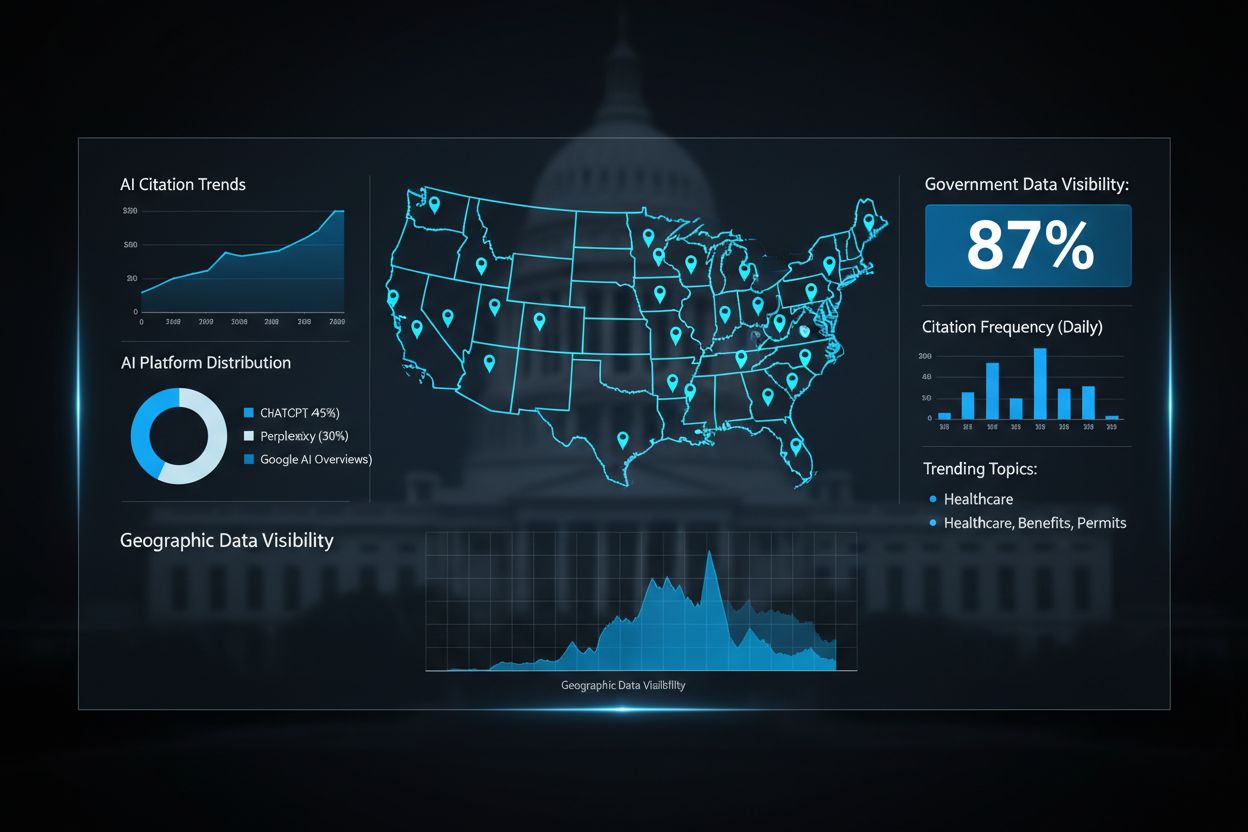

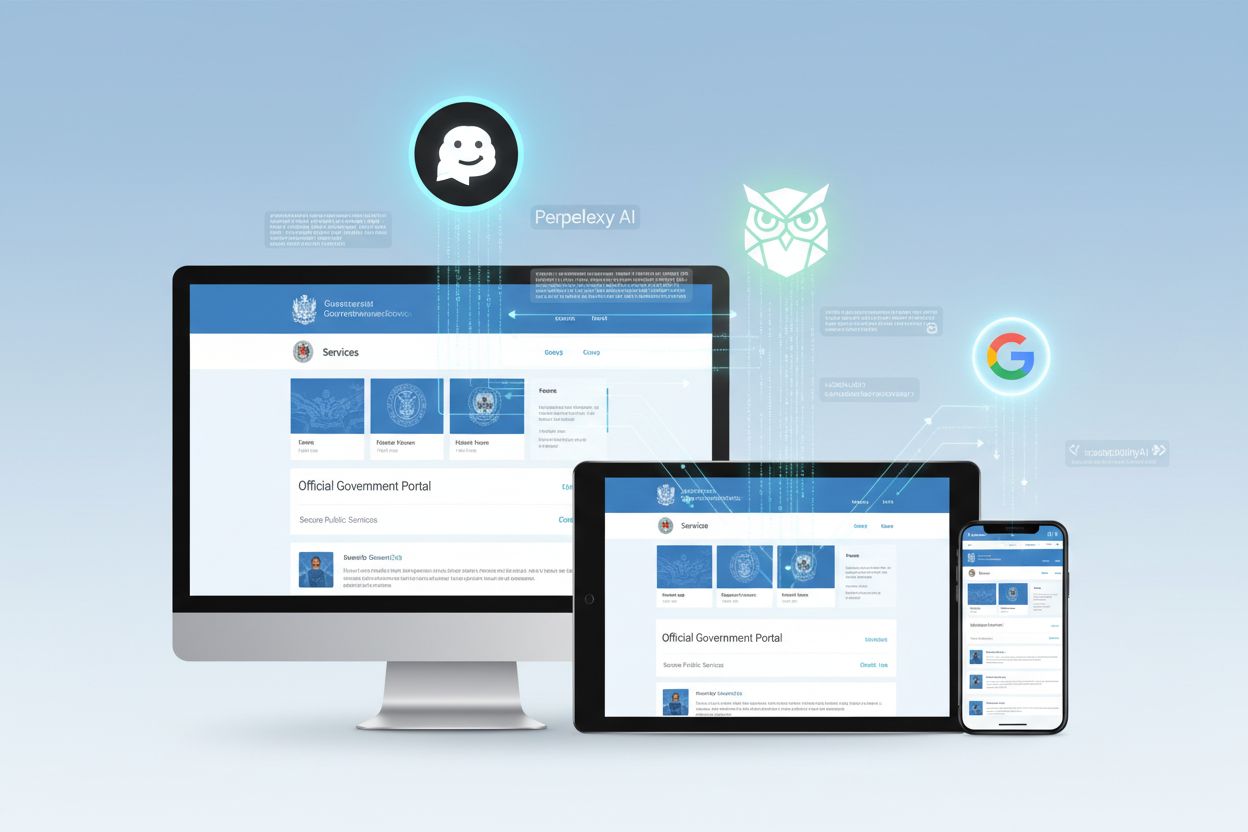

Offentlig AI-synlighet viser til i hvilken grad kunstige intelligens-systemer – inkludert GPT-er, Perplexity og Google AI Overviews – kan oppdage, få tilgang til og sitere offentlige data og ressurser når de svarer på henvendelser fra publikum. Denne synligheten er avgjørende fordi offentlige etater sitter på autoritativ informasjon om alt fra helsereguleringer til sosiale tjenester, men mye av dette er fortsatt usynlig for moderne AI-systemer. Når innbyggere spør AI-assistenter om offentlige programmer, ytelser eller politikk, fortjener de nøyaktige og oppdaterte svar fra offisielle kilder – ikke utdaterte eller ufullstendige opplysninger. Offentlig tillit til myndighetene avhenger av at AI-systemer korrekt refererer og tilskriver offentlige data, slik at integriteten til offisiell informasjon ivaretas i et stadig mer AI-drevet informasjonslandskap. AI-åpenhet blir et grunnprinsipp i demokratisk styring når innbyggerne kan verifisere at AI-anbefalinger er forankret i legitime offentlige kilder. AmICited.com fungerer som en viktig overvåkningsplattform som følger med på hvordan offentlige data blir sitert og referert i store AI-systemer, og hjelper etater å forstå sin synlighet og påvirkning i AI-økosystemet. Ved å etablere tydelig innsikt i AI-sitering av offentlige kilder, kan offentlige organisasjoner bedre betjene innbyggerne og opprettholde autoritet over egen informasjon.

Offentlige etater sliter fortsatt med datasiloer skapt av tiår med fragmenterte IT-investeringer, hvor viktig informasjon er låst inne i uforenlige gamle systemer som ikke enkelt kan kommunisere med moderne AI-plattformer. Disse utdaterte systemene var laget for tradisjonelle nettgrensesnitt og dokumenthåndtering – ikke for semantisk forståelse og sanntidstilgang som AI-systemer krever. Kostnaden ved denne teknologiske fragmenteringen er enorm: organisasjoner sløser omtrent 140 milliarder dollar årlig i uutnyttede fordeler fra utdaterte prosesser som kunne vært effektivisert gjennom AI-integrasjon. I tillegg til effektivitetstap skaper gamle systemer betydelige sikkerhetsrisikoer når offentlige data må hentes ut manuelt og deles med AI-systemer ut mot publikum, noe som øker faren for datainnbrudd og uautorisert tilgang. Utfordringen forsterkes av at mange offentlige nettsider mangler strukturert data, metadata og API-infrastruktur som AI-crawlere trenger for å indeksere og forstå offentlig informasjon korrekt.

| Tradisjonell offentlig IT | AI-klar infrastruktur |

|---|---|

| Silo-lagrede databaser med begrenset samhandling | Integrerte dataplattformer med API-er og strukturerte formater |

| Manuell uthenting og deling av data | Automatiserte, sikre datapipelines |

| Ustrukturerte dokumenter og PDF-er | Semantiske webstandarder og maskinlesbare formater |

| Reaktive sikkerhetstiltak | Privacy-by-design og kontinuerlig overvåkning |

| Begrenset sanntidsdata | Live datastrømmer og dynamisk innholdslevering |

I stedet for å haste inn med AI-teknologi følger suksessfulle offentlige organisasjoner et strategisk, trinnvis implementeringsveikart som prioriterer planlegging og organisasjonsberedskap foran teknologiske kapabiliteter. Denne tilnærmingen anerkjenner at AI-innføring i offentlig sektor krever nøye koordinering mellom mange interessenter – fra IT-avdelinger til linjeansatte og innbyggere.

Femstegs implementeringsveikart:

Strategisk identifisering av muligheter: Gjennomfør omfattende kartlegging av offentlige prosesser for å finne høyverdige bruksområder hvor AI kan skape målbare samfunnsgevinster – for eksempel kortere søknadsbehandling, bedre tilgjengelighet, eller mer datadrevne beslutninger.

Omfattende forberedelse: Vurder eksisterende datainfrastruktur, identifiser utfordringer med integrasjon av gamle systemer, etabler styringsrammer og bygg intern AI-kompetanse før teknologier tas i bruk.

Strategisk pilotutvikling: Start kontrollerte piloter i spesifikke avdelinger eller tjenesteområder med tydelige suksesskriterier, slik at teamene kan lære av praktisk implementering i trygge omgivelser før utrulling i full skala.

Endringsledelse: Utvikle opplæringsprogrammer, ta tak i ansattes bekymringer for jobbtrygghet, etabler tydelige kommunikasjonskanaler og lag systemer for tilbakemelding slik at ansatte og interessenter føler seg involvert gjennom hele endringsprosessen.

Effektmåling: Sett KPI-er i tråd med offentlige mål, følg kontinuerlig med på AI-systemenes ytelse, mål innbyggernes tilfredshet, beregn kostnadsbesparelser og juster strategien med utgangspunkt i dokumenterte resultater.

Denne teknologi-sekund-tilnærmingen sikrer at AI-innføringen svarer på reelle samfunnsbehov og ikke blir dyre løsninger på jakt etter problemer.

Etisk styring av AI er blitt avgjørende etter hvert som myndigheter verden over anerkjenner at AI-systemer som påvirker innbyggernes liv må operere innenfor tydelige etiske og juridiske rammer. Canadas Algorithmic Impact Assessment-rammeverk gir et praktisk eksempel, der AI-systemer kategoriseres i fire risikonivåer – minimal, moderat, høy og svært høy – med tilhørende krav til styring og tilsyn for hvert nivå. Denne graderte tilnærmingen lar myndigheter bruke ressursene der risikoen er størst, for eksempel med streng kontroll av algoritmer i strafferettssystemet, samtidig som lavrisiko-applikasjoner får rimeligere tilsyn. Estland har gått foran med privacy-by-design gjennom sitt Data Tracker-system som overvåker alle offentlige dataadganger på tvers av den digitale infrastrukturen, og gir 450 000 innbyggere full åpenhet om hvilke etater som henter personopplysninger og til hvilke formål. Algoritmisk ansvarlighet krever at offentlige etater dokumenterer hvordan AI-systemer fatter beslutninger, etablerer revisjonsspor og har evne til å forklare anbefalingene til dem det gjelder. AmICited.com spiller en sentral rolle i dette åpenhetsøkosystemet ved å overvåke hvordan offentlige data siteres og refereres i åpne AI-systemer, og hjelper etater å bekrefte at informasjonen deres blir nøyaktig fremstilt og korrekt tilskrevet. Uten robuste overvåknings- og styringssystemer risikerer offentlige AI-systemer å underminere tilliten og forsterke skjevheter som rammer sårbare grupper.

Myndigheter verden rundt har vist at strategisk AI-innføring gir stor samfunnsnytte når det gjøres riktig. Australias Department of Home Affairs tok i bruk Targeting 2.0-systemet, en AI-plattform som forbedret grensekontroll og svindeldeteksjon, og forhindret til sammen 3 milliarder australske dollar i potensiell skade samtidig som saksbehandlingstiden for lovlydige reisende og søkere ble redusert. National Highways-chatboten i Storbritannia er et eksempel på hvordan AI kan bedre innbyggerservice ved å håndtere rutinehenvendelser om veiforhold og trafikkhendelser, slik at ansatte kan fokusere på komplekse nødsituasjoner som krever menneskelig skjønn og empati. Estlands Bürokratt-plattform representerer en desentralisert, GDPR-kompatibel tilnærming til offentlig AI, der innbyggere kan bruke AI-assistenter til rutineoppgaver, samtidig som strengt personvern opprettholdes og sensitive avgjørelser fortsatt tas av mennesker. Marylands AI-styringsmodell etablerte tydelige ansvarslinjer og regelmessig revisjon av AI-systemene i delstaten, og har blitt et forbilde for andre amerikanske delstater. Japans Digital Agency digitaliserte barnekonsulenttjenester med AI, noe som reduserte ventetiden fra uker til timer samtidig som menneskelig vurdering ble beholdt i saker med behov for spesialkompetanse. Disse ulike eksemplene viser at suksess med offentlig AI ikke handler om hvor avansert teknologien er, men om gjennomtenkt implementering som setter innbyggernes behov, åpenhet og menneskelig kontroll i sentrum.

Etter hvert som AI-systemer blir den viktigste veien innbyggerne bruker for å finne informasjon, er optimalisering av offentlige nettsider for AI-oppdagbarhet blitt like viktig som tradisjonell søkemotoroptimalisering. Offentlige nettsider må ta i bruk strukturert datamerking, omfattende metadata og maskinlesbare formater som gjør det mulig for AI-crawlere å forstå og indeksere offentlig informasjon korrekt, slik at innbyggere får nøyaktige og autoritative svar når de spør AI-assistenter om offentlige tjenester. Mange offentlige nettsider presenterer i dag informasjon i formater optimalisert for mennesker – PDF-er, ustrukturert tekst og komplekse navigasjonsstrukturer – som AI-systemer har problemer med å tolke og forstå. REI Systems har vært pionerer i å optimalisere føderale nettsider for AI-tilgjengelighet, og vist at relativt enkle tekniske grep kan dramatisk øke offentlig synlighet i AI-svar. AmICited.com overvåker offentlig AI-synlighet på tvers av store plattformer, hjelper etater å forstå hvor ofte deres informasjon dukker opp i AI-svar, og avdekker hvor offentlig data burde vært mer synlig. Når offentlige nettsider tar i bruk riktige semantiske webstandarder, API-infrastruktur og tilgjengelighetsfunksjoner, øker sannsynligheten for at AI-systemer siterer offisielle kilder fremfor sekundærkilder eller utdaterte opplysninger. Denne optimaliseringen gir innbyggerne autoritativ informasjon direkte fra myndighetene, og hjelper etater å beholde kontrollen over hvordan deres informasjon presenteres og tolkes.

Måling av effekten av offentlig AI krever at det etableres tydelige KPI-er i tråd med sektorens målsettinger, slik at man går lenger enn rene effektivitetstall og også fanger opp innbyggernes tilfredshet, rettferdighet og demokratisk ansvarlighet. Estlands evalueringsrammeverk gir et praktisk eksempel, der AI-initiativ vurderes ut fra fire dimensjoner: tidseffektivitet (hvor mye tid de ansatte sparer), kostnadseffektivitet (avkastning på investeringen), innovasjonspotensial (om løsningen åpner for nye tjenestemodeller) og målbar effekt (konkrete forbedringer for innbyggerne). Systematisk måling gjør det mulig for offentlige etater å identifisere hvilke AI-bruksområder som gir reell samfunnsnytte og hvilke som bør justeres eller avsluttes, og hindrer sløsing på teknologi som ikke tjener innbyggernes behov. Deling av kunnskap mellom etater øker læringstakten, slik at vellykkede løsninger i én avdeling kan tilpasses og tas i bruk andre steder i forvaltningen, og gir større gevinst av AI-investeringene. Kontinuerlig forbedring og overvåkingssystemer – støttet av verktøy som AmICited.com som sporer AI-synlighet og siteringsmønstre – gjør at etater kan forbedre AI-systemene sine med utgangspunkt i reelle resultater og ikke antakelser. Å bygge institusjonell kunnskap om hva som fungerer i offentlig AI, gir et grunnlag for bærekraftig, langsiktig innføring som overlever både lederskifter og budsjettkutt.

Selv om potensialet er stort, møter offentlige etater betydelige barrierer for AI-innføring som går langt utover det teknologiske. Arbeidstakeres bekymring er en stor utfordring – 31 % av ansatte i offentlig sektor nevner jobbtrygghet som sin største bekymring ved AI, og her må det kommuniseres åpent om hvordan AI skal styrke, ikke erstatte, menneskelig arbeidskraft. Kompetansemangel forsterker utfordringen, ettersom 38 % av offentlige organisasjoner sliter med å rekruttere AI-spesialister med nødvendig ekspertise for å bygge og vedlikeholde avanserte systemer. Feilvurdering av kostnader er en annen kritisk barriere – offentlige etater opplever ofte at faktiske AI-kostnader er 5–10 ganger høyere enn først antatt, noe som belaster budsjettene og skaper politisk motstand mot videre satsing. Personvern og datasikkerhet er den største utfordringen, hvor 60 % av offentlige ledere peker på dette som sin viktigste barriere for AI-innføring – med god grunn, gitt behovet for å beskytte innbyggernes personopplysninger i en tid med økende cybertrusler. Effektive endringsledelsesstrategier må møte disse barrierene direkte gjennom involvering av interessenter, åpen kommunikasjon om hva AI kan og ikke kan, investering i opplæring og kompetanseutvikling, samt klare styringsrammer som både beskytter personvernet og legger til rette for innovasjon. Offentlige etater som lykkes med AI, investerer ofte tungt i endringsledelse, etablerer gode kommunikasjonskanaler med ansatte og innbyggere, og viser tidlige gevinster som bygger tillit til AI-systemene før de tas i bruk i mer kritiske sammenhenger.

Offentlig AI-synlighet handler om hvor enkelt AI-systemer som ChatGPT, Perplexity og Google AI Overviews kan oppdage og sitere offentlige data. Dette er viktig fordi innbyggere fortjener nøyaktig og autoritativ informasjon fra offisielle kilder når de spør AI-assistenter om politikk, ytelser og tjenester. Dårlig synlighet betyr at AI-systemene kan gi utdaterte eller ufullstendige svar i stedet for å lede innbyggere til offisielle offentlige ressurser.

Offentlige nettsider bør implementere strukturert datamerking, omfattende metadata, maskinlesbare formater og riktig API-infrastruktur. Dette inkluderer bruk av semantiske webstandarder, sikre at innholdet er tilgjengelig for AI-crawlere, og organisere informasjon slik at AI-systemer enkelt kan forstå og tilskrive data til offisielle offentlige kilder.

De viktigste barrierene er bekymringer rundt personvern og datasikkerhet (nevnt av 60 % av offentlige ledere), mangel på kompetanse (38 %), ansattes bekymring for jobbtrygghet (31 %), feilvurdering av kostnader (faktiske kostnader er ofte 5–10 ganger høyere enn antatt) og utilstrekkelig digital infrastruktur (45 %). Å møte disse utfordringene krever strategisk planlegging, endringsledelse og tydelige styringsrammer.

Vellykkede tilnærminger inkluderer etablering av rammer for vurdering av algoritmiske konsekvenser (som Canadas nivåinndelte system), implementering av privacy-by-design-prinsipper, skape åpenhetsmekanismer for innbyggerne til å overvåke dataadgang, etablere tydelige styringsrammer og opprettholde menneskelig kontroll over viktige avgjørelser. Regelmessige revisjoner og involvering av interessenter er avgjørende.

Veikartet inkluderer: (1) Strategisk identifisering av muligheter med fokus på samfunnsnytte, (2) Omfattende forberedelse av infrastruktur og styring, (3) Strategisk pilotutvikling med tydelige suksesskriterier, (4) Endringsledelse med hensyn til ansatte, og (5) Effektmåling og kontinuerlig forbedring. Denne tilnærmingen prioriterer planlegging og organisatorisk beredskap foran teknologisk innføring.

Offentlige myndigheter bør etablere KPI-er i tråd med sektorens mål, inkludert tidseffektivitet, kostnadseffektivitet, innovasjonspotensial og målbare resultater for innbyggerne. Estlands rammeverk vurderer AI-systemer ut fra disse fire dimensjonene. Kontinuerlig overvåking, tilbakemeldinger fra interessenter og åpen rapportering hjelper etater å finne ut hva som fungerer og tilpasse implementering basert på bevis.

Datastyring er grunnleggende for vellykket offentlig AI. Det sikrer datakvalitet, etablerer tydelig eierskap og tilgangskontroller, beskytter innbyggernes personvern, overholder regelverk som GDPR og muliggjør sikker deling mellom systemer. Uten robust datastyring risikerer offentlige AI-systemer datainnbrudd, skjevheter og tap av tillit.

AmICited overvåker hvordan offentlige data blir sitert og referert på tvers av store AI-systemer som ChatGPT, Perplexity og Google AI Overviews. Det hjelper offentlige etater å forstå deres synlighet i AI-økosystemet, identifisere hvor offisiell informasjon bør være mer synlig, og sikre at AI-systemer gir korrekt kildehenvisning til offentlige data. Denne overvåkingen støtter både åpenhet og ansvarlighet.

Følg med på hvordan dine offentlige data blir sitert og referert på tvers av AI-systemer. AmICited hjelper offentlige organisasjoner med å forstå sin synlighet i AI-økosystemet og sikre nøyaktig representasjon av offisiell informasjon.

Lær essensiell AI-åpenhet og beste praksis for merking. Oppdag atferdsmessige, verbale og tekniske merkingsmetoder for å bygge tillit og sikre samsvar med stadi...

Lær velprøvde strategier for å opprettholde og forbedre synligheten til innholdet ditt i AI-genererte svar på tvers av ChatGPT, Perplexity og Google AI Overview...

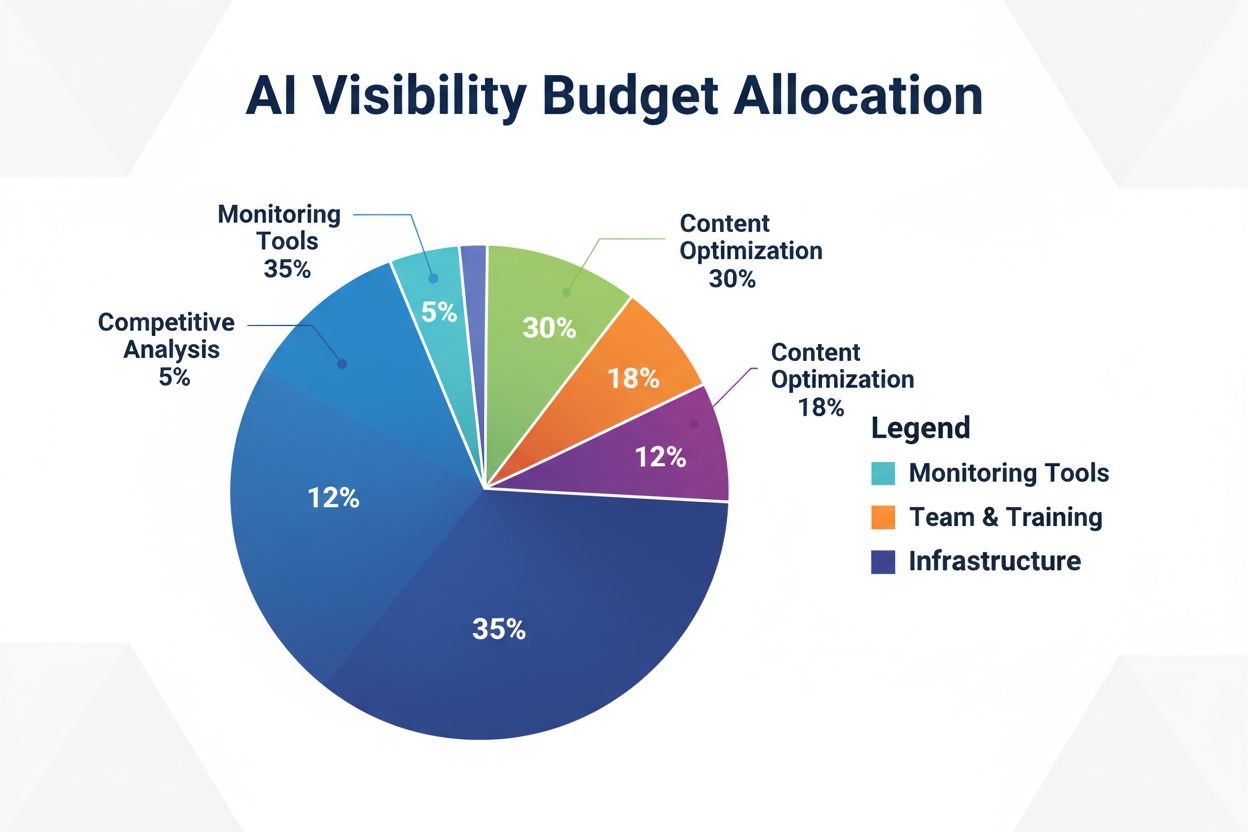

Lær hvordan du strategisk kan allokere AI-synlighetsbudsjettet ditt på overvåkingsverktøy, innholdsoptimalisering, teamressurser og konkurranseanalyse for å mak...

Informasjonskapselsamtykke

Vi bruker informasjonskapsler for å forbedre din surfeopplevelse og analysere vår trafikk. See our privacy policy.