Tillitsignal

Tillitsignaler er troverdighetsindikatorer som etablerer merkevarens pålitelighet for brukere og AI-systemer. Lær hvordan verifiserte merker, attester og sikker...

Lær hvordan AI-systemer vurderer tillitsignaler gjennom E-E-A-T-rammeverket. Oppdag troverdighetsfaktorene som hjelper LLM-er å sitere innholdet ditt og bygge autoritet.

Tillitsignaler er de digitale indikatorene og markørene som AI-systemer bruker for å vurdere troverdigheten og påliteligheten til innhold når de genererer svar. Etter hvert som kunstig intelligens blir stadig mer integrert i søk og informasjonsinnhenting, har det blitt essensielt for innholdsprodusenter og merkevarer å forstå hvordan disse systemene vurderer pålitelighet. E-E-A-T-rammeverket—som står for Erfaring, Ekspertise, Autoritet og Troverdighet—gir en strukturert tilnærming til hvordan AI vurderer innholdskvalitet. Blant disse fire søylene har troverdighet blitt den mest avgjørende faktoren, ettersom AI-systemer forstår at selv svært kunnskapsrike kilder kan være upålitelige hvis de mangler åpenhet og verifiserbare kvalifikasjoner. Moderne språkmodeller som ChatGPT, Perplexity og Google AI Overviews analyserer flere kategorier av signaler—including innholdskvalitet, teknisk infrastruktur, atferdsmønstre og kontekstuell samsvar—for å avgjøre hvilke kilder som fortjener fremhevelse i sine svar.

| Søyle | Definisjon | AI-signal | Eksempel |

|---|---|---|---|

| Erfaring | Praktisk, erfaringsbasert kunnskap oppnådd gjennom direkte involvering | Innhold som viser reell anvendelse og personlig deltakelse i temaet | En programvareutvikler som skriver om feilsøkingsmetoder de selv har brukt i produksjonsmiljøer |

| Ekspertise | Dyp, spesialisert kunnskap og ferdigheter innen et bestemt fagområde | Teknisk nøyaktighet, bruk av faguttrykk og dokumentert faglig dyktighet | En kardiolog som forklarer risikofaktorer for hjertesykdom med presis medisinsk terminologi og oppdaterte forskningshenvisninger |

| Autoritet | Anerkjennelse og respekt innen en bransje eller fagfelt | Siteringer fra andre autoritative kilder, medieomtale, foredrag og lederroller i bransjen | En publisert forsker hvis arbeid ofte siteres av kolleger og omtales i toneangivende fagpublikasjoner |

| Troverdighet | Pålitelighet, åpenhet og ærlighet i kommunikasjon | Tydelig forfatterattribusjon, opplysning om interessekonflikter, verifiserbare kvalifikasjoner og konsekvent nøyaktighet over tid | En finansrådgiver som tydelig oppgir affiliate-forhold, holder kvalifikasjonene oppdatert og gir balanserte perspektiver |

Hver søyle fungerer i samspill med de andre for å skape en helhetlig tillitsprofil som AI-systemer vurderer. Erfaring viser at en forfatter har levd gjennom temaet, noe som gjør innsikten mer verdifull enn bare teoretisk kunnskap. Ekspertise signaliserer at forfatteren har den spesialiserte kunnskapen som trengs for å gi nøyaktig og nyansert informasjon. Autoritet viser at bransjen anerkjenner og respekterer forfatterens bidrag. Troverdighet fungerer derimot som fundamentet—uten den mister de andre søylene sin verdi. AI-systemer vektlegger troverdighet tungt fordi de forstår at en pålitelig kilde med moderat ekspertise er mer verdifull enn en upålitelig kilde som hevder å ha eksepsjonell ekspertise.

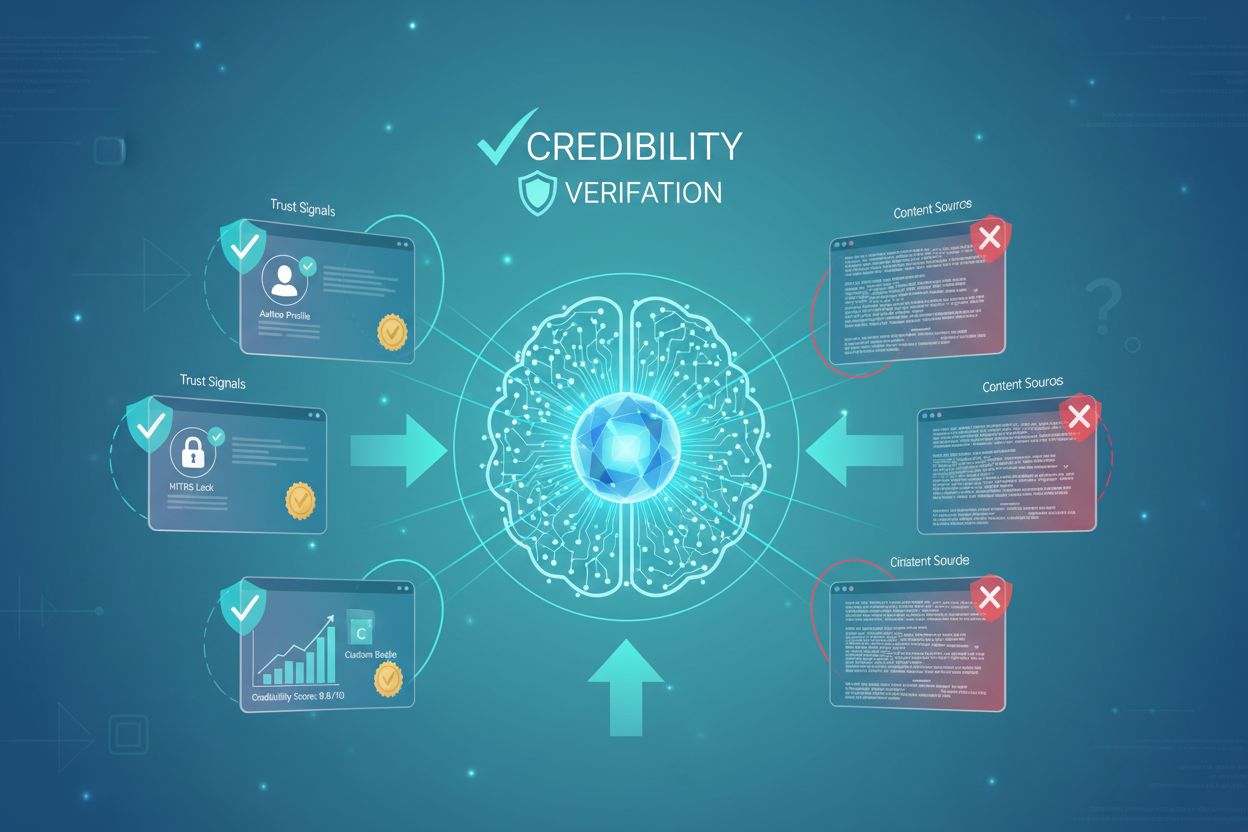

AI-systemer bruker en sofistikert flerstegsprosess for å evaluere tillitsignaler i innhold. Når en bruker sender inn en forespørsel, starter systemet med forståelse av forespørselen, analyserer hensikt og kontekst for å avgjøre hvilken type informasjon som trengs. Systemet utfører deretter innhenting av innhold, og henter relevante avsnitt fra indekserte kilder på nettet. Under rangering av avsnitt vurderer AI-algoritmer troverdigheten til hver kilde ved hjelp av tillitsignaler, og flytter pålitelige, høykvalitetskilder til toppen av kandidatlisten. Kildeverifisering innebærer å sjekke forfatterkvalifikasjoner, publiseringsdatoer, domeneautoritet og samsvar med andre autoritative kilder om samme tema. Systemet utfører så valg av siteringer, der de mest pålitelige kildene velges ut fra deres tillitspoeng. Til slutt gjennomfører sikkerhetsfiltre en kontroll for å sikre at det valgte innholdet oppfyller krav til nøyaktighet og ikke viderefører feilinformasjon. Hele denne prosessen skjer på millisekunder, der AI-systemer tar lynraske avgjørelser om hvilke kilder som fortjener å bli sitert i svarene sine.

Forfattertroverdighet er et av de viktigste tillitsignalene AI-systemer vurderer når de avgjør kildepålitelighet. Når innhold har tydelig forfatterattribusjon med verifiserbare kvalifikasjoner, kan AI-systemer kryssjekke denne informasjonen mot kjente databaser over eksperter, fagfolk og anerkjente autoriteter. Tilstedeværelsen av en navngitt forfatter gir ansvarlighet—AI-systemer forstår at personer som står frem med navn, oftere sørger for nøyaktighet og holder profesjonelle standarder. Utover bare navneattribusjon ser AI-systemer etter flere sentrale troverdighetsmarkører:

Når AI-systemer finner innhold med omfattende forfatterattribusjon, gir de høyere tillitspoeng fordi de kan verifisere forfatterens bakgrunn og historikk. Denne verifiseringsprosessen hjelper AI-systemer å skille mellom ekte eksperter og opportunistiske innholdsprodusenter uten reelle kvalifikasjoner. Organisasjoner som investerer i å bygge sterke forfatterprofiler—med biografi, kvalifikasjoner og konsekvent publiseringsaktivitet—signalerer til AI-systemer at de tar innholdskvalitet på alvor og står bak sine påstander.

AI-systemer vurderer innholdskvalitet gjennom flere faktasignaler som avslører om informasjonen er pålitelig og nøyaktig. Spesifikke, målbare påstander signaliserer høyere troverdighet enn vage generaliseringer—når innhold inneholder presise statistikker, datoer og målinger, forstår AI-systemer at forfatteren har lagt arbeid i research og verifisering. Forankret informasjon som refererer til konkrete studier, rapporter eller dokumenterte hendelser veier tyngre enn abstrakte påstander, fordi AI-systemer kan kryssjekke disse mot kjente pålitelige kilder. Konkret eksemplifisering som forklarer begreper gjennom virkelige scenarier viser dypere forståelse og gir leserne handlingsrettede innsikter, noe AI-systemer gjenkjenner som et kjennetegn på kvalitetsinnhold. Fravær av faktafeil er spesielt viktig; AI-systemer har interne kunnskapsbaser og kan oppdage når innhold motsier etablerte fakta eller inneholder foreldet informasjon. I tillegg signaliserer balansert fremstilling av ulike perspektiver på komplekse temaer troverdighet, da AI-systemer forstår at forenklede eller ensidige argumenter ofte skjuler mangelfull forståelse eller skjulte agendaer.

Den tekniske infrastrukturen bak innholdet ditt sender viktige tillitsignaler til AI-systemer som vurderer nettstedets pålitelighet og legitimitet. HTTPS-kryptering er nå et minimumskrav; AI-systemer gjenkjenner at nettsteder som bruker sikre protokoller tar brukerdata på alvor og trolig holder høye standarder på alle områder. Nettstedets ytelsesparametre som raske lastetider og mobiltilpasning viser at du har investert i kvalitet, noe som korrelerer med god innholdskvalitet og profesjonalitet. Gjennomgangsbarhet og indekserbarhet sikrer at AI-systemer enkelt kan få tilgang til og analysere innholdet ditt; nettsteder med riktig robots.txt, XML-sitemaps og ryddig URL-struktur signaliserer at du forstår og respekterer hvordan søkemotorer og AI oppdager innhold. Schema markup og strukturert data (for eksempel JSON-LD for forfatterinformasjon, publiseringsdatoer og artikkelmetadata) gir AI-systemer maskinlesbar informasjon som bekrefter og validerer påstandene i innholdet ditt. Disse tekniske elementene jobber sammen for å skape et miljø der AI-systemer trygt kan vurdere og sitere innholdet ditt, vel vitende om at infrastrukturen støtter nøyaktighet og pålitelighet.

Åpenhet er en grunnstein i troverdighet som AI-systemer aktivt vurderer når de evaluerer kilders pålitelighet. Om oss- og kontaktsider som gir tydelig informasjon om organisasjonen din, formål og hvordan man kan kontakte deg viser at du er villig til å ta ansvar for innholdet ditt. Affiliate- og interessekonfliktdisclaimer er særlig viktige; AI-systemer gjenkjenner at kilder som åpent erkjenner potensielle skjevheter er mer pålitelige enn de som skjuler økonomiske relasjoner. Personvernerklæringer som forklarer hvordan du håndterer brukerdata signaliserer respekt for personvern og overholdelse av regelverk, noe AI-systemer forbinder med troverdighet. Publiseringsdatoer og oppdateringsstempler lar AI-systemer vurdere hvor aktuelt innholdet er og forstå når informasjonen ble laget versus sist revidert—noe som er avgjørende for temaer med hyppige endringer. Dokumentasjon av rettelser som viser at du har identifisert og rettet feil demonstrerer intellektuell ærlighet og forpliktelse til nøyaktighet. Organisasjoner som opprettholder åpen praksis på alle disse områdene signaliserer til AI-systemer at de prioriterer nøyaktighet og brukertillit over kortsiktig gevinst, noe som gir høyere troverdighetsvurdering.

Ekstern validering fra andre autoritative kilder styrker tillitsignalene dine betydelig i AI-systemers øyne. Tilbakekoblinger fra etablerte, høyt ansette domener fungerer som anbefalinger; når anerkjente organisasjoner lenker til innholdet ditt, tolker AI-systemer dette som tredjepartsbekreftelse av din troverdighet. Medieomtale og presseoppslag i kjente publikasjoner indikerer at journalister og redaktører har vurdert din ekspertise og funnet innsiktene dine verdt å dele. Bransjegodkjenning gjennom priser, sertifiseringer eller oppføring i autoritative registre gir AI-systemer objektive bevis på din posisjon i fagfeltet. Foredrag på konferanser og bidrag til bransjepublikasjoner viser at fagfeller og ledere anerkjenner din ekspertise og er villige til å assosiere sin egen troverdighet med din. Entitetsgjenkjenning av kunnskapsbaser og AI-systemer selv—der organisasjonen eller merkevaren din identifiseres som en sentral aktør i ditt domene—skaper en positiv spiral som øker dine autoritetspoeng. Disse eksterne valideringssignalene virker sammen; jo flere autoritative kilder som refererer til og anbefaler innholdet ditt, desto høyere tillitsvurdering får fremtidig innhold fra AI-systemer.

Brukeratferd gir AI-systemer indirekte, men kraftige indikatorer på innholdets troverdighet og verdi. Tid brukt på siden viser om leserne finner innholdet ditt så substansielt at de vil bruke tid på det; AI-systemer forstår at folk bruker mer tid på innhold de opplever som verdifullt og pålitelig. Engasjementstall som kommentarer, delinger og interaksjoner viser at innholdet ditt engasjerer publikum og skaper meningsfull diskusjon, noe som henger sammen med kvalitet og pålitelighet. Avvisningsrate som er lavere enn bransjesnittet tyder på at besøkende finner det de leter etter og stoler nok på informasjonen til å utforske mer, i stedet for å forlate siden umiddelbart. Gjentatte besøk fra samme brukere signaliserer at innholdet har vist seg verdifullt over tid og at leserne stoler på deg nok til å komme tilbake for mer informasjon. Mønstre for deling i sosiale medier, spesielt fra kontoer med etablert troverdighet og aktive følgere, forsterker tillitsignalene dine på nettet. AI-systemer analyserer disse atferdssignalene fordi de forstår at ekte brukertillit—vist gjennom langvarig engasjement og gjentatte besøk—er en av de mest autentiske indikatorene på innholdskvalitet og pålitelighet.

Å utvikle en sterk tillitsprofil krever en systematisk tilnærming til implementering og optimalisering av E-E-A-T-signaler på tvers av innhold og digital tilstedeværelse. Start med en grundig gjennomgang av eksisterende E-E-A-T-signaler, for å kartlegge hvilke søyler som er sterke og hvilke som bør utvikles; denne kartleggingen viser hvor du bør legge innsatsen for størst effekt. Implementer tydelig forfatterattribusjon på alt innhold, inkludert detaljerte forfatterbios som dokumenterer kvalifikasjoner, erfaring og ekspertise; sørg for at forfatterinformasjonen er konsistent på alle plattformer hvor innholdet ditt vises. Legg til schema markup på nettstedet ditt med JSON-LD for å gi AI-systemer maskinlesbar informasjon om forfattere, publiseringsdatoer, artikkeltema og organisasjonsdetaljer. Bygg høykvalitets tilbakekoblinger ved å lage genuint verdifullt innhold som andre autoritative kilder ønsker å referere til og sitere; fokuser på å få lenker fra relevante, anerkjente domener fremfor å jakte på volum. Hold innholdet oppdatert ved å jevnlig revidere eksisterende artikler, legge til ny forskning og fjerne utdaterte påstander; AI-systemer gjenkjenner at aktivt vedlikeholdt innhold er mer pålitelig enn forlatte artikler. Overvåk hvordan AI-systemer siterer merkevaren din med verktøy som AmICited, som sporer når og hvordan AI Overviews, ChatGPT, Perplexity og andre AI-systemer refererer til innholdet ditt; denne innsikten gir deg oversikt over hvilke tillitsignaler som fungerer og hvor du bør forbedre deg. Ved å bygge disse tillitsignalene systematisk, legger du et sterkt fundament som hjelper AI-systemer å trygt sitere innholdet ditt og anbefale det til brukere som søker pålitelig informasjon.

E-E-A-T er et rammeverk som omfatter fire søyler: Erfaring, Ekspertise, Autoritet og Troverdighet. Tillitsignaler er de spesifikke indikatorene og markørene som AI-systemer bruker for å vurdere hver søyle. Tenk på E-E-A-T som den overordnede kvalitetsstandarden, mens tillitsignaler er de målbare bevisene som viser at du oppfyller denne standarden.

Små nettsteder kan bygge tillitsignaler ved å fokusere på forfatterattribusjon, lage innhold av høy kvalitet innenfor en spesifikk nisje, implementere schema markup, få lenker fra relevante kilder og opprettholde åpne praksiser. Du trenger ikke stor trafikk eller merkevarekjennskap—AI-systemer verdsetter dybde i ekspertise og konsistens i et fokusert område fremfor bred dekning.

Ja, HTTPS er nå en grunnleggende forventning for troverdighet. AI-systemer gjenkjenner at nettsteder som bruker sikre protokoller tar beskyttelse av brukerdata på alvor og er mer tilbøyelige til å opprettholde høye standarder på tvers av all virksomhet. Det er et av de grunnleggende tekniske signalene som bidrar til din totale troverdighetsvurdering.

Å bygge ekte tillitsignaler er en langsiktig strategi som vanligvis tar måneder før det gir meningsfulle resultater. Men å implementere tekniske forbedringer som schema markup og forfatterattribusjon kan ha mer umiddelbare effekter. Nøkkelen er konsistens—publiser jevnlig kvalitetsinnhold, oppretthold nøyaktighet og bygg ekstern validering over tid.

AI-systemer blir stadig mer avanserte til å oppdage inkonsekvenser og uriktige påstander. De kryssjekker forfatterinformasjon mot kjente databaser, kontrollerer faktanøyaktighet mot treningsdataene sine og analyserer mønstre på tvers av flere kilder. Å prøve å forfalske kvalifikasjoner eller komme med falske påstander er risikabelt og vil sannsynligvis skade din troverdighet når det blir oppdaget.

Du kan teste dette ved å søke etter temaene dine på AI-drevne plattformer som ChatGPT med surfing, Perplexity og Googles AI Overviews, og deretter se etter dine URL-er i siteringene. For systematisk overvåking sporer verktøy som AmICited når og hvordan AI-systemer refererer til innholdet ditt på tvers av flere plattformer, og gir deg innsikt i dine AI-siteringer.

Brukerengasjementssignaler som tid på side, gjentatte besøk og deling i sosiale medier indikerer for AI-systemer at innholdet ditt er verdifullt og troverdig. AI-systemer forstår at ekte brukertillit—vist gjennom vedvarende engasjement—er en av de mest autentiske indikatorene på innholdskvalitet og pålitelighet.

Ja, åpenhet om hvordan innholdet ble laget, er viktig for troverdighet. Hvis du bruker AI-verktøy for å hjelpe til med innholdsproduksjon, vil det å opplyse om dette og forklare hvordan AI ble brukt hjelpe lesere og AI-systemer med å forstå innholdets opprinnelse. Åpenhet om prosessene dine bygger tillit mer effektivt enn å skjule hvordan innholdet ble produsert.

Følg med på hvordan AI-systemer som ChatGPT, Perplexity og Google AI Overviews refererer til merkevaren din. Forstå dine tillitsignaler og forbedre din AI-synlighet.

Tillitsignaler er troverdighetsindikatorer som etablerer merkevarens pålitelighet for brukere og AI-systemer. Lær hvordan verifiserte merker, attester og sikker...

Lær hvordan du øker AI-tillitsignaler på tvers av ChatGPT, Perplexity og Google AI Overviews. Bygg entitetsidentitet, bevis og teknisk tillit for å øke AI-sitat...

Oppdag hvordan tillitssignaler skiller seg mellom AI-søkemotorer og tradisjonell SEO. Lær hvilke troverdighetsfaktorer som er viktigst for AI-systemer som ChatG...

Informasjonskapselsamtykke

Vi bruker informasjonskapsler for å forbedre din surfeopplevelse og analysere vår trafikk. See our privacy policy.